27.05.2026 à 13:13

Face aux chocs pétroliers, les biocarburants ne s’improvisent pas

Texte intégral (2401 mots)

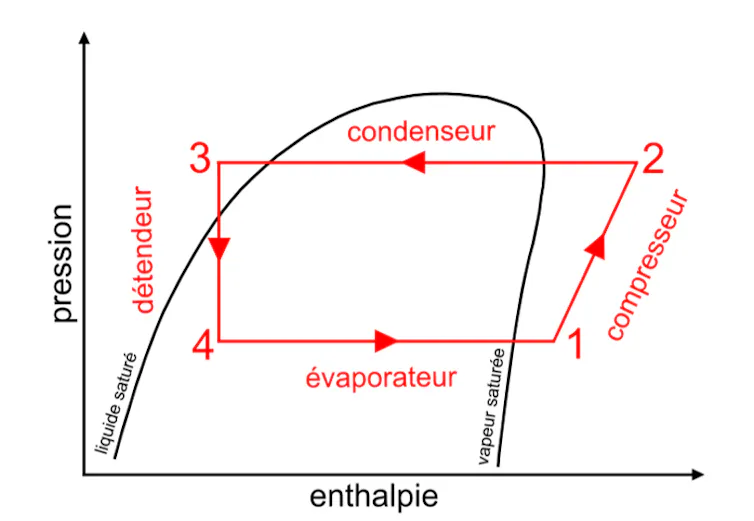

Face à la hausse des cours du pétrole, le salut viendra-t-il des biocarburants ? Aujourd’hui, les biocarburants les plus intéressants sont ceux de deuxième génération, qui s’appuient sur des sous-produits de l’agriculture et de l’industrie forestière, sans entrer en compétition avec l’alimentation. Mais dans des pays tropicaux, tels que la Malaisie ou l’Indonésie, la fragmentation des paysages et le taux d’humidité élevé des résidus font rapidement grimper la facture : de quoi affecter la compétitivité de cette alternative.

Les tensions pétrolières causées par la guerre en Iran ont fait remonter le cours du Brent à plus de 100 dollars (ou 85,88 euros) le baril début mars 2026. Depuis, les cours jouent au yoyo en fonction des espoirs diplomatiques. Les flux commerciaux sont en tout cas très loin d’avoir retrouvé leur niveau normal.

Dans ce contexte, les biocarburants – incorporant une part biosourcée, soit bioéthanol soit biodiesel – redeviennent plus visibles. À noter qu’aucun des biocarburants disponibles à la pompe n’est du bioéthanol ou du biodiesel « pur », ils sont toujours mélangés avec des carburants classiques. Ainsi, en France, en 2024, le gazole et l’essence consommés à la pompe comportaient au total environ 9 % d’énergie renouvelable biosourcée.

L’Indonésie et la Malaisie, qui souffrent particulièrement du blocage du détroit d’Ormuz pour leur approvisionnement en pétrole, ont récemment annoncé augmenter la teneur en huile de palme dans leurs biocarburants – au risque de faire grimper le cours de l’huile de palme et d’aggraver la déforestation.

Ces carburants actuels restent, pour l’essentiel, des biocarburants de première génération. Les biocarburants de deuxième génération, issus de résidus lignocellulosiques plutôt que de cultures en compétition avec l’alimentation, paraissent plus désirables. Mais à quelles conditions peuvent-ils être réellement compétitifs face aux carburants issus du pétrole ?

Encore faut-il regarder leurs coûts réels. Nous avons mené plusieurs études en Malaisie qui révèlent l’existence de plusieurs coûts cachés en lien avec la fragmentation du territoire, mais également avec le climat tropical, qui impose de transporter de la matière encore humide, faute de pouvoir la laisser sécher sur place.

Différentes générations de biocarburants

Commençons par rappeler ce qu’on entend par biocarburant de première, deuxième ou troisième génération.

Les biocarburants de première génération utilisent des matières premières agricoles qui entrent en concurrence avec l’alimentation, par exemple les bioéthanols de betterave, de colza, de maïs ou de blé, ou encore les biodiesels de colza, de soja, ou d’huile de palme.

Les carburants de deuxième génération, pour leur part, ne sont pas en compétition avec l’alimentation. Ils sont au contraire du recyclage de résidus agricoles ou forestiers, donc essentiellement de la cellulose (pailles, pellets, etc.), ou des huiles de cuisson « usagées » issues de la restauration.

Ceux de troisième génération (comme les cultures de microalgues), enfin, promettent de s’affranchir de ces limites car elles ne mobilisent pas de surfaces agricoles ou forestières comme les deux premières, mais restent pour l’heure moins stabilisées aux plans technologique et économique.

Dans l’état actuel, les deux premières générations sont les seules réellement maîtrisées à l’échelle industrielle. Le débat porte donc, pour le moment, sur les conditions concrètes de réussite des biocarburants de deuxième génération.

À lire aussi : Carburants de synthèse, biocarburants, kérosène vert… De quoi parle-t-on exactement ?

Premier coût caché la biomasse de deuxième génération : la fragmentation du territoire

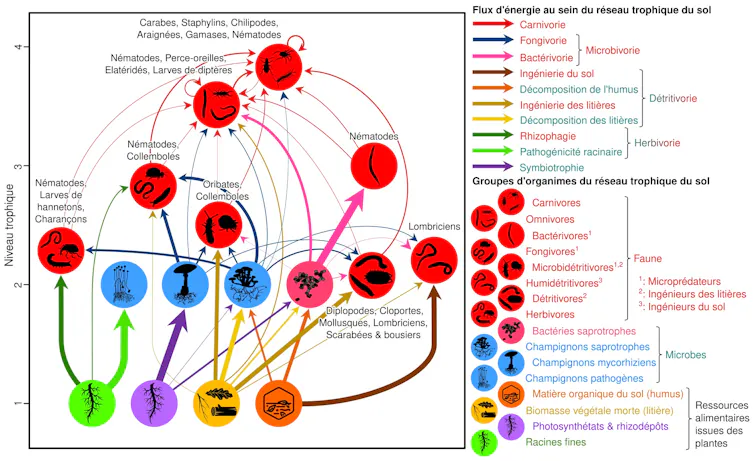

La biomasse n’est pas une ressource concentrée. Elle est, pour l’essentiel, répartie dans l’espace, dans des champs et des forêts plus ou moins morcelés. Or, plus une telle ressource est dispersée sur le territoire en petites unités, plus son coût de collecte augmente.

Nos travaux menés en Malaisie montrent que le coût d’approvisionnement augmente à chaque fois que la fragmentation spatiale augmente. Pour un million de tonnes de biomasse effectivement disponible, cela représente plus de 4 dollars (soit 3,44 euros) par tonne par unité supplémentaire de fragmentation spatiale. À titre d’exemple, cette fragmentation spatiale a été évaluée à environ 3,3 dollars pour les déchets forestiers – et même à plus de 6 dollars pour certains déchets de palmiers – contre environ 0,3 dollar pour les scieries productrices de contre-plaqué.

Le reste de la logistique joue tout autant. En effet, le coût d’approvisionnement augmente de plus de 6 dollars (soit 5,15 euros) en moyenne par tonne par tranche de 100 kilomètres de transport. Et l’impact de la taille du camion est tout aussi critique : passer d’un petit camion d’une tonne à un 26 tonnes peut réduire le coût d’environ 84 dollars (plus de 72 euros) par tonne.

Ceci a plusieurs implications importantes. Une biomasse apparemment abondante sur un territoire donné peut être non compétitive si elle est trop morcelée. Inversement, une ressource moins abondante mais davantage concentrée peut devenir plus intéressante au plan industriel.

Cette règle est particulièrement importante en Indonésie et en Malaisie, où les mosaïques tropicales de plantations, forêts, routes et petites unités industrielles n’ont rien à voir avec des territoires plus homogènes que l’on retrouve par exemple dans certaines régions agricoles en Europe et aux États-Unis.

À lire aussi : Forêts et plantations de palmiers à huile peuvent-elles vraiment coexister ? Des résultats prometteurs en provenance de Bornéo

La teneur en eau, un deuxième coût caché

Ce n’est pas tout. Tous les résidus de biomasse végétale contiennent une part plus ou moins grande d’eau.

Or, transporter de l’eau dans la biomasse, c’est consommer davantage de carburant pour déplacer une masse qui ne produira pas d’énergie utile.

D’autres parmi nos travaux montrent qu’en Malaisie, à disponibilité comparable, la paille de riz reste bien plus compétitive que les frondes de palmier, du fait de leur teneur élevée en humidité.

Tous ces facteurs contribuent à faire augmenter le coût de production des biocarburants :

Quand seule la fragmentation spatiale de la ressource augmente, le coût optimal du biocarburant augmente de 17 %.

Quand seule l’humidité augmente, il grimpe de 42 %.

Quand humidité et fragmentation se cumulent, le coût augmente de 69 %. Dans le même temps, la capacité optimale de l’usine de bioraffinerie qui traite ces résidus chute de 36 %.

Sous les tropiques humides, la différence entre matière sèche et matière humide est donc un déterminant majeur pour les coûts. Ce point vaut aussi pour les stratégies combinant plusieurs types de biomasses : mélanger plusieurs résidus n’améliore pas automatiquement la compétitivité. En effet, tout dépend de ce que le mélange fait à l’humidité moyenne.

Nos travaux montrent qu’un approvisionnement industriel de résidus de régimes vides de fruits (EFB) (le nom que l’on donne au sous-produit végétal obtenu après collecte des fruits), à 60 % d’humidité, peut être 31 % moins rentable qu’un approvisionnement combinant à la fois des EFB et des fibres de fruits pressés (sous-produit fibreux obtenu après extraction de l’huile de palme par pressage), dont l’humidité moyenne est de 48 %.

Un approvisionnement mixte peut donc être une excellente stratégie… à condition d’éviter tout mélange qui ajouterait de l’eau à transporter, et annulerait l’avantage attendu.

L’usine optimale n’est pas toujours la plus grande

Il existe enfin un troisième coût caché, lié aux économies d’échelle que l’on imaginerait faire en centralisant le traitement des résidus de biomasse. Il existe, en effet, un concept industriel qui remonte à l’invention du fordisme : plus l’usine est grande, plus l’économie d’échelle est forte. C’est vrai en théorie, mais dans la pratique, cela se vérifie ou non selon les cas.

Concernant les biocarburants, cette règle se heurte rapidement à la géographie réelle des ressources. Plus l’usine est grande, plus il faut aller chercher loin des biomasses plus ou moins humides, fragmentées, potentiellement difficiles d’accès ou coûteuses à prétraiter. Les gains d’échelle en termes de procédés pour la raffinerie peuvent alors être effacés par les coûts amont. C’est pourquoi toutes les biomasses sont d’intérêt variable, selon le contexte.

Dans le cas de la Malaisie et de l’Indonésie, la voie de fermentation de seconde génération est la plus compétitive, avec la paille de riz et la fibre de fruits pressés. À l’inverse, les troncs de palmier et certains résidus d’hévéaculture n’y sont sont pas rentables pour de la bioraffinerie.

Mais dans d’autres endroits, la situation pourra être opposée. La stratégie industrielle ne doit donc pas reposer sur des économies d’échelles maximum, mais sur l’ajustement de la capacité industrielle à la matière réelle disponible sur le terrain, à son humidité, à sa dispersion et à son accès.

Du sur-mesure, plutôt que du prêt à l’emploi

Les biocarburants sont, en général, une excellente solution à l’instabilité des cours du pétrole. Mais ils ne sont pas performants par simple abondance de biomasse. Ils exigent un travail fin d’ingénierie : séchage, points de prétraitement, points de collecte et de regroupement, choix des mélanges, logistique, adaptation de la taille des usines…

Les schémas imaginés pour les grandes plaines homogènes du Midwest américain, où la production d’éthanol est concentrée dans la Corn Belt, ou pour certains contextes agricoles centrés sur le colza ou la betterave en Europe, ne se transfèreront pas tels quels dans les pays tropicaux. En particulier en Asie du Sud-Est, où l’humidité, la fragmentation et les contraintes locales changent toute l’équation.

Les biocarburants ne sauraient se réduire à un simple substitut au pétrole, où l’on déclinerait la même solution partout. Ce sont des solutions régionales, qui ne peuvent fonctionner qu’à condition d’être conçues région par région.

Cet article a été décliné sous forme de chronique radio dans l'émission Le Club de C'est pas du vent, diffusée sur RFI le 27 mai 2026 et disponible sous forme de podcast.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

26.05.2026 à 16:32

Refuges thermiques en rivière : quand les eaux souterraines sauvent les poissons de la surchauffe

Texte intégral (3130 mots)

Appréciés des poissons et bien connus des pêcheurs, les refuges thermiques en rivière sont précieux pour la faune aquatique, mais potentiellement menacés par le changement climatique. Dans une étude sur trois d’entre eux dans le bassin du Rhône, le Bureau de recherches géologiques et minières, ou BRGM, et ses partenaires se sont intéressés au rôle des sources d’eaux souterraines dans la régulation de la température des cours d’eau.

Les canicules touchent également durement la faune, et notamment les habitants de nos rivières. Lors de ces épisodes estivaux, la température de l’air augmente inexorablement ainsi que la température de surface des cours d’eau. La chaleur s’accumule et réchauffe progressivement l’eau des rivières. Comme nous, la faune aquatique tolère une certaine variation de température de son milieu ambiant, mais seulement jusqu’à une certaine limite. Au-delà, trouver une zone moins chaude pour s’y abriter devient une condition de survie. On nomme ainsi « refuge thermique » un tronçon de rivière dans lequel la température de l’eau est sensiblement plus froide l’été, ce qui permet à la faune de s’y abriter pour survivre et se reproduire.

Bien connus des pêcheurs, les refuges thermiques résultent souvent de caractéristiques hydrographiques visibles : présence de végétation en bordure de rivière leur fournissant de l’ombre, encaissement du cours d’eau dans des gorges, ce qui les protège du rayonnement solaire ou encore une confluence avec un affluent plus froid, en provenance de la montagne. Toutefois, un grand nombre de refuges thermiques ont une origine invisible : les eaux souterraines.

En été, après des jours ou des semaines sans pluie, l’eau des cours d’eau provient essentiellement des nappes d’eau souterraine, dont la vidange est lente et assure ainsi le débit d’étiage vital pour nos cours d’eau. Cette eau, d’origine profonde, est à l’abri du réchauffement au cours de l’été et affiche généralement une température constante tout au long de l’année. Le long de la rivière, les arrivées ponctuelles d’eau souterraine contribuent ainsi à refroidir durant l’été (et à réchauffer durant l’hiver) l’eau des rivières, constituant ce que les hydrologues appellent une « anomalie thermique ». Si celle-ci attire la faune aquatique, elle devient, pour les écologues, un refuge thermique.

L’eau de nos rivières s’est réchauffée de près de 1 °C au cours de la période 2009-2022. Elle devrait continuer à se réchauffer sous l’impact du changement climatique, notamment en été, contrecoup de la baisse des débits d’étiage. Dans ce contexte, les anomalies thermiques pourront-elles continuer à jouer leur rôle de refuge ? Quel serait l’impact d’un réchauffement de l’eau souterraine sur ce mécanisme ?

À lire aussi : Peut-on encore éviter la disparition du saumon sauvage en France ?

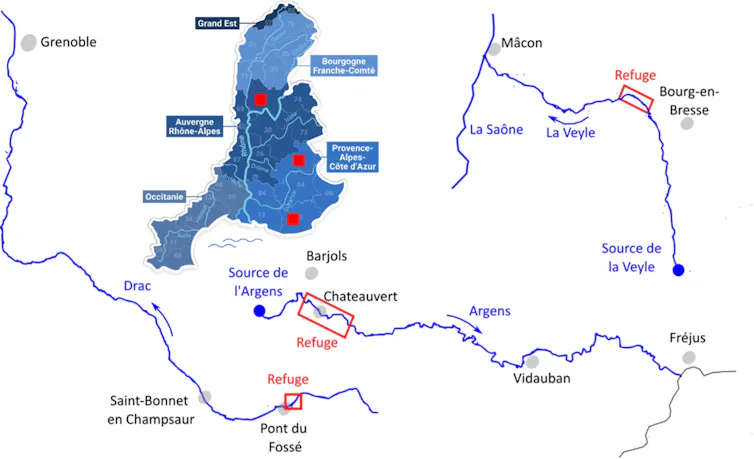

Trois refuges thermiques étudiés dans le bassin du Rhône

Le Bureau de recherches géologiques et minières (BRGM), service géologique national, étudie le sous-sol et les eaux souterraines qu’il contient. Dans le cadre du projet ESTHER, mené en collaboration avec l’Agence de l’eau Rhône Méditerranée et Corse, un programme d’observation et de modélisation des refuges thermiques dépendants des eaux souterraines a été mené.

Cette recherche a permis la surveillance de trois refuges thermiques situés dans le bassin du Rhône :

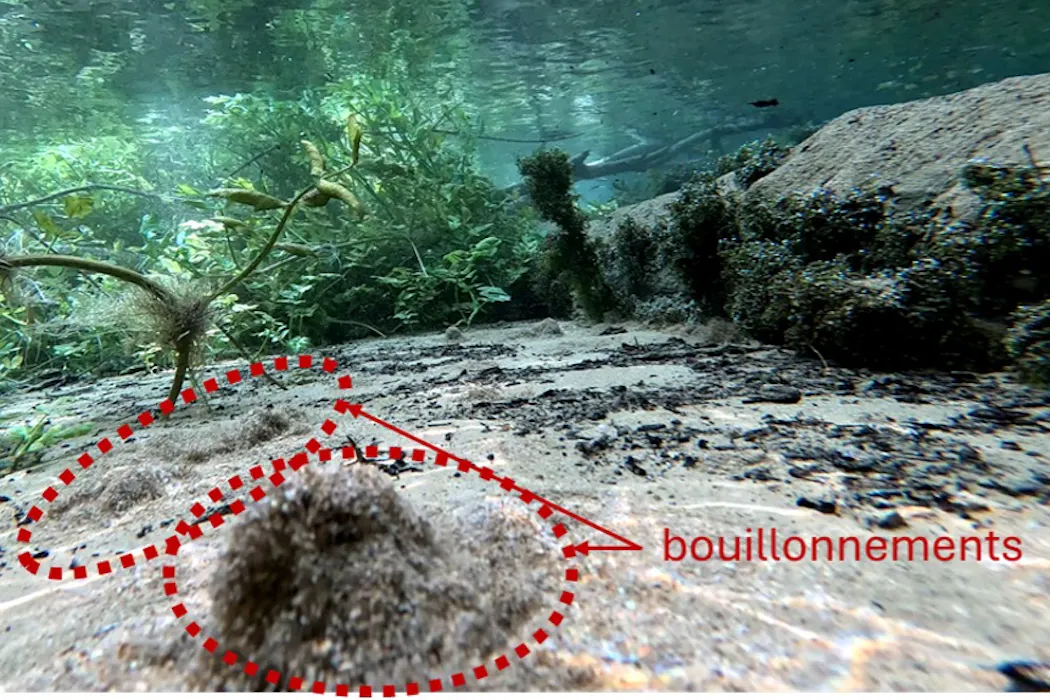

en Provence verte, le fleuve Argens traverse des roches calcaires aquifères dont l’eau souterraine se déverse ponctuellement dans le cours d’eau via des sources appelées « bouillidous » ;

le Drac, rivière montagnarde au régime influencé par la fonte des neiges, issue du massif des Écrins, interagit avec sa nappe d’accompagnement dans un tronçon alimenté par l’adoux des Foulons, d’origine souterraine ;

la Veyle, rivière des Dombes, traverse un aquifère qui l’alimente tout au long de son cours ainsi que ses affluents, l’Iragnon et l’Être, dont les origines sont des sources drainant l’aquifère local.

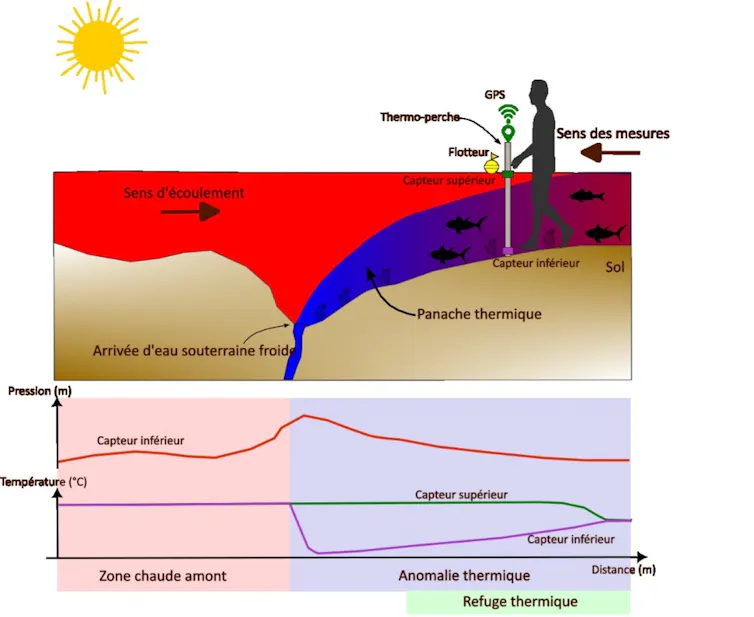

Nous avons observé chacun de ces trois sites de façon minutieuse avec des capteurs autonomes qui mesurent à pas de temps fin (toutes les trente minutes) les variations horaires, journalières et saisonnières de la température de l’eau. Disposés à des endroits clés du tronçon de rivière étudié, ces instruments ont été utilisés pour analyser les modifications de température provoquées par les arrivées d’eau souterraine.

Une station météorologique a également été installée sur chacun des sites pour identifier les épisodes de pluies et de fortes chaleurs. En effet, la température de l’air est une variable fondamentale pour comprendre les interactions thermiques entre une rivière et l’atmosphère. Des mesures de débit, enfin, nous ont permis de déterminer l’effet des crues : plus le débit est élevé, plus la rivière est capable de résister aux augmentations des températures de l’air.

Mais l’eau souterraine est capricieuse : elle reste discrète, souvent invisible et cachée dans les profondeurs de la rivière. Pour compléter les mesures mentionnées précédemment, il restait donc à repérer les sources souterraines pour quantifier leur effet.

À la recherche des sources souterraines

Pour cela, il a fallu faire preuve d’inventivité… et de courage : il a fallu remonter à pied la rivière avec un dispositif de mesures conçu spécialement pour cette étude.

Il s’agit d’une thermo-perche à laquelle ont été attachés deux capteurs de température : la sonde inférieure est fixée au pied de la perche, tandis que la sonde supérieure est fixée sur un flotteur lui permettant de coulisser le long de la perche.

L’opérateur tient verticalement le dispositif et le déplace sur le fond du lit de la rivière, d’aval en amont, sur la longueur d’investigation souhaitée. En plus de la température, les capteurs mesurent également la conductivité électrique de l’eau et la pression.

Il ne reste alors plus qu’à remonter le cours d’eau avec la thermo-perche pour identifier les écarts de températures entre les deux sondes. Ces derniers sont indicateurs d’une stratification de la température provoquée par une arrivée d’eau souterraine profonde dans le lit du cours d’eau.

Toutes les données collectées par les différents appareils de mesure sont ensuite analysées pour mieux comprendre comment les eaux souterraines influencent la température des rivières étudiées. Elles permettent d’estimer l’importance de l’anomalie thermique et de suivre son évolution au fil des saisons et selon les débits mesurés. Cela renseigne sur la taille du refuge thermique disponible pour la faune aquatique.

Une observation s’impose déjà : quand les eaux souterraines arrivent en quantité suffisante par rapport au débit du cours d’eau, elles agissent comme un « régulateur naturel » des variations de températures. La rivière garde alors une température plus stable, sur une distance pouvant aller jusqu’à plusieurs kilomètres, ni trop chaude en été ni trop froide en hiver, créant ainsi un environnement idéal pour la faune aquatique.

Ceci est mis en évidence par l’évolution de plusieurs indicateurs thermiques, modifiés par les apports d’eau souterraine ; par exemple, le nombre de jours par an pendant lesquels la température de l’eau est supérieure à 20 °C, température considérée par les écologues comme un seuil biologique important pour de nombreuses espèces aquatiques.

Des modélisations numériques pour préserver les refuges thermiques

Ces résultats sont également précieux pour calibrer et ajuster les modèles numériques développés pour la deuxième phase du programme ESTHER. En effet, pour anticiper les impacts du changement climatique sur les températures des rivières et, plus précisément, sur le fonctionnement des refuges thermiques dépendants des eaux souterraines, nous mettons en œuvre des approches de modélisation numérique.

Cette méthodologie permet de relier explicitement climat, hydrologie, hydrogéologie et échanges de chaleur entre l’atmosphère, les eaux souterraines et les cours d’eau pour explorer la manière dont la température des rivières évoluera selon différents scénarios de changement climatique, à l’échelle d’un tronçon de rivière ou d’un refuge thermique donné.

Qu’entend-on par modélisation ? Il s’agit, dans ce contexte, de représenter le système atmosphère/eau souterraine/cours d’eau par un ensemble d’équations (bilan d’énergie, bilan de masse, forces hydrauliques…), résolues numériquement dans le temps et l’espace. Les données issues des modèles climatiques globaux ou régionaux (par exemple, évolution des température de l’air, des précipitations, du rayonnement solaire, du vent, etc.) sont ensuite réintégrées dans ces équations. Il en résulte des modèles permettant de prévoir l’évolution future des débits et des températures de l’eau de la rivière étudiée.

Une fois bien calibrés, nous pourrons utiliser ces modèles pour tester des solutions d’adaptation au changement climatique, comme le développement ou la densification de la ripisylve (espèces végétales en bordure des cours d’eau) en aval d’une venue souterraine. De quoi protéger le refuge des rayons du soleil et prolonger son influence en aval. Il sera probablement crucial de préserver le débit des arrivées d’eau souterraine en réduisant les pompages dans les aquifères dont elles proviennent.

De même, ces modèles permettront de quantifier les impacts sur la température de l’eau des aménagements destinés à améliorer l’état quantitatif et qualitatif des cours d’eau. Ainsi, l’intérêt des opérations de suppression des seuils hydrauliques, de renaturation, de reméandrage et d’autres aménagements pourra être évalué au regard de leur impact éventuel sur un refuge thermique. De quoi fournir aux gestionnaires une évaluation de la vulnérabilité des refuges thermiques et les aider à identifier des moyens de la réduire.

Nous remercions l’Agence de l’eau Rhône Méditerranée Corse pour son soutien et sa participation au programme ESTHER et, plus particulièrement, Julie Jeanpert et Benoît Terrier, ainsi que la Maison régionale de l’eau, le syndicat mixte de l’Argens, le syndicat mixte Veyle vivante, le syndicat de rivière du Drac amont et de ses affluents (Communauté locale de l’eau du Drac amont, ou Cleda) et le Conseil départemental des Hautes-Alpes.

Jean-Christophe Maréchal a reçu des financements de l'AERMC

Adrien Selles a reçu des financements de l'Agence de l'Eau Rhône Méditerranée Corse

Yvan Caballero ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

26.05.2026 à 16:27

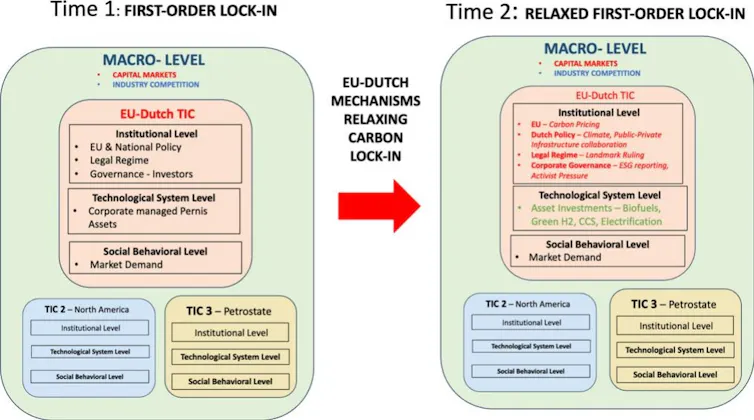

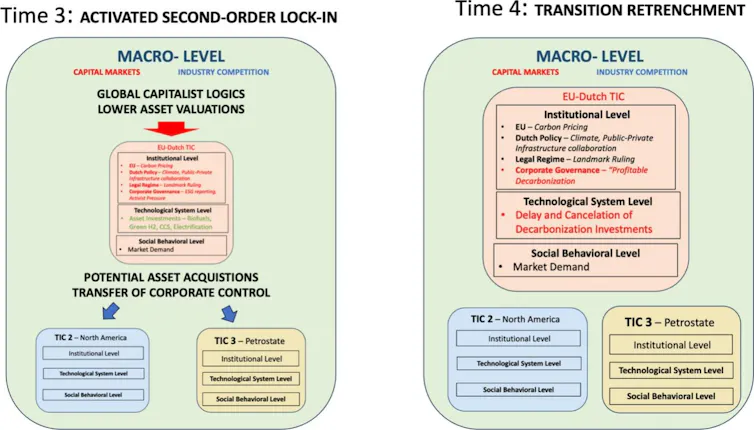

Transition écologique locale : quatre conditions pour passer de l’ambition à l’action

Texte intégral (2764 mots)

Une enquête menée à Lyon, dans le Rhône, et Grenoble, dans l’Isère, montre qu‘il ne suffit pas qu'un exécutif avec une ambition écologiste arrive au pouvoir pour insuffler des actions publiques de transition écologique. Il faut pour cela repenser aussi l’organisation des services administratifs.

Cela ressemble aux douze travaux d’Hercule. À l’heure du changement climatique, les collectivités locales doivent renforcer la résilience de leur territoire, engager des transformations de long terme, répondre aux attentes des habitants, tout en composant avec les tensions énergétiques, les contraintes budgétaires et en coopérant avec des partenaires encore inégalement formés aux risques climatiques.

Face à toutes ces nécessités, comment transformer une ambition politique de transition écologique en action publique locale ?

Pour répondre à cette question, nous avons mené une recherche sur Grenoble (Isère) et Lyon (Rhône), deux territoires où des exécutifs écologistes sont arrivés au pouvoir à des moments différents : en 2014 à Grenoble et en 2020 à Lyon. Notre enquête repose sur 56 entretiens avec des cadres de la fonction publique territoriale : directeurs généraux, directeurs opérationnels, chargés de mission ; et des élus. L’analyse s’appuie également sur 86 documents institutionnels.

Notre étude montre que la transition écologique locale ne dépend pas seulement de la volonté politique. Elle suppose aussi des capacités administratives concrètes. Quatre conditions apparaissent alors décisives : mesurer les vulnérabilités, transformer l’organisation interne, rendre les arbitrages écologiques acceptables et apprendre à gouverner dans l’incertitude.

VILLE ET MÉTROPOLE, QUI FAIT QUOI ?

- La ville agit à l’échelle de proximité : écoles, équipements publics, espaces publics, participation citoyenne, action sociale locale.

- La métropole détient des compétences structurantes pour la transition : urbanisme, mobilités, eau, déchets, énergie, habitat, développement économique.

- Tandis que la métropole dispose souvent des leviers techniques et réglementaires, la ville joue un rôle central dans l’appropriation des politiques par les habitants et leur acceptabilité sociale. Une transition locale efficace suppose donc de coordonner les instruments métropolitains avec la proximité municipale.

Mesurer les vulnérabilités pour mieux agir

La première condition consiste à mieux saisir les vulnérabilités territoriales, car les collectivités ne font pas face à une seule crise, mais à une accumulation de risques : canicules, sécheresses, inondations, tensions énergétiques, difficultés d’accès au logement, contraintes financières ou encore fragilités sociales.

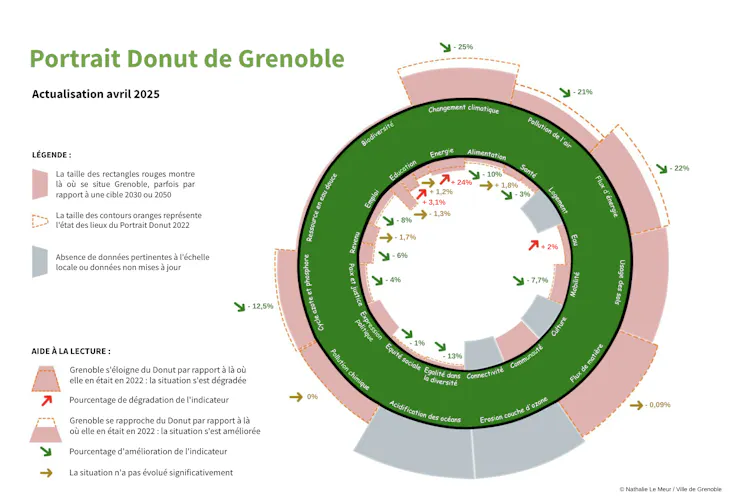

Dans ce contexte, la Ville de Grenoble s’est dotée du Donut territorial, un outil de diagnostic territorial pensé par l’économiste Kate Raworth permettant de croiser les dimensions sociales et environnementales de la transition. À Grenoble, la situation de cuvette alpine rend particulièrement visibles les liens entre pollution de l’air, santé et mobilités, tandis que les canicules obligent à penser ensemble logement, végétalisation des espaces publics et protection des populations les plus vulnérables. Selon la chargée de mission qui le pilote, l’outil permet ainsi de « dépasser le cloisonnement classique des collectivités en silos et à faire parler les différents services entre eux ».

De son côté, la Métropole du Grand Lyon cherche à mesurer les effets de ses dépenses publiques sur la transition écologique. Elle a pour cela misé sur une budgétisation par impact qui ne consiste pas seulement à classer les lignes budgétaires comme « vertes » ou non. Elle vise à analyser les projets dans leur ensemble. Comme l’explique la cheffe de projet de budgétisation :

« Une piste cyclable peut être très négative si elle traverse des corridors protégés et s’il n’y a personne dessus. »

L’enjeu n’est donc pas de juger une dépense à partir de son intitulé, mais d’évaluer ses effets concrets sur le territoire, les usages et les objectifs environnementaux de la collectivité.

Ces outils ne sont pas seulement techniques. Ils changent la manière dont l’administration regarde le territoire, hiérarchise ses priorités et arbitre entre différents objectifs de transition.

Transformer l’organisation interne

La deuxième condition est organisationnelle. La transition écologique ne peut pas être portée uniquement par quelques élus ou par une direction spécialisée. Elle suppose une transformation plus large de l’administration.

À Grenoble Alpes Métropole, le rattachement de la direction climat à la direction générale répond à un problème identifié par le directeur général des services, qui est au sommet de la hiérarchie administrative :

« Les équipes chargées du climat pouvaient être perdues dans un coin et manquer de vision transversale. »

Cette acculturation passe aussi par la formation de l’ensemble des agents à la Fresque du climat, un atelier collectif de sensibilisation aux causes et aux effets du changement climatique.

Mais l’enjeu n’est pas seulement de sensibiliser. En complétant la Fresque du climat par des dispositifs comme 2tonnes, un atelier de simulation de trajectoires bas carbone, ou Nos vies bas carbone, centré sur les ordres de grandeur de l’empreinte carbone et les leviers d’action du quotidien, la métropole cherche à transformer la sensibilisation en capacité d’agir. Pour le directeur général des services, il s’agit de « libérer la capacité de proposition des agents ». Certaines équipes sociales ont ainsi proposé, à la suite de ces ateliers, d’accompagner les quartiers populaires sur la transition alimentaire et les changements de consommation.

À Lyon, la dynamique est plus récente. La Ville s’appuie sur un projet d’administration participatif visant à mieux articuler transition écologique, sociale et démocratique. L’organigramme a aussi été revu pour encourager davantage de coopération entre directions. Cette transformation ne va toutefois pas de soi.

Comme l’explique un chargé de mission :

« C’est vraiment un choc culturel important, parce qu’il faut concilier des temps de travail classiques avec des ateliers où l’on assume clairement d’être dans la co-construction, avec des méthodes parfois bouleversantes et frustrantes. »

La transition écologique transforme donc aussi les manières de travailler, de décider et de coopérer au sein de l’administration.

Ce point est essentiel : une collectivité peut porter une ambition forte, mais si son organisation interne ne suit pas, la transition reste difficile à mettre en œuvre.

Rendre les arbitrages écologiques acceptables

La troisième condition concerne les conflits produits par les politiques de transition. Les objectifs environnementaux sont souvent partagés en principe, mais leur mise en œuvre locale peut générer des tensions importantes, notamment lorsqu’elle touche au foncier, aux mobilités ou aux activités économiques.

Le zéro artificialisation nette (ZAN) en est un exemple. Limiter l’urbanisation permet de préserver les sols et de réduire l’étalement urbain, mais cette politique modifie aussi la valeur du foncier et les perspectives de développement des communes. Un directeur de l’aménagement résume ainsi cette tension :

« Il y a des antagonismes très forts et très compréhensibles, parce que quand on retire une zone à construire, on fait perdre dix fois ou vingt fois la valeur à un terrain. »

Les zones à faibles émissions (ZFE) ont produit des tensions comparables. Si elles visent à améliorer la qualité de l’air, elles affectent aussi directement les conditions de déplacement des habitants, des commerçants et des professionnels. À Grenoble Alpes Métropole, une concertation volontaire avait été engagée à l’automne 2022 pour alimenter la décision publique sur plusieurs points sensibles : dérogations périmètre, horaires d’application.

Elle a combiné plate-forme participative, réunions publiques, rencontres sur l’espace public, questionnaire en ligne et ateliers citoyens. Mais, ce travail local d’explication et d’ajustement a été fragilisé par l’instabilité des décisions nationales, jusqu’au vote du projet de loi de simplification dans une version prévoyant la suppression des ZFE en avril 2026.

Cette séquence souligne une fragilité démocratique : les métropoles portent des mesures sensibles pour la transition, mais leur cadre reste largement fixé par l’État, leur mise en œuvre dépend des communes et leur rôle demeure souvent peu lisible pour les citoyens.

Se préparer à des crises plus fréquentes

La quatrième condition est la capacité des collectivités locales à apprendre des crises et à s’y préparer, dans un environnement marqué par leur intensification.

À Grenoble, la prise de conscience d’un environnement plus difficile à anticiper a conduit la Ville à former ses managers à la complexité et à structurer une stratégie de résilience. En recensant 53 risques, ce diagnostic permet de prioriser ceux qui pourraient le plus affecter les habitants et la continuité des services publics. La stratégie débouche notamment sur des actions concrètes : prioriser le plan de lutte cyber, identifier les missions essentielles à maintenir en cas de crise et recenser les agents mobilisables en urgence. Un directeur général adjoint explique que le fait de « savoir manager en zone de turbulence a rendu très fluide le passage en mode crise lors de la pandémie, face aux canicules, à la sécheresse ou à la crise énergétique ».

Un laboratoire inter-administrations, créé en 2019, permet aussi à plusieurs acteurs publics locaux de préparer les politiques publiques de demain. Il mobilise par exemple le Rapport annuel sur les risques et la résilience comme outil de prospective locale pour partager les vulnérabilités du territoire et identifier les ressources nécessaires à leur adaptation. Cette préparation s’ouvre également aux habitants. La Ville expérimente par exemple des formats plus accessibles, comme un serious game lors de la Journée de la résilience, pour rendre les risques moins abstraits et les relier à des situations concrètes du quotidien : que faire en cas de canicule, de coupure d’électricité, d’inondation ou d’évacuation ?

À la Métropole Grand Lyon, cette logique apparaît davantage en construction. L’ancienne directrice générale des services expliquait :

« Il n’y a pas eu nécessairement un grand document cadre sur lequel la métropole questionne la résilience […] La volonté de l’exécutif a été de privilégier l’action et d’y aller brique par brique. »

Cette approche s’est traduite par des chantiers sectoriels, comme la reprise en régie publique de l’eau, actée dès décembre 2020, afin de renforcer la maîtrise d’une ressource essentielle, ou encore par des actions sur l’alimentation, la réduction de la pollution, l’énergie et l’aménagement. Comme l’explique ce directeur général adjoint, les priorités sont de « prévenir les risques, limiter les impacts des pollutions diverses et mieux protéger nos différentes ressources ».

À la Ville, il n’existe pas non plus de stratégie globale des risques, mais de nouveaux dispositifs émergent. Cette préparation repose à la fois sur des cadres d’accélération, comme la Mission européenne « Cent villes climatiquement neutres » qui a notamment conduit à créer une Agora Lyon 2030.

Ce dispositif marque un changement : plutôt que de travailler secteur par secteur, la Ville réunit des acteurs variés du territoire autour d’une feuille de route commune et d’engagements propres à chaque structure sur la thématique du climat. Le Club transitions et résilience s’inscrit dans cette logique en favorisant les échanges d’expériences et la diffusion de pratiques entre acteurs du territoire.

La préparation aux crises ne repose donc pas seulement sur des plans : elle suppose aussi des espaces d’apprentissage où administrations, partenaires publics et acteurs du territoire apprennent à anticiper ensemble.

Que retenir ?

Grenoble et Lyon montrent ainsi que la transition écologique locale ne repose pas uniquement sur des annonces ou des objectifs stratégiques. Elle dépend aussi de la capacité des collectivités à construire des outils de pilotage, à transformer l’organisation, à gérer les conflits d’usage et à préparer les crises futures.

L’exemple de Grenoble et Lyon invite enfin à prendre au sérieux le temps long des transitions locales. À Grenoble, le second mandat écologiste a permis de stabiliser certains dispositifs et d’intégrer davantage les enjeux climatiques dans l’administration.

À Lyon, le premier mandat correspondait plutôt à une phase de lancement et d’expérimentation. Autrement dit, un premier mandat peut ouvrir les chantiers de la transition ; un second peut permettre de les institutionnaliser dans les routines administratives, les outils de pilotage et les pratiques professionnelles.

Gillian ORIOL ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

25.05.2026 à 18:16

Ce que nous dit la pensée d’Ivan Illich de l’intérêt du vélo

Texte intégral (2331 mots)

Le philosophe Ivan Illich est né il y a un siècle. En cette année anniversaire, plusieurs manifestations sont prévues pour commémorer son apport à la pensée critique de la société industrielle et, notamment du 27 au 29 mai 2026 à Paris. L’occasion de revenir sur ses analyses, qui restent d’actualité, pour comprendre en particulier l’intérêt du vélo.

Il y a cent ans naissait à Vienne, en Autriche, Ivan Illich (1926-2002), qui devint un penseur critique et très stimulant de la société industrielle. En pleine période de contestation post Mai-68, il publie coup sur coup plusieurs ouvrages qui l’ont rendu mondialement célèbre : Une société sans école (1971), la Convivialité (1973), Énergie et Équité (1975) et Némésis médicale (1975).

Il y formulait une critique des institutions majeures telles que l’école, l’Église, les transports ou la médecine. Ce polyglotte amendait lui-même les traductions réalisées dans de nombreuses langues. Dans les années 1980-1990, Illich poursuit son œuvre en refusant toute médiatisation et devient professeur itinérant, avant de finir sa vie en Allemagne, à Brême.

Parmi ses nombreux raisonnements, l’un, énoncé dans Énergie et Équité, est bien connu des militants travaillant sur le plaidoyer du vélo.

Qu’est-ce que la vitesse généralisée ?

Dans cet ouvrage, Illich écrit :

« L’Américain moyen consacre plus de mille six cents heures par an à sa voiture. Il y est assis, qu’elle soit en marche ou à l’arrêt ; il la gare ou cherche à le faire ; il travaille pour payer le premier versement comptant ou les traites mensuelles, l’essence, les péages, l’assurance, les impôts et les contraventions. […] Tout cela pour parcourir 10 000 km par an ; cela représente à peine 6 km à l’heure. »

Bref, en tenant compte non seulement du temps de transport, mais aussi du temps de travail nécessaire pour payer le transport, la vitesse de l’automobiliste apparaît inférieure à celle du cycliste. Un résultat souvent qualifié de « stupéfiant ». Cette vitesse intégrant le temps de travail pour payer le transport est appelée « vitesse généralisée » ou encore « vitesse économique » (en anglais effective speed.

C’est initialement Jean-Pierre Dupuy, ingénieur X-Mines, devenu philosophe de grand renom et travaillant avec Illich, qui a proposé ce raisonnement. Dans l’annexe de la version française d’Énergie et Équité, il réalise précisément ce calcul pour la France, en utilisant les statistiques de 1967 (les dernières disponibles alors) et en retenant trois catégories de véhicule et quatre niveaux de revenus. Il constate en effet que la vitesse généralisée de l’automobile est en général inférieure à celle de la bicyclette et conclut :

« Loin d’être un instrument de gain de temps, l’automobile apparaît sous cet éclairage comme un monstre chronophage. »

Un raisonnement à revoir

Malheureusement, ce résultat n’est plus vrai aujourd’hui ! Les données utilisées par Jean-Pierre Dupuy dans ses calculs ont profondément évolué en presque 60 ans.

Pour le comprendre, il faut d’abord formaliser les calculs. La vitesse généralisée (Vg), avons-nous montré, dépend de la vitesse moyenne (v), du coût kilométrique (k) et du salaire horaire (w), selon la formule : Vg = 1/[(1/v) + (k/w)].

Ainsi, en soixante ans, la vitesse moyenne des déplacements en voiture, y compris interurbains, a augmenté de 33 %, passant de 30 à 40 km/h. Malgré le suréquipement des voitures actuelles et grâce aux efforts de productivité de l’industrie automobile, le coût kilométrique de la voiture moyenne n’a augmenté que de 40 %. En revanche, le taux de salaire horaire a bondi de 150 %. On en déduit que la vitesse généralisée de la voiture a augmenté de plus de 50 %.

Quant à celle du vélo, elle n’a augmenté que de 10 % tout au plus : pour acheter un vélo, la part du temps passé à travailler est en effet bien plus faible que pour acheter une voiture. Au total, la vitesse généralisée de la voiture (environ 23 km/h) est devenue bien supérieure à celle du vélo (environ 14 km/h).

Certes, si on se replie sur les seuls déplacements urbains, on peut sauver le résultat d’Illich-Dupuy. Mais tout cycliste sait déjà qu’il se déplace souvent plus vite à vélo qu’en voiture en zone dense et le raisonnement n’a plus rien de stupéfiant.

Des nuisances de la vitesse

Il est cependant possible d’améliorer le raisonnement de nos deux auteurs, en analysant finement ce qu’apporte la vitesse.

Pour desserrer les villes d’autrefois très denses où tout se faisait à pied et où la promiscuité et l’insalubrité régnaient, il était nécessaire d’augmenter la vitesse des déplacements. Mais jusqu’où et avec quels modes ? C’est là qu’il est important de remarquer que toutes les nuisances de l’automobile s’accroissent de façon exponentielle au-delà de 30 km/h.

Les accidents deviennent mortels pour les piétons et les cyclistes percutés. Le bruit du moteur est dominé dès 40 km/h par le bruit de roulement, qui lui-même est dépassé au-delà de 120 km/h par le bruit aérodynamique. Certes, la pollution émise par les véhicules est minimale vers 60 km/h, mais seulement toutes choses égales par ailleurs. Or, elles ne le sont pas : quand on généralise le 30 km/h en ville, les accélérations sont moindres, les rues deviennent plus sûres et certains automobilistes se mettent à utiliser d’autres modes, ce qui réduit la pollution, qui devient minimale vers 30 km/h, et non à 60 km/h.

De même, il faut tenir compte des espaces latéraux qu’imposent des vitesses plus élevées (voies de circulation plus larges, terre-plein central, bandes d’arrêt d’urgence, bas-côtés et échangeurs). La consommation d’espace de circulation est, en effet, minimale vers 30 km/h, et non pas vers 70 km/h comme le suggèrent les courbes débit-vitesse couramment utilisées lors des modélisations dans le domaine des transports.

Paradoxalement, la congestion routière s’accroît elle aussi avec la vitesse, car « La vitesse fait le trafic » : en allant plus vite, les usagers en profitent pour aller plus loin.

Ils parcourent ainsi des distances accrues sur un territoire plus étendu. L’étalement urbain qui en résulte encourage encore davantage l’usage de la voiture au détriment des autres modes. Or l’automobile se trouve être, et de loin, le mode de déplacement le plus consommateur d’espace par personne transportée.

Enfin, avec la vitesse, les modes non motorisés sont disqualifiés. Marche et vélo ne peuvent plus assurer les distances effectuées désormais en voiture. Exposés à une forte insécurité routière, les cyclistes disparaissent et les piétons limitent leurs déplacements. De même, les autobus qui doivent s’arrêter souvent ne peuvent guère rivaliser avec une circulation automobile rapide.

À lire aussi : La marche, premier mode de déplacement en France : ce que disent vraiment les statistiques de mobilité

Le monopole radical de la voiture

En tenant compte de toutes ces nuisances néfastes pour la société, on peut définir une « vitesse généralisée sociale », qui culmine vers 30 km/h, puis décline avec l’augmentation de la vitesse moyenne. Ce résultat rejoint parfaitement le concept de « contre-productivité » proposé par Ivan Illich : au-delà d’un certain seuil, les avantages d’une solution technique s’émoussent et finissent par devenir des inconvénients.

En matière de transport, Illich estime dans Énergie et Équité que ce seuil correspond à la vitesse maximale d’un cycliste quotidien, soit 25 km/h précise-t-il. Dans la Convivialité, il ajoute :

« Il y a dysfonction dans la circulation dès qu’elle admet, en un point quelconque du système, une vitesse supérieure à celle d’une bicyclette. C’est pourquoi, la vélocité du vélo peut servir de critère à la détermination du seuil critique de vitesse. »

Quand ce seuil est dépassé, la voiture s’impose peu à peu partout, disqualifie les modes actifs et les transports publics, jusqu’à détenir un « monopole radical », c’est-à-dire par s’imposer comme le seul mode de déplacement légitime, explique Illich. Dépendant désormais de cet objet sophistiqué qu’est la voiture, les automobilistes perdent leur autonomie. Le vélo classique (non assisté électriquement) peut au contraire être entretenu et réparé par les cyclistes eux-mêmes, aidés au besoin par les plus bricoleurs. Certains parlant alors « de vélonomie », une expression qu’aurait appréciée Illich.

Frédéric Héran ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

24.05.2026 à 12:27

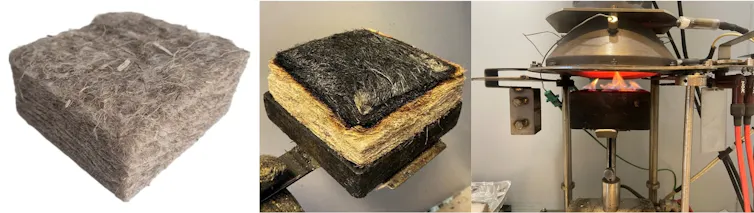

Révolution dans l’isolation : des laines végétales acoustiques et résistantes au feu

Texte intégral (2996 mots)

Trouver un matériau protégeant du bruit, du froid, de la chaleur, mais qui soit également résistant aux flammes sans utiliser de traitements polluants, et si possible produit localement… de récentes recherches ont peut-être trouvé ce Saint-Graal. Elles démontrent le potentiel des laines végétales que l’on peut désormais traiter contre le feu avec des solutions non toxiques et qui ont également l’immense bénéfice de stocker le CO₂ atmosphérique.

C’est un fléau qu’on ignore trop souvent : selon l’Organisation mondiale de la santé, la pollution sonore constitue le deuxième facteur de morbidité environnementale en Europe, juste après la pollution atmosphérique. L’Agence européenne de l’environnement précise, elle, qu’en 2019 au moins 20 % de la population européenne était exposée à des niveaux de bruit considérés comme nocifs pour la santé humaine.

Une étude récente de l’Ademe évalue enfin à 124,1 milliards d’euros par an le coût social et sanitaire des bruits de transport et de voisinage dans les logements français, en partie imputable à la mauvaise qualité de l’isolation des bâtiments.

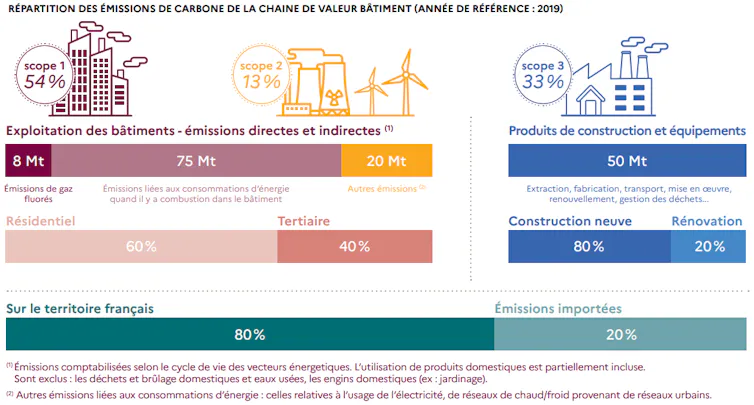

Face à cette réalité, le secteur du bâtiment joue un rôle clé dans la lutte contre les nuisances sonores. Il est également indissociable de l’objectif de neutralité climatique fixé par l’Union européenne pour 2050. En effet, en Europe, avec trois bâtiments sur quatre construits avant 1980, souvent sans réglementation acoustique ni thermique, le secteur de la construction représente à lui seul 40 % de la consommation énergétique et environ 36 % des émissions globales de dioxyde de carbone (CO₂) à l’échelle européenne.

Dans ce contexte, l’amélioration de l’isolation, tant acoustique que thermique, des bâtiments existants et neufs s’impose donc comme un défi majeur, à l’échelle française, européenne et même mondiale.

Face à ces enjeux sanitaires et environnementaux, les matériaux biosourcés, comme les laines végétales émergent comme une solution particulièrement adaptée aux exigences actuelles et aux attentes des pouvoirs publics (Loi de transition énergétique pour la croissance verte, Réglementation environnementale 2020 etc.).

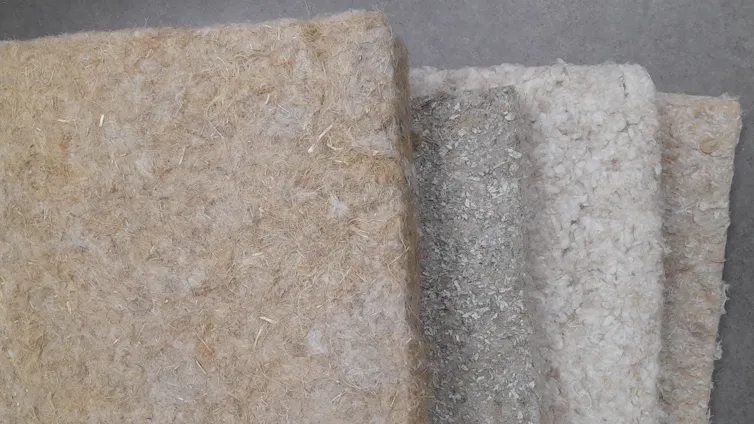

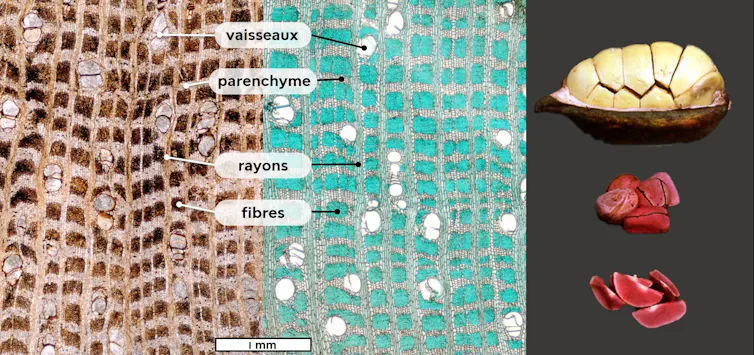

Les laines végétales, un matériau aux nombreux atouts

Les laines végétales appartiennent à la famille des isolants biosourcés qui regroupent des panneaux isolants fabriqués à partir de fibres organiques renouvelables d’origine végétale (lin, chanvre…) ou animales (laine de mouton, par exemple). Ces panneaux, pouvant être constitués d’un ou de plusieurs types de fibres pour combiner leurs propriétés, présentent de nombreux atouts et apparaissent, aujourd’hui, comme le type d’isolant offrant la solution la plus respectueuse de l’environnement.

En effet, la biomasse végétale, produite par photosynthèse à partir du CO₂ prélevé dans l’atmosphère, permet de stocker durablement du carbone dans les matériaux de construction, contribuant ainsi à la réduction des émissions de gaz à effet de serre. Par ailleurs, la grande variété d’espèces utilisables permet de valoriser des ressources disponibles localement réduisant ainsi l’empreinte écologique liée au transport. Sur le plan agricole, les cultures dont proviennent les fibres végétales, comme celle du chanvre, par exemple, peu gourmand en eau et dont la France est le premier producteur européen, favorisent la régénération des sols, limitant le recours aux engrais et renforçant leur durabilité.

Enfin, les laines végétales se distinguent également par d’excellentes propriétés d’isolation thermique liées à leur porosité élevée. La nature même des fibres, capables d'absorber une partie de l’humidité de l’air, confère aux laines des propriétés thermorégulatrices contribuant à la stabilité de l’humidité et de la température à l’intérieur des bâtiments pour le confort des occupants tout au long de la journée. Une qualité de plus en plus importante, surtout en été.

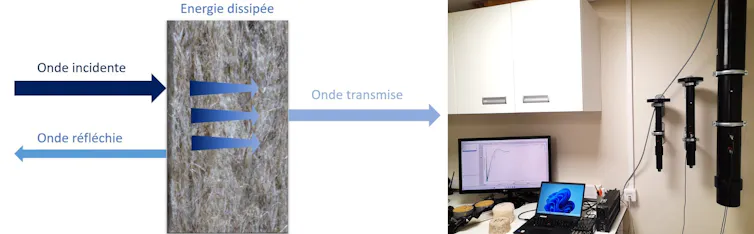

Des performances remarquables et notamment en acoustique

Les performances acoustiques des laines végétales ne sont pas en reste. Grâce à leur porosité élevée, les laines végétales présentent une absorption acoustique élevée correspondant à leur capacité à absorber l’énergie d’une onde sonore. En effet, en pénétrant dans la structure fibreuse des laines, les ondes acoustiques subissent une dissipation de leur énergie par des effets visqueux (frottement de l’air présent dans les matériaux sur les parois des fibres) et thermiques (échanges de température entre l’air piégé au sein des matériaux et les fibres).

Résultat : l’onde réfléchie en surface voit son énergie considérablement réduite par rapport à l’onde incidente initiale, ce qui est une propriété recherchée lorsque l’on vise à améliorer la qualité acoustique d’une salle. Ces propriétés sont mesurables en laboratoire grâce à un dispositif appelé tube de Kundt.

Concernant les propriétés en transmission liées à l'isolation acoustique, des études récentes démontrent que les laines végétales, une fois intégrées dans des systèmes de parois conventionnelles, offrent des performances généralement équivalentes à celles des isolants minéraux traditionnels (laine de roche, laine de verre,…).

Ces résultats marquent une étape décisive dans l’adoption des matériaux biosourcés dans la construction, ouvrant la voie à une utilisation plus large et plus ambitieuse de ces solutions durables dans le secteur du bâtiment.

Un domaine en plein essor

À l’heure actuelle, selon l’Association des industriels de la construction biosourcée, les matériaux d’isolation biosourcés représentent 11 % du marché français de l’isolation en 2023 avec une progression spectaculaire de 95 % en volume depuis 2016. Cette croissance soutenue devrait se poursuivre et même s’amplifier dans les prochaines années, portée par les objectifs de la RE2020 et de la loi Climat et résilience qui imposera, dès 2030, l’utilisation de matériaux biosourcés ou bas carbone dans au moins 25 % des rénovations lourdes et des constructions publiques.

Cependant, un frein limite encore l’essor de l’utilisation des matériaux biosourcés : leur réaction face au feu. En effet, les composés végétaux sont par nature combustibles. Pour répondre aux exigences imposées par la réglementation incendie, leur utilisation répond à des règles techniques de mise en œuvre et ils peuvent faire l’objet d’un traitement d’ignifugation afin de retarder l’apparition de la flamme. Mais les traitements à base de bore et de sels d’ammonium fréquemment utilisés ont été restreints pour des questions de toxicité.

Pour respecter la nature des fibres végétales utilisées dans les laines d’isolation et conserver leurs intérêts environnementaux, des traitements alternatifs bio-inspirés sont possibles et font l’objet de recherches. Par exemple, une solution à base d’acide phytique (formé pendant la maturation des graines dans les végétaux) et d’urée a été récemment testée sur des laines isolantes à base de fibres de chanvre.

Ce traitement par pulvérisation, compatible avec le procédé industriel de fabrication des isolants, modifie la réaction de pyrolyse (décomposition du matériau sous l’action de la chaleur) des fibres en créant une couche protectrice résiduelle charbonnée stable. Cette couche formée à la surface des laines permet de protéger la partie saine des matériaux et de stopper la propagation de la flamme, sans altérer les performances thermiques, de régulation de l’humidité et acoustiques des laines végétales.

Vers des isolants biosourcés toujours plus performants

Le développement de ces nouvelles générations de traitements permet d’utiliser de nouveaux procédés de fabrication à faible impact environnemental et sanitaire. De plus, les recherches actuelles visent également à optimiser les performances acoustiques en basses fréquences (BF) pour des panneaux d’épaisseur réduite inférieure à 5 centimètres, afin de proposer des isolants superoptimisés combinant légèreté, efficacité et sécurité incendie.

Ces innovations pourraient révolutionner l’usage des matériaux biosourcés, en les rendant compétitifs même dans des applications exigeantes, tout en respectant leur vocation écologique. Les recherches en cours ouvrent de fait la voie à des solutions techniques directement utilisables, en s’appuyant sur des méthodes peu coûteuses et adaptées à une production industrielle.

Cet article a été co-écrit avec Philippe Glé (UMRAE – Cerema Strasbourg) et Thomas Schatzmayr Welp Sá (UMRAE – Cerema Strasbourg).

Clément Piégay a reçu des financements de l'ANR.

Sandrine Marceau a reçu des financements de l'ADEME, l'ANR et l'Union Européenne.

24.05.2026 à 12:26

Pollution extrême en Asie du Sud : quand les pratiques agricoles brouillent les observations satellites

Texte intégral (3448 mots)

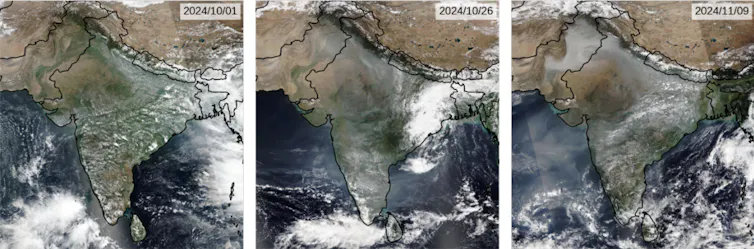

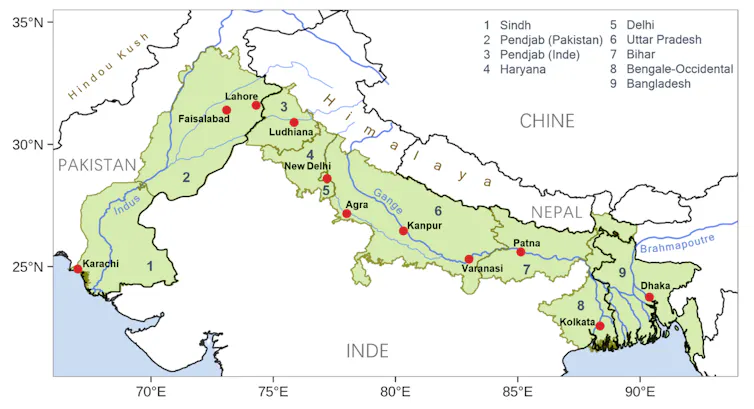

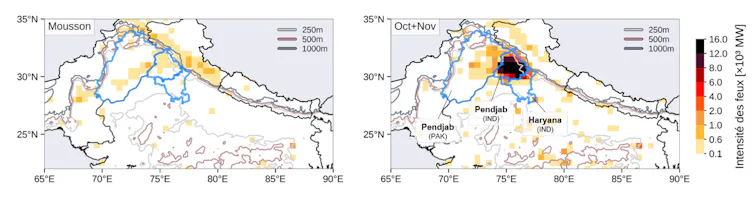

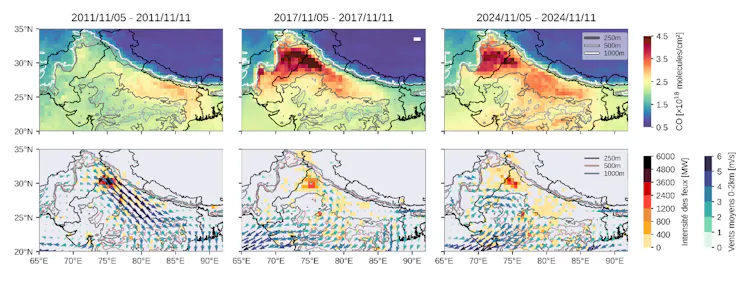

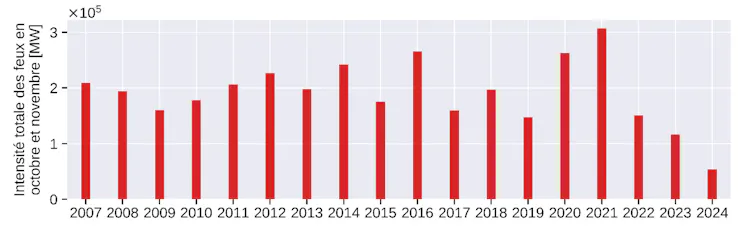

Chaque année, en octobre-novembre, des épisodes de pollution intense sont observés dans une vaste région s’étalant de l’est du Pakistan au Bangladesh et longeant l’Himalaya. Une étude récente montre qu’ils sont liés au brûlage de déchets agricoles et que l’intensité de la contamination dépend des conditions météorologiques. Elle met également en évidence que les paysans connaissent les heures de passage des satellites utilisés par les autorités locales pour surveiller les quantités brûlées, ce qui complique le suivi des pollutions.

Le 18 novembre 2024, le Taj Mahal était plongé dans un brouillard opaque, ne laissant apparaître que l’ombre du mausolée. Au même moment, à 200 kilomètres au nord, des niveaux de particules fines dépassant 60 fois les seuils limites définis par l’Organisation mondiale de la santé étaient enregistrées à New Delhi. Mortels, ces taux de pollution ont alors entraîné la fermeture de plusieurs écoles et le confinement des personnes les plus vulnérables dans la capitale indienne.

Ce nuage de pollution, aussi appelé « smog », s’était formé en réalité dès la fin du mois d’octobre précédent. Il a persisté pendant le mois suivant, comme le montrent les images du satellite états-unien VIIRS, où un nuage grisâtre est visible depuis l’est du Pakistan jusqu’au nord de l’Inde, le 9 novembre 2024.

Ce n’est pas la première fois que cette région connaît de tels pics de pollution extrêmes à cette période de l’année. Ceux-ci coïncident en effet avec le brûlage des résidus agricoles, une pratique largement répandue chez les agriculteurs de la plaine indogangétique (vaste région s’étalant de l’est du Pakistan au Bangladesh et longeant l’Himalaya).

Ma thèse de doctorat porte sur le suivi de la pollution atmosphérique en Asie à partir d’observations satellitaires. En partant de cet événement, j’ai cherché à mieux comprendre le mécanisme de formation des épisodes de pollution dans cette région et, notamment, à voir quel facteur, de l’étendue des surfaces brûlées ou de la météorologie, influençait le plus l’intensité de ces épisodes d’une année à l’autre.

Les raisons du brûlage des déchets agricoles

La plaine indogangétique a connu au cours de ces dernières décennies un essor industriel et économique qui s’est accompagné d’une forte croissance démographique. Ces activités intenses contribuent à la dégradation de la qualité de l’air dans la région.

Une autre source de pollution est le secteur agricole, élément vital de l’économie régionale. La vaste plaine fertile est considérée comme la principale région nourricière d’Asie du Sud, générant près de la moitié de la production céréalière consommable. Elle doit en grande partie cette productivité à la révolution verte survenue la fin des années 1960, qui a généralisé et intensifié la culture par rotation du riz et du blé dans certains États indiens, tels que le Pendjab et l’Haryana.

Le riz est semé en mai puis récolté en octobre-novembre, tandis que le blé est semé en novembre et récolté en avril-mai. Ce calendrier agricole est calé sur la mousson, où les pluies généreuses de juin à septembre arrosent les terres et aident les plants de riz, gourmands en eau, à se développer.

Ces cultures génèrent toutefois de grandes quantités de paille. Si une partie peut être utilisée pour nourrir le bétail ou à des fins domestiques, la majorité de ces déchets, en particulier ceux provenant de la riziculture, est brûlée.

À lire aussi : Derrière les problèmes de smog à Delhi en Inde, une révolution agricole plus verte à réinventer

Plusieurs raisons l’expliquent.

D’une part, la paille de riz a une utilisation limitée dans la vie courante, contrairement aux autres déchets agricoles, et ne sert pas pour l’alimentation du bétail, par exemple.

D’autre part, les agriculteurs indiens sont pressés par le temps : le court délai entre la récolte du riz et le semis du blé demande un nettoyage rapide des champs. Le brûlage à champ ouvert est vu alors comme une solution simple, efficace et surtout économique pour les agriculteurs, qui sont bien souvent contraints financièrement.

La fenêtre temporelle entre les deux cultures s’est encore réduite depuis 2009, avec la mise en place de lois de protection des nappes phréatiques au Pendjab et dans l’Haryana. En effet, une des conséquences de la Révolution verte est la surexploitation des eaux souterraines à cause de l’irrigation massive, ce qui a conduit à des pénuries en eau, vers la fin des années 1990. Ces lois visent alors à ralentir l’épuisement des nappes phréatiques, en obligeant les agriculteurs à retarder le semis du riz afin d’aligner sa croissance avec la mousson.

Même si l’état des nappes phréatiques s’est considérablement amélioré depuis 2009, ces lois ont davantage favorisé le recours au brûlage des résidus agricoles et, par conséquent, ont participé à la détérioration de la qualité de l’air régionale. Les feux allumés lors de cette pratique impactent négativement la santé des 600 millions d’habitants de la plaine indogangétique puisqu’ils émettent de nombreux polluants dans l’air, tels que les particules fines et le monoxyde de carbone (CO).

Une surveillance insuffisante de la pollution

Pour prévenir la population de ces pics de pollution, il est essentiel de suivre les niveaux de polluants dans la région. En Inde, il a fallu attendre 2014 pour que le gouvernement lance la surveillance automatique de la qualité de l’air dans tout le pays. Même si le nombre des stations de surveillance est passé de 30 à plus de 500 en dix ans, elles se concentrent principalement dans les zones urbaines et connaissent bien souvent des problèmes techniques.

La surveillance de la qualité de l’air dans la région a également été impactée par le retour de l’administration Trump aux États-Unis, qui a cessé de communiquer les mesures faites au niveau de ses ambassades depuis mars 2025.

Dans ce contexte, les observations réalisées depuis l’espace permettent de surveiller de manière continue et régulière la composition atmosphérique, et ce, depuis près de deux décennies. C’est notamment le cas des instruments français IASI, qui survolent la Terre à bord des satellites européens Metop depuis 2007 et qui mesurent en particulier les concentrations journalières de CO provenant des feux.

Pour notre étude, nous avons analysé cette série de mesures longue de plus de dix-huit ans, conjointement aux réanalyses des vents de surface et à l’intensité des feux agricoles fournies par les instruments MODIS, embarqués sur les satellites de la Nasa.

Nos résultats montrent que les vents de surface influencent considérablement l’intensité des épisodes de pollution. En 2024, des vents exceptionnellement faibles ont persisté pendant près d’une semaine, favorisant alors l’accumulation du CO au sein de la région. On a observé des conditions similaires en 2017, mais pendant plus de deux semaines. Au contraire, en 2011, des vents plus forts ont contribué à atténuer la pollution alors que des feux agricoles plus intenses aient été détectés.

Des feux passés sous les radars

Notre travail met néanmoins en évidence une intensification des pics de CO, malgré une diminution des feux observés par MODIS ces dernières années.

Plusieurs hypothèses nous amènent à penser que les agriculteurs ont changé leur façon de gérer les résidus. La principale semble être une conséquence directe de l’interdiction de leur brûlage dans certains États indiens, comme Le Pendjab et l’Haryana, depuis 2015. Des amendes sont infligées aux agriculteurs qui pratiquent le brûlage des déchets agricoles. Une autre hypothèse serait liée à l’adoption de variétés de riz à croissance rapide, ce qui laisse plus de temps aux agriculteurs de gérer les résidus.

En réalité, la surprise vient du fait que les agriculteurs brûlent les résidus en dehors du passage des satellites américains pour échapper aux sanctions. Une récente étude démontre, à l’aide de satellites géostationnaires qui sondent la région quasiment toutes les heures, qu’en 2024 les feux ont été allumés en fin d’après-midi, soit bien après le passage de MODIS vers 13 h 30…

Même si cette découverte prête à sourire, elle n’enlève en rien la gravité de la situation : on estime à une fourchette de 44 000 à 98 000 le nombre de morts prématurées, entre 2003 et 2017, liées à l’exposition à la pollution émise par ces feux agricoles.

Le gouvernement indien essaie, à sa façon, de lutter contre la pollution de l’air en instaurant des tours « anti-smog » ou bien en déclenchant des pluies artificielles, à New Delhi par exemple. Or, ces solutions peinent à convaincre la population locale : des manifestations contre la dégradation de la qualité de l’air ont eu lieu pour la première fois en novembre 2025 à New Delhi.

Cathy Clerbaux a reçu des financements du CNES et de Eumetsat pour mener à bien les travaux de son équipe de recherche

Sarah Safieddine et Selviga Sinnathamby ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

22.05.2026 à 12:55

Comment faire face aux vagues de chaleur à Paris ? La piste du refroidissement passif hybride

Texte intégral (2750 mots)

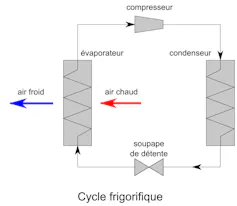

Des températures élevées sont attendues en France les prochains jours. Les vagues de chaleur posent un défi inédit pour nos villes de climat tempéré où, pendant longtemps, la priorité était au contraire de lutter contre le froid. Plutôt que de dépendre exclusivement de la climatisation, le refroidissement passif hybride propose de s’inspirer des bonnes pratiques des climats arides et semi-arides. L’approche tient en trois points : empêcher la chaleur d’entrer dans les bâtiments, la stocker grâce à des matériaux présentant une forte inertie thermique et, enfin, la restituer la nuit grâce à des mécanismes de ventilation naturelle.

L’augmentation des vagues de chaleur dans les climats tempérés place le confort thermique d’été au centre des préoccupations urbaines. Or, dans de nombreuses villes européennes, les bâtiments ont d’abord été conçus pour limiter les pertes de chaleur en hiver au moyen d’une isolation performante et d’enveloppes étanches. Ces choix, rationnels face au froid, deviennent problématiques lorsque les températures élevées persistent plusieurs jours et que la nuit ne permet plus d’évacuer l’énergie accumulée en journée.

On parle de « nuits tropicales » lorsque la température ne descend pas en dessous de 20 °C la nuit, empêchant le corps de récupérer. Quand cette situation se répète, la canicule peut devenir une crise sanitaire, avec des risques accrus pour les personnes âgées ou malades, d’autant plus lorsqu’elles vivent dans des logements défavorables à la ventilation. Lors de la canicule de 2003, à Paris, la température a dépassé les 39 °C, avec neuf jours de températures supérieures à 35 °C, causant 14 800 décès, dont un tiers en Île-de-France.

Face à cette situation, la climatisation apparaît souvent comme la réponse la plus directe et immédiate : on baisse la température quasiment instantanément. Mais à grande échelle, cette solution peut devenir une forme de maladaptation en augmentant les consommations électriques lors des pics de chaleur, créant une pression accrue sur les réseaux énergétiques et en rejetant de la chaleur localement dans l’espace extérieur.

Sans oublier que l’accès à la climatisation est socialement inégal. Selon une étude de l’agence de la transition écologique (Ademe), datant de 2020, le principal obstacle à l’achat d’une climatisation est financier, avec 37 % des professions libérales, cadres et professions intellectuelles supérieures qui ont installé une climatisation, contre seulement 19 % des ménages dont la personne de référence est sans emploi ou inactive.

Pour améliorer l’adaptation des villes sans créer de nouveaux problèmes (surconsommation électrique, augmentation locale des températures extérieures…), une autre approche gagne peu à peu du terrain : le refroidissement passif hybride (ou hybrid passive cooling). Il ne s’agit pas d’éliminer toute technologie fondée sur la ventilation mécanique ou la climatisation, mais de les réserver à un rôle d’appoint, en faisant des mécanismes passifs la base du confort.

À lire aussi : La climatisation, une solution pour mieux vivre le réchauffement climatique ?

Qu’est-ce que le refroidissement passif hybride ?

Pour comprendre ce que recouvre réellement le refroidissement passif hybride, il faut aller au-delà du simple inventaire technique. Il recoupe des mécanismes complémentaires qui remplissent trois fonctions thermiques fondamentales : la prévention, le stockage et la dissipation de la chaleur.

Par « prévention », on décrit tout ce qui empêche la chaleur de rentrer dans le bâtiment : ombrage, orientation des espaces, limitation des surfaces vitrées exposées, ou encore dispositifs extérieurs thermoréflectifs, par exemple la technologie développée par la société Cool Roof.

La deuxième idée est de stocker temporairement la chaleur afin d’atténuer les pics de température en intérieur. Les matériaux à forte inertie thermique comme le béton, la pierre ou la terre permettent cette accumulation de chaleur. Plus récemment, les matériaux à changement de phase (ou MCP) ont été développés pour augmenter cette capacité de stockage. En absorbant la chaleur lors de leur transition d’état, ils fonctionnent comme un tampon thermique, capable de lisser les variations de température sans augmenter massivement l’épaisseur des parois.

- La dissipation, enfin, consiste à extraire la chaleur accumulée dans le bâti. C’est ici que la ventilation naturelle occupe une place centrale. Lorsque les conditions extérieures le permettent, notamment la nuit, l’air extérieur plus frais peut être utilisé pour évacuer la chaleur stockée dans la structure. Sans cette étape de régénération, les stratégies de stockage perdent leur efficacité et le bâtiment est progressivement saturé en chaleur.

Ces trois fonctions forment une chaîne : prévenir réduit la quantité de chaleur à stocker, stocker amortit les pics de température, dissiper réinitialise le système. Or, dans la plupart des configurations décrites, la ventilation naturelle apparaît comme l’élément structurant.

Celle-ci est rarement suffisante toute seule, surtout dans des contextes urbains denses où les flux d’air sont contraints par des mécanismes de ventilation spécifiques. En revanche, elle devient déterminante lorsqu’elle est intégrée dans un ensemble de stratégies de refroidissement cohérent. Lorsque les températures deviennent trop élevées ou que les conditions extérieures ne permettent plus d’évacuer suffisamment de chaleur, des systèmes mécaniques (ventilation mécanique contrôlée, voire dans certains cas climatisation) peuvent intervenir. C’est précisément cette combinaison qui caractérise le refroidissement passif hybride

À lire aussi : Qu’est-ce que le rafraîchissement passif ?

Architecture et gestion de la chaleur, un héritage avant tout culturel

Les principes mobilisés par le refroidissement passif hybride ne sont pas nouveaux.

Dans les régions arides et semi-arides, les populations ont longtemps vécu sans climatisation ni ventilation mécanique, en s’appuyant sur des architectures capables de capter le vent, de créer de l’ombre ou encore d’utiliser l’inertie des matériaux, c’est-à-dire leur capacité à stocker la chaleur le jour puis à l’évacuer la nuit lors de la baisse des températures.

Mais l’efficacité de ces systèmes ne tient pas uniquement à leur conception. Elle repose sur une gestion quotidienne. Les ouvertures, par exemple, ne sont pas réalisées au hasard. Elles sont gérées selon un cycle thermique déterminé. On limite les entrées d’air pendant les heures les plus chaudes, puis on ouvre en grand quand l’air redevient plus frais, notamment la nuit, pour purger la chaleur stockée.

Cette logique contraste avec certaines pratiques contemporaines. En effet, dans de nombreux bureaux climatisés aujourd’hui, les fenêtres restent fermées, car la régulation thermique est confiée presque entièrement à des systèmes mécaniques et électroniques. L’argument est le suivant : ouvrir les fenêtres est contre-productif si le système est en phase de climatisation, mais l’usager des bâtiments n’a que rarement la main sur ces systèmes.

Il faut aussi souligner que, dans les sociétés contemporaines équipées de climatisation, le confort est souvent défini comme une température intérieure stable et constante. Dans de nombreuses pratiques ancestrales, au contraire, le confort repose sur un équilibre plus dynamique : les habitants adaptent leurs comportements, leurs activités ou leur localisation pour maintenir des conditions supportables.

À Yazd, en Iran, les maisons traditionnelles combinent des dispositifs passifs comme les tours à vent, les murs épais et les espaces semi-ouverts, qui maintiennent naturellement des conditions plus fraîches. Mais ces dispositifs ne fonctionnent pas seuls. En milieu de journée, les pièces en étage exposées sont délaissées au profit des espaces plus massifs ou en contact avec le sol, comme les pièces basses ou les sous-sols. Les ouvertures donnant sur l’extérieur chaud sont fermées. Les espaces semi-ouverts ventilés, comme les loggias, sont utilisés en soirée ou la nuit pour dormir et se reposer.

Autrement dit, la performance du refroidissement passif résulte de l’interaction entre les bâtiments et les pratiques. C’est l’architecture qui va rendre certaines actions possibles (ombre, ventilation, inertie) ou impossibles, et ce sont les usages qui les mettront réellement en œuvre.

Des bâtiments innovants à Paris

À l’échelle des villes, la nécessité de solutions de refroidissement sobres en énergie se traduit de plus en plus en dispositifs concrets. À Paris, par exemple, la réponse à la chaleur associe plusieurs familles d’actions : solutions vertes (arbres, végétalisation), bleues (eau) et grises (matériaux, ombrage, aménagements bâtis) comme les « îlots frais » réalisés par Fraîcheur de Paris (société gestionnaire du réseau de froid parisien) en 2018 et 2019.

Dans ce cadre, certains équipements et bâtiments publics mobilisés en période de canicule s’appuient naturellement sur ces principes : ombrage extérieur, matériaux présentant une forte inertie thermique, ventilation et gestion du cycle jour/nuit. La climatisation est mobilisée, mais plutôt comme un filet de sécurité lorsque les conditions deviennent extrêmes. Autrement dit, le refroidissement passif hybride s’intègre déjà, de façon plus ou moins explicite, dans la manière dont une grande ville structure sa stratégie d’adaptation à la chaleur.

Un exemple concret à Paris est la médiathèque James-Baldwin (XIXᵉ), qui articule réhabilitation d’un ancien bâtiment et construction neuve en misant sur une logique de refroidissement passif hybride. On y retrouve ses trois grands principes : prévenir, stocker et dissiper.

Pour prévenir l’entrée de chaleur, le bâtiment multiplie les protections : brise-soleil orientables, coursive de bois en façade sud, résille en bois et végétalisation qui accentuent l’ombre et réduisent l’échauffement des parois.

Pour stocker sans surchauffer trop vite, la médiathèque tire parti du béton du bâtiment réhabilité, tout en ayant amélioré l’enveloppe au moyen d’une isolation thermique extérieure en fibre de bois.

Enfin, pour dissiper la chaleur, la clé réside dans la ventilation naturelle, en particulier nocturne pour purger la chaleur accumulée lorsque l’air extérieur redevient plus frais.

Le refroidissement, un système sociotechnique

Mais le refroidissement passif hybride ne se limite pas à l’ajout de brise-soleil ou de matériaux innovants. En effet, une ventilation nocturne ne produit son effet que si les ouvertures peuvent être utilisées dans des conditions acceptables de sécurité et de confort pour les occupants. Un dispositif d’ombrage n’est protecteur que s’il est correctement positionné et réellement utilisé. Un matériau de stockage n’est utile que si la dissipation ultérieure est assurée.

La performance ne réside donc pas uniquement dans la technologie, mais dans l’articulation entre dispositifs, pratiques et coordination entre concepteurs, gestionnaires et usagers des bâtiments.

À mesure que la chaleur devient un paramètre déterminant pour qualifier l’environnement urbain, le refroidissement ne peut plus être pensé comme un simple équipement individuel ajouté en fin de chaîne. Il doit être compris comme un système sociotechnique à part entière, où la conception architecturale, les principes physiques et l’organisation des usages forment un tout.

Autrement dit, il ne s’agit plus seulement de recourir à des machines pour obtenir un ajustement de température, mais d’organiser durablement la gestion de la chaleur dans les bâtiments.

Cela nécessitera aussi d’impliquer davantage les occupants, en adaptant concrètement l’usage des espaces :

éviter les pièces les plus exposées aux heures chaudes,

privilégier les zones qui restent naturellement plus fraîches, comme les pièces épaisses ou situées en partie basse,

et enfin, déplacer certaines activités selon les moments de la journée, par exemple réserver le repos aux heures les plus chaudes dans les pièces les plus fraîches, et reporter les tâches domestiques aux périodes plus tempérées, le matin ou en soirée.

Cet article a été développé et co-écrit avec Stanislav Mukhamedov, étudiant en école d’ingénieur à l’ESILV majeure EVD, dans le cadre de son travail de recherche sur l’adaptation des grandes métropoles aux vagues de chaleur.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

22.05.2026 à 12:53

Qu’est-ce que le rafraîchissement passif ?

Texte intégral (2114 mots)

Comment rendre la chaleur à l’intérieur des bâtiments plus tolérable ? On pense volontiers d’abord à la climatisation, mais d’autres approches, à la consommation d’énergie réduite, voire nulle, peuvent également être mobilisées. On parle alors de rafraîchissement passif.

Le rafraîchissement passif s’impose depuis plusieurs années. L’expression désigne l’ensemble des solutions permettant d’abaisser la température d’un bâtiment ou de limiter son réchauffement lors des saisons estivales ou des épisodes de fortes chaleurs, tout en ayant une consommation énergétique réduite, voire nulle.

Les épisodes de canicule, de plus en plus longs et fréquents du fait du changement climatique, nous rappellent que refroidir nos bâtiments n’est pas qu’un enjeu de confort, mais aussi un enjeu de santé publique pour les décennies à venir.

C’est particulièrement le cas dans les régions du globe où les températures dépassent régulièrement 40 °C, ou encore pour les personnes vulnérables comme les personnes âgées, les jeunes enfants ou les personnes malades. Le rafraîchissement peut également être tout simplement nécessaire pour des questions de confort thermique.

Climatiser, pour le meilleur ou pour le pire ?

À l’heure actuelle, le rafraîchissement des bâtiments repose aujourd’hui essentiellement sur l’usage des climatiseurs, qui présentent l’inconvénient d’être très énergivores.

La climatisation estivale d’un logement peut ainsi engendrer un surplus de consommation d’électricité de l’ordre de 15 %. Certes, l’impact carbone de cette consommation reste relativement limité en France, grâce à une production d’électricité bas carbone, mais ce n’est pas le cas dans de nombreux pays. À l’échelle mondiale, le refroidissement représentait 18,5 % de la consommation totale d’électricité du secteur du bâtiment en 2016, contre 13 % en 1990.

En plus de leur forte consommation énergétique, les climatiseurs présentent aussi l’inconvénient de rejeter de la chaleur à l’extérieur, contribuant à l’effet d’îlot de chaleur bien connu dans les villes. À titre d’exemple, à Paris, leur usage estival pourrait être responsable d’une augmentation allant jusqu’à 2 °C de la température extérieure dans certains quartiers.

À lire aussi : La climatisation, une solution pour mieux vivre le réchauffement climatique ?

Les leviers principaux : aération, architecture et urbanisme

Dans ce contexte, les solutions consommant peu ou pas d’énergie (par définition, il s’agit des solutions de rafraîchissement passif) sont de plus en plus recherchées. Celles-ci comprennent une large gamme de pratiques et de dispositifs.

Il existe par exemple des pratiques très simples qui favorisent la ventilation naturelle, comme ouvrir les fenêtres au petit matin pour abaisser la température intérieure de quelques degrés, puis fermer les volets et fenêtres durant la journée afin de limiter les apports de chaleur. Ce premier niveau peut-être actionné facilement, même en l’absence de dispositifs spécifiques.

La conception architecturale peut également être optimisée afin d’améliorer la ventilation naturelle : par exemple, en orientant les constructions afin de limiter les obstacles à la circulation du vent, en tenant compte de la topographie du milieu (relief, plaine, colline…), ou encore de l’implantation des autres bâtiments alentours.

Il est ainsi possible d’opter pour des architectures favorisant la ventilation naturelle en s’inspirant des constructions traditionnelles, comme les bâtiments en U, ouverts sur les vents dominants, ou les cours intérieures ombragées, équipées de puits fonctionnant comme des cheminées évacuant l’air chaud.

Enfin, on peut réduire l’exposition directe au soleil, par exemple en concevant des rues étroites, comme à Masdar aux Émirats arabes unis.

À lire aussi : S’inspirer de l’architecture traditionnelle pour faire face à la canicule

Le choix des matériaux et de la végétalisation

Certains matériaux de construction naturels, comme le calcaire (et, par extension, les enduits à la chaux) ou la vase, sédiment composé d’argile, régulent efficacement les températures. Ils absorbent l’eau lors des périodes humides ou fraîches (comme la nuit). Cette eau s’évapore pendant une partie de la journée lors de l’augmentation des températures, provoquant un effet de rafraîchissement diurne.