13.04.2026 à 16:42

La scolarité des enfants suivis par la protection de l’enfance : un problème majeur qui ne doit pas occulter les réussites

Texte intégral (1903 mots)

Les enfants passés par l’aide sociale à l’enfance sont plus souvent confrontés à des difficultés scolaires. Il est important de le reconnaître sans verser dans un discours stigmatisant qui contribuerait à entretenir un cercle vicieux. La recherche est une alliée précieuse pour identifier des leviers de réussite.

Le 12 février 2026, une circulaire du ministère de l’éducation nationale est parue au Bulletin officiel pour « favoriser la réussite et l’ambition scolaires des enfants protégés ». Ces derniers sont des enfants dont la situation a été identifiée comme étant en risque ou en danger et auprès desquels l’État intervient, par la voix de services décentralisés, l’aide sociale à l’enfance (ASE), dans un but de protection, qu’ils restent dans leur milieu de vie habituel ou qu’ils soient accueillis dans d’autres structures. Ils étaient 384 900 mineurs et jeunes de moins de 21 ans dans ce cas au 31 décembre 2023.

S’il peut sembler aller de soi, cet objectif vient lever un paradoxe jusque-là invisible : la scolarité de ces enfants n’était pas affichée clairement comme un objectif de l’État, alors même qu’ils sont placés sous sa protection.

Pourquoi souligner cette ambition ? Que savons-nous de la scolarité de ces enfants ? Quel est l’état de la recherche sur cette question ? Nous verrons que des difficultés fortes sont maintenant bien documentées, mais qu’elles ne sont pas systématiques, et qu’il est nécessaire d’être vigilant sur la façon d’en parler au risque d’alimenter ce problème.

Des difficultés scolaires plus fréquentes, mais non systématiques

Les recherches en France convergent maintenant depuis plus d’une dizaine d’années pour identifier des difficultés scolaires plus fréquentes pour ces enfants. Plus de la moitié d’entre eux est en retard d’au moins une classe par rapport aux autres enfants du même âge (plus de 1 sur 10 le sont d’au moins deux classes). Ils sont dix fois plus souvent orientés en scolarités adaptées, comme les sections d’enseignement général et professionnel adapté (Segpa), connaissent plus fréquemment des moments de déscolarisation.

Ces éléments sont des indicateurs de difficultés rencontrées : le redoublement ou ces orientations sont envisagés lorsque les résultats sont bas. Mais ce sont aussi des éléments fragilisant la suite de la scolarité. Le redoublement, par exemple, a des effets préjudiciables pour les élèves qui le vivent : sans résoudre les difficultés scolaires, il ajoute un stigmate fort et réduit l’estime que les élèves ont d’eux-mêmes.

Les orientations vers des dispositifs spécialisés rendent difficile le retour dans un cursus ordinaire. Les temps de déscolarisation marquent aussi durablement les scolarités.

De plus, les orientations scolaires sont plus contraintes pour ces enfants : ils sont près de 8 sur 10 à être orientés en filières professionnelles dans le second cycle, contre 3 pour 10 pour l’ensemble de la population. Ces orientations sont d’abord envisagées par défaut, peu les choisissent en premier lieu. À 17 ans, seulement 13 % préparent un baccalauréat général (contre 51 % pour l’ensemble de la population).

Les sorties du système éducatif sont plus rapides, et débouchant plus souvent sur des situations précaires : 31 % des jeunes de 18 à 22 ans sortant de l’ASE se déclarent inactifs ou au chômage et 42 % suivent des études (contre respectivement 21 % et 50 % pour les jeunes de milieux populaires).

Ce que l’on sait des causes de ces difficultés

La littérature permet maintenant d’identifier une part importante des causes de ces difficultés. On peut citer les difficultés rencontrées par ces enfants avant l’intervention et liées aux raisons qui la justifient. Les travaux d’Isabelle Frechon confirment la fréquence élevée de violences vécues pour les enfants ayant eu l’expérience d’un placement : 31 % déclarent avoir subi des violences sexuelles, 35 % des violences physiques, 12,5 % des violences psychologiques et 11 % des négligences lourdes au cours de leur enfance et/ou adolescence. D’intensité et de durée différentes, ces violences génèrent des traumatismes, des préoccupations, du stress qui gênent les apprentissages.

Par ailleurs, bien qu’aucun milieu social ne soit épargné par les maltraitances, ces enfants sont plus souvent issus des milieux populaires et particulièrement des strates les plus précaires. Ils font donc partie des populations mises en difficulté par un système éducatif très inégalitaire, et ils cumulent les situations de précarité qui renforcent les difficultés scolaires.

Par ailleurs, l’intervention des services de protection de l’enfance a des effets ambivalents sur les scolarités. Elles peuvent les soutenir en partie, mais contribuent également aux difficultés, notamment en générant des ruptures multiples (des changements d’adultes référents, d’établissements scolaires, d’environnements de vie, un éloignement des amis).

Du fait d’un ensemble complexe de raisons, les enfants passant par la protection de l’enfance sont souvent destinataires d’attentes faibles au sujet de leur scolarité et de leur projection d’études et d’emploi. Par le corps enseignant, tout d’abord, du fait de représentations tenaces, associant la protection de l’enfance à des difficultés nécessairement scolaires, mais également par les travailleurs sociaux. Ces faibles attentes de part et d’autre contribuent à des orientations plus fréquentes vers l’enseignement spécialisé, vers des scolarités par défaut et favorisent des périodes de non-scolarisation.

De fortes incertitudes sur l’avenir qui contraignent l’orientation

Pour ces enfants, l’avenir est fortement incertain. La limite des 18 ans annonce une fin de prise en charge institutionnelle pour la plupart, et jusqu’aux 21 ans pour les plus soutenus. Ils disposent de moins de ressources (familiales, institutionnelles, sociales) pour envisager une poursuite d’études ou pour assurer la recherche et l’obtention d’un emploi. Ces difficultés sont connues des jeunes et des membres du champ professionnel. Ils les anticipent et vont viser des orientations au moindre risque, vers des filières courtes, pour viser une indépendance plus sûre, plus rapidement, limitant les projections d’avenir qui suivent peu leurs propres envies.

Sur ces éléments, les filles sont davantage mises en difficulté, à la différence du reste de la population. Les orientations vers les voies professionnelles plus fréquentes contraignent davantage leur parcours scolaire et n’assurent pas la sécurité prévue. À la sortie de la prise en charge, elles sont plus affectées par les conditions d’accès à l’emploi que les garçons, elles sont davantage au chômage ou inactives.

Le constat des difficultés plus fortes est bien établi par la recherche et il démontre que le droit à l’éducation n’est pas pleinement atteint pour ces enfants. Le rappel de ces tendances peut toutefois avoir un effet délétère pour eux en augmentant la forte stigmatisation qui peut peser négativement sur les capacités qu’on leur attribue, et les ambitions qu’on leur porte. En effet, ce sont bien des attentes élevées et la considération que la scolarité est importante qui soutiennent les parcours de réussite scolaire.

Des réussites scolaires peu visibles

À l’occasion de mes recherches de thèse doctorale, soutenue en 2013, j’identifiais qu’en Angleterre la publication régulière des données comparées sur la scolarité, entre les enfants protégés et le reste de la population, et l’injonction à soutenir leur réussite, sans attribuer des moyens suffisants, stigmatisaient cette population et avaient des effets négatifs sur les professionnels. Ces derniers rendaient compte d’une résignation face aux difficultés.

Il y a ainsi une vigilance à avoir sur la façon dont on mentionne publiquement le problème de la scolarité des enfants protégés. Il est nécessaire d’étudier les conditions de ces difficultés et d’identifier les leviers pour les réduire, mais sans faire peser sur ces enfants un stigmate négatif. Il est important de trouver un juste équilibre pour souligner le versant positif du problème, à savoir soutenir la réussite et avoir des attentes élevées envers ces enfants, sans invisibiliser le constat sur les difficultés élevées et le diagnostic de leurs causes.

Si cette question était jusque-là un sujet de préoccupation affichée des professionnels de la protection de l’enfance et des institutions locales ou territoriales (associations ou départements), la circulaire ministérielle constitue le signal de sa reconnaissance comme problème public. La circulaire implique pleinement l’éducation nationale dans ces préoccupations et la responsabilité d’agir pour soutenir ces enfants. D’ailleurs, depuis les années 2010, les recherches, en France comme à l’international, fournissent un ensemble de connaissances maintenant bien établies qui renseignent autant sur les freins existants que sur les leviers disponibles pour accompagner la réussite des enfants protégés.

Benjamin Denecheau ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

13.04.2026 à 16:41

Trois récits de vie pour comprendre le mal-être dans la fonction publique

Texte intégral (1818 mots)

Face à l’austérité budgétaire, certains agents de la fonction publique font face à des injonctions contradictoires – moins de moyens, mais une meilleure qualité de service –, des responsabilités floues et un manque de reconnaissance qui affectent leur bien-être. Pour comprendre ces enjeux complexes, une étude donne la parole à trois agents de la fonction publique d’État.

Une directrice d’école en burn out faute d’aide. Un cadre hospitalier en charge des décisions, sans pouvoir réel. Un fonctionnaire dont les compétences restent ignorées. Ces situations ne sont pas des cas isolés. Elles suggèrent une transformation silencieuse du management dans la fonction publique.

La fonction publique présente des défis managériaux spécifiques, documentés depuis plusieurs décennies. Ces défis oscillent entre sens du devoir, convictions et valeurs partagées, et contraintes telles que l’austérité budgétaire.

À partir de récits de vie d’agents publics, notre étude révèle des situations où les responsabilités augmentent, alors que les moyens et les marges de décision diminuent. Cette évolution contribue à affaiblir l’engagement des fonctionnaires et contractuels. Notre approche narrative permet d’appréhender les enjeux contemporains de la gouvernance publique d’État à partir de l’expérience vécue de professionnels.

Injonctions contradictoires

L’équilibre entre contrôle de l’activité des agents de la fonction publique et liberté décisionnelle nécessaire à toute prise de décision reste un sujet de débat. Depuis plus de vingt-cinq ans, le chercheur Christopher Hood questionne la mise en œuvre du New Public Management, tandis que Geert Bouckaert invite à repenser la notion de performance et ses critères dans le secteur public. Dans ce contexte, les fonctionnaires se retrouvent face à des injonctions contradictoires : préserver une qualité de service envers les concitoyens avec des moyens limités et des obligations de résultat.

Le New Public Management trouve sa transposition en France à travers des programmes d’actions interministériels lancés en 2007 et 2012. La Révision générale des politiques publiques (RGPP) a été notamment consacrée à la réorganisation des structures de l’administration publique. La modernisation de l’action publique (MAP) à l’amélioration de la qualité des services publics ou la simplification et de réorganisation administrative.

Notre analyse met en lumière les formes concrètes du désenchantement des ressources humaines dans la fonction publique et la dégradation de la qualité du management liées à ces évolutions, notamment à travers deux cadres théoriques :

La justice organisationnelle qui analyse les appréciations des salariés du caractère juste du traitement dont ils font l’objet au sein de la structure qui les emploie ;

Les conflits de rôles qui naissent quand les périmètres d’activités ne sont pas suffisamment bien définis ou l’existence d’une répartition déséquilibrée de la charge de travail entre agents de la fonction publique.

Manque de reconnaissance (premier récit de vie)

Appel aux consultants extérieurs

« Ce qui me désole au sein du ministère, c’est l’indifférence manifeste envers les CV des fonctionnaires. Il est vrai que nous avons été embauchés selon certaines conditions de niveau et de compétences, mais après plus de quatre ans comme moi au sein des services, les agents ont eu l’occasion d’acquérir de nouvelles compétences. Plutôt que de faire appel à des consultants externes pour leurs compétences, on pourrait exploiter les compétences internes qui sont réellement abondantes et variées. »

Tâches routinières

« Avant de rejoindre la fonction publique, j’ai occupé plusieurs postes dans divers cabinets d’expertise comptable, où j’ai géré de manière autonome la comptabilité d’entreprises reconnues. J’ai choisi la fonction publique pour satisfaire mon père qui valorise la stabilité et la sécurité qu’elle offre. Cependant, mon rôle actuel à la direction générale se limite à des tâches routinières et subalternes. Ce manque de reconnaissance de mon niveau de compétence et d’expérience me désole. »

Qui est responsable ? (second récit de vie)

« Je suis en position de responsabilité, en tant que cadre depuis cinq années. J’ai la charge de la gestion des soignants au sein d’une organisation hospitalière multi-sites. Il y a des difficultés pour accompagner tous nos patients, accueillis sur un site et quelquefois opérés sur un autre site. Il faut alors trouver des places pour l’hospitalisation. »

« Nous expliquons que c’est au chef de service de déterminer qui sera le premier patient de la journée et l’heure à laquelle il sera hospitalisé. À notre niveau, nous sommes des représentants administratifs. Nous devons répondre à des sujets qui sont pour eux administratifs, mais qui en réalité sont organisationnels. C’est compliqué : qui est responsable ? »

Gérer seule une situation difficile (troisième récit de vie)

Problématique en dehors des clous

« Je suis directrice dans une petite école et institutrice dans une classe de CE2. J’ai vingt-cinq ans d’expérience et on peut dire que je fais partie des piliers de l’école. Jusqu’à cette situation, j’étais passionnée et ce métier a toujours été une véritable vocation. »

À lire aussi : Quand le cynisme mine l’engagement dans la fonction publique…

« Depuis la petite section, nous accueillons un enfant avec des troubles importants – sans connaître l’origine de ses troubles, car sa maman n’a jamais voulu fournir de bilan médical à l’école. Il a pu bénéficier d’un accompagnant d’élève en situation de handicap durant 5 ans, mais plus aujourd’hui. C’est donc un peu moi qui joue ce rôle, mais en plus je dois m’occuper des autres élèves de ma classe. »

Pas de soutien de l’académie

« La situation était tenable tant qu’il bénéficiait de cette personne dédiée. Il a toujours eu tendance à frapper les autres et je pense qu’une bonne partie des enfants de l’école y ont eu droit. Cette année, les problématiques se sont amplifiées. Il y a eu de nombreuses plaintes des parents. On m’a même dit : “Mais que faites-vous madame, vous ne surveillez pas ?” “Convoquez la mère !” »

« Je me suis donc retournée vers l’académie et l’inspecteur, en demandant conseils et aides. Il m’a été répondu qu’il ne faudrait surtout pas céder aux plaintes quotidiennes des parents. Je n’ai pas reçu d’aide ou de moyens supplémentaires. Je pleurais tous les jours. J’aimais mon métier d’enseignante, mais là, je n’avais plus le sens. Mon médecin m’a dit, “C’est un burn out”. »

Hypocrisie organisationnelle

L’ensemble de ces récits permet de proposer plusieurs perspectives d’analyse à la lumière de l’hypocrisie organisationnelle – discours et actes contradictoires. Par exemple, le troisième invite à se demander si cette hypocrisie ne sert pas à protéger l’organisation, ici l’éducation nationale.

Une autre perspective est celle du leadership. Les trois récits suggèrent que :

Les agents publics sont contraints d’endosser des responsabilités pour gérer des situations complexes, sans recevoir de reconnaissance lorsqu’ils réussissent à trouver des solutions. L’écart entre les missions confiées et les moyens disponibles devient difficilement supportable ;

Ils ne disposent parfois pas du pouvoir décisionnel nécessaire pour résoudre les problèmes auxquels ils sont confrontés ;

Ils restent souvent prisonniers d’un statut ou d’une organisation hiérarchique rigide, qui freinent l’évolution de leurs missions, malgré l’acquisition d’expérience ou de nouvelles compétences. Cette situation génère à terme démotivation ou démission, qu’elle soit silencieuse ou effective.

Ces récits illustrent une forme de « management du risque » de la part des niveaux hiérarchiques supérieurs, qui consiste à laisser les collaborateurs affronter seuls certaines situations, tout en revendiquant la maîtrise de la décision et de l’action. Ces extraits mettent en lumière l’importance cruciale de la reconnaissance et de la valorisation du travail, tant au sein de la fonction publique qu’au service de l’usager ou du citoyen. En filigrane se dessine la nécessité d’un leadership éclairé et bienveillant, capable de soutenir et guider ses équipes.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

13.04.2026 à 16:41

Les coûts économiques de la guerre vont bien au-delà des destructions matérielles

Texte intégral (1710 mots)

Les effets les plus importants des conflits sont souvent les moins visibles : ils détruisent les parcours de vie, affectent la santé, plombent les économies, exacerbent les inégalités de genre, accélèrent les déplacements forcés… La guerre génère aussi des gagnants, intentionnels ou involontaires.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le numéro 10 est consacré aux « Violences : la société à vif ».

La guerre détruit des infrastructures, désorganise les économies, brise des trajectoires individuelles et recompose parfois les rentes. En mesurer le coût suppose de tenir ensemble ces différentes dimensions. Loin d’être un simple exercice comptable, cette quantification est indispensable pour identifier les populations les plus vulnérables et orienter les politiques de reconstruction.

Les coûts les plus visibles sont matériels. Les conflits contemporains détruisent massivement les infrastructures et désorganisent en profondeur les capacités productives. Dans le cas de l’Ukraine, les premières estimations situaient les pertes totales entre 500 milliards et 1 000 milliards de dollars (de 427,9 milliards à 855,8 milliards d’euros) dès 2022. Fin 2024, la Kyiv School of Economics chiffrait la reconstruction des seules infrastructures physiques à des dizaines de milliards de dollars : 60 milliards pour les logements, 38,5 milliards pour les routes, 14,6 milliards pour le secteur énergétique, 14,8 milliards pour l’agriculture. Ces chiffres ne rendent compte que des pertes tangibles ; ils laissent dans l’ombre la désorganisation plus profonde des tissus productif et social.

À l’échelle macroéconomique, les effets sont tout aussi sévères. Le génocide rwandais de 1994 s’est accompagné d’une chute de 40 % du PIB par habitant et d’un effondrement des investissements directs étrangers. À Gaza, le PIB réel a reculé de plus de 80 % au premier semestre 2024, tandis que la part de la population en situation de pauvreté multidimensionnelle est passée de 63,7 % avant la guerre à 97,9 % en 2024.

À lire aussi : Économie de guerre : de quoi parle-t-on ?

Les enfants, premières victimes

Les coûts les plus importants sont souvent les moins visibles. La guerre perturbe les parcours de vie, détruit les actifs des ménages et fragilise durablement les mécanismes économiques de base. Les enfants en sont les premières victimes. En 2023, 473 millions d’enfants vivaient dans des zones de conflit, et plus de 30 000 violations graves de leurs droits ont été recensées.

La littérature économique montre que ces expositions précoces ont des effets durables sur le capital humain : au Pérou, une exposition à la violence avant l’âge scolaire réduit en moyenne la scolarité de 0,31 année à l’âge adulte ; au Rwanda, les enfants exposés au génocide accusent un retard d’environ 0,5 année de scolarité primaire.

Les conséquences sanitaires sont, elles aussi, profondes. Au Nigeria, les femmes exposées à la guerre civile entre 1967 et 1970 présentent, à l’âge adulte, une taille inférieure de 0,75 à 4,5 centimètres selon l’âge d’exposition, signe d’un environnement nutritionnel et sanitaire gravement détérioré (Akresh et coll., 2012).

Par ailleurs, le simple risque de violence, même en l’absence d’exposition directe, affecte les comportements et les conditions de vie. En Côte d’Ivoire et en Ouganda, une augmentation d’un écart-type du risque de violence entre la conception et la première année de vie accroît la mortalité infantile de 0,8 à 1 point de pourcentage. Les coûts du conflit ne se limitent donc pas aux seuls lieux où la violence se réalise.

Des liens sociaux désagrégés

Les effets sur les structures sociales sont plus ambivalents. De nombreux travaux documentent une baisse durable de la confiance et un renforcement des replis identitaires après les conflits, y compris longtemps après la fin des hostilités. D’autres mettent en évidence, dans certains contextes, des dynamiques inverses : montée de l’engagement civique et politique, comportements plus prosociaux, participation accrue à la vie collective. La guerre ne produit donc pas des effets sociaux uniformes. Si elle peut désagréger les liens, elle peut aussi, dans certains contextes, renforcer des formes d’engagement ou de coopération.

Les conflits exacerbent aussi les inégalités de genre. Près de 80 % des personnes déplacées sont des femmes (Banque mondiale, 2011), exposées à des risques sanitaires accrus et à des formes de violence spécifiques. Les violences sexuelles, documentées dans de nombreux contextes, ne sont pas seulement des effets collatéraux du conflit. Des travaux récents montrent qu’elles peuvent répondre à des logiques de contrôle territorial et d’extorsion économique, notamment dans les zones riches en ressources naturelles.

L’immigration des élites

Les déplacements forcés constituent une autre dimension majeure et souvent sous-estimée des coûts. Un conflit de faible intensité génère en moyenne 500 000 déplacés, un conflit meurtrier jusqu’à 1,2 million. Ces migrations ne sont pas aléatoires : les individus les plus éduqués et les mieux dotés économiquement sont souvent les plus mobiles. Cette sélection entraîne une perte durable de capital humain dans les zones d’origine, fragilisant la reconstruction et pouvant alimenter, à moyen terme, de nouvelles tensions.

Les entreprises subissent elles aussi des coûts importants, directs et indirects. La violence perturbe l’offre de travail, désorganise les chaînes d’approvisionnement et accroît l’incertitude sur les décisions d’investissement. Au Kenya, les violences postélectorales de 2008 ont provoqué une chute de plus de 50 % des exportations de fleurs.

Dans les territoires palestiniens occupés, les distorsions liées à l’accès aux intrants importés expliquent environ 70 % de la baisse de valeur ajoutée des entreprises exposées. Mais ces effets ne restent pas confinés aux zones de violence : dans le cas indien, environ trois quarts du coût économique total d’un conflit transitent par les chaînes de valeur, affectant des entreprises situées dans des régions pourtant épargnées. Ne comptabiliser que les firmes directement exposées conduit donc à sous-estimer massivement l’impact global.

Des rentes redistribuées

Enfin, la guerre génère aussi des gagnants, et la distinction entre gagnants intentionnels et gagnants involontaires est ici essentielle. Les premiers cherchent activement à tirer profit du conflit : l’industrie de l’armement, dont le chiffre d’affaires cumulé atteignait 631,9 milliards de dollars (540,8 milliards d’euros) en 2023 en est l’exemple le plus évident. Certaines entreprises vont plus loin encore, en nouant des arrangements avec des groupes armés pour maintenir leur activité ; le cas Lafarge en Syrie en est l’illustration la plus emblématique.

Les seconds profitent du conflit par un concours de circonstances : la disparition ou l’affaiblissement de concurrents exposés à la violence redistribue mécaniquement des parts de marché en leur faveur, sans qu’ils l’aient recherché. Dans les deux cas, ces dynamiques rappellent que la guerre ne produit pas uniquement des destructions : elle redistribue aussi des rentes et des positions, ce qui contribue parfois à en prolonger la durée.

Au total, les coûts de la guerre s’étendent bien au-delà des destructions immédiates. Ils s’inscrivent dans les corps, les trajectoires scolaires, les structures familiales, les réseaux productifs et les équilibres sociaux, souvent pour des décennies. Les chiffrer rigoureusement ne revient pas à réduire la guerre à une équation ; c’est une condition pour hiérarchiser les urgences, cibler la reconstruction et limiter la reproduction de la violence.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le numéro 10 a pour objet « Violences : la société à vif ». Vous pourrez y lire d’autres contributions.

Le titre et les intertitres sont de la rédaction de The Conversation France.

Mathieu Couttenier ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

13.04.2026 à 16:41

Quel avenir pour les animaux sur les plateaux de cinéma ?

Texte intégral (2341 mots)

Depuis ses débuts, le cinéma a utilisé les animaux comme des acteurs à part entière. Mais leur présence sur les plateaux se fait moindre avec l’essor des images de synthèse, tandis que les associations de défense des animaux œuvrent pour en finir avec des pratiques parfois maltraitantes.

L’histoire des acteurs non humains est longue et riche en anecdotes, de Luke, le chien de la star du cinéma muet Roscoe (alias Fatty) Arbuckle, aux colleys qui ont incarné Lassie au cinéma et à la télévision. L’ours Bart a accumulé plus de 20 apparitions au cinéma et à la télévision dans les années 1980 et 1990, tandis que d’innombrables chevaux ont contribué aux séries historiques qui inondent aujourd’hui les plateformes de streaming.

Mais les affaires ne vont plus aussi bien qu’avant pour les dresseurs qui se spécialisent dans la location d’animaux de toutes sortes aux productions cinématographiques et télévisuelles.

À lire aussi : Décoloniser notre rapport aux animaux pour inventer un nouveau rapport au monde

Selon The Hollywood Reporter, la tendance est présente depuis au moins vingt-cinq ans, et elle est due à un mélange d’activisme en faveur des droits des animaux et de progrès technologiques, ce que j’ai observé moi-même dans mes recherches sur les animaux à l’écran.

Moins de rôles à se partager

L’adoption par Hollywood des images de synthèse a joué un rôle immense dans la « mise au chômage » de ces animaux « acteurs ». Depuis que Jurassic Park (1993) a osé mêler des dinosaures en computer-generated imagery (CGI) à des acteurs humains, de plus en plus d’animaux numériques sont apparus aux côtés des humains.

Mais d’autres facteurs ont accéléré cette tendance. La pandémie de Covid-19, les grèves des acteurs et scénaristes hollywoodiens de 2023 et une récente baisse du nombre de nouvelles séries télévisées ont entraîné une diminution du nombre de productions et de rôles disponibles, qu’ils soient destinés à des humains ou à des animaux.

Mais, même avant ces événements récents, des voix s’élevaient pour demander à Hollywood de réduire radicalement sa dépendance vis-à-vis des animaux de cinéma.

En 2012, The Hollywood Reporter – le même magazine spécialisé qui a récemment déploré une baisse des locations d’animaux – a publié un reportage répertoriant des incidents au cours desquels des animaux sont morts, ont été blessés ou ont été exposés à de graves dangers sur les plateaux. Ces productions ont néanmoins continué à arborer le célèbre crédit « No Animals Were Harmed » (« Aucun animal n’a été maltraité durant ce tournage ») décerné par l’American Humane Association, quand bien même les animaux avaient été maltraités. L’American Humane Association a affirmé que ces incidents étaient tragiques, mais sans conclure qu’ils résultaient d’une négligence.

En 2016, l’association Pour une éthique dans le traitement des animaux (PETA) a publié les résultats d’enquêtes menées sous couverture documentant des conditions de vie inférieures aux normes et des problèmes médicaux non traités chez Birds & Animals Unlimited, qui gère des centres de dressage d’animaux pour le cinéma et la télévision. En 2024, l’organisation a détaillé les cas de négligence envers les animaux confiés aux soins d’Atlanta Film Animals. Les deux sociétés ont nié ces allégations.

Il existe bien sûr de nombreuses façons de réduire au minimum, voire d’éviter complètement, l’utilisation d’animaux réels au cinéma et à la télévision.

La Planète des singes : Les Origines et ses suites ont utilisé la capture de mouvement, c’est-à-dire des humains reproduisant les mouvements de personnages qui ont ensuite été transformés par images de synthèse en chimpanzés, gorilles, bonobos et orangs-outans.

Pour la production d’Ang Lee de 2012, l’Odyssée de Pi, les artistes en effets visuels ont créé des milliers d’animaux virtuels (cependant, un tigre du Bengale en chair et en os a également été sollicité et a failli se noyer, ndlr), tandis que le réalisateur Darren Aronofsky a opté pour des animaux entièrement numériques, complétés par quelques accessoires réels, dans Noé, en 2014.

À contre-courant des tendances high-tech, le film d’horreur Primate (2025) a fait un retour aux sources sans recourir à de vrais animaux, en faisant appel à un artiste vêtu d’un costume et de prothèses pour incarner un chimpanzé enragé et meurtrier.

Les images de synthèse peuvent-elles désensibiliser les spectateurs à la violence envers les animaux ?

Il existe sans aucun doute des dresseurs qui se soucient profondément de leurs protégés et respectent les meilleures pratiques en matière d’élevage. Mais il va de soi que moins il y a d’animaux en captivité, mieux c’est, et les récentes avancées en matière d’IA ont rendu les effets visuels et les images de synthèse encore plus réalistes et plus faciles à modéliser.

Cependant, le fait de remplacer des animaux en chair et en os par des créatures faites de pixels semble avoir ouvert la voie à des abus sans limites. Prenons l’exemple de la violence brutale dans les remakes de la Planète des singes, qui incluent des combats au corps à corps, le marquage au fer rouge et une scène de crucifixion.

Autrefois, le fait que les animaux présents sur le plateau soient réels freinait parfois les pulsions les plus sauvages des cinéastes ; la violence était suggérée ou se déroulait hors champ dans des films familiaux comme Jody et le faon (1946) et Fidèle Vagabond (1957).

Parallèlement, des astuces de caméra et des accessoires ont été utilisés pour créer des scènes de cruauté envers les animaux dans de nombreux films, d’American Psycho (2000) à John Wick (2014).

Bien que les effets des médias violents sur les spectateurs soient notoirement difficiles à étudier, certaines données suggèrent que certains publics peuvent devenir insensibles aux conséquences réelles de contenus malsains et violents. On comprend aisément comment cette désensibilisation pourrait s’étendre au visionnage de scènes de cruauté envers les animaux à l’écran.

Les spectateurs peuvent encore flairer le virtuel

Une approche hybride de la représentation des animaux à l’écran semble s’être imposée, utilisant ce qu’un chercheur a appelé – en référence aux chiens à l’écran – des « performances canines composites ».

L’équipe à l’origine de la version 2025 de Superman, par exemple, a cherché à créer un chien réaliste, jusque dans les moindres poils ébouriffés. Mais il fallait qu’il défie la gravité et d’autres lois de la physique. Ils ont donc intégré juste assez d’animaux réels en préproduction pour animer une créature principalement en images de synthèse, le chien du réalisateur James Gunn servant de « modèle », ou de « référence » au super-chien Krypto.

Cette technique rappelle les méthodes des animateurs de Disney qui, face au défi de créer les personnages de Bambi (1942), se sont retrouvés dans une impasse. Ils ont donc étudié l’anatomie animale, photographié des cerfs dans la nature et dessiné des animaux amenés au studio afin de mieux capturer leurs mouvements sur le papier.

Mais lorsqu’il s’agit de films en prises de vues réelles ancrés dans la vie quotidienne, les animaux réels ont encore leur place sur le plateau. D’une part, il est généralement moins coûteux de faire appel à de vrais animaux. De plus, la plupart des animaux virtuels à l’écran ne sont tout simplement pas assez réalistes pour permettre la suspension totale de l’incrédulité qui fait la magie du cinéma.

C’est pourquoi, dans l’adaptation de 2025 des Mémoires d’Helen MacDonald, H Is for Hawk, les cinéastes auraient utilisé cinq vautours pour incarner Mabel, l’oiseau adopté par Helen (Claire Foy). C’est pourquoi le film Marty Supreme, nominé aux Oscars, mettait en scène toute une ménagerie d’animaux vivants, notamment un cheval, un chameau, un tatou, un chien, un lapin et même un lion de mer jouant au ping-pong. Oui, l’otarie de la scène était réelle, mais la balle ne l’était pas.

L’avenir des dresseurs et de leurs protégés semble dépendre de la qualité des effets visuels. Pour certains défenseurs des animaux – sans parler des animaux eux-mêmes, qui n’ont pas leur mot à dire sur leur travail –, ce jour n’arrivera jamais assez tôt.

Les cinéphiles et les défenseurs des animaux, quant à eux, pourraient espérer un juste milieu : un avenir dans lequel seuls les animaux traités de manière éthique continueraient à apparaître à l’écran.

Cynthia Chris ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

13.04.2026 à 16:38

What fish redistribution in the Mediterranean is telling us about species’ climate resilience

Texte intégral (1726 mots)

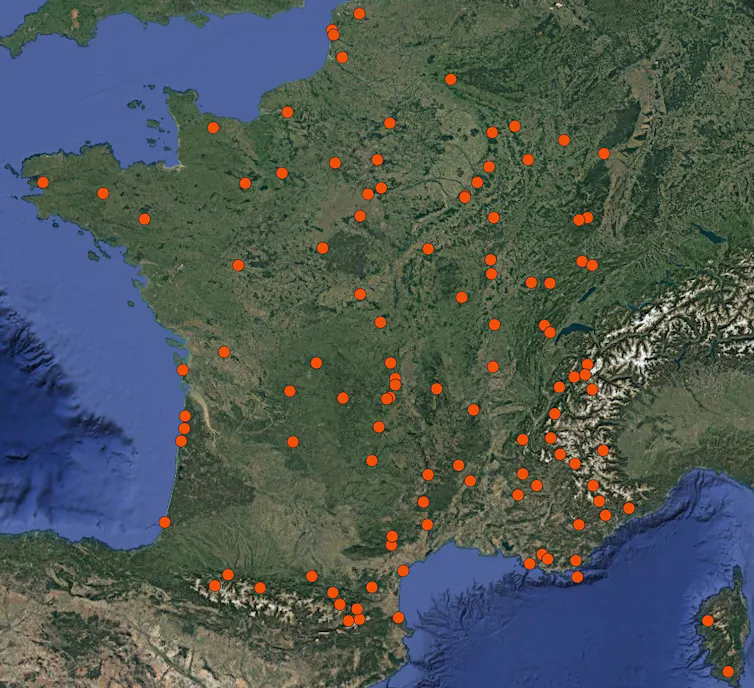

Over the past twenty years, nearly half of commercially important Mediterranean fish species have shifted their distribution due to climate change, causing marine species to move away from their historical locations. These significant changes in fish habits are expected to have a major impact on biodiversity, ecosystems and fishing opportunities.

On a global scale, species have been observed shifting towards higher latitudes and depths, in search of cooler conditions.

However, at regional scales, the picture is far more complex. Our recent study demonstrates that in the Mediterranean Sea, as a result of climate change, warm water-favouring thermophilic species that prefer moderately warm temperatures, such as the starry skate Raja asterias, are changing their distribution towards the south and west, while cool water-favouring boreal species, such as the black-bellied angler Lophius budegassa, are only changing their distribution in depth.

The broader picture of this ecological process is known as meridionalization through which native warm-water species expand and cold-water species decline.

Temperature-associated habitat selection: the Mediterranean predicament

The Mediterranean is one of the most vulnerable ecosystems in the world due to multiple and cumulative human pressures, including a high level of climate risk that will increase in the future. These combined impacts are already driving major ecological changes in marine species.

The Mediterranean is also a semi-enclosed basin, connected to the global ocean only through the Strait of Gibraltar, which limits the options available to species attempting to track suitable environmental conditions.

However, even if these Mediterranean species move north, they cannot go very far: they soon encounter geographical continental constraints, such as the French continental zone, in the Gulf of Lions.

An alternative to moving northwards is to move towards deeper waters in search of cooler temperatures, when their physiological limits allow it. However, at the regional scale, the picture is far more complex, with very different dominant patterns emerging.

In our recent scientific study conducted along the eastern Spanish Mediterranean coast, from Murcia to northern Catalonia:

“ We found that almost half of the commercially valuable Mediterranean species have changed their distribution over the last two decades: 42 out of the 102 species analysed showed significant distributional shifts.”

Although these changes vary among species, they are dominated by southward and south-westward movements along the Iberian Peninsula, particularly towards the Gulf of Alicante.

Depth-related changes were also diverse, but were mainly characterised by shifts towards shallower waters.

Why are fish moving ‘swimming against’ global patterns, southwards and toward shallower waters?

These species shifts can be explained by local climate velocity, a measure that describes both the speed and direction of ocean warming.

Climate velocity tracks the rate of change in sea surface temperature, indicating the direction and speed species should move to conserve the initial or preferred temperature conditions of their habitat. As such, if species displacements correlate with climate velocity, species are more likely to remain within suitable climatic conditions.

Our results show that the largest distributional shifts are strongly associated with areas experiencing the fastest warming. As a result, many species have shifted the centre of distribution of their populations towards the south-west.

Among these species are the four-spot megrim (Lepidorhombus boscii, the picarel (Spicara smaris and the starry ray Raja asterias, which given their preference for moderately warm-water temperature, have moved south-westwards, shifting in the same direction as the velocity climate change. However, in addition to the horizontal displacement, they have also moved toward shallower waters:

“Contrary to our expectations, species were predominantly shifting towards shallower waters, more coastal areas because depth naturally decreases in this region as species move south.”

These findings highlight the regional-scale impacts of climate change on commercially important marine species. There is an urgent need to implement climate-smart fisheries management measures, as adaptation to climate change is no longer a future challenge, but a present-day necessity.

Climate-smart solutions involve management measures that focus on implementing regional and local strategies such as identifying marine climate refugia, which attract species and provide an environment in which fish stocks can thrive in spite of climate change, and that prioritises their protection and conservation.

Improving the adaptative responses of the small-scale fishing sector is also a key climate-smart solution. This can only happen if fishers and local communities play a significant role in the decision-making processes, and if scientists, fisheries and policymakers work together to adopt much needed climate-adaptive practices.

This article was co-written with the help of the following authors: Hidalgo, M., Puerta, P., García Molinos, J., Zamanillo, M., Brito-Morales, I., González-Irusta, J. M., Esteban, A., Punzón, A., García-Rodríguez, E., Vivas, M., & López-López, L.

Created in 2007 to help accelerate and share scientific knowledge on key societal issues, the Axa Research Fund – now part of the Axa Foundation for Human Progress – has supported over 750 projects around the world on key environmental, health & socioeconomic risks. To learn more, visit the website of the AXA Research Fund or follow @ AXAResearchFund on LinkedIn.

A weekly e-mail in English featuring expertise from scholars and researchers. It provides an introduction to the diversity of research coming out of the continent and considers some of the key issues facing European countries. Get the newsletter!

Marina Sanz-Martín (MSM) and co-authors acknowledge the crew and staff of the Spanish Institute of Oceanography (CN-IEO, CSIC) for collecting and providing long-term survey data for the MEDITS program and facilitating a unique record of ffish distribution and abundance. This research was performed as part of the VADAPES project, funded with the support of the Biodiversity Foundation of the Spanish Ministry for the Ecological Transition and the Demographic Challenge; the CLISSARTES project (AXA-007), funded by AXA Research Fund; and the COCOCHA project (PID2019-110282RA-I00) funded by the Spanish Ministry of Economy and Competitiveness, Feder funds and the Spanish Research Agency. MSM acknowledges funding from the Government of the Balearic Islands through a Vicenç Mut postdoctoral grant. The authors acknowledge the development and maintenance of online repositories and databases such as COPERNICUS, EMODNET, AQUAMAPS, OBIS, Bio-Oracle, FishBase, and SEALIFEBASE, and their fundamental role in advancing knowledge in marine and fisheries science.

13.04.2026 à 11:40

Attention, les activités des entreprises pourraient devenir inassurables

Texte intégral (1721 mots)

Dans un contexte d’accélération du risque climatique, les assureurs voient leur rôle évoluer auprès des entreprises. La question n’est plus seulement « combien cela coûtera ? », mais aussi « comment éviter que certaines activités deviennent tout simplement inassurables ? » Zoom sur les petites et moyennes entreprises, cœur du tissu économique français.

Longtemps amortisseuse, l’assurance est aujourd’hui sous tension face à des sinistres plus fréquents et coûteux. Rien que pour les tempêtes Nils et Pedro, en février 2026, ainsi que les inondations dans l’ouest et le sud-ouest de la France, France Assureurs et la Caisse centrale de réassurance estiment le coût des dommages à 1,2 milliard d’euros.

Le changement climatique n’est plus seulement une question environnementale. Les risques financiers liés au climat deviennent matériels pour l’économie française, européenne et mondiale. Ainsi, 80 % des entreprises ont subi des perturbations opérationnelles, des fermetures temporaires (70 %) et une hausse de plus de 150 % des coûts d’assurance.

Si les compagnies d’assurance ne couvrent plus certains territoires ou certains secteurs, les coûts se déplaceront vers les entreprises avec un risque de fragilisation du crédit et de stabilité financière.

Un monde à + 4 °C, inassurable

En 2015, Henri de Castries, alors dirigeant d’AXA, avertissait : « Un monde à + 2 °C pourrait être assurable, mais un monde à + 4 °C ne le serait certainement pas. » Dans la cartographie prospective 2026 de France Assureurs, le risque d’inassurabilité s’impose comme la préoccupation centrale de long terme, au côté du risque climatique et des enjeux liés à l’intelligence artificielle.

En effet, les phénomènes climatiques extrêmes gagnent en fréquence et intensité et tendent à devenir une nouvelle norme. Dans certains territoires, ces chocs poussent déjà des assureurs à se retirer – la Californie en a donné un aperçu avec les incendies qui ont ravagé l’État : pas moins de 100 000 Californiens ont perdu leur couverture entre 2019 et 2024.

En France, la Direction générale des entreprises (DGE) estime que « deux millions d’établissements seraient fortement exposés à une augmentation du risque de tempête ». Elle souligne que les tempêtes et les inondations touchent directement les actifs, tandis que les vagues de chaleur dégradent la productivité du travail.

Pour les entreprises, on distingue les risques physiques, aigus liés à des événements extrêmes, et chroniques, liés à des évolutions de long terme. Ces risques finissent par se traduire en risques financiers pour les entreprises – sur les actifs, les chaînes de valeur, les conditions de travail et, in fine, leur productivité.

Seuls 12 % des entreprises ont défini une stratégie d’adaptation

Selon l’Insee, la France comptait en 2021 159 000 petites et moyennes entreprises (PME) marchandes, non agricoles et non financières (hors microentreprises), représentant 4,3 millions de salariés. À l’échelle européenne, elles sont 23 millions, soit environ deux tiers des emplois.

Une gestion préventive des risques climatiques devient une nécessité, même si elle reste encore peu répandue – à l’exception de certains secteurs particulièrement exposés, comme l’agriculture. Dans ce secteur, le coût de l’adaptation est élevé (plus d’une dizaine de milliards d’euros d’investissements d’ici à 2050), mais demeure inférieur au coût de l’inaction.

À lire aussi : À la fin, qui prendra en charge le coût des assurances ?

Selon une enquête réalisée en 2024 par Bpifrance, « 68 % des dirigeants ne considèrent pas l’adaptation au changement climatique comme un enjeu majeur », seuls 12 % ont défini une stratégie d’adaptation et 57 % estiment que leur entreprise est aujourd’hui faiblement exposée aux aléas climatiques.

Trop peu d’entreprises disposent aujourd’hui de véritables plans de résilience, alors même que la résilience devrait devenir un « critère de décision stratégique ». Ce décalage tient à la nature même du risque : tant que l’impact financier n’est pas tangible – sur les actifs, l’activité ou la trésorerie –, il est difficile, pour un dirigeant, d’en mesurer l’ampleur et d’engager des mesures d’adaptation.

Les PME en première ligne

Les PME disposent rarement des mêmes marges de manœuvre que les grands groupes : moins de trésorerie pour absorber un choc, moins d’équipes vouées à la gestion des risques, et moins de poids pour négocier des conditions de couverture. Leur exposition est souvent très concrète, avec des dommages sur leurs bâtiments et leurs machines, des arrêts de production, des tensions logistiques et des effets domino chez les fournisseurs ou les clients.

Elles peuvent se retrouver insuffisamment couvertes – voire pas couvertes du tout – contre certains événements, tels que les inondations, les glissements de terrain, les submersions, les canicules. En 2025, 74 % des très petites entreprises (TPE) et des PME disposent d’une couverture inadaptée, soit environ 3,3 millions d’entreprises concernées.

À lire aussi : DAF et risques climatiques : pourquoi l’inaction devient le principal risque financier des entreprises

Parce que beaucoup de PME ne sont pas directement soumises aux obligations de reporting en durabilité comme la Directive relative à la publication d’informations en matière de durabilité (CSRD), le risque est de repousser la question. Pourtant, mesurer quelques informations clés – exposition, vulnérabilités, plans d’action – aide à piloter l’adaptation et à dialoguer avec les partenaires financiers, les assureurs et les grands donneurs d’ordre.

Assurance paramétrique

L’étude de Bpifrance rappelle que les dirigeants de PME et d’entreprises de taille intermédiaire (ETI) ont besoin d’être accompagnés. Dans ce contexte, les parties prenantes externes (banques, assureurs, grands donneurs d’ordre) intensifient leurs attentes, ce qui ouvre la voie à de nouveaux outils de conformité et à des évolutions stratégiques.

Pour un assureur, le risque renvoie à un événement dommageable, de survenance incertaine, qui devra être indemnisé. La Caisse centrale de réassurance (CCR) estime que « la hausse de la sinistralité du seul fait du climat serait comprise entre 27 % et 62 % en moyenne à horizon 2050 ». Certaines zones, plus exposées, connaissent déjà des difficultés d’accès à l’assurance.

Parmi les réponses possibles, l’assurance paramétrique – qui déclenche un paiement en fonction de paramètres météorologiques – constitue un levier intéressant de résilience climatique.

Le nouveau rôle des assureurs

C’est ici que l’assurance peut jouer un rôle décisif. Au-delà de l’indemnisation, elle peut contribuer à réduire les dommages en amont et à maintenir l’assurabilité du tissu économique. Trois pistes, déjà à l’œuvre dans certains marchés, méritent attention :

Inciter à la résilience : ajuster primes et franchises, offrir des bonus ou de meilleures conditions lorsque des mesures de prévention sont mises en place ;

Partager données et expertise : fournir cartographies, retours d’expérience et indicateurs pour aider les PME à comprendre leur exposition et agir ;

Proposer des services de prévention : diagnostics, recommandations opérationnelles et accompagnement vers des solutions adaptées, y compris l’assurance paramétrique.

L’efficacité de l’ensemble des solutions assurantielles face aux aléas climatiques suppose en effet une sensibilisation accrue des entreprises et… du public.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

13.04.2026 à 11:40

Entrepreneuriat : quand la science balaie les idées reçues sur les start-up, les savoir-être…

Texte intégral (1517 mots)

Incubateurs, subventions, formations à la créativité… les dispositifs de soutien à l’entrepreneuriat se multiplient en France. Ces solutions sont-elles vraiment efficaces ? Et si les « bonnes idées » pour stimuler l’entrepreneuriat freinaient en réalité l’innovation qu’elles prétendent pourtant encourager.

L’injonction à entreprendre n’a jamais été aussi forte. Pour dynamiser l’économie et transformer les territoires, la réponse des pouvoirs publics et des acteurs économiques semble invariablement être la même : « Plus d’accompagnement, plus d’incitations, plus de passion. » Pourtant, cette approche intuitive, souvent guidée par de bonnes intentions, se heurte parfois violemment à la réalité du terrain.

Dans l’imaginaire collectif comme dans les discours politiques, l’entrepreneuriat est souvent paré de vertus magiques. Il suffirait de libérer les énergies, de financer l’audace et de multiplier les structures d’accueil pour que l’innovation fleurisse. Mais les politiques publiques, tout comme les stratégies d’accompagnement, gagnent à être évaluées à l’aune de la recherche scientifique. C’est précisément la mission que s’est assignée le réseau R2E.

Alliance scientifique entre l’Université de Lorraine, l’Université de Strasbourg, l’Université de Reims Champagne-Ardenne, Neoma Business School et YSchools, ce collectif fédère plus de 230 chercheurs de différentes disciplines (gestion, économie, sciences politiques), avec l’objectif de faire émerger un « entrepreneuriat par la preuve » (evidence-based entrepreneurship). Par ricochet, il s’agit aussi de mettre en lumière des phénomènes contre-intuitifs qui remettent en question bien des certitudes.

À lire aussi : Y a-t-il une part d’inconscient dans l’entrepreneuriat ?

Trop de soutien tue le soutien ?

L’une des premières pierres d’achoppement identifiées par les travaux récents concerne l’architecture même de l’écosystème entrepreneurial. Pour stimuler l’entrepreneuriat et la création d’entreprises, les dispositifs se sont multipliés, sans réflexion sur l’efficacité globale de ces multiples dispositifs, allant des incubateurs aux accélérateurs et autres guichets uniques, subventions régionales, aides nationales…

Or, l’analyse de terrain révèle un effet pervers de cette générosité publique, provoquant un effet « millefeuille ». La sédimentation des dispositifs crée un environnement illisible. Au lieu de se sentir soutenus, les porteurs de projet se retrouvent aux prises avec une complexité administrative chronophage. Le temps passé à décrypter les critères d’éligibilité ou à naviguer entre des injonctions parfois contradictoires est du temps soustrait au développement du produit ou à la recherche de partenaires ou de clients.

La recherche montre ainsi que, au-delà d’un certain seuil, l’abondance de soutiens désorganisés devient un frein. Il convient de sortir de la logique administrative (remplir des dossiers de subvention), pour favoriser le développement de l’activité de l’entrepreneur. En effet, les différentes structures d’accompagnement doivent rendre des comptes à leurs financeurs créant un effet de justification en cascade. La recommandation qui émerge en est claire : l’efficacité des politiques publiques ne réside pas dans le volume des aides, mais dans leur coordination et leur simplicité. Dit autrement : « Trop de soutien tue le soutien. »

L’illusion des « soft skills »

Les études récentes s’attachent également à déconstruire le portrait-robot de l’entrepreneur idéal, souvent romancé par les médias. On nous présente la figure de l’entrepreneur visionnaire, mû par une passion dévorante et des soft skills relationnels hors normes. On imagine volontiers que c’est l’envie de « changer le monde » (purpose-driven action) qui constitue le moteur principal, notamment chez les jeunes générations.

Pourtant, les données racontent une histoire plus pragmatique. Si la passion est une étincelle, elle ne suffit pas à alimenter le moteur sur la durée. Les travaux empiriques soulignent que l’intention entrepreneuriale se transforme en action concrète principalement grâce à la maîtrise de compétences techniques et financières. Comprendre un business plan, anticiper des besoins de trésorerie ou évaluer un seuil de rentabilité sont des facteurs bien plus déterminants pour « passer le cap » que la seule audace créative.

Pourquoi ? Parce que la compétence financière réduit l’incertitude. Elle transforme une peur irrationnelle de l’échec en un risque calculé et gérable. En survalorisant le discours fondé sur les inspirations au détriment des hard skills de gestion, les formations risquent de passer à côté de l’essentiel. De même, les motivations des jeunes entrepreneurs restent, dans la réalité, fortement ancrées dans des logiques économiques et personnelles, bien loin de l’image d’Épinal d’une génération purement altruiste et naturellement talentueuse.

Se lancer plutôt que se (sur)informer

Ce besoin de compétences tangibles se heurte à un autre phénomène contemporain, le « paradoxe de l’abondance informationnelle ». À l’ère du numérique, les jeunes entrepreneurs ont accès à une quantité illimitée de données : benchmarks, études de marché en ligne, retours d’expérience sur les réseaux sociaux…

L’intuition voudrait que plus on est informé, meilleure sera la décision. Cela ne reflète pas vraiment la réalité du terrain, puisque de l’abondance à la surcharge il n’y a qu’un pas et que cette surcharge tend à paralyser l’action. Les jeunes entrepreneurs surinvestissent la phase de recherche, cherchant la réponse parfaite ou la réassurance absolue dans les données, retardant la confrontation au terrain.

Là où l’entrepreneuriat exige de l’expérimentation et de l’agilité, l’infobésité crée de l’inertie. Apprendre à filtrer et à limiter l’information devient dès lors une compétence critique à enseigner.

La reprise d’entreprise, une voie à creuser

Enfin, l’approche scientifique permet de réévaluer des modèles souvent jugés moins « sexy » que la start-up technologique, comme la reprise d’entreprise. Souvent perçue comme risquée ou réservée à des profils seniors, la reprise souffre d’un déficit d’image.

Pourtant, les crises successives ont agi comme des révélateurs. Les entrepreneurs ayant vécu une reprise d’entreprise démontrent une résilience supérieure en période de turbulences. Avoir dû s’adapter à une structure existante, comprendre sa culture et la transformer sans la briser constituent tous trois un apprentissage inestimable. La crise ne fait souvent que renforcer ces mécanismes d’adaptation.

Le danger de l’isolement

De plus, l’idée que la reprise est intrinsèquement risquée est contestée par les faits. Ce n’est pas l’opération qui est dangereuse, c’est l’isolement du repreneur. Les dirigeants en sont d’ailleurs pleinement conscients. Selon le sondage ELABE (2023) « Les dirigeants et la cession-transmission d’entreprise », 91 % d’entre eux estiment qu’il est important d’être accompagné par des tiers dans ce type de démarche. La reprise encadrée présente ainsi des taux de pérennité remarquables.

Il y a là un gisement de croissance et de sauvegarde de l’emploi que les politiques territoriales gagneraient à prioriser, plutôt que de tout miser sur la création ex nihilo.

Éclairer les décideurs, ce n’est pas seulement valider leurs choix, c’est parfois, et cela est salutaire, challenger les idées reçues pour éviter le gaspillage de ressources publiques. Pour transformer nos territoires, l’entrepreneuriat ne doit plus être seulement une incantation, mais une science de l’action, lucide et ancrée dans les réalités complexes de la société.

Ce texte a été rédigé avec Élisa Mathieu, ingénieur d’études, membre de R2E.

Christophe Schmitt est membre de R2E (Recherche et Expertise en Entrepreneuriat). Il a reçu des financements de l’Union Européenne dans le cadre du Programme opérationnel FEDER et de la Région Grand Est.

13.04.2026 à 11:40

L’histoire de notre petite enfance peut avoir un impact concret dans nos relations au travail

Texte intégral (1295 mots)

En entreprise, tous les salariés ont des réactions différentes. Sécure, anxieux ou évitant, ces styles de relation, remontant à la petite enfance, peuvent se réactiver au travail. Comment mieux comprendre cette psychologie de l’attachement pour accompagner la santé mentale en entreprise (et prévenir les burn out) ?

La détresse psychologique en entreprise ne résulte pas seulement d’une surcharge de travail ou d’un manque de ressources. Elle se construit dans les interactions quotidiennes. Un feed-back peut être vécu comme une remise en cause. Un silence peut être interprété comme un rejet.

Le Baromètre 2026 de la santé mentale au travail indique que 22 % des salariés français se déclarent en mauvaise santé mentale, contre 26 % en 2025. Cette amélioration reste fragile. Près de six millions de personnes vivent encore une détresse psychologique durable, associée à une baisse de l’engagement et à une dégradation de la coopération au travail.

Face à ces constats, les entreprises ont multiplié les dispositifs de prévention. Par exemple, elles déploient des cellules d’écoute, des formations aux risques psychosociaux et des plateformes d’accompagnement. Ces outils sont nécessaires, mais ils interviennent souvent lorsque les difficultés sont déjà installées. Ils permettent d’identifier des symptômes individuels sans toujours agir sur les mécanismes qui les produisent.

La santé mentale au travail dépend en grande partie de la manière dont les individus interprètent et régulent leurs émotions. La psychologie de l’attachement, initialement développée par le psychanalyste John Bowlby en 1958, permet d’éclairer ces mécanismes. Cette théorie postule que tout individu a besoin d’une relation d’attachement avec au moins une personne qui prend soin de lui, un caregiver, notamment dans la petite enfance. Cette relation est censée procurer un sentiment de sécurité. Elle conduit à la construction de modèles internes qui orientent la perception de soi, des autres et des situations sociales.

Nos travaux menés dans le cadre du projet de l’Agence nationale de la recherche ATTACHED montrent que ces modèles ne disparaissent pas à l’âge adulte. Ils se réactivent dans les situations professionnelles, en particulier lorsque les individus sont confrontés à de l’incertitude ou à des tensions, comme nous l’avons étudié avec Ange Abalé en 2025.

Sécurisant, anxieux ou évitant

La littérature distingue trois grandes tendances d’attachement, également observées dans nos recherches en milieu professionnel.

Un style sécure favorise la confiance en soi et en autrui. Le désaccord peut alors être discuté sans être vécu comme une menace identitaire. Cette posture facilite des échanges ouverts et soutient la coopération.

Un style anxieux se traduit par une hypersensibilité aux signaux sociaux. Une remarque peut rapidement être perçue comme une critique. Cette hypervigilance favorise la rumination et le stress.

Un style évitant conduit à minimiser l’importance des émotions et de la dépendance mutuelle. Face à la tension, la stratégie consiste souvent à se distancier ou à rationaliser, ce qui peut freiner l’expression des difficultés et retarder leur résolution.

À lire aussi : La prévention, la clé pour protéger la santé mentale au travail

Ces tendances ne constituent pas des profils figés : elles varient selon les contextes organisationnels. Leur intérêt réside dans leur capacité à rendre visibles ces mécanismes implicites qui influencent la manière dont les contraintes du travail sont vécues.

Régulation émotionnelle au travail

Identifier ces mécanismes ouvre des leviers d’action. Lorsqu’un salarié comprend que son agitation face à un feed-back s’inscrit dans un mode d’interprétation particulier, il peut ajuster sa réponse. Lorsqu’un manager identifie sa tendance à se distancier dans le désaccord, il peut apprendre à maintenir le lien sans éviter la discussion. La prévention ne se limite ainsi plus à une logique corrective. Elle devient un travail sur la qualité des interactions.

Certaines entreprises cherchent à intégrer cette dimension relationnelle dans leurs dispositifs de prévention. C’est le cas d’ENGIE qui a mis en place un réseau de « capteurs terrain ». Leur rôle consiste à repérer des signaux faibles, comme une fatigue inhabituelle, un retrait relationnel ou des variations d’humeur, puis à engager un échange avec le salarié concerné.

Ces acteurs de proximité n’ont pas vocation à traiter directement les situations identifiées. Leur fonction est d’écouter, de créer un premier espace de dialogue et d’orienter vers les ressources appropriées (médecine du travail, ressources humaines, accompagnement psychologique), avec l’accord du salarié. Cette approche repose sur une logique de détection précoce et de responsabilisation collective, en s’appuyant sur les interactions quotidiennes de travail.

Transformer les relations au travail

La détresse psychologique ne se comprend pas uniquement à l’échelle individuelle. Elle se construit dans des situations de travail concrètes, au croisement des contraintes, des interactions et des modes d’organisation.

Transformer les relations au travail suppose alors de déplacer le regard. Il ne s’agit plus seulement d’accompagner des individus en difficulté, mais d’agir sur ce qui structure leurs échanges au quotidien : la manière de coopérer, de donner du feed-back ou de gérer les désaccords.

Cette évolution se manifeste aussi à l’échelle nationale. Par exemple, la Charte d’engagement pour la santé mentale au travail, lancée en 2025, a déjà été signée par plus de 170 entreprises. Elle mobilise notamment plusieurs leviers : former les managers et développer le dialogue social sur la santé psychologique au travail, améliorer en continu la qualité de vie et des conditions de travail (QVCT). Elle invite ainsi à intégrer les conditions relationnelles.

Les expériences de notre petite enfance façonnent encore nos relations au travail. Les comprendre permet de nourrir des échanges plus fluides, une coopération plus solide et une meilleure gestion du stress.

Ludivine Adla a reçu des financements de l'Agence nationale de la recherche.

13.04.2026 à 11:40

Entre paillettes et éthique : l’influence responsable est-elle un mirage ?

Texte intégral (1807 mots)

Entre modèles inspirants et panneaux publicitaires ambulants, les influenceurs suscitent autant d’admiration que de rejet. Malgré son essor fulgurant et son attrait pour les marques, le marketing d’influence et les dérives éthiques qui y sont associées interrogent. Dans ce contexte, l’émergence d’une influence responsable est-elle possible ?

L’intensification récente des conflits armés au Moyen-Orient a vu Dubaï devenir le théâtre de scènes d’agitation : traversées de missiles, incendies, détonations… De quoi faire naître la peur chez les habitants de la ville parmi lesquels des influenceurs expatriés. Ces stars des réseaux sociaux, qui jusqu’ici vantaient les mérites de Dubaï qu’ils considéraient comme un havre de paix, ont, dans les premières heures du conflit, exprimé leur peur et sollicité l’aide de la France et des services de l’État, avant d’adopter une attitude plus discrète, rigueur de la loi locale oblige.

Mais sur la toile, ces prises de parole ont suscité une vague de moqueries. Cette mésestime s’est muée en indignation lorsque certains, pressés de regagner la France, n’ont pas hésité à abandonner sur place leurs animaux de compagnie, pourtant mis en scène quotidiennement comme des accessoires de leur « lifestyle ». Ces comportements, dans un contexte tragique, viennent cristalliser une défiance générale déjà latente nourrie par les nombreuses dérives éthiques qui ont entaché le marketing d’influence ces dernières années.

À lire aussi : Pourquoi il fallait encadrer davantage la publicité faite par les influenceurs

Des dérives commerciales

Les influenceurs sont des relais entre le public et les marques grâce à diverses pratiques telles que le placement de produit souvent accompagné du partage des fameux « codes promo ». De ces pratiques a émergé une remise en cause de l’ensemble du secteur. Les influenceurs ont largement été critiqués pour leur manque de transparence et d’authenticité, pour le doute que certains laissent planer quant au caractère commercial des contenus qu’ils diffusent.

Outre la forme, c’est également le fond de leurs contenus qui suscite des interrogations. Dropshipping (traduit par « livraison directe », il s’agit d’un modèle de distribution consistant à vendre en ligne des produits sans avoir à les stocker ou à les expédier soi-même), promotion de produits inefficaces voire dangereux, de contrefaçon, de formations douteuses, d’arnaques financières, de chirurgie esthétique, telles sont les accusations dont ont fait (et font parfois encore) l’objet certains influenceurs donnant naissance au terme « influvoleur » popularisé par le rappeur Booba.

De façon plus générale, le modèle de l’influence commerciale génère d’importants risques de manipulation et d’exploitation des vulnérabilités des consommateurs, en particulier des jeunes.

Une structuration progressive

Face à l’ampleur des dérives, les instances de régulation ont réagi en particulier avec l’entrée en vigueur de la loi n°2023-451 du 9 juin 2023. Il s’est agi d’établir des définitions légales, d’interdire la promotion de certains produits et d’accroître les contrôles. L’Autorité de régulation professionnelle de la publicité (ARPP) occupe également un rôle clé dans la responsabilisation des acteurs de l’influence grâce à sa formation pour l’obtention du Certificat de l’influence commerciale responsable ou bien encore à l’Observatoire de l’influence responsable.

Bien que les pratiques abusives soient davantage sanctionnées et que le nombre de dérives semble diminuer, l’image des influenceurs reste entachée. Et c’est notamment la présence de nombreux influenceurs français à Dubaï qui cristallise les critiques. La ville est devenue un véritable hub pour ces personnalités parfois fortunées, notamment en raison de ses conditions fiscales avantageuses.

Pour le grand public, ce choix est difficile à accepter : des influenceurs qui s’adressent à des communautés résidant en France choisissent de s’installer à l’étranger pour des raisons fiscales. Dans ce contexte, après avoir publié un tweet moqueur, le youtubeur Tibo InShape a déclaré :

« Aujourd’hui le but, c’est de dénoncer l’hypocrisie des influenceurs qui sont à Dubaï, qui fuient les impôts, qui fuient, pour certains, la justice française. Je ne parle pas de tous les influenceurs, mais je parle de ceux qu’on appelle “influvoleurs” qui arnaquent les Français. »

Certains ironisent alors en rappelant aux influenceurs qu’un retour en France pourrait être synonyme de contrôle fiscal immédiat et diffusent des images représentant des gardes-frontières à l’aéroport tenant un panneau sur lequel il est inscrit « À tous les influenceurs et autres exilés fiscaux à Dubaï, l’administration fiscale vous souhaite un bon retour en France ».

Des enjeux éthiques

Le phénomène du marketing d’influence s’inscrit ainsi dans un paysage complexe et évolutif marqué par la nécessité d’en appréhender les enjeux éthiques. C’est notamment ce que nous avons étudié dans notre article « Vers une influence responsable ? Perception des produits à forte charge éthique et vulnérabilité des cibles », dans lequel nous avons introduit la notion de « responsabilité sociale de l’influenceur » (RSI). Cette responsabilité est notamment liée aux choix relatifs aux produits promus à travers les contenus diffusés, la prise en compte de la vulnérabilité des cibles ainsi que l’exigence de transparence quant à la nature commerciale des contenus et des partenariats établis avec les marques.

Malgré une amélioration progressive des pratiques, la situation actuelle montre qu’il y a encore du chemin à parcourir avant de parvenir à rendre l’influence commerciale véritablement responsable. Le rapport parlementaire, déposé en janvier 2026 par Arthur Delaporte et Stéphane Vojetta, souligne notamment la nécessité de continuer de tenter d’améliorer l’encadrement du secteur afin de protéger au mieux les consommateurs.

Cette dynamique de responsabilisation ne repose pas uniquement sur l’action des pouvoirs publics : plusieurs collectifs se forment pour encourager à l’amélioration des pratiques d’influence. C’est notamment le cas de Paye ton Influence. Piloté par Amélie Deloche (@amelie.dlch), ce collectif s’est donné pour mission de dénoncer les pratiques incompatibles avec les limites planétaires et en appelant à une transformation profonde du secteur.

Changer de l’intérieur

Certains influenceurs tentent également de faire évoluer le secteur de l’intérieur. C’est par exemple le cas de Charlotte Lemay (@chamellow), mannequin et influenceuse qui prône une influence à la fois consciente et écoresponsable. Elle est présidente de l’association à but non lucratif Aware Collective qui a pour but de sensibiliser les influenceurs aux pratiques écoresponsables et est co-autrice de l’ouvrage Influenceur·se engagé·e.

De façon générale, de plus en plus d’influenceurs (tels que @girl_go_green, @iznowgood ou @mylittlewayoflife) semblent vouloir s’inscrire dans cet objectif de responsabilisation du secteur, que ce soit en militant pour des causes sociales et environnementales ou en tentant d’adopter des pratiques animées par l’éthique, la transparence et l’authenticité. Cela peut se traduire par la proposition d’alternatives aux marques de fast-fashion, la promotion de marques locales et engagées ou bien encore l’incitation à consommer moins.

In fine, si le monde de l’influence tente de sortir de son « Far West » pour devenir une industrie plus responsable, le chantier reste immense. La plupart des rapatriés que nous évoquions au début de cet article reprendront dès qu’ils en auront l’occasion le chemin du mirage doré de Dubaï et de ses promesses fiscales au détriment de la solidarité et du respect du vivant. La véritable influence responsable ne se décrète pas dans un texte de loi, elle se prouve chaque jour par des actes qui se passent de filtres.

Charlène Carreteiro ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

12.04.2026 à 17:07

Comment éduquer à la transition écologique en dépassant la culpabilisation ?

Texte intégral (1617 mots)

Nos difficultés à passer à l’action en matière de transition écologique ne seraient pas tant liées à des biais cognitifs qu’à des freins émotionnels. Des émotions, telles que la peur ou la culpabilité, sont stériles, mais elles peuvent laisser la place à l’espoir de faire changer les choses. Tout du moins, à certaines conditions.

Nous n’avons jamais autant parlé de climat, de biodiversité et de transition écologique. Dans les universités, les écoles et les formations professionnelles, les contenus se multiplient. Les chiffres sont là, les diagnostics sont connus, l’urgence est largement documentée. Et pourtant, une question persiste : pourquoi savons-nous autant sans agir davantage ?

Ce décalage entre connaissances et action est aujourd’hui bien identifié. Il est souvent présenté comme un problème d’information, de volonté individuelle ou de contraintes matérielles. Mais les résultats récents de notre recherche suggèrent une autre lecture : le principal frein à l’action écologique ne serait pas cognitif mais émotionnel.

À lire aussi : La faute de nos biais cognitifs, vraiment ? Comment cette notion fabrique l’inaction écologique

Quand l’éducation à l’écologie fatigue

Dans de nombreux dispositifs éducatifs actuels, la transition écologique est abordée à travers des messages alarmants : effondrement des écosystèmes, extinction des espèces, urgence climatique. Ces discours sont scientifiquement fondés, mais leurs effets psychologiques sont rarement interrogés.

Chez les étudiants comme chez les apprenants adultes, ces messages suscitent fréquemment de la culpabilité, de la peur, voire un sentiment d’impuissance. L’individu se sent responsable d’un problème qui le dépasse. Ces émotions traduisent moins un manque de sensibilité qu’une forte conscience morale des enjeux environnementaux.

Mais lorsqu’elles s’accumulent sans accompagnement, elles peuvent devenir paralysantes. À terme, cette surcharge émotionnelle peut conduire non pas à l’engagement, mais au retrait :

« À quoi bon agir, si tout est déjà perdu ? »

Ce phénomène est aujourd’hui largement discuté sous le terme d’écoanxiété. Pourtant, il reste peu intégré dans la conception des programmes éducatifs. L’éducation à la durabilité continue souvent de miser sur l’accumulation de connaissances, en supposant que la prise de conscience suffira à déclencher le changement.

À lire aussi : L’éco-anxiété : une réponse saine face à la crise climatique

L’émotion comme point de bascule

Notre recherche menée auprès d’étudiants ayant participé à un programme intensif de formation à la durabilité met en lumière un mécanisme clé : ce ne sont pas les connaissances en elles-mêmes qui déclenchent l’action, mais la manière dont les émotions associées à ces connaissances évoluent dans le temps.

Au début du programme, la majorité des participants exprimaient une forme de lassitude ou de résistance. Les enjeux environnementaux leur semblaient omniprésents, mais abstraits, culpabilisants, voire décourageants. Certains parlaient de « bruit de fond », d’autres d’un sentiment de fatalité.

Puis, progressivement, quelque chose a changé. Non pas parce que les messages étaient devenus moins sérieux, mais parce qu’ils étaient plus incarnés, misant davantage sur les volets relationnel et participatif. Les émotions négatives ne s’effacent pas, elles évoluent. La peur et la culpabilité peuvent progressivement céder la place à la curiosité, puis à une forme d’espoir, avant de se traduire par un sentiment d’utilité personnelle.

Des travaux récents en psychologie montrent que cet espoir, lorsqu’il est étroitement associé à des actions concrètes et collectives, favorise un engagement plus soutenu face au changement climatique. Cette perspective invite ainsi à dépasser une conception réductrice des émotions, souvent envisagées uniquement comme des freins à l’action.

À lire aussi : Comment mobiliser les émotions pour inciter à agir en faveur du climat ?

Les limites de la pédagogie du choc

Ce basculement émotionnel constitue un tournant décisif. Lorsque les apprenants cessent de se percevoir uniquement comme des responsables coupables et commencent à se voir comme des acteurs capables d’agir, même à leur échelle, le passage à l’action devient possible. Ce sentiment de capacité d’agir – largement étudié sous le concept d’auto-efficacité – joue un rôle central dans la mise en mouvement et la persistance de l’engagement.

Nos résultats invitent à interroger en profondeur la manière dont nous enseignons la transition écologique. Pendant longtemps, la pédagogie environnementale a reposé sur une logique de choc : montrer l’ampleur des dégâts pour provoquer une prise de conscience. Or, cette stratégie atteint aujourd’hui ses limites.

La répétition de messages anxiogènes peut engendrer de la saturation informationnelle, une forme de déni défensif ou encore un désengagement émotionnel.

À l’inverse, les dispositifs éducatifs qui favorisent l’expérimentation, la coopération et la co-construction produisent des effets très différents. Dans l’étude, les moments les plus transformateurs ne sont pas les conférences magistrales, mais les ateliers collaboratifs, les projets concrets et les échanges avec des acteurs engagés.

Ces formats permettent aux apprenants de vivre la transition écologique non plus comme une menace abstraite, mais un espace d’action collective, où l’engagement est partagé et socialement reconnu.

Un sentiment d’utilité sociale

Un résultat particulièrement marquant de notre recherche concerne le rôle des émotions dites « positives », comme l’espoir, la fierté ou le sentiment de contribution. Contrairement à une idée répandue, ces émotions ne minimisent pas la gravité des enjeux. Elles permettent au contraire de rendre l’action psychologiquement soutenable dans la durée.

L’engagement devient plus stable et plus durable quand :

les apprenants constatent que leurs actions, même modestes, ont du sens ;