15.05.2026 à 10:21

Au Danemark, les enfants prennent davantage de risques et ça pourrait contribuer à leur bien-être

Texte intégral (2136 mots)

Loin de la surveillance constante qui domine dans de nombreux pays, les parents danois laissent davantage leurs enfants expérimenter, se tromper et prendre des risques mesurés. Une philosophie éducative qui pourrait favoriser la confiance en soi et l’autonomie.

On a beaucoup écrit sur les scores élevés et constants du Danemark dans les classements mondiaux du bonheur, si bien qu’il n’est peut-être pas surprenant que le Danemark soit également considéré comme le meilleur pays pour élever des enfants, selon U.S. News and World Report. Le petit pays scandinave figure aussi parmi les mieux classés en matière de bien-être des enfants, un indicateur qui prend en compte la santé physique, la santé mentale, l’éducation et les relations sociales.

Des politiques publiques comme un congé parental généreux, de solides investissements publics dans l’éducation et un système de santé universel ont évidemment joué un rôle dans ces résultats. Les Danois affichent également un niveau élevé de confiance sociale : 74 % d’entre eux estiment que l’on peut faire confiance à la plupart des gens, contre seulement 37 % des Américains.

Mais un autre facteur pourrait contribuer au bien-être des enfants danois : ils sont souvent encouragés à participer à des jeux risqués et peu encadrés.

Cela peut sembler contradictoire avec le désir des parents de tout faire pour assurer la sécurité de leurs enfants. Pourtant, en tant que Danoise d’origine et psychologue, j’ai étudié la manière dont le style parental plus détaché pratiqué au Danemark pourrait être l’une des clés pour élever des enfants plus résilients et autonomes.

Les bienfaits du jeu libre

Les Danois utilisent deux mots distincts pour traduire le mot « jouer ». Le terme « leg » désigne le jeu libre et non structuré ; « spille », lui, renvoie aux jeux ou activités régis par des règles préétablies, comme jouer au football, aux échecs ou du violon.

Chaque forme de jeu a ses bénéfices. Mais des études ont montré que le jeu libre et spontané exige davantage de compromis et de créativité, car les enfants ont la liberté de modifier ou d’inventer les règles. Les enfants apprennent à attendre leur tour et à résoudre des problèmes – des compétences plus difficiles à développer lorsque les adultes interviennent ou lorsque les règles sont fixées à l’avance.

Il existe également ce qu’on appelle le jeu à risque, une forme de jeu non structuré fondée sur des activités excitantes pouvant entraîner des blessures physiques. Sur une aire de jeux, cela peut signifier grimper sur de hautes structures, descendre un toboggan la tête la première ou se bagarrer. En dehors des aires de jeux, cela peut consister à faire un feu, nager, faire du vélo ou utiliser des outils comme des scies, des marteaux ou des couteaux.

La chercheuse norvégienne en éducation de la petite enfance Ellen Beate Hansen Sandseter a été pionnière dans l’étude du jeu à risque. Elle s’est intéressée à ses fonctions évolutives, notamment à la manière dont il aide les enfants à devenir des adultes compétents et autonomes. D’autres chercheurs ont montré que le jeu à risque favorise la santé mentale en apprenant aux enfants à devenir plus résilients et à mieux gérer leurs émotions.

Risques positifs et risques négatifs

Lorsqu’il est question de jeu à risque, il est utile de distinguer les risques positifs des risques négatifs.

Sur une aire de jeux, un risque positif correspond à un défi qu’un enfant est capable d’identifier et qu’il choisit de relever. Il peut évaluer s’il veut essayer une tyrolienne, ou décider lui-même du moment où il atteint sa limite en grimpant pour la première fois sur un filet d’escalade. L’objectif est que l’enfant explore ses propres limites et apprenne à gérer des émotions comme la peur ou l’anxiété. Bien sûr, il existe un risque d’éraflures ou de bosses. Mais la réussite peut renforcer la confiance en soi.

À l’inverse, un risque négatif correspond à un danger que l’enfant n’a ni l’expérience ni les connaissances nécessaires pour anticiper. Utiliser des équipements de jeu dont le bois est pourri, manier un outil comme une perceuse sans instruction adaptée ou nager dans des rapides peut entraîner des accidents graves sans apporter de bénéfice en matière d’apprentissage.

De nombreuses aires de jeux au Danemark sont conçues pour encourager les risques positifs. Le pays est notamment connu pour ses « junk playgrounds », ou terrains d’aventure, dont le premier a été créé pendant la Seconde Guerre mondiale. Ces espaces de jeu sont aménagés avec des pneus usagés, des planches et des cordes plutôt qu’avec des équipements fixes. Les enfants ont souvent accès à des outils afin de construire des structures et transformer eux-mêmes l’espace selon leurs envies.

L’objectif n’est évidemment pas de mettre les enfants en danger. Il s’agit plutôt de leur permettre d’explorer par eux-mêmes, de tester leurs limites et d’essayer de nouvelles choses.

L’enfant naturellement compétent

Bien sûr, aucun parent n’a envie de voir son enfant se blesser. Mais les recherches suggèrent que les parents danois et les parents américains ont des perceptions du risque différentes – ainsi que des seuils distincts pour déterminer ce qu’ils considèrent comme dangereux.

Une étude a ainsi comparé les réactions de mères américaines et danoises face à des images montrant un enfant engagé dans 30 types de jeux différents : faire de la luge, du vélo, utiliser une scie pour couper du bois ou grimper dans un grand arbre, par exemple. Elle a montré que les mères danoises étaient, en moyenne, plus nombreuses à se dire à l’aise avec l’idée que leur propre enfant se trouve dans ces situations. Lors des entretiens menés par la suite, les mères danoises étaient également plus enclines à expliquer qu’elles initiaient leurs enfants à certaines activités à risque, par exemple en leur apprenant à utiliser des outils. L’une d’elles racontait ainsi avoir montré à son enfant de 5 ans comment manier une hache pour couper du bois.

Au Danemark, les crèches et jardins d’enfants apprennent même souvent aux enfants à utiliser un couteau aiguisé, certains remettant un « diplôme du couteau » une fois cette compétence acquise. L’apprentissage du vélo, lui, peut se faire dans ce qu’on appelle des « aires de circulation », équipées de rues à taille d’enfant, de pistes cyclables, de feux de signalisation et de panneaux.

Cette différence dans la tolérance au risque pourrait s’expliquer par des approches éducatives distinctes. Les parents danois considèrent leurs enfants comme naturellement compétents, ce qui signifie qu’ils leur font confiance pour affronter les risques et les difficultés. Les adultes cherchent alors à créer des environnements permettant à ces compétences naturelles de s’épanouir ; ils privilégient l’encouragement à la coopération plutôt que le contrôle.

À l’inverse, les parents américains ont davantage tendance à considérer les enfants comme vulnérables et ayant besoin d’être protégés. La santé mentale constitue une préoccupation majeure : selon une enquête du Pew Research Center menée en 2023, 40 % des parents américains se disent extrêmement ou très inquiets à l’idée que leur enfant souffre un jour d’anxiété ou de dépression. Ironiquement, les enfants qui disposent de moins d’autonomie sont aussi davantage susceptibles de rencontrer des difficultés psychologiques.

Quand la permissivité va trop loin

Laisser les enfants prendre l’initiative peut très bien fonctionner, mais il arrive aussi qu’ils ne soient pas capables de percevoir ou d’anticiper certains risques.

Les jeunes Danois, par exemple, consomment davantage d’alcool que leurs homologues européens. Une enquête récente a montré que près de sept élèves danois de troisième sur dix avaient bu de l’alcool au cours du dernier mois, et qu’un sur trois avait été ivre durant cette même période. Une étude a révélé que les parents danois plus stricts concernant la consommation d’alcool étaient moins susceptibles d’avoir des adolescents buvant fréquemment. Mais, dans l’ensemble, la culture danoise entretient un rapport très permissif à l’alcool, si bien que ces parents restent rares.

Par ailleurs, les enfants danois de 10 ans figurent parmi ceux qui possèdent le plus souvent un smartphone dans le monde, alors même que des études ont montré que la possession d’un smartphone chez les enfants est associée à des niveaux plus élevés de dépression, de stress et d’anxiété, ainsi qu’à un sommeil de moins bonne qualité.

Mais ces statistiques ne concernent pas le jeu à risque, que même des médecins et infirmiers urgentistes défendent. Elles montrent plutôt que les styles parentaux permissifs peuvent également avoir des effets négatifs.

Les bénéfices du jeu à risque – apprendre à tolérer l’échec, la détresse et l’incertitude – ne sont pas seulement importants dans l’enfance. Ils sont au cœur de ce qui fait de nous des êtres humains.

Marie Helweg-Larsen a reçu des financements des National Institutes of Health.

15.05.2026 à 10:21

À quoi a ressemblé la fin du monde provoquée par l’astéroïde qui a tué les dinosaures : le récit minute par minute

Texte intégral (5919 mots)

Que se serait-il passé si vous aviez assisté à l’impact de l’astéroïde qui a provoqué l’extinction des dinosaures ? En s’appuyant sur des décennies de recherches, deux scientifiques reconstituent minute par minute les heures qui ont suivi la collision ayant bouleversé la Terre il y a 66 millions d’années.

Une grande femelle Tyrannosaurus rex avance à travers les conifères de son territoire, humant l’air. Elle reconnaît l’odeur de la carcasse d’un dinosaure à cornes, un Triceratops, dont elle se nourrissait la veille. Elle s’approche et arrache encore quelques lambeaux de chair, mais l’odeur est infecte, même pour elle. Elle descend ensuite jusqu’au lac pour boire. De petits crocodiles et des tortues se précipitent dans l’eau à son approche, mais elle leur prête à peine attention. Ce qui l’intéresse davantage, c’est un dinosaure cuirassé, un Ankylosaurus, tapi non loin de là. Elle sait toutefois que cette proie ne se laissera pas abattre facilement et qu’elle n’a pas assez faim pour risquer un combat.

Ce qu’elle ignore, c’est qu’un danger bien plus grand approche. Elle lève la tête et aperçoit une lumière éclatante fonçant vers le sol, accompagnée de faibles crépitements et sifflements.

Notre T. rex possède une excellente audition pour les sons de basse fréquence et les vibrations qu’elle ressent l’inquiètent. Mais son trouble ne dure qu’un instant. En une fraction de seconde, elle est réduite en cendres et son monde bascule à jamais.

Tout cela se déroule il y a 66 millions d’années, lorsqu’un gigantesque astéroïde frappe la Terre dans la région de l’actuelle mer des Caraïbes. À la fin du Crétacé, le niveau des mers était alors de 100 à 200 mètres plus élevé qu’aujourd’hui, si bien que les rivages de la mer des Caraïbes s’étendaient loin à l’intérieur du continent américain, sur l’est du Mexique et le sud des États-Unis. L’impact s’est produit dans ces eaux.

L’événement provoqua des bouleversements immédiats de la planète et de son atmosphère, entraînant l’extinction des dinosaures ainsi que d’environ la moitié des autres espèces vivant sur Terre. Mais qu’aurait-on ressenti face à un impact d’une telle ampleur ? Qu’aurait-on vu, entendu ou senti ? Et comment serait-on mort — ou aurait-on survécu ? En tant que spécialistes, respectivement, des météorites et de la paléontologie, nous avons reconstitué une chronologie détaillée de cet événement à partir de décennies de recherches. Alors, remontons le temps jusqu’au tout dernier jour du Crétacé.

J-1 avant l’impact

Tout est calme et cette journée du Crétacé se déroule comme les autres. Dans ce qui deviendra bientôt le point d’impact, le climat est agréablement chaud, autour de 26 °C, et humide. Une situation fréquente à cette époque.

Depuis environ une semaine, l’astéroïde n’est visible que la nuit. Comme l’immense roche fonce droit vers la Terre, elle apparaît comme une étoile immobile dans le ciel. Pas de spectaculaire traînée lumineuse : il s’agit d’un astéroïde rocheux, et non d’une comète.

Au cours des dernières 24 heures, le point lumineux devient visible en plein jour. Mais il ressemble toujours à une étoile ou à une planète, devenant simplement de plus en plus brillant dans les dernières heures précédant l’impact.

Le jour J : l’impact

Si vous vous étiez trouvé à proximité, vous auriez d’abord assisté à un bref spectacle de lumière et de bruit. Quelques minutes, voire quelques secondes avant l’impact, vous auriez aperçu l’immense boule de feu, accompagnée de crépitements ou de sifflements. Ce bruit caractéristique résulte d’un effet photoacoustique : la lumière extrêmement intense de la boule de feu chauffe le sol, qui réchauffe ensuite l’air situé juste au-dessus, provoquant des ondes de pression — autrement dit, du son.

Vient ensuite un bang supersonique assourdissant, produit parce que l’astéroïde se déplace plus vite que la vitesse du son. Mais l’astéroïde est si gigantesque — probablement près de 10 kilomètres de diamètre — qu’il frappe la surface avant même que les êtres vivants proches de la zone d’impact aient le temps de chercher un abri.

L’énergie colossale de l’astéroïde creuse un cratère au terme d’une série de phénomènes qui, ensemble, ne durent que quelques secondes. Lorsque l’astéroïde percute la surface, son énergie cinétique — liée à sa vitesse — est instantanément transmise au sol sous forme d’énergie cinétique, thermique et sismique. Cela déclenche une série d’ondes de choc qui chauffent et compriment à la fois l’astéroïde et la zone frappée.

À mesure que ces ondes se propagent, les roches se fissurent, se fragmentent puis sont projetées dans les airs, formant une vaste dépression en forme de bol — appelée cavité transitoire — environ dix secondes après l’impact. Sous l’effet de la chaleur et de la compression, d’immenses quantités de matière fondent puis se vaporisent, y compris l’astéroïde lui-même, libérant une gigantesque colonne de vapeur incandescente atteignant plus de 10 000 kelvins (soit environ 9 727 °C).

Au cours des secondes suivantes, la cavité continue de s’agrandir jusqu’à atteindre plusieurs fois le diamètre initial de l’astéroïde. Des simulations suggèrent qu’environ 20 secondes après l’impact, cette cavité transitoire atteint au moins 30 kilomètres de profondeur — bien davantage que le point le plus profond actuellement connu sur Terre, le Challenger Deep, situé dans la fosse des Mariannes dans l’océan Pacifique, qui descend à environ 11 kilomètres. Les bords du cratère culminent alors à plus de 20 kilomètres de hauteur, soit plus du double des 8 900 mètres du mont Everest.

Mais cette structure gigantesque ne subsiste même pas une minute avant de commencer à s’effondrer. Moins de trois minutes après l’impact, le centre du cratère rebondit pour former un pic de plusieurs kilomètres de haut. Ce sommet éphémère ne dure qu’environ deux minutes avant de s’effondrer à son tour dans le cratère.

Que vous soyez un dinosaure ou un scarabée bousier, si vous vous étiez trouvé près de la cavité transitoire, vous auriez été instantanément incinéré par l’explosion. Mais même à une distance pouvant atteindre 2 000 kilomètres de l’épicentre, vous auriez probablement été rapidement tué par le rayonnement thermique et les vents supersoniques qui se propagent désormais depuis le site d’impact.

Instant t + 5 minutes

Cinq minutes après l’impact, les vents se sont « calmés » pour atteindre la puissance d’un ouragan de catégorie 5, rasant tout sur environ 1 500 kilomètres autour du site d’impact. Enfin, tout ce qui n’a pas déjà été consumé par les flammes.

Dans cette région, la température de l’atmosphère dépasse désormais les 500 kelvins (environ 227 °C). L’impression serait celle d’être enfermé dans un four, provoquant brûlures, coups de chaleur et mort rapide. Le bois et la végétation s’embrasent, déclenchant des incendies partout.

Comme l’astéroïde a frappé la mer, l’atmosphère est également saturée de vapeur d’eau surchauffée, rendant ces vents d’une violence extrême encore plus meurtriers.

Puis viennent les vagues géantes, provoquées par les quantités colossales de roche et d’eau déplacées par l’impact. Ces mégatsunamis de plus de 100 mètres de hauteur frappent d’abord les côtes de l’actuel golfe du Mexique, submergeant les terres avant de se retirer en laissant derrière eux d’immenses quantités de débris.

À ce stade, le cratère a presque atteint ses dimensions définitives : environ 180 kilomètres de diamètre et 20 kilomètres de profondeur. Mais l'impact n'a pas seulement creusé un trou gigantesque dans la croûte terrestre. Toute la roche et la vapeur déplacées lors de la collision doivent retomber quelque part. Plusieurs sites en Amérique du Nord montrent ainsi que des blocs de débris issus de l’impact, parfois de la taille d’un mètre, ont été projetés à des centaines de kilomètres.

Ainsi, si vous vous étiez trouvé entre 2 000 et 3 000 kilomètres de l’épicentre et aviez survécu aux premières secondes, vous seriez probablement mort ensuite de la chaleur extrême, des séismes, des ouragans, des incendies, des inondations provoquées par les tsunamis ou encore des retombées de matière en fusion.

Mais que se passe-t-il beaucoup plus loin du site d’impact ? Durant les cinq premières minutes suivant la collision, les dinosaures parcourant les forêts du Crétacé dans ce qui correspond aujourd’hui à la Chine ou à la Nouvelle-Zélande ne remarquent encore rien d’anormal.

Mais cela ne va pas durer.

Instant t + 1 heure

À ce stade, les ondes de choc sur terre comme en mer ne sont plus qu’un désagrément mineur comparé à l’incendie qui continue de pleuvoir depuis le ciel. Une partie de l’énergie de l’impact a été transférée dans l’atmosphère, chauffant l’air et les poussières jusqu’à les rendre incandescents.

Une heure après l’impact, une ceinture de poussières a déjà fait le tour du globe. Des dépôts de gouttelettes de roche fondue solidifiées — appelées sphérules d’impact — ainsi que des grains minéraux ont été retrouvés dans de nombreux sites, de la Nouvelle-Zélande au sud jusqu’au Danemark au nord.

Dans ces régions éloignées, vous n’auriez pas eu conscience des tsunamis ravageant les Amériques ni des gigantesques incendies, mais le ciel aurait déjà commencé à s’assombrir.

Jour J+1

À présent, d’immenses tsunamis se déplacent vers l’est à travers l’Atlantique et vers l’ouest à travers le Pacifique, pénétrant dans l’océan Indien par les deux côtés.

Leurs vagues atteignent encore environ 50 mètres de hauteur, provoquant morts et destructions sur de nombreuses côtes du globe. À titre de comparaison, le tsunami du 26 décembre 2004 avait atteint jusqu’à 30 mètres de haut.

Ces tsunamis tuent poissons et animaux marins, projetés loin sur les rivages avant d’y être abandonnés, tout comme ils détruisent les forêts côtières et noient les animaux terrestres. Mais peu à peu, les vagues perdent de leur puissance et n’entraînent probablement pas, à elles seules, l’extinction complète d’espèces entières.

Les ouragans se sont eux aussi affaiblis, mais des vents comparables à ceux d’une tempête tropicale continuent de soulever des débris et d’alimenter le chaos dans les régions touchées par les tsunamis. Le ciel en feu déclenche également des incendies à travers toute la planète, lesquels projettent à leur tour toujours plus de suie dans l’atmosphère. La trace de ces gigantesques feux a été retrouvée sous forme de particules de carbone dans les sédiments de la limite K-Pg — cette fine couche d’argile vieille de 66 millions d’années marquant la séparation entre le Crétacé et le Paléogène.

Plus loin encore, dans ce qui correspond aujourd’hui à l’Europe et à l’Asie, le ciel continue de se charger de poussières et de suie, comme partout ailleurs sur Terre. Les températures commencent à chuter à mesure que la lumière du Soleil est bloquée. Les arbres et les plantes en général, y compris le phytoplancton, cessent progressivement leur activité comme en hiver, incapables de réaliser la photosynthèse. Quant aux animaux dépendant de températures chaudes, ils finissent par se terrer avant de mourir.

Jour J+1 semaine

Le monde devient de plus en plus sombre. Des simulations du rayonnement solaire atteignant la surface terrestre après l’impact montrent qu’au bout d’environ une semaine, le flux solaire — c’est-à-dire la quantité de chaleur et de lumière reçue sur une surface donnée — ne représente plus qu’un millième de son niveau d’avant la collision. Cette obscurité est provoquée par les immenses quantités de poussières et de suie présentes dans l’atmosphère.

Cette diminution continue de la lumière s’accompagne d’une baisse globale des températures d’au moins 5 °C à la surface de la Terre. La plupart des dinosaures ainsi que les grands reptiles volants et marins meurent probablement de froid au cours de cette première semaine. Les reptiles plus petits, dotés d’un métabolisme plus lent ou d’un régime alimentaire plus adaptable, peuvent toutefois survivre un peu plus longtemps.

Le refroidissement de l’atmosphère et l’épais couvert nuageux provoquent également des pluies. Mais pas des pluies ordinaires : des pluies acides s’abattent sur l’ensemble de la planète.

Deux mécanismes distincts sont à l’origine de ces pluies acides. Le premier est lié à la géologie de la région de l’impact. L’astéroïde a frappé une zone riche en sédiments contenant du soufre, lequel s’est vaporisé et a libéré des oxydes de soufre — des composés gazeux acides et irritants formés de soufre et d’oxygène — dans l’immense panache de plasma projeté dans l’atmosphère.

Le second mécanisme provient de l’énergie même de la collision, suffisamment puissante pour transformer l’azote et l’oxygène de l’air en oxydes d’azote, des gaz extrêmement réactifs qui peuvent former du smog.

Avec la baisse des températures, la vapeur d’eau finit par se condenser en gouttes, tandis que les oxydes de soufre et d’azote se dissolvent dans l’eau pour former de l’acide sulfurique et de l’acide nitrique. Ce phénomène suffit à provoquer une chute rapide du pH. Selon les premiers modèles, le pH de ces pluies aurait pu descendre jusqu’à 1 – une acidité comparable à celle de l’acide des batteries.

À ce stade, la Terre est devenue un endroit particulièrement hostile. La végétation en décomposition, la fumée étouffante et les aérosols soufrés se combinent pour donner à la planète une odeur pestilentielle. Les plantes et les animaux terrestres ou vivant dans les mers peu profondes qui avaient survécu à l’obscurité et au froid succombent désormais aux pluies acides corrosives et à l’acidification des océans.

Les pluies acides détruisent également les forêts en lessivant les sols de nutriments essentiels comme le calcium, le magnésium et le potassium. Dans les mers peu profondes, coquillages, crustacés et coraux meurent eux aussi, l’eau acide dissolvant progressivement leurs structures calcaires.

Jour J+1 an

Les vents se sont calmés, les incendies se sont éteints et les océans ont retrouvé leur tranquillité. À première vue, la collision avec l’astéroïde pourrait ne sembler être qu’une immense cicatrice au fond de l’océan. Pourtant, ses effets continuent de ravager la planète.

L’atmosphère reste saturée de poussières et le Soleil n’a plus brillé depuis un an. Les températures ont continué à chuter : la température moyenne à la surface du globe est désormais inférieure d’environ 15 °C à celle d’avant l’impact. L’hiver s’est installé sur Terre.

Les dinosaures et reptiles marins qui auraient survécu à la première semaine de froid extrême meurent rapidement ensuite. Un an après l’impact, il ne reste plus de ces géants que des squelettes en décomposition. Çà et là, de petits animaux — comme des mammifères de la taille de rats ou des insectes — se cachent dans des fissures et des terriers, survivant péniblement grâce à leurs réserves et à quelques végétaux en décomposition.

En réalité, cette année a été catastrophique pour la vie sur Terre : plus de 50 % des plantes ont disparu, victimes du froid et du manque de lumière solaire. Des pertes comparables ont touché les animaux terrestres ainsi que les espèces vivant dans les eaux peu profondes acidifiées.

Si la plupart des groupes de plantes ainsi que de nombreux groupes modernes d’insectes, de poissons, de reptiles, d’oiseaux et de mammifères se rétablissent relativement rapidement, la situation est bien plus sombre pour d’autres espèces.

Les dinosaures et les ptérosaures terrestres ont disparu, tout comme de nombreux reptiles marins, les ammonites, les bélemnites et les rudistes dans les océans. Les ammonites et les bélemnites occupaient des positions élevées dans la chaîne alimentaire : elles souffrent donc non seulement du froid et de l’acidification des océans, mais aussi de l’effondrement de leurs ressources alimentaires, notamment des petits organismes marins dont elles dépendaient.

J+10 ans

La Terre reste prisonnière d’un hiver implacable. Même si la majeure partie du soufre est retombée de l’atmosphère sous forme de pluies acides, les poussières et les particules de suie persistent encore dans le ciel. La température moyenne à la surface du globe demeure environ 5 °C plus basse qu’avant l’impact.

Les grands océans ne sont pas gelés, mais les lacs et les rivières à l’intérieur des terres sont recouverts de glace partout dans le monde. Bien sûr, aucun être humain n’existait encore à cette époque — il n’y avait même pas de grands mammifères. Mais puisque seules les espèces capables de s’enfouir sous terre ou de vivre sous l’eau ont survécu, il est peu probable que vous auriez pu tenir jusque-là.

Les groupes de plantes et d’animaux ayant survécu — comme les tortues, les petits crocodiles, les lézards, les serpents, certains oiseaux vivant au sol et de petits mammifères — recommencent alors à coloniser la Terre. Mais ils restent confinés à quelques zones relativement préservées, très éloignées du site d’impact.

Dans ces régions, la lumière solaire redevient enfin suffisante pour permettre aux plantes et au phytoplancton de reprendre la photosynthèse. Comme les feuilles, graines et végétaux constituent la base des chaînes alimentaires terrestres et marines, la vie commence lentement à se reconstruire. Peu à peu, la vie réinvestit les paysages dévastés. Mais les écosystèmes ont profondément changé, et les dinosaures ont définitivement disparu.

J+66 millions d’années

Aujourd’hui, 66 millions d’années après l’impact, les cicatrices de la collision sont enfouies dans les couches géologiques — et les scientifiques commencent peu à peu à les déchiffrer. C’est en 1980 que des chercheurs ont ainsi, pour la première fois, mis au jour des preuves de cet impact. Dans leur article devenu classique, le physicien prix Nobel Luis Alvarez et ses coauteurs décrivent un enrichissement soudain en iridium dans une fine couche d’argile observée au Danemark et en Italie.

L’iridium est très rare dans les roches présentes à la surface de la Terre, car la majeure partie de cet élément a été piégée dans le noyau terrestre lors de la formation de la planète. En revanche, il est fréquent dans les météorites. Alvarez et ses collègues en ont conclu que la quantité d’iridium accumulée dans ces sédiments était si élevée qu’elle ne pouvait s’expliquer que par l’impact d’une météorite gigantesque.

Comme les scientifiques n’avaient observé ce pic d’iridium que dans deux sites, l’hypothèse de l’impact fut alors rejetée par de nombreux chercheurs. Mais au cours des années 1980, des pics d’iridium furent identifiés dans des couches d’argile sur un nombre croissant de sites — dans des sédiments déposés sur les continents, dans des lacs ou encore dans les océans.

L’hypothèse de l’impact gagna véritablement en crédibilité lorsqu’un cratère datant de la bonne période fut découvert en 1991. Ce cratère, enfoui sous des couches rocheuses plus récentes mais clairement visible grâce aux relevés géophysiques, se situe pour moitié sur la péninsule du Yucatán, au Mexique, et pour moitié sous la mer. Depuis les années 1990, les preuves de l’impact n’ont cessé de s’accumuler, notamment lorsque des chercheurs ont confirmé qu’un épisode brutal de refroidissement climatique s’était bien produit à la fin du Crétacé.

Au total, on estime qu’environ la moitié des espèces végétales et animales vivant à la fin du Crétacé ont disparu.

On a longtemps pensé que certains groupes survivants — comme de nombreuses plantes, insectes, mollusques, lézards, oiseaux ou mammifères — avaient traversé la catastrophe sans trop de dommages. Mais des études détaillées montrent que ce n’est pas le cas : tous ont été durement touchés.

Par hasard ou par chance, suffisamment d’individus et d’espèces ont néanmoins réussi à survivre au froid et à la disparition des ressources alimentaires, ou se trouvaient dans des régions du monde moins sévèrement affectées. Lorsque les conditions sont redevenues plus favorables, ces survivants ont pu recoloniser rapidement leurs anciens milieux, mais aussi occuper les espaces laissés vacants par les groupes disparus.

L’une des conséquences majeures de l’extinction des dinosaures – qui dominaient alors les écosystèmes en tant que superprédateurs – fut ainsi l’essor et la diversification des mammifères.

Lorsque Luis Alvarez et ses collègues ont décrit pour la première fois la chute des températures provoquée par l’impact, ils ont parlé d’un « hiver nucléaire », reflet du contexte politique du début des années 1980. Aujourd’hui, nous serions sans doute davantage enclins à décrire ces effets comme une forme de dérèglement climatique mondial — des phénomènes comparables étant actuellement provoqués par l’augmentation du dioxyde de carbone dans l’atmosphère, avec son cortège d’inondations et de variations extrêmes des températures.

Il est frappant de penser que sans cette collision avec un astéroïde, les primates n’auraient peut-être jamais atteint le niveau d’évolution qui est le nôtre aujourd’hui. Mais il est tout aussi frappant de constater que les humains modernes provoquent désormais certaines des mêmes modifications atmosphériques que celles ayant conduit à la disparition de nos lointains ancêtres reptiles — et qui pourraient, un jour, entraîner notre propre perte.

Monica Grady a reçu des financements du Leverhulme Trust dans le cadre d’une Emeritus Fellowship ainsi que du STFC. Elle est affiliée à The Open University, à Liverpool Hope University et au Natural History Museum.

Michael J. Benton ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

15.05.2026 à 09:36

La découverte d’une liste de survivants de la peste noire éclaire la façon dont on guérissait de la maladie au Moyen-Âge

Texte intégral (2251 mots)

Qui survivait à la peste noire, et combien de temps fallait-il pour guérir ? Un document exceptionnel retrouvé dans les archives d’une abbaye anglaise révèle les noms de paysans touchés par la maladie, la durée de leur absence et l’ampleur du choc provoqué par l’épidémie dans les campagnes médiévales.

Dans le cadre de nos recherches dans les collections médiévales de la British Library, nous avons identifié un document jusqu’ici passé inaperçu, qui apporte un éclairage inédit sur les survivants de l’épidémie de peste noire (1346-1353).

Ce document — un fragment de parchemin inséré dans un registre comptable de l’abbaye de Ramsey concernant le manoir de Warboys, dans le Huntingdonshire au centre-est de l'Angleterre — indique combien de temps des paysans étaient absents de leur travail lorsqu’ils étaient frappés par la peste. Il révèle également les noms de ceux qui ont survécu ainsi que la durée de convalescence estimée par leurs employeurs.

Dans notre récent article écrit avec Barney Sloane, nous apportons un nouvel éclairage sur un groupe de 22 paysans du domaine qui ont probablement contracté la peste, sont restés alités pendant plusieurs semaines, avant de finalement guérir.

Considérée comme l’une des pandémies les plus meurtrières de l’histoire, la peste noire aurait provoqué la mort d’entre un tiers et deux tiers de la population de l’Europe médiévale.

Face à l’ampleur de la catastrophe, les historiens se sont surtout attachés à retrouver des traces des victimes. Mais cette approche a largement laissé dans l’ombre l’histoire de ceux qui ont contracté la maladie puis en ont réchappé.

Malgré la mortalité extrêmement élevée de l’épidémie, il était possible de survivre à la peste, et les chroniqueurs médiévaux évoquent cette éventualité — aussi improbable soit-elle. Ainsi, Geoffrey le Baker, clerc de Swinbrook dans l’Oxfordshire au centre de l'Angleterre, écrivait dans la décennie suivante que les chances de guérison dépendaient, selon lui, des symptômes présentés par les malades :

« Des personnes qui, un jour, étaient pleines de joie étaient retrouvées mortes le lendemain. Certaines étaient tourmentées par des bubons apparaissant soudainement sur différentes parties du corps, si durs et secs que lorsqu’on les perçait, presque aucun liquide n’en sortait. Beaucoup de ces personnes survécurent, soit grâce à l’incision des bubons, soit après de longues souffrances. D’autres victimes présentaient de petites pustules noires disséminées sur toute la peau du corps. Parmi elles, très peu – pour ainsi dire aucune – retrouvèrent la vie et la santé. »

Mais qui survivait réellement ? Pourquoi tant de personnes succombaient-elles à la maladie alors que d’autres y réchappaient ? Et combien de temps duraient exactement ces « longues souffrances » ? Malheureusement, les preuves documentaires sont extrêmement rares, car la plupart des sources médiévales consignent des informations sur la mortalité plutôt que sur la maladie elle-même.

Une liste unique de survivants de la peste

Un élément inédit figurant dans les comptes du manoir de Warboys détaille le cas d’un groupe de personnes tombées malades entre la fin du mois d’avril et le début du mois d’août 1349. Les moines de l’abbaye de Ramsey y ont dressé une liste de leurs paysans suffisamment malades pour ne plus pouvoir travailler sur les terres du seigneur, en précisant la durée de leur absence.

L’expérience de la peste variait manifestement fortement d’une personne à l’autre.

Le rétablissement le plus rapide fut celui d’Henry Broun, qui ne manqua qu’une seule semaine de travail. À l’inverse, John Derworth et Agnes Mold souffrirent de formes bien plus longues de la maladie et furent absents pendant neuf semaines.

En moyenne, la maladie durait entre trois et quatre semaines, les trois quarts des personnes reprenant le travail en moins d’un mois. La rapidité de ces guérisons est d’autant plus surprenante que ces travailleurs avaient droit à jusqu’à un an et un jour d’arrêt maladie.

Cette liste de survivants comprend une proportion importante de paysans qui bénéficiaient des tenures les plus importantes du domaine. Les historiens et les archéologues débattent depuis longtemps de la question de savoir si la peste frappait indistinctement, sans considération de statut social, de sexe ou d’âge, ou si les populations les plus pauvres et les plus âgées étaient davantage vulnérables.

Le fait qu’un si grand nombre de paysans relativement aisés aient survécu pourrait indiquer que leurs meilleures conditions de vie facilitaient leur rétablissement par rapport à leurs voisins plus pauvres, peut-être parce qu’ils résistaient mieux aux infections secondaires et aux complications.

Il ne faut par ailleurs pas accorder trop d’importance au fait que 19 des 22 survivants étaient des hommes : cela reflète le biais de genre propre à la répartition des terres dans les seigneuries médiévales plutôt qu’une quelconque différence de vulnérabilité à la peste selon le sexe.

Ce chiffre de 22 personnes peut sembler peu élevé mais, en temps normal, au cours des années 1340, seules deux ou trois absences étaient enregistrées pendant les mois d’été. Cela représente donc une multiplication par dix du nombre habituel de maladies sur le domaine.

Autrement dit, ces paysans malades ont cumulé à eux seuls 91 semaines de travail perdues sur une période de seulement 13 semaines.

Notre compréhension des conséquences de la peste noire a longtemps été façonnée par l’ampleur effroyable de la mortalité. Pourtant, ce n’est qu’en réintégrant dans le tableau ceux qui sont tombés malades puis ont survécu que l’on peut réellement mesurer le choc colossal que la pandémie a provoqué dans la société. Dans les villages comme dans les villes d’Europe, les morts, les mourants et les malades devaient largement dépasser en nombre les personnes encore en bonne santé.

Les conséquences apparaissent clairement dans les récits et chroniques médiévaux. L’un d’eux rapporte qu’« il y avait une telle pénurie de serviteurs et de travailleurs que plus personne ne savait ce qu’il fallait faire ». Sous l’effet combiné de cette mortalité massive, d’une vague de maladies sans précédent et de conditions météorologiques désastreuses, les récoltes de 1349 et 1350 ont été décrites comme les pires qu’ait connues l’Angleterre médiévale, pires encore que celles ayant provoqué la grande famine de 1315-1317.

Ce document exhumé des archives permet de réintégrer l’histoire de la maladie et de la guérison dans celle de la peste noire, en montrant qu’il était possible de survivre à l’une des pires pandémies de l’histoire.

Ces nouvelles preuves révèlent aussi l’extraordinaire résilience des paysans médiévaux. Beaucoup sont restés alités pendant des semaines, couverts de bubons — ces ganglions enflammés, gonflés et douloureux au niveau de l’aine ou du cou, caractéristiques de la peste noire —, vomissant du sang et ravagés par la fièvre. Pourtant, nombre d’entre eux ont survécu et repris le travail après seulement quelques semaines.

Les recherches ayant permis la rédaction de cet article ont été menées grâce au financement d’un projet de recherche soutenu par le Leverhulme Trust, intitulé « Modelling the Black Death and Social Connectivity in Medieval England ».

Grace Owen est chercheuse postdoctorale associée au projet « Modelling the Black Death and Social Connectivity in Medieval England », financé par le Leverhulme Trust.

14.05.2026 à 17:41

Des archéologues ont découvert des dés vieux de 12 000 ans : voici ce qu’ils nous apprennent sur l’histoire du jeu

Texte intégral (1544 mots)

Les êtres humains ont toujours eu le goût du jeu. Mais pendant la majeure partie de notre histoire, le jeu n’a laissé que peu de traces. Contrairement aux outils ou aux ossements, les jeux se conservent rarement, et les plaisirs éphémères qu’ils procurent sont encore plus difficiles à retrouver.

La récente découverte de dés vieux de 12 000 ans, publiée dans American Antiquity, apporte un nouvel éclairage sur le caractère ludique des sociétés humaines dans un passé lointain.

L’archéologue Richard J. Madden a identifié 565 dés provenant de sites à travers l’Amérique du Nord, notamment dans le Wyoming, le Colorado et le Nouveau-Mexique. Ils datent du XIXe siècle et remontent jusqu’à 12 000 ans. La reconnaissance de ces artefacts comme étant des dés repousse de plusieurs milliers d’années les preuves matérielles du jeu chez l’homme, à travers ce que Madden interprète comme des preuves de jeux de hasard et de paris. Il estime que les Amérindiens jouaient aux dés 6 000 ans avant tout le monde.

Pour identifier ces objets comme des dés, Madden a rassemblé des données sur des objets comparables issues de publications archéologiques et de bases de données sur les vestiges, en s’appuyant sur une étude antérieure exhaustive des objets de jeu amérindiens.

Des dés binaires

Ces objets ne ressemblent pas aux dés à six faces que nous utilisons aujourd’hui. Il s’agit plutôt de dés binaires : des pièces plates, rondes ou rectangulaires marquées d’un côté et vierges de l’autre. Si vous êtes un fan de Donjons et Dragons comme nous, vous pourriez appeler un tel dispositif de lancer un d2. En effet, on peut comparer le lancer de l’un de ces dés anciens à un tirage au sort avec une pièce de monnaie – bien que cette découverte souligne également que les dés sont bien plus anciens que les pièces.

Lorsqu’on évalue des recherches révolutionnaires de ce type, il est essentiel de réfléchir à la nature des vestiges archéologiques de ce passé très lointain. Nous dépendons d’un éventail très limité d’objets, car beaucoup ne survivent pas dans le sol. Souvent, lorsque nous jouons, même aujourd’hui, nous n’utilisons aucun objet matériel. Pensez à un jeu de chat ou de cache-cache. Imaginez maintenant un jeu similaire se déroulant il y a 12 000 ans. Un archéologue pourrait-il jamais en trouver des traces ?

Même lorsque le jeu nécessite du matériel, comme dans les jeux de société, les traces ne sont souvent pas conservées.

En effet, des études ethnographiques des études ont montré que les gens jouent fréquemment à des jeux de société d’une manière qui ne laisse aucune trace archéologique. Pour de nombreux jeux, les gens creusent des trous et tracent des lignes au sol pour le transformer en plateau, et utilisent des pierres, des graines, des coquillages et même des excréments d’animaux séchés comme pions.

Les objets naturels font également l’affaire : des bâtons à deux extrémités et des cauris (coquillages) peuvent servir de dés binaires. Ce n’est pas seulement une pratique du passé ou propre à des contrées lointaines : partout dans le monde, on joue chaque jour en utilisant de manière créative toutes sortes d’objets – bouchons de bouteille, boîtes de conserve, ficelle, bâtons, cailloux et autres bricoles – qui ne sont pas facilement identifiables comme des jouets. C’est pourquoi, pour nous, archéologues qui étudions le jeu, les dés constituent des découvertes spéciales, car ce sont sans ambiguïté des outils qui servent à jouer.

Les dés anciens

Les archéologues trouvent des dés plus souvent que vous ne le pensez, sous toutes sortes de formes intéressantes. L’un des exemples les plus célèbres est celui des os astragales, les os de la cheville d’animaux à sabots (principalement des moutons et des chèvres). Ils possèdent quatre faces distinctes et ont été couramment utilisés comme dés.

L’un des jeux les plus anciens de l’histoire de l’humanité, le jeu des 20 cases (une version ultérieure du Jeu royal d’Ur), est connu pour avoir utilisé de tels dés, car des os d’astragale ont été retrouvés dans les tiroirs des boîtes de jeu. Dans de nombreux cas, plutôt que de prélever ces os sur des animaux abattus, les gens les reproduisaient dans d’autres matériaux tels que la pierre, le verre ou le métal. Des exemplaires en ivoire ont été découverts avec les jeux qui se trouvaient dans la tombe égyptienne de Toutankhamon. Cela suggère que les gens n’ont commencé à fabriquer des objets ressemblant à des dés qu’après avoir déjà utilisé des objets naturels adaptés à ce même usage.

Dans son étude, Madden soutient que les dés témoignent d’une évolution continue des jeux qui impliquent une dimension économique. Nous souhaitons orienter ce débat dans une autre direction. Le jeu existe en dehors du cadre des jeux d’argent ou des jeux qui impliquent des transactions, et l’analyse contextuelle nécessaire pour identifier véritablement le jeu d’argent dans le passé fait défaut dans cette étude. De plus, cette étude aborde le jeu exclusivement sous un angle fonctionnaliste, en particulier à travers des cadres évolutifs et économiques.

Nous avons fait valoir ailleurs que des études comme celles-ci tiennent rarement compte d’un point fondamental : le jeu existe souvent pour le seul plaisir de jouer. Parfois, on lance la pièce pour gagner, mais souvent, on la lance juste pour s’amuser.

Bien que nous ne soyons pas convaincus que ces anciens peuples amérindiens géraient des réseaux de jeux d’argent, il s’agit d’une découverte passionnante. Ce que ces dés, ainsi que d’autres trouvés dans des contextes archéologiques à travers le monde, mettent en évidence, c’est la beauté fascinante du jeu, aujourd’hui comme par le passé. Ainsi, la prochaine fois que vous lancerez des dés, sachez que vous participez au même esprit ludique – le suspense, la joie, la déception d’un mauvais lancer – que celui que ressentaient déjà les gens il y a 12 000 ans.

Aris Politopoulos a reçu des financements au titre de la subvention de démarrage « Archaeological Futures » et du prix Ammodo Science Award for Groundbreaking Research pour le projet Past♥Play. Aria est membre du conseil d'administration de la fondation Stichting VALUE.

Angus Mol a reçu des financements du Conseil néerlandais de la recherche (NWO) dans le cadre de la bourse NWO-VIDI « Playful Time Machines » et du prix Ammodo pour la recherche scientifique novatrice, pour le projet Past♥Play. Il est membre du conseil d'administration de la fondation VALUE.

Walter Crist a reçu des financements du programme COST (Coopération européenne en science et technologie) pour le projet GameTable : Techniques informatiques pour le patrimoine des jeux de société, et de Game-in-Lab pour le projet « Play and the City » : Étude du patrimoine culturel des jeux de la ville de Rome. Il siège au conseil d'administration de l'Institut chypriote-américain de recherche archéologique (CAARI).

14.05.2026 à 17:40

La propriété immobilière, un héritage culturel de l’agriculture

Texte intégral (1307 mots)

Acheter ou louer un appartement ou une maison est sûrement une décision financière que l’on imagine fondé sur des considérations intimes. Pourtant, les décisions des individus en matière de propriété immobilière seraient influencées par des croyances culturelles héritées. En cause : le passé agricole de leurs ancêtres.

Vos ancêtres cultivaient-ils les plaines d’une région agricole européenne comme l’Ukraine ou la Beauce ? Ou élevaient-ils du bétail près de la Corne de l’Afrique ? Loin d’être anecdotique, la question à cette réponse pourrait en partie déterminer si vous êtes ou non aujourd’hui propriétaire de votre logement.

Les résultats d’une vaste étude empirique que nous avons menée indiquent, en effet, que les représentations culturelles liées à la terre et au bétail – respectivement des actifs immobiles et mobiles – se transmettent de génération en génération. Ces conceptions contribuent encore aujourd’hui à expliquer la probabilité qu’un individu devienne propriétaire. En particulier, les personnes issues de sociétés historiquement fondées sur l’agriculture céréalière sont plus susceptibles de posséder un bien immobilier que les autres.

Une décision financière importante

« Faut-il acheter une maison/un appartement ou simplement louer ? » Il s’agit sans doute de la décision financière la plus importante pour la plupart des ménages, qui choisissent ainsi de faire de leur logement (plutôt que de l’or ou des actions) leur principal actif. Au-delà des considérations économiques (comme la capacité à rembourser un crédit sur 20 ans), la propriété immobilière est aussi influencée par la manière dont les individus perçoivent la sécurité, la valeur et le statut social associés à un logement.

À lire aussi : Crédit immobilier : les raisons d’un blocage du marché du logement

Or, ces préférences culturelles sont profondément enracinées : elles trouvent leur origine dans des sociétés agricoles anciennes où la richesse reposait principalement sur deux types d’actifs, l’un mobile (le bétail), l’autre immobile (la terre). Mais les champs et les troupeaux étaient bien plus que de simples actifs économiques. Ils imprégnaient la culture, à travers des mythes et d’un folklore, qui ont laissé des traces et influencent encore aujourd’hui les représentations – et, in fine, les taux de propriété immobilière.

Les individus issus de sociétés historiquement dominées par l’agriculture céréalière, où la terre était davantage valorisée que les actifs mobiles, restent enclins à privilégier les actifs immobiles et deviennent donc plus souvent propriétaires.

Le poids de l’héritage culturel

Pour étayer cette hypothèse, nous avons analysé un corpus ethnographique. Les données contenues dans une base de données mondiale relative au folklore montrent que, dans les sociétés fondées sur l’agriculture, les motifs liés à la terre sont davantage présents dans leurs récits, tandis que les sociétés pastorales mettent davantage en avant le bétail. Parmi les premières figurent la plupart des pays européens, depuis l’Antiquité grecque jusqu’au Moyen Âge, où la terre était associée au pouvoir et au prestige pendant des siècles.

On peut penser au Chat botté, où le chat rusé fait passer le fils du meunier pour un propriétaire terrien afin de lui assurer une fin heureuse. À l’inverse, dans des sociétés pastorales d’Afrique de l’Est comme celle des Nuer, les structures de pouvoir et les représentations sociales reposent sur le bétail.

Aujourd’hui, les pays occidentaux comme de nombreuses sociétés pastorales sont devenus des économies industrielles, voire post-industrielles, ayant laissé derrière eux la plupart de leurs institutions traditionnelles liées à la terre ou au bétail. Pourtant, ces héritages culturels persistent et continuent d’influencer la manière dont les sociétés perçoivent les actifs mobiles et immobiles.

Héritages persistants

L’examen des données actuelles de la zone OCDE (41 pays disposant de données homogènes) confirme largement l’hypothèse posée. Ce sont dans les pays ayant une forte tradition agricole fondée sur la terre que l’on trouve aussi aujourd’hui des taux de propriété immobilière plus élevés. L’effet est significatif : une augmentation d’un écart-type de l’importance relative des terres cultivées (par rapport aux pâturages) est associée à une hausse d’environ 6 points du taux de propriété.

Le même schéma apparaît à l’échelle régionale en Europe. Même en neutralisant les effets propres à chaque pays, les régions historiquement agricoles présentent des taux de propriété plus élevés. Ces résultats ne prouvent toutefois pas à eux seuls un lien de causalité. D’autres explications pourraient exister.

Ainsi, les représentations culturelles voyagent avec l’immigration, il faut distinguer l’influence de la culture de celle de l’expérience locale, comme les guerres, l’inflation ou d’autres facteurs pouvant aussi influencer la décision d’acheter un bien immobilier.

Le poids des cultures

Pour cela, nous avons analysé le comportement des immigrés de deuxième génération aux États-Unis. L’idée est que ces individus – un échantillon de plus de 5 000 personnes – vivent dans les mêmes institutions et le même système économique, mais héritent de cultures différentes selon le pays d’origine de leurs parents (145 pays).

Les résultats confirment notre hypothèse : les descendants de sociétés historiquement fondées sur les cultures agricoles ont une probabilité plus élevée d’être propriétaires. Ce résultat reste robuste après avoir contrôlé de nombreux facteurs tels que le revenu, l’éducation, l’origine ethnique, la localisation géographique, la situation matrimoniale ou la structure du foyer.

Pour s’assurer de la solidité de l’explication, il convient de tester des explications alternatives. Le résultat mis en évidence précédemment persiste même après la prise en compte de facteurs tels que le PIB, les inégalités, la démocratie, l’état de droit ou des indicateurs culturels plus larges.

Les données suggèrent qu’il ne s’agit pas simplement d’une « culture générale de la propriété ». Ce qui prédit la propriété chez les immigrés de deuxième génération, c’est la part de la propriété dans le pays d’origine qui s’explique par les conditions agricoles et les caractéristiques des sols. Cela renforce l’idée d’un héritage culturel spécifique lié à l’agriculture.

Vuillemey Guillaume ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

14.05.2026 à 17:38

Rosalind Franklin, la « dark lady » de la structure de l’ADN ou comment on exclut les femmes des sciences

Texte intégral (2606 mots)

Rosalind Franklin, la « dark lady » de l’ADN, mourrait le 16 avril 1958 d’un cancer de l’ovaire. Cristallographe avertie, spécialiste d’analyses de structure moléculaire, elle commence sa carrière indépendante (après sa thèse) à Paris au CNRS. Que nous apprend son histoire sur l’exclusion des femmes des carrières scientifiques ?

Dans les années 1950, une véritable course scientifique pour la découverte de la structure de l’ADN est lancée. Elle implique principalement trois équipes, celle de Linus Pauling à Caltech (États-Unis), et deux au Royaume-Uni : celle de James Watson et Francis Crick à Cambridge et celle de Maurice Wilkins du département de biophysique du King’s College à Londres dirigé par John Randall.

C’est dans ce contexte que ce dernier propose à Rosalind Franklin de monter sa propre équipe d’analyse structurale pour étudier la structure de l’ADN : l’enjeu est de taille, et Rosalind Franklin s’installe à Londres en janvier 1951. Les relations sont très vite tendues avec Maurice Wilkins, qui ne la vit pas comme une chercheuse indépendante (on dirait aujourd’hui « principal investigator »), mais plutôt comme travaillant dans son équipe, comme sa collaboratrice, voire son assistante ainsi que la désigne Watson. John Randall est probablement responsable de ne pas l’avoir accueillie dans des conditions claires pour ses collègues.

Elle travaille avec un doctorant, Raymond Gosling, et cherche à aligner les fibres d’ADN pour enregistrer des clichés de diffractions aux rayons X. Un des problèmes expérimentaux est l’existence de deux structures entremêlées dont la proportion dépend du degré d’humidité. Rosalind Franklin se propose de préparer un échantillon avec une unique structure pour avoir une image plus claire et elle y parvient. Le cliché n°51, devenu célèbre, lui permet d’obtenir, avec Raymond Gosling, la preuve expérimentale de la structure hélicoïdale. Mais ce cliché est dévoilé à James Watson par Maurice Wilkins : il lui a été transmis par Raymond Gosling, et il n’y a aucune trace d’un accord de Rosalind Franklin (ni Watson, ni Wilkins n’évoquent Franklin quand ils relatent cet échange dans leurs livres respectifs).

Ce cliché est la pierre angulaire expérimentale qui manquait aux réflexions de Watson et Crick sur la structure de l’ADN. Ils rédigent alors un article qu’ils destinent à Nature. Leur proposition a le mérite de justifier la stabilité de la structure en interaction par paires via des liaisons hydrogène : c’est important mais ne devrait pas occulter l’apport de Franklin dont le travail constitue la preuve expérimentale de la double hélice avec la présence du squelette phosphate à l’extérieur de la structure.

Les publications dans Nature

En 1953, John Randall, rencontrant l’éditeur de Nature, Lionel Brimble, apprend la publication imminente de la proposition de Watson et Crick, et il le convainc, sans évoquer celui de Franklin, de publier l’article de Wilkins, lui aussi sur la structure de l’ADN. Rosalind Franklin, déjà lassée par l’environnement peu inclusif de King’s College, est sur le départ pour aller à Birkbeck College où elle arrivera en mars 1953. Elle a déjà quasiment terminé de rédiger son propre travail sur l'ADN. Il lui fallut, apprenant que l’article de Watson et Crick et celui de Wilkins allaient être publiés, exiger elle-même, alors que l’avancée de sa recherche était parfaitement connue à King’s College, que le sien paraisse dans le même numéro.

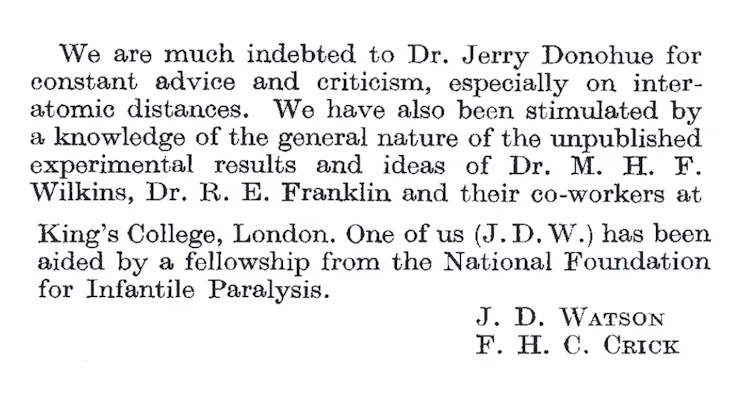

Trois articles seront donc publiés en 1953, l’un après l’autre, sous un chapeau commun « Molecular structure of nucleic acids » : l’article de Watson et Crick, qui apparaît en premier, celui de Wilkins puis celui de Franklin. Une note de l’article de Watson et Crick indique clairement que leur proposition théorique repose sur les travaux expérimentaux, non publiés jusqu’alors, de Wilkins et de Franklin.

Aujourd’hui, les canons d’un article scientifique veulent qu’on décrive tout d’abord les résultats « bruts », expérimentaux, qui sont analysés, décodés, pour amener à une discussion plus théorique des implications de ce qui a été mis au jour. Ici, l’éditeur a mis l’article théorique devant les deux articles expérimentaux. Certes sous un chapeau commun « Molecular structure of DNA », mais qui, aujourd’hui, est uniquement référencé (Web of science fin 2025) comme lié à l’article de Watson et Crick ! C’est sans doute, justement, parce qu’il est le premier de la série de trois. N’aurait-on pas pu imaginer un unique article avec les contributions expérimentales appuyant la proposition théorique ?

Est-ce important ? Il semble que oui : même si les nombres de citations doivent être manipulés avec précaution, on doit constater que le premier article, celui de Watson et Crick, est cité plus de 12 000 fois, alors que celui de Franklin et Gosling, ca. 1140 fois et celui de Wilkins, Stokes et Wilson ca. 740 fois (chiffres issus du site Web of science fin 2025).

Le Nobel : les femmes oubliées

On dit souvent que Rosalind Franklin n’a pas pu avoir le prix Nobel avec Watson, Crick et Wilkins en 1962 car il n’est pas décerné à titre posthume. Mais, on oublie alors que la règle qui l’interdit date de 1974. Avant 1962, au moins deux prix Nobel ont été attribués à titre posthume (Erik Axel Karlfeldt en 1931 et Dag Hammarskjöld en 1961). Mais voilà, il y a trois lauréats au prix de 1962, nombre maximal pour un prix Nobel, et Rosalind Franklin a été le « quatrième homme » (!), comme ce fut le cas de Jocelyn Bell, découvreuse des pulsars ou de Lise Meitner pour la fission nucléaire. Alors que le prix Nobel n’affiche qu’un peu plus de 6 % de lauréates, beaucoup sont citées comme étant sur cette « quatrième » marche !

Rosalind Franklin a été systématiquement écartée d’un réseau d’échanges (y compris d’échange de données, celles du cliché 51) et de discussions dans un environnement fortement sexiste. Par exemple, le salon des enseignants-chercheurs à King’s College est à l’époque interdit aux femmes. Or, ces endroits permettent des rencontres informelles cruciales dans les rapports entre scientifiques.

Sans ressentiment, semble-t-il, contre Watson et Crick, elle quitte le King’s College peu de temps après pour mener à Birkbeck College des travaux pionniers fondamentaux sur la structure des virus.

L’éditorial de Nature du 27 avril 2023, 70 ans après la publication des trois articles, discute de cette question et conclut :

« Malheureusement, cela reste vrai : le titre d’un article publié dans Nature (en 2022) « Les femmes sont moins reconnues que les hommes dans le domaine scientifique », en dit long. La diversité, l’équité et l’inclusion sont des concepts que certains considèrent encore comme des modes passagères et comme un anathème pour la « bonne » science. L’histoire de l’ADN prouve pourtant qu’ils sont les fondements d’une collaboration fructueuse et du progrès scientifique ».

Une exclusion insidieuse pérenne : que faire ?

Il est important de faire évoluer le vocabulaire : pourquoi ne pas choisir de parler de la « double hélice de Franklin, Watson et Crick » ? Et surtout il faudrait raconter cette histoire, en cours à l’école, au lycée, à l’université : c’est aussi de notre responsabilité en tant qu’enseignants, enseignantes, universitaires de transmettre des messages à nos publics étudiants sur la place des femmes en sciences. S’il ne s’agit évidemment pas de taire les noms de Watson et Crick, pensons, de manière inclusive, à mentionner ceux de Franklin et des autres femmes scientifiques : Jeanne Barret en botanique, Ada Lovelace pionnière de la programmation informatique, Lise Meitner et la découverte de la fission nucléaire, Maud Menten pour les modèles cinétiques de catalyse enzymatique, Marie Tharp pour les cartes des fonds sous-marins et sa contribution à la théorie de la tectonique des plaques, Marthe Gautier dans le contexte de la découverte de l’origine chromosomique du syndrome de Down, Chien-Shiung Wu pour ses études sur les interactions faibles, Jocelyn Bell pour les pulsars, et toutes les autres…

Les oublier, c’est ancrer chez les jeunes femmes l’idée que le monde de la science est fait pour les hommes et les en exclure : c’est le mécanisme aujourd’hui bien connu de la menace du stéréotype, concept proposé en 1995 par Claude Steele et Joshua Aronson : le stéréotype (par exemple, « les femmes sont moins douées que les hommes en sciences », « les garçons sont moins doués que les filles en dessin »), même s’il est sans fondement biologique, induit chez celles et ceux qui le connaissent, et particulièrement qui en sont victimes, un comportement qui le confirme.

Comme Rosalind Franklin, les femmes sont toujours partiellement exclues des lieux de sciences et des lieux de pouvoir scientifique mais c’est plus subtil qu’une salle des professeurs exclusivement masculine comme c’était le cas à King’s College. Le film Picture a Scientist notamment nous en montre des exemples : parcours de recrutement puis de carrière plus difficiles, espaces de travail plus réduits, parole non entendue, efforts plus importants demandés aux femmes, ou même réflexions faites sur les tenues vestimentaires…

Il faut en parler et promouvoir le recueil de données genrées pour permettre l’identification de ces biais, prérequis à leur prise en compte et aux actions pour les contrer. Si c’est souvent fait pour documenter les effets de genre sur les recrutements (et vérifier que les processus sont vertueux), cela n’est pas ou peu le cas pour les conditions de travail (soutien aux activités des femmes, allocations d’espace de travail, bureaux partagés ou non, contributions aux tâches collectives, sursollicitation singulièrement pour des tâches peu gratifiantes pour la carrière en lien avec l’exigence de quotas…). Ne faut-il pas envisager, le temps que la parité devienne effective, des mesures compensatoires pour que les femmes ne soient pas pénalisées dans les carrières scientifiques ? On pourrait penser à renforcer les aides au moment du congé maternité par exemple : sans défavoriser les collègues masculins, cela contribuerait à rendre, par là même, ces carrières plus accueillantes pour les jeunes filles. Car, aujourd’hui plus que jamais, face aux défis qui menacent notre planète, nous avons besoin de tous les cerveaux pour trouver des solutions et on ne peut pas se permettre d’exclure de facto la moitié de la population ! Beaucoup de chemin reste à parcourir pour une société scientifique plus juste et plus efficace !

Je remercie vivement Sophie Vriz d’avoir attiré mon attention sur la note de Watson et Crick dans l’article de 1953, Elisabeth Bouchaud de m’avoir signalé que l’interdiction des prix Nobel posthumes date de 1974 et pour sa magnifique série de pièces de théâtre « Les Fabuleuses » à la Reine Blanche, Dominique Guianvarc'h de m'avoir signalé le nom “dark lady” de l'ADN, et à toutes celles et tous ceux qui, comme Bernold Hasenknopf, systématiquement, chaque année, citent les femmes scientifiques dans leurs cours.

Clotilde Policar ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

14.05.2026 à 12:21

Guerre en Iran : la solidité du Kenya de nouveau à l’épreuve

Texte intégral (1916 mots)

Depuis 2020, le Kenya, qui vient de co-présider avec la France, à Nairobi, le sommet « Africa Forward » des 11 et 12 mai, a subi sans sombrer la pandémie de Covid-19, mais aussi des sécheresses, une flambée des prix des matières premières et les effets de l’instabilité régionale. Cette résistance affichée cache une fragilité structurelle : l’investissement est faible, la dépendance énergétique est élevée, et les tensions sociales et politiques persistent. Alors que la guerre en Iran a un impact direct sur l’économie du pays, le shilling et les réserves de change tiendront-ils cette fois ?

Depuis 2020, le Kenya a subi les mêmes chocs externes que le reste du monde – Covid-19, hausse du prix des matières premières, durcissement des conditions de financement, reconfiguration de l’ordre géopolitique et économique mondial. Mais dans le cas kényan, il faut y ajouter les sécheresses récurrentes en Afrique de l’Est, les invasions de criquets et la proximité de conflits armés – voire guerres civiles – en Éthiopie, au Soudan et dans la région des Grands Lacs (RDC, Rwanda).

S’il est important de souligner que le Kenya parvient globalement à résister à ces chocs externes, le répit pourrait n’être que de courte durée. À court terme, la guerre en Iran pourrait de nouveau déstabiliser le pays. À moyen et à long terme, d’importantes réformes sont nécessaires pour réduire les vulnérabilités du pays en augmentant l’investissement, la productivité et l’inclusivité d’une économie en partie capturée par les élites dirigeantes.

Entre 2020 et 2022, le Kenya a évité une triple crise

Durant la pandémie de Covid-19, les autorités kényanes ont mis en place différentes mesures, incluant confinements, couvre-feu, port du masque, restrictions de déplacement et vaccination. Les chiffres du ministère de la santé font état de 5 638 morts, dans un pays de quelque 55 millions d’habitants. Même si des études montrent que ces chiffres pourraient être sous-estimés, la surmortalité aurait été limitée à la vague Delta (variante du SARS-CoV-2) et aux plus de 65 ans. Le Kenya a évité une crise sanitaire d’ampleur.

En revanche, la pandémie, mais aussi les sécheresses et la hausse du prix des matières premières due à l’invasion de l’Ukraine par la Russie ont provoqué une dégradation de la situation économique du pays et de celle de ses habitants, en particulier des plus vulnérables : si la récession a été contenue à 0,3 % en 2020, le taux de pauvreté (fixé au seuil de 4,20 dollars par jour en parité de pouvoir d’achat) est passé de 56,8 % à 65,6 % entre 2019 et 2020.

À la veille des élections présidentielles et générales d’août 2022, l’inflation était en passe d’atteindre son pic à 9-10 %, les subventions au prix du pétrole et d’autres soutiens « Covid-19 » s’estompaient, et des manifestations virulentes contre la hausse du coût de la vie avaient lieu. Dans ce contexte, les élections ont été qualifiées de « triomphe pour la démocratie kényane » dans la mesure où elles se sont déroulées sans heurts majeurs comparé à un historique de violences – souvent qualifiées à tort d’« ethniques ».

2023-2024 : le spectre « ghanéen » d’un défaut sur la dette externe

Pour autant, la structure économique du Kenya reste fragile. L’image de la start-up nation, sixième économie d’Afrique à la croissance de 5 %, attirant les investisseurs du monde entier dans le secteur des technologies de l’information et de la communication, coexiste avec une autre réalité : l’économie kényane, basée sur l’agriculture et les services, pâtit de la faiblesse des investissements (cf.graphique 1), est peu productive, et exporte principalement des matières premières agricoles peu transformées (thé, café, fleurs coupées).

Les recettes du tourisme (2,9 % du PIB en 2024), et les devises apportées par les migrants (3,4 % du PIB) ne sont pas suffisantes pour équilibrer le compte courant, structurellement déficitaire du fait de la dépendance aux importations d’énergie, de biens d’équipement et alimentaires lors des sécheresses.

Ainsi, au plus fort de la crise énergétique post-invasion de l’Ukraine, le déficit du compte courant a atteint 5 % du PIB en 2022, dont 4,5 points liés aux importations d’énergie. L’accès à des devises est donc nécessaire vu le besoin de financement externe du Kenya, qui atteint 5,8 % du PIB en 2022 (cf. graphique 2).

Or, le pays attire moins d’investissements provenant de l’étranger que le Rwanda, l’Ouganda, la Tanzanie, et les pays de sa classe de revenu en moyenne (cf. graphique 3).

En 2022, le recours aux marchés internationaux était par ailleurs exclu, les spreads kenyans ayant atteint 14 % en juillet 2022, reflet du resserrement monétaire dans les pays riches, mais aussi de l’incertitude liée à la période préélectorale. S&P, Fitch et Moody’s avaient ainsi toutes dégradé la note souveraine du Kenya en six mois, entre décembre 2022 et mai 2023. Dès lors, le Kenya a dû puiser dans ses réserves de change pour couvrir ses besoins de financements externes.

En mai 2023, les réserves sont au plus bas depuis 2019 (cf. graphique 4), et la perspective d’un défaut sur le remboursement de l’Eurobond de 2 milliards de dollars, arrivant à échéance en juin 2024, emballe les marchés qui ont en tête le défaut du Ghana en 2022. Sinon auto-réalisatrices, ces anticipations auront eu de lourdes répercussions sur les fuites de capitaux, les conditions de financement, l’épuisement des réserves de change et la dépréciation du shilling : après des années de parité maintenue autour de 100 KES/1 USD, le shilling a atteint un point bas historique à 162 en janvier 2024 (soit une dépréciation réelle de 16,9 % sur l’année 2023).

Après des mois de diplomatie et de communication active du gouvernement, et avec un très fort soutien des bailleurs, le FMI a approuvé en urgence un prêt exceptionnel de 941 millions de dollars en janvier 2024. Cet apport se combinant à l’émission de 1,5 milliard d’Eurobond en février 2024 à la faveur du desserrement monétaire international, le Kenya remboursera son Eurobond.

Guerre en Iran, élections en 2027 : une situation tendue

En 2024-2025, le Kenya se relève de ces multiples chocs externes dans une situation très contrastée. Les indicateurs macroéconomiques affichent de bonnes performances, mais la situation socio-politique est tendue.

Contrairement à ses pairs régionaux, le Kenya est loin d’avoir retrouvé son niveau de pauvreté pré-pandémie : celui situé sous le seuil de 3 dollars/jour a même augmenté de 37,7 % à 43,8 %. Des manifestations d’ampleur, réprimées par la force, ont eu lieu en 2024 lorsque le gouvernement propose un projet de loi de finances destiné à redresser les comptes publics, qui reposait sur des taxes sur les produits du quotidien et le numérique, notamment. Le gouvernement abandonnera une partie des mesures mais, dans un contexte de capture du pouvoir économique par les élites dirigeantes, il ne se résout pas à mener certaines réformes structurelles nécessaires pour stimuler l’économie (plus fermée que ses pays pairs ou de référence (cf. graphique 1) ni à adopter une politique de réduction du déficit public qui ne reposerait pas sur une taxation affectant de façon disproportionnée les plus pauvres. Ces blocages ont mené à l’arrêt anticipé du programme du FMI dans le pays en 2025.

Si la guerre en Iran se prolongeait, l’impact serait important, via les mêmes canaux externes et internes que ceux qui ont fait tanguer le Kenya en 2023-2024 : le pétrole représente environ 20 % des importations depuis 2021 (dont la moitié des Émirats arabes unis et un quart supplémentaire des autres États du Golfe). Ainsi, la balance commerciale devrait être fragilisée par la hausse de la facture énergétique, et encore davantage si la hausse du prix des billets d’avion faisait baisser le tourisme.

Le déficit du compte courant est ainsi prévu à 4,1 % par le FMI (contre 3,4 % avant la guerre). Si ces tendances devaient se poursuivre, le risque est fort d’assister à une dépréciation du shilling, à une fuite des capitaux et à un durcissement des conditions de financement international. Pour l’instant, les spreads ont légèrement augmenté au début de la guerre, mais ils sont revenus à leur niveau préguerre fin avril. Du côté des réserves, la crise au Moyen-Orient arrive à un moment où elles sont, tant en volume (environ 13 milliards de dollars) qu’en équivalent-mois d’importations (5,5) à un niveau historiquement haut.

Cependant, la baisse toute récente visible sur le graphique 4, en partie liée à un remboursement anticipé de titres de dette juste après une émission comme en 2024, pourrait aussi être le signe que le Kenya commence à puiser dans ses réserves pour payer ses importations et/ou pour soutenir le shilling.

Du côté interne enfin, le pétrole représente 12 % du panier de consommation des Kenyans, et l’alimentation, sujette à la hausse du prix des engrais, 36 %. La hausse des prix de l’énergie a déjà un impact visible sur l’inflation : à +5,6 % en avril 2026 par rapport à avril 2025, et +6,5 % rien que pour les prix des transports entre mars et avril 2026, c’est la plus forte hausse depuis le pic d’avril 2022. Or, avec un déficit public initialement prévu à 5,6 % du PIB en 2026 par le FMI, mais qui devrait maintenant atteindre 6,4 %, le gouvernement a très peu de marges de manœuvre pour soutenir une population déjà largement éprouvée… à un an d’une élection présidentielle qui pourrait bien s’accompagner une nouvelle fois d’une montée des tensions.

Gaëlle Balineau ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

14.05.2026 à 12:21

Les K-SMP : les discrètes sociétés militaires privées sud-coréennes

Texte intégral (2227 mots)

Moins visibles que leurs homologues chinoises, les sociétés militaires privées sud-coréennes, que l’on nomme également les K-SMP ou K-PMC en anglais, sont aujourd’hui en pleine expansion, notamment en Asie. Bien que le développement de sociétés militaires privées au service de Séoul ait commencé à partir du conflit en Irak de 2003, le pays entretient un rapport très différent à ces organisations, en comparaison de celui que l’on peut observer en Europe de l’Ouest ou encore en Amérique du Nord.

L’émergence des K-SMP s’explique d’abord par la création, en Corée du Sud, des premiers acteurs privés œuvrant dans le domaine de la sécurité. En effet, avant toute volonté d’externalisation des activités militaires, le pays a vu apparaître à partir des années 1950 une série de petites sociétés dédiées au soutien des forces armées. D’abord au service de l’armée américaine pour assurer des livraisons de produits frais aux troupes stationnées dans le pays, ces sociétés vont se tourner progressivement vers la protection d’installations militaires et offrir de véritables services de sécurité. Avec la Guerre du Vietnam (1955-1975) et le retour des troupes sud-coréennes qui ont participé au conflit, le secteur de la sécurité privée en Corée du Sud va se développer, passant de 800 personnes en 1971 à 150 000 en 2013, avec environ 4 500 entreprises enregistrées.

Le lien entre Séoul et Washington va profondément influencer l’armée sud-coréenne. Celle-ci assiste notamment à l’usage progressif de sous-traitants par les troupes américaines durant leurs différents engagements conjoints — notamment en Irak en 2004 quand la division sud-coréenne Zaytun est déployée au Kurdistan irakien — mais également sur le territoire coréen, où certaines SMP américaines ont obtenu des contrats auprès des forces américaines stationnées sur place.

Si l’on ajoute à cela les tensions toujours persistantes entre Séoul et Pyongyang et les nombreuses opérations de maintien de la paix à l’international auxquelles a participé la Corée du Sud, on comprend pourquoi l’armée sud-coréenne est aujourd’hui l’une des forces armées les plus puissantes du monde de par sa modernité et son expérience.

Démographie et réglementation : les moteurs du développement des K-SMP

En complément de ces éléments historiques, deux facteurs favorisent le développement des K-SMP. Le premier est la démographie. La Corée du Sud est aujourd’hui confrontée à l’effondrement de son taux de natalité et à une décroissance démographique depuis 2020.

L’enjeu du maintien des capacités militaires du pays se pose d’autant plus que l’armée de Séoul est en partie dépendante de la conscription masculine. Pour y faire face, le pays a déjà recours à la sous-traitance, notamment dans les domaines de la logistique, de la sécurisation d’installations militaires, du cyber ou de l’entretien et de la maintenance de matériels.

Face à cette situation, le législateur sud-coréen a réagi. Certes, d’un côté, le contrôle des armes à feu demeure strict dans le pays, ce qui limite de facto la marge de manœuvre des sociétés militaires privées, mais, de l’autre, la réglementation autour des K-SMP a petit à petit évolué, notamment en ce qui concerne les missions de protection des navires face aux actes de piraterie. Des travaux en la matière ont été initiés à partir de 2014 et il existe aujourd’hui un véritable cadre légal pour les sociétés privées assurant ces missions, avec un système de licence pour les entreprises et un contrôle de leurs personnels.

L’emploi et la reconversion d’anciens membres des forces armées, des services de renseignement ou encore des forces de police est d’ailleurs favorisé par le cadre réglementaire coréen qui impose des limites d’âge pour occuper un poste de commandement (officier, inspecteur de police, etc.), mais également une durée maximale de temps en fonction. À l’issue de cette période, la personne est placée en retraite de son institution — ce qui, bien sûr, favorise le secteur privé, lequel peut récupérer des personnels expérimentés à la recherche d’une deuxième carrière après un long passage dans les services régaliens.

État des lieux du marché des K-SMP (2003 à aujourd’hui)

On retrouve des traces de Sud-Coréens travaillant comme « conseillers en sécurité » en Afrique durant la guerre froide et les conflits de décolonisation. Toutefois, le phénomène de développement des K-SMP en tant que telles semble remonter au conflit en Irak en 2003. En effet, en parallèle de l’engagement militaire sud-coréen aux côtés des États-Unis, on retrouve dès ce conflit les traces d’une première société militaire privée coréenne, la New Korea Total Service ou NKTS.

Fondée en 2003 à Séoul, NKTS débuta ses opérations au Moyen-Orient en décembre de la même année en obtenant des contrats en Jordanie, en Arabie saoudite, au Koweït, en Irak et aux Émirats arabes unis. Au total, la société aurait employé environ 100 Coréens — anciens des forces spéciales ou encore des services de police — et 300 employés issus des pays où elle était implantée.