27.03.2026 à 13:58

Quand le GPS devient une arme en mer : comment la guerre électronique menace les navires et leurs équipages

Texte intégral (2714 mots)

Des navires qui semblent tourner en rond, dériver à l’intérieur des terres ou apparaître soudain à des centaines de kilomètres de leur route : ces anomalies sont devenues plus fréquentes dans les zones de conflit. Elles révèlent l’essor du spoofing GPS, une menace croissante pour les systèmes de navigation maritime et pour les équipages qui en dépendent.

La guerre en Iran fait la une de l’actualité, entre frappes aériennes et montée des tensions militaires. Mais au-delà des destructions immédiates, le conflit révèle aussi une menace plus discrète, et en rapide progression : la vulnérabilité des navires – et de leurs équipages – aux perturbations de leurs systèmes de navigation.

Le transport maritime moderne repose largement sur la navigation satellitaire GPS. Lorsque ces signaux sont brouillés ou manipulés, les navires peuvent soudain apparaître, pour leur propre équipage comme pour les autres bâtiments, à un endroit où ils ne sont pas. Dans certains cas, des bateaux ont été observés en train de « sauter » d’un point à l’autre sur les cartes, dériver à des kilomètres à l’intérieur des terres ou semblant tourner en rond selon des trajectoires impossibles. Dans les zones de guerre, ce risque est encore plus élevé : un navire peut alors être dévié de sa route et se retrouver, sans le savoir, en plein danger.

En tant que chercheur en cybersécurité spécialisé dans les infrastructures critiques et les systèmes maritimes, j’étudie la manière dont les menaces numériques affectent les navires et les personnes qui les exploitent.

Pour comprendre les risques liés aux perturbations du GPS, il faut d’abord comprendre comment fonctionne ce système. Le GPS détermine une position à partir de signaux envoyés par des satellites en orbite autour de la Terre. Un récepteur calcule sa localisation en mesurant le temps que ces signaux mettent à lui parvenir. Or, lorsqu’ils atteignent la surface de la Terre, ces signaux sont extrêmement faibles, ce qui les rend relativement faciles à brouiller ou à manipuler.

Brouillage et usurpation du GPS

Dans le cas du brouillage GPS (dit « jamming »), un attaquant neutralise les véritables signaux satellites en les noyant sous un bruit électromagnétique. Les récepteurs ne parviennent alors plus à les capter et les systèmes de navigation perdent leur position. Sur un téléphone, cela peut se traduire par une carte qui se fige ou par une localisation qui saute de manière erratique.

L’usurpation GPS (ou « spoofing ») est plus sophistiquée. Au lieu de bloquer les signaux, l’attaquant émet de faux signaux satellites imitant les vrais. Le récepteur les accepte et calcule alors une position erronée. C’est comme si vous rouliez vers le nord alors que votre GPS affirme soudain que vous partez vers le sud. Le récepteur ne dysfonctionne pas : il a simplement été trompé.

Pour les marins, le spoofing peut avoir de graves conséquences. En pleine mer, il existe peu de repères permettant de vérifier la position d’un navire lorsque le GPS se comporte de manière étrange. Près des côtes, on ne dispose plus de la moindre marge d’erreur : les profondeurs varient rapidement et les dangers sont nombreux, en particulier dans des passages étroits comme le détroit d’Ormuz, près de l’Iran, où des opérations de spoofing GPS sont signalés depuis le début de la guerre. Or les navires sont massifs et manœuvrent lentement : même de petites erreurs de navigation peuvent provoquer des échouements ou des collisions.

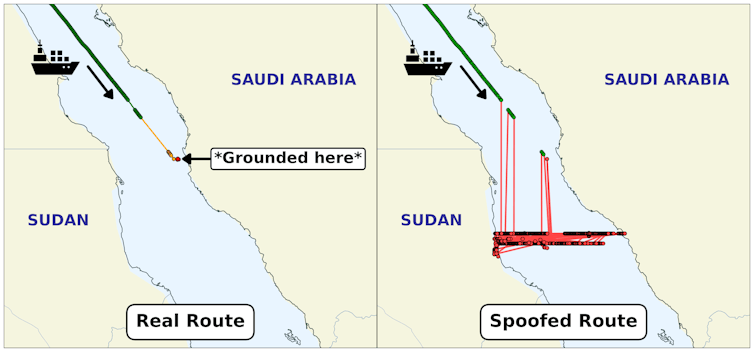

Un échouement en mer Rouge

Un exemple marquant s’est produit en mai 2025. Alors qu’il transitait par la mer Rouge, le porte-conteneurs MSC Antonia a commencé à afficher des positions très éloignées de sa localisation réelle. Pour les navigateurs à bord, le navire semblait avoir soudain « sauté » de plusieurs centaines de kilomètres vers le sud sur la carte et se mettre à suivre une nouvelle trajectoire. Désorienté, l’équipage a fini par perdre le contrôle de la situation, et le navire s’est échoué. L’incident a causé plusieurs millions de dollars de dégâts et nécessité une opération de renflouement qui a duré plus de cinq semaines.

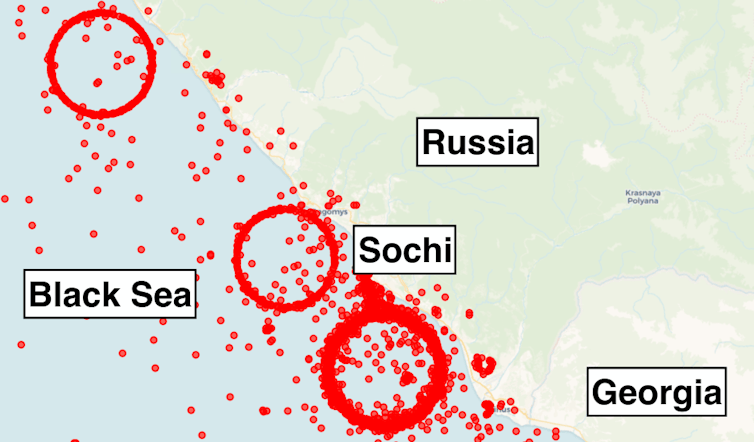

L’incident du MSC Antonia est loin d’être un cas isolé. Les données de suivi maritime ont mis en évidence des groupes de navires apparaissant soudain dans des positions impossibles, parfois loin à l’intérieur des terres ou décrivant des cercles parfaits sur les cartes. Des anomalies de plus en plus souvent attribuées à des opérations de spoofing GPS dans des zones de fortes tensions géopolitiques.

Mais les interférences GPS ne sont qu’une facette des menaces numériques qui pèsent désormais sur le transport maritime. Des rapports du secteur font état d’attaques par rançongiciel visant des compagnies maritimes, de compromissions de chaînes d’approvisionnement et d’inquiétudes croissantes autour de la sécurité des systèmes de contrôle embarqués, qu’il s’agisse des moteurs, de la propulsion ou des équipements de navigation. Plus les navires sont connectés – via l’internet satellitaire et des outils de surveillance à distance –, plus les points d’entrée potentiels pour les cyberattaques sont nombreux.

Les navires militaires tentent souvent de réduire ces risques en mettant en place une séparation plus stricte des réseaux informatiques et en organisant régulièrement des exercices d’entraînement, comme les simulations dites de « mission control », qui consistent à opérer malgré des systèmes de communication ou de navigation dégradés. Certains experts en cybersécurité estiment que des pratiques similaires pourraient renforcer la résilience du transport maritime commercial, même si la taille réduite des équipages et les ressources limitées rendent l’adoption de procédures inspirées du monde militaire plus difficile.

L’expérience des marins

Dans le débat public sur la cybersécurité maritime, l’attention se porte souvent sur les failles techniques des systèmes embarqués. Mais une autre dimension est tout aussi essentielle : les femmes et les hommes qui doivent interpréter ces technologies et réagir lorsque quelque chose tourne mal.

Dans une étude récente, mes collègues et moi avons interrogé des marins professionnels sur leur expérience des incidents cyber et sur leur capacité à y faire face. Les entretiens ont été menés avec des officiers de navigation, des ingénieurs et d’autres membres d’équipage responsables des systèmes du navire. Un constat s’en dégage clairement : les menaces numériques se multiplient en mer, mais les équipages sont mal préparés pour y répondre.

Beaucoup de marins nous ont expliqué que leur formation à la cybersécurité se concentrait presque exclusivement sur le phishing par e-mail et l’usage de clés USB. Une approche qui peut avoir du sens dans un environnement de bureau, mais qui prépare très peu aux incidents cyber à bord d’un navire, où les systèmes de navigation et de contrôle peuvent devenir les principales cibles. Résultat : de nombreux marins manquent de repères clairs pour comprendre comment une cyberattaque pourrait affecter les équipements dont ils dépendent au quotidien.

Le problème apparaît lorsque les systèmes du navire commencent à se comporter de manière anormale. Plusieurs marins ont ainsi raconté avoir vu le GPS afficher des positions erronées ou perdre momentanément le signal. Dans ces situations, il est souvent difficile de savoir s’il s’agit d’une simple panne technique ou du signe d’une interférence malveillante.

Et même lorsque l’équipage soupçonne un problème, de nombreux navires ne disposent pas de procédures claires pour faire face à un incident cyber. Les marins décrivent fréquemment des situations où ils devraient improviser si les systèmes de navigation ou d’autres outils numériques se comportaient de façon inattendue. Contrairement aux pannes matérielles, qui s’accompagnent généralement de listes de vérification et de protocoles bien établis, les incidents cyber se situent souvent dans une zone grise où les responsabilités et les réponses à apporter restent floues.

Un autre défi tient à la disparition progressive des pratiques traditionnelles de navigation. Pendant des siècles, les marins s’appuyaient sur les cartes papier et la navigation astronomique pour déterminer leur position. Aujourd’hui, la plupart des navires commerciaux dépendent presque entièrement de systèmes électroniques.

Plusieurs marins ont ainsi souligné que les cartes papier ne sont plus toujours disponibles à bord et que la navigation céleste est très rarement pratiquée. Si le GPS ou les systèmes de navigation électroniques cessent de fonctionner, les équipages disposent donc de peu de moyens pour vérifier indépendamment leur position. L’un des marins interrogés résume brutalement le risque : « Sans cartes, si vous êtes victime de spoofing, vous êtes un peu fichus. »

Une connectivité croissante, des risques accrus

Dans le même temps, les navires sont de plus en plus connectés. Les bâtiments modernes s’appuient désormais largement sur l’internet satellitaire – notamment des systèmes comme Starlink – ainsi que sur des outils de surveillance à distance pour gérer leurs opérations et communiquer avec la terre.

Si ces technologies améliorent l’efficacité, elles élargissent aussi les vulnérabilités des systèmes embarqués. La connectivité qui permet aux équipages d’envoyer des e-mails ou d’accéder à internet peut également ouvrir des voies d’accès aux cybermenaces vers les systèmes du navire.

À mesure que le spoofing GPS se multiplie dans les régions marquées par des tensions géopolitiques, les difficultés décrites par les marins dans notre étude deviennent de plus en plus difficiles à ignorer. Les océans peuvent sembler vastes et vides, mais les signaux numériques qui guident les navires modernes circulent dans un espace saturé et disputé.

Lorsque ces signaux sont manipulés, les conséquences ne se limitent pas aux systèmes militaires. Elles touchent aussi les navires commerciaux qui transportent l’essentiel des marchandises mondiales, ainsi que les équipages chargés de les conduire en toute sécurité.

Anna Raymaker a reçu des financements de la National Science Foundation et du Department of Energy pour ses travaux de recherche.

26.03.2026 à 15:44

Qu’est-ce que l’« IA agentique » ? Comprendre son histoire pour dépasser l’effet de mode

Texte intégral (1555 mots)

Réserver un voyage en comparant des centaines d’offres, rédiger un rapport à partir de plusieurs documents, analyser des données médicales ou corriger automatiquement un programme informatique : ces tâches exigent de la réflexion, de la méthode et des compétences variées. L’« IA agentique » promet désormais de les accomplir de manière autonome, en orchestrant les opérations nécessaires, en utilisant des outils et en corrigeant ses propres erreurs… Toutefois, l’IA agentique actuelle ne recouvre pas encore toute la richesse du concept d’« agent autonome » tel qu’il a été élaboré dans les décennies précédentes.

Le cabinet Gartner a présenté 2026 comme l’année des « agents IA ». Ces systèmes dépassent la simple amélioration des assistants conversationnels. Les agents IA d’OpenClaw sont d’ores et déjà capables de dialoguer entre eux et d’exécuter des tâches complexes avec une supervision humaine limitée. Pour les entreprises, que ce soit dans l’industrie, l’administration ou la santé, la promesse est celle d’une automatisation plus souple qu’avec les logiciels traditionnels, capable de s’adapter à des situations variées plutôt que d’appliquer des règles prédéfinies.

Pourtant, derrière l’apparente nouveauté se cache une histoire plus ancienne. L’IA agentique s’inscrit dans la continuité de plusieurs décennies de recherche sur les agents autonomes et les systèmes multi-agents. Ce qui change aujourd’hui, ce sont les outils, notamment les grands modèles de langage et leur capacité à interagir plus naturellement avec les humains.

De la génération de texte à l’action

Les modèles conversationnels, comme ChatGPT, Gemini ou Claude, impressionnent par leur aptitude à résumer ou à rédiger des textes complexes. Pris isolément, ils restent toutefois essentiellement réactifs : ils produisent une réponse en fonction d’une requête. Un agent autonome va plus loin. Il peut analyser une demande, planifier une séquence d’opérations, utiliser des outils externes (moteur de recherche, base de données, logiciel), évaluer le résultat obtenu et ajuster sa stratégie si nécessaire.

Là où un modèle de langue se limite à écrire un programme informatique, un agent peut l’exécuter dans un environnement sécurisé, observer les erreurs éventuelles, corriger le code, puis le tester à nouveau. En somme, les agents IA ne font pas que parler, ils agissent.

Le passage de la génération de texte à l’action transforme la nature même du logiciel. Alors qu’un programme suit des instructions précisément définies à l’avance, un agent autonome peut, lui, adapter dynamiquement ses décisions en fonction du contexte, des résultats obtenus et des objectifs fixés. Il ne remplace pas nécessairement l’humain, mais modifie la répartition des tâches entre supervision et exécution.

Promesses et risques

Cette évolution ouvre des perspectives considérables. Dans les organisations, des agents peuvent automatiser des processus métiers laborieux. Dans l’industrie, ils peuvent coordonner des systèmes logiciels complexes. Dans le domaine médical, ils peuvent analyser des dossiers, rechercher des publications pertinentes et proposer des synthèses pour assister les médecins. Mais ces promesses s’accompagnent de risques.

En effet, les modèles actuels peuvent produire des informations inexactes, les fameuses hallucinations, et sont susceptibles de reproduire des biais présents dans leurs données d’entraînement. Si les agents sont cantonnés à un rôle d’assistant, ces limites sont déjà problématiques ; elles deviennent critiques lorsqu’elles concernent des systèmes capables d’agir sur des infrastructures techniques, notamment en exécutant des commandes système, en manipulant des fichiers ou en envoyant des requêtes réseau.

La question des agents d’IA n’est donc pas seulement technique : elle est aussi juridique, économique et sociétale. Elle touche à la transformation du travail qualifié et à la gouvernance des systèmes informatiques.

Une filiation historique

L’idée d’un agent autonome n’est pas née avec les modèles de langue. Elle remonte aux origines mêmes de l’intelligence artificielle. En 1956, lors de la conférence fondatrice de Dartmouth (au nord-est des États-Unis), l’un de ses organisateurs, Marvin Minsky, définissait déjà l’IA comme la conception de programmes capables d’accomplir des tâches mobilisant des capacités dites intelligentes telles que comprendre, apprendre, raisonner ou décider.

À partir des années 1980, la notion d’« agent intelligent » devient centrale. Un « agent » est alors défini comme un programme capable de percevoir son environnement, de prendre des décisions et d’agir pour atteindre des objectifs. Très tôt, les chercheurs développent le champ des systèmes multi-agents : des ensembles organisés de programmes autonomes qui interagissent dans un même environnement numérique. L’objectif est de comprendre comment ces entités peuvent se coordonner, coopérer ou entrer en compétition afin de résoudre des problèmes complexes.

Plusieurs travaux emblématiques illustrent concrètement cette approche. Le système HEARSAY-II repose sur un modèle de « tableau noir ». Plusieurs modules spécialisés pour la reconnaissance, l’analyse et l’interprétation du langage contribuent à la compréhension de la parole en partageant leurs hypothèses dans un espace commun structuré. Le Contract Net Protocol propose un mécanisme inspiré des appels d’offres : pour réaliser une tâche, un agent émet un appel à proposition, d’autres agents proposent leurs services, et les plus compétents se voient attribuer le contrat. Autrement dit la coordination entre agents est au cœur de l’IA depuis plusieurs décennies.

Un réservoir d’idées encore sous-exploité

Mais si l’idée d’agent n’est pas nouvelle, l’« IA agentique » s’impose aujourd’hui auprès des non-spécialistes en raison du rôle central joué par les grands modèles de langue. Bien que dénués de compréhension causale et de compréhension du monde physique, ceux-ci fournissent aux agents une capacité linguistique et une forme de « sens commun » statistique qui facilitent l’interaction avec les humains et l’interprétation d’instructions complexes en langage naturel.

Toutefois, l’IA agentique actuelle ne recouvre pas encore toute la richesse du concept d’agent autonome tel qu’il a été élaboré dans les décennies précédentes. Dans la pratique, elle repose encore le plus souvent sur une séquence d’actions où chaque étape est prévue et ordonnée à l’avance. Les travaux menés depuis les années 1990 sur les systèmes multi-agents qui portent sur la coopération, la négociation, l’allocation de tâches et l’adaptation collective offrent un réservoir d’idées encore largement sous-exploitées.

L’intégration de ces mécanismes avec les capacités des grands modèles ouvre pour demain des perspectives nouvelles : des agents capables non seulement d’exécuter un plan mais de s’organiser collectivement, de se spécialiser et de s’adapter à des environnements complexes.

L’IA agentique constitue ainsi une nouvelle étape plutôt qu’une rupture. Elle associe l’héritage théorique des systèmes multi-agents à la puissance récente des modèles génératifs. Comprendre cette filiation historique permet de dépasser l’effet de mode. L’IA agentique représente une tentative de transformer des modèles prédictifs en systèmes capables d’agir, de planifier et, peut-être demain, de s’organiser collectivement dans des environnements complexes.

Maxime MORGE a reçu des financements de Lyon 1 Université et CNRS, .

25.03.2026 à 17:07

La science est-elle malade de ses revues ? Patrick Couvreur et Justine Fabre sont dans la Grande Conversation

Lire plus (319 mots)

Comment fonctionne vraiment l’édition scientifique ? Modèles économiques, poids des grands éditeurs, fraudes, évaluation des articles, open access, voie diamant : cette Grande Conversation, l'émission de The Conversation et CanalChat en partenariat avec l'Académie des sciences, propose de lever le voile sur un univers méconnu du grand public, mais décisif pour l’avenir de la recherche.

Les chercheurs produisent les articles, évaluent souvent bénévolement ceux de leurs pairs et contribuent à la mise en forme des publications. Pourtant, la diffusion de ces travaux est contrôlée par des éditeurs commerciaux. Avec la montée de l’open access, un nouveau modèle s’est imposé : les APC, les frais de publication que les chercheurs ou leurs institutions doivent payer pour rendre leurs articles accessibles.

Résultat : le système combine désormais deux logiques payantes. Les institutions continuent de payer des abonnements, tout en finançant de plus en plus les APC. En France, ces frais de pourraient dépasser 50 millions d’ici 2030. À cela s’ajoutent près de 90 millions d’euros d’abonnements aux revues. Économiquement insoutenable…

Des solutions existent, comme le modèle de publication scientifique en libre de l'Académie des Sciences et du CNRS, gratuit pour les auteurs comme pour les lecteurs. Mais elles tardent à se généraliser. Pourquoi? Quelles sont les logiques qui poussent les chercheurs à continuer de jouer le jeu des APC? Comment peut-on promouvoir l'open access? Nos deux invités, le chercheur Patrick Couvreur et la directrice du Patrimoine et des Ressources scientifiques de l'Académie des Sciences Justine Fabre, nous aident à y voir plus clair dans ce nouvel épisode de La Grande Conversation.

25.03.2026 à 15:27

IA : pourquoi former une « tête bien faite » n’a jamais été aussi crucial

Texte intégral (1580 mots)

Alors que l’intelligence artificielle générative produit des textes, des images et des raisonnements toujours plus convaincants, une question éducative essentielle émerge : que signifie encore comprendre ? À l’ère de la surcharge informationnelle, former une « tête bien faite » ne consiste plus à accumuler des savoirs, mais à apprendre à juger de leur profondeur, de leur validité et de leur inscription dans le réel.

Des étudiants peuvent rendre aujourd’hui des travaux irréprochables sur la forme : structurés, argumentés, parfois brillants. Pourtant, lorsqu’on les interroge, un malaise affleure. Ils peinent à expliquer ce qu’ils ont réellement compris, à justifier leurs choix, à relier ce qu’ils ont produit à une expérience vécue ou à une situation concrète. L’intelligence artificielle (IA) générative n’est pas toujours la cause directe de cette situation, mais elle en est un révélateur puissant. Car si produire de l’information n’a jamais été aussi simple, comprendre ce que l’on fait n’a jamais été aussi exigeant.

Connaître, savoir, comprendre : une distinction devenue centrale

À l’ère de l’IA, la question éducative ne peut plus être pensée en termes d’accumulation de connaissances. Elle impose de clarifier ce que l’on entend par connaître, savoir et comprendre, et d’interroger la manière dont ces dimensions s’articulent dans les processus d’apprentissage.

Deux grandes traditions épistémologiques permettent d’éclairer cette distinction. Le scientifique Michael Polanyi a montré que toute connaissance humaine comporte une part irréductiblement tacite : elle est enracinée dans l’expérience, l’action et l’engagement du sujet. « Nous savons plus que ce que nous pouvons dire », écrit-il, soulignant que la compréhension précède souvent sa formulation explicite. Cette connaissance en acte, souvent implicite, se construit dans le faire, l’essai, l’erreur et la confrontation au réel.

À l’inverse, le philosophe Gaston Bachelard a établi que le savoir scientifique ne procède pas d’un simple prolongement de l’expérience. Il exige une rupture avec les évidences premières et avec l’opinion, au prix d’un travail de construction rationnelle, critique et abstraite. « La science ne procède pas de l’opinion », rappelait-il, insistant sur la nécessité de former l’esprit à poser des problèmes plutôt qu’à accumuler des réponses.

Former une « tête bien faite », ce n’est donc ni accumuler des savoirs abstraits, ni se contenter d’une expérience brute. C’est apprendre à tenir ensemble ces deux dimensions : l’expérience vécue et la construction conceptuelle, l’action et la réflexivité.

Ce que l’IA sait faire – et ce qu’elle ne peut pas faire

Les systèmes d’intelligence artificielle excellent précisément là où le savoir est formalisable : calcul, synthèse, reproduction, mise en forme. Ils prennent en charge une part croissante du savoir explicite, stabilisé, calculable. Mais ils opèrent dans un régime spécifique : celui de la corrélation statistique et de la production d’énoncés plausibles.

L’IA ne connaît pas le monde, elle ne le comprend pas. Elle n’a ni expérience, ni rapport incarné au réel, ni accès aux conditions de pluralisme des phénomènes qu’elle décrit. L’information qu’elle génère est par nature probabiliste – elle repose sur des calculs de vraisemblance issus de corrélations statistiques plutôt que sur une compréhension des causes, contingente – elle dépend des données, des contextes d’énonciation et des paramètres techniques, et révisables – en ce sens qu’elle peut être corrigée, contredite ou reformulée à tout moment sans que cela n’implique une progression interne de la compréhension.

Cette distinction est aujourd’hui au cœur des travaux contemporains sur les usages éducatifs de l’IA, qui montrent que l’automatisation de certaines tâches cognitives peut, si elle est mal encadrée, appauvrir l’exercice du jugement critique.

Plus les productions de l’IA deviennent convaincantes, plus le risque est grand de confondre cohérence formelle et compréhension réelle, à savoir paraître véridique en lieu et place d’un énoncé prudent et ouvrant le dialogue.

Mesurer la complexité : une compétence qui s’apprend

Face à cette situation, un enjeu éducatif majeur émerge : la capacité à mesurer la complexité des choses. Distinguer ce qui relève de la surface informationnelle de ce qui engage une compréhension structurée. Apprécier les niveaux de profondeur d’un problème, d’un système ou d’une situation.

Or cette capacité ne se décrète pas. Elle se construit progressivement par l’expérience du réel. Elle suppose un travail actif de confrontation entre ce que l’on anticipe théoriquement et ce que révèle l’épreuve de la réalisation concrète. C’est dans l’écart, toujours instructif, entre le modèle et l’expérience que s’affinent les critères de jugement et que se développe une intelligence véritablement située, au sens où elle articule savoir formalisé et connaissance vécue.

Le savoir ne devient opérant qu’à condition d’être éprouvé, mis en tension avec le réel, réajusté à la lumière de ses résistances et de ses surprises. Inversement, l’expérience brute, si elle n’est pas reprise dans un cadre réflexif et conceptuel, demeure muette et difficilement transmissible. La formation doit donc organiser les conditions de cette circulation exigeante entre théorie et pratique, abstraction et incarnation.

Une révolution pédagogique autant que technologique

L’intelligence artificielle ne transforme pas seulement nos outils. Elle intervient au cœur même des fonctions cognitives supérieures : mémoire externalisée, accès instantané à l’information, génération de raisonnements apparents. Là où les technologies précédentes amplifiaient des capacités humaines déjà constituées, l’IA en reconfigure désormais l’équilibre.

L’enjeu éducatif se déplace en conséquence. Il ne s’agit plus principalement d’apprendre à produire ou à restituer de l’information mais d’apprendre à en évaluer la profondeur, la cohérence, les conditions de validité et les effets dans le réel. Cette mutation rejoint les analyses du sociologue Edgar Morin sur la pensée complexe, qui soulignent la nécessité de former des esprits capables de relier, de contextualiser et d’affronter l’incertitude plutôt que de réduire le réel à des réponses simplifiées.

Des travaux récents en sciences cognitives et en sciences de l’éducation montrent d’ailleurs que l’usage substitutif de l’IA peut conduire à une forme de délégation cognitive excessive, réduisant l’engagement intellectuel et la mémorisation à long terme, là où un usage réflexif et critique peut au contraire renforcer l’apprentissage.

Former des ingénieurs – et des citoyens – capables de juger

Former une tête bien faite à l’ère de l’IA implique ainsi de ne pas confondre délégation cognitive et renoncement intellectuel. Il s’agit de former des sujets capables de faire usage de systèmes puissants sans s’y soumettre, capables de maintenir une exigence de sens là où la machine ne produit que de la forme.

Chez IONIS, le développement des IONIS Institute of Technology (I2T) sur nos campus procède d’une conviction forte : si nos étudiants ingénieurs doivent maîtriser les technologies de l’intelligence artificielle, ils doivent tout autant apprendre à en éprouver les limites par la confrontation au réel. Le laboratoire, l’atelier et l’expérimentation deviennent alors des lieux centraux de formation du jugement.

Former de bons ingénieurs – et plus largement des citoyens éclairés – consiste à cultiver un esprit critique, mesuré et évolutif, nourri par l’expérience concrète, le faire et le défaire. À l’ère de l’IA, la question essentielle n’est donc pas seulement ce que nous attendons de la machine mais bien ce que nous attendons de l’humain : sa capacité à comprendre, à créer et à décider avec discernement dans des environnements incertains et technologiquement augmentés.

Clément Duhart ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

24.03.2026 à 16:09

Après plus d’un demi-siècle, les astronomes percent les secrets d’une étoile mystérieuse

Texte intégral (2465 mots)

Découverte au début du XXe siècle, l’étoile Gamma Cassiopeiae a posé plusieurs énigmes aux astronomes. Si on comprend mieux aujourd’hui son fonctionnement, elle ouvre un pan insoupçonné du fonctionnement des astres.

Observer une étoile, voilà qui semble plutôt banal en astronomie. Aujourd’hui, on imagine davantage les énigmes cosmiques tapies dans les premiers instants de l’Univers ou sous les nuages des exoplanètes. Pourtant, une étoile visible chaque nuit recèle un mystère, enfin élucidé après cinquante ans de recherches !

Cet astre se cache au cœur de Cassiopée, une constellation en forme de W ou de M, selon son orientation cette nuit-là, et visible toute la nuit et toute l’année. Gamma Cassiopeiae – c’est son nom – est aussi appelée Navi, clin d’œil de l’astronaute Gus Grissom (Navi correspond à son deuxième prénom, Ivan à l’envers, qu’il utilisait pour la navigation). Peu connue du grand public, c’est pourtant une vedette pour les astronomes.

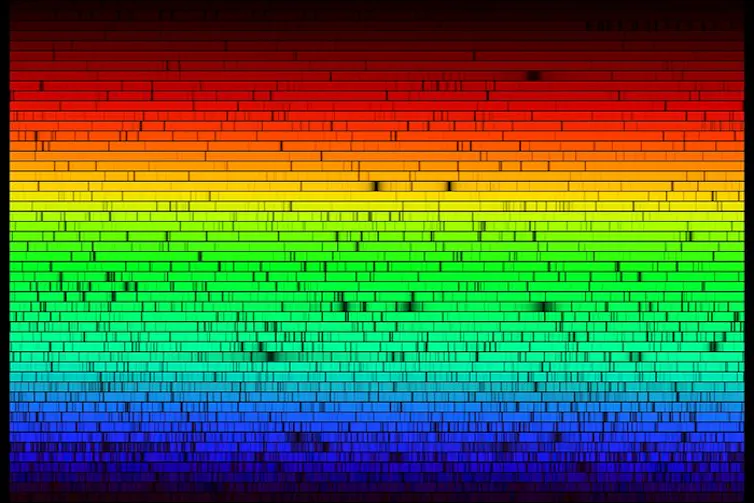

Il y a cent vingt ans, l’astronome italien Angelo Secchi pointe sa lunette vers cet astre pour en étudier le spectre. Le spectre d’une étoile, en général, ressemble à un arc-en-ciel, au sein duquel des raies noires apparaissent : elles correspondent aux couleurs absorbées par les différents éléments qui composent l’atmosphère de l’étoile. On peut donc retrouver sa composition en étudiant ces raies. Mais Secchi y repère une chose étrange : des raies brillantes, qui correspondent plutôt à la lumière émise, et non absorbée, par de l’hydrogène.

Une étoile pleine de mystères

Ce premier mystère a mis soixante-cinq ans à être résolu. L’astronome Otto Struve explique en 1931 que ces émissions inhabituelles naissent dans un disque de matière entourant l’étoile. On aurait pu croire observer ce que l’on appelle un disque d’accrétion, un disque de poussière et de gaz entourant les étoiles jeunes, à partir duquel se forment l’étoile et ses planètes. Mais ici, il s’agit en réalité d’un disque de décrétion, alimenté par de la matière éjectée par l’étoile ! Gamma Cassiopeiae (Gamma Cas) devint alors le prototype d’une nouvelle famille, celles des étoiles dites « Be », des étoiles chaudes qui émettent de la matière. Ce groupe rassemble en fait une bonne fraction des étoiles chaudes de type B. Beaucoup d’astronomes amateurs les prennent pour cible pour suivre leurs variations, au gré de l’évaporation ou de la reconstruction de leur disque.

Cependant, on découvrit il y a cinquante ans que Gamma Cas, le prototype, n’était pas si représentatif de sa famille ! En 1976, le satellite SAS-3, l’un des premiers télescopes spatiaux à observer dans le domaine des rayons X, détecta en effet une émission énergétique en provenance de Gamma Cas. Normalement, les émissions de rayons X des étoiles massives sont assez stables et peu intenses, représentant seulement un dix-millionième de leurs émissions totales. Elles proviennent de matière chauffée à seulement 5 millions de degrés. Gamma Cas, elle, brille 40 fois plus intensément, son émission de rayons X varie fortement en quelques minutes, voire en quelques secondes, et la température associée à ces émissions est estimée à 150 millions de degrés, provoquant une ionisation extrême de la matière.

L’étoile présente de plus des signatures de fluorescence, un phénomène qui se produit quand de la matière froide absorbe de la lumière (ici, des rayons X) puis la réémet à une fréquence légèrement différente – de nouveau, quelque chose de totalement inédit pour les étoiles massives.

Gamma Cas, la seule de son espèce ?

Au fil des ans, et surtout durant ces vingt dernières années, les télescopes spatiaux Chandra, XMM-Newton, et e-ROSITA ont repéré deux douzaines d’objets similaires à Gamma Cas : tous de type Be, tous dotés d’une émission X inhabituelle et parfaitement ordinaires par ailleurs. Environ 10 % des étoiles Be les plus massives semblent concernées. Ce n’est donc plus une curiosité, mais bien un phénomène astrophysique à part entière !

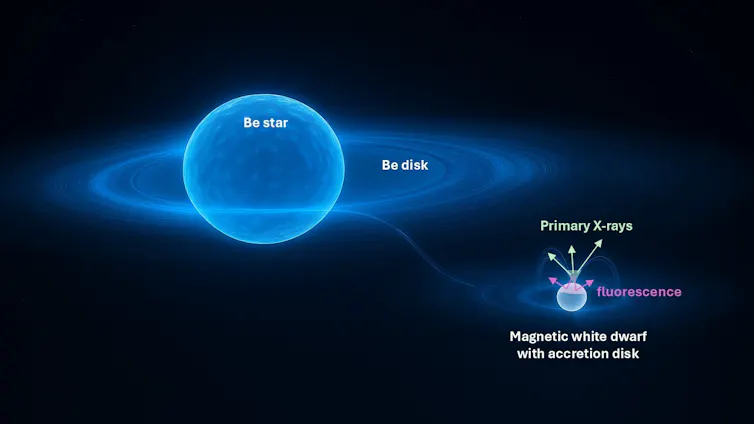

Bien sûr, les astronomes ont voulu expliquer ces propriétés étranges. Deux hypothèses principales ont été formulées : ces émissions, c’est soit de la faute de l’étoile, soit de celle d’un compagnon, c’est-à-dire un autre astre accompagnant l’étoile – ce qui ne serait pas surprenant, la plupart des étoiles massives vivant en couple ou en trio. Dans le premier cas, des rayons X naîtraient de l’interaction entre le champ magnétique de l’étoile et celui de son disque. Ce seraient des événements rapides et énergétiques, et la fluorescence serait alors provoquée par des rayons X se réfléchissant sur le disque autour de l’étoile.

Dans le second cas, il faut évidemment un compagnon. Or, les astronomes estiment aujourd’hui que les étoiles Be naissent justement à la suite d’interactions au sein de couples stellaires. D’ailleurs, Gamma Cas possède bien un compagnon, de masse similaire au Soleil. Au départ, Gamma Cas était une étoile bien moins massive, mais son compagnon lui a transféré de la matière, ce qui l’a fait grossir et tourner beaucoup plus vite. Dans le même temps, le compagnon, lui, est devenu compact. S’il s’agit d’un cœur stellaire dénudé (une stripped star, étoile ayant perdu ses couches externes lors du transfert de matière), il pourrait émettre un vent qui entrerait en collision avec le disque de décrétion, le choc générant des rayons X.

Hélas, les observations contredisent les prédictions de ce modèle, qui a dû être abandonné. Si le compagnon est une étoile à neutrons ou une naine blanche, il pourrait attirer la matière du disque et celle-ci, en tombant vers lui, générerait des émissions X. Pour le cas de l’étoile à neutrons, les calculs précis entrent ici aussi en conflit avec les observations. Restent donc deux scénarios : les rayons X sont produits près de l’étoile massive ou bien près du compagnon de type naine blanche.

Un nouveau satellite nous donne la clé du mystère

Pour trancher, il faut mesurer le mouvement imprimé dans l’émission X. En effet, dans un couple stellaire, aucun repos : les deux astres se tournent autour dans une valse (quasi) éternelle. L’un s’approche quand l’autre s’éloigne mais l’étoile, dix fois plus massive que son compagnon, bouge dix fois moins. L’émission X est soit liée à l’étoile Be et donc bouge comme elle, soit liée au compagnon et donc bouge comme lui. Facile par conséquent de faire la différence ? En théorie oui, mais en pratique, moins, car les instruments en rayons X manquaient jusqu’ici de précision.

C’est là qu’intervient XRISM, fleuron de l’Agence spatiale japonaise, JAXA. Lancé fin 2023, ce satellite embarque un instrument, baptisé Resolve, très particulier : il est capable de mesurer la lumière un photon à la fois et, ainsi, de fournir des caractéristiques sur sa cible, notamment sa vitesse, avec une précision inégalée.

XRISM a visé Gamma Cas trois fois, en décembre 2024, février et juin 2025, à chaque fois pendant une demi-journée environ. Trois mesures à trois moments clés du mouvement orbital. Verdict : les rayons X du gaz ultra chaud tout comme la fluorescence associée au gaz plus froid suivent le mouvement d’un compagnon stellaire. Après un demi-siècle, les astronomes percent donc enfin le secret de ces rayons X inattendus.

Mystère résolu ? Oui et non. Depuis des décennies, on prévoit que des étoiles de type Be soient associées à des naines blanches, mais on n’en avait encore trouvé aucune qui ne fasse pas débat dans notre galaxie. XRISM révèle enfin où elles se cachent : chez Gamma Cas et ses semblables.

Cependant, les modèles prédisaient aussi que ces naines blanches devaient être non seulement nombreuses (elles accompagneraient de 30 à 50 % des étoiles Be), mais aussi préférentiellement associées aux étoiles Be de faible masse. On en trouve ici une fraction plus modeste (10 %) et plutôt chez des étoiles de masse élevée. Clairement, les interactions dans les systèmes binaires ne sont pas encore complètement comprises. Nous n’avons donc pas fini d’entendre parler de Gamma Cas et de ses cousines !

Yaël Nazé ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

23.03.2026 à 15:39

Fusion nucléaire : un nouveau seuil dépassé dans le plus grand tokamak chinois

Texte intégral (1351 mots)

Le chemin vers la fusion thermonucléaire est long et semé d’embûches. Une des nombreuses étapes a récemment été franchie dans le plus grand tokamak chinois, EAST, où la limite de densité de plasma qui était observée jusque-là a été dépassée.

Dans un tokamak (un type de machine expérimentale conçue pour exploiter l'énergie de la fusion), le plasma est le milieu où se produisent les réactions de fusion nucléaire. Plus celui-ci est dense, plus les atomes se rencontrent et ont de chance de fusionner et de libérer de l’énergie. L’expérience récente a produit des densités de 30 % à 65 % plus élevées que celles normalement atteintes dans cette machine, sans déclencher les instabilités perturbatrices qui se produisent généralement lorsque la limite de densité du plasma est dépassée.

Cette étude, co-dirigée par Ping Zhu et Ning Yan, que j’ai contribuée à interpréter, a été publiée début janvier dans la revue Science Advances et reprise par la revue Nature. Un point particulièrement prometteur est que cette avancée a une base théorique, que j’avais développée et publiée avec d’autres collègues quatre ans auparavant. En confirmant plusieurs de ses prédictions, l’expérience soutient la théorie, ce qui ouvre la voie à d’autres améliorations.

Pourquoi cette avancée est importante

Le réchauffement climatique, la pollution de l’air, la géopolitique de l’énergie et le caractère intermittent des énergies renouvelables rendent urgent le développement de nouvelles centrales électriques à fonctionnement continu. Dans ce cadre, les atouts majeurs de la fusion thermonucléaire sont le fait que ses cendres et son combustible sont non radioactifs, ainsi que la vaste répartition mondiale de ce dernier et l’absence de risque d’accident nucléaire. Et c’est pourquoi, la communauté scientifique travaille depuis des décennies dans un esprit de collaboration à l’échelle mondiale (remarquablement, malgré la guerre en Ukraine, la Russie participe toujours au projet ITER).

Les recherches sur la fusion thermonucléaire contrôlée ont connu récemment une forte accélération grâce au projet de réacteur international de démonstration ITER – et aussi parce que davantage d’argent privé que public est investi dans ce type de recherche au niveau mondial depuis 2023.

Comme on l’a vu, une des contraintes ralentissant cette entreprise est l’existence d’une limite de densité du plasma dans les expériences réalisées jusqu’à présent : avec des densités de plasma trop faibles, les réactions nucléaires ont lieu trop peu souvent pour générer de l’énergie en quantité importante.

À cause de ce problème, les réacteurs tokamaks en projet sont gigantesques : ceci permet aux ions du plasma d’avoir plus de temps pour entrer en collision avant de s’échapper. ITER, par exemple, fait 23 000 tonnes pour 29 mètres de haut et 28 mètres de diamètre. Aussi, aujourd’hui, un des grands défis de la fusion thermonucléaire est de réaliser un réacteur plus petit, qui soit donc moins cher et plus robuste. Or, jusqu’à présent, nous étions coincés, car nous n’arrivions pas à dépasser expérimentalement une densité, apparemment limite, du plasma.

En 2021, mes collègues Fabio Sattin, Paolo Zanca et moi-même avions proposé une base théorique prédisant deux régimes d’auto-organisation plasma-paroi : le régime habituel où la densité de plasma est limitée et un autre régime sans limite de densité. Nous expliquions que ce régime pourrait être atteint en diminuant la quantité d’impuretés projetées par les parois, dues à leur bombardement par les ions du plasma. Nous suggérions à cette fin de démarrer le plasma en utilisant la stratégie utilisée pour le démarrage d’un autre type d’installation destinée à faire de la fusion thermonucléaire, les « stellarators ».

Cette stratégie a été appliquée avec succès dans EAST, où le régime sans limite de densité a été atteint, confirmant ainsi les résultats expérimentaux obtenus au sein du tokamak chinois J-TEXT annoncés en 2023 à la Fusion Energy Conference de l’AIEA à Londres (Royaume-uni).

Plus précisément, les expériences sur EAST ont combiné le contrôle de la pression initiale du gaz combustible avec un chauffage par résonance cyclotronique électronique pendant la phase de démarrage (ces deux facteurs combinés correspondent aux décharges stellarators), permettant une efficace diminution des interactions plasma-paroi dès le début de la décharge. Grâce à cette approche, l’accumulation d’impuretés et les pertes d’énergie ont été considérablement réduites, et le plasma atteint une densité élevée à la fin du démarrage. De plus, décharge après décharge, une diminution de la quantité d’impuretés a accompagné l’augmentation de la limite. Malheureusement, l’allocation maximale de temps expérimental n’a pas permis de voir jusqu’où pouvait aller cette nette amélioration… mais on peut donc espérer qu’elle se poursuive dans de futures expériences.

Quelles sont les suites de ces travaux ?

L’équipe de recherche d’EAST prévoit donc d’appliquer à nouveau cette méthode lors de la prochaine campagne expérimentale, avec l’idée d’accéder au régime sans limite de densité dans des conditions de plasma à haute performance.

Les physiciens travaillant sur d’autres tokamaks ont également été alertés, et pourraient être intéressés par l’utilisation du même scénario de démarrage pour repousser la limite de densité. Une proposition d’expérience a même déjà été faite pour le nouveau tokamak japonais JT60-SA.

Tout savoir en trois minutes sur des résultats récents de recherches, commentés et contextualisés par les chercheuses et les chercheurs qui les ont menées, c’est le principe de nos « Research Briefs ». Un format à retrouver ici.

Dominique Escande ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

22.03.2026 à 17:12

Des bactéries pour aller sur Mars

Texte intégral (2357 mots)

Aller sur Mars représente un voyage de plus de mille jours. Comment rendre autonome un équipage pendant autant de temps ? Découvrez le projet MELiSSA qui vise à recycler le carbone, l’hydrogène, l’oxygène et l’azote grâce aux bactéries en recréant le fonctionnement d’un écosystème terrestre à l’intérieur d’une fusée.

Les voyages habités vers la Planète rouge ne sont plus de la fiction. La Nasa prévoit même les premiers dans les années 2030, autrement dit demain. Pourtant, les défis techniques, scientifiques et humains à relever sont encore immenses avant de parcourir les 225 millions de kilomètres qui nous séparent de Mars, à l’aller comme au retour. L’équipage devra résister pendant des mois à l’effet des radiations, de la microgravité, du confinement, de l’isolement, etc., et à l’absence de biodiversité. C’est pourtant d’elle qu’il sera question ici pour régler un autre défi, celui de l’autonomie.

Des ressources pour un voyage au long cours

Dans l’espace, un homme ou une femme a besoin toutes les 24 heures d’un kilo de nourriture, d’un kilo d’oxygène, de trois litres d’eau potable et de 20 litres supplémentaires pour l’hygiène corporelle. De sorte qu’un voyage de mille jours aller-retour vers Mars obligerait à décoller avec 25 tonnes de ressources par personne.

En admettant que ce soit possible avec un des lanceurs super lourds qui emportent 130 à 150 tonnes, il faudrait ajouter la quantité de ressources quotidiennes nécessaire une fois sur Mars et pouvoir redécoller avec un emport suffisant pour le retour. L’autonomie de l’équipage sur le long terme est donc un vrai défi.

L’idée serait de tout produire et recycler en cours de route et sur place, de manière durable. Tel est l’objectif du projet MELiSSA pour l’alimentation. L’acronyme signifie système de support de vie micro-écologique alternatif, qui se base sur deux composantes de la biodiversité, les bactéries et l’écosystème. Ce dispositif bio-inspiré est développé par l’Agence Spatiale Européenne (ESA) et ses partenaires. Pour l’hygiène corporelle, le recyclage de l’eau fait partie d’un processus à part.

Des bactéries fonctionnant comme dans un écosystème terrestre

Le préfixe « éco » du terme écosystème provient du grec ancien Oikos qui se traduit par la métaphore de la maison et ses habitant·es. Mais une maison a besoin de lumière, de CO2 et d’eau pour créer un phénomène crucial pour la vie sur Terre, la photosynthèse oxygénique.

À partir de lumière, de CO2 et d’eau, les cyanobactéries, c’est-à-dire les bactéries photosynthétiques, les algues et les plantes se mettent à fabriquer des molécules carbonées (sucres et lipides), en libérant de l’oxygène. Ce sont les producteurs primaires à la base des principaux écosystèmes, de la pyramide des consommateurs et des réseaux trophiques. Ce type de réseau se définit comme l’ensemble des interactions alimentaires. Mais les producteurs primaires ont besoin de minéraux. Une partie provient de la décomposition de la matière organique et des excréments assurée par les bactéries et les champignons.

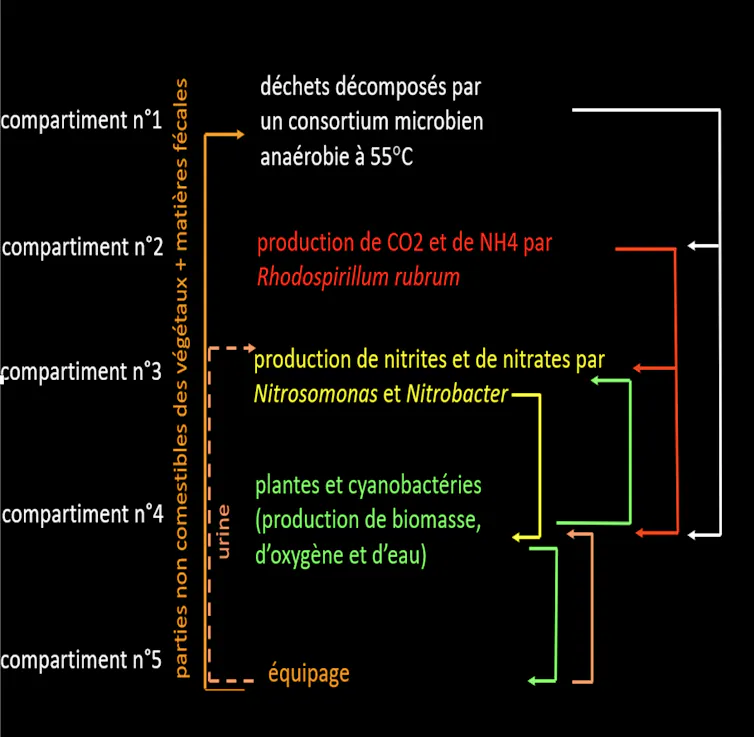

C’est ce fonctionnement circulaire dans le milieu terrestre qui a inspiré les scientifiques du projet MELiSSA en le simplifiant pour mieux le contrôler. Le dispositif est ingénieux et comporte cinq compartiments interconnectés. L’objectif est de produire les ressources nécessaires à l’équipage par des plantes cultivées en hydroponie, ou culture hors sol, et des cyanobactéries, puis décomposer les déchets par des consortiums bactériens artificiels.

Les déchets sont un mélange d’au moins 70 % de végétaux non consommés et d’un maximum de 30 % d’excréments. La décomposition se fait en absence d’oxygène et à 55 °C par un consortium dominé par les bacilles Thermocaproicibacter et Thermoanaerobacterium. Dans ce four, les bactéries thermophiles atteignent leur optimum de croissance, tandis que les pathogènes opportunistes meurent, ce qui fait partie aussi de l’objectif. La décomposition libère des acides gras volatiles, du CO2, de l’ammoniac et de l’hydrogène qui vont alimenter les autres compartiments.

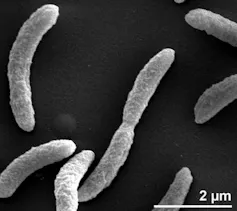

Les acides gras sont transférés dans le compartiment n°2 contenant une seule espèce de bactéries, Rhodospirillum rubrum. La majorité des cellules sont spiralées et possèdent sept flagelles à chaque pôle. Certaines peuvent atteindre entre 10 et 60 µm de long dans certains milieux. Ces bactéries, de couleur rose en absence d’oxygène, sont multitâches, capables de faire la photosynthèse mais sans produire d’oxygène, de fixer l’azote et de libérer de l’ammoniac. Ce n’est pourtant pas ces caractéristiques qui intéressent MELiSSA, mais leur capacité à pousser plus loin la conversion des acides gras en CO2. Celui-ci passe alors directement dans le compartiment n°4 pour entretenir la photosynthèse par les plantes et par les cyanobactéries.

Le compartiment suivant, n°3, contient deux autres espèces de bactéries, typiques d’une étape fondamentale du cycle de l’azote, la nitrification. Il s’agit de réactions chimiques en chaîne très complexes. Tout commence par les bactéries appartenant au genre Nitrosomonas qui fixent des atomes d’oxygène à l’ammonium en produisant des nitrites ou NO2. L’oxygène nécessaire émane du compartiment n°4 tandis que l’ammoniac provient principalement de l’urine de l’équipage. Les nitrites sont ensuite oxydés à leur tour par les bactéries du genre Nitrobacter en nitrates ou NO3. Les nitrates passent alors dans le compartiment n°4 comme source d’azote pour les plantes et les cyanobactéries.

Un dispositif de production et de recyclage en constante amélioration

La biomasse produite, mais aussi l’oxygène et l’eau sont consommés par l’équipage dans le compartiment n°5. Les déchets vont dans le compartiment n°1, le CO2 dans le n°4, et le cycle recommence. Tous les éléments, à savoir le carbone, l’hydrogène, l’oxygène et l’azote, sont recyclés.

Mais ce dispositif est sans cesse en développement pour être optimal. Par exemple les scientifiques de MELiSSA essaient de remplacer R. rubrum par des biopiles où un consortium bactérien contenant le genre Geobacter est associé à l’anode, l’une des deux électrodes, pour convertir les acides gras en CO2 en créant un courant électrique. Sur le plan énergétique, celui-ci est encore marginal, certes.

Les scientifiques testent par ailleurs des plantes, comme la laitue, la tomate, le chou ou le riz et un genre de cyanobactérie, Limnospira connu sous le nom de spiruline. Si les cyanobactéries représentent aujourd’hui seulement 30 % de la biomasse, leur contribution est appelée à croître, car leur système photosynthétique leur donne la capacité de réagir de manière quasi instantanée au changement de flux lumineux. Par ailleurs, la spiruline est très riche en protéines et contient des vitamines et des acides gras de type oméga 6.

Le projet MELiSSA montre que la connaissance des bactéries et la compréhension du fonctionnement des écosystèmes terrestres sont une des clés pour rendre possible l’autonomie alimentaire des vols habités vers la planète Mars. Mais l’autonomie ne sera pas atteinte d’ici les années 2030, ni même le recyclage global de l'eau. A priori, il en serait de même côté américain pour la Nasa, et la question reste posée pour les approches russes et chinoises. Quoi qu’il en soit, l’idée de l’ESA est aussi de valoriser plus rapidement le dispositif sur Terre pour contribuer au développement de l’économie circulaire.

Retrouvez notre vidéo basée sur cet article

Ce texte n’aurait pas été possible sans la relecture de Chloé Audas, directrice du projet MELiSSA, Brigitte Lamaze, ingénieure à l’ESA, et Claude-Gilles Dussap, directeur de la Fondation MELiSSA. L’auteur les remercie vivement.

Laurent Palka est membre du CESCO, Centre d'Ecologie et des Sciences de la Conservation et de l'association Chercheurs Toujours.

20.03.2026 à 15:15

Des centaines d’insectes affamés, un étudiant et une combinaison en mesh… Comment une série d’expériences aide à comprendre le vol des moustiques

Texte intégral (3440 mots)

Derrière chaque piqûre se cache une mécanique précise : en suivant des moustiques à la trace, une équipe de chercheurs a mis au jour les lois qui gouvernent leur comportement.

« Quatre minutes, c’est trop long ».

Voici le message que m’a envoyé Chris Zuo, étudiant de premier cycle, accompagné de photos montrant d’innombrables piqûres de moustiques sur sa peau nue. Ce massacre sur l’ensemble du corps n’était pas le résultat d’un camping qui aurait mal tourné. Il avait passé ce laps de temps limité dans une pièce contenant 100 moustiques affamés, vêtu uniquement d’une combinaison en mesh que nous pensions capable de le protéger.

C’est ainsi qu’a débuté notre enquête de trois ans pour comprendre le comportement d’un insecte d’une simplicité trompeuse : le moustique. Cela peut ressembler au plan sadique d’un professeur, mais en réalité, nous avons respecté toutes les procédures. Le comité d’éthique de notre université a approuvé le protocole, en s’assurant que Chris était en sécurité et qu’il n’était soumis à aucune pression. Les moustiques étaient exempts de maladies et provenaient de notre État, la Géorgie. Et cette séance a donné lieu aux premières — et dernières — piqûres reçues par qui que ce soit dans le cadre de l’étude.

En plus de mon rôle de tortionnaire pour étudiants, je suis auteur et professeur à Georgia Tech, avec plus de 20 ans d’expérience dans l’étude des déplacements des animaux.

Les moustiques sont l’animal le plus dangereux au monde. Les maladies qu’ils transmettent, du paludisme à la dengue, provoquent plus de 700 000 décès par an. Les moustiques ont causé plus de morts que les guerres.

Le monde dépense 19 milliards d’euros par an en milliards de litres d’insecticides, en millions de kilos de larvicides et en millions de moustiquaires imprégnées d’insecticide – le tout pour lutter contre un insecte minuscule qui pèse dix fois moins qu’un grain de riz et ne possède que 200 000 neurones.

Et pourtant, les humains sont en train de perdre la guerre contre les moustiques. Ces insectes évoluent pour prospérer en milieu urbain et propagent les maladies plus rapidement avec le changement climatique. Comment des animaux aussi simples peuvent-ils nous repérer avec une telle facilité ?

Les scientifiques savent que les moustiques ont une très mauvaise vue et qu’ils dépendent de signaux chimiques pour compenser. Mais savoir ce qui attire un moustique ne suffit pas à prédire son comportement. On peut savoir qu’un missile à guidage thermique est attiré par la chaleur sans pour autant comprendre comment il fonctionne.

C’est là qu’intervient Chris et son sacrifice dans la pièce infestée de moustiques. En suivant les trajectoires de nombreux moustiques autour de lui, nous espérions déterminer comment ils adaptent leurs décisions à sa présence. Comprendre la manière dont les moustiques réagissent aux humains constitue une première étape pour mieux les contrôler.

Comment les moustiques repèrent leur repas

Sur les 3 500 espèces de moustiques, plus de 100 sont dites anthropophiles, c’est-à-dire qu’elles préfèrent les humains comme source de nourriture. Certaines espèces sont capables de repérer une seule personne au milieu d’un troupeau entier de bovins pour aller lui sucer le sang.

C’est une prouesse, étant donné que les moustiques ne volent pas bien. Ils cessent de voler dès qu’il y a une légère brise de 3 à 5 km/h, soit une vitesse d’air comparable à celle générée par le balancement de la queue d’un cheval. Dans des conditions plus calmes, les moustiques utilisent leur cerveau minuscule pour suivre la chaleur, l’humidité et les odeurs humaines transportées par le vent.

Le dioxyde de carbone, sous-produit de la respiration de tous les êtres vivants, est particulièrement attractif. Les moustiques le détectent aussi facilement que vous percevez l’odeur d’une benne à ordures pleine, jusqu’à environ 9 mètres de leur hôte, là où les concentrations chutent à quelques parties par million, soit l’équivalent de quelques tasses de colorant dans une piscine olympique.

La vision des moustiques ne leur est pas très utile pour partir à la recherche de leur prochain repas. Leurs deux yeux comptent plusieurs centaines de petites lentilles individuelles appelées ommatidies, chacune large comme un cheveu humain. Elles produisent une image en mosaïque, légèrement floue, comme pixelisée. En raison des lois de l’optique, les moustiques ne peuvent distinguer un humain adulte qu’à quelques mètres de distance. Avec la seule vue, ils sont incapables de différencier un humain d’un petit arbre. Ils examinent donc chaque objet sombre.

Collecter des données sur les trajectoires de vol

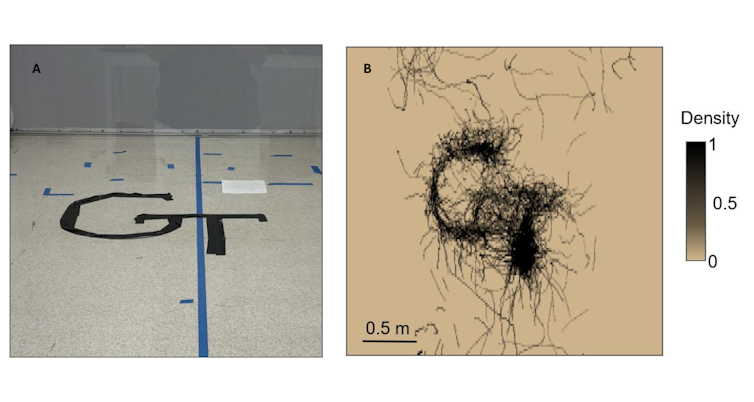

La difficulté lorsqu’on étudie le vol des moustiques, c’est que, comme des enfants surexcités, la plupart de leurs mouvements n'ont pas vraiment de sens. Dans une pièce vide, les moustiques modifient très souvent leur vitesse et leur direction de façon complètement aléatoire. Il nous fallait donc de nombreuses trajectoires de vol pour faire émerger un signal au milieu de ce bruit.

L’un de nos collaborateurs, le biologiste de l’université de Californie à Riverside Ring Cardé, nous a expliqué que dans les années 1980, les scientifiques menaient des « études de piqûres » en se mettant en sous-vêtements et en écrasant les moustiques qui se posaient sur leur peau nue. Selon lui, la nudité permettait d’éviter des variables parasites, comme la couleur du tissu d’une chemise.

Chris et moi nous sommes regardés. S’asseoir nu et attendre de servir de proie aux moustiques ? Non… Nous avons plutôt conçu la combinaison en mesh que Chris portait initialement dans la pièce infestée. Mais après avoir vu ses piqûres, il nous fallait une meilleure solution.

À la place, Chris a choisi des vêtements à manches longues, qu'il a lavés avec une lessive sans parfum, et a enfilé gants et masque. Entièrement protégé, il n’avait plus qu’à rester debout et attendre, tandis qu’un nuage de moustiques tourbillonnait autour de lui.

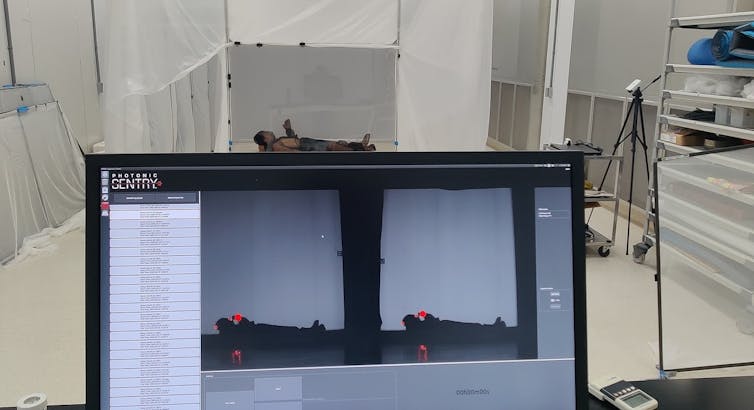

Les Centers for Disease Control and Prevention (CDC) des États-Unis nous ont fait découvrir le Photonic Sentry, une caméra capable de suivre simultanément des centaines d’insectes en vol dans une pièce. Elle enregistre 100 images par seconde avec une résolution de 5 mm, dans un espace de la taille d’un grand studio. En seulement quelques heures, Chris et un autre doctorant, Soohwan Kim, ont produit plus de données sur le vol des moustiques que tout ce qui avait été mesuré auparavant dans l’histoire humaine.

Pour les mathématiciens, comme nos collaborateurs Jörn Dunkel, Chenyi Fei et Alex Cohen du MIT, la géométrie du corps de Chris reste trop complexe pour étudier les réactions des moustiques. Les mathématiciens excellent dans l’art de ramener les problèmes complexes à leur essence. Chenyi a donc suggéré d’épargner Chris : pourquoi ne pas le remplacer par un simple mannequin, une boule noire en polystyrène fixée sur un support, associée à une source de dioxyde de carbone ?

Au cours des deux années suivantes, Chris a filmé sans relâche les moustiques tournoyant autour de ces mannequins en polystyrène. Puis il les aspirait à l’aide d’un aspirateur, en essayant de ne pas se faire piquer.

Décrypter les trajectoires

Un moustique vole comme on pilote un avion : il tourne à gauche ou à droite, accélère ou freine. Nous avons d’abord caractérisé son comportement de vol en fonction de sa vitesse, de sa position et de sa direction par rapport à la cible, première étape pour construire notre modèle.

Notre confiance dans ces règles de comportement s’est renforcée à mesure que nous analysions davantage de trajectoires, jusqu’à exploiter 20 millions de données concernant les positions et les vitesses des moustiques. Cette idée consistant à intégrer des observations pour étayer une hypothèse mathématique remonte à 200 ans et porte le nom d’inférence bayésienne. Nous avons ensuite illustré le comportement des moustiques observé à l’aide d’une application web.

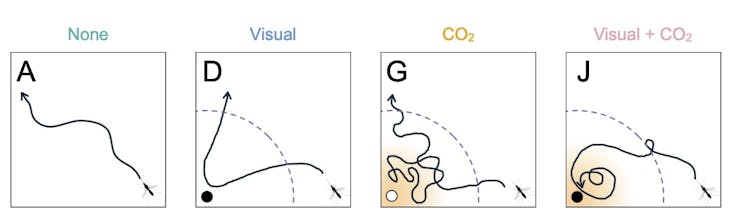

Grâce à notre modèle, nous avons montré que différents types de cibles modifient le vol des moustiques. Les cibles visuelles provoquent des survols, où les moustiques passent à proximité avant de continuer leur route. Le dioxyde de carbone entraîne des hésitations, les moustiques ralentissant à proximité de la cible. La combinaison d’un signal visuel et de dioxyde de carbone génère des trajectoires orbitales à grande vitesse.

Jusqu’à présent, nous avions uniquement utilisé des expériences avec des sphères en polystyrène pour entraîner notre modèle. Le véritable test consistait à voir s’il pouvait prédire le vol des moustiques autour d’un humain. Chris est retourné dans la chambre, cette fois vêtu de blanc et coiffé d’un chapeau noir, se transformant en véritable cible. Notre modèle a correctement prédit la répartition des moustiques autour de lui. Nous avons ainsi identifié des zones à risque, où la probabilité de voir des moustiques tournoyer autour de lui était élevée.

Prédire le comportement des moustiques constitue une première étape pour les déjouer. Dans les zones infestées, on conçoit par exemple des maisons dotées de dispositifs empêchant les moustiques de suivre les signaux humains et d’entrer. De même, les pièges à moustiques aspirent les insectes lorsqu’ils s’approchent trop près, mais laissent encore s’échapper entre 50 % et 90 % d’entre eux. Beaucoup de ces dispositifs reposent encore sur des essais empiriques. Nous espérons que notre étude fournira un outil plus précis pour concevoir des méthodes de capture ou de dissuasion.

Lorsque la mère de Chris a assisté à sa soutenance de master, je lui ai demandé ce qu’elle pensait du fait que son fils se soit proposé comme appât pour les moustiques. Elle m’a répondu qu’elle en était très fière. Moi aussi — et pas seulement parce que je suis soulagé que Chris ne m’ait jamais demandé de prendre sa place dans la chambre infestée de moustiques.

David Hu ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

18.03.2026 à 11:32

Pêche récréative et pollution plastique : créer des leurres souples qui disparaissent vraiment

Texte intégral (2415 mots)

Chaque année, des millions de pêcheurs perdent (sans le vouloir) une partie de leur matériel dans l’eau. Parmi les objets les plus souvent « abandonnés » : les leurres souples, petits bouts de plastique très efficaces… mais très persistants.

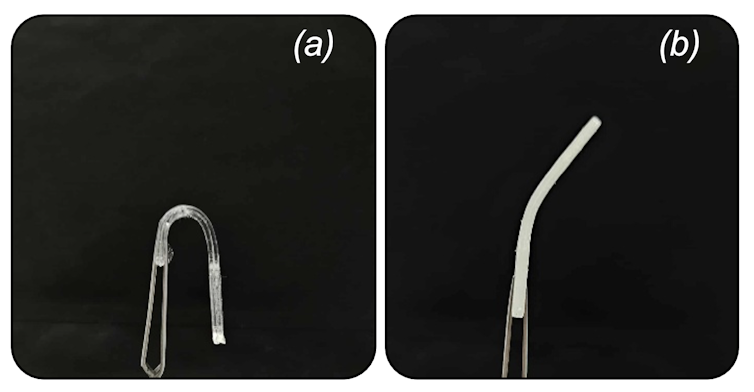

Mon travail de thèse, mené en collaboration avec l’entreprise FiiiSH, a consisté à développer des formulations à base de PHA capables de réduire la persistance des leurres souples dans l’environnement. La solution la plus prometteuse identifiée à ce jour n’est pas encore assez souple pour un usage pleinement satisfaisant, mais elle montre déjà de forts signes de biodégradation et de non-toxicité. Il reste donc du travail pour atteindre le bon compromis mécanique, mais la piste est sérieuse.

Une pratique massive et des pertes invisibles

La pêche de loisir est un loisir très répandu en France, en mer comme en eau douce. Les estimations institutionnelles évoquent environ 3,8 millions de pratiquants en mer en 2024, et plusieurs millions de cartes de pêche sont délivrées chaque année en eau douce. À cette échelle, même si la grande majorité des pêcheurs adopte de bonnes pratiques, une part de pertes reste inévitable : accrochage sur roches, branches, épaves, casse de ligne, courant, houle… À force de répétitions, un « petit » objet perdu involontairement devient un flux collectif.

Un leurre souple doit « vivre » dans l’eau. Sa nage dépend de sa forme, mais aussi de sa viscoélasticité : trop rigide, il nage mal ; trop mou, il se déchire ; instable, il durcit ou devient poisseux avec le temps. En bref, le matériau doit être à la fois flexible, résistant, stable au stockage et transformable industriellement. C’est un cahier des charges très strict et complexe pour un matériau.

La pollution liée à la pêche est multiple : emballages, fils, plombs, mais aussi fragments de leurres. Un leurre souple ne pèse que quelques grammes : pris isolément, l’impact paraît négligeable. Mais dans des zones très fréquentées (digues, estuaires, embouchures, postes en rivière…), les pertes se concentrent et s’additionnent. On estime qu’un pêcheur perd en moyenne 10 leurres par an, pour environ 15 g par leurre, ce qui donne un ordre de grandeur de cette pollution plastique. Ces chiffres restent toutefois à prendre avec précaution, car ils sont difficiles à mesurer précisément. Avec le temps, les plastiques conventionnels peuvent s’abîmer sous l’effet des UV, de l’abrasion et des contraintes mécaniques, et générer des fragments plus petits : les microplastiques. Dans certains cas, des composés peuvent aussi migrer depuis l’objet en plastique vers l’eau. L’enjeu n’est donc pas seulement esthétique : il touche à la persistance des débris et à leur interaction avec les écosystèmes.

Les PHA : des plastiques produits par des bactéries

Les polyhydroxyalcanoates (PHA) sont une famille de polyesters que certaines bactéries fabriquent naturellement comme réserve de carbone et d’énergie. Industriellement, on retrouve une logique de fermentation : on nourrit des microorganismes avec une source de carbone (par exemple, sucres, huiles), on pilote les conditions pour favoriser l’accumulation de PHA dans les cellules, puis on récupère la biomasse et on extrait/purifie le polymère. On obtient alors une « résine » utilisable en plasturgie, sous forme de granulés. Les PHA sont donc bien des plastiques à part entière. En revanche, dans leur état initial, leurs propriétés sont souvent trop rigides pour des applications comme les leurres souples de pêche, ce qui impose d’ajouter des additifs, notamment des plastifiants, afin d’assouplir la matière.

L’intérêt des PHA est double. D’une part, ils peuvent être biosourcés (selon le procédé et les substrats). D’autre part, leur structure de polyester est favorable à la biodégradation dans certains milieux. Mais ce « peut être biodégradable » est important : tout dépend des conditions et de la formulation finale.

Un plastique biodégradable ne disparaît pas comme un comprimé effervescent. Il ne fond pas au contact de l’eau. La biodégradation est un processus biologique : des microorganismes, via des enzymes, transforment progressivement le matériau en produits simples (CO2, eau, sels minéraux et biomasse en conditions aérobies).

La clé, c’est la conversion finale : un matériau qui ne fait que se fragmenter plus vite peut produire des microplastiques sans réellement être biodégradé. Autre point essentiel : « biodégradable » n’est pas synonyme de « biosourcé ». Un matériau peut être biosourcé sans être biodégradable, et l’inverse. Pour éviter le greenwashing, il faut toujours préciser le milieu (sol, compost, eau douce, mer), la méthode de mesure et l’ordre de grandeur du temps de l’essai dans lequel l’échantillon se dégrade.

Comment transformer un PHA en leurre ?

Le défi est d’obtenir une matière suffisamment souple. Beaucoup de PHA sont naturellement plutôt rigides. Pour approcher la sensation d’un leurre conventionnel, on peut jouer sur la chimie du copolymère, mais aussi sur la formulation : plastifiants compatibles, mélanges, ou architectures internes qui stabilisent la souplesse.

C’est ici que mon travail de recherche s’inscrit, dans le cadre d’une collaboration avec l’entreprise FiiiSH : développer des formulations PHA adaptées à la pêche au leurre souple, en intégrant dès le départ les contraintes industrielles (mise en forme, reproductibilité, stabilité au stockage) et les exigences environnementales. Aujourd’hui, ces travaux ont déjà permis d’identifier plusieurs formulations prometteuses et de les évaluer à l’échelle laboratoire à travers des essais de caractérisation thermique, mécanique et rhéologique (la rhéologie est l’étude de la déformation et de l’écoulement de la matière sous l’effet d’une contrainte appliquée). L’enjeu est désormais de confirmer leur robustesse, leur stabilité dans le temps et leur pertinence pour un usage réaliste en leurre souple.

Même avec un PHA prometteur, tout se joue souvent dans sa plastification. Obtenir un matériau souple ne suffit pas : il faut une souplesse stable et une bonne tenue mécanique. Or la compatibilité entre un PHA et un plastifiant est délicate : un plastifiant non miscible peut provoquer des hétérogénéités qui induisent une déchirure plus facile et une tenue mécanique qui chute. À l’inverse, un plastifiant trop compatible avec la résine peut « trop bien » s’y intégrer : il assouplit tellement le polymère qu’il relâche une partie du réseau d’enchevêtrements, et on obtient alors un matériau certes mou, mais très sensible à la déchirure. Pour se représenter la structure d’un plastique, on peut imaginer un plat de spaghettis bien emmêlés : les « nœuds » formés par les fils de pâte correspondent aux enchevêtrements, ces points d’accroche qui donnent au matériau sa cohésion.

Un petit objet mais une grande preuve à apporter

Rendre un leurre souple biodégradable ne consiste pas à « changer de plastique » dans une fiche technique. C’est un compromis délicat entre performance, stabilité et preuve environnementale. Les PHA offrent une piste crédible, à condition de rester rigoureux sur les mots (« biodégradable » n’est ni « soluble » ni « effervescent ») et sur les mesures. La suite se joue autant en laboratoire qu’en industrie : formulation, mise à l’échelle, transparence sur les compositions et validation dans des scénarios réalistes.

Si cette transition réussit sur un objet aussi exigeant qu’un leurre souple, elle pourrait inspirer d’autres produits exposés à la nature, où l’on ne peut pas éliminer totalement les pertes mais où l’on peut réduire, concrètement, la persistance.

À ce stade, un premier prototype de leurre a déjà vu le jour. Il reste désormais à l’éprouver en conditions réelles de pêche pour juger de sa performance sur le terrain. La solution n’est pas encore totalement aboutie, notamment parce qu’elle doit encore gagner en souplesse, mais elle n’est plus seulement une idée de laboratoire : elle commence déjà à prendre la forme d’un leurre.

Erwan Vasseur a reçu des financements de l'entreprise Fiiish et IRDL (Institut de Recherche Dupuy De Lôme).

18.03.2026 à 09:58

La théorie des cordes a-t-elle été découverte par accident ?

Texte intégral (1709 mots)

Une plongée dans l’histoire de la théorie des cordes, ou quand une solution suggérée pour un problème donné éclaira en réalité un domaine bien plus vaste.

La physique théorique a connu trois grandes révolutions au tournant du XXᵉ siècle : la mécanique quantique et les deux théories de la relativité, restreinte et généralisée. La mécanique quantique décrit l’infiniment petit. La relativité restreinte et sa célèbre formule E = mc² décrivent la physique des objets se déplaçant aux vitesses proches de la lumière. La relativité générale décrit la force de gravité comme provenant de la courbure de l’espace-temps.

Prises ensemble, elles ont bouleversé notre compréhension de l’espace-temps, de la matière, et des interactions fondamentales. Les implications de ce bouleversement ne sont encore aujourd’hui pas totalement comprises.

En effet, on ne sait pas utiliser ce cadre pour décrire certaines situations extrêmes, comme l’espace-temps à l’intérieur des trous noirs, ou au moment du Big Bang – deux situations où les effets quantiques et gravitationnels sont simultanément importants. C’est dans cet entrelacs que réside le mystère central de la « gravité quantique », que la physique moderne cherche à élucider, et pour lequel la théorie des cordes propose un cadre qui unifie relativité générale et physique quantique.

Du point de vue de l’histoire des sciences, un élément remarquable de cette théorie sophistiquée est qu’elle a, en fait, été découverte par hasard, au sein d’un domaine bien différent de la gravité quantique : celui de la physique des particules subatomiques !

Gabriele Veneziano et les particules subatomiques

Genève, fin des années 1960. Gabriele Veneziano a 26 ans, il vient de finir son doctorat de physique nucléaire en Israël et se trouve en visite au CERN. À l’époque, les physiciens théoriciens du monde entier se heurtaient à un problème coriace : la méthode qui avait permis de comprendre les interactions entre électrons et lumière (qu’on appelle aujourd’hui la théorie quantique des champs) semblait ne pas fonctionner pour décrire les interactions entre les autres particules subatomiques.

En particulier, on ne comprenait pas l’interaction nucléaire forte, qui régit les interactions entre les briques élémentaires de la matière : protons, neutrons, etc. Celles-ci forment un véritable zoo de particules qu’on nomme les hadrons.

Une nouvelle approche est alors explorée : le « bootstrap ». Ne pouvant trouver la bonne théorie pour décrire les hadrons individuellement, les physiciens se posèrent la question dans l’autre sens : quelles sont les propriétés générales que doit satisfaire n’importe quelle théorie ? La réponse : au minimum, elle doit satisfaire simultanément aux exigences de la mécanique quantique et de la relativité restreinte.

Cette approche par exemple permet de montrer qu’une interaction fondamentale ne peut excéder une certaine intensité sans briser les lois de la mécanique quantique (un peu comme il existe une vitesse maximale en relativité). En clair : si l’on mélange les lois de la mécanique quantique et celles de la relativité restreinte, tout n’est pas permis, et les lois physiques possibles deviennent fortement contraintes.

C’est dans ce cadre que Gabriele Veneziano proposa en 1968 une fonction mathématique très particulière – la fonction bêta d’Euler – pour modéliser les hadrons et leurs interactions. À ce moment, on ne connaissait pas la théorie qui permettrait d’expliquer d’où sort cette formule : on savait seulement qu’elle satisfaisait, pour la première fois, toutes les propriétés mathématiques recherchées. Son papier eut un succès immédiat, car la formule répondait à de nombreuses questions en même temps.

Sérendipité et théorie des cordes

La sérendipité est souvent idéalisée comme un heureux hasard. Mais, en science, elle prend une forme plus subtile : elle naît de l’interaction entre un contexte de recherche fertile et une capacité à reconnaître qu’une solution trouvée pour un problème donné éclaire en réalité un domaine bien plus vaste.

Le cas de la formule de Veneziano est emblématique. Quelques années après l’article de Veneziano, les physiciens Leonard Susskind, Yoichiro Nambu et Holger Bech Nielsen comprirent (indépendamment) que cette formule décrivait en fait non pas des hadrons mais des « cordes quantiques », c’est-à-dire des objets microscopiques filiformes, qui vibrent à la manière de minuscules cordes de violon.

Et c’est là que ça devient vraiment intéressant.

Les cordes et le… graviton ?

Depuis les années 1970, à mesure que l’on explore cette interprétation, d’autres indices troublants apparaissent. La théorie semble invariablement contenir une particule particulière : le graviton, censé véhiculer la force de gravitation quantique. De plus, elle exige l’existence de dimensions d’espace supplémentaires – un prix qui semble alors trop élevé pour une théorie censée décrire les hadrons !

Et surtout, comment une théorie inventée pour décrire les interactions de la matière à l’intérieur du noyau atomique pouvait-elle contenir une théorie qui décrit tout autre chose – la gravité quantique ?

Comme, à la même époque (autour de 1973), la théorie quantique des champs finit par expliquer les interactions fortes grâce à la découverte de la chromodynamique quantique, et notamment de la liberté asymptotique, le modèle de Veneziano est laissé de côté dans ce contexte.

Mais quelques physiciens visionnaires, comme Joël Scherk et John Schwarz, pressentirent que cette théorie, à cause de son mystérieux graviton, possédait un potentiel unique pour s’attaquer à la gravité quantique.

Dix ans plus tard, en 1984, Michael Green et John Schwarz confirmèrent cette intuition et démontrèrent que la théorie des cordes est bel et bien une véritable théorie de gravité quantique.

On voit donc que la découverte de la théorie des cordes est l’illustration même de la sérendipité : une théorie née d’un certain questionnement éclaire le cœur d’un aspect tout autre de la science.

Gabriele Veneziano lui aussi contribuera notablement au développement de la théorie des cordes, notamment en étudiant les liens entre celle-ci et la structure microscopique de l’espace-temps.

La théorie de cordes aujourd’hui

Aujourd’hui, la théorie des cordes est bien plus qu’une simple théorie candidate de la gravité quantique. Aux côtés de la théorie quantique des champs, elle constitue un cadre conceptuel et mathématique d’une richesse inégalée, capable d’unifier des idées venues de la physique des particules, de la relativité, de la théorie des champs, du chaos et des mathématiques pures et produire des avancées conceptuelles et techniques dans ces domaines.

Par exemple, le modèle de Veneziano et ses généralisations, dont on sait aujourd’hui qu’ils proviennent de la théorie des cordes, exhibent des propriétés mathématiques remarquables liées à la fonction zêta de Riemann. Ces propriétés s’expliquent physiquement par la façon dont deux cordes ouvertes s’attachent pour former une corde fermée.

Plus encore, le programme du « bootstrap », qui avait donné naissance à la théorie des cordes, connaît aujourd’hui une nouvelle vie : grâce à la puissance des ordinateurs modernes et à des idées venues de la théorie des cordes et de la théorie des champs, les physiciens appliquent ces idées pour décrire des phénomènes très divers, allant des transitions de phase à la physique hadronique et même à la gravité quantique.

Mais il reste un mystère fondamental : pourquoi cette théorie, née « par hasard », semble-t-elle si naturellement adaptée à décrire la gravité quantique ? Était-ce vraiment un hasard… ou un indice que la seule façon d’unifier les trois théories qui forment le socle de la physique du XXᵉ siècle est la théorie des cordes ? On pourrait bien avoir une réponse à cette question mathématique dans les années qui viennent.

Piotr Tourkine a reçu des financements de l'Agence Nationale de la Recherche (ANR-22-CE31-0017).

17.03.2026 à 16:33

Yellowstone, merveille géologique : aux frontières du feu, de l’eau et du vivant

Texte intégral (2941 mots)

Le parc national de Yellowstone, aux États-Unis, présente l’un des spectacles géologiques les plus fascinants au monde : geysers en éruption, bassins aux couleurs intenses, terrasses de travertin sculptées par des eaux thermales. Derrière ces paysages se dissimule l’un des systèmes volcaniques les plus actifs de la planète, dont la chaleur souterraine façonne chaque fontaine, chaque couleur, chaque dépôt minéral, et rappelle que la Terre est une planète vivante.

Le parc national de Yellowstone est le plus ancien parc national du monde et est situé dans l’ouest des États-Unis, entre le Wyoming, le Montana et l’Idaho. Inscrit sur la liste du patrimoine mondial de l’Unesco, il est célèbre pour sa faune et ses paysages, mais surtout pour une activité géothermique exceptionnelle, unique par son intensité et sa diversité.

Le parc se situe sur une large caldeira volcanique (c’est-à-dire une vaste dépression circulaire formée par l’effondrement du toit d’une chambre magmatique après une éruption), formée par plusieurs éruptions majeures qui se sont produites il y a 2,1 millions, 1,3 million et environ 640 000 ans. Même en l’absence d’éruptions explosives actuellement, le volcan reste actif : son activité se traduit par une augmentation de température en profondeur et une série de phénomènes hydrothermaux observables en surface.

Une chaudière souterraine toujours en activité