13.04.2026 à 16:45

Comprendre les « modèles de fondation », ces nouvelles infrastructures numériques à la base de nombreuses applications d’IA

Texte intégral (2606 mots)

La polyvalence des modèles de fondation les transforme en une nouvelle « infrastructure » numérique, au même titre que le cloud ou Internet. Au lieu de reconstruire un modèle d’IA spécifique à chaque projet, on peut se brancher directement sur des briques généralistes existantes. C’est un des secrets qui permet de développer des applications si sophistiquées et qui restent accessibles aux non-spécialistes.

Les systèmes d’apprentissage automatique ne se limitent plus à des outils conçus pour une seule tâche, comme la traduction ou la recommandation de produits. Une transformation majeure tient à l’émergence des foundation models, ou modèles de fondation : de très grands modèles entraînés sur des volumes massifs de données pour acquérir des connaissances générales, réutilisables dans de nombreux contextes.

Dans les organisations, ils agissent comme un accélérateur potentiel de transformation, mais leurs effets sur le terrain obligent, pour l’instant, à nuancer les promesses spectaculaires. Comment fonctionnent-ils ? Comment sont-ils régulés et quels sont les obstacles à une adoption qui porte ses fruits ?

Comment fonctionnent les modèles de fondation ?

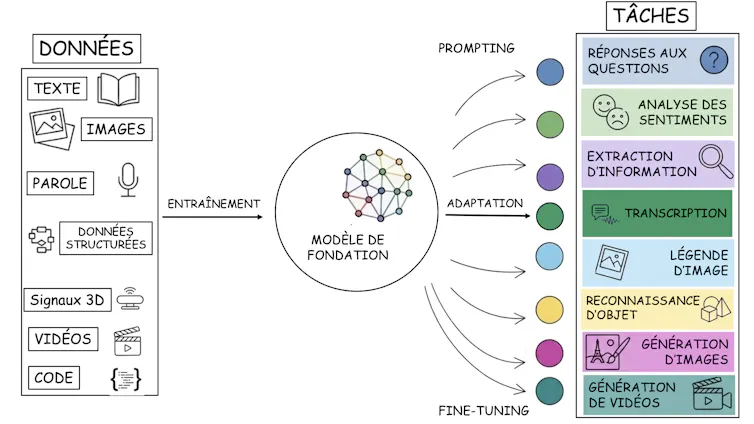

Les modèles de fondation reposent sur un principe simple : apprendre des structures générales à partir de très grandes quantités de données hétérogènes – textes, images, codes, sons, vidéos, bases de données ouvertes et contenus sous licence, ou une combinaison de ces types de données.

L’objectif de l’entraînement initial est de permettre au modèle d’identifier des régularités statistiques dans les données et de construire des représentations générales du langage, des images ou d’autres formes d’information. Sur le plan technique, ces systèmes utilisent le plus souvent des architectures de réseaux de neurones profonds. Durant la phase d’entraînement, le modèle apprend à prédire une partie manquante de l’information, par exemple le mot suivant dans une phrase ou une portion d’image, en ajustant progressivement des milliards de paramètres. Ce processus d’apprentissage, appelé pré-entraînement, nécessite des ressources de calcul considérables et constitue la base du caractère « généraliste » de ces modèles.

Une fois pré-entraîné, le modèle de fondation peut être adapté à des usages spécifiques, allant de l’analyse de sentiment ou la réponse à des questions jusqu’à des tâches plus techniques, comme l’assistance au diagnostic médical.

Cette adaptation peut se faire grâce à un ajustement supplémentaire appelé fine-tuning, par exemple en nourrissant un modèle généraliste d’imagerie médicale avec des radiographies spécifiques à une maladie permettant à l’outil d’apprendre à prédire l’évolution d’une pathologie précise.

Elle peut aussi passer par l’apprentissage avec retour humain (reinforcement learning with human feedback), qui consiste à faire évaluer plusieurs réponses par des humains pour inciter le modèle à privilégier des formulations claires et sécurisées plutôt que de simples suites de mots statistiques.

Enfin, cette adaptation peut s’opérer simplement par prompting, en guidant le modèle par des instructions textuelles du type : « Résume ce document en trois points. »

C’est cette capacité à être réutilisés dans de nombreux contextes qui explique pourquoi ces systèmes sont qualifiés de « modèles de fondation » : ils servent de base technologique à une large gamme d’applications. Par exemple, GPT-4 ou GPT-5 servent déjà de socle opérationnel à de nombreuses applications, à l’image de ChatGPT, tout en conservant un potentiel d’extension encore largement ouvert.

Comprendre l’écosystème : comment modèles de fondation, LLM et IA générative s’articulent-ils ?

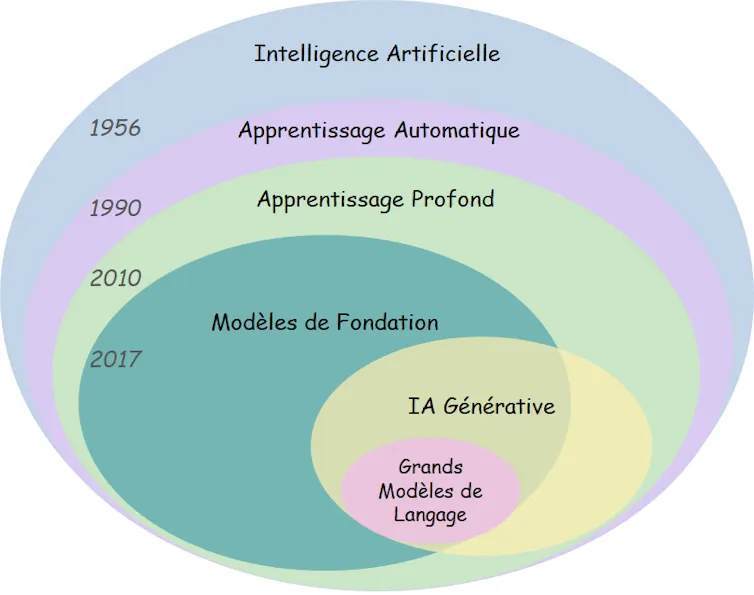

Concrètement, les modèles de fondation ne sont pas une application en soi, mais une infrastructure de base. Ils marquent une évolution récente de l’intelligence artificielle (IA), rendue possible par la combinaison de trois facteurs : l’explosion des données, les progrès des capacités de calcul et l’apparition de nouvelles architectures d’apprentissage.

Un tournant majeur intervient en 2017 avec l’architecture des transformers. Cette innovation permet de mieux capter les relations dans les données (notamment le langage), et devient la base de modèles comme BERT ou GPT. Lorsqu’un modèle de fondation (une expression née officiellement en 2021) est spécialisé dans le traitement du langage, on parle alors de grand modèle de langage (LLM). Et c’est sur cette base que se développent aujourd’hui les usages les plus visibles : ceux de l’IA générative, capable de produire du texte, des images, des vidéos, du son ou du code – qui est devenue grand public et commercialement viable avec le lancement de ChatGPT, fin 2022, marquant le passage de l’infrastructure à l’usage de masse.

Le rapport entre ces modèles de fondation et l’IA générative peut être comparé à celui d’un « moteur » par rapport à sa « fonction ». Le modèle de fondation est ce moteur puissant, pré-entraîné sur des données colossales et conçu pour être adaptable à une multitude de tâches. L’IA générative, quant à elle, est la fonction d’application finale : c’est la capacité de ce moteur à produire un contenu inédit.

Concrètement, si l’on prend un modèle de fondation comme GPT-4 (le moteur), on peut l’utiliser pour analyser des milliers d’avis clients (une tâche purement analytique). Mais lorsqu’on lui demande de rédiger un e-mail, on active alors sa fonction d’IA générative. De la même manière, dans le domaine visuel, un modèle de fondation entraîné sur des millions d’images peut servir de moteur aussi bien pour détecter une anomalie sur une radiographie médicale (classification) que pour dessiner un paysage imaginaire à partir d’une simple phrase (IA générative).

Promesses d’efficience et réalités de terrain

Cette polyvalence signifie que les modèles de fondation tendent à devenir une nouvelle « infrastructure » numérique, au même titre que le cloud ou Internet : au lieu de reconstruire un modèle d’IA spécifique propre à chaque projet, les acteurs économiques se branchent directement sur ces briques généralistes existantes.

Dans les organisations, ils agissent comme un accélérateur potentiel de transformation, mais leurs effets sur le terrain obligent à nuancer les promesses de gains de productivité spectaculaires. Beaucoup d’entreprises peinent encore à dégager un retour sur investissement évident pour l’automatisation administrative, constatant souvent que les modèles de fondation ne réduisent pas la charge de travail, mais l’intensifie : les employés doivent désormais consacrer davantage d’énergie à vérifier et à corriger les résultats.

Par ailleurs, l’assistance aux experts (aide au code, à la décision) se heurte à une « frontière technologique en dents de scie » : face à une tâche donnée, le modèle peut exceller, mais s’avérer contre-productif s’il est utilisé aveuglément en dehors de sa zone de compétence.

Néanmoins, ces modèles permettent de créer de nouveaux services comme la personnalisation de la relation client à grande échelle. Mais pour libérer ce potentiel, la simple mutualisation technologique ne suffit pas. Il faut impérativement repenser l’organisation du travail en formant les employés pour leur donner l’autonomie nécessaire face à la machine.

Les débats européens sur la régulation

En Europe, les enjeux se sont cristallisés dans les discussions autour de l’AI Act, qui introduit une catégorie spécifique pour les « systèmes d’IA à usage général », dont les modèles de fondation sont l’exemple emblématique. L’idée est de ne plus réguler uniquement les cas d’usage finaux, mais aussi ces briques génériques qui irriguent tout l’écosystème.

La Commission nationale de l’informatique et des libertés (Cnil) s’est également saisie de ces enjeux à travers un plan d’action consacré à l’intelligence artificielle, visant à accompagner l’innovation tout en garantissant la protection des droits fondamentaux. Elle met notamment l’accent sur la protection des données utilisées pour entraîner les modèles, la transparence des systèmes ainsi que le développement d’IA respectueuses de la vie privée.

Dans ce contexte, l’entraînement de ces modèles soulève aussi des défis importants au regard du règlement général sur la protection des données (RGPD), notamment concernant l’origine des données utilisées, la possibilité pour les individus d’exercer leurs droits sur leurs données et la capacité technique des systèmes à supprimer ou de ne plus exploiter certaines informations après leur intégration dans l’apprentissage. Pour les entreprises, cela signifie que ces technologies doivent être intégrées dans des démarches structurées de conformité, de documentation et de gestion des risques.

La question devient donc : dans quelles conditions utiliser les modèles de fondation ? Cela implique une gouvernance claire entre fournisseurs, intégrateurs et utilisateurs, des exigences de transparence et de documentation, l’anticipation des impacts sur l’emploi à travers la formation et la reconversion ainsi qu’une articulation avec les politiques de responsabilité sociétale des entreprises (RSE), afin d’évaluer leurs effets sociaux, organisationnels et environnementaux.

Sabrine Mallek ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

13.04.2026 à 16:44

La grossesse modifie le cerveau – et nous commençons tout juste à comprendre comment et pourquoi

Texte intégral (2033 mots)

La grossesse modifie le cerveau plus profondément que ce que les scientifiques imaginaient jusqu’à présent. Des données majeures issues de plusieurs études récentes permettent de décrypter les processus à l’œuvre au niveau de différentes aires cérébrales quand la femme est enceinte, mais aussi après l’accouchement.

Chaque année, des millions de femmes vivent une grossesse, mais la science commence seulement à s’intéresser à ses effets sur le cerveau – l’organe qui subit sans doute la transformation la plus remarquable. Au cours de la dernière décennie, un petit groupe de scientifiques en Espagne et aux Pays-Bas a cartographié ces changements avec un niveau de détail sans précédent.

Les chercheurs ont réalisé cinq scanners cérébraux sur 127 femmes qui devenaient mères pour la première fois : une fois avant la conception, deux fois pendant la grossesse, et de nouveau une fois un mois et six mois après l’accouchement. Il s’agit de la plus grande étude de ce type jamais réalisée.

Les études d’imagerie cérébrale qui suivent les mêmes personnes tout au long de la grossesse – avec des examens effectués avant la conception et après la naissance – sont extrêmement difficiles à mener. Les chercheurs doivent identifier les femmes qui envisagent de concevoir, commencer les examens avant le début de la grossesse, puis les suivre tout au long de ces mois marqués par des bouleversements physiologiques.

Une étude phare publiée en 2017 dans Nature Neuroscience a démontré pour la première fois que la grossesse modifie la structure du cerveau, mais elle incluait 25 femmes qui devenaient mères pour la première fois. La nouvelle étude porte sur plus de cinq fois ce nombre. C’est un bond en avant considérable.

Les résultats obtenus à partir des examens cérébraux de ces 127 femmes étaient cohérents et frappants. La matière grise – la partie du cerveau riche en cellules nerveuses – a diminué de près de 5 % dans plusieurs régions impliquées dans les émotions, l’empathie et la perception sociale au cours de la grossesse, en atteignant son niveau le plus bas au cours des dernières semaines précédant la naissance.

« J’aime utiliser la métaphore de la taille d’un arbre, a récemment déclaré à la BBC la professeure Susana Carmona, coautrice principale de l’étude. Certaines branches sont coupées pour permettre à l’arbre de pousser plus efficacement. »

Après l’accouchement, le volume a commencé à se reconstituer, atteignant environ 3,4 % six mois après la naissance. Cette évolution a été observée sur la quasi-totalité de la surface du cerveau et a concerné toutes les femmes participant à l’étude, sans exception.

Il est important de noter que cette tendance ne s’est pas manifestée chez les femmes qui sont devenues mères au cours de la période étudiée sans avoir elles-mêmes vécu une grossesse – par exemple, les partenaires de même sexe qui élevaient ensemble un nouveau-né mais qui n’avaient pas porté l’enfant. Cela suggère que les changements cérébraux observés sont dus à la biologie de la grossesse elle-même, plutôt qu’à la simple anticipation du fait de devenir parent.

Les chercheurs ont également mesuré les taux d’hormones et ont constaté que deux formes d’œstrogènes suivaient de près les modifications cérébrales. Leur taux augmentait à mesure que le volume de matière grise diminuait, puis déclinait fortement après la naissance, au moment de l’expulsion du placenta.

Ce lien entre les hormones et la structure cérébrale fait le lien entre des décennies de recherches menées sur des souris, chez qui il a été décrit depuis longtemps que l’augmentation des taux d’hormones pendant la grossesse modifie le fonctionnement du cerveau maternel et déclenche des comportements protecteurs.

Le volume de matière grise se reconstitue-t-il un jour complètement ?

Dans leur étude la plus récente, les chercheurs ont constaté qu’à six mois, la régénération de la matière grise se poursuivait. Une étude antérieure menée par le même groupe de recherche, au cours de laquelle des mères ont été suivies pendant six ans après leur accouchement, a révélé que les modifications cérébrales restaient détectables et permettaient toujours de prédire la proximité des relations entre les mères et leurs enfants.

Cette étude a permis d’identifier correctement, sur la seule base d’examens d’imagerie cérébrale, les femmes qui avaient été enceintes, avec une précision de plus de 90 %, même six ans après l’accouchement. Loin d’être un bouleversement temporaire, la grossesse semble laisser une empreinte durable.

Une étude néerlandaise publiée en 2026 a approfondi ces résultats en portant son attention sur des femmes au cours d’une deuxième grossesse. Les modifications cérébrales se sont reproduites, mais selon un schéma différent.

Les régions du cerveau qui avaient subi les transformations les plus marquantes lors d’une première grossesse – celles impliquées dans la conscience de soi et la perception des émotions d’autrui – n’ont présenté que des changements relativement modestes lors de la deuxième grossesse, comme si la transformation initiale avait déjà eu lieu. En revanche, les zones impliquées dans l’attention et la réactivité au monde extérieur ont été plus fortement affectées, ce qui reflète peut-être les exigences supplémentaires liées à la prise en charge d’un premier enfant pendant la grossesse.

Ce qui ressort le plus clairement de l’ensemble de ces recherches est le fait que les régions qui connaissent les transformations les plus importantes sont les régions impliquées dans la compréhension des autres : l’interprétation des intentions, l’empathie et la reconnaissance des signaux. Une étude d’imagerie publiée dans Nature Neuroscience en 2024 a examiné une femme à 26 reprises, depuis avant la conception jusqu’à deux ans après l’accouchement, ce qui a permis de fournir une cartographie sans précédent des changements qui se produisent dans un cerveau tout au long de la grossesse – une ressource désormais librement accessible à d’autres chercheurs.

Comparaison avec le cerveau des adolescents

La comparaison avec le cerveau des adolescents est le fil conducteur de tous ces travaux. Quand les chercheurs ont directement comparé les modifications cérébrales liées à la grossesse avec celles qui se produisent durant l’adolescence – une autre étape de la vie caractérisée par une poussée d’hormones sexuelles et un profond changement comportemental –, les schémas du changement se sont révélés presque identiques. Ont été observés le même amincissement du cortex, le même aplatissement des sillons à la surface du cerveau, le même taux de variation du volume cérébral chaque mois.

Si l’adolescence remodèle le cerveau pour le préparer à la vie sociale adulte, les données disponibles aujourd’hui disponibles suggèrent que la grossesse le remodèle à nouveau – de manière plus spécifique, plus profonde – pour le préparer à une tâche encore plus exigeante : s’occuper d’un nourrisson.

Il reste à comprendre ce que ces changements impliquent au niveau des cellules et des circuits, comment ils s’inscrivent dans le contexte de près d’une femme sur cinq qui souffre de dépression au moment de l’accouchement, et si les écarts par rapport au schéma habituel rendent les femmes plus vulnérables ou plus résilientes. Les outils permettant de commencer à répondre à ces questions existent désormais. Pour la première fois, nous disposons d’une carte.

Birgit Derntl a reçu des financements de la Fondation allemande pour la recherche (DFG, École doctorale internationale IRTG 2804), de la Fondation Hans et Ria Messer ainsi que de l'Union européenne (réseau doctoral MSCA MenoBrain).

Ann-Christin S. Kimmig a reçu des financements de la Fondation allemande pour la recherche (DFG, École doctorale internationale IRTG 2804) et de l’Office allemand d’échanges universitaires (DAAD).

Franziska Weinmar a reçu des financements de la Fondation allemande pour la recherche (DFG) dans le cadre du groupe international de formation à la recherche « La santé mentale des femmes tout au long de la période de procréation » (DFG, IRTG2804) ainsi que de la Fondation Hans et Ria Messer.

13.04.2026 à 16:44

Intelligence artificielle : quels sont les apports concrets de la régulation européenne ?

Texte intégral (2350 mots)

L’intelligence artificielle s’impose désormais au cœur de décisions qui engagent directement la vie, la santé et les droits des citoyens européens. Dans des entreprises, des administrations, des hôpitaux ou sur des plateformes numériques, des algorithmes trient, évaluent, recommandent et parfois décident. Face à cette automatisation croissante, une question centrale se pose : la réponse de l’Union européenne pour encadrer l’intelligence artificielle est-elle à la hauteur des risques qu’elle prétend prévenir ?

Imaginons qu’une entreprise décide d’utiliser une intelligence artificielle (IA) pour automatiser son processus de recrutement. L’algorithme, conçu pour analyser des milliers de CV, est entraîné sur les données RH de l’entreprise des dix dernières années. Or, les profils recrutés durant cette période sont majoritairement masculins. L’algorithme déduit alors de ces données que les candidats masculins sont préférables et exclut de fait les profils féminins.

Ce scénario n’est pas fictif : il s’inspire directement du cas d’Amazon, dont l’outil de recrutement par IA a dû être abandonné après la révélation de ces biais eu égard aux risques juridiques qu’ils engendraient. Cet exemple illustre précisément les risques que le législateur entend prévenir : erreurs algorithmiques, atteintes aux droits fondamentaux, captation et fuite de données, dépendance technologique.

En réponse, l’Union européenne a bâti depuis plusieurs années un arsenal juridique ambitieux, allant du Règlement général sur la protection des données (RGPD) au Règlement sur l’intelligence artificielle (RIA). Ces textes doivent relever un défi de taille : concilier innovation et protection, réguler les acteurs internationaux sans les éloigner du marché européen, et garantir les droits fondamentaux sans censure – le tout face à des technologies transversales, opaques et en constante évolution. Cet ensemble de règles constitue-t-il une réponse satisfaisante ?

Pas de régulation de l’IA, sans régulation des données

La régulation de l’intelligence artificielle ne saurait être envisagée indépendamment d’une politique structurée de la donnée. La donnée constitue en effet le carburant indispensable au développement et au perfectionnement des systèmes d’intelligence artificielle. En cela, la quantité de données compte tout autant que leur qualité.

C’est pourquoi, le législateur européen a d’abord cherché à réguler la donnée avant de réguler l’IA : d’une part avec le RGPD dont la finalité est de protéger les données à caractère personnel (les informations concernant une personne physique identifiée ou identifiable, comme un numéro de téléphone ou une adresse postale).

D’autre part avec une série de textes portant sur la régulation des données non personnelles (les informations ne se rapportant à aucune personne identifiable, comme une statistique ou un nombre d’accidents sur une autoroute visée). Ceux-ci comprennent le DSA, le DMA, le DGA, le Data Act et visent notamment à limiter la domination des géants du numérique et organiser le partage et l’accès de certaines données entre plateformes, entreprises, administrations publiques et utilisateurs, condition indispensable au développement de l’IA.

Ces textes relatifs aux données ont été le préalable à l’élaboration de la première réglementation générale au monde sur l’intelligence artificielle : le RIA.

Quelles sont les obligations imposées aux entreprises par le RIA ?

Contrairement aux États-Unis, qui privilégient une approche dérégulée, et à la Chine, qui encadre principalement certains usages ciblés, l’Union européenne a fait le choix d’un cadre juridique général et contraignant, s’appliquant à l’ensemble des secteurs et des systèmes d’intelligence artificielle, afin de poser les bases d’un véritable droit commun de l’IA au sein du marché européen depuis son entrée en vigueur le 1er août 2024.

Son objectif est d’encadrer

« le développement, la mise sur le marché et l’utilisation de systèmes d’intelligence artificielle, qui peuvent poser des risques pour la santé, la sécurité ou les droits fondamentaux ».

Pour atteindre cet objectif, le RIA commence par définir précisément le champ des technologies qu’il entend encadrer. Il distingue : les systèmes d’intelligence artificielle, qui correspondent aux applications concrètes utilisées par les utilisateurs (ex : un outil de tri de candidatures, ChatGPT) et les modèles d’intelligence artificielle à usage général, qui constituent le socle technologique sur lequel reposent ces applications, comme GPT-4 pour ChatGPT.

Pour assurer un équilibre entre protection des personnes et innovation, le RIA classe les systèmes d’intelligence artificielle en quatre niveaux de risque :

le risque inacceptable (ex : système de notation sociale des citoyens, présentant un risque d’une atteinte grave aux droits fondamentaux) impliquant l’interdiction du système d’IA.

le risque élevé (ex : une IA utilisée pour évaluer des salariés, présentant un risque d’atteinte au droit du travail et à la vie privée) imposant des obligations comme celle de réaliser des audits ou celle d’entraîner le système sur des données qualitatives et exemptes de biais.

le risque limité (ex : assistant conversationnel d’un service client, présentant le risque d’une collecte de données sans consentement éclairé) obligeant notamment les opérateurs à informer les utilisateurs de l’usage de l’IA.

le risque minimal (ex : IA intégrée dans un jeu vidéo) dont ne découle aucune obligation spécifique.

Pour chaque niveau de risque, des obligations spécifiques et proportionnées sont donc édictées en fonction de leurs effets potentiels sur les droits fondamentaux, la sécurité et la santé des personnes. Ces obligations s’imposent à différents opérateurs selon le moment où ils interviennent dans la chaîne de valeur de l’IA : fournisseur, mandataire, importateur, distributeur…

Par exemple, un système d’IA utilisé pour l’analyse d’images médicales, qualifié de système à risque élevé, est soumis à des obligations spécifiques qui varient selon l’opérateur concerné : le fournisseur doit concevoir le système en conformité avec les exigences de sécurité et de gestion des risques comme s’assurer qu’il ne peut pas y avoir de faux positif ou de faux négatif dans le diagnostic mais également que le système ne présente pas de biais du fait d’une sous-représentation de certains groupes ethniques ou de genre, l’importateur et le distributeur doivent vérifier que cette conformité a été respectée, et l’hôpital qui déploie le système doit s’assurer qu’il est utilisé correctement et sous supervision humaine.

Concernant les modèles d’IA à usage général (ex : GPT-4, algorithme sur lequel repose ChatGPT), le législateur européen a édicté différentes règles selon qu’ils présentent ou non un risque systémique.

L’article 3 § 65 du RIA définissant le risque systémique comme :

« un risque spécifique aux capacités à fort impact des modèles d’IA à usage général, ayant une incidence significative sur le marché de l’Union en raison de leur portée ou d’effets négatifs réels ou raisonnablement prévisibles sur la santé publique, la sûreté, la sécurité publique, les droits fondamentaux ou la société dans son ensemble, pouvant être propagé à grande échelle tout au long de la chaîne de valeur ».

Ce risque est évalué selon la puissance de calcul du modèle. Les modèles d’IA à usage général qui présentent un risque systémique doivent notamment signaler les incidents graves (des biais, des faux positifs, une cyberattaque), prendre d’importantes mesures de cybersécurité ou encore tester le modèle et atténuer les risques systémiques identifiés (grâce à des audits, des mesures de protection contre les piratages ou encore des mesures de détection de biais). Plusieurs autorités ont été désignées pour contrôler la bonne application du règlement, c’est le cas notamment du comité européen de l’intelligence artificielle au niveau européen, et de la CNIL au niveau national.

Les limites du RIA

Le RIA a suscité des critiques des experts du droit et du monde professionnel à propos de sa mise en œuvre. Ainsi, 46 dirigeants d’entreprise ont dénoncé, dans une lettre ouverte destinée à la présidente de la Commission européenne, « des règlementations européennes peu claires, qui se chevauchent et deviennent de plus en plus complexes ». La technicité du RIA conjuguée à la complexité des algorithmes compliquent l’application du texte, en particulier pour les obligations de transparence – incompatibles avec l’opacité des algorithmes – et pour l’identification des responsabilités, les entreprises peinant à déterminer quelles obligations leur incombent selon leur position dans la chaîne de valeur et le niveau de risque du système.

En découle alors une autre problématique, le risque de freiner les acteurs français et européens, comme Orasio, H Company ou DeepL, qui tentent de concurrencer les géants américains de l’intelligence artificielle qui ont davantage de moyens (juridiques, technologiques, financiers) pour mettre en œuvre les obligations du RIA.

À cet égard, il convient de relever que le législateur européen a finalement renoncé, le 11 février 2025, à adopter une législation spécifique relative à la responsabilité civile des acteurs de l’intelligence artificielle, dont la finalité était d’harmoniser les règles de responsabilité civile pour les dommages causés par l’IA, afin de protéger les victimes et d’unifier le cadre juridique au sein de l’UE. Cet abandon est intervenu suite à une opposition de certains États membres, notamment la France, mais aussi des critiques formulées par le lobbying de grandes entreprises technologiques qui dénonçaient un risque de surrégulation et une insécurité juridique susceptible de freiner l’innovation. En l’absence d’un tel cadre spécifique, ce sont donc les règles de droit positif de responsabilité civile qui demeurent applicables aux dommages causés par les systèmes d’intelligence artificielle.

Les enjeux de la régulation

En combinant protection des données, encadrement des usages et obligations pesant sur les acteurs les plus puissants, l’Union européenne a posé les bases d’un véritable droit commun de l’IA unique au monde.

Cependant, cette réponse n’est satisfaisante qu’à une condition : que son application ne transforme pas la régulation en barrière à l’entrée pour les acteurs européens tels que Mistral AI, NEURA Robotics ou Dust. En effet, le risque est de renforcer la domination des géants américains et chinois plutôt que de la combattre. D’autant que cette domination ne se limite pas au plan économique : elle s’exerce également sur le plan politique. Un rapport de Corporate Europe Observatory et LobbyControl, deux ONG spécialisées dans la surveillance du lobbying, montre ainsi que les Big Tech auraient une influence significative sur la rédaction des Codes de bonnes pratiques prévus par le RIA notamment en parvenant à affaiblir certaines obligations.

La véritable réussite de la régulation européenne ne se mesurera donc pas seulement à la protection des citoyens, mais à sa capacité à faire émerger une intelligence artificielle européenne, à la fois éthique, compétitive et souveraine.

Chloé Dornbierer ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.