31.03.2026 à 14:03

Cinquante ans d’Apple : huit moments clés qui ont changé notre monde

Texte intégral (2222 mots)

De la démocratisation de l’ordinateur personnel à l’invention de l’écosystème des applications, Apple a souvent imposé de nouvelles manières d’utiliser la technologie. Voici quelques-unes des innovations les plus marquantes de l’entreprise depuis un demi-siècle.

Au début des années 1970, l’idée qu’une personne ordinaire puisse posséder un ordinateur semblait absurde. À l’époque, les ordinateurs ressemblaient davantage à des porte-avions ou à des centrales nucléaires qu’à des appareils domestiques : d’immenses machines installées dans des centres de données, exploitées par des équipes de spécialistes au service de gouvernements, d'universités et de grandes entreprises.

Puis vint Apple.

Fondée le 1er avril 1976 par deux « décrocheurs universitaires », les fameux « college dropouts » Steve Jobs et Steve Wozniak, la start-up de la Silicon Valley n’a pas inventé l’informatique. Mais elle a sans doute accompli quelque chose de plus important : contribuer à transformer l’informatique en technologie personnelle.

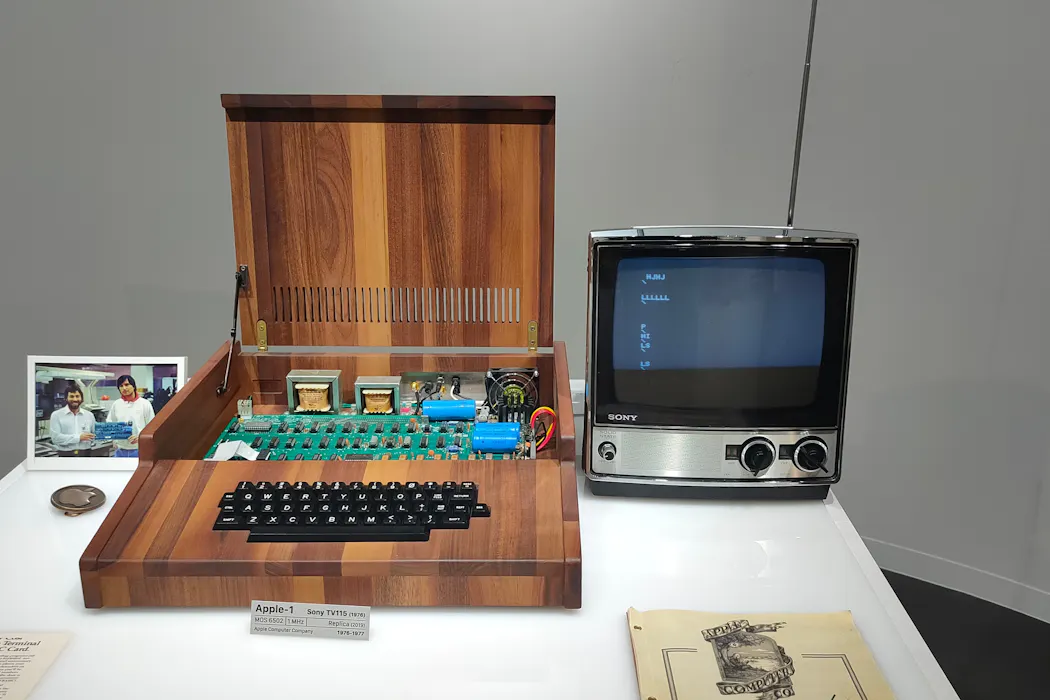

Avant Apple, les ordinateurs étaient le plus souvent vendus sous forme de kits à assembler. Jobs a compris que les gens préféraient des machines déjà montées, prêtes à fonctionner. Les tout premiers Apple I, dotés de boîtiers en bois de koa fabriqués à la main, se vendent aujourd’hui aux enchères pour plusieurs centaines de milliers de dollars.

En tant qu’utilisateur précoce d’Apple et développeur d’applications, voici ma sélection personnelle des réalisations technologiques les plus marquantes de l’entreprise – et de Steve Jobs – au cours des 50 dernières années.

Apple II – beige et unique en son genre

Les premiers ordinateurs personnels relevaient davantage de la curiosité que de l’outil réellement utile. L’Apple II, lancé en juin 1977, introduisit quelque chose de nouveau : le style. Même sa couleur – beige ! – était originale, contrastant avec les boîtiers métalliques noirs courants à l’époque.

L’affichage en couleurs était nouveau et enthousiasmant, et le clavier offrait une sensation agréable à l’usage. Un simple haut-parleur, doté d’une sortie d’un seul bit, était ingénieusement exploité pour produire des tonalités et même des sons ressemblant à la parole. Le design était révolutionné jusqu’à l’emballage : Jerry Manock, premier designer salarié d'Apple, installa la machine dans un boîtier en plastique moulé à l’allure élégante et professionnelle.

La souris – une nouvelle manière d’interagir

En 1979, Steve Jobs, alors âgé de 24 ans et convaincu que le géant technologique IBM était en train de rattraper Apple, se mit en quête de la prochaine grande innovation. L’entreprise de photocopieurs Xerox, qui souhaitait obtenir des actions Apple avant même son entrée en bourse, lui proposa en échange une visite de ses laboratoires de recherche voisins. Jobs comprit alors que des chercheurs du centre de recherche de Xerox à Palo Alto, comme Alan Kay, étaient en train d’inventer la prochaine génération d’interfaces informatiques.

Au cœur de cette révolution se trouvait un dispositif mis au point au milieu des années 1960 par le mentor d'Alan Kay, Douglas Engelbart, à l’université Stanford, et surnommé « la souris ». La vision de Douglas Engelbart, qui voyait l’ordinateur comme une machine destinée à augmenter les capacités de l’esprit humain, inspira Alan Kay et ses collègues, qui conçurent des interfaces graphiques dans lesquelles les utilisateurs interagissaient avec des barres de défilement, des boutons, des menus et des fenêtres.

Macintosh – la naissance du lancement de produit moderne

Steve Jobs pensait que n’importe qui devait pouvoir utiliser un ordinateur. En janvier 1984, le premier Apple Mac poussa cette idée à un niveau inédit. Fini les commandes informatiques sibyllines et les manuels qui les accompagnaient. Les premiers utilisateurs, dont je faisais partie, avaient l’impression de savoir instinctivement comment tout faire.

Mais le lancement du Mac ne se résume pas à ce saut technologique. Il inspira aussi ce qui est devenu un moment culturel désormais ancré dans nos vies : le lancement de produit. Après une publicité aguicheuse diffusée lors du Super Bowl et réalisée par Ridley Scott, Steve Jobs mit en scène dans un théâtre de 1 500 places un lancement de produit centré sur un présentateur charismatique et seul en scène. Il sortit d’un sac un petit ordinateur carré – encore beige – alors appelé Macintosh, qui se mit à parler de lui-même sous les applaudissements enthousiastes de la salle.

Pixar – le projet parallèle de Jobs

Au cours de sa première décennie, Apple connut une croissance exceptionnelle – mais frôla aussi la faillite à plusieurs reprises. Des difficultés qui conduisirent l’entreprise à l’un des épisodes les plus spectaculaires de son histoire lorsque, en mai 1985, Apple força Jobs à quitter la société.

Un an plus tard, alors qu’il dirige la start-up NeXT Inc, Steve Jobs rachète une division de la société de production de George Lucas, qu’il rebaptise rapidement Pixar. Son logiciel RenderMan permettait de générer des images en répartissant les calculs entre plusieurs machines travaillant simultanément.

Pixar, souvent décrit avec humour comme le « projet parallèle » de Jobs, deviendra l’un des studios d’animation les plus influents – et les plus rentables – au monde, en produisant notamment le premier long métrage entièrement animé par ordinateur, Toy Story (1995).

IMac – la rencontre de deux visions

Après une tentative infructueuse de développer un nouveau système d’exploitation avec IBM, Apple finit par racheter la société NeXT de Steve Jobs. En septembre 1997, celui-ci revient alors comme PDG par intérim alors que l’entreprise se trouve, selon ses propres mots, à « deux mois de la faillite ». Si ce retour est salué par de nombreux utilisateurs d’Apple, il inquiète une partie des salariés. Jobs commence en effet rapidement à licencier du personnel et à fermer les produits jugés défaillants.

Au cours de cette restructuration, il visite le studio de design d’Apple et s’entend immédiatement avec un jeune designer britannique, Jony Ive. De cette rencontre naît en 1998 l’iMac translucide aux couleurs acidulées. Essentiellement des machines NeXT plus petites et moins chères, les iMac (le « i » signifiant Internet) inaugurent aussi une autre innovation d’Apple, aujourd'hui devenue une habitude : abandonner les technologies vieillissantes. Le lecteur de disquettes est supprimé au profit d’un lecteur de CD – un choix très critiqué à l’époque, mais largement imité par la suite.

IPod – 1 000 chansons dans votre poche

Pour Apple, l’informatique n’a jamais consisté uniquement à faire de l’informatique. En 2001, l’entreprise commence à s’intéresser au traitement du son et de la vidéo, et plus seulement du texte et des images. En novembre de la même année, elle lance l’iPod – un baladeur capable de stocker « 1 000 chansons dans votre poche », contre au maximum 20 à 30 par cassette sur un Walkman de Sony.

L’iPod se pilote grâce à une élégante « click wheel » permettant de naviguer à l’écran. La musique est synchronisée via une nouvelle application appelée iTunes. Dès 2005, les utilisateurs s’en servent aussi pour gérer des fichiers audio téléchargés automatiquement depuis Internet grâce à un système appelé RSS. C’est ce qui donnera le « pod » de podcast.

IPhone – un ordinateur dans toutes les mains

En 2007, de nombreux fabricants de téléphones mobiles avaient approché Apple pour fusionner l’iPod avec leurs appareils. Steve Jobs choisit une autre voie. Le 9 janvier, il dévoile le produit le plus ambitieux jamais lancé par Apple : un appareil combinant téléphone, lecteur de musique et ordinateur Mac – le tout au format d’un simple combiné, sans clavier physique et doté d’un large écran.

La plupart des « experts » des médias, de TechCrunch au Guardian, prédisaient un échec. Steve Ballmer, alors PDG de Microsoft, se moquait du prix de 500 dollars, affirmant que personne n’achèterait un tel appareil. En réalité, 1,4 million d’iPhone furent vendus avant même la fin de l’année – et plus de 3 milliards depuis. Pour la première fois, un véritable ordinateur se retrouvait dans toutes les mains – ouvrant la voie aux réseaux sociaux tels que nous les connaissons aujourd’hui.

La révolution logicielle de l’App Store

À la mi-2008, l’iPhone offre à tous les développeurs la possibilité de créer une multitude vertigineuse de nouvelles applications. Dans le même temps, l’App Store – lancé le 10 juillet 2008 – résout l’un des problèmes les plus complexes : la distribution et la commercialisation de ces « apps ». Historiquement, les logiciels étaient souvent copiés et diffusés librement. L’App Store change la donne en utilisant un chiffrement robuste pour garantir que la copie achetée ne puisse être utilisée que par l’utilisateur concerné, réduisant ainsi le piratage.

En lançant le premier App Store au sens moderne du terme, Apple a transformé la manière dont les utilisateurs découvrent et achètent des logiciels. Cela déclenche une explosion du nombre d’applications et impose une idée simple mais puissante : quoi que vous souhaitiez faire, quelqu’un, quelque part, a déjà créé l’application pour le faire. Apple résume cette évolution dans un slogan devenu célèbre : « There’s an app for that » (« Il y a une application pour ça »).

À maintes reprises, cette entreprise hors norme a anticipé l’intérêt d’ouvrir l’informatique au plus grand nombre. Joyeux anniversaire, Apple !

Nick Dalton ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

30.03.2026 à 16:42

Les Mayas : des mathématiciens qui lisaient l’avenir dans les étoiles ?

Texte intégral (2154 mots)

Mille ans avant l’Europe, les Mayas résolvaient déjà des équations complexes. Armés du seul regard et d’une patience infinie, ils scrutaient le ciel et prédisaient avec précision les éclipses et les trajectoires des planètes.

Embarquons pour un voyage dans des temps reculés. Nous sommes sur les territoires des actuels Mexique, Guatemala, Bélize, Honduras et Salvador. C’est dans ce cadre luxuriant que les Mayas ont bâti un héritage extraordinaire : une astronomie stupéfiante, des mathématiques avancées, une architecture audacieuse et une écriture hiéroglyphique riche.

Ainsi, les cités mayas étaient orientées vers les astres. À Chichén Itzá (actuellement au Mexique), lors des équinoxes, les ombres sur la pyramide El Castillo semblent animer la progression du dieu serpent Kukulkan le long des marches – un phénomène comparable s’observe à El Tajín.

Les « codex », leurs traités astronomiques, sont un des rares témoignages survivants de ces savoirs. Le plus célèbre est le codex de Dresde. Son mystère est double : l’énigme de ses symboles – glyphes serrés, colonnes de chiffres, divinités codifiées – et celle de son destin.

Comment ce manuscrit du Yucatán a-t-il traversé l’Atlantique pour échouer dans une bibliothèque de Saxe ? La théorie dominante veut que l’Espagnol Hernán Cortés (1485-1547) l’ait envoyé en Europe après la conquête du Mexique, parmi les objets précieux offerts à la cour madrilène. Le manuscrit aurait circulé en Europe avant d’aboutir à Vienne, où, en 1739, le directeur de la bibliothèque royale de Dresde Johann Christian Götze le racheta à un propriétaire le jugeant « incompréhensible et sans valeur », ignorant qu’il tenait l’un des documents astronomiques les plus sophistiqués jamais produits. Götze le rapporta à Dresde, où il est toujours conservé aujourd’hui.

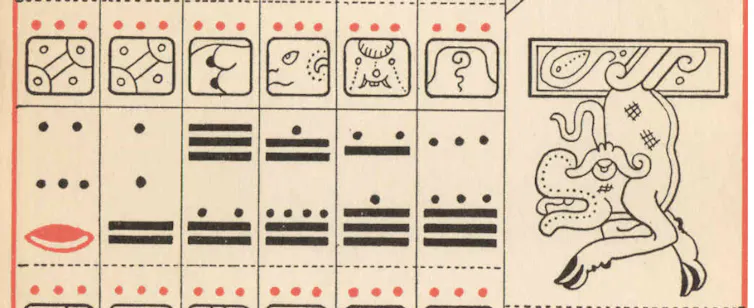

Mars et le secret derrière le nombre 78

Pour déchiffrer les symboles du codex, un détour s’impose. Les Mayas comptaient en base 20 : un point valait une unité, une barre cinq unités, et un coquillage représentait le zéro – concept que l’Europe n’adoptera qu’au XIᵉ siècle.

Sur la page du codex de Dresde concernent Mars et ses cycles se trouve une suite de nombres : 78, 156, 234, 312, 390, 780. Chaque terme est un multiple de 78. On observe par ailleurs que cette suite est presque une suite arithmétique (une suite telle que la différence entre deux termes consécutifs doit être égale à une constante), mais le dernier terme déroge : il vaut 10 × 78 (au lieu de 6 × 78).

Le 78 correspond à un dixième de la « période synodique » de Mars, c’est-à-dire le temps pour retrouver la même position dans le ciel, vue depuis la Terre, soit 780 jours. Les Mayas l’avaient calculée avec une précision remarquable : 780 jours contre 779,94 jours aujourd’hui. Les cinq premiers termes balisent les étapes intermédiaires, et le dernier marque le cycle complet.

Le zodiaque maya comptait 13 constellations le long de l’écliptique, et Mars met 260 jours (13 × 20) pour le parcourir. Trois traversées complètes du zodiaque maya correspondent exactement à 780 jours. Cette durée de 260 jours correspond aussi au Tzolk’in, le calendrier rituel maya, ce qui permet d’aligner parfaitement le rythme de Mars et le calendrier. Ainsi, la suite de nombres sur le codex formait une table de navigation céleste.

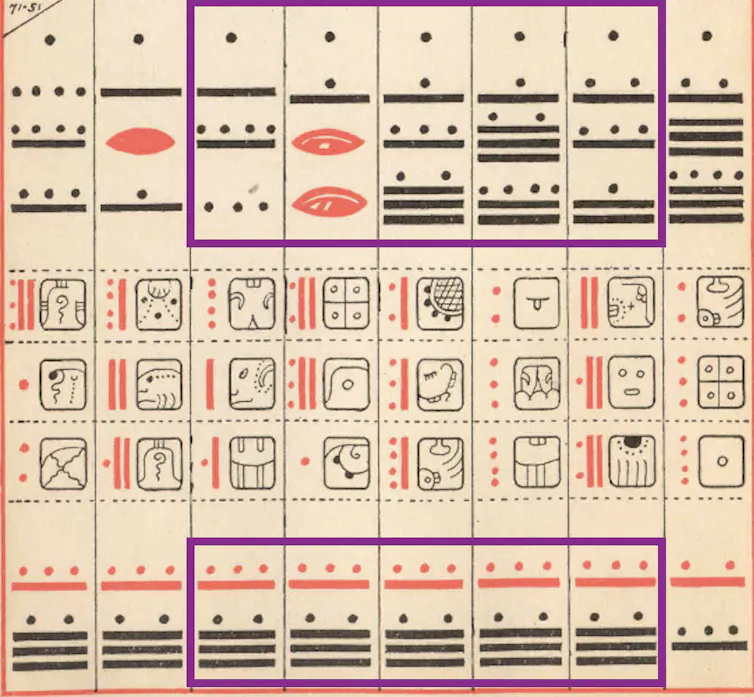

Les éclipses lunaires

Une autre page du codex présente une nouvelle suite de nombres : 9 360, 9 537, 9 714, 9 891, 10 039. Jusqu’à 9 891, chaque valeur augmente de 177 jours (9 183 + 177 = 9 360, 9 360 + 177 = 9 537, 9 537 + 177 = 9 714, 9 714 + 177 = 9 891). Mais ici encore, le dernier terme rompt le schéma : 10 039 = 9 891 + 148, révélant un second cycle.

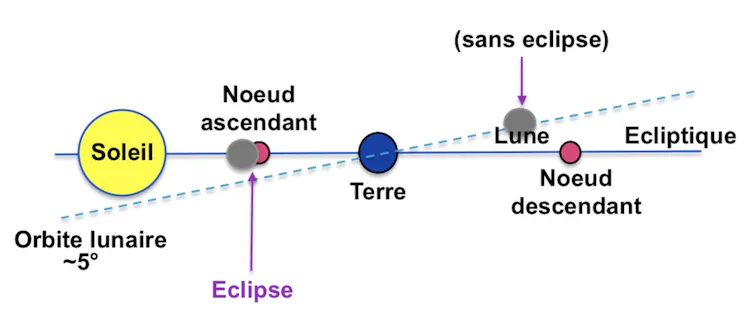

Ceci n’est pas une erreur : si la période synodique de la Lune est de 29,5 jours environ, toutes les pleines lunes ne donnent pas lieu à une éclipse. L’intervalle entre deux éclipses consécutives correspond à 5 ou 6 lunaisons (soit 148 ou 177 jours).

En effet, l’orbite de la Lune est inclinée d’environ 5° : les éclipses ne se produisent qu’au voisinage d’un nœud orbital. Le Soleil y passe tous les 173,31 jours (la saison d’éclipses), et il s’écoule nécessairement 5 ou 6 lunaisons entières entre deux éclipses.

Les Mayas avaient calculé la période synodique de la Lune à 29,53 jours, à quelques secondes de la mesure moderne. Certains multiples coïncidaient avec les saisons d’éclipses, leur permettant de les anticiper.

Le système mathématique des Mayas

La sophistication mathématique des Mayas transparaît jusque dans leur quotidien. Ils pratiquaient instinctivement ce que l’on appelle aujourd’hui l’arithmétique modulaire. Le principe en est simple : plutôt que de considérer la valeur d’un nombre, l’arithmétique modulaire s’intéresse uniquement au reste qu’il laisse après division par un nombre de référence – le modulo (ici, modulo 20). Les Mayas, sans jamais employer ce vocabulaire, appliquaient précisément cette logique, et ce, bien avant que le mathématicien allemand Carl Friedrich Gauss (1777-1855) n’en pose les bases formelles au tournant du XIXᵉ siècle. Aujourd’hui, on trouve un écho de ce genre de mathématiques dans des domaines aussi contemporains que la cryptographie et la sécurité informatique.

En langage moderne, ces calculs s’interprètent comme des opérations dans l’anneau ℤ/20ℤ. Cette notion d’anneau est l’une des pierres angulaires des mathématiques contemporaines, au cœur de l’algèbre abstraite de la fin du XIXᵉ siècle. Parmi ses fondateurs figure le mathématicien Richard Dedekind (1831–1916).

Les pages du codex recèlent encore bien des zones d’ombre et de mystère. Qui sait quels secrets dorment encore dans les colonnes de glyphes du codex, attendant d’être dévoilés ?

Noémie Combe ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

29.03.2026 à 16:40

IA et métacognition : savoir quand on peut faire confiance, ou non, à la machine n’est pas toujours évident

Texte intégral (2119 mots)

Cet article est publié en collaboration avec Binaire, le blog pour comprendre les enjeux du numérique.

Un système d’IA doit toujours être supervisé par un humain, mais encore faut-il que cette personne soit en mesure de distinguer quand elle comprend ce que propose la machine et quand elle peut être influencée.

Les cadres contemporains de gouvernance de l’intelligence artificielle (IA) reposent sur un présupposé rarement rendu explicite : lorsqu’un opérateur humain reçoit l’output d’un système d’IA, il doit être en mesure de l’évaluer de manière significative. Les dispositions de l’AI Act européen relatives aux systèmes à haut risque exigent transparence, explicabilité et supervision humaine.

Sont explicitement visés les systèmes utilisés dans le recrutement et l’évaluation des travailleurs, l’accès aux prestations sociales, les décisions d’octroi de crédit, le contrôle aux frontières, l’administration de la justice, et les soins de santé critiques.

Le plan d’action des États-Unis sur l’IA appelle au maintien d’un contrôle humain significatif sur les décisions IA à conséquences importantes. Les principes de l’OCDE sur l’IA inscrivent le centrage sur l’humain au cœur de ses engagements.

Ces engagements sont nécessaires mais insuffisants. Ils portent sur ce que les systèmes d’IA doivent fournir aux opérateurs humains et laissent entièrement sans réponse la question de ce que ces derniers doivent être capables de faire pour agir sur ce qu’ils reçoivent. Cette lacune n’est pas accidentelle. C’est un angle mort structurel dans l’architecture actuelle de la gouvernance de l’IA.

Le modèle implicite du superviseur humain dans la plupart des textes réglementaires est celui d’un professionnel compétent et attentif qui, face à des outputs précis et lisibles, formule des jugements éclairés. C’est une hypothèse plausible dans des environnements stables, à faibles enjeux et bien maîtrisés, mais une hypothèse fragile dans des contextes à forts enjeux, soumis à la pression temporelle, et techniquement opaques – précisément les contextes dans lesquels les systèmes d’IA sont de plus en plus déployés.

Par exemple, l’infirmier aux urgences en charge du triage aux urgences qui reçoit un score de triage produit par un système IA ne dispose pas systématiquement des explications qui l’ont généré. Le conseiller bancaire qui doit décider en quelques minutes de bloquer un compte sur la base d’une alerte de fraude automatisée travaille potentiellement avec un modèle propriétaire qu’il ne peut pas interroger. L’agent administratif qui valide l’attribution d’un logement social ou d’une prestation algorithmiquement priorisée ne peut généralement pas expliquer pourquoi un dossier a été classé avant un autre. L’enseignant qui contresigne une notation automatisée d’examen n’a pas accès aux critères qui ont produit le score. Dans chacun de ces cas, la supervision humaine est formellement présente – et substantiellement impossible.

Des opérateurs métacognitivements avertis

La métacognition – la capacité à monitorer et réguler ses propres processus cognitifs – est le substrat psychologique d’une supervision efficace. Un opérateur métacognitivement averti sait quand il comprend quelque chose, quand il conjecture, et quand son jugement est façonné par des facteurs qu’il n’a pas consciemment enregistrés. Cette capacité ne peut pas être présumée ; elle varie significativement selon les individus, les formations et les pressions situationnelles.

La recherche en interaction humain-automatisme a documenté un ensemble de modes de défaillance qui émergent spécifiquement lorsque des humains supervisent des systèmes automatisés ou alimentés par l’IA. Le biais d’automatisation – la tendance à surpondérer les recommandations générées par la machine par rapport à son propre jugement – est l’un des résultats les plus robustes du domaine. Dans une étude fréquemment citée, les chercheurs Parasuraman et Riley ont montré en 1997 que les humains mésusent (c’est-à-dire font un mauvais usage ou utilisent de manière inadéquate ou inappropriée) systématiquement de l’automatisation en l’appliquant là où elle est peu fiable, et la délaissent là où elle serait bénéfique – deux types d’erreurs qui reflètent un défaut d’étalonnage métacognitif plutôt qu’un défaut de provision d’information. Par exemple, dans des expériences en simulateur de vol citées par ces auteurs, des pilotes équipés d’un système d’alerte automatique ont éteint un moteur en réponse à une fausse alerte – une décision qu’ils avaient eux-mêmes déclaré, avant l’expérience, ne jamais prendre sur la seule foi d’une alerte automatisée.

Le défi est aggravé par les caractéristiques propres aux systèmes d’IA contemporains. Les travaux de Kahneman sur une cognition à double processus – connu aussi sous le nom de Système 1/Système 2, les deux vitesses de pensées – éclairent ce mécanisme. Face à un système IA qui produit un output avec fluidité et assurance, l’esprit humain tend à activer un traitement rapide et intuitif (celui qu’on mobilise pour des tâches familières et peu risquées), plutôt que de réaliser une analyse profonde de la situation, plus longue, plus réfléchi, plus logique, et donc plus gourmande cognitivement.

Plus concrètement, une explication qui paraît plausible déclenche des réponses cognitives différentes d’une explication qui l’est vraiment. Lorsque les explications des systèmes d’IA sont synthétiquement fluides, numériquement précises et visuellement formatées comme des outputs faisant autorité, elles suppriment précisément le scepticisme que nécessite une supervision significative.

Peut-être de manière contre-intuitive, fournir davantage d’explications n’améliore pas de manière fiable le jugement humain des résultats d’IA. Une équipe de recherche, dans une étude expérimentale rigoureuse, a constaté que les explications produites par l’IA n’amélioraient pas systématiquement les performances de l’équipe humain-IA, et les dégradaient dans plusieurs conditions – notamment lorsque les explications étaient techniquement exactes mais cognitivement incompatibles avec la manière dont les opérateurs formaient leurs propres jugements.

Plus concrètement, sur la tâche d’analyse de sentiment, l’IA expliquait son jugement en surlignant les mots qu’elle avait identifiés comme positifs ou négatifs. Or les participants humains évaluaient le ton d’un texte de manière globale, en tenant compte du contexte et de la cohérence d’ensemble – un processus que la mise en évidence de mots individuels ne peut pas restituer. Ici, l’IA et l’humain n’arrivent pas à leur jugement par le même chemin : L’IA identifie des élements locaux (un mot, une phrase), là ou l’humain construit un jugement holiste (l’ensemble du texte, le contexte, la cohérence interne). Quand l’explication fournie reflète la logique de la machine plutôt que celle du raisonnement humain, elle ne donne pas à l’opérateur les outils pour évaluer si la recommandation est fiable – elle le convainc simplement de la suivre.

L’explicabilité est ainsi une condition nécessaire mais insuffisante d’une supervision efficace. Ce qui réduit l’écart entre les deux, c’est la maturité métacognitive.

Trois implications pour la gouvernance de l’IA

Si la maturité métacognitive est une propriété réelle et variable des opérateurs humains, alors les cadres de gouvernance qui imposent l’explicabilité sans s’intéresser à la métacognition des opérateurs sont tout simplement incomplets. Selon les travaux de la littérature scientifique – parmi lesquels ceux de l’IA explicable, de l’interaction humain-automatisme, des sciences cognitives, de la psychologie, des sciences humaines et sociales –, trois implications peuvent être énoncées :

La transparence centrée sur la documentation est insuffisante. Ce n’est pas une intuition : c’est ce que la recherche montre depuis trente ans. Ainsi, documenter et expliquer le comportement d’un système ne suffit pas à garantir de bonnes décisions humaines sans impliquer les individus dans les processus de conception de ces explications et de cette documentation et prendre en compte le contexte du besoin métier à l’instant t. Des études contrôlées ont même montré que « trop d’explications » peuvent dégrader la performance de l’équipe humain-IA en noyant l’information pertinente dans le bruit.

La qualification métacognitive des opérateurs devrait être considérée comme une composante de la gouvernance IA. Il s’agit ici d’un gap que la recherche a commencé à nommer, sans qu’aucun référentiel n’ait encore été formalisé.

Plus concrètement, les textes réglementaires comme l’AI Act exigent que les superviseurs humains soient « compétents », mais sans jamais définir ce que cela signifie – et en particulier, aucun référentiel n’évalue ce que les chercheurs appellent la compétence métacognitive, soit la capacité à détecter les défaillances de son propre raisonnement face à un système opaque, compétence qui relève de la formation et du contexte, pas de l’intelligence brute. Une précision importante s’impose ici. Parler de la qualification métacognitive des opérateurs ne revient pas à questionner la valeur ou l’intelligence des personnes qui supervisent des systèmes d’IA. Il ne s’agit pas non plus de classer les humains selon leur capacité à « bien penser ». La métacognition n’est ni un trait de personnalité ni un indicateur de valeur. C’est une compétence situationnelle, sensible au contexte, à la formation, à la charge cognitive et aux conditions de travail. Par exemple, un chirurgien expérimenté peut présenter un excellent étalonnage métacognitif dans son domaine et être tout aussi vulnérable au biais d’automatisation qu’un débutant face à un système d’IA opaque dans un contexte pour lequel il n’a reçu aucune formation spécifique.

- Les compétences métacognitives – savoir ce qu’on comprend, détecter ses propres erreurs de raisonnement, réguler ses stratégies cognitives – varie selon les individus et n’est pas uniformément répartie au sein de la population, ce qui crée un risque structurel pour la sécurité. Il s’agit d’une hypothèse, formulée à partir de travaux menés en psychologie de l’éducation, qui n’a pas encore été étudiée dans le contexte de la gouvernance de l’IA. C’est peut-être le prochain axe de recherche que les gouvernements devraient activement encourager. En effet, si les organisations les mieux dotées en moyens matériels et en ressources humaines peuvent satisfaire aux exigences de supervision réelle, celles qui n’en n’ont pas – non pas parce que leurs personnels seraient moins capables, mais parce que les conditions permettant le développement de cette compétence situationnelle n’ont pas été réunies – produiront une conformité de façade, insuffisante, générant une fausse sécurité particulièrement dangereuse dans les domaines critiques.

Ikram Chraibi Kaadoud ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.