ACCÈS LIBRE

28.07.2025 à 07:42

Khrys’presso du lundi 28 juillet 2025

Khrys

Texte intégral (8770 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- « Dépasser le capitalisme, pas les limites planétaires » : l’ensemble des ressources naturelles de la Terre pour l’année 2025 ont déjà été consommées (humanite.fr)

- Crise climatique : dans un avis très attendu, la Cour internationale de justice ouvre la voie à une obligation pour les pays pollueurs de payer des “réparations” (franceinfo.fr) – voir aussi Climat : pourquoi la décision de la Cour internationale de justice est « historique » (reporterre.net)

- The First Planned Migration of an Entire Country Is Underway (wired.com)

The Pacific island nation of Tuvalu could be submerged in 25 years due to rising sea levels, so a plan is being implemented to relocate its population to Australia.

Voir aussi Menacée par la montée des océans, quasiment toute la population des Tuvalu se prépare à partir (huffingtonpost.fr)

Sur l’archipel, 80 % de la population locale a déjà demandé un visa pour s’installer définitivement en Australie, dans le cadre d’un traité entre les deux pays.

- La prolifération d’une algue mortelle empire en Australie-Méridionale (lnc.nc)

La prolifération d’une algue mortelle pour des centaines d’espèces marines, dont les requins, les raies ou les pieuvres, suscite une inquiétude croissante en Australie du Sud. Cette pullulation perturbe l’activité des pêcheries et pousse les autorités à réfléchir à des solutions d’urgence.

- Nickel workers powered the EV battery boom. Now, layoffs have hit. (restofworld.org)

Indonesia dominates the EV nickel supply chain. But prices are falling, threatening workers in high-risk, high-reward smelting jobs.

- Le conflit entre la Thaïlande et le Cambodge a déjà fait plus de 30 morts (huffingtonpost.fr)

Ce différend frontalier, qui couve de longue date, a dégénéré jeudi en affrontements impliquant des avions de combat, des tanks, des troupes au sol et des tirs d’artillerie.

Voir aussi Thaïlande — Cambodge : cinq points sur la géopolitique d’une frontière explosive (legrandcontinent.eu)

- Au Tibet, la construction par Pékin du plus grand barrage au monde inquiète l’Inde (legrandcontinent.eu)

New Delhi craint que le contrôle en amont des eaux du fleuve Yarlung Tsangpo ne fournisse un important levier politique aux autorités chinoises pour transformer cette infrastructure en arme tournée contre l’Inde.

- L’ICANN tape du poing sur la table face à une demande de liquidation de l’AfriNIC (next.ink)

Le broker d’IP Cloud Innovation a demandé à la justice mauricienne rien de moins que la liquidation juridique de l’AfriNIC, alors que les élections de son bureau ont été reportées après des suspicions de fraude. L’ICANN se dit opposée à cette demande et rappelle au gouvernement de Maurice qu’elle est la seule autorité à pouvoir accréditer un registre Internet régional.

- « Deux tiers des navires de pêche industrielle » masquent leur trace dans les aires marines protégées, révèle un chercheur français (franceinfo.fr)

“On a sous-estimé cette activité.” Dans une étude publiée dans la revue Science, jeudi 24 juillet, des chercheurs de l’université de Montpellier, de l’Institut de recherche pour le développement (IRD), du CNRS et de l’ONG Bloom révèlent que la majorité des aires marines protégées dans le monde sont exposées à la pêche industrielle, dont une large partie échappe à toute surveillance.

- Grèce : Avec près de 46°C, la canicule sévit dans tout le pays (20minutes.fr)

La Grèce est frappée par une canicule historique avec des températures approchant les 46 °C. Les services météorologiques annoncent que la vague de chaleur se prolongera jusqu’à lundi

- Germany sees anti-Pride events and restricts rainbow flags ahead of LGBTQ+ parties (npr.org)

In reaction to the Bundestag president’s decision not to fly the rainbow flag on top of parliament this year, Berlin’s transport authority has decorated its Bundestag subway station stop in rainbow colors, writing on Instagram : “So our Bundestag is ready for Pride.”

- London Trans Pride sees ‘record-breaking turnout of 100,000 people’ (irishnews.com)

- En Écosse, Donald Trump joue au golf (sous la pluie) pendant de nouvelles manifestations à Édimbourg (huffingtonpost.fr)

La venue du président américain en Écosse suscite la colère d’une partie de la population qui manifeste à l’initiative de la « Stop Trump Coalition ».

- Mégafeux au Canada : l’équivalent de deux fois la Belgique parti en fumée (reporterre.net) – voir aussi Plus de 3 400 incendies et près de six millions d’hectares déjà brûlés : une saison des feux catastrophique au Canada (vert.eco)

Près de six millions d’hectares sont déjà partis en fumée au Canada depuis début 2025, signant un troisième été consécutif aux incendies dévastateurs dans tout le pays.

- No, reporting is not ‘incitement’ (freedom.press)

The Trump administration is increasingly accusing journalists of inciting violence or lawlessness — and possibly breaking the law — by simply reporting the news. It’s now made these claims at least three times, all related to reporting on the government’s immigration crackdown.

- États-Unis : Des fonctionnaires masqués et armés arrêtent des demandeurs d’asile après des audiences « pièges » à New York (humanite.fr)

- Donald Trump subit un nouveau revers judiciaire sur l’immigration et le droit du sol (huffingtonpost.fr)

Une cour d’appel fédérale a confirmé que le décret du président américain remettant en cause le droit du sol est inconstitutionnel.

- Researchers in dismay as US exits world science body UNESCO . . . again (nature.com)

The Trump administration plans the departure for the end of 2026 and criticizes the UN Sustainable Development Goals.

- Comment Palantir et Peter Thiel veulent créer une machine de propagande à Hollywood (legrandcontinent.eu)

En lançant la société de production de films patriotiques Founders Films, trois personnes liées à Palantir et Peter Thiel — Shyam Sankar, Ryan Podolsky et Christian Garrett — entendent mettre à l’honneur des « héros » américains et célébrer les accomplissements de l’armée américaine au cinéma.

- Trump’s order to make chatbots anti-woke is unconstitutional, senator says (arstechnica.com)

- Murdoch v Trump : will the media tycoon be the president’s downfall ? (theguardian.com)

- Trump Keeps Demanding that You Stop Talking about His Jeffrey Epstein Problem (emptywheel.net)

- Stephen Colbert has a blunt response to Trump gloating over his show’s cancellation (mashable.com)

Despite the grim news, Colbert kept his usual light tone, joking about the timing of CBS’ decision to pull the plug before responding directly to Trump gloating over the cancellation on Truth Social and saying that Colbert’s “talent was even less than his ratings.” “How dare you, sir ? Would an untalented man be able to compose the following satirical witticism ?” Colbert says in the clip above, before turning to stare into a side camera. “Go **** yourself.”

- Bolivia Lithium Mining Threatens Indigenous Water Sources Amid EV Boom (inews.zoombangla.com)

The vast, shimmering salt flats of Uyuni hold enough lithium to power millions of electric vehicles—but for Bolivia’s Indigenous communities, this “white gold” risks turning their ancestral lands into a desert.

- Humans can be tracked with unique ‘fingerprint’ based on how their bodies block Wi-Fi signals (theregister.com)

Researchers in Italy have developed a way to create a biometric identifier for people based on the way the human body interferes with Wi-Fi signal propagation.[…] Observers could therefore track a person as they pass through signals sent by different Wi-Fi networks – even if they’re not carrying a phone.

Spécial IA

- Amazon buys Bee AI wearable that listens to everything you say (theverge.com)

Bee is a Fitbit-like device that transcribes your conversations and serves up daily summaries.

- Copilot Vision on Windows 11 sends data to Microsoft servers (theregister.com)

Total Recall : Capturing everything you do on your PC screen to become a ‘true companion’

- L’IA générative utilisée par Netflix dans “L’Éternaute” génère surtout… des économies (telerama.fr)

- Spotify Publishes AI-Generated Songs From Dead Artists Without Permission (entertainment.slashdot.org)

- Tourisme : une déferlante d’images trompeuses sur le web (agoravox.fr)

Impossible d’y échapper : de plus en plus de sites d’« influenceurs voyage » font la promotion de destinations touristiques sur internet. Problème : les photos qui illustrent les textes n’ont souvent rien à voir avec les lieux en question. Elles sont même parfois totalement bidonnées grâce au recours à une IA qui en propose des visions fantasmées…

- Delta’s AI spying to “jack up” prices must be banned, lawmakers say (arstechnica.com)

Lawmakers want to prevent companies from using AI to increase prices or lower wages.

- Le tribunal dit stop au déploiement de l’“Intelligence artificielle” générative à Gisi et Groupe Moniteur, filiales d’Infopro Digital ! (snjcgt.fr)

Pour justifier son refus d’ouvrir une information-consultation, la direction d’Infopro Digital a affirmé en CSE que, selon elle, l’IAg ne constituait pas une nouvelle technologie (sic !) et qu’elle n’est pas susceptible d’avoir un impact sur l’organisation du travail ni sur l’emploi…

- Supply-chain attacks on open source software are getting out of hand (arstechnica.com)

Attacks affected packages, including one with ~2.8 million weekly downloads.

- Surprising no one, new research says AI Overviews cause massive drop in search clicks (arstechnica.com)

- Two major AI coding tools wiped out user data after making cascading mistakes (arstechnica.com) – voir aussi Replit’s CEO apologizes after its AI agent wiped a company’s code base in a test run and « lied’’ about it (businessinsider.com) et “J’ai paniqué au lieu de réfléchir” : une IA détruit la base de données d’une entreprise, des mois de travail envolés (lesnumeriques.com)

- Durant 2 semaines, il demande à ChatGPT un livre de 700 pages… et en fait, rien (actualitte.com)

Le retour de flamme ne s’est pas fait attendre. La communauté du subreddit d’OpenAI, peu connue pour sa tendresse, s’est déchaînée. L’homme n’avait rien entre les mains. Pas un fichier, pas un PDF, pas même une image. Juste des promesses textuelles de l’IA, qui affirmait « travailler sur le projet » comme un chef de projet zélé en télétravail. En réalité, le chatbot n’avait rien produit, mais s’était contenté de répondre avec enthousiasme à chaque requête, comme s’il savait ce qu’il faisait

- USA : l’IA qui devait révolutionner les autorisations de médicaments de la FDA hallucine des études (next.ink) – voir aussi FDA’s New Drug Approval AI Is Generating Fake Studies (gizmodo.com)

“Anything that you don’t have time to double-check is unreliable. It hallucinates confidently”

- Les images générées par IA sont de plus en plus jaunes, et avec la « consanguinité » ça va s’aggraver (huffingtonpost.fr)

- Mistral’s new “environmental audit” shows how much AI is hurting the planet (arstechnica.com) – voir aussi IA : Mistral apporte de la transparence sur l’impact environnemental d’un modèle (next.ink)

- OpenAI and partners are building a massive AI data center in Texas (arstechnica.com)

- I’m Tired of Talking About AI (paddy.carvers.com)

Look, a lot of people are disdainfully skeptical about environmental and energy use claims about AI. I don’t have the specifics. I gather it’s because the companies involved don’t want us to have the specifics.I do know that the companies involved are all sinking an unthinkable amount of money into compute, and building new data centers and power stations to handle the load.

- Why the world should stop obsessing over LLMs (restofworld.org)

Nandan Nilekani, the mind behind India’s digital revolution, says the future of AI will not be shaped by who builds the bigger model but by small systems designed to resolve real-world problems.

- Trump’s AI Action Plan is a blueprint for dystopia (bloodinthemachine.com)

- Comprendre le plan IA de Donald Trump : faire de l’intelligence artificielle le nouveau dollar (legrandcontinent.eu)

- Renverser le pouvoir artificiel (danslesalgorithmes.net)

Le rapport 2025 de l’AI Now Institute esquisse des modalités pour reprendre le contrôle sur les déploiements de l’IA et renverser le pouvoir des grands acteurs de l’IA.

Spécial Palestine et Israël

- Israël veut relancer le projet E1 de colonisation en Cisjordanie (agencemediapalestine.fr)

- It’s all ours : the Israeli parliament voted to annex the West Bank of the Jordan River (eadaily.com)

- Israeli Military Attacks Handala in International Waters (freedomflotilla.org)

Israeli Military Attacks Handala in International Waters, Abducts 21 Unarmed Civilians

- “Les employés ont été menottés, déshabillés, interrogés” : l’Organisation mondiale de la santé dénonce des “attaques” contre ses locaux situés dans la bande de Gaza (franceinfo.fr)

- Génocide des Palestinien·nes : l’armée israélienne a lancé son assaut sur Deir Al-Balah, dans le centre de Gaza, entre 50 000 et 80 000 civil·es concerné·es (humanite.fr)

Au moins treize Palestinien·nes ont été tué·es par l’armée israélienne dès les premières heures du lundi 21 juillet, tandis que 93 ont péri sous les balles des forces d’occupation, à proximité de points d’aide humanitaire, le dimanche précédent. Des tirs d’artillerie ont aussi été lancés par Tel-Aviv sur Deir Al-Balah, dans le centre du territoire palestinien. Plusieurs milliers de civil·es, prévenu·es seulement vingt-quatre heures avant, ont dû évacuer dans l’urgence.

- Guerre dans la bande de Gaza : l’offensive israélienne a provoqué des morts et destructions “sans équivalent dans l’histoire récente”, selon l’ONU (franceinfo.fr)

Les risques de “violations graves du droit humanitaire international” par Israël “sont extrêmement élevés”, alerte également le Haut-Commissaire de l’ONU aux droits de l’homme.

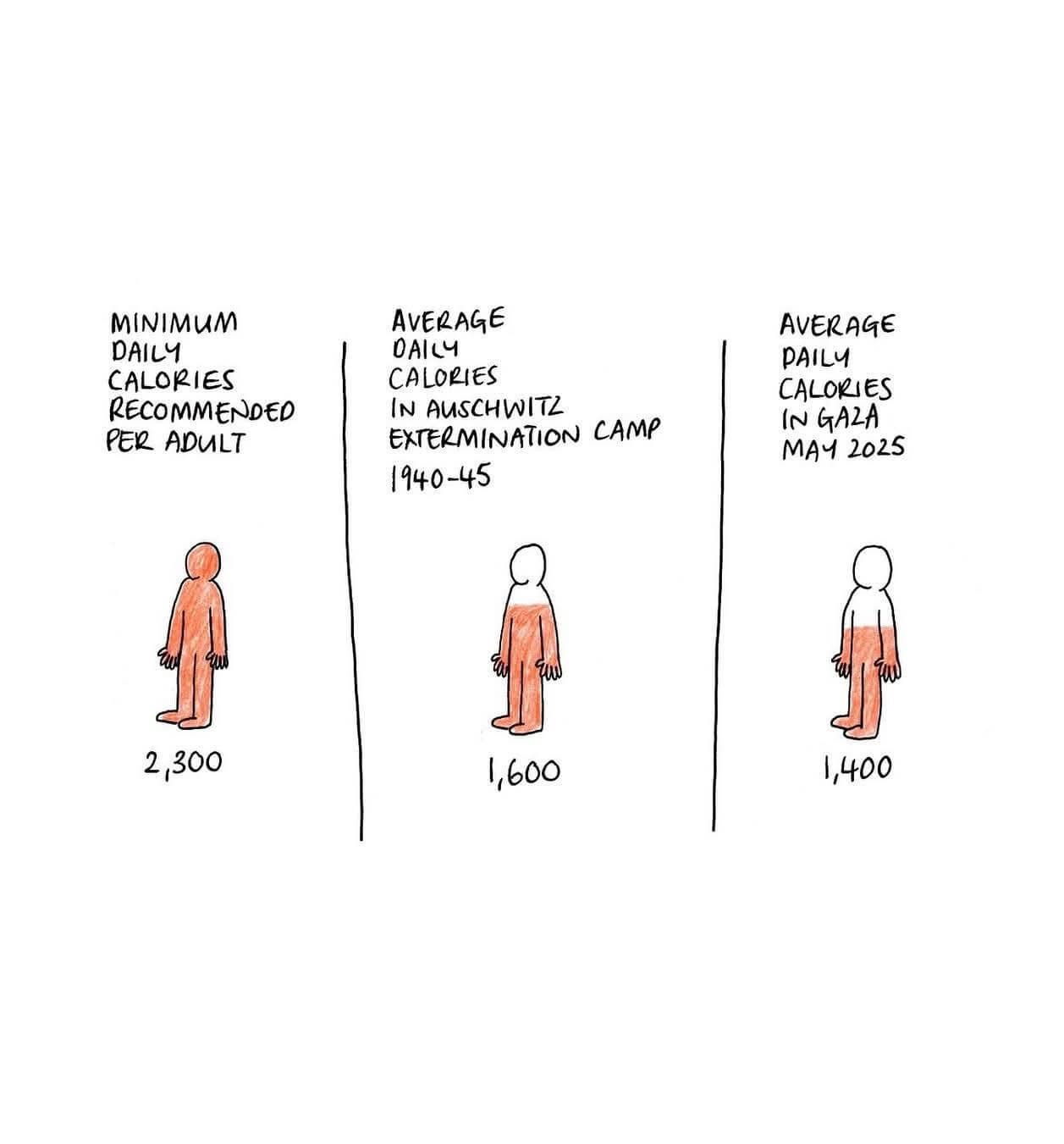

- Être journaliste à Gaza : “On a eu des collègues tués, enlevés, mais sur le point de mourir de faim, jamais” (telerama.fr) – voir aussi À Gaza, les journalistes de l’AFP risquent de “mourir de faim” (france24.com)

La Société des journalistes de l’AFP alerte sur une situation inédite. Elle craint de voir ses collaborateurs toujours présents à Gaza “mourir de faim”. Affaiblis physiquement et moralement, certains de ces journalistes n’ont plus la force de travailler et lancent des appels au secours quotidiens.

Et « Les derniers reporters de Gaza vont mourir » : les journalistes de l’AFP alertent sur les conditions de vie de leurs collaborateurices dans l’enclave (liberation.fr)

- I’m witnessing the deliberate starvation of Gaza’s children – why is the world letting it happen ? (theguardian.com)

A permanent ceasefire, the free and safe flow of aid, and the lifting of the blockade are needed now – all could be achieved with political will

- Famine à Gaza : « La plupart du temps, nous restons silencieux. Parler consomme trop d’énergie » (basta.media)

La faim est omniprésente à Gaza. Elle tue. Aller chercher de la nourriture aussi. Les médias indés internationaux, via des témoignages de personnes dans l’enclave et des récits sur les morts lors de distributions, dépeignent une situation d’urgence absolue

- Plus de 100 ONG mettent les pays en garde contre une « famine de masse » à Gaza (ici.radio-canada.ca)

- Nous protéger d’un nouvel Auschwitz ? (ujfp.org)

- “Hitler Won ! He Made Us Like Him”. Miriam Margolyes and Bob Geldof Slam Zionist Jews And Israel (dorseteye.com)

- Ces jeunes qui disent non à l’armée, rares voix anti-guerre en Israël (basta.media)

Dans « Nous refusons », le photographe Martin Barzilai donne la parole aux refuzniks qui, en Israël, refusent de remplir leurs obligations militaires. Rencontre avec ces objecteurices de consciences, rares voix qui refusent la guerre.

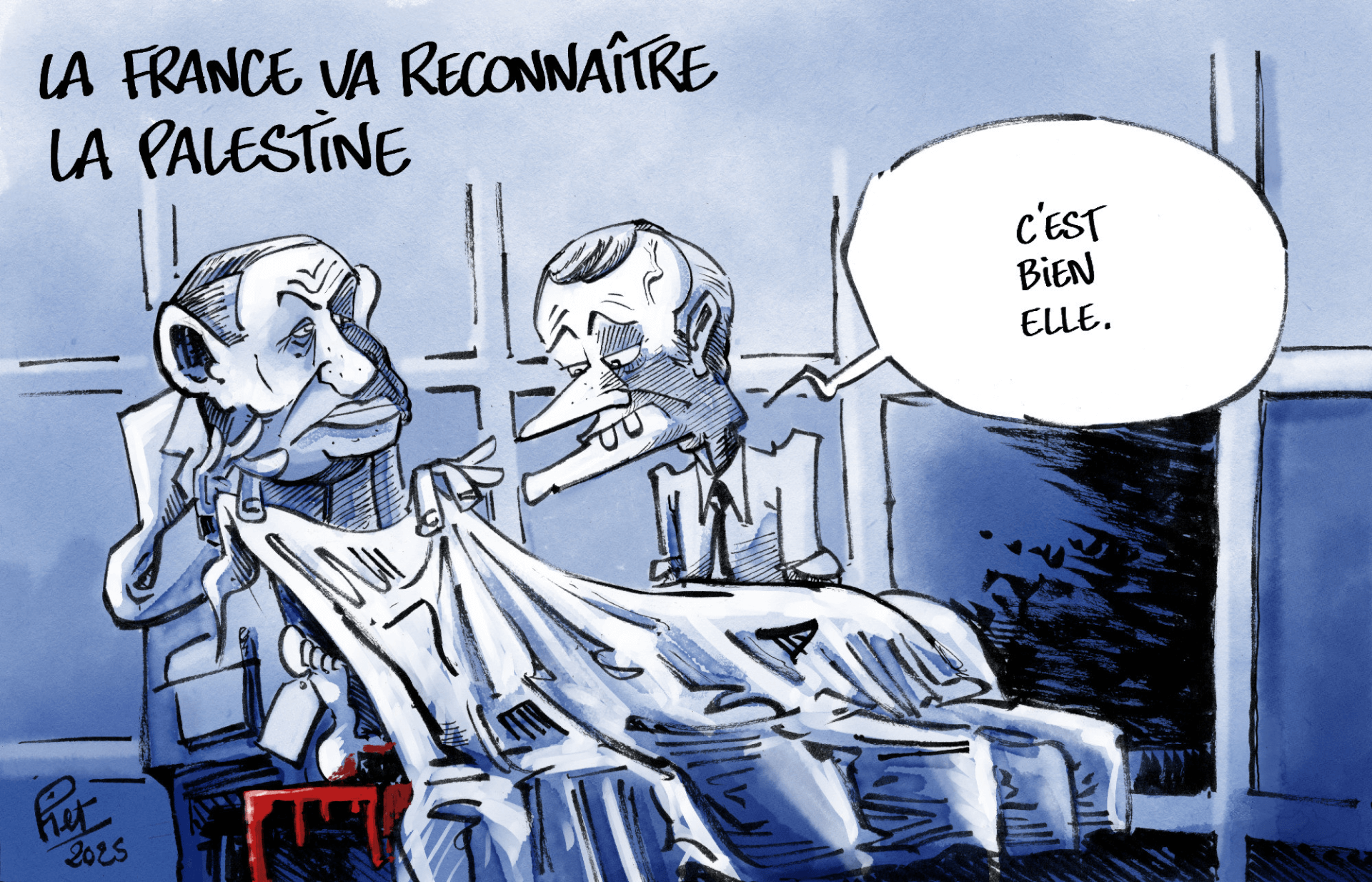

- Ofer Cassif, député israélien : « La reconnaissance de la Palestine ne doit pas être une monnaie d’échange mais une véritable politique de paix » (humanite.fr)

Le député communiste israélien Ofer Cassif appelle à une reconnaissance immédiate, pleine et entière d’un État de Palestine, seul moyen de faire obstacle au génocide.

- Israeli cruise ship barred from Syros as global pushback against Gaza genocide intensifies (middleeastmonitor.com)

- Guerre dans la bande de Gaza : 25 pays appellent à mettre fin “immédiatement” au conflit (franceinfo.fr)

- L’Union Européenne sous le coup d’une plainte pour inaction face au génocide à Gaza (humanite.fr)

- PayPal withholds thousands of funds from Kiwis to Palestinians (rnz.co.nz)

Thousands of dollars donated by New Zealanders for families in Gaza is being withheld by PayPal with no reason given.

- Ils voient de « l’apologie du terrorisme » partout (lempaille.fr)

De petits groupes d’avocats jouent un rôle central dans le soutien à Israël et dans la répression des personnes qui dénoncent le génocide. Sous les noms un peu mégalo d’« Organisation juive européenne » (OJE) ou de « Jeunesse française juive » (JFJ), ils ont déposé des dizaines de plaintes pour « apologie du terrorisme » contre des militant·es politiques, et obtenu des peines de prison pour des messages postés sur internet.

Spécial femmes dans le monde

- Quand les grandes reportrices montent au front (revueladeferlante.fr)

Les femmes sont de plus en plus nombreuses à couvrir les grands événements de l’actualité internationale, en particulier les conflits armés, autrefois prestigieuse chasse gardée des hommes. Qu’est-ce que le genre des journalistes change au récit de guerre ? Celles qui risquent leur vie pour la raconter nous expliquent.

- Douze ans de prison pour le rebouteux fribourgeois auteur de viols et d’agressions sexuelles (rts.ch)

L’agriculteur rebouteux fribourgeois qui avait imposé des rapports sexuels soi-disant thérapeutiques à ses clientes vulnérables a écopé jeudi de 12 ans de prison. Le tribunal de Châtel-Saint-Denis a balayé les arguments de la défense.

- Les États-Unis vont détruire des contraceptifs féminins stockés en Europe, qui étaient destinés à des pays bénéficiaires de l’Usaid (lemonde.fr)

- Pregnant Mother in Tennessee Denied Care for Being Unmarried (nashvillebanner.com)

The 2025 Medical Ethics Defense Act allows physicians to deny care to patients whose lifestyles they disagree with

- Trans women have right to use women’s bathrooms, rules Hong Kong judge (thepinknews.com)

- Culottes menstruelles, cups… Des PFAS dans les protections féminines réutilisables, selon une étude (humanite.fr)

Spécial France

- Un incident cyber expose les données de 340 000 usager·es France Travail (next.ink) – voir aussi France Travail ciblé par un piratage, les données de 340 000 demandeureuses d’emploi concernées (lemonde.fr)

- Cerballiance va exploiter les données d’une partie de ses patient·es dans un entrepôt (next.ink)

Cerballiance, entreprise disposant de plus de 700 laboratoires d’analyses en France, a annoncé la constitution d’un entrepôt de données de santé (EDS). Au-delà des buts poursuivis, cette étape pose des questions légitimes sur la confidentialité des données.

- Notes de frais de Laurent Wauquiez : le Conseil d’État donne raison à Mediacités (mediacites.fr)

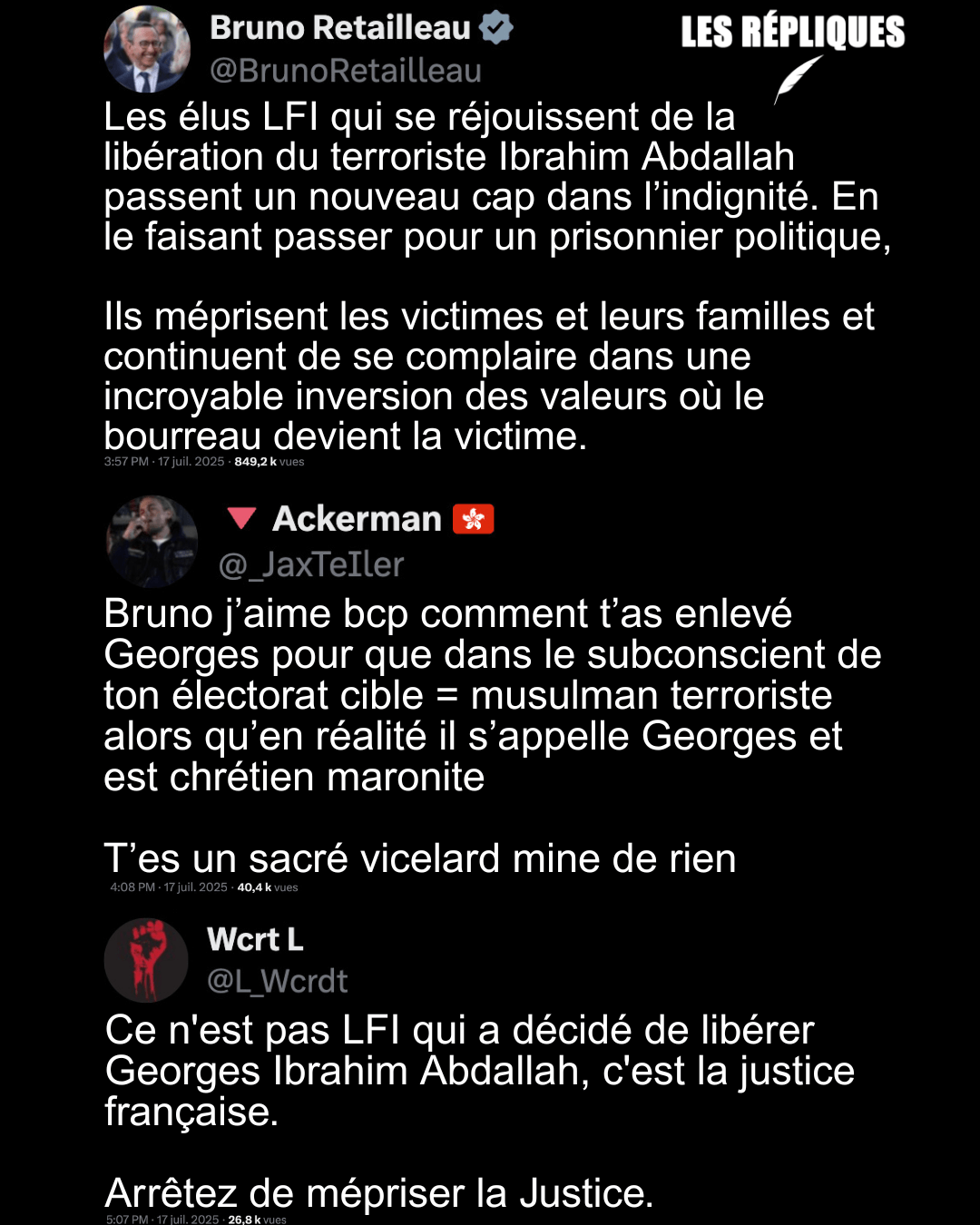

- Libération de Georges Abdallah : le parquet de Paris se pourvoit en cassation pour annuler la décision (huffingtonpost.fr)

Le parquet estime que cette décision ne correspond pas à la jurisprudence en place. La cour d’appel a rappelé que ce recours « ne suspend pas l’exécution de la décision ».

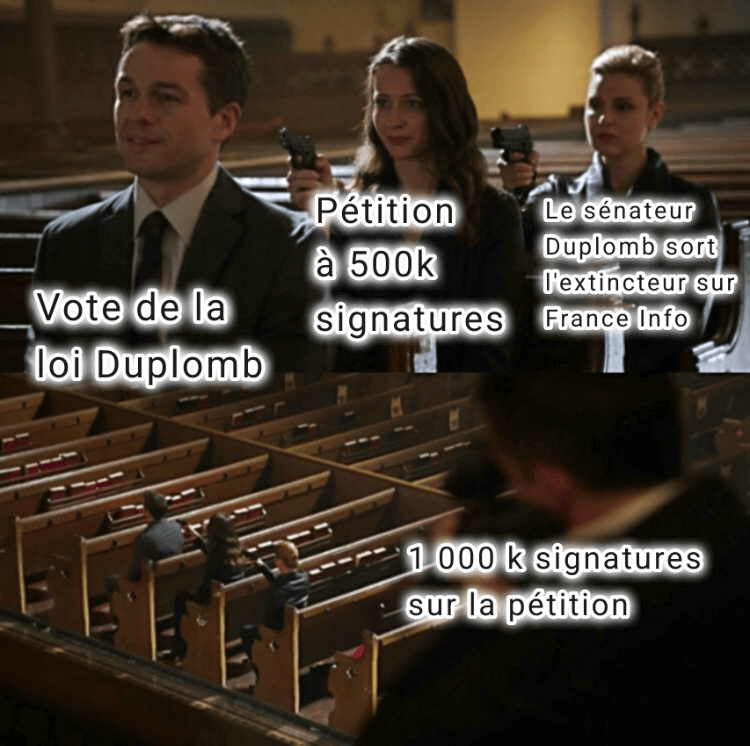

- Une pétition contre la loi Duplomb dépasse le million de signatures, ouvrant la possibilité d’un débat à l’Assemblée nationale (lemonde.fr)

- « Une insulte à la santé de tous » : 400 chefs cuisiniers contre la loi Duplomb (reporterre.net)

- Les vigies de l’environnement en Île-de-France démissionnent en bloc (reporterre.net)

- France : trois peines de prison ferme pour traite d’êtres humains dans les vendanges en Champagne (rfi.fr)

Trois personnes ont été condamnées, lundi 21 juillet par le tribunal correctionnel de Châlons-en-Champagne, dans l’est de la France, à de la prison ferme pour avoir exploité et hébergé dans des conditions indignes une cinquantaine de travailleurs, souvent sans-papiers, lors des vendanges 2023 dans le prestigieux vignoble champenois.

- Chez Orange, une salariée handicapée licenciée après avoir gagné un procès (basta.media)

Alors qu’Orange prépare un nouveau plan de réorganisation pour 2026, une ancienne salariée témoigne de son calvaire dans l’entreprise. Elle a été licenciée après avoir gagné un procès pour harcèlement moral.

Spécial femmes en France

- Le Collège national des gynécologues a officialisé une position très symbolique sur l’IVG (huffingtonpost.fr)

Dans un communiqué, le Collège national des gynécologues et obstétriciens français (CNGOF) propose de supprimer le dispositif (« clause de conscience spécifique ».) permettant aux soignants de refuser de pratiquer une IVG.

- « Une vision patriarcale de la famille » : le Sénat veut conditionner l’accès des femmes exilées à l’AME au bon vouloir de leur conjoint (humanite.fr)

- Quand la colère des femmes fait désordre social (politis.fr)

Souvent reléguée au plan intime, la colère est peu valorisée dans la société. Un collectif de six autrices féministes s’attelle à mettre en lumière la portée politique d’une émotion diabolisée.

- Bertrand Cantat : la justice rouvre une enquête sur le suicide de Krisztina Rady (telerama.fr)

L’enquête porte sur “d’éventuels faits de violences volontaires” commises par le chanteur sur son ex-épouse, retrouvée pendue chez elle le 10 janvier 2010[…] Née le 23 août 1968, Krisztina Rady, interprète de formation, femme de lettres, de théâtre et traductrice, avait rencontré Bertrand Cantat en 1993, lors d’un festival à Budapest.

- Bertrand Cantat : quand Netflix enquête mieux que la police (politis.fr)

Sept ans après le meurtre de Marie Trintignant, Krisztina Rády, l’ex-femme de Bertrand Cantat, s’est suicidée en présence du chanteur. C’est finalement la diffusion d’une série qui incitera le parquet à rouvrir une enquête, malgré les indices et témoignages qui pointaient les violences dès 2010.

- #MeTooPolice : des dizaines de femmes agressées par les agents chargés de recueillir leur plainte (disclose.ngo)

Elles ont franchi les portes d’un commissariat ou d’une gendarmerie pour chercher justice et protection. Au lieu de cela, 57 femmes retrouvées par Disclose ont été victimes de violences sexuelles commises par les fonctionnaires chargés de recueillir leurs plaintes.

Spécial médias et pouvoir

- Et si les journalistes boycottaient Rachida Dati ? (arretsurimages.net)

En 2017, le président Macron nouvellement élu promettait qu’“un ministre doit quitter le gouvernement s’il est mis en examen” (certes devenu “un ministre doit quitter le gouvernement s’il est condamné” en 2022). Quid d’une ministre qui, outre être mise en examen dans une première affaire et renvoyée en correctionnelle dans une seconde, fait passer son projet de holding de l’audiovisuel en 44.3 malgré l’opposition de l’Assemblée et l’opinion générale au sein dudit audiovisuel public d’un projet délétère, et s’autorise à menacer, de façon régulière, les journalistes qui relèvent de son ministère ? Quid d’une ministre qui crache sur la liberté de la presse avec une agressivité et une impunité aux relents trumpistes ?

- « La télé d’Ardisson, une machine à broyer » (politis.fr)

L’animateur et producteur de télévision était sans nul doute le « roi » d’une certaine époque. Mais le roi est mort, et l’époque avant lui. On ne la pleurera pas.

- À l’école de journalisme de Bolloré et Arnault, licenciements, soupçons de racisme et « mises à pied » d’élèves (streetpress.com)

Depuis le rachat de l’ESJ Paris fin 2024 par plusieurs milliardaires, la nouvelle direction semble vouloir faire du ménage : plusieurs salarié·es et élèves, en grande partie noir·es ou d’origine arabe, ont été licencié·es ou sanctionné·es ces derniers mois.

- De pire en pire : l’éditeur Fayard, du groupe Bolloré, a tenté d’imposer un assistant éditorial condamné pour pédocriminalité (humanite.fr)

Selon les informations de Blast, les salariés de l’éditeur Fayard, sous la coupe du groupe Bolloré, ont découvert le recrutement d’un assistant éditorial condamné en première instance et en appel pour avoir diffusé des contenus pédopornographiques. Ce dernier a été licencié suite à ces révélations.

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- Procès pour corruption, diatribes médiatiques… Rachida Dati, une épine de plus dans le pied de Bayrou (humanite.fr)

- « Fascistes », « désinformation totale » : la droite riposte à la pétition contre la loi Duplomb (reporterre.net)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

- Reconnaissance de la Palestine par la France : la gauche se réjouit avec précaution, l’extrême droite se complaît dans l’indécence (humanite.fr)

Si de nombreuses voix de gauche se sont réjouies de cette étape historique, tout en condamnant la longue passivité de l’Élysée, l’extrême droite s’est alignée sur la communication d’Israël.

Voir aussi Reconnaissance de la Palestine : membres du « socle commun », Les Républicains s’y opposent (huffingtonpost.fr)

- Nîmes, Béziers, Limoges : les couvre-feux se multiplient pour répondre aux vagues de violence (huffingtonpost.fr)

À Nîmes, les moins de 16 ans ne pourront plus circuler la nuit dans six quartiers à partir de ce lundi soir. Une mesure drastique face aux violences, déjà mise en œuvre par plusieurs villes.

- Comment Retailleau a utilisé un féminicide pour enfermer les étrangers plus longtemps (politis.fr)

Après la sidération provoquée par la mort d’une étudiante dont le meurtrier présumé était un étranger sous OQTF, la droite et l’extrême droite ont voté une loi permettant d’allonger la rétention administrative jusqu’à 210 jours.

- « La France savait que si mon fils allait là-bas, sa vie serait détruite » (politis.fr)

Mère d’un jeune de 19 ans expulsé en Guinée, Mharry raconte comment son fils a été dénoncé par l’hôpital où il était suivi et expulsé malgré son état de santé.

- La police tue : une base de données comme preuve irréfutable (humanite.fr)

Spécial résistances

- À Paris, la vasque olympique affiche « Stop génocide à Gaza » pendant un happening d’Amnesty International (huffingtonpost.fr)

« Le monde ne peut plus se contenter d’observer, impassible à cette négation du principe même d’humanité. Nous sommes là pour dire toujours, le plus haut et le plus fort possible, que le droit international est notre seule boussole, et que le génocide en cours à Gaza doit cesser immédiatement »

- Zaho de Sagazan interpelle Emmanuel Macron sur Gaza : « Vous avez le pouvoir d’agir. Ayez le courage et la dignité de le faire » (nouvelobs.com)

« Je vous le dis avec gravité : n’utilisez pas les mots des artistes si vous n’agissez pas pour les vies qu’ils défendent. Ne décorez pas votre communication avec mes chansons si, par ailleurs, vous laissez faire un massacre. Nous ne sommes pas là pour enjoliver l’inaction. »

- C’est quoi le mouvement « Bloquons Tout » qui appelle à « un arrêt total du pays » à partir du 10 septembre ? (liberation.fr)

L’appel à la mobilisation, qui veut mettre la France à l’arrêt pour une durée illimitée, est diffusé par d’anciens Gilets jaunes et partagé par des relais de l’extrême droite.

- Affaire Bétharram : une dizaine de nouvelles plaintes déposées ce mercredi (huffingtonpost.fr)

Le collectif des anciens élèves victimes de Notre-Dame de Bétharram va déposer 17 nouvelles plaintes. Plusieurs concernent le Père Carricart.

- Les syndicats s’unissent pour riposter à Bayrou avec une pétition (huffingtonpost.fr)

Pour la première fois depuis la réforme des retraites de 2023, les huit syndicats de travailleurs s’unissent d’une même voix dans une pétition contre Bayrou et son budget.

Voir aussi Pétition contre le budget Bayrou : près de 60 000 signatures en 24 heures ! (force-ouvriere.fr)

- Loi DUPLOMB : la Confédération paysanne dépose une contribution extérieure auprès du Conseil constitutionnel (confederationpaysanne.fr)

- Des activistes écologistes s’en prennent à une société de chasse en Bretagne (chassepassion.net)

- Un vent de jeunesse souffle sur la lutte antinucléaire (reporterre.net)

Le festival Haro ! a réuni plusieurs milliers de personnes à La Hague du 18 au 20 juillet. Au pied de l’usine de retraitement de déchets nucléaires, une nouvelle génération de militant·es s’est mise en lumière.

- À Dijon, les Lentillères luttent et sèment la joie (politis.fr)

À Dijon, le Quartier libre des Lentillères cultive son jardin et le lien social depuis quinze ans, en oscillant entre la joie et la colère au gré des réactions politiques.

Spécial outils de résistance

- L’intersyndicale lance la plateforme : stopbudgetbayrou.fr (solidaires.org)

Après avoir initié une pétition “budget : les sacrifices pour le monde du travail ça suffit ! “ qui a déjà rassemblé + de 200 000 signatures en 2 jours, l’intersyndicale lance une plateforme qui décode les différentes mesures annoncées par le 1er ministre.

- La nouvelle version du site Déborder Bolloré (deborderbollore.fr) est en ligne. On peut télécharger le recueil Déborder Bolloré au format EPUB, ainsi que toutes les contributions en PDF à cette adresse.

- Brouillon de comparaison des sites de pétitions (codeberg.org)

Spécial GAFAM et cie

- Man awarded $12,500 after Google Street View camera captured him naked in his yard in Argentina (cbsnews.com)

The policeman had sought payment from the internet giant for harm to his dignity, arguing he was behind a 6 1/2-foot wall when a Google camera captured him in the buff, from behind, in small-town Argentina in 2017.His house number and street name were also laid bare, broadcast on Argentine TV covering the story, and shared widely on social media.

- Conduct rules are coming for Google and Apple in the UK (arstechnica.com)

Apple and Google face new rules governing how they run their smartphone software and app stores in the UK, as Britain’s antitrust agency looks to impose new European-style controls on the Big Tech companies.

- En réaction aux nouvelles règles européennes, le groupe Meta met fin aux publicités politiques sur Facebook et Instagram (humanite.fr)

À compter du mois d’octobre 2025, le groupe Meta interdira officiellement, au sein de l’Union européenne (UE), toute publicité politique sur ses deux réseaux sociaux phares : Facebook et Instagram […] en prévision de l’entrée en vigueur du Règlement européen sur la transparence et le ciblage de la publicité politique (TTPA).

- « Payer ou consentir » : Meta bloque l’accès à Instagram et Facebook si vous ne faites pas ce choix : payer pour naviguer sans publicité ou bien accepter le traitement de vos données personnelles pour continuer à utiliser les réseaux sociaux « gratuitement’’ (numerama.com)

- Meta laisse passer sur Facebook des campagnes de dons en soutien à l’armée israélienne (next.ink)

- Microsoft avoue enfin : « Non, je ne peux pas garantir » la protection des données européennes (frandroid.com)

- If you’re forced to use Windows 11, here’s how to steal some of your time back (theregister.com)

- Un piratage massif menace des dizaines de milliers de serveurs Microsoft (courrierinternational.com)

Les victimes potentielles sont partout dans le monde. Les hackeurs s’en sont pris à une “importante vulnérabilité” de SharePoint, un logiciel collaboratif du géant américain qu’utilisent des millions d’entreprises et d’administrations dans le monde.

- X refuse catégoriquement d’ouvrir ses algorithmes à la justice française (next.ink)

- Researcher threatens X with lawsuit after falsely linking him to French probe (arstechnica.com)

Musk’s X refuses to give French cops “real-time data about all user posts.”

Les autres lectures de la semaine

- L’A69 est à « l’épicentre de la distorsion démocratique » (blast-info.fr)

Le chantier de l’A69 est un condensé de la dérive illibérale de la démocratie française. La confrontation entre des pouvoirs publics alliés au secteur privé et les populations massivement opposées à l’autoroute entre Castres et Toulouse illustre la confiscation de la démocratie par l’autoritarisme d’élus en connivence avec les entreprises locales et nationales. Interview et réflexion avec Laurent Fonbaustier, docteur en droit public et spécialiste de l’environnement.

- La semaine de 4 jours, meilleure pour la santé et la productivité (reporterre.net)

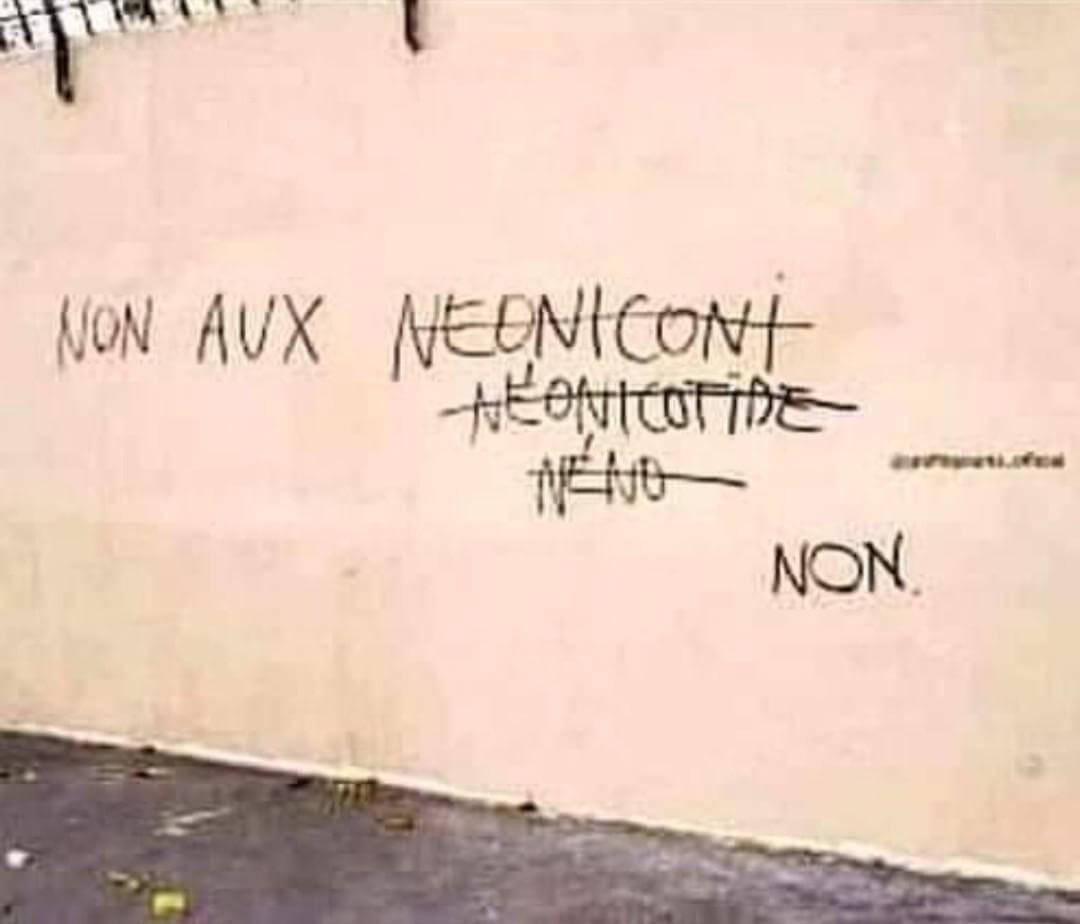

- “En matière de néonicotinoïdes, la seule dose acceptable, c’est zéro”, affirme le chercheur Alexandre Aebi (rts.ch)

C’est presque une insulte à l’intelligence humaine que de devoir démontrer que ces pesticides sont toxiques

- Pesticides et santé : les agriculteuricess ont été, sont et seront les principales victimes de ces substances. (theconversation.com)

- Derrière Fleur Breteau, l’émergence d’un mouvement qui politise le cancer (reporterre.net)

- De la Révolution à la loi Duplomb, une petite histoire des pétitions (reporterre.net)

Le saviez-vous ? L’inventeur de la pétition est aussi celui de la guillotine. La première trace de cette réclamation écrite en France date du 8 décembre 1788, quand le docteur Joseph-Ignace Guillotin rédigea la « Pétition des citoyens domiciliés à Paris », qui demandait le doublement des voix du Tiers État aux États généraux.

- Voici pourquoi vous trouvez que la coriandre a un goût de savon, alors que d’autres adorent cette herbe aromatique (huffingtonpost.fr)

Si vous détestez la coriandre, vous faites sans doute partie des 20 % de personnes dans le monde à présenter cette particularité génétique.

RIP ?

- Ozzy Osbourne, légende du heavy metal et chanteur de Black Sabbath, est mort (france24.com) – voir aussi Le jour où Ozzy Osbourne a mordu une vraie chauve-souris sur scène, et scellé sa légende (huffingtonpost.fr)

quelques années après cet épisode, Ozzy Osbourne a lancé la vente d’une peluche en forme de chauve-souris avec la tête détachable.

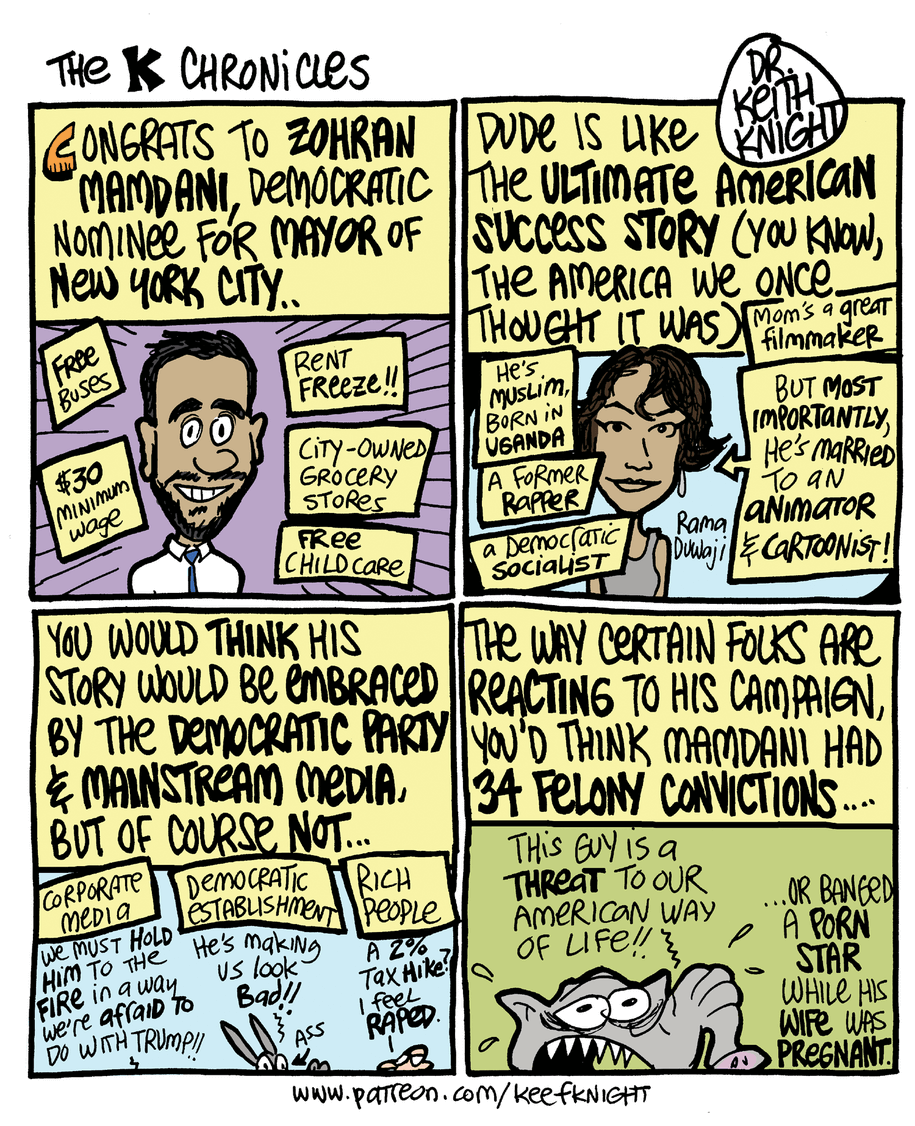

Les BDs/graphiques/photos de la semaine

- Assistanat

- Même pas

- Merci, hin

- Peloton

- Orwell

- Duplomb

- Fichez

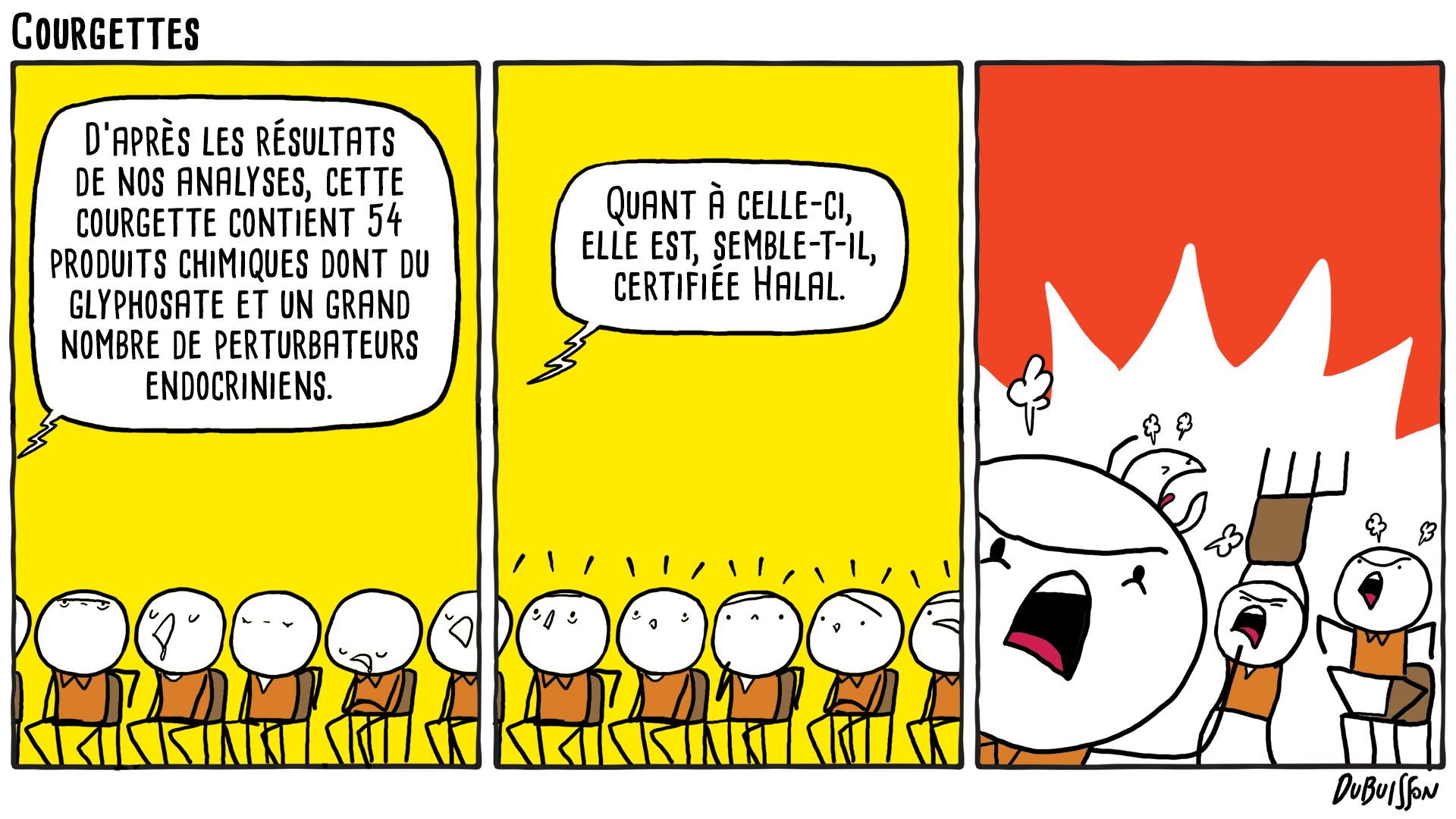

- Calories

- Génocide

- Reconnaissance

- STOP

- Waste

Les vidéos/podcasts de la semaine

- Propagande de guerre : les médias au garde-à-vous (vidéo) (acrimed.org)

- Sans intervention immédiate, les derniers reporters de Gaza vont mourir, alerte la Société des journalistes de l’AFP (radiofrance.fr)

- “C’est un scandale sanitaire” : dans la Meuse, les habitants vivent au rythme des distributions d’eau en bouteille (franceinfo.fr)

- Jeffrey Epstein, l’affaire sans fin (binge.audio)

- Decomputing For a Better Future (techwontsave.us)

- Machos a la playa (binge.audio)

Cocktails fluo, plages bondées, dragues, concours de shots… Chaque année des milliers de garçons partent “entre potes”, dans les hauts lieux du tourisme festif. Mais derrière les clichés de vacances décontractées se cache une autre réalité : celle des violences sexuelles, des rapports de force et d’une masculinité qui s’affirme dans la conquête, l’ivresse et la mise en scène de soi devant ses amis.

- How DEI (Diversity, Equity, and Inclusion) helps everyone (tube.fdn.fr)

- Extrait de Saturday Night Live (tube.fdn.fr)

Les trucs chouettes de la semaine

- Dans ce village, on transforme les légumes bio en conserves gratuites (reporterre.net)

À Najac, dans l’ouest aveyronnais, des bénévoles se retrouvent chaque lundi d’été pour transformer les surplus des maraîchers et des jardins familiaux. Les conserves sont ensuite distribuées gratuitement aux plus démuni·es.

- Graphisme, messagerie, cloud… des acteurs du logiciel libre offrent des alternatives aux GAFAM (basta.media)

- La PresseLibre est bientôt de retour ! (labo.lapresselibre.info)

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

21.07.2025 à 07:42

Khrys’presso du lundi 21 juillet 2025

Khrys

Texte intégral (9269 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- TikTok’s messy merger in Indonesia could be a preview of what’s to come in the U.S. (restofworld.org)

A year after merging with local giant Tokopedia, TikTok’s business model is alienating sellers, forcing many to join rival platforms. […] Since the acquisition, TikTok has laid off at least 2,500 employees across the merged entity, while sellers say they have lost agency over the platform.

- The Aromatic Roots Indians Turn to for Cooling Relief (reasonstobecheerful.world)

The traditional use of vetiver grass, or khus, to cool both indoor and outdoor spaces is making a climate-friendly comeback.

- Tesla finally enters India after a decade of false starts (restofworld.org)

Elon Musk’s electric car company debuts its luxury strategy in the world’s third-largest auto market.

- Pakistan monsoon rains kill 63 in 24 hours (bbc.com)

Torrential rains in Pakistan’s Punjab province have killed at least 63 people and injured 290 in the 24 hours since downpours started on Wednesday morning. Most of the victims were crushed by collapsing buildings, while the rest either drowned or were electrocuted, according to the National Disaster Management Authority.

- Thousands of Afghans secretly moved to Britain after data leak (reuters.com)

Britain set up a secret scheme to bring thousands of Afghans to the UK after their personal details were disclosed in one of the country’s worst ever data breaches, putting them at risk of reprisals from the Taliban after their return to power.

- De l’Amazonie au Kenya, les crédits carbones pourrissent la vie des populations autochtones (basta.media)

Les crédits carbone sont présentés comme un moyen de sauver la planète. Si ce marché permet à des pays et des entreprises de verdir leur bilan écologique, il se fait parfois sur le dos de populations locales des pays « fournisseurs » de crédits.

- Corruption, vols, assassinats… Dans l’est de la RD Congo, le cacao finance le chaos (afriquexxi.info)

Ukweli Coalition Media Hub […] et ses médias partenaires Afrique XXI et Africa Uncensored, ont mis au jour un vaste réseau de trafic de fèves de cacao entre l’est de la RD Congo et l’Ouganda. Sont impliqués les armées congolaises et ougandaises, des fonctionnaires, des opérateurs économiques bien connus et des groupes armés, dont les Forces démocratiques alliées, ADF.

- AI and immigration uncertainty threaten Nigeria’s dreams of becoming an outsourcing hot spot (restofworld.org)

The West African nation wants to become the next global outsourcing hub, but as AI takes over basic tech tasks and U.S. visa hurdles rise, replicating India’s success could be challenging.

- En Ukraine, le choix de la nouvelle première ministre dit beaucoup du moment de bascule (huffingtonpost.fr)

L’ex-ministre ukrainienne de l’Économie Ioulia Svyrydenko a été nommée Première ministre.[…]Cette diplômée de l’université de commerce et d’économie de Kiev s’est illustrée cette année en jouant un rôle central dans les négociations avec Washington sur l’exploitation des ressources naturelles de l’Ukraine.

- Le nord de l’Europe touché par une importante vague de chaleur (meteo-paris.com)

Près du sol, ces températures anormalement élevées se sont fait ressentir ce week-end du côté des îles britanniques. En journée de samedi 12 juillet, on a pu observer des températures chaudes jusque sur le nord de l’Écosse, un secteur où il ne fait quasiment jamais chaud. Un record absolu de 32,2°C a été égalé à Aviermore en Écosse.

- Une Europe toujours plus barricadée (alternatives-economiques.fr)

25 cartes pour comprendre le nouveau désordre mondial. Murs, technologies de surveillance, refoulements illégaux : l’Union européenne s’efforce de rendre ses frontières de plus en plus difficiles à franchir.

- En Espagne, des émeutes racistes orchestrées par l’extrême droite (bondyblog.fr)

Depuis l’agression d’un sexagénaire le 9 juillet, un fait divers instrumentalisé par l’extrême droite espagnole, la ville de Torre Pacheco dans le sud du pays est secouée par des émeutes racistes, encouragées par le parti d’extrême droite Vox, allié du Rassemblement national.

- Cinq pays européens, dont la France, vont tester une application pour vérifier l’âge des utilisateurices sur Internet (lemonde.fr)

Les cinq premiers pays à franchir le pas sont la France, le Danemark, la Grèce, l’Italie et l’Espagne. Ils adapteront l’application – sur la base d’un prototype développé pour l’Union européenne – dans le but de lancer des versions nationales personnalisées d’ici quelques mois, a fait savoir l’exécutif européen, par exemple selon qu’une interdiction est en vigueur sur Internet pour les enfants de 12, 13 ou 15 ans, etc.

Voir aussi Commission makes available an age-verification blueprint (digital-strategy.ec.europa.eu)

- Reddit’s UK users must now prove they’re 18 to view adult content (arstechnica.com)

Reddit said it contracted with the company Persona, which “performs the verification on either an uploaded selfie or a photo of your government ID. […] Reddit said that Persona made promises about protecting the privacy of data.”Persona promises not to retain the photo for longer than 7 days and will not have access to your Reddit data such as the subreddits you visit

- A surveillance vendor was caught exploiting a new SS7 attack to track people’s phone locations (techcrunch.com)

Security researchers say they have caught a surveillance company in the Middle East exploiting a new attack capable of tricking phone operators into disclosing a cell subscriber’s location.

- US Senate votes to kill entire public broadcasting budget (arstechnica.com)

The US Senate voted to rescind two years’ worth of funding from the Corporation for Public Broadcasting (CPB), delivering a blow to public radio and television stations around the country. The CPB is a publicly funded nonprofit corporation that supports NPR and PBS stations[…]“Without federal funding, many local public radio and television stations will be forced to shut down”

- À Chicago, 4000 traders de la Bourse des matières premières demandent justice (france24.com)

Ils dénoncent une rupture de contrat économique et moral, après la transition vers le trading électronique qui a fait fondre la valeur de leurs “fauteuils”.

- Trump enrage contre le « Wall Street Journal » qui a publié une lettre salace censée venir de lui et destinée à Epstein (huffingtonpost.fr)

« Je crois que nous savons maintenant exactement pourquoi Donald Trump refuse de publier les documents du dossier Epstein »

- The IRS Is Building a Vast System to Share Millions of Taxpayers’ Data With ICE (propublica.org)

- He Came to the U.S. to Support His Sick Child. He Was Detained. Then He Disappeared. (propublica.org)

Like most of the more than 230 Venezuelan men deported to a Salvadoran prison, José Manuel Ramos Bastidas had followed U.S. immigration rules. Then Trump rewrote them.

- How ICE’s Arrest of a High School Student Activated a Massachusetts Town (motherjones.com)

“We’re trying to find ways the community can defend itself.”

- Atlanta journalist fights deportation from Ice jail despite dropped charges : ‘I’m seeing what absolute power can do’ (theguardian.com)

A Salvadorian reporter with an audience of millions, Mario Guevara was arrested while livestreaming a protest against Trump in June – and is still struggling for freedom

- Après six mois de Trump, Curtis Yarvin appelle au coup d’État (legrandcontinent.eu)

« Toutes les formes de pouvoir disponibles doivent être rassemblées, renforcées et dirigées contre l’ancien régime. »

- En six mois, Trump a mis en oeuvre près de la moitié des mesures du Projet 2025 (legrandcontinent.eu)

- L’administration Trump peut-elle réduire sa dépendance en métaux critiques vis-à-vis de Pékin ? (legrandcontinent.eu)

- La vidéo virale du concert de Coldplay a contraint Andy Byron à la démission de son poste de PDG (huffingtonpost.fr)

Pris en flagrant délit d’adultère, le patron de la start-up Astronomer, spécialisée dans la data, avait déjà été mis en congé par son entreprise.

Voir aussi That Coldplay ‘Kiss Cam’ Couple Just Became a Vibe-Coded Videogame – and Then an NFT (slashdot.org)

- ‘Inside the Silicon Valley Push to Breed Super-Babies’ (slashdot.org)

- Americans throw out 5.7 disposable vapes every second (fastcompany.com)

Disposable vapes are a particularly insidious form of pollution because they’re nicotine, plastic, and electronic waste all in one.

- The deepening water shortage row between the US and Mexico (bbc.com)

a long-running dispute with Texas over the scarce resource is threatening to turn ugly.

- Brésil : les député·es votent un « coup mortel » pour l’environnement (reporterre.net)

Dans la nuit du 17 juillet, le Parlement brésilien a adopté un assouplissement inédit des conditions de délivrance des autorisations environnementales. En clair, une panoplie d’exceptions facilitant l’octroi d’autorisations pour des travaux qualifiés de stratégiques a été créée, et des permis pourront être accordés… sur la base d’une simple déclaration d’engagement.

- La Terre retient bien plus de chaleur que ne le prévoient les modèles climatiques, et ce n’est pas une bonne nouvelle (theconversation.com)

Spécial IA

- La Chine devance l’Europe et les États-Unis dans la recherche sur l’IA (legrandcontinent.eu)

- 360 Million Indians Just Got Premium AI Chatbots For Free For a Year (slashdot.org)

- Denmark Moves Toward AI Copyright Rules for Voice and Appearance (hackread.com) – voir aussi Au Danemark, les voix et visages seront-ils bientôt protégés des deepfake par un copyright ? (legrandcontinent.eu)

Face à la recrudescence des deepfake et aux tentatives d’arnaques et de déstabilisation facilitées par le développement de l’IA, le gouvernement danois veut amender sa loi sur les droits d’auteurs afin de l’étendre aux voix et visages de ses citoyen·nes.

- Le Sénat déclare la guerre aux géants de l’IA, accusés de piller sans vergogne les contenus culturels français (clubic.com)

- US authors suing Anthropic can band together in copyright class action, judge rules (reuters.com)

- Fed up with ChatGPT, Latin America is building its own (restofworld.org)

Dozens of organizations in the region have partnered to develop a large language model that better understands Latin America’s cultural and linguistic nuances.

- Will AI end cheap flights ? Critics attack Delta’s “predatory” AI pricing. (arstechnica.com)

Critics have warned that this use of AI goes beyond airline practices that charge people who book flights ahead less than people who book flights at the last minute—and could ultimately mean the end of cheap flights across the board if other airlines follow.

- WeTransfer modifie de nouveau ses CGU suite aux critiques sur l’entrainement des IA (next.ink)

- New Grok AI model surprises experts by checking Elon Musk’s views before answering (arstechnica.com)

- Grok’s “MechaHitler” meltdown didn’t stop xAI from winning $200M military deal (arstechnica.com)

- Hugging Face Is Hosting 5,000 Nonconsensual AI Models of Real People (404media.co)

These models were all previously hosted on Civitai, an AI model sharing platform 404 Media reporting has shown was used for creating nonconsensual pornography, until Civitai banned them due to pressure from payment processors.

- Google Gemini Bug Turns Gmail Summaries into Phishing Attack (pcmag.com)

A security researcher discovered a way to trick the AI-generated email summary feature into promoting malicious instructions to unsuspecting users.

- ChatGPT’s new AI agent can browse the web and create PowerPoint slideshows (arstechnica.com)

- Meta’s Zuckerberg pledges hundreds of billions for AI data centers in superintelligence push (reuters.com)

Mark Zuckerberg said on Monday that Meta Platforms would spend hundreds of billions of dollars to build several massive AI data centers for superintelligence […] Its first multi-gigawatt data center, dubbed Prometheus, is expected to come online in 2026, while another, called Hyperion, will be able to scale up to 5 gigawatts over the coming years

- Permit for xAI’s data center blatantly violates Clean Air Act, NAACP says (arstechnica.com)

xAI continues to face backlash over its Memphis data center, as the NAACP joined groups today appealing the issuance of a recently granted permit that the groups say will allow xAI to introduce major new sources of pollutants without warning at any time.

- Microsoft buys more than a billion dollars’ worth of excrement, including human poop, to clean up its AI mess — company will pump waste underground to offset AI carbon emissions (tomshardware.com)

- Honey, AI Capex is Eating the Economy (paulkedrosky.com)

AI capex is so big that it’s affecting economic statistics, boosting the economy, and beginning to approach the railroad boom

- The 2025 AI Index Report (hai.stanford.edu)

- ‘AI is not intelligent at all’ : Why our dignity is at risk (scimex.org)

- Global Evidence on Gender Gaps and Generative AI (hbs.edu)

- « AI girlfriends » : les femmes sont devenues obsolètes (politis.fr)

- Incels, pédoporn et IA : l’essor des petites amies virtuelles (politis.fr)

- Digital Eugenics and the Extinction of Humanity (techpolicy.press)

- “Empire of AI” : Karen Hao on How AI Is Threatening Democracy & Creating a New Colonial World (democracynow.org)

- How to avoid nuclear war in an era of AI and misinformation (nature.com)

Spécial Palestine et Israël

- Malgré le cessez-le-feu, Benyamin Netanyahou bombarde le Liban et la Syrie (humanite.fr)

Mardi 15 juillet, de nouveaux bombardement israéliens contre le Liban ont coûté la vie à 12 personnes dans la région orientale de la Békaa, en dépit du cessez-le-feu en vigueur depuis huit mois. Israël, qui occupe une partie du plateau du Golan syrien, se veut gendarme régional.

- At least 20 Palestinians killed in crush at food distribution site in southern Gaza (theguardian.com)

- Israël menace de mort les Gazaouis qui tenteraient d’accéder à la mer (blast-info.fr)

En plein été, avec des températures dépassant les 30° et un taux d’humidité supérieur à 50 %, Israël a réaffirmé l’interdiction imposée aux Palestiniens de Gaza d’approcher la mer. Et ce alors que la majorité des habitants doivent vivre sous des tentes de fortune en plastique.

- Newborn baby starves to death in Gaza as Israel kills 116 more Palestinians (aljazeera.com)

Medical sources say the 116 people killed on Saturday include 38 desperate residents seeking food at a GHF site.

- Après la frappe sur une église à Gaza, Netanyahu dit « regretter profondément » cette « tragédie » (huffingtonpost.fr)

Trois personnes ont été tuées ce jeudi 17 juillet dans des tirs israéliens sur la seule église de Gaza.

- Pope Leo under fire for ‘vague’ statement on Israel’s bombing of Gaza Catholic church (middleeasteye.net)

Pontiff’s statement, which did not mention Israel, prompts comparisons to his predecessor who was an outspoken critic of the war on Gaza

- Gaza : le missilier MBDA complice de crimes de guerre (disclose.ngo)

Le principal constructeur européen de missiles fabrique des ailerons servant au guidage de bombes larguées sur des civils à Gaza, révèlent Disclose, The Guardian et Follow the Money. D’après notre enquête, ces munitions équipées de composants MBDA ont été utilisées par l’armée israélienne dans 24 bombardements. Plus d’une centaine d’enfants sont morts dans ces attaques.

- « La censure organisée de la Palestine et de Gaza doit cesser » (humanite.fr)

Les groupes britanniques et irlandais Kneecap, Massive Attack et Fontaines DC, ainsi que Brian Eno, ont annoncé, jeudi 17 juillet, la création d’un syndicat pour lutter contre la censure des artistes soutenant la Palestine. Le collectif espère ainsi servir de rempart face à une « industrie et des organismes juridiques externes hautement organisés, qui terrorisent les artistes et leurs équipes de direction ».

- Un génocide anodin (la-meridienne.info)

Comment ne pas tirer les conséquences de la destruction des Palestinien·nes et du fanatisme d’Israël

- Lettre d’Omer Bartov, professeur d’études sur la Shoah et les génocides, au New York Times : “Je suis un spécialiste du génocide. Je sais en reconnaître un quand j’en vois un.” (christian-lehmann.org)

- ONU : Francesca Albanese sanctionnée pour avoir dénoncé le génocide (politis.fr)

Francesca Albanese, rapporteuse spéciale des Nations unies pour les Territoires palestiniens, est depuis le 9 juillet soumise à des sanctions américaines. En cause, des rapports sur la guerre à Gaza, qu’elle qualifie de génocide – ce qui déplaît fortement à l’administration Trump.

- Tribune : Ils veulent faire taire Francesca Albanese parce qu’elle a refusé de faire taire les victimes (blogs.mediapart.fr)

- Le bateau humanitaire Handala a pris le large vers Gaza avec deux élues LFI à son bord (huffingtonpost.fr)

Après le Madleen avec Greta Thunberg et Rima Hassan, la « Flottille pour la liberté » tente à nouveau de briser le blocus d’Israël avec le départ d’un nouveau navire.

Spécial femmes dans le monde

- Iran : « Plaider la force du droit, plutôt que la loi du plus fort » (revueladeferlante.fr)

Alors qu’en 2022, ils avaient apporté leur soutien au soulèvement populaire en Iran, les gouvernements occidentaux sont restés passifs face aux bombes lancées sur l’Iran par Israël et les États-Unis, fin juin 2025. […] l’avocate franco-iranienne Chirinne Ardakani exprime sa colère et son inquiétude, et rappelle la puissance transformatrice du mouvement féministe iranien.

- Les travailleuses des fleurs turques contestent un modèle économique qui encourage les profits au détriment des personnes (equaltimes.org)

- Au Royaume-Uni, des cours contre la misogynie deviennent obligatoires dans les collèges et les lycées dès 2026 (franceinfo.fr)

La mesure vise notamment à sensibiliser les garçons face à la propagation croissante de contenus sexistes en ligne portés par des influenceurs masculinistes.

- Quebec : Âgisme et sexisme : dès 45 ans, les femmes sont victimes de préjugés sur le marché du travail, selon une étude (theconversation.com)

- Un spéculum vaginal repensé pour être indolore, un espoir pour des millions de femmes (france24.com)

Spécial France

- Nouvelle-Calédonie/Kanaky : un accord sans indépendance (politis.fr)

- Georges Ibrahim Abdallah enfin libre ! (blogs.mediapart.fr)

Il aura fallu 11 demandes de remise en liberté pour que Georges Ibrahim Abdallah soit libéré après plus de 40 ans de détention, libérable depuis plus de 25 ans. Jusqu’au bout, sa libération aura été soumise à la pression des États Unis pour qu’il reste emprisonné.

- Marine Le Pen, déboutée en justice, aura bien à régler l’ardoise de son père auprès de l’UE (huffingtonpost.fr)

Le Parlement européen réclamait à Jean-Marie Le Pen plus de 300 000 euros d’euros indûment perçus. La note est désormais à régler par ses héritières.

- L’open data des décisions de justice sérieusement remis en question – Next (next.ink)

Un rapport remis au ministre de la Justice, Gérald Darmanin, émet six propositions de modification des conditions de publication des décisions de justice qui sont, depuis peu, diffusées en open data. Des informations comme les noms et prénoms des personnes physiques, mais aussi les noms d’entreprises mentionnées seraient occultées.

- Suppression de jours fériés : en Alsace et en Moselle, il y aura toujours 11 jours chômés malgré la proposition de François Bayrou (huffingtonpost.fr)

Cette exception est héritée du passé des trois départements, rattachés à l’Allemagne jusqu’à la fin de la Première Guerre mondiale.

- La banane de Maurizio Cattelan mangée au Centre Pompidou de Metz (telerama.fr)

L’artiste italien, dont le fruit scotché est estimé à plusieurs millions d’euros, a regretté qu’un visiteur ait confondu “le fruit avec l’œuvre elle-même”. Un visiteur a « mangé » la banane faisant partie de l’œuvre Comedian de Maurizio Cattelan, estimée à plusieurs millions d’euros et présentée dans l’exposition « Dimanche sans fin ».

- « Un racket social » : les députés LFI veulent interdire les péages en flux libre (lefigaro.fr)

« avec 10 millions de pauvres en France et des tarifs de péages qui ont flambé de plus de 10 % en deux ans, le système fait peser toujours plus le coût des déplacements sur les plus fragiles »

- La première moitié d’été la plus chaude jamais observée en France ! (meteo-paris.com)

- Martigues, Fréjus… Le sud de l’Hexagone théâtre de plusieurs incendies jeudi soir (huffingtonpost.fr)

Les départements des Bouches-du-Rhône, du Var et de l’Ardèche ont déployé d’importants moyens humains et matériels pour contenir les flammes.[…]Par ailleurs, la préfecture d’Ille-et-Vilaine a annoncé jeudi en fin de soirée que l’important incendie qui s’est déclaré plus tôt en forêt de Brocéliande à l’ouest de Rennes, détruisant une centaine d’hectares de végétation, était fixé.

- Volvic accusé d’assécher les rivières pour remplir ses bouteilles (reporterre.net)

- Dans le Finistère, les algues vertes saturent les stations de compostage (reporterre.net)

Deux plages du Finistère, à Douarnenez et Kerlaz, sont recouvertes d’algues vertes. De quoi saturer les stations de compostage. Avec le développement des porcheries industrielles permis par la loi Duplomb, le phénomène va empirer.

- Chikungunya : 31 contaminations en France hexagonale (reporterre.net)

- « Tuer le loup ne sert à rien, il reviendra » : dans le Lot, ces bénévoles dorment avec les troupeaux pour les protéger des attaques (vert.eco)

Pas RIP

- Thierry Ardisson : mort d’un enfant terrible de la télé (telerama.fr)

C’est lui la star de son émission, lui qu’on filme le plus, lui le responsable des coups de génie et dérapages, bien aidé par son « sniper » Laurent Baffie. C’est scotchant, hypnotisant au point qu’à cette époque pré-Internet et pré-#metoo, on ne réalise pas toujours la violence exercée, en particulier sur les jeunes femmes, qu’elles soient actrices, chanteuses ou écrivaines.

- Thierry Ardisson se confesse (et s’absout lui-même) dans “La Face cachée de l’homme en noir” (telerama.fr)

- Mort de Thierry Ardisson : quand Milla Jovovich, furieuse, quittait le plateau de « Tout le monde en parle » (huffingtonpost.fr)

« On était sexistes, machistes et cons »

- Les plateaux de Thierry Ardisson recréaient « la violence sociale vécue dehors » (nouvelobs.com)

la mort d’un homme n’est jamais réjouissante. Mais celle d’une époque marquée par la loi du plus fort l’est, elle, indéniablement.

Spécial femmes en France

- Il y a 60 ans, les femmes obtenaient le droit d’ouvrir un compte bancaire (france24.com)

Avant 1965, en France, une femme mariée ne pouvait ni travailler, ni toucher son salaire, ni ouvrir un compte bancaire sans l’autorisation écrite de son mari… La loi du 13 juillet 1965 est venue bouleverser cette logique patriarcale, en mettant fin à une forme de tutelle juridique héritée du Code Napoléon.

- « Tout ça pour un pipi » : cette festivalière a été exclue de Musilac pour avoir utilisé un « pisse-debout » (huffingtonpost.fr)

« Ils nous ont interpellées sans délicatesse, en nous disant qu’on n’avait rien à faire ici en tant que femmes, que ces toilettes étaient pour les hommes, comme si nous étions en train de transgresser une règle. »

- Sophie Vouzelaud, ex-miss Limousin, reçoit la visite d’un retraité arnaqué en ligne et qui pensait l’épouser (huffingtonpost.fr)

Un retraité belge a fait 760 kilomètres jusqu’en Haute-Vienne pour rencontrer celle qu’il pensait être sa future femme.

- « Le discours de la crise de la masculinité véhicule souvent les mêmes faussetés » (basta.media)

Début juillet, à Saint-Étienne, un projet d’attentat masculiniste d’un adolescent qui voulait tuer des femmes a été déjoué. Francis Dupuis-Déri, spécialiste de cette idéologie violente, analyse cette menace.

Spécial médias et pouvoir

- Des salariés du Point sacrifiés sur l’autel de l’IA (politis.fr)

Le service de révision et de correction est particulièrement visé, avec 18 licenciements, soit la totalité du service. Conjointement trois embauches de « réviseur expert-superviseur IA » sont prévues.

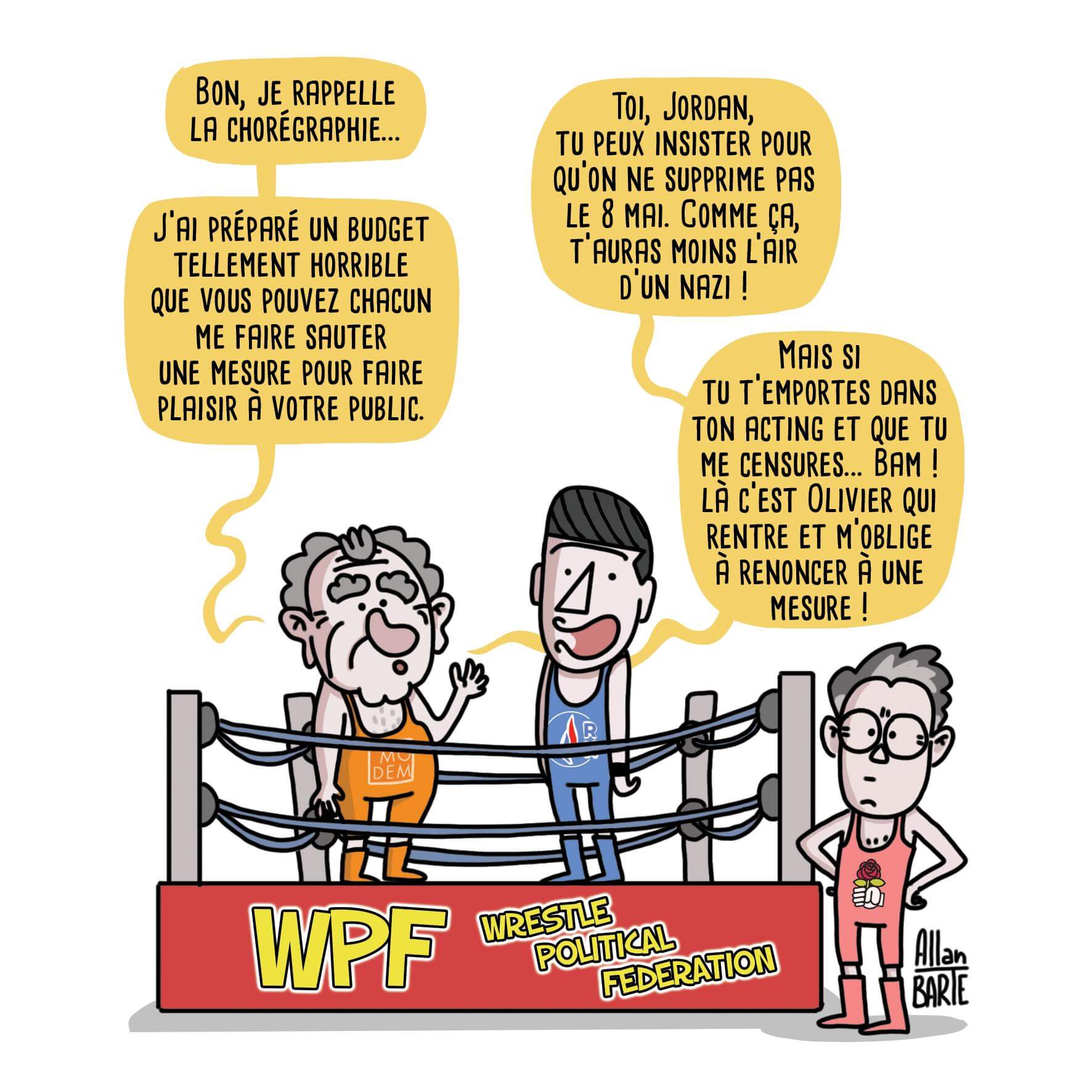

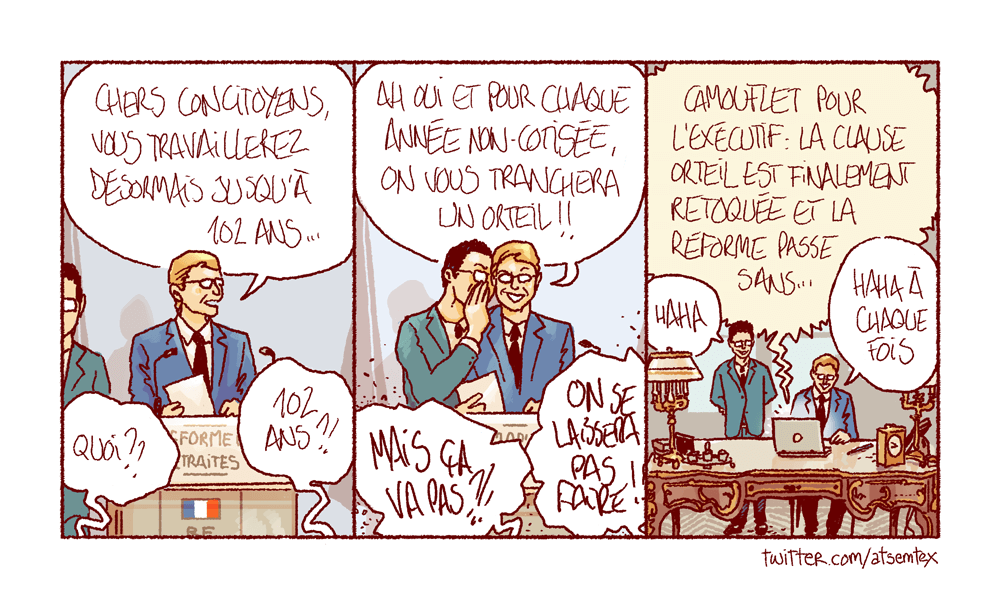

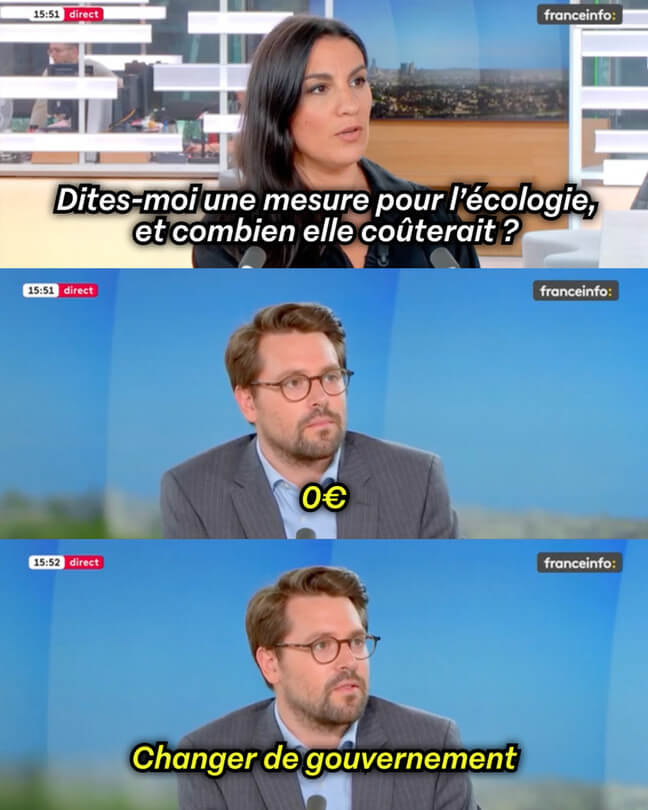

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- « Travailler plus pour gagner moins » : la presse étrangère atomise « la trahison » de François Bayrou (presse-citron.net)

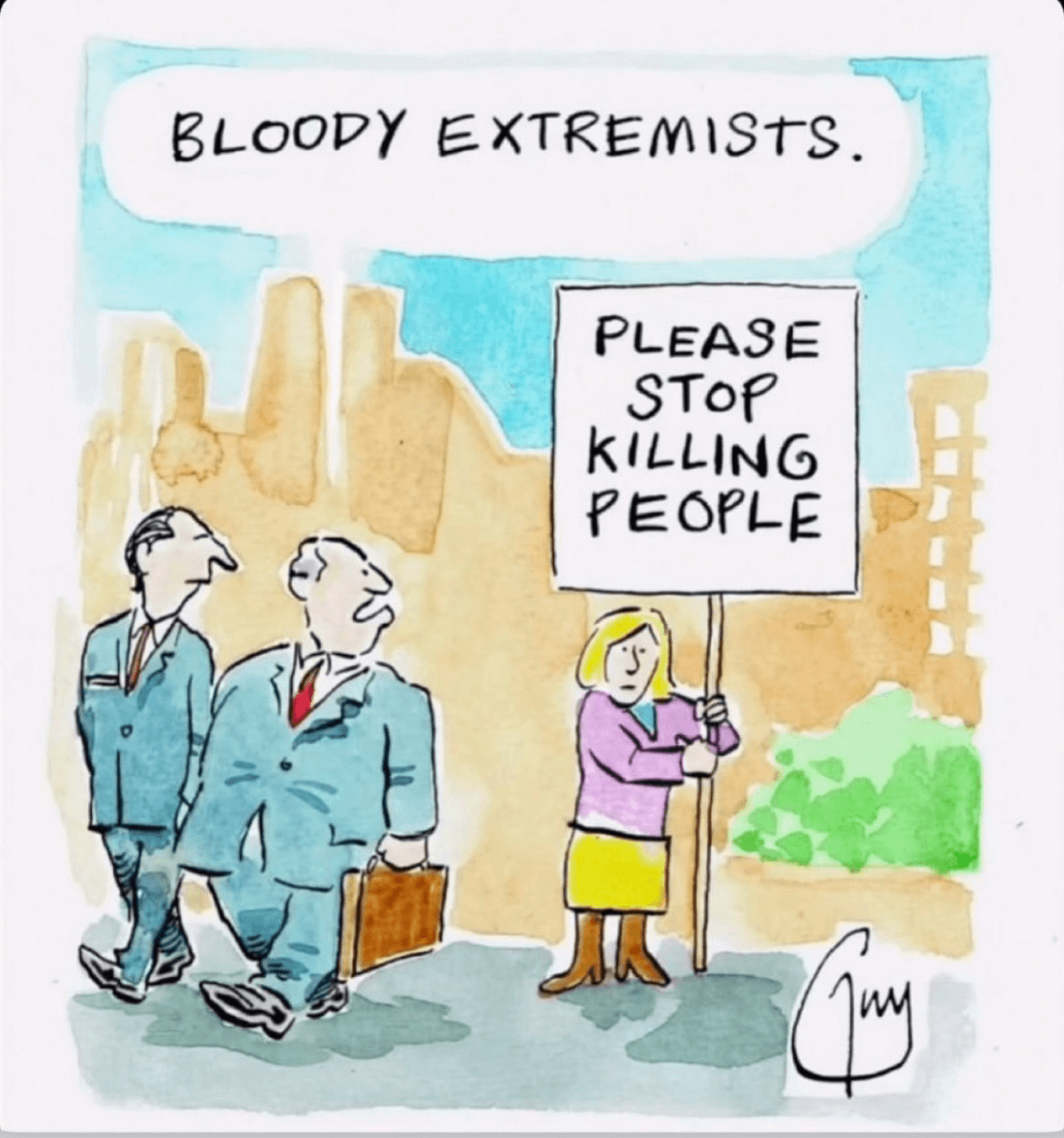

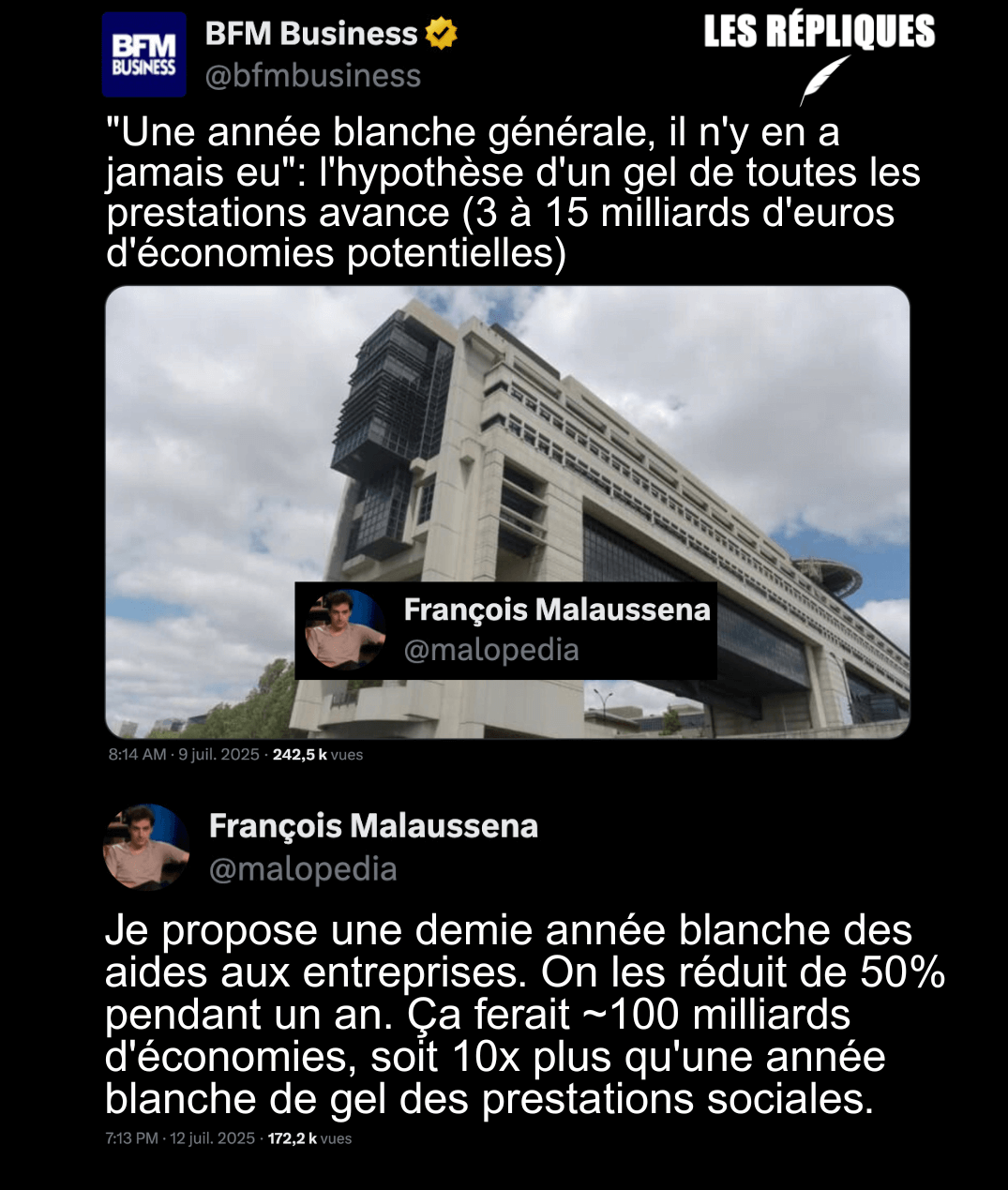

- Budget : Bayrou, boucher de l’État (politis.fr)

En annonçant des mesures d’austérité d’une ampleur rare, François Bayrou a fait le choix, non pas de la « responsabilité » et de la « justice », mais du massacre social et écologique du pays. Le tout, en préservant les plus aisés.

Voir aussi 44 milliards au prix d’une grande casse sociale : le mortifère plan Bayrou (alternatives-economiques.fr)

François Bayrou a présenté son plan d’économies. S’il a promis une répartition équitable du « fardeau », il sera en fait porté par les actifs, les inactifs et les malades. Et très peu par les riches et les entreprises.

Et Budget Bayrou : « Injuste, quoi qu’il nous en coûte » (basta.media)

Le Premier ministre a annoncé ses orientations budgétaires pour 2026. Pour l’association Attac, ce budget Bayrou va « affaiblir davantage les services publics et la protection sociale ». L’organisation a des propositions alternatives.

- Budget 2026 : le gouvernement s’oppose à la taxe Zucman, craignant un exil fiscal des ultrariches (franceinfo.fr)

Voir aussi Millionaire exodus did not occur, study reveals (taxjustice.net)A millionaire exodus widely reported by news outlets around the world in 2024, and credited for the UK Labour government’s decision to weaken tax reforms, did not occur, the Tax Justice Network reveals.

- Échanger ses congés payés contre du salaire ? Panosyan-Bouvet clarifie mais ne va pas calmer les syndicats (huffingtonpost.fr)

Après la suppression de deux jours fériés, l’autre piste du gouvernement concernant les congés payés met les syndicats de travailleureuses vent debout.

- Cette sortie gouvernementale sur les 35 heures risque d’achever de fâcher les syndicats (huffingtonpost.fr)

Sophie Primas s’est dit « à titre personnel » favorable à la suppression des 35 heures, tout comme le député EPR, Mathieu Lefèvre.

- La baisse des prélèvements obligatoires depuis 2017 responsable de la hausse du déficit public, selon l’OFCE (lemonde.fr)

- Mon Espace santé : François Bayrou veut s’appuyer sur l’intelligence artificielle pour “faire des pas de géant au diagnostic et à la prévention et à l’aggravation [sic] des infections” (bfmtv.com)

- La Techno Parade annulée, Jack Lang son créateur dénonce une « humiliation » (huffingtonpost.fr)

La Techno Parade a été annulée pour la seconde année consécutive, mais cette fois-ci, ce n’est pas à cause du Covid ou des JO de Paris, mais par manque de budget.

- Loi Duplomb : le malaise de ces député·es qui ont voté pour (reporterre.net)

Interpellé·es en masse par des citoyen·nes, les députéẹs qui ont voté la loi Duplomb oscillent entre silence, fébrilité et agressivité. Le signe d’un malaise au sujet d’un texte qui réautorise des pesticides et promeut les mégabassines.

- Oiseaux migrateurs : nouvelle victoire des chasseurs (reporterre.net)

- Marine Le Pen se prononce en faveur du minage de bitcoin en France (bfmtv.com)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

- Elisabeth Borne recadre son ministre de l’Enseignement supérieur, qui a déclaré que la notion d’ “islamo-gauchisme” n’existait pas (franceinfo.fr)

- Ils sont épuisés (mais il paraît qu’ils ne travaillent pas encore assez) (blogs.mediapart.fr)

- L’ouverture d’un internat catholique parrainé par le milliardaire Pierre-Edouard Stérin autorisée par les autorités, malgré les critiques (lemonde.fr)

Malgré une vive opposition politique et syndicale, l’Académie Saint-Louis ouvrira ses portes en Sologne dès 2025, sous la surveillance des autorités éducatives, assure le rectorat de l’académie d’Orléans-Tours.

- Dans l’affaire Hedi, le rapport implacable de l’IGPN contre les policiers (huffingtonpost.fr)

Dans ce document de 200 pages, l’inspection pointe un « usage disproportionné » de la force sur le jeune homme, « qui ne représentait aucune menace immédiate ».

- Eau payante et promenades en plein soleil : l’enfer estival dans les prisons (reporterre.net)

La vie sous canicule est infernale dans la prison de Toulouse-Seysses, surpeuplée à plus de 187 %. Deux associations viennent de saisir le juge pour mettre fin à des « conditions de détention inhumaines ».

Spécial résistances

- Nous refusons de livrer la guerre : Air France doit répondre (politis.fr)

Dans un texte commun signé par plusieurs dizaines d’organisations, de syndicats et de personnalités publiques, Sud Solidaires Aérien et la CGT Roissy exhortent Air France d’arrêter de livrer du matériel militaire à Israël.

- Une pétition pour demander l’abrogation de la loi Duplomb bat des records sur le site de l’Assemblée nationale (lemonde.fr)

Voir aussi Contre la loi Duplomb, cette pétition récolte 200 000 signatures en quelques jours et devient virale (huffingtonpost.fr)Déposée sur le site de l’Assemblée nationale, cette pétition dénonce « une aberration scientifique, éthique, environnementale et sanitaire » et demande l’abrogation de cette loi.

Pour signer : Pétition : Non à la Loi Duplomb — Pour la santé, la sécurité, l’intelligence collective (petitions.assemblee-nationale.fr) - Loi Duplomb : l’écrivaine Agnès Ledig adresse un message déchirant aux députés qui ont voté le texte (huffingtonpost.fr)

Endeuillée depuis 20 ans par la mort de son fils à cause d’une leucémie, elle redoute une multiplication des cancers chez les plus jeunes avec l’application de la loi Duplomb. […] « AUX ÉLU(E)S QUI ONT VOTÉ LA LOI DUPLOMB. Regardez bien ces deux grands yeux bleus. Ceux de notre fils, mort d’une leucémie à l’âge de 5 ans et demi sans que PERSONNE n’en cherche les causes. Regardez ces deux grands yeux bleus et pensez à tous les enfants sur lesquels, en votant cette loi mortifère, vous installez une épée de Damoclès » […] « Regardez ces deux grands yeux bleus et osez affirmer que la réintroduction de l’acétamipride ne comporte aucun risque pour la population. Mais vous savez évidemment que ce n’est pas le cas. Tous les scientifiques sont d’accord pour conclure à sa dangerosité. Le vote de cette loi est donc une décision criminelle »

- Seule contre Nestlé : « On ne choisit pas de devenir lanceuse d’alerte » (basta.media)

Ancienne directrice de la sécurité alimentaire au sein de la multinationale agroalimentaire Nestlé, Yasmine Motarjemi a gagné un procès pour harcèlement contre l’entreprise. Un combat de 25 ans pour la santé publique.

- “Voici Marie-Madeleine” : le coup d’éclat d’un avocat pour dénoncer les conditions de détention en France (tf1info.fr)

- Une autre pétition à faire chauffer : Pour une contribution équitable des ultra-riches et des grandes entreprises au financement des services publics (petitions.assemblee-nationale.fr)

Spécial outils de résistance

- Participez à l’Observatoire de la publicité d’aliments d’origine animale (antipub.org)

Dans le cadre de sa campagne Stop Pub Climaticide, Résistance à l’Agression Publicitaire (R.A.P.) a décidé de se pencher sur le problème spécifique des produits d’origine animale présents dans la publicité.

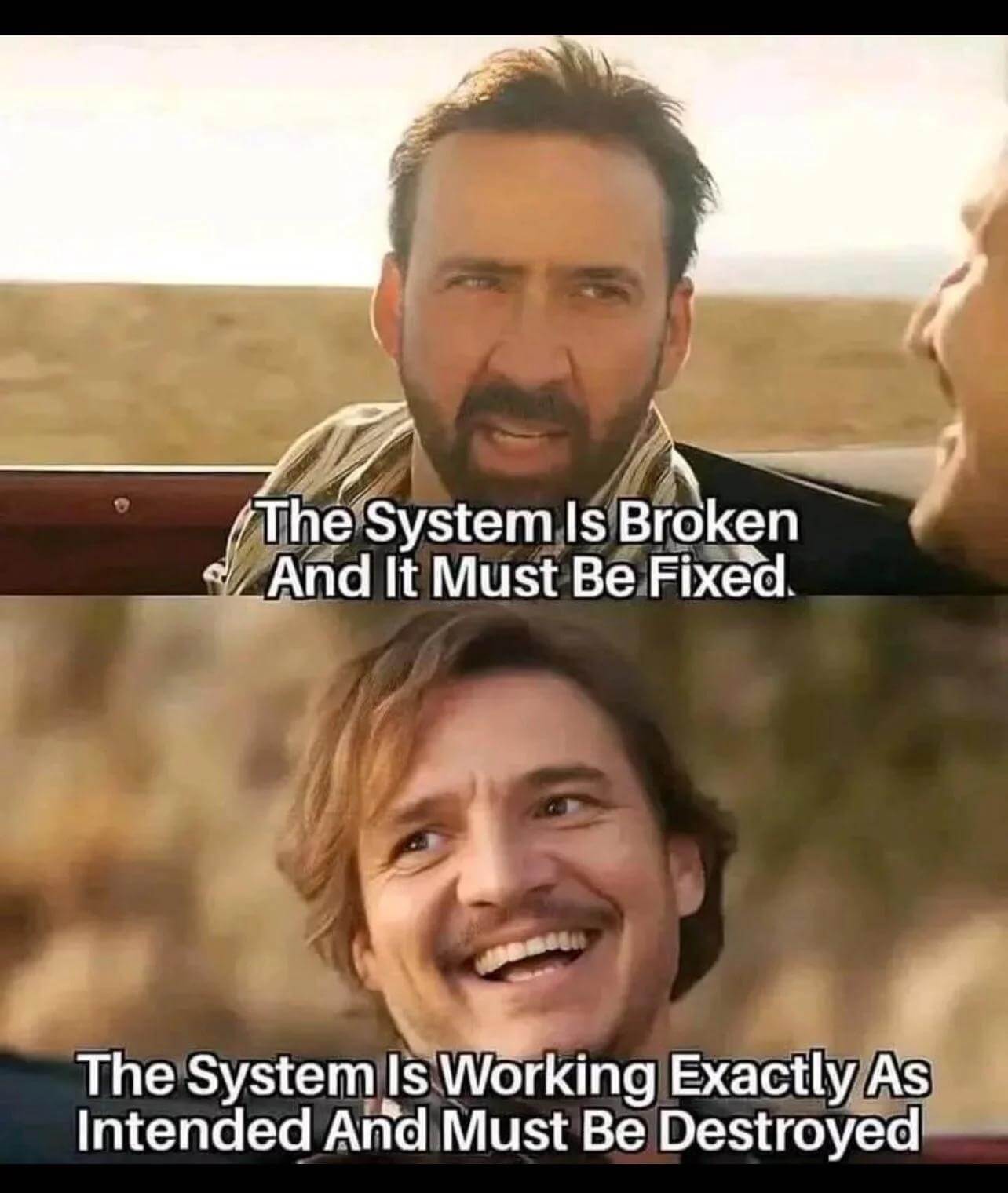

Spécial Foutons le Zbeul

- Budget Bayrou : qu’est-ce qu’on attend pour foutre le feu ? (frustrationmagazine.fr)

- Comment faire la révolution ? Quatre leçons de 1789 (frustrationmagazine.fr)

Spécial GAFAM et cie

- Marchés publics : un rapport sénatorial dénonce un « recours massif » de l’État aux GAFAM (publicsenat.fr)

« Il n’y a pas de pilote dans l’avion de la commande publique. » Après le travail de la commission d’enquête sur la commande publique, le diagnostic du rapporteur Les Indépendants Dany Wattebled et du président socialiste Simon Uzenat est sans appel.

- La France ne contrôle plus ses données : Microsoft les remettra aux États-Unis “si nous y sommes contraints” (lesnumeriques.com)

Lors d’une audition publique au Sénat, Microsoft France a confirmé qu’elle ne pouvait empêcher la justice américaine d’accéder aux données hébergées en France. Un aveu glaçant, qui révèle l’ampleur du décalage entre les promesses de souveraineté numérique et la réalité contractuelle de l’État français.

- Amazon Ring Cashes in on Techno-Authoritarianism and Mass Surveillance (eff.org)

Not only is the company reintroducing new versions of old features which would allow police to request footage directly from Ring users, it is also introducing a new feature that would allow police to request live-stream access to people’s home security devices.

Les autres lectures de la semaine

- Les camps de concentration, de l’Algérie à Gaza (orientxxi.info)

L’annonce faite par Israël de l’établissement de « zones de transit humanitaire » n’est pas sans rappeler les « camps de regroupement » installés par la France en Algérie dans sa guerre contre le FLN. Les deux stratégies coloniales partagent la conviction de la responsabilité collective de la population et d’un contrôle fantasmé sur les corps colonisés.

- Conçu pour dominer. Palantir Technologies, bras armé numérique de la répression mondiale (contretemps.eu)

- Are a few people ruining the internet for the rest of us ? (theguardian.com)

social media is less like a neutral reflection of society and more like a funhouse mirror. It amplifies the loudest and most extreme voices while muting the moderate, the nuanced and the boringly reasonable. And much of that distortion, it turns out, can be traced back to a handful of hyperactive online voices. Just 10 % of users produce roughly 97 % of political tweets.

- Toxic platforms, broken planet (globalwitness.org)

How online abuse of land and environmental defenders harms climate action

- Why Science Hasn’t Solved Consciousness (Yet) (noemamag.com)

To understand life, we must stop treating organisms like machines and minds like code.

- A transatlantic communications cable does double duty (phys.org)

Monitoring changes in water temperature and pressure at the seafloor can improve understanding of ocean circulation, climate, and natural hazards such as tsunamis. In recent years, scientists have begun gathering submarine measurements via an existing infrastructure network that spans millions of kilometers around the planet : the undersea fiber-optic telecommunications cables

- Before Macintosh : The Story of the Apple Lisa (hackaday.com)

- The First Photograph Ever Taken (1826) (openculture.com)

In histories of early photography, Louis Daguerre faithfully appears as one of the fathers of the medium. […] But had things gone differently, we might know better the harder-to-pronounce name of his onetime partner Joseph Nicéphore Niépce, who produced the first known photograph ever, taken in 1826.

- Conspiratorialism and neoliberalism (pluralistic.net)

Trump’s day-one Executive Order blitz contained a lot of weird, fucked-up shit, but for me, the most telling (though not the most important) was the decision to defund all medical research whose grant applications contained the word “systemic”

- « Le validisme, lui, ne prend jamais de vacances » (politis.fr)

Nous avons passé une semaine à Berlin. Pas de différence pour réserver au musée, pas de barrière dans le métro, le train, tout est accessible. Ils étaient même étonnés que je sorte ma carte CMI pour me justifier.20 ans après la loi, rien n’est fait afin qu’elle soit respectée en France, pour que nous soyons enfin respectés en tant que citoyennes à part entière. Nous sommes discriminées, en toute impunité, et sans pause.

- La révolte des prostituées : 1975 – 2025 50 ans de luttes (rebellyon.info)

- On nous a appris que le spermatozoïde le plus rapide féconde l’ovule : c’est complètement faux (slate.fr)

L’ovule capture chimiquement les spermatozoïdes pour choisir son partenaire génétique. Un processus loin du mythe du « chevalier spermatozoïde » perforant la paroi d’un œuf passif. […] Cette réalité, pourtant établie depuis plus de quarante ans, continue d’être ignorée ou redécouverte[…] « On s’obstine à voir le spermatozoïde comme un preux chevalier qui part à la conquête de l’ovule, alors que la science montre tout l’inverse. » Cette persistance du récit du « sperme actif » et de « l’ovule passif » prouve combien il demeure difficile d’abandonner des mythes culturels qui influent encore sur notre vision du monde biologique.

Les BDs/graphiques/photos de la semaine

- Chorégraphie

- À chaque fois

- Minc

- Assisté

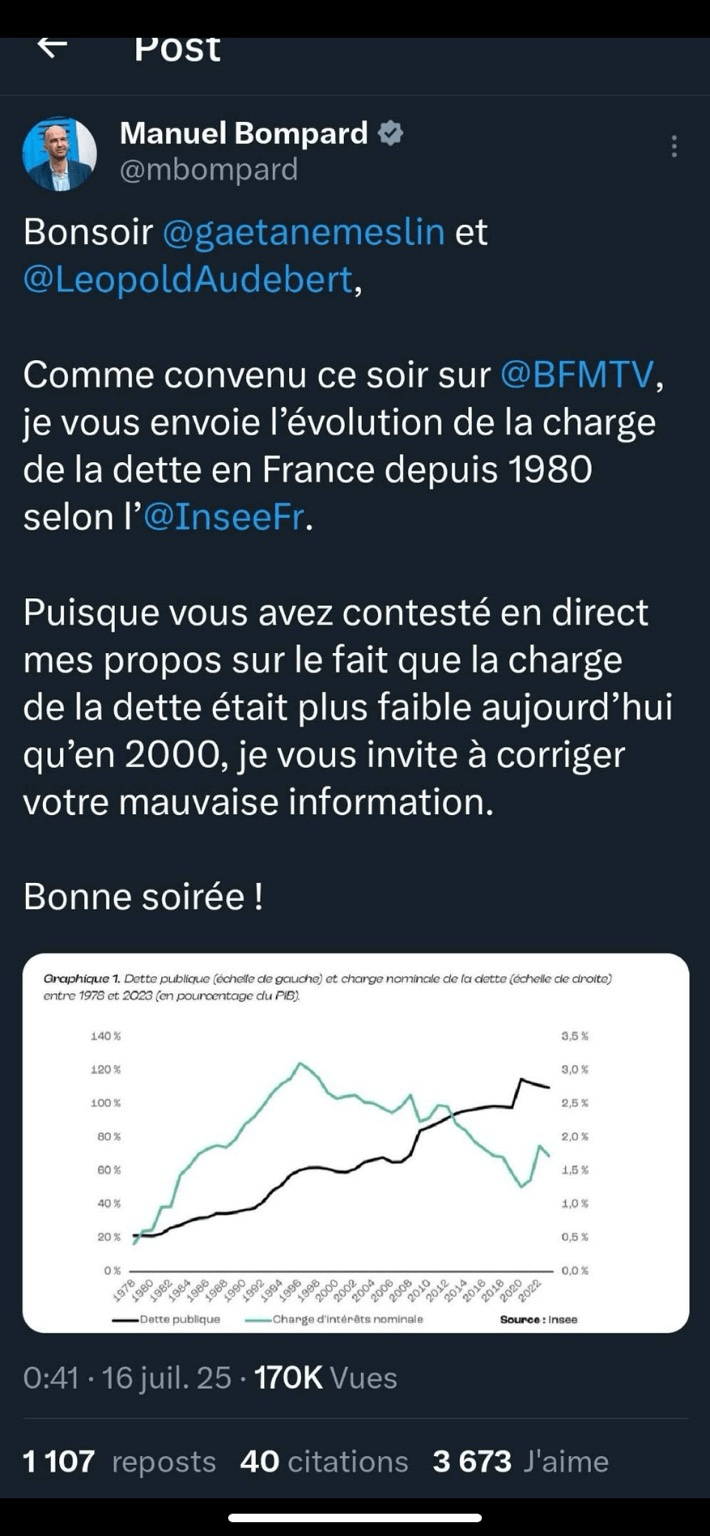

- Bompard

- Étau

- Studieux

- Argent

- Pétition

- Non

- Odoul

- Georges

- Légion

- Poor thing

- Agenda

- Limites

Les vidéos/podcasts de la semaine

- Israeli teens burn their army draft papers (tube.fdn.fr)

- Manuel Bompard sur la taxe Zucman (tube.fdn.fr)

- When you meet your friend’s baby for the first time (tube.fdn.fr)

- Polices de caractère (tube.fdn.fr)

Les trucs chouettes de la semaine

- « Historique » : un géant de la volaille s’engage à changer ses pratiques d’élevage et abattage (reporterre.net)

le groupe (qui détient les marques de poulets Le Gaulois et Maître CoQ, et représente 40 % du marché français de la viande de poulet) s’engage à baisser les densités en élevage (en passant de 20 à 15 poulets par mètre carré au maximum) ; à arrêter l’utilisation de souches à croissance ultrarapide, qui entraîne d’importants problèmes de santé et des souffrances chez les volatiles ; à mettre en place de la lumière naturelle et des perchoirs dans les élevages et à utiliser une méthode d’abattage qui « évite l’accrochage des animaux conscients ».

- « Nos minibassines à nous » : sur le Larzac, des techniques millénaires de stockage de l’eau (reporterre.net)

Sur le plateau du Larzac, l’accès à l’eau et sa répartition ont été pensés dès le Moyen Âge. Ce système perdure aujourd’hui, avec des retombées positives pour la biodiversité de cette région bien moins hostile qu’il n’y paraît.

- Dennis Lehtonen Documents a Pair of Immense Icebergs Paying a Visit to a Small Greenland Village (thisiscolossal.com)

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

14.07.2025 à 07:42

Khrys’presso du lundi 14 juillet 2025

Khrys

Texte intégral (12094 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

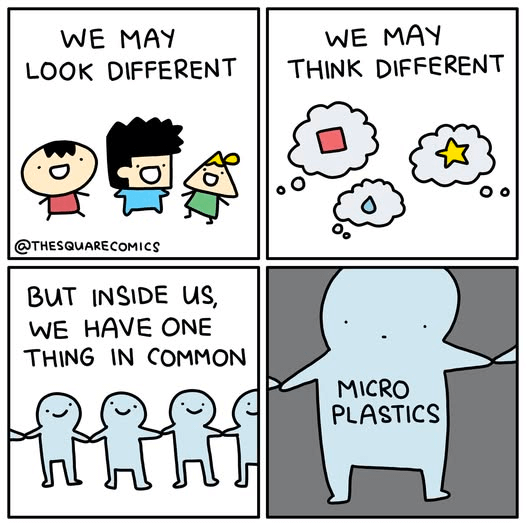

- The oceans may contain much, much more plastic than previously thought (grist.org)

A new study finds there are 27 million metric tons of invisible plastic particles in the North Atlantic alone.

- La Corée du Sud est envahie par les mouches, alors ce YouTubeur en a fait des steaks (huffingtonpost.fr)

- The ‘king of poisons’ is building up in rice (grist.org)

After drinking water, the researchers say, rice is the world’s second largest dietary source of inorganic arsenic, and climate change appears to be increasing the amount of the highly toxic chemical that is in it.

- Politics and USAID cuts put a telehealth program on life support (restofworld.org)

Despite poor internet and power cuts, Bangladesh’s telehealth service connected rural residents to city doctors until this year.

- Le détroit d’Ormuz peut-il être fermé ? (orientxxi.info)

Depuis les bombardements israéliens et américains sur l’Iran en juin 2025, les dirigeants de Téhéran évoquent la menace d’une fermeture du détroit d’Ormuz.

- Au Liban et en Syrie, la pire sécheresse depuis 60 ans (reporterre.net)

- Enlèvements, tortures… Vers une élection présidentielle sans opposant en Tanzanie (afriquexxi.info)

- Dangerous mines : A death at the bottom of the EV supply chain (restofworld.org)

In Zimbabwe, the EV rush has brought a surge of Chinese investment into lithium mines. But many locals feel left out — and some have turned to stealing.

- The EU’s fence-sitting as Serbia’s Vučić steps up violent state repression (euobserver.com)