29.04.2026 à 00:03

Quand l’écologie était populaire et (souvent) victorieuse

François Jarrige

Dans son livre “Verts de rage”, François Jarrige revient sur deux siècles de combats environnementaux en France. Il souligne l’importance du rôle des classes populaires et des alliances entre groupes hétéroclites, associés de circonstance contre les pollueurs et accapareurs en tout genre. Illustration avec quatre luttes emblématiques des années 1970-1990.

L’article Quand l’écologie était populaire et (souvent) victorieuse est apparu en premier sur Terrestres.

Texte intégral (8677 mots)

Temps de lecture : 19 minutes

Ce texte est extrait du livre de François Jarrige Vert de rage ! Deux siècles de luttes environnementales en France, paru aux éditions du Détour en 2026.

Vous connaissez peut-être la Guerre des Demoiselles en Ariège, mais connaissez-vous les soulèvements contre les soudières de Marseille ou contre les fours à chaux du mâconnais ? Alors que la première désigne la lutte de paysans contre la confiscation de la forêt par l’État en 1830, le second renvoie à la mobilisation, au tout début du 19e siècle, contre les usines de production chimique de la soude qui « vomissent la mort » et empoisonnent les habitants, l’eau et les plantes de la région de Marseille. Le troisième soulèvement est le combat de riverains pour protéger les cultures, les bêtes et les villages de la puanteur des fours à chaux, qui s’incrustait notamment dans le raisin au point de rendre le vin infect.

Dans son dernier livre, François Jarrige retrace 200 ans de luttes pour l’environnement, dont il entend remettre la dimension sociale au cœur du récit pour contribuer à une histoire populaire de la nature. Depuis les mobilisations pour protéger les moyens de subsistance au 19e siècle jusqu’aux mégabassines de Sainte-Soline en 2023 en passant par la lutte acharnée contre le remembrement agricole des années 1950, le livre montre la détermination constante de nombreux groupes sociaux pour préserver le territoire, les moyens de subsistance et la nature – des paysages aux espèces menacées. C’est aussi une introduction accessible au champ de l’histoire environnementale, qui rappelle que la mobilisation contre l’accaparement et la pollution est consubstantielle à l’industrialisation et à la modernisation. Une histoire qu’il est urgent de faire découvrir aux plus jeunes à l’heure où la catastrophe écologique s’accélère et la répression des mouvements écolo s’amplifie. Nous publions ici quatre exemples de luttes emblématiques des années 1970, époque de basculement où les projets délétères se multiplient… et les soulèvements aussi. Souvent victorieux.

1969 : protéger la montagne (la Vanoise)

L’affaire de la Vanoise, en 1969, illustre et couronne les évolutions à l’œuvre au cours des années 1960, inaugurant une nouvelle séquence dans l’histoire des conflictualités environnementales. Cet épisode constitue en effet un « moment fondateur » selon le constat de Florian Charvolin, à la suite des associations environnementalistes qui ne cessent de faire de ce conflit un moment inaugural dans l’histoire des luttes écologistes1. Au-delà des naturalistes considérés comme de doux rêveurs, la défense de ce site inhabité mobilise en effet comme jamais l’opinion, jusqu’à devenir une cause publique souvent présentée comme la première véritable lutte écologiste moderne. Cette affaire remodèle le cadre des controverses à propos des grands projets d’aménagement, tout en ouvrant une nouvelle ère de politisation de la protection de la nature.

En 1968, les promoteurs d’un projet de station de ski à Val Thorens envisagent en effet un vaste projet immobilier et la création d’équipements et de remontées mécaniques sur le glacier du Val Chavière, situé à l’intérieur du parc national de la Vanoise (Savoie), afin de permettre le ski d’été. Ce projet s’insère dans un plan de développement économique et touristique des grandes vallées alpines alors que leur avenir est désormais identifié au tourisme de masse et à la multiplication des stations de ski. Mais ce projet remet aussi en cause l’intégrité du parc naturel qui avait été le premier à voir le jour en France, en 19632. Les élus locaux, portés par l’enthousiasme aménageur de l’époque, soutiennent le projet, le conseil général de la Savoie donne son accord, le maire de Modane qui est aussi président du conseil d’administration du parc également… À Paris, Albin Chalandon est ministre de l’Équipement et du Logement de 1969 à 1971, alors que l’ingénieur des Ponts et Chaussées Maurice Michaud élabore le « Plan neige » qui vise à développer rapidement le tourisme de montagne.

Mais aux yeux des associations de protection de la nature, le projet est scandaleux et l’affaire est d’autant plus grave que celles-ci avaient été associées à la définition des caractéristiques des parcs nationaux lors du vote de la loi de 1960. Elles se mobilisent donc fortement sur ce dossier qui les conduit à se structurer davantage et à gagner en visibilité. À l’époque, les associations françaises n’ont certes pas une organisation aussi professionnalisée que leurs homologues anglo-saxonnes, qui font notamment appel à une main-d’œuvre salariée et mènent des campagnes de sensibilisation de grande ampleur. Néanmoins, la Fédération française des sociétés de protection de la nature (FFSPN) joue un rôle fondamental d’initiateur de la protestation et de coordinateur de la campagne au niveau national. Jean-Pierre Raffin notamment, alors doctorant en science naturelle, est détaché auprès de l’association à plein temps pour s’occuper des questions logistiques. Par ailleurs, Jean Carlier, alors directeur du service des informations à RTL, utilise sa position et ses relations dans les médias pour alerter l’opinion.

L'infolettre des Terrestres

Toutes les deux semaines, dans votre boîte mail : un éditorial de la rédaction, le résumé de nos dernières publications, un conseil de lecture des Terrestres et des articles tirés de nos archives, en écho à l'actualité.

Dans ce contexte, les associations de protection de la nature se fédèrent rapidement pour protéger le parc. Elles mobilisent leurs membres, organisent des réunions publiques, font signer des pétitions et introduisent des recours en justice dans une campagne finalement victorieuse puisque l’aménagement est abandonné. En mars 1969, dans le journal Le Monde, Philippe Traynard, professeur à la faculté des sciences de Grenoble, président du Club Alpin français et membre du conseil d’administration du parc, alerte sur les risques introduits par les projets d’équipement du glacier de Chavière pour le ski ! En juillet 1969, 108 associations déposent une motion signée par 50 000 personnes auprès de la présidence de la République. La mobilisation devient aussi internationale lorsque le 1er décembre 1969, l’assemblée générale de l’Union internationale de conservation de la nature (UICN), réunie à New Delhi en Inde, adopte à l’unanimité une résolution s’opposant au projet en France.

La Vanoise illustre les ambivalences des luttes environnementales, leur caractère socialement composite et les alliances ponctuelles que celles-ci peuvent susciter entre des groupes antagoniques.

Mais les milieux de la protection de la nature doivent aussi s’allier avec leurs ennemis comme les chasseurs locaux, auparavant hostiles au parc naturel, mais également inquiets devant l’essor des stations de ski qui risquent de faire fuir les bouquetins. L’affaire de la Vanoise illustre les ambivalences des luttes environnementales, leur caractère socialement composite et les alliances ponctuelles que celles-ci peuvent susciter entre des groupes antagoniques.

Au cours de l’hiver 1969-1970 de nombreuses avalanches mortelles frappent par ailleurs le massif alpin, et une étude montre que de nombreux sites de la future station de Val Chevrière sont sujets à ce risque. Cet argument est rapidement mobilisé pour remettre en cause le projet. En août 1970 démarre aussi l’enquête publique qui se clôture en septembre : environ 160 000 signatures de personnes hostiles au projet sont déposées à Chambéry. Face à une telle levée de boucliers, le projet est finalement abandonné et, durant l’été 1971, le nouveau ministre de l’Environnement, Robert Poujade, visite le massif.

Cet épisode est particulièrement significatif en ce qu’il témoigne d’une médiatisation et d’une politisation largement inédites des naturalistes qui s’engagent dans l’action, allant sur le site réaliser des inventaires, prenant position publiquement. Face aux bétonneurs, ils en appellent à l’opinion et activent leurs réseaux pour submerger la préfecture de la Savoie de milliers de protestations et de plaintes écrites lors de l’enquête.

Cette lutte victorieuse qui mobilise l’opinion au tournant des années 1970, fait rapidement l’objet d’une mise en récit par les militants, comme le journaliste Jean Carlier qui s’est engagé contre le projet et publie dès 1972 son analyse. Pour lui, cette lutte emblématique a joué un rôle majeur et eu de nombreuses retombées comme la création, au début de l’année 1969, de la FFSPN (devenue depuis France Nature Environnement, FNE) et de l’Association des journalistes et écrivains pour la protection de la nature (AJEPN, devenue en 1981 les Journalistes-écrivains pour la Nature et l’Écologie, JNE). En janvier 1971, juste avant de rendre au parc national de la Vanoise son intégrité, le président Georges Pompidou crée un ministère de l’Environnement3.

L’affaire de la Vanoise est un moment de bascule dans l’histoire des luttes environnementales : elle inaugure une nouvelle dynamique de « politisation populaire de la protection de la nature ».

Cette affaire et sa médiatisation représentent un moment de bascule dans l’histoire des luttes environnementales : elle inaugure une forme de militantisme inédit fondé notamment sur la mobilisation des naturalistes, mais aussi sur une nouvelle dynamique de « politisation populaire de la protection de la nature4 ». Alors que les membres des sociétés d’histoire naturelle soucieux de protéger les espèces vivantes et les milieux étaient auparavant considérés comme de doux rêveurs, leur mobilisation contribue à attirer l’attention du public sur la question de la nature et de sa protection, jusqu’à en faire un enjeu de débats et de conflits qui se traduit, au cours des années 1970, par la multiplication des mobilisations et des luttes.

➤ Lire aussi | Cent ans de sabotage : résister à l’oppression politique et technologique・Jean-Marc Ghitti (2025)

1973 : l’affaire des boues rouges (Corse)

En février 1973, une grande manifestation unitaire réunissant à Bastia habitants, lycéens, pêcheurs et responsables politiques locaux, entend protester contre le déversement massif de boues rouges par la société italienne Montedison au large du cap Corse. Cette mobilisation est le point d’orgue d’une protestation de grande ampleur qui associe la défense des intérêts économiques locaux, les amoureux des paysages et de la faune marine, et le mouvement nationaliste naissant. Cette lutte environnementale, largement médiatisée sur le continent, ouvre un cycle de contestations qui durera plusieurs années sur l’île, ponctué de protestations collectives, de poursuites judiciaires, d’expertises, mais aussi d’actes de sabotage.

Immense groupe industriel italien né dans les années 1960 par la fusion de sociétés minières, métallurgiques et chimiques, l’entreprise Montedison affronte alors une conjoncture difficile avec le choc pétrolier et la concurrence internationale. Le géant chimique italien produit, dans le golfe de Gênes, de vastes quantités de substances indispensables à la société de consommation naissante, comme des vernis de peinture, des plastiques ou des produits pharmaceutiques. Pour obtenir le dioxyde de titane, nécessaire à ces productions mais particulièrement toxique à produire, il faut attaquer un minerai par l’acide sulfurique ; ce qui engendre d’énormes quantités de déchets de couleur rouge comprenant notamment du cadmium. Pour limiter les lourds investissements qu’impliquerait le traitement en amont de ces déchets, l’entreprise choisit (dans la continuité des politiques anciennes de dilution) de les rejeter en mer à une cinquantaine de kilomètres des côtes, entre le cap Corse et l’île italienne de Capraia.

À partir de 1972, ce sont des centaines de milliers de tonnes de ces boues toxiques qui sont déversées, formant une marée rouge longue de 20 kilomètres et large de 5. Les pêcheurs corses crient leur colère et énumèrent les dégâts pour leur activité, alors que l’entreprise nie toute dangerosité, inaugurant une longue querelle d’experts5. La présence dans ces boues d’acides sulfuriques et de divers sels métalliques, les rend dangereuses pour la vie marine, menaçant le plancton alors que de grands cétacés sont bientôt retrouvés morts. Depuis 1972, le gouvernement italien a autorisé ces rejets au mépris des alertes scientifiques ; des navires spécialement conçus pour déverser chaque jour 2 000 à 3 000 tonnes de déchets commencent à sillonner les hauts-fonds marins censés diluer les déversements toxiques. Mais la zone est très fréquentée par les marins-pêcheurs corses et les pollutions provoquent un rejet croissant dans l’opinion alors que l’île fait l’objet d’une promotion touristique et patrimoniale nouvelle.

À partir de 1972, ce sont des centaines de milliers de tonnes de ces boues toxiques qui sont déversées, formant une marée rouge longue de 20 kilomètres et large de 5.

La question écologique a commencé à émerger en Corse au début des années 1960, à la faveur d’un mouvement de protestation contre un projet du gouvernement Michel Debré visant à créer un centre d’expérimentations nucléaires dans d’anciennes mines désaffectées, au sud de Calvi. Après l’abandon de ce projet, la défense des « beautés naturelles » de l’île s’affirme comme un mot d’ordre partagé par les militants régionalistes et les promoteurs d’une mise en tourisme de l’île. En 1966, un rapport présenté au conseil général défend la « protection et la sauvegarde des richesses naturelles de la Corse » ; un parc naturel régional est d’ailleurs officiellement créé sur l’île en 1971. Dès cette époque, les milieux régionalistes se mobilisent contre des projets d’aménagement de l’île, surfant sur le sentiment de dépossession d’une partie des habitants, exploitant l’attachement local à la terre et les questions environnementales pour mobiliser la population insulaire contre les menaces venues de l’étranger et l’inaction du gouvernement. Ici, la pollution est perçue comme une manifestation d’impérialisme et de colonisation insulaire6.

C’est dans ce contexte qu’émerge le mouvement de protestation contre les boues rouges – l’un des plus célèbres épisodes de lutte environnementale des années 1970. Des comités de défense « anti-boues rouges » voient le jour, associant dans une large protestation populaire des élus communistes et nationalistes, des pêcheurs et agriculteurs, mais aussi des scientifiques comme Denise Vial (une jeune professeure de biologie au lycée de Bastia qui alerte sur la crise écologique qui se profile). Une autre femme, Lucia Molinelli, médecin généraliste à Bastia et militante écologiste, devient la porte-parole du comité de défense, avant de livrer son témoignage sur cette lutte7.

Des figures scientifiques nationales comme les océanographes Paul-Émile Victor ou le commandant Cousteau, contribuent également à alerter les médias, alors que le ministère français de l’Environnement minimise de son côté les risques sur le milieu marin. Lors de la manifestation de février 1973, les tensions s’exacerbent et, alors que le sous-préfet de Bastia est molesté, des élus communistes et nationalistes sont arrêtés. Au cours du printemps 1973, les protestataires déploient un large répertoire d’actions, distribuant des tracts et collant des affiches qui proclament que « les boues rouges tuent », bloquant à plusieurs reprises les ports de Corse et ceux de Marseille, Nice ou Sète. En outre, l’affaire s’internationalise lorsque des opposants corses sont conviés, en juin 1973, à Beyrouth, à l’occasion d’un grand congrès mondial dédié à la protection de la mer Méditerranée.

Des comités de défense « anti-boues rouges » associent élus communistes et nationalistes, pêcheurs et agriculteurs, mais aussi des scientifiques ou une médecin généraliste.

À partir de septembre 1973 s’engage aussi une confrontation judiciaire : alors que le juge de Livourne, en Italie, interdit l’appareillage des navires chargés de la triste besogne, la multinationale continue de défendre l’innocuité des déversements. Face à l’attentisme des autorités qui craignent que le mouvement ne s’étende vers d’autres sites de production, les protestations se transforment en une action directe lorsque, dans la nuit du 13 au 14 septembre, un attentat à l’explosif endommage l’un des navires. Cette action clandestine revendiquée par le Front paysan corse de libération a notamment été conduite la nuit par un berger, Jean-Pierre Susini, qui revendiquera cette action cinquante ans après8. Ce type d’action clandestine devient ensuite une des caractéristiques du mouvement nationaliste Corse du FLNC qui voit le jour officiellement en 1976, dans la foulée de ces vives tensions environnementales.

Un procès a finalement lieu en avril 1974 : il oppose la multinationale à une coalition d’opposants qui l’emporte malgré une série d’appels et de péripéties juridiques. Au terme de plusieurs années de contentieux, la société italienne est finalement condamnée à verser 500 000 francs de dommages et intérêts aux départements corses, donnant naissance à l’incrimination de « dommage écologique » ; c’est-à-dire la reconnaissance juridique de la détérioration d’une ressource naturelle et l’obligation pour le pollueur de réparer financièrement le dommage. Ce principe mettra toutefois du temps à être reconnu et intégré dans le droit de l’environnement.

➤ Lire aussi | Le risque industriel sans effort (as soon as possible)・Thomas Le Roux (2021)

1980 : les grandes manifestations antinucléaires (Plogoff)

Plogoff est situé à l’extrême pointe de la Bretagne, au sud-ouest du cap Sizun, à proximité de la baie des Trépassés et de la pointe du Raz – haut lieu touristique célébré pour ses paysages grandioses. Accrochée à ses falaises granitiques, secouée par les vents et les tempêtes, cette petite commune littorale vivait traditionnellement des ressources de la pêche et de l’agriculture. Mais, au cours des années 1970, la commune, dont la population de 2 500 habitants environ commence à décroître, doit accueillir un vaste projet d’implantation d’une centrale nucléaire. EDF envisage d’y installer un site de 176 hectares, à cheval entre le domaine maritime et le territoire de la commune.

Bien que le conseil général du Finistère et le conseil régional aient d’abord donné leur accord, voyant dans la centrale une possibilité de modernisation et de désenclavement régional, la population locale s’insurge rapidement contre cette décision, bientôt rejointe par des militants de toute la France. Cette lutte de Plogoff est devenue un véritable mythe pour le mouvement écologique ; un exemple de combat victorieux et de mobilisation réussie puisqu’elle conduit le gouvernement socialiste, élu en 1981, à finalement abandonner le projet. Elle est d’ailleurs rapidement décrite dans des films et des récits qui livrent leurs témoignages à chaud et contribuent à la célébrité de cet épisode emblématique d’une nouvelle radicalité écologique autour de la question nucléaire9.

Au début de l’année 1980, alors qu’une enquête publique s’engage pour valider le projet d’implantation de la centrale, les manifestations se multiplient et les luttes entamées déjà depuis plusieurs années se durcissent, souvent violentes et massives. Le 16 mars 1980, 50 000 personnes défilent ainsi lors de la clôture de l’enquête publique ; le 24 mai suivant, ce sont plus de 100 000 manifestants qui convergent à Plogoff pour réaffirmer leur opposition au projet, condamné pour ses risques et ses impacts sur le milieu.

Cette lutte est devenue un lieu de mémoire du mouvement antinucléaire et écologiste, mais aussi le sujet de nombreux travaux d’histoire et de sciences sociales10. Le chercheur en sciences politiques Gilles Simon a ainsi montré comment cette lutte de Plogoff a pu devenir un puissant mouvement social par un apprentissage progressif des enjeux nucléaires, par l’invention de multiples espaces d’expressivité critique et de créativité, mais aussi par sa capacité à construire de complexes alliances médiatiques et politiques à différentes échelles.

Les opposants parviennent à agréger des acteurs et des motifs variés : défenseurs de l’esthétique des paysages, régionalistes en lutte contre la colonisation intérieure, paysans hostiles à la modernisation agro-industrielle, libertaires en lutte contre l’État nucléaire…

À l’origine de la lutte, on trouve d’abord de jeunes militants écologistes, souvent à fort capital scolaire, alliés à des figures historiques du mouvement antinucléaire et des luttes bretonnes. Leur force tient à leur capacité à associer des habitants moins familiers des mobilisations sociales, qu’il s’agisse de paysans hostiles à l’agriculture intensive ou d’épouses de marins désireuses de préserver leur milieu de vie. La lutte de Plogoff illustre aussi le passage de la première génération écologiste des années 1950, soucieuse de sauvegarder des sites remarquables, à une seconde, plus politisée, qui engage la lutte contre les pollutions et les aménagements du littoral en inscrivant désormais son action dans des enjeux globaux.

À Plogoff même, la mobilisation s’engage réellement à partir de juin 1976 lorsqu’une série de sondages réalisés par EDF conduit à la création d’un « comité de défense » suivie, en 1980, par la multiplication des « comités Plogoff » en Bretagne et dans tout le pays. L’ampleur exceptionnelle de cette lutte tient à de multiples facteurs : le soutien du maire, un retraité de la marine qui n’hésite pas à prendre la tête de la contestation, mais aussi celui de nombreux autres réseaux écologistes et antinucléaires. Les opposants parviennent à agréger des acteurs et des motifs variés : défenseurs de l’esthétique des paysages, régionalistes en lutte contre la colonisation intérieure, paysans hostiles à la modernisation agro-industrielle, libertaires en lutte contre l’État nucléaire…

Ces opposants réussissent, par ailleurs, à politiser la question nucléaire en sortant l’atome civil de la seule expertise technique via la diffusion et la production de savoirs profanes et alternatifs. Des savants critiques se mobilisent pour alerter sur les risques, comme des syndicalistes paysans, soucieux de défendre les terres agricoles contre les contaminations et les risques d’accident qui menacent leur activité. Ils déploient un vaste répertoire protestataire jouant de rituels et de symboliques variés pour faire entendre leur voix dans les médias et les arènes publiques. Les réunions et les conférences d’information, la présence physique via des stands, des affiches, mais aussi des happenings festifs ou l’installation d’une bergerie, ont largement contribué à la visibilité de la lutte et à la construction de ses relais médiatiques.

La population, renforcée de militants venus de toute l’Europe, engage une véritable guérilla contre les gendarmes sans cesse harcelés, notamment par des femmes et des mères de famille.

À la fin du mois de janvier 1980, le conflit s’exacerbe : des barricades sont érigées pour bloquer l’accès au village, la confrontation avec les gendarmes s’engage au son des cantiques en breton et des slogans antinucléaires. Dans les jours et les semaines qui suivent, la population, renforcée de militants venus de toute l’Europe, engage une véritable guérilla contre les gendarmes sans cesse harcelés, notamment par des femmes et des mères de famille. La violence redouble avec des jets de pierre et de cocktail molotov, même si l’appel à la non-violence est au cœur des actions écologistes. Le 24 mai 1980, 100 000 à 150 000 manifestants fêtent la fin de la procédure alors qu’un grand fest-noz clôt l’événement. La lutte réussit car elle rencontre une mobilisation exceptionnelle et durable, une capacité à multiplier les alliances et les compositions, une inventivité renouvelée en matière de symboles, dans un contexte international et politique favorable. Mais cette lutte joue aussi un rôle d’apprentissage et de construction d’une vie démocratique sur les enjeux nucléaires ; elle transforme les imaginaires de ceux qui y participent et ouvre de nouvelles libertés – rapidement fragilisées.

1994 : contre le tunnel du Somport (Urdos)

Initiée à la fin des années 1980 par des notables modernisateurs de part et d’autre de la frontière franco-espagnole, au nom du supposé « désenclavement » des territoires du Béarn et de l’Aragon, la construction du tunnel routier du Somport est officiellement décidée et lancée en 1991. Les Pyrénées représentent en effet une barrière physique qui impose de multiples contraintes aux échanges internationaux et, tout au long du xxe siècle, le projet d’un franchissement transpyrénéen ne cesse d’alimenter les projets et les rêves des aménageurs11. Le tunnel doit ainsi relier l’Espagne et la France à l’ouest de la chaîne pyrénéenne, à travers un grand ouvrage d’art de huit kilomètres. Déclarés d’utilité publique en 1993, les travaux doivent commencer en 1994.

Suscitant d’abord l’indifférence, ce projet d’aménagement routier à l’échelle européenne va peu à peu devenir l’une des luttes environnementales les plus emblématiques du milieu des années 1990, illustrant les nouvelles stratégies protestataires écologistes12. Dès les débuts de la construction, les oppositions éclosent localement avant de s’élargir de part et d’autre de la frontière et à l’échelle européenne. Lors de l’annonce du projet, en 1991, une brève occupation du site est organisée par le Comité pour la sauvegarde active de la vallée d’Aspe (Csava). Des groupes locaux voient peu à peu le jour, soutenus par des organisations militantes comme Les Amis de la Terre, FNE, Greenpeace, le WWF, Les Verts, le PCF, la Fédération anarchiste ou la Ligue communiste révolutionnaire.

La confrontation entre les opposants et les pouvoirs publics se durcit alors que les premiers déploient un vaste panel d’actions protestataires, alternant les mobilisations pacifiques, les actions de sabotage et d’occupation.

Cette opposition au tunnel mobilise rapidement des stratégies d’action diverses : des formes d’action directe, des procédures juridiques et des réflexions sur des alternatives, tout en mettant en avant les menaces sur les milieux locaux que fait peser l’essor du trafic routier. Malgré plusieurs années de contentieux juridiques et de controverses, les élus de tout bord soutiennent ce projet dans lequel ils voient un élément clé de l’essor économique et de l’ouverture de l’Espagne sur l’Europe ; les associations environnementales sont mises à l’écart et stigmatisées comme des freins au progrès.

La confrontation entre les opposants et les pouvoirs publics se durcit alors que les premiers déploient un vaste panel d’actions protestataires, alternant les mobilisations pacifiques, les actions de sabotage et d’occupation. Les grandes organisations écologistes nationales s’engagent aux côtés des opposants locaux, contribuant à la médiatisation de cette lutte. Mais, localement, la répression se déploie avec une intensité particulièrement forte : de nombreuses amendes sont distribuées pour faire taire les opposants alors que certains sont condamnés à de la prison. Dès 1992, quatre activistes sont ainsi condamnés à des peines avec sursis et de lourdes sommes en dommages et intérêts pour de simples graffitis à l’entrée du tunnel. Certains journaux dénoncent la criminalisation du mouvement, la disproportion des peines et la partialité de la justice en faveur du projet.

En réaction, des « comités Somport » apparaissent un peu partout pour soutenir la lutte alors qu’en 1994, une Coordination autonome des comités Somport pour l’arrêt immédiat des travaux en vallée d’Aspe est créée afin de coordonner leur action. Dans son témoignage paru en 2000, l’une des figures de l’opposition au tunnel a livré son récit de cette lutte, considérée à l’époque comme l’une des plus importantes en Europe. L’auteur y rappelle la liste des griefs et des arguments articulant les enjeux naturalistes (comme la défense de l’ours et de son habitat, et de la vallée de l’Aspe particulièrement riche sur le plan écologique) et la critique de l’essor du transport routier et de ses nuisances13.

L’opposition atteint son apogée en mai 1994, lorsque 7 000 à 10 000 personnes, répondant à l’appel d’une trentaine d’associations, convergent le dimanche 22 mai pour manifester contre le lancement du chantier. Ce rassemblement, d’abord pacifique, au sommet du col du Somport dégénère lorsque des affrontements ont lieu avec la police, blessant quatre personnes. Cette grande manifestation d’opposition au tunnel, menée notamment par Éric Petetin, surnommé « l’Indien » (l’une des figures locales de la contestation, arrêtée plusieurs fois et qui multiplie les actions spectaculaires comme une grève de la faim), frappe l’opinion par son ampleur14. Cette mobilisation devient l’une des grandes luttes écologistes de la fin du XXe siècle. Les manifestants venus d’Espagne, de nombreuses régions de France, mais aussi d’Allemagne ou de Belgique, protestent contre la transformation d’une vallée verdoyante en couloir routier, alors même qu’existe à proximité un ancien tunnel ferroviaire. Ils mobilisent un large répertoire d’arguments et d’actions, proposant aussi des alternatives de mobilité, comme la réouverture de la ligne ferroviaire Pau-Canfranc qui a fermé dans les années 1970.

La lutte du Somport devient aussi emblématique des luttes écologistes et de leur capacité à mobiliser largement en agrégeant des acteurs d’horizons variés.

La presse locale tend d’abord à ridiculiser et à marginaliser les opposants, comme de doux rêveurs ou des marginaux ; le journal Sud-Ouest, par exemple, discrédite cette « Internationale anti-tunnels » qui « n’attire qu’une poignée d’étrangers »15. Mais la lutte du Somport devient aussi emblématique des luttes écologistes et de leur capacité à mobiliser largement en agrégeant des acteurs d’horizons variés. Après 1994, toutefois, les stratégies protestataires évoluent et les opposants se divisent ; plusieurs milliers de personnes font, par exemple, le choix d’acquérir des terrains pour ralentir le chantier. En dépit de ses limites et de ses difficultés, la lutte contre cette infrastructure contribuera à repousser l’ouverture du tunnel – qui n’aura lieu qu’en 200316.

➤ Lire aussi | Relire “L’utopie ou la mort”・Christophe Bonneuil (2020)

Image d’accueil : photographie d’Eugène Le Droff, tirée du Cahier d’illustrations du livre “Plogoff – L’apprentissage de la mobilisation sociale” de Gilles Simon, publié aux Presses universitaires de Rennes en 2010 et disponible en ligne.

NOUS AVONS BESOIN DE VOUS !

Depuis 2018, Terrestres est la revue de référence des écologies radicales.

À travers des essais, enquêtes, traductions inédites et récits de résistances, nous explorons les nouvelles pensées et pratiques nécessaires pour répondre à la catastrophe écologique.

Chaque semaine, nous publions en accès libre des articles qui approfondissent les enjeux écologiques, politiques, et sociaux, tout en critiquant l’emprise du capitalisme sur le vivant. Plus qu’une revue, Terrestres est un laboratoire d’idées et un lieu de réflexions critiques, essentielles à l’élaboration d’alternatives justes et émancipatrices.

En nous lisant, en partageant nos articles et en nous soutenant, par vos dons si vous le pouvez, vous prenez le parti de l’écologie radicale dans la bataille culturelle qui fait rage.

Merci  !

!

Notes

- F. Charvolin, « L’affaire de la Vanoise et son analyste. Le document, le bouquetin et le parc national », Vingtième Siècle. Revue d’histoire, vol. 113, n° 1, 2012, p. 82-93.

- A. Selmi, Administrer la nature : Le parc national de la Vanoise, Maison des sciences de l’homme/Quae, 2006.

- J. Carlier, Vanoise : Victoire pour demain, Calmann-Lévy, 1972.

- F. Charvolin, « L’affaire de la Vanoise et son analyste », art. cité.

- L’émission « La France défigurée » consacre un reportage dès le 30 juillet 1972, à « La pollution des boues rouges en Corse » (https://www.ina.fr/ina-eclaire-actu/video/caf89044016/la-pollution-des-boues-rouges-en-corse).

- M. Lefevre, « Écologie et géopolitique en Corse », Hérodote, vol. 100, n° 1, 2001, p. 32-54.

- L. Molinelli, Boues rouges : La Corse dit non, L’Harmattan, 1995.

- S. Marteau, « L’affaire des boues rouges, une histoire Corse », Le Monde, M-le-mag, dimanche 30 juillet 2023.

- En 1980 sort au cinéma le documentaire « Plogoff, des pierres contre des fusils » de Nicole Le Garrec et plusieurs témoignages de militants actifs dans la mobilisation paraissent : T. Le Diouron, A. Cabon, G. de Lignières, Plogoff-la-révolte, Le Signor, 1980 ; R. Pichavant, Les Pierres de la liberté : Plogoff, 1975-1980, Morgane, 1980.

- T. Kernalegenn, Luttes écologistes dans le Finistère (1967-1981) : Les chemins bretons de l’écologie, Yoran Embanner, 2006 ; G. Borvon, Plogoff : Un combat pour demain, Cloître, 2004 ; G. Simon, Plogoff : L’apprentissage de la mobilisation sociale, PUR, 2010 ; V. Porhel, « Genre, environnement et conflit à Plogoff (1980) », Genre & Histoire, n° 22, automne 2018.

- P. Delas, « Le passage international du Somport : le grand rêve des transpyrénéens », Revue géographique des Pyrénées et du Sud-Ouest. Sud-Ouest Européen, vol. 45, n° 3, 1974, p. 243-270.

- G. Hayes, « Opportunity, Protest, and the Somport Tunnel », Environmental Protest, op. cit.

- J.-L. Paladio, Somport, le tunnel de l’absurde, (auto-édition), 2000.

- « Le cas Petetin. L’écologiste du Somport est en prison pour quatorze mois, victime d’une répression judiciaire disproportionnée », Le Monde, 31 juillet 1993.

- J.-P. Crabe, « Rôle et utilisation de la presse dans l’affaire du tunnel du Somport », Mémoire de maîtrise d’histoire, université de Pau et des Pays de l’Adour, 1998.

- A. Cazenave-Piarrot, « Le franchissement des Pyrénées centrales : contraintes, pratiques, enjeux », Revue géographique des Pyrénées et du Sud-Ouest. Sud-Ouest Européen, 2004/17, p. 123-137.

L’article Quand l’écologie était populaire et (souvent) victorieuse est apparu en premier sur Terrestres.

24.04.2026 à 07:30

« Nous travaillons gratuitement comme liquidateur·ices nucléaires »

Kate Brown· Nassima Abdelghafour · Martin Denoun

Alors que l’on commémore les 40 ans de Tchernobyl, que les plans de relance du nucléaire civil se multiplient et que l’ombre de l’arme atomique plane toujours sur le monde, deux sociologues s’entretiennent avec l’historienne Kate Brown. Au menu : le mythe du confinement, les contaminations durables, les dépollutions impossibles et l’importance des contre-enquêtes.

L’article « Nous travaillons gratuitement comme liquidateur·ices nucléaires » est apparu en premier sur Terrestres.

Texte intégral (9974 mots)

Temps de lecture : 24 minutes

Un entretien avec Kate Brown réalisé par Nassima Abdelghafour et Martin Denoun, publié en partenariat avec Reporterre, où vous pouvez retrouver une version raccourcie de ce texte.

Deux ouvrages importants de l’historienne états-unienne Kate Brown, professeure d’histoire au Massachusetts Institute of Technology, ont été traduits en français ces dernières années. Tchernobyl par la preuve. Vivre avec le désastre et après et Plutopia. Une histoire des premières ville atomiques, sont parus respectivement en 2021 et 2024 chez Actes Sud. À la fois très documentés et rigoureux, si bien écrits qu’ils se lisent comme des romans, ces deux ouvrages nous plongent dans des catastrophes nucléaires massives. Plutopia nous fait découvrir des catastrophes discrètes et presque routinières, quand Tchernobyl par la preuve braque un nouvel éclairage sur une catastrophe bien connue qui n’en finit pas d’advenir.

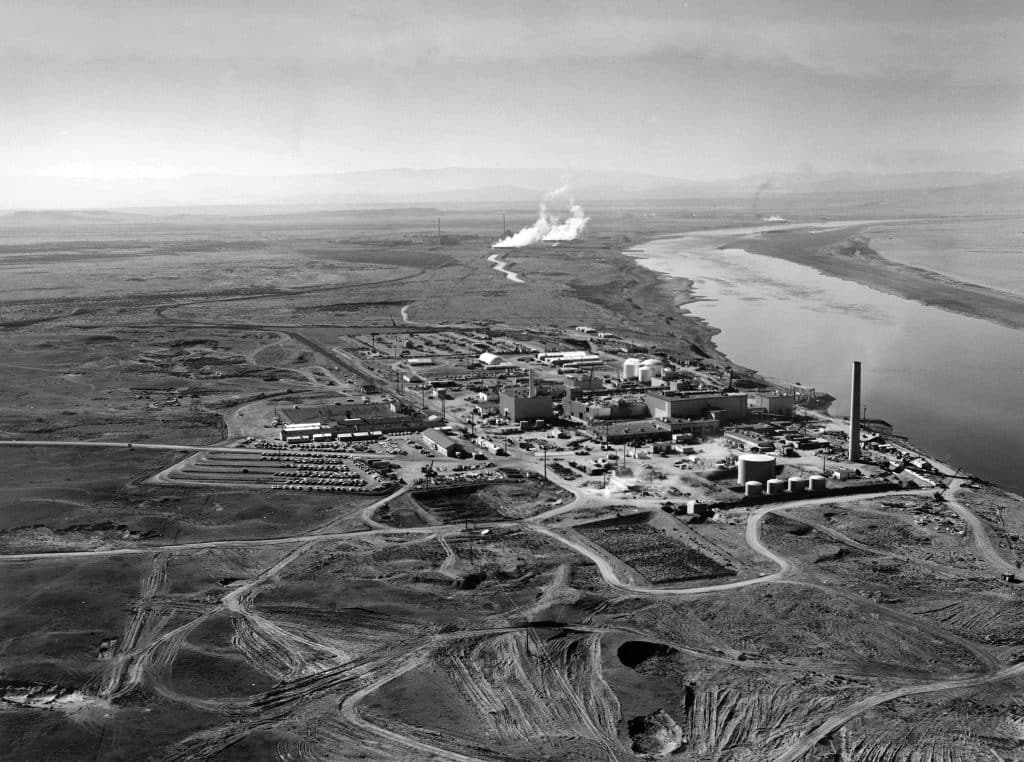

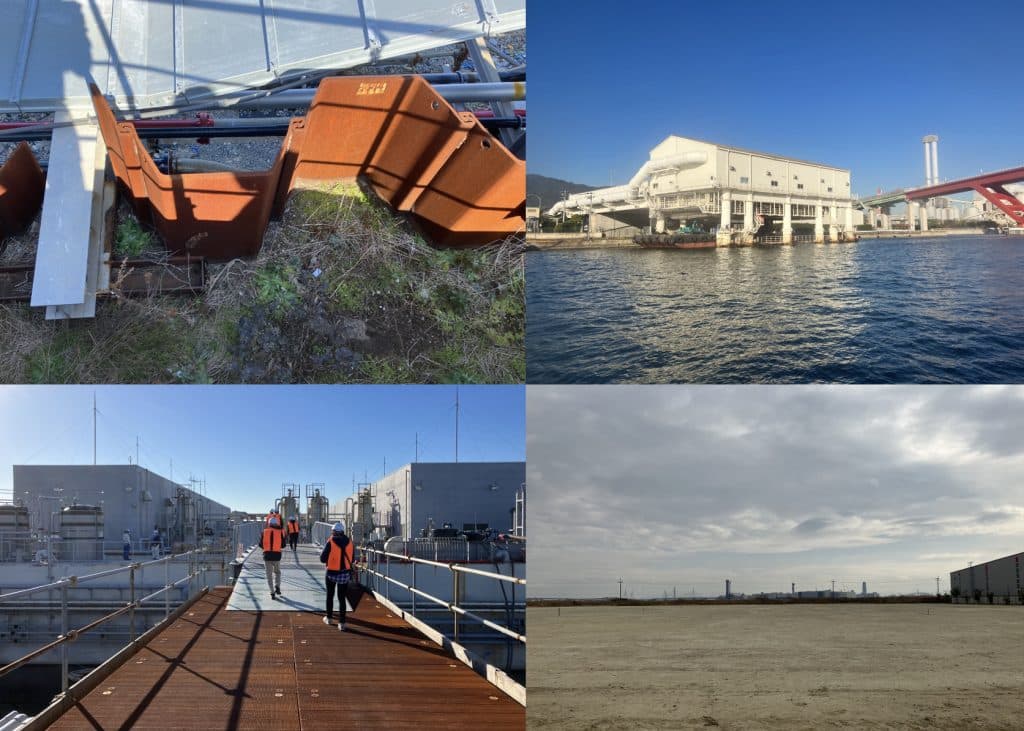

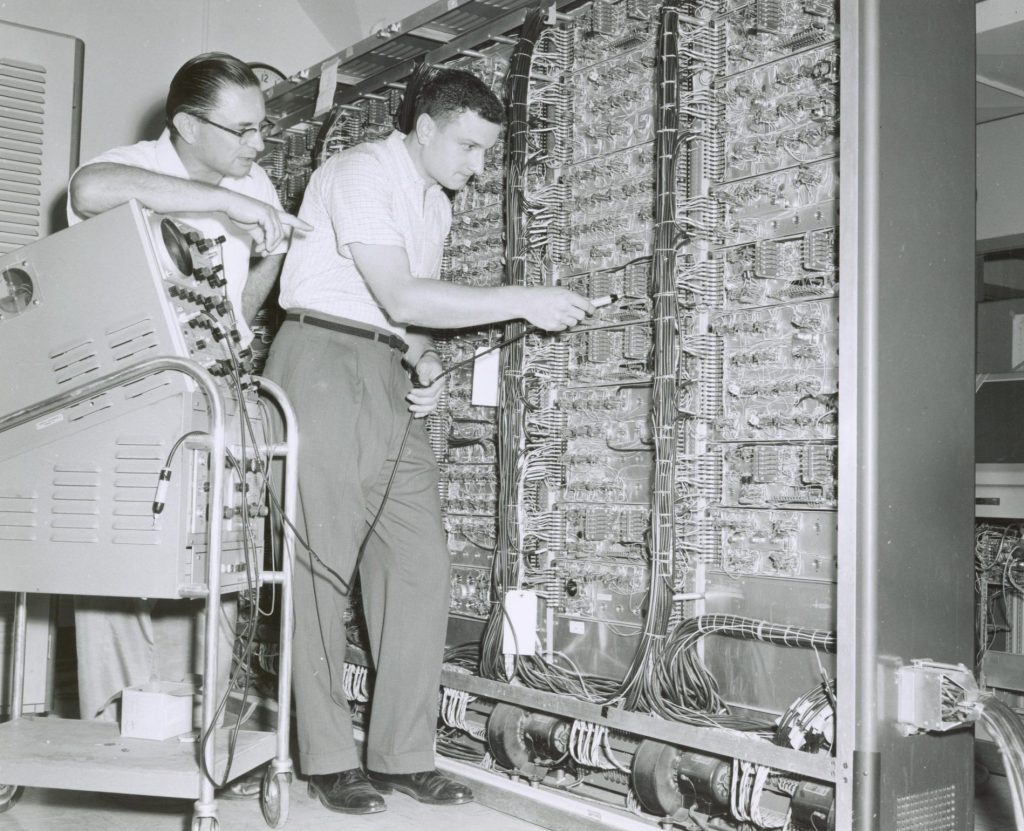

Dans Plutopia, Kate Brown suit les traces de deux villes-usines nucléaires créées dans les années 1940 dans des lieux reculés. C’est l’histoire de l’industrie naissante du plutonium, ce métal radioactif nécessaire à la fabrication de bombes atomiques, à la fois aux États-Unis et en URSS. Elle décrit comment ont été conçus, construits et gérés les sites de Hanford près de la ville de Richland, dans l’est de l’État de Washington aux Etats-Unis, et de Maïak près de la ville d’Ozersk, dans l’Oural, en URSS. L’usine de Hanford, cheville ouvrière du projet Manhattan, a produit le plutonium de la bombe larguée sur Nagasaki. La construction du complexe nucléaire de Maïak a démarré en 1945 et a marqué le début de la course aux armements nucléaires pendant la guerre froide. Pour ces raisons, les deux sites ont été construits et exploités secrètement. Au fil des années, des quantités gigantesques de polluants radiotoxiques sont déversées dans l’environnement autour des usines de plutonium. Et pourtant, Richland et Ozersk, les villes attenantes aux sites respectifs de Hanford et Maïak, sont des villes laboratoires où s’expérimentent à la fois le contrôle biomédical des habitant·es et la promesse d’une vie urbaine confortable et privilégiée.

“Plutopia” nous fait découvrir des catastrophes discrètes et presque routinières, quand “Tchernobyl par la preuve” braque un nouvel éclairage sur une catastrophe bien connue qui n’en finit pas d’advenir.

Dans Tchernobyl par la preuve, on suit Kate Brown dans une enquête passionnante et parfois rocambolesque sur les traces de l’accident de Tchernobyl et de ses suites. En exploitant des archives régionales qui n’avaient jamais été dépouillées, l’historienne raconte ce qu’un accident nucléaire implique : une gestion à l’aveugle face à des processus chimico-physiques échappant aux collectes de données classiques, des mensonges visant à masquer à la fois ce qui est su et ce qui est ignoré, des pollutions hétérogènes qui résistent aux schémas rassurants de gestion de crise, des contaminations qui s’accumulent au cours du temps et circulent très loin, des corps exposés qui souffrent en silence, et enfin des citoyen·nes qui se font enquêteur·ices et qui bâtissent des contre-savoirs essentiels pour mettre fin à ce silence.

Nassima Abdelghafour et Martin Denoun – Une même tension traverse Plutopia et Tchernobyl par la preuve : depuis ses débuts, l’industrie nucléaire a produit un discours public qui insiste sur le confinement de l’activité nucléaire dans des espaces clos et contrôlés. Dans les trois cas que vous analysez – les usines de Hanford et de Maïak, et l’accident de Tchernobyl – vous montrez que ce confinement est mis en échec non seulement par les radionucléides, mais aussi par les humains, qui circulent constamment entre ces espaces à accès restreint et l’extérieur.

Kate Brown – J’étais dans une épicerie haut-de-gamme, à Washington DC, la tête dans un congélateur, un compteur Geiger à la main. Je passais le compteur au-dessus d’un sac de myrtilles sauvages surgelées en réfléchissant à cette affaire de confinement de la contamination nucléaire. J’avais remarqué lors d’un séjour dans le nord de l’Ukraine – je travaillais sur les effets de Tchernobyl – que des milliers de personnes sortaient de forêts marécageuses autour de Tchernobyl avec des paniers pleins de myrtilles à la main. Ils les vendaient à des acheteurs qui attendaient dans des camions le long de la route. L’échelle industrielle de cette cueillette m’a intriguée. Avec mon assistante de recherche, Olha Martynyk, nous nous sommes procurées des paniers et sommes allées à la cueillette aussi. Nous avons apporté nos myrtilles dans l’entrepôt où une grossiste achetait les myrtilles apportées par les camions que nous avions vus. Chaque myrtille qu’elle testait était radioactive, certaines bien au-delà du seuil de 450 Becquerels le kilo, en vigueur en Ukraine, mais elle a tout acheté quand même. Je me suis demandée pourquoi, jusqu’à ce que j’apprenne que la norme dans l’Union Européenne et aux États-Unis est de 1200 Bq le kilo. En mélangeant les baies dépassant le seuil avec celles restant en dessous, la grossiste pouvait légalement vendre ses baies dans l’UE, bien que certaines myrtilles testées aient atteint 3000 Bq par kilo. Je découvrais avec étonnement cette dispersion délibérée et régulée des radiations de Tchernobyl par les marchés.

J’ai trouvé un rapport du département de la sécurité intérieure aux États-Unis sur un camion qui avait déclenché les compteurs Geiger à la frontière avec le Canada. Qu’y avait-il dans le camion ? Des myrtilles d’Ukraine. C’est cela qui m’a menée jusqu’au congélateur du magasin, pour constater à quel point les myrtilles de Tchernobyl étaient proches de mon propre petit-déjeuner. La vente de produits radioactifs ne relève pas d’une logique de confinement, mais de prolifération. Et elle est organisée par de nombreux acteurs qui expédient les myrtilles, airelles et champignons cueillis dans les forêts de Tchernobyl aux consommateur·ices partout dans le monde.

La vente de produits radioactifs est organisée par de nombreux acteurs qui expédient les myrtilles, airelles et champignons cueillis dans les forêts de Tchernobyl aux consommateur·ices partout dans le monde.

Il s’agit là d’une prolifération organisée délibérément. Mais que se passe-t-il dans les cas où un confinement est vraiment mis en œuvre ?

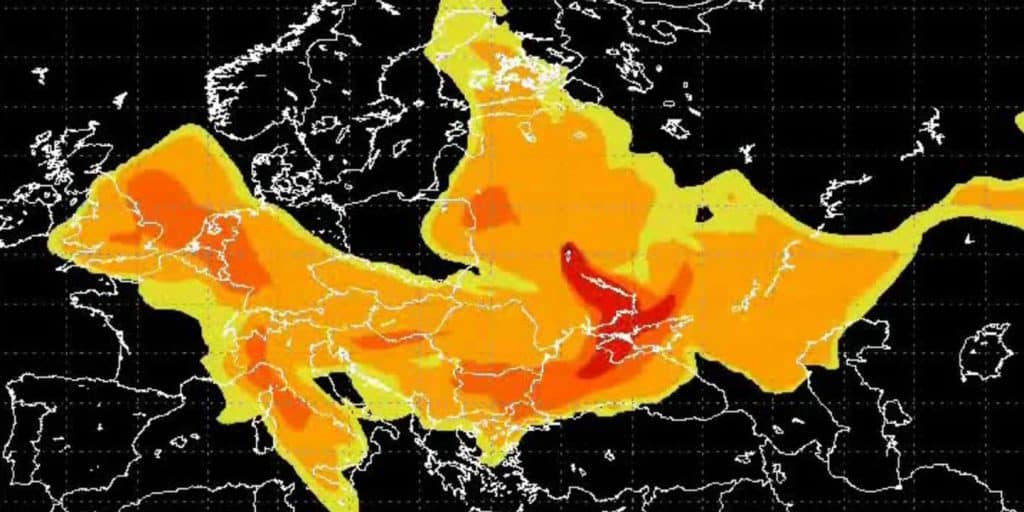

Kate Brown – En effet, même lorsqu’il est appliqué, le confinement n’est pas la panacée. Quelques jours après l’accident de Tchernobyl en 1986, les dirigeants soviétiques ont tracé un cercle autour de la centrale et de la ville de Pripyat, et en ont interdit l’accès. La nouvelle « zone d’exclusion » avait pour objectif de préserver les gens de la contamination radioactive, invisible et imperceptible, qui se répandait selon des trajectoires irrégulières depuis le réacteur n° 4 encore en flammes. L’évacuation qui a suivi, ainsi que les patrouilles dans la zone d’exclusion ont sans doute sauvé des milliers de gens d’une exposition à de dangereuses doses, mais cette zone a aussi conduit à des formes d’exposition par inadvertance. Les dirigeants soviétiques ont vite appris qu’on ne pouvait pas contenir les isotopes, qui voyageaient par le vent, dans l’eau, sur les pneus des camions et les vêtements des gens. À l’été 1986, presque tous les échantillons testés par les pouvoirs publics – lait, pain, beurre, viande, thé, produits frais – étaient contaminés. L’existence de la zone d’exclusion, vidée de ses habitant·es et contrôlée, couplée avec l’incapacité des dirigeants soviétiques à publier des cartes représentant de manière dynamique la diffusion de la radioactivité dans des lieux où les gens vivaient et produisaient de la nourriture, a conduit de nombreuses personnes à se croire en sécurité, à tort.

L'infolettre des Terrestres

Toutes les deux semaines, dans votre boîte mail : un éditorial de la rédaction, le résumé de nos dernières publications, un conseil de lecture des Terrestres et des articles tirés de nos archives, en écho à l'actualité.

Les confinements sont donc aussi des dispositifs de contrôle de l’information ?

Kate Brown – Tout à fait. Une bonne partie de Tchernobyl par la preuve décrit les problèmes très variés dont se plaignaient les gens aux médecins dans les zones contaminées autour de Tchernobyl. Au lieu des 54 victimes de Tchernobyl officiellement reconnues, le gouvernement ukrainien a fait état en 2016 de 150 000 victimes, seulement pour l’Ukraine, ce qui est une estimation plus fidèle de l’impact de l’accident – la Biélorussie et la Russie, qui ont reçu 80% de la radioactivité après l’accident, n’ont quant à elles pas produit de chiffres.

C’est la même chose autour des usines de plutonium. Hanford et Maïak sont des sites militaires, clôturés et gardés. Seules les personnes munies d’un badge pouvaient entrer, et n’avaient accès qu’à certaines zones du site. En compartimentant les sites, les dirigeants militaires confinaient l’information, craignant l’espionnage d’une puissance nucléaire rivale. Ils craignaient aussi les dirigeants locaux trop curieux, puis plus tard, les riverain·es inquièt·es des clusters de cancers, pathologies thyroïdiennes et autres maladies auto-immunes dans les communautés de fermiers autour des usines. Dans les premières années après l’accident de Tchernobyl, confiner l’information et les connaissances sur les rayonnements ionisants a été le résultat le plus significatif des zones nucléaires contrôlées. Malheureusement, ni les clôtures ni les gardes n’ont pu confiner la radioactivité elle-même.

Au lieu des 54 victimes de Tchernobyl officiellement reconnues, le gouvernement ukrainien a fait état en 2016 de 150 000 victimes, seulement pour l’Ukraine – la Biélorussie et la Russie, qui ont reçu 80% de la radioactivité après l’accident, n’ont quant à elles pas produit de chiffres.

Hanford et Maïak ont relâché environ 350 millions de curies de contaminants radioactifs dans l’environnement, c’est presque le double de l’accident de Tchernobyl selon les estimations les plus hautes. Le problème n’est pas non plus contenu dans le temps. En 2017, des émissions radioactives dues à des feux dans la Forêt Rouge autour de Tchernobyl ont été détectées jusqu’en Hollande ! Le mythe du confinement est puissant et omniprésent, alors que la diffusion de la radioactivité a des conséquences qui perdurent. En 2016, les trois comtés autour de la réserve nucléaire de Hanford ont vu un nombre très élevé d’enfants naître avec une anencéphalie, une malformation rare et mortelle. Entre 2010 et 2016, ces trois comtés ont enregistré un taux de pathologies du tube neural (le système nerveux des embryons) de 12,7 pour 10 000 naissances, contre 6,4 en moyenne dans le pays. Le rapport du ministère de la santé de l’État de Washington concernant ce taux alarmant n’a indiqué aucune cause pouvant l’expliquer. La radioactivité émanant de la réserve nucléaire a été considérée pendant un temps, puis écartée, puisque la radioactivité était prétendument confinée par la clôture, et rapidement évacuée par le débit important du fleuve Columbia et les vents puissants qui balayent la plaine. Après avoir recommandé aux femmes enceintes de prendre de l’acide folique en complément alimentaire, l’État a classé l’affaire et cessé de surveiller les malformations à la naissance dans ces trois comtés. Cet exemple illustre comment ce mythe du confinement des radiations a survécu à la fin de la guerre froide.

À rebours du caractère singulier et extraordinaire de la radioactivité, vous montrez aussi – c’est là une des originalités de votre livre Plutopia– que les villes du plutonium (Richland aux États-Unis et Ozersk en URSS) fonctionnent comme des matrices d’organisation sociale, avec d’étonnantes similitudes entre les deux blocs antagonistes. Vous décrivez comment la mise en place secrète de l’industrie du plutonium, extrêmement polluante et dangereuse, va de pair avec la manière dont les villes du plutonium deviennent des laboratoires préfigurant ce qu’allait devenir la vie urbaine de l’après-guerre. Comment vous est venue l’intuition que ces villes atomiques étaient aussi, plus prosaïquement, des lieux d’expérimentation sociale ?

Kate Brown – Deux choses m’ont permis de comprendre que ces villes fermées et top-secrètes, créées spécialement pour la production de plutonium, étaient les lieux d’expérimentations sociales qui ont constitué des modèles d’urbanisme dans leurs sociétés respectives. La première, c’est que ces villes semblent désespérément normales. La première fois que j’ai visité Richland, j’ai été déçue. Je circulais dans des rues larges, le long de maisons toutes similaires, aux pelouses impeccables. Fuyant le murmure de l’arrosage automatique, j’ai fini au centre commercial « Atomic », entouré d’hectares de parking… Pourquoi étais-je venue jusqu’ici ? Cette ville n’avait rien de top-secret ! C’était une banlieue américaine typique de l’après-guerre. C’est seulement par la suite que j’ai compris que l’entreprise DuPont (en charge de l’usine de Hanford) a utilisé les financements fédéraux dont elle bénéficiait pour faire de Richland une communauté modèle, dédiée aux familles blanches à la recherche d’un environnement sécurisé pour élever leurs enfants. Selon DuPont, l’objectif était d’attirer des cadres ainsi que les meilleurs ouvriers à Richland, une petite localité isolée dans l’est de l’État de Washington. Les maisons avaient le confort moderne, de l’électroménager dernier cri, et des loyers subventionnés par le gouvernement fédéral. Richland avait d’excellentes écoles, un service de bus, de nombreux commerces, parcs et loisirs. La largeur des rues rendait possible une évacuation de masse. Le centre commercial pouvait faire office d’abri anti-aérien, et les immenses parkings, de coupe-feu.

La ville soviétique dédiée au plutonium s’appelait Ville-40 (elle a ensuite été renommée Ozersk, qu’on peut traduire par « la vallée du lac »). Je n’ai jamais pu y entrer parce qu’Ozersk est resté une ville fermée, même dans les années 1990, période où la course à l’armement nucléaire ralentissait. Mais d’après les photos et les descriptions, j’ai compris qu’Ozersk aussi était une ville modèle pour les citoyens soviétiques. Chaque famille bénéficiait d’un logement individuel plutôt que d’une pièce dans un appartement communautaire. Bordant un lac, entourée de forêts, Ozersk avait de beaux parcs, des théâtres, des centres sociaux et des restaurants. Il y avait même un club nautique. Les soviétiques aimaient surtout les magasins bien approvisionnés, où l’on trouvait, comme une ancienne habitante me l’a dit « tout, même du crabe et du caviar ».

➤ Lire aussi | L’utopie nucléaire des villes atomiques de la guerre froide・Kate Brown (2026)

Au contraire, les étagères des magasins soviétiques de province étaient souvent vides. Les villageois·es de la partie sud de l’Oural, autour d’Ozersk, devaient cultiver ou cueillir dans les bois, puis mettre en conserve leur propre nourriture pour répondre à leurs besoins nutritionnels. Acheter des vêtements ou des meubles nécessitait des déplacements dans les grandes villes et de longues files d’attente. Mais pas à Ozersk. C’était une utopie consumériste. Après un accident nucléaire majeur en 1953, des employé·es de l’usine de plutonium de Maïak, voyant des retombées grises venant de l’usine et des ambulances transportant à toute allure de jeunes soldats mortellement blessés à l’hôpital, ont démissionné. Mais après seulement quelques mois dans « le vaste monde », comme ils l’appelaient, ils ont supplié de récupérer leur emploi et de revenir dans la forteresse bien gardée et bien approvisionnée d’Ozersk.

Ces villes dédiées au plutonium sont devenues des modèles de développement urbain d’après-guerre dans chaque pays. Bénéficiant de prêts subventionnés par l’État fédéral, les Américains blancs ont déserté les villes pour des banlieues peuplées d’autres Blancs, paradis des enfants et des automobilistes, qui se sont développées partout dans le paysage américain. Les soviétiques, à la même période, faisaient tout pour quitter les villages et les bourgs et s’installer dans les villes, bien approvisionnées. Les villes-usines comme Ozersk, dédiées à la production d’un seul produit, où la direction de l’usine veille à bien approvisionner ses employés, ont fleuri en URSS.

Le deuxième indice qui m’a menée à la conclusion que les plutopies n’étaient pas exceptionnelles, c’est que les contaminants auxquels les travailleur·euses et les résident·es d’Ozersk et de Richland ont été exposé·es via leur nourriture, leur eau et l’air ne sont pas absents du reste du monde. Du césium, du strontium radioactifs et parfois du plutonium sont régulièrement identifiés dans les corps des habitant·es des États-Unis et de Russie. Après que les essais nucléaires se sont multipliés dans le monde, pas grand-chose ne distinguait biologiquement un·e habitant·e de Plutopia de ses compatriotes vivant dans des villes ordinaires… mis à part le volume des contaminants !

Du césium, du strontium radioactifs et parfois du plutonium sont régulièrement identifiés dans les corps des habitant·es des États-Unis et de Russie.

La question de la contamination radioactive est au cœur de vos deux livres. Vous décrivez précisément comment les corps humains et animaux, les plantes, le sol, l’air et l’eau sont contaminés par les pollutions radioactives. Vous expliquez par exemple comment les effluents radioactifs libérés par l’accident de Tchernobyl se sont répandus, débordant le découpage par zones d’évacuation hiérarchisées en fonction de leur distance avec le réacteur explosé. La météo, la topographie et le style de vie (par exemple, la consommation de légumes du potager plutôt que d’aliments emballés) ont conduit à des niveaux de contamination parfois très élevés dans des endroits pourtant éloignés.

Kate Brown – Les principes habituels pour se protéger des radiations et autres produits toxiques reposent sur l’espace et le temps. Les recommandations en cas d’urgence incitent les gens à se mettre à distance des sources de toxicité et à limiter la durée d’exposition. Mais ce que j’ai trouvé en étudiant Richland, Ozersk et Tchernobyl, les endroits du globe où le plus de pollution radioactive a été relâchée, c’est que la présence de radiations déjoue les conventions de mesure du temps et de l’espace – le temps décompté en secondes, en minutes, et jusqu’en années, et l’espace mesuré en mètres. En conséquence, les scientifiques ont fini par mésinterpréter les effets des contaminants sur la santé humaine. Ils l’ont fait sans arrière-pensée, en appliquant les procédures standard de radioprotection, ou pas tout-à-fait innocemment, à travers leurs efforts pour rassurer les citoyens anxieux en minimisant les effets des radiations sur la santé.

Comment les produits radiotoxiques déforment-ils le temps et l’espace ?

Kate Brown : Prenons d’abord l’espace. Un accident nucléaire se produit, et des hommes en combinaison arrivent avec du matériel pour construire des clôtures. Ils délimitent un espace contaminé et installent des panneaux avertissant du danger. Ces zones laissent penser, à tort, que le danger se situe d’un côté de la clôture, et la sécurité de l’autre. Les citoyens vivant de l’autre côté des clôtures autour de l’usine de Hanford aux États-Unis ou de celle de Maïak en URSS croyaient que les barrières ainsi que les procédures de sécurité exécutées religieusement à l’intérieur de la zone les protégeaient. Et c’était le cas, dans une certaine mesure, mais les produits radiotoxiques sont dangereux pour la santé humaine parce qu’ils ne sont ni stables ni inertes. En mouvement perpétuel, ils imitent de manière opportuniste les éléments dont les organismes ont besoin pour vivre. Les plantes et les animaux se chargent de toxines radioactives et les transportent avec eux. Les isotopes radioactifs se fixent sur les molécules d’eau et de terre, se répandent au gré des courants jusque dans les tubes digestifs des mammifères. Les clôtures montées pour les retenir sont rapidement débordées. Les cartes représentant l’extension de la contamination radioactive deviennent obsolètes dans les jours qui suivent leur impression.

Néanmoins, les scientifiques travaillant pour l’Agence internationale de l’énergie atomique (AIEA) qui ont été chargés en 1990 de déterminer l’impact de l’accident, en termes de santé publique, dans les territoires habités autour de Tchernobyl, ont procédé comme si les cartes décrivant l’étendue de la contamination et les clôtures décrivaient la réalité. Ils ont mené une étude comparant des habitants de territoires « propres » et « contaminés ». Au cours d’une mission de trois semaines, les consultants des Nations Unies ont examiné 1600 personnes. Ils ont conclu que la santé des habitant·es des villages contaminés comme celle des villages du groupe « de contrôle » était mauvaise et se dégradait depuis l’accident de Tchernobyl, qui avait relâché près de 200 millions de curies de radiation. Les scientifiques ont conclu que dans les villages, contaminés ou appartenant au groupe de contrôle, les gens ne souffraient pas des radiations car les doses étaient trop faibles, d’après eux, pour créer des problèmes de santé – la référence étant à ce moment-là les doses, bien supérieures, absorbées par les survivants de la bombe atomique. Les scientifiques des Nations Unies ont conclu que les habitants souffraient d’anxiété, d’une mauvaise alimentation et d’une consommation excessive d’alcool1.

Seulement, l’exposition aux radiations ne se réduit pas à la distance. Les gens vivant dans les zones considérées comme fortement exposées ont eu le droit à une aide gouvernementale, qui leur a permis d’acheter de la nourriture produite ailleurs et acheminée par des camions. Ces fermiers-là ont continué leur activité, mais au lieu de consommer la majeure partie de la nourriture produite, ils ont vendu ces denrées contaminées sur les marchés des villages voisins, où la contamination enregistrée était plus faible, et que les scientifiques avaient assignés au groupe de contrôle. Dans ce cas, des habitant·es plus éloignés des zones fortement irradiées ont finalement été plus exposé·es que d’autres vivant plus près. La distance ne les a pas protégés.

Au lieu de consommer la majeure partie de la nourriture produite, les fermiers ont vendu ces denrées contaminées sur les marchés des villages voisins, où la contamination enregistrée était plus faible.

Comment les radiations déforment-elles le temps ?

Kate Brown – Le temps dans les zones radioactives ne s’écoule pas uniformément : il se gonfle et se contracte de manière imprévisible2. Pour les pompiers et travailleurs nucléaires de Tchernobyl, qui ont vieilli prématurément en raison des radiations, le temps s’est accéléré. Dans des endroits comme la Forêt Rouge, 10 km2 de pins sylvestres fortement touchés par les retombées du réacteur en flammes, le temps s’est ralenti : des arbres qui auraient dû se décomposer en quelques années étaient toujours là deux décennies plus tard, en raison du peu d’insectes et de microbes présents pour accomplir le travail de décomposition3. Le vieillissement accéléré des humains s’est aussi produit dans les zones de production de plutonium, mais s’agissant de sites militaires, peu de données ont été publiées à ce sujet.

Revenons à la guerre froide un instant. Une partie des faits que vous décrivez dans Tchernobyl par la preuve ont été mis au jour par des gens que vous appelez des « héros du quotidien ». Sans soutien institutionnel, avec leurs propres ressources et malgré les risques, elles et ils ont enquêté sur la catastrophe de Tchernobyl et ses conséquences. Pouvez-vous nous parler de ces personnes ?

Kate Brown – Ces héros du quotidien sont formidables ! Natalia Lozyts’ka enseignait la physique à Kiev. Elle avait accès à un compteur Geiger et avait remarqué les coups de soleil violacés et les évanouissements de ses enfants après l’accident. Elle a commencé à mesurer la radioactivité sur son paillasson et dans la cour devant chez elle. Elle a trouvé des points intensément radioactifs, et a prélevé avec une truelle de minuscules particules dont la radioactivité s’élevait à 3 milli-Roentgen par heure. Elle les a scotchées sur une feuille de papier, noté les lieux et dates des prélèvements. Elle a mesuré leur radioactivité chaque jour, et à mesure que ces particules se dégradaient, elle a pu calculer la quantité de radionucléides contenus à l’intérieur4. Confrontée à la totale absence d’information concernant la radioactivité après l’accident, elle a utilisé ces minuscules fragments radioactifs pour comprendre ce qui s’était passé, 170 km au nord de Kiev. Elle a découvert tout un spectre de radioactivité et en a déduit que le réacteur n’avait pas explosé en raison d’un dégagement de vapeur ou d’une réaction chimique, comme les autorités soviétiques l’avaient affirmé, mais qu’il s’agissait bel et bien d’une explosion nucléaire – cela n’a ensuite été confirmé qu’en 2016 par Lars Erik de Geer et son équipe, dans un laboratoire extrêmement bien équipé5. Lozyt’ska était si inquiète de sa découverte qu’elle s’est mise à mesurer la radioactivité dans des villages voisins. Les fermiers lui parlaient de leurs symptômes, troublants – maux de gorge, saignements de nez, vertiges et évanouissements. Elle a écrit aux dirigeants pour les informer de ses recherches, mais n’a reçu aucune réponse. Elle a envoyé plusieurs autres courriers, que j’ai retrouvés dans les archives. Finalement, voulant désespérément faire passer le message, elle s’est déguisée en femme de ménage et s’est introduite à la première conférence sur les conséquences sanitaires de l’accident de Tchernobyl, en mai 1988 – un spectacle organisé depuis Moscou pour rassurer le monde entier6. Trois agents du KGB ont attrapé Lozyt’ska essayant de transmettre des documents à un délégué états-unien. Ils l’ont expulsée manu militari. Cela ne l’a pas dissuadée, elle a trouvé d’autres moyens de diffuser l’information.

Alexandre Komov, un autre héros rencontré dans les archives, ne parvenait pas à convaincre les autorités de Kiev que dans sa province de Rivni, pourtant éloignée de Tchernobyl, le lait était trop contaminé pour être consommé. Il a finalement chargé un camion de briques de lait et l’a conduit jusqu’à Kiev, pour que les dirigeants sceptiques le testent eux-mêmes. Dans la ville ukrainienne de Zhytomyr, le Dr Pavel Chekrenev a découvert que l’eau rejetée par une tannerie locale était six fois plus radioactive que les seuils autorisés en cas d’urgence, pourtant élevés. Cette eau se déversait dans le réservoir d’eau potable de Zhytomyr. Il a mis la tannerie à l’arrêt et interrompu le traitement de 19 000 peaux7. Il a été rétrogradé pour cela, mais il a eu gain de cause sur le fond : les peaux contaminées n’ont finalement pas été tannées, l’eau potable de la ville a été protégée, et cela a épargné aux habitant·es de Zhytomyr une source supplémentaire de contamination.

➤ Lire aussi | “Chère Greta Thunberg” – À propos du nucléaire・Xavière Gauthier (2022)

Ces « héros du quotidien » sont d’ailleurs beaucoup moins présents dans Plutopia, comment l’expliquez-vous ?

Kate Brown – C’est une excellente question. Pourquoi ne sont-ils pas présents dans Plutopia ? Ils devraient exister. Pendant quarante ans, les usines de Hanford et Maïak ont déversé des tonnes de déchets radioactifs dans leur environnement, à peu près 350 millions de curies pour chacune des deux usines. Je raconte dans Plutopia que les travailleur·euses des usines ont eu des accidents, sont tombé·es malades, sont mort·es. Au vu des enjeux, pourquoi y a-t-il si peu de traces de résistance à ces usines de bombes dangereuses et polluantes ?

Maïak et Hanford étaient des sites militaires. Toutes les personnes pouvant y entrer signaient des serments de loyauté chaque année. Quand j’ai demandé à une ancienne employée de Maïak pourquoi personne ne s’était plaint, elle m’a dit « quand nous avons été embauché·es, personne ne nous a avertis des effets de la radioactivité. Nous ne savions même pas ce que c’était. Nous n’avions peur que du KGB »8. Les agents du KGB bannissaient de la ville bien approvisionnée d’Ozersk non seulement les mots « plutonium » et « radiation », mais aussi toutes les personnes qui causaient des problèmes.

Les employés de Hanford, dans l’état de Washington, craignaient aussi le service de sécurité du site. Faire preuve de curiosité, même de manière anodine, était considéré comme malsain. Betsy Stuart se souvient qu’une de ses voisines avait demandé à une amie ce que son mari faisait dans la vie. Quand l’autre lui a répondu qu’elle ne pouvait pas parler du travail de son mari, la voisine a dit quelque chose qu’elle n’aurait pas dû dire. Le lendemain matin, elle avait disparu. « Croyez-moi », m’a dit Stuart, « quand on se réunissait, on ne parlait jamais de ce qu’on faisait. Nous avions la sensation constante d’être écoutés »9.

Je n’ai trouvé qu’un seul cas de lanceur d’alerte pendant la guerre froide. En 1962, le chef du bureau régional du KGB s’est plaint que les gaz radioactifs de Maïak, non filtrés, contaminaient deux villages de soldats et de travailleurs autour d’Ozersk. Et c’est tout. En revanche, aucun signe de dissension du côté de l’usine de Hanford. On pourrait trouver cela contre-intuitif : c’était l’URSS le régime autoritaire connu pour arrêter, emprisonner et exécuter les gens qui posaient trop de questions. Les travailleurs de Hanford faisaient confiance à leurs supérieurs, et les États-Unis s’enorgueillissaient d’une société ouverte et libre.

En effet, c’est étonnant !

Kate Brown – En plus de la peur des services de sécurité, d’autres forces à Richland contribuaient à étouffer les questions et les protestations. La richesse industrielle des États-Unis comme la prospérité des familles des travailleur·euses états-unien·nes augmentaient, au point que la science, la technologie et la culture se renforçaient mutuellement pour diffuser un message de compétence, d’expertise et de confiance.

C’est là où les coûteuses infrastructures culturelles de Richland et la stratégie d’industrialisation rurale, à grand renfort de subventions, a payé. La culture de Richland, c’est le respect de la richesse, de l’éducation, de l’expertise, de la hiérarchie et des règlements, et cela a permis de mettre en sourdine les doutes, la peur, les rumeurs et même les faits. Les dirigeants de Hanford ont beaucoup investi dans l’éducation des enfants des ouvriers, générant une adhésion profonde au progrès scientifique.

La culture de Richland, c’est le respect de la richesse, de l’éducation, de l’expertise, de la hiérarchie et des règlements, et cela a permis de mettre en sourdine les doutes, la peur, les rumeurs et même les faits.

Un résident se souvenait ainsi : « à Richland, le soleil brillait 300 jours par an. Chaque habitant avait une pharmacie, une épicerie, un terrain de baseball et une station-service à quelques pâtés de maison. On avait de bons médecins. Chaque pelouse était tondue, chaque maison peinte. Les donuts chauds, le shopping chez CC Anderson, et les célébrations au Bomber Bowl sont des souvenirs chers à tous les gamins de Richland. Pourquoi est-ce que c’étaient de si belles années ? On était protégés. Les parents élevaient leurs enfants dans cette cité atomique, loin du mal, loin des villes en déliquescence et de la dégradation sociale. C’est la sérénité, le bien-être, l’absence de conflit. »10

Les événements géopolitiques récents nous ont beaucoup fait penser à vos livres. La centrale nucléaire de Zaporijjia en Ukraine a été attaquée par l’armée russe, puis Israël et les États-Unis ont bombardé des installations nucléaires en Iran – avec des conséquences inconnues en termes de pollution radioactive. Dans le même temps, plusieurs pays, dont la France, la Hongrie, la Pologne et la Slovaquie, ont annoncé un renouveau du nucléaire civil. Ils projettent de construire de nouvelles infrastructures et de prolonger le parc nucléaire existant. Ces projets sont soutenus à la fois par des éco-modernistes qui soutiennent le nucléaire pour décarboner l’économie, et par des acteurs placés à la droite ou à l’extrême droite des échiquiers politiques, qui détestent les renouvelables. Depuis votre perspective d’historienne, cette configuration vous semble-t-elle nouvelle, ou rappelle-t-elle des schémas plus anciens ?

Kate Brown – Il n’y a pas grand-chose de nouveau dans les conflits nucléarisés d’aujourd’hui, ni dans la renaissance nucléaire civile, si ce n’est l’intensification des politiques nationalistes et xénophobes qui instrumentalisent l’énergie nucléaire à des fins politiques, davantage qu’économiques. L’énergie nucléaire est trois à cinq fois plus chère que l’énergie solaire et éolienne au kW/h. Il faut des décennies pour construire une centrale nucléaire, contre quelques semaines ou quelques mois pour installer des panneaux solaires ou des éoliennes. Ces temporalités constituent une différence critique, quand on pense à l’urgence climatique. On a vu avec la guerre en Ukraine la vulnérabilité des installations nucléaires, qui, une fois prises par l’ennemi, peuvent être transformées en gigantesques bombes polluantes. Nous avons vu en Iran, et avant cela en Irak, comme il est facile de confondre des installations nucléaires civiles et militaires pour justifier des offensives. Pendant la guerre froide, les forces conservatrices ont adopté le nucléaire comme une promesse de puissance économique, politique et militaire. C’est toujours le cas aujourd’hui, de manière assez irrationnelle, car quiconque se soucie de souveraineté et de résilience économique comprend que les renouvelables sont moins chères, plus sûres, plus propres et plus rapides à déployer.

➤ Lire aussi la série Atolls irradiés・Naïké Desquesnes et Léna Silberzahn (2025)

L’histoire de la production de la bombe nucléaire et de Tchernobyl nous a montré que les incroyables promesses éco-modernistes sont précisément… incroyables. Elles laissent dans leur sillage des paysages empoisonnés, des gens malades et des projets de dépollution qui n’en finissent pas. L’historienne féministe Emily Callaci a montré dans son livre Wages for Housework comment le travail de « ménage » en contexte de changement climatique et autres catastrophes anthropogéniques revient à des personnes qui l’accomplissent gratuitement : trouver le moyen de consommer une nourriture non-contaminée, éviter les coins les plus pollués du quartier, prendre soin d’un enfant qui n’est jamais en pleine forme ou d’un adulte qui ne parvient pas à concevoir d’enfant… Et des années plus tard, prendre soin de proches touchés par des cancers ou des maladies chroniques. Avec le développement de ces projets nucléaires, et la quantité croissante d’isotopes radioactifs en circulation dans le monde, nous sommes de plus en plus nombreux·ses à travailler, gratuitement, comme liquidateur·ices nucléaires.

Image principale : la zone autour de Tchernobyl. Photographie : Kate Brown.

SOUTENIR TERRESTRES

Nous vivons actuellement des bouleversements écologiques inouïs. La revue Terrestres a l’ambition de penser ces métamorphoses.

Soutenez Terrestres pour :

- assurer l’indépendance de la revue et de ses regards critiques

- contribuer à la création et la diffusion d’articles de fond qui nourrissent les débats contemporains

- permettre le financement des deux salaires qui co-animent la revue, aux côtés d’un collectif bénévole

- pérenniser une jeune structure qui rencontre chaque mois un public grandissant

Des dizaines de milliers de personnes lisent chaque mois notre revue singulière et indépendante. Nous nous en réjouissons, mais nous avons besoin de votre soutien pour durer et amplifier notre travail éditorial. Même pour 2 €, vous pouvez soutenir Terrestres — et cela ne prend qu’une minute..

Terrestres est une association reconnue organisme d’intérêt général : les dons que nous recevons ouvrent le droit à une réduction d’impôt sur le revenu égale à 66 % de leur montant. Autrement dit, pour un don de 10€, il ne vous en coûtera que 3,40€.

Merci pour votre soutien !

Notes

- The International Chernobyl Project: Proceedings of an International Conference, Vienne, 21-24 mai 1991, (IAEA, 1991). Les références sur les effets néfastes des « faibles » doses chroniques de rayonnement de Tchernobyl sont abondantes. Je présente ici un éventail de sources allant des archives aux articles publiés dans des revues scientifiques à comité de lecture. “Otchet o vypolnenii gosudartstvennoi natsional’noi programy “Deti Chernbylia” za 1992 goda,” 1992, Tsentral’nyi derzhavnyi arkhiv vishchikh organiv vladi, Kyiv, (TsDAVO) 324/19/33, 1-18 ; “Dokumentiy MOZ Ukrainy pro vikonannia derzhavnykh program ta pro stan zdorov’ia naseleniia,” 27 janvier 1992, TsDAVO 342/19/32, 19-30 ; “Dovidka,” après le 11 mars 1990, TsDAVO 342/17/5240, 88-98 ; N. Iu Liubinetskaia, “Ot chet o nauchnou rabote po teme: Okhrana zdorov’ia profilaktika i reabilitatsia zabolevanii u voennosluzhashchikh i chlenov ik semei,” Sluzhba Bezpeki Ukraini, derzhavnyi arkhiv, Kyiv, (SBU) 35/64/36, Kyiv 1996, 149-80 ; “Itogi raoty otdela po izucheniiu meditsinskikh posledgstvii Chernobyl’skoi katastrofy za 1996 god,” sans date, 1996, SBU 35 68, 1-12 ; E. I. Stepanova et al., “Effekty vozdeistviia posledstvii Chernobyl’skoi avarii na detskii organizm,” Pediatriia, 12 (1991): 8-13 ; Erik R. Svendsen, et al., “Cesium 137 Exposure and Spirometry Measures in Ukrainian Children Affected by the Chernobyl Nuclear Accident,” Environmental Health Perspectives, vol. 118, no. 5 (Mai 2010): 720-5 ; Andre Dubois, “Gastrointestinal Radiodamage and Radioprotection: Chernobyl in Retrospect,” at “Symposium on Perspectives in Radioprotection: Program and Abstract,” 13-14 mars 1987, Bethesda, MD, USU Archives ; Mohammad Reza Shiekh Sajjadieh, et al., “Cytokine Status in Ukrainian Children with Irritable Bowel Syndrome Residing in a Radioactive Contaminated Area,” Iranian Journal of Immunology, 9(4), 248-53 ; K. Spivak, C. Hayes, J.H. Maguire, “Caries prevalence, oral health behavior, and attitudes in children residing in radiation-contaminated and non-contaminated towns in Ukraine,” Community Dent Oral Epidemiology, 2004 ; 32: 1-9 ; Anna Lindgren, et al., “Individual whole-body concentration of Cesium 137 is associated with decreased blood counts in children in the Chernobyl-contaminated areas, Ukraine, 2008-2010, Journal of Exposure Science and Environmental Epidemiology, (2013), 1/9: 1-3.

- Sur le temps, voir Julian Barbour, The End of Time : The Next Revolution in Physics (Oxford University Press, New York, 2001): 11-15.

- Timothy A. Mousseau et al., “Highly reduced mass loss rates and increased littler layer in radioactively contaminated areas,” Oecologia, 24 juin 2013,DOI: 10.1007/s00442-014-2908-8; et “Chernobyl Trees Barely Decomposed, Study Finds,” NBC News, 26 mars 2014.

- “Au recteur de l’Université de Kiev” 1986, archives personnelles de Lozyts’ka.

- Entretien téléphonique avec Lars Erik de Geer, 18 décembre 2017, et Lars-Erik De Geer et al., “A Nuclear Jet at Chernobyl Around 21:23:45 UTC on April 25, 1986,” Nuclear Technology, 2017.

- “Medical Aspects of the Chernobyl Accident,” Kiev 11-13 Mai, 1988, (IAEA: Vienna, 1989): 9-12. Pour une analyse de l’impact négatif que la conférence a eu sur les patient·es et les traitements, voir le courrier d’Aleksandr P. Borshchevskii à Evgenii Chazov, 30 octobre 1988, GARF 8009/51/4340: 67-84.

- “Actes d’enquête sanitaire,” Akt sanitarnogo obsledovaniia,” 11 août, 1986, et “Directive des Ministres soviétiques” “Poruchenie Soveta Ministry, UkSSR,” 20 août 1986, TsDAVO 324/17/4348: 14, 66.

- Vladyslav B. Larin, “Mayak’s Walking Wounded,” The Bulletin of the Atomic Scientists, septembre/octobre 1999: 23.

- Sanger, Working on the Bomb, 170.

- Mai 1999, Archives de l’association des anciens élèves Alumni Sandstorm, accessibles sur www.alumnisandstorm.com.

L’article « Nous travaillons gratuitement comme liquidateur·ices nucléaires » est apparu en premier sur Terrestres.

23.04.2026 à 17:50

L’utopie nucléaire des villes atomiques de la guerre froide

Kate Brown

C’est l’histoire d’une utopie nucléaire sur fond de haine réciproque entre les deux puissances ennemies de la guerre froide. Dans “Plutopia”, l’historienne Kate Brown retrace l’histoire de deux cités – l’une soviétique, l’autre américaine – dévolues à la production de plutonium. Et décrit la vie dans ces villes-usines aussi cruciales que secrètes. Extrait.

L’article L’utopie nucléaire des villes atomiques de la guerre froide est apparu en premier sur Terrestres.

Texte intégral (7788 mots)

Temps de lecture : 18 minutes

Extrait de l’introduction du livre de Kate Brown, Plutopia – Une histoire vraie des premières villes atomiques, traduit de l’anglais (États-Unis) par Cédric Weis et paru aux éditions Actes Sud dans la collection « Questions de société » en 2024.

C’est l’histoire d’une utopie, à deux extrémités du monde. L’histoire d’un rêve tragique, au cœur de la guerre froide. L’histoire de deux ennemis, hantés par la Bombe. L’histoire de deux villes fermées, reflets l’une de l’autre, unies par la peur de l’apocalypse, par leur haine réciproque et par une même obsession, la production effrénée de plutonium : Richland, aux États-Unis, dans le Sud-Est de l’État de Washington ; Ozersk (littéralement, la « vallée des lacs »), en URSS, dans le Sud de l’Oural.

Ces deux villes-usines, centres névralgiques des arsenaux nucléaires des deux blocs, n’ont pas seulement produit des ogives et des missiles, elles ont aussi créé d’heureux souvenirs d’enfance, des logements abordables et d’excellentes écoles au sein de communautés modèles, devenues des havres de paix pour les familles qui y ont vécu. Leurs habitants, pionniers du plutonium, se remémorent qu’ils ne verrouillaient jamais leur porte, que leurs enfants traînaient sans danger dans les rues, que les relations de voisinage étaient bonnes, et qu’il n’y avait ni chômage, ni indigence, ni criminalité.

Le souvenir de ce sentiment de sûreté et de sécurité dans des lieux situés à l’épicentre de la course aux armes nucléaires m’a beaucoup intriguée. Dans ces mêmes villes, des agents de la sûreté et des médecins surveillaient et auscultaient fébrilement les habitants par le biais de réseaux d’informateurs, d’écoutes téléphoniques et d’examens médicaux obligatoires. Quant aux ingénieurs des usines d’armement, invités à produire un maximum de plutonium en un temps record, ils polluaient dramatiquement et en toute impunité l’environnement.

Des différentes étapes de la chaîne de fabrication des armes nucléaires, la production de plutonium est la plus sale. Chaque kilogramme de produit fini génère des milliers de mètres cubes de déchets radioactifs. En quatre décennies de fonctionnement, l’usine de plutonium de Hanford, près de Richland, et celle de Mayak, près d’Ozersk, ont chacune émis au moins 200 millions de curies de radioactivité dans leur environnement immédiat – l’équivalent, au total, de deux catastrophes de Tchernobyl1. Ces usines ont rendu inhabitables des dizaines de milliers d’hectares, contaminé des rivières, des champs et des forêts, et des milliers de personnes leur ont attribué leurs maladies.

L'infolettre des Terrestres

Toutes les deux semaines, dans votre boîte mail : un éditorial de la rédaction, le résumé de nos dernières publications, un conseil de lecture des Terrestres et des articles tirés de nos archives, en écho à l'actualité.