11.05.2026 à 15:19

Le cyborg, ce corps-machine qui nous invite à explorer l'histoire et le futur des hybridations

Jessica Ragazzini, Chercheuse associée, Université de Strasbourg; Université du Québec en Outaouais (UQO)

Quentin Petit Dit Duhal, Docteur en Histoire de l'art, Université Paris Nanterre

Texte intégral (2048 mots)

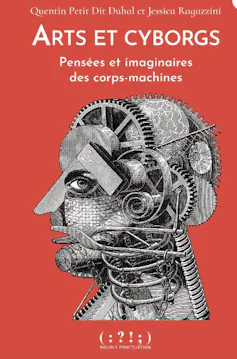

En proposant une archéologie des imaginaires du corps-machine – des mythes antiques aux pratiques féministes, queer, afrofuturistes et crip – l’ouvrage Arts et Cyborgs. Pensées et imaginaires des corps-machines retrace les usages esthétiques et politiques de l’hybridation, tout en situant les controverses contemporaines liées à l’intelligence artificielle dans une longue histoire des artefacts anthropomorphes.

Depuis plusieurs années, l’intelligence artificielle (IA) suscite une attention croissante, tant dans les pratiques artistiques que dans les travaux universitaires. Deux postures tendent à structurer, parfois de manière caricaturale, les débats qui l’entourent : d’une part, elle suscite l’enthousiasme pour les formes inédites d’interaction et de co-production entre humain et machine ; d’autre part, elle provoque une grande inquiétude face aux risques d’appauvrissement des interprétations du monde, de standardisation des formes et de réification du vivant.

Dans l’un comme dans l’autre cas, la proximité supposée d’une machine dont « l’intelligence » qui serait comparable à celle de l’être humain, voire susceptible de la dépasser, est au cœur de la polarisation. Or, cette fascination et les peurs qu’elle charrie ne surgissent pas ex nihilo. En effet, depuis l’Antiquité, les créations artificielles, les figures anthropomorphes et les récits de création constituent des réflexions privilégiées qui éprouvent les limites du vivant et permettent de repenser la définition de l’être humain.

Dans ce contexte, l’ouvrage Arts et Cyborgs. Pensées et imaginaires des corps-machines propose une synthèse de l’histoire longue de la fascination pour les objets et corps anthropomorphes. Ce projet retrace une généalogie à la fois artistique, philosophique et curatoriale de l’hybridation entre chair et technique, représentation centrale de la culture contemporaine et passée. Rejetant l’idée d’un inventaire exhaustif, cette publication présente les continuités et ruptures afin d’offrir des outils conceptuels permettant de situer les formes actuelles dans un réseau de références plus ancien et complexe.

Une figure-limite

Forgé en 1960 par les scientifiques Nathan S. Kline et Manfred E. Clynes, le terme « cyborg » désigne un organisme cybernétique susceptible d’adapter le corps humain aux conditions d’une vie extraterrestre. Au-delà de cette origine technoscientifique, l’imaginaire cyborg s’est rapidement constitué comme une construction du rapport à soi et aux mondes à titre de figure-limite, au sein de laquelle se rejouent les partages entre organisme et artefact, autonomie et contrôle, vulnérabilité et puissance.

Réinvestie par les luttes et mouvements sociaux à partir des années 1970, la figure du cyborg contribue à déstabiliser les catégories binaires, en particulier celles du genre, et à interroger les régimes de normalisation qui organisent les rapports sociaux et sociétaux.

Cette fécondité critique est théorisée de manière décisive par la philosophe et biologiste Donna Haraway dans son Manifeste Cyborg dans lequel le cyborg apparaît comme un paradigme politique qui remet en question les logiques de pouvoir fondées sur des oppositions naturalisées (corps/objet, vivant/machine, nature/culture). En ce sens, il ouvre un horizon spéculatif et prospectif qui mène à envisager des futurs possibles où les catégories mêmes par lesquelles nous décrivons l’humanité et la non-humanité se trouvent reconfigurées, dans un entre-deux instable entre biologie et technologie.

Échapper aux normes sociales et symboliques

Si la culture contemporaine attribue au cyborg une myriade de définitions parfois concurrentes ou même contradictoires, celles-ci s’inscrivent dans une histoire plus vaste des représentations de la figure humaine. Dès l’Antiquité, des récits tels que l’histoire de Pygmalion ou celle d’Hermaphrodite déplacent des frontières réputées stables entre être et matière (la pierre animée), entre masculin et féminin, entre fabrication et engendrement montrant la complexité des modes d’existence qui échappent finalement aux nomenclatures fixes et stéréotypées. Au fil des siècles, de tels mythes se sont multipliés devenant des matrices narratives par lesquelles les artistes ont pu imaginer des formes abolissant ou contestant les normes sociales et symboliques de leur époque.

Parallèlement, la philosophie a élaboré des cadres conceptuels visant à préciser ce qui distingue l’être humain du non-humain, mais aussi ce qui les relie tels que l’agentivité, la sensibilité, le langage, la technique, etc. Les controverses actuelles relatives à l’IA – notamment lorsque des systèmes génératifs produisent images ou sons à partir de corpus préexistants – réactivent ainsi des questions anciennes : ces productions relèvent-elles d’une forme de création analogue à celle d’un artiste mobilisant un bagage culturel ? Les deux types de productions sont-elles radicalement opposées du fait de l’impossible subjectivité humaine du programme génératif ? Ces débats ne sont pas sans rappeler ceux prononcés lors de l’apparition de la photographie qui révélaient déjà les craintes d’usage des dérives d’une image réaliste indirectement produite par l’être humain.

Envisager des transformations sociétales

Ainsi, si la photographie est aujourd’hui largement reconnue comme un médium artistique à part entière, son histoire rappelle que les technologies visuelles ne sont jamais neutres. Au début du XXe siècle, l’usage volontiers patriarcal de la photographie de la part de certains artistes futuristes et surréalistes contraste avec les expérimentations de Hannah Höch ou de Claude Cahun, qui en font un outil de déstabilisation des identités, des normes de genre et des régimes de représentation.

De manière comparable, l’hybridation technologique contemporaine par laquelle la figure cyborg prend forme dans les œuvres féministes et queer constitue un contrepoint critique face à la circulation massive sur les réseaux sociaux, d’images d’IA reconduisant des stéréotypes sexistes et anti-LGBTQI2A+.

Dans ces pratiques, la figure cyborg ne se réduit pas à une iconographie de science-fiction, elle devient un dispositif de pensée pour envisager des transformations sociétales, renverser des hiérarchies corporelles et imaginer d’autres normes possibles. C’est aussi ce que montrent les artistes a frofuturistes qui articulent la spéculation politiquement engagée ou encore les artistes crip dont le corps perçu aujourd’hui en situation de handicap, pourrait se voir demain doté d’une mécanique surpuissante qui le transformerait en un nouvel idéal corporel à atteindre.

Faire place à l’erreur

Le corps cyborg ouvre un horizon de capacités « surhumaines » ou « surbiologiques ». Toutefois, il demeure simultanément exposé aux failles, aux incompatibilités et aux dysfonctionnements propres aux dispositifs techniques et aux vulnérabilités de la chair. Dans les pratiques artistiques, ces incidents constituent des matériaux heuristiques qui mettent en évidence les infrastructures, les normes et les idéologies inscrites dans notre monde contemporain. Le glitch, le bug ou la panne peuvent alors être revendiqués comme motifs esthétiques, en rupture avec les impératifs d’optimisation, de fluidité et d’hyperproductivité qui accompagnent souvent l’imaginaire technocapitaliste du progrès technoscientifique.

Faire place à l’erreur revient à ouvrir un champ de futurs possibles où l’altération devient souhaitable, précisément parce qu’elle introduit de l’indéterminisme qui échappe à toute tentative de contrôle humain ou technologique. Ce geste reconfigure les narratives historiques de réussites de l’inventivité et du génie de l’humanité, il ouvre des brèches dans les récits linéaires du progrès en perturbant sa frise chronologique. Les dysfonctionnements apparaissent ainsi comme étant des leviers critiques pour penser l’histoire autrement à travers ses trous, ses silences, ses répétitions, ou ses accélérations angoissantes.

Ouvrir le champ des possibles

L’intérêt des imageries cyborg réside dans leur polysémie et dans l’antagonisme possible de leurs usages, ces figures peuvent aussi bien perpétuer des fantasmes de maîtrise que soutenir des politiques de l’émancipation. C’est pourquoi elles requièrent une lecture contextualisée, attentive à la fois aux symboliques mobilisées, aux enjeux contemporains et aux dimensions spéculatives qui ouvrent la porte à des futurs pessimistes autant qu’optimistes. En ce sens, l’ouvrage Arts et Cyborgs. Pensées et imaginaires des corps-machines vise à proposer une histoire des imaginaires non hégémonique. En articulant archéologie des formes, analyse des discours et attention aux pratiques curatoriales, il ouvre la voie à de nouvelles recherches sur les manières dont les corps – réels, représentés ou fictionnés – deviennent des lieux d’une reconfiguration des sensibilités, des nomenclatures, des pouvoirs et des possibles.

Arts et Cyborgs. Pensées et imaginaires des corps-machines a été publié par les éditions Double Ponctuation.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

11.05.2026 à 14:20

L’école face à la pauvreté : comment les inégalités sociales se transforment en inégalités scolaires

Yves Reuter, Professeur émérite en didactique, Université de Lille

Lahanier-Reuter Dominique, Chercheuse en sciences de l'éducation, Université de Bordeaux

Texte intégral (1683 mots)

En France, plus que dans d’autres pays, l’échec scolaire est socialement marqué. Les élèves touchés par la pauvreté en classe de sixième ont des conditions d’entrée dans la vie adulte plus défavorables que les autres élèves. Comment transformer l’école pour qu’elle soit réellement un espace d’égalité des chances ?

Comment expliquer le sort réservé aux plus démunis dans l’école française et, notamment, les orientations précoces hors des parcours « ordinaires » qui les concernent plus souvent ? Serait-ce, à suivre un certain nombre de représentations sociales, une sorte de fatalité ?

Nos recherches interrogent certains des fonctionnements pédagogiques les plus classiques de l’école. Nous montrons en quoi les explications, extrascolaires et scolaires, les plus souvent avancées ne suffisent pas à comprendre cette situation si on ne prend pas en compte des dimensions telles l’opacité des pratiques scolaires, les injustices, la mise à l’écart de certains élèves ou encore l’enchainement des micro-décisions qui conduisent aux orientations subies.

Cependant, les démarches de certaines équipes pédagogiques, et notamment le changement de posture des enseignants, témoignent qu’il est possible de lutter contre ces mécanismes délétères.

Quelles situations de pauvreté en France ?

Selon la note de l’Insee du 7 juillet 2025, L’essentiel sur… la pauvreté, la pauvreté ne cesse d’augmenter en France depuis le milieu des années 2000 et touchait, en 2023, près de dix millions de personnes.

Cette pauvreté touche massivement les enfants et les jeunes. Selon les données de l’Insee de 2024, 2 759 000 des moins de 18 ans (soit plus de 20 % d’entre eux) étaient en situation de pauvreté monétaire ou de privation matérielle. Par ailleurs, selon le baromètre de l’Unicef, le nombre d’enfants SDF augmente.

Cette situation est d’autant plus préoccupante en France que, plus que dans d’autres pays, l’échec scolaire est socialement marqué. Il frappe les élèves les plus pauvres : faibles résultats, décrochage, orientation subie, de surcroit dans les filières les moins légitimes. Ainsi, selon l’édition 2023 du Rapport sur les inégalités en France : « Dès le plus jeune âge, les résultats des élèves sont liés en partie au milieu social de leurs parents. Les écarts se creusent au fil de la scolarité ».

Une note d’analyse du Haut-commissariat à la Stratégie et au Plan publiée en 2026 a synthétisé les résultats du suivi d’une cohorte d’élèves pendant 16 ans, depuis leur entrée au collège jusqu’à 26-27 ans. Il s’avère que, plus l’exposition à la pauvreté en sixième est intense, plus les conditions de vie à l’entrée dans l’âge adulte sont défavorables : sortie précoce du système scolaire, probabilité accrue de n’être ni en emploi, ni en études, ni en formation, et lorsqu’ils sont en emploi de percevoir un bas salaire (parmi les 20 % les plus faibles de la cohorte).

Peut-on encore parler d’école inclusive en s’aveuglant sur le sort réservé aux plus pauvres ?

Comment comprendre cet échec qui touche les plus pauvres ?

Quels sont les mécanismes susceptibles d’expliquer cette situation ? Il existe des facteurs extrascolaires bien connus telles les conditions de vie, la ghettoïsation de l’habitat ou encore la dégradation des services publics. Il existe aussi des facteurs qui touchent l’institution scolaire dans sa globalité : les moyens insuffisants consacrés à l’éducation, le peu de reconnaissance accordée aux enseignants, l’inadaptation de leur formation initiale et continue, les classes surchargées en comparaison d’autres pays, les réformes et les injonctions incessantes.

Au-delà de ces facteurs généraux, nos recherches nous ont permis de préciser trois grands mécanismes qui génèrent l’échec des plus pauvres, à savoir l’opacité de l’univers et des pratiques scolaires (par exemple, la multiplicité des sigles, les organisations disciplinaires, les annotations…), certaines règles d’imposition (imposition du silence, de la concurrence entre élèves, des modalités évaluatives…) et, enfin, les injustices et stigmatisations (quant à la langue parlée, quant à la soi-disant « absence de culture », auxquels il faut ajouter les prophéties défaitistes – « Ce n’est pas pour toi », « Tu n’y arriveras pas »).

La philosophe britannique Miranda Fricker parle d’injustice épistémique envers les dominés. Ce concept renvoie aux mécanismes qui disqualifient certaines personnes sur le plan des savoirs, par exemple la décrédibilisation des témoignages (ne pas être cru parce qu’on est pauvre), la négation des contributions (ne pas être considéré comme de véritables producteurs de connaissances) ou encore l’impossibilité de la transmission (ne pas avoir la possibilité de transmettre aux plus jeunes de sa famille ses savoirs, car on est empêché de le faire).

À cela, il convient encore d’ajouter la manière dont l’école tend à abandonner certains élèves et, plus particulièrement, les plus défavorisés : refus de donner la parole, manque de stimulations, baisse des exigences, stigmatisation d’absences alors qu’elles sont dues à l’accompagnement administratif des parents ou à la nécessité de prendre soin des plus jeunes de la fratrie. Par exemple, le dernier jour de maternelle, J. se tourne vers sa maîtresse et lui dit « au revoir Madame », et celle-ci de s’étonner « c’est la première fois que j’entends sa voix ! »

Nous nous sommes aussi de plus en plus attachés à étudier l’amont des orientations imposées, notamment dans le cadre de la recherche Cipes (Choisir l’Inclusion Pour Eviter la Ségrégation), menée au sein d’ATD Quart-Monde. Il s’agit de voir comment les décisions d’orientation qui déterminent en grande partie de l’avenir scolaire et social des élèves ne surviennent pas d’un coup mais sont le résultat de micro-décisions qui se produisent dès le début de la scolarité : exclusions temporaires sans rattrapage du travail prévu, placement systématique au fond de la classe.

Quelques pistes possibles

Dans le cadre des recherches que nous évoquons, le fatalisme pas plus que le déterminisme ne sont de mise puisque l’échec ou la réussite se construisent dans les interactions pédagogiques et que des résultats intéressants sont obtenus par des équipes d’enseignants mettant en œuvre des pratiques pédagogiques dites différentes.

Ces pratiques ont en commun d’articuler la sécurisation et l’exigence ainsi que la bienveillance et la stimulation et d’être constamment en quête de ce qui peut faire sens pour les élèves.

Des démarches telles que la coopération ou les projets qui allègent le stress lié à la compétition et qui favorisent la mobilisation des élèves constituent des leviers éprouvés. Il en est de même pour les dispositifs d’évaluation formative qui ne portent pas atteinte à l’estime de soi et peuvent conduire à l’auto-évaluation.

Nous insisterons ici sur le changement de posture des enseignants. Cela consiste, entre autres, à fonder son action sur le principe d’éducabilité (tous les élèves peuvent apprendre et progresser), à abandonner les seules positions de transmetteur des contenus et de gardien de l’ordre scolaire pour se constituer en facilitateur, en accompagnateur et en garant des apprentissages.

Cela consiste aussi, et c’est essentiel, à se mettre en position d’écouter et d’apprendre aussi bien des élèves que de leur famille. Par exemple, cela peut permettre de mieux comprendre certains comportements d’élèves : la fatigue qui s’inscrit dans une vie de manques, d’inquiétudes et d’épreuves, l’effacement de soi pour éviter d’attirer l’attention, la tension permanente pour résister aux différentes formes de domination, la méfiance des institutions, la peur de dire ses problèmes car les confidences peuvent se retourner contre soi, les stratégies de contournement afin d’éviter des rapports de pouvoir défavorables, la révolte et les affrontements car la colère sociale est là en permanence.

Il convient aussi d’insister sur une conception des apprentissages comme acculturation dans la mesure où les cultures scolaires sont spécifiques et souvent en rupture avec les cultures des apprenants, notamment les plus pauvres.

Au travers de ces leviers, il s’agit donc de faire fond sur des démarches qui prennent en compte positivement ce que font et savent les élèves et leur famille et qui ne transforment pas les différences extrascolaires en inégalités scolaires.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

11.05.2026 à 11:13

La révolution silencieuse du travail en mode projet

Christophe Midler, Directeur de recherche CNRS émérite, École polytechnique

Florence Charue-Duboc, Directeur de recherche au CNRS au PREG-CRG Professeur chargée de cours, École polytechnique

Sihem BenMahmoud-Jouini, Associate Professor, HEC Paris Business School

Sylvain Lenfle, Professeur en management de l’innovation, Conservatoire national des arts et métiers (CNAM)

Texte intégral (1240 mots)

En quelques décennies, le travail en projet s’est déployé dans tous les domaines de l’action collective, des entreprises aux administrations. Cette « projectification » de la société, puissant levier d’innovation et d’adaptabilité, a redéfini les formes du travail, les structures organisationnelles et les modes de décision publique. Mais cette « révolution silencieuse » révèle aussi des fragilités nouvelles, où la quête d’agilité se paie d’instabilité et de nouvelles tensions.

Le mode projet comme forme de coordination du travail n’a jamais été aussi présent. Il est en effet très fréquent de nos jours d’entendre parler de projets agiles d’implémentation de l’intelligence artificielle générative. Ces derniers concrétisent les promesses ou les projets en écosystème pour mobiliser des coalitions d’acteurs publics et privés. Ils mettent ainsi en œuvre les grandes transitions contemporaines appelées par le changement climatique, comme la réindustrialisation verte.

Le projet est un pilier du modèle de croissance par l’innovation récompensé cette année par le prix de la Banque de Suède en sciences économiques en mémoire d’Alfred Nobel ; Philippe Aghion en est le lauréat. Cependant, la montée en puissance du projet comme forme majeure de coordination dans les entreprises, comme dans les administrations, date d’un demi-siècle maintenant.

Sans fracas ni slogans, une transformation profonde a redessiné l’organisation du travail et la conduite de l’action collective : le projet s’est imposé comme le moteur de l’innovation et du changement. Ce mouvement, qualifié dès 1995 par Christophe Midler par le terme de « projectification », s’est déployé depuis de manière discrète, mais irréversible.

C’est que nous analysons dans un article pour les 50 ans de la Revue française de gestion.

Management de projet

Né des grands programmes militaires de la guerre froide, le management de projet reposait à l’origine sur la planification et le contrôle : définir un objectif, le découper en tâches, suivre les délais et les coûts. Ce modèle, issu du management scientifique à l’américaine, entre en crise dans les années 1980, incapable de gérer la complexité et l’incertitude croissantes des environnements.

Or, à la même époque, l’industrie automobile japonaise renouvelle les méthodes de management de projet en montrant qu’efficacité et créativité peuvent se conjuguer par le renforcement des équipes projet, la coopération entre métiers et la résolution collective de problèmes.

À lire aussi : Quand le management a fait des États-Unis une superpuissance

Sous l’impulsion de chercheurs français et scandinaves, le projet cesse alors d’être un simple outil d’exécution pour devenir un mode d’organisation à part entière, centré sur l’apprentissage, l’expérimentation et l’engagement collectif.

De l’industrie à l’État

Dans l’industrie, il s’incarne dans les « plateaux projets », où ingénieurs, designers et fournisseurs travaillent ensemble pour raccourcir les cycles de développement. Il va bientôt être à l’épicentre d’une transformation plus profonde et plus vaste des ingénieries des entreprises : le développement de l’ingénierie concourante, qui bouleverse l’engagement des différents métiers impliqués dans les processus de développement produits. Il va même contribuer à transformer le rapport entre entreprises, avec le déploiement du co-développement et la co-innovation.

Peu à peu, cette logique se diffuse à d’autres domaines : recherche, culture, urbanisme, santé, éducation, numérique. L’État lui-même adopte des dispositifs expérimentaux, temporaires et collaboratifs pour piloter ses politiques publiques.

Ce basculement a bouleversé la hiérarchie classique entre les métiers (structures permanentes de l’entreprise) et les projets (actions temporaires). Ces derniers deviennent le lieu où se construisent les compétences, les carrières et parfois les stratégies des entreprises. Dans un monde d’innovation intensive, il ne se contente plus d’exécuter la stratégie : il contribue à la fabriquer.

Les projets d’exploration, par exemple dans l’industrie spatiale ou automobile avec les véhicules autonomes, par exemple, permettent d’apprendre en marchant, de tester des usages, d’associer partenaires industriels et clients autour d’objectifs mouvants.

Instabilité, surcharge et incertitude

Cette organisation du travail en mode projet n’est pas sans revers. Vanté pour sa flexibilité, il engendre aussi instabilité, surcharge et incertitude professionnelle. Les collectifs se font et se défont au rythme des échéances ; la performance se mesure au livrable plus qu’à la durée. Cette intensification invisible du travail touche particulièrement les ingénieurs, chercheurs et managers, souvent contraints d’enchaîner les projets comme des « missions », sans que cela ne soit valorisé à sa juste en valeur dans leur carrière.

Le projet apparaît désormais comme le nouvel instrument de gouvernement du changement. Il incarne la capacité à articuler flexibilité et vision, initiative locale et cadre collectif. À titre d’exemple, l’expérience chinoise du véhicule électrique illustre comment une puissance publique peut orchestrer ces dynamiques : en fixant une vision de long terme, en soutenant l’expérimentation et en sélectionnant les initiatives les plus efficaces – un « darwinisme administré » au service de la transition industrielle.

Au-delà du trio coût-délai-qualité, il est devenu nécessaire d’intégrer les dimensions environnementales, sociales et d’apprentissage collectif. Et cela n’est pas sans susciter des débats quant à son articulation avec nos modèles d’action collective démocratique occidentaux.

Cinquante ans après l’émergence du concept, la projectification a profondément transformé nos entreprises, nos administrations et nos manières de travailler. Ce n’est plus seulement une technique de gestion : c’est une grammaire du changement, à la fois promesse d’agilité et source de nouvelles tensions. Une révolution décisive, qui façonne l’économie de demain.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

11.05.2026 à 11:12

Rendre l’écologie désirable : comment changer la manière d’en parler ?

Adeline Ochs, Professeure, départment marketing, Audencia

Aurélie Merle, Maitresse de conférences, Université Jean Monnet, Saint-Étienne; IAE Saint-Etienne

Texte intégral (1599 mots)

L’écologie peine à attirer les foules. Et si susciter des émotions positives au lieu d’émettre des injonctions culpabilisantes, incarner les récits par un autre personnage que l’ours polaire ou se sentir concerné avec des exemples à proximité de nous pouvait nous faire changer d’avis ? Car tout le monde part d’abord de sa réalité avant d’envisager celle du monde.

« Un yaourt dans un pot de poils, too much » ? La campagne de communication de Polyvia, syndicat national des industries de la plasturgie, renforce auprès des consommateurs certaines représentations dominantes d’une écologie « intégriste » et « jusqu’au-boutiste » et participe à son discrédit.

Grâce à leur communication, les entreprises – ces « imaginacteurs » – participent à construire des imaginaires collectifs plus ou moins favorables à la transition écologique et sociale. À l’heure actuelle, leurs récits valorisent majoritairement des imaginaires peu compatibles avec les limites planétaires : association du bonheur à la (sur) consommation matérielle, domination de la nature par l’Homme, etc. Or, ces représentations collectives dominantes façonnent nos comportements.

En face, certaines entreprises cherchent à modifier ces imaginaires collectifs dans le sens de la transition écologique et sociale, mais peinent à séduire. Leur faible part de voix par rapport aux acteurs traditionnels peut l’expliquer, tout comme des discours perçus comme moralisateurs, éloignés de la réalité, voire même manipulateurs.

Et si les récits de la transition écologique ne souffraient pas d’un manque de solutions, mais d’un déficit d’envie ? Quelles sont les épices qui pourraient transformer des modèles plus vertueux en récits désirables, capables de nous donner l’appétit du changement ?

C'est ce que nous cherchons à analyser dans le chapitre « Quels ingrédients pour construire de nouveaux récits désirables ? » du livre Consommer sans détruire.

Favoriser les émotions positives

Un trajet de dix kilomètres en voiture thermique émet 2,18 kg de CO2 alors qu’il en émet zéro en phase d’usage avec un vélo mécanique et 0,04 en métro. Ces données éclairent notre raison, mais ne nous font pas pour autant enfourcher une bicyclette. Les preuves chiffrées ne suffisent pas. Susciter des émotions favorise la mise en action.

Alors quels types d’émotions ?

Nous aurions tendance à acheter plus lorsque la peur de la mort est activée collectivement. Les communications qui génèrent de la fierté ou de la joie suscitent, quant à elles, davantage d’adhésion. Le succès du « Dry January » participe à un défi collectif qui génère un sentiment de fierté, plus efficace que la simple mise en avant des méfaits de l’alcool. Trop de complaisance risque toutefois de conduire à sous-évaluer l’importance des changements à mettre en œuvre.

Les individus peuvent estimer que le problème peut être résolu sans eux, et ne voient plus l’intérêt d’agir à titre personnel. Pour contourner ces comportements, les chercheurs recommandent des messages optimistes qui mettent l’accent sur la faisabilité et l’importance du comportement. Par exemple, la campagne les « nouveaux riches », portée par des entreprises comme Getaournd, Blablacar, Lokki ou Homeexchange, mobilise l’humour et des émotions positives pour valoriser des gestes individuels simples – louer, partager, échanger.

Biais de proximité

Le discours écologique s’est appuyé sur la figure de l’ours polaire prisonnier sur la banquise. Bien que cette image demeure un symbole puissant, elle a pu contribuer à ancrer l’idée que la crise environnementale relevait d’une réalité lointaine, déconnectée de nos expériences quotidiennes. Au contraire, les récits ancrés dans des cadres familiers facilitent la capacité des citoyens à s’y projeter.

Plus un individu perçoit une proximité – tant géographique que temporelle – avec les situations décrites, plus le récit lui semble accessible et est susceptible d’influencer concrètement ses comportements. Dans l’une de ses campagnes publicitaires, Renault invitait les individus à renoncer à utiliser leur voiture sur certains trajets. Pour ce faire, elle montrait le quotidien de plusieurs foyers qui, tout en activant des émotions positives, privilégiaient la marche ou le vélo sur des trajets journaliers.

Personnifier son récit

Les histoires sans personnages marquent peu. Évoquer les effets du réchauffement climatique sur la biodiversité marine reste abstrait, mais donner la parole à un pêcheur dont l’activité décline frappe davantage. La personnification réduit la distance psychologique et active l’empathie. Les histoires ont besoin d’être incarnées.

Plusieurs questions se posent. Qui sont les personnages principaux du récit à incarner ? Quelles valeurs et symboliques véhiculent-ils ? Sont-ils désirables pour l’audience ?

Alors que les consommateurs responsables sont associés à différents stéréotypes – rabat-joie, ermites, bobos, etc. – cette dernière question est clé. Cette logique vaut aussi pour les figures publiques.

Peur d’être exclus du groupe

Près de 19 % des Français déclarent avoir peur d’être exclus d’un groupe s’ils changent leur façon de consommer ; ce chiffre passe même à 34 % chez les 18-34 ans. Les normes sociales sont clés et peuvent être exprimées dans les récits via ce que les protagonistes font et valorisent : partager un moment heureux en famille dans un environnement non marchand ou offrir un unique cadeau immatériel à Noël.

Les récits dominants accompagnant la consommation de masse sont perçus comme désirables par une large part des consommateurs. Malgré les scandales, les marques d’ultrafast-fashion, comme Temu et Shein, continuent à prospérer, notamment auprès des jeunes. Dans les sociétés occidentales, les récits sont fondés sur des valeurs individualistes, qui privilégient les intérêts personnels (financiers, statutaires, santé) à l’intérêt collectif.

Comment faire alors la bascule entre ces imaginaires collectifs « égocentrés » et les récits de la transition écologique et sociale ?

Conjuguer intérêts individuels et collectifs

Une approche graduelle, faisant cohabiter les intérêts individuels et collectifs dans les récits, peut constituer un moyen de connecter les imaginaires de la « consommation de masse » à ceux de la transition. Par exemple, dans les sociétés occidentales, marquées par des valeurs individualistes, le renforcement d’émotions comme la fierté, orientées vers soi, pourrait avoir un effet plus fort que l’émerveillement, orienté vers les autres.

Dans une forme de « bataille des imaginaires », les récits de la transition vont se confronter à d’autres. La fréquence de diffusion constitue un paramètre important au regard des biais d’exposition (plus l’individu est exposé à une information, plus la probabilité qu’il ait un sentiment positif à son égard augmente).

Il n’existe pas un récit type, mais plusieurs récits possibles, chacun offrant des espaces de liberté favorisant leur appropriation. Il apparaît essentiel de prévenir le risque d’un nouvel imaginaire dogmatique.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

11.05.2026 à 11:12

Du DIF au CPF : le salarié, acteur de son parcours professionnel, entre promesse d’autonomie et opacité

Caroline Diard, Professeur associé - Département Droit des Affaires et Ressources Humaines, TBS Education

Texte intégral (1677 mots)

Depuis dix ans, la formation des salariés est de plus en plus individualisée. L’idée est de rendre ces derniers responsables et maîtres de leurs parcours. La multiplication non maîtrisée des offres de formation et la création d’un reste à charge pour le salarié modifient les conditions d’exercice de ces nouvelles possibilités. Au point de les vider de toute substance ?

Avec un budget individuel spécifique et un accès simplifié aux formations, le compte professionnel de formation (CPF) était présenté comme une promesse d’autonomie et d’adaptabilité depuis sa création en 2014.

Douze ans plus tard, le bilan est mitigé. En 2026, la participation forfaitaire obligatoire augmente, rendant le dispositif moins attractif. Tremplin vers de nouvelles compétences ou reconversions, il peut en effet devenir un casse-tête face à une offre pléthorique et opaque !

Individualisation progressive de la formation

Depuis la loi 16 juillet 1971, la formation professionnelle permanente constitue une obligation nationale. Depuis, de nombreux dispositifs permettant de se former tout au long d’une carrière ont été développés. Le bilan de compétences, la validation des acquis de l’expérience (VAE), le congé individuel de formation (CIF), le droit individuel à la formation (DIF), puis plus récemment le compte personnel de formation (CPF) ont été créés dans une logique d’individualisation des parcours tout au long de la vie. Ceci afin de tenter de réduire les inégalités d’accès à la formation. Le salarié a été rendu au fil du temps, légalement plus autonome dans ses démarches de formation, il est ainsi devenu acteur de son évolution professionnelle.

À lire aussi : La formation continue, garantie d’une reconversion professionnelle réussie ?

Le droit individuel à la formation (DIF), créé en 2004, marque une première étape vers l’autonomie des salariés. Réservé aux CDI ayant un an d’ancienneté ou aux CDD de plus de 4 mois, il offrait vingt heures de formation par an, cumulables sur six ans. Mais son utilisation était très encadrée, nécessitant l’accord préalable de l’employeur, sauf pour les formations hors temps de travail (avec versement d’une allocation de 50 % de la rémunération nette). L’originalité du dispositif reposait dans la possibilité de transfert des droits en cas de licenciement (hors faute grave). Le DIF pouvait financer un bilan de compétences ou une VAE, mais il était perdu en cas de retraite et actionnable sous conditions en cas de démission.

La loi du 5 mars 2014 relative à la formation professionnelle, à l’emploi et à la démocratie sociale a remplacé le DIF par le compte personnel de formation (CPF). Les heures cumulées au titre du DIF ont été transférées sur le CPF. Contrairement au DIF qui était lié au contrat de travail, le CPF est lié à la personne et il est géré à l’extérieur de l’entreprise par la Caisse des dépôts et consignation.

Les salariés disposent désormais d’un compte qui les suit tout au long de leur carrière indépendamment de leur employeur.

Le CPF, vers une individualisation radicale

Par la suite, la loi du 5 septembre 2018 a consolidé les droits individuels des salariés en renforçant le rôle du Compte personnel de formation (CPF). Cette loi « pour la liberté de choisir son avenir professionnel » transforme alors le paysage de la formation professionnelle continue.

Depuis 2019, les heures du CPF ont été monétisées, c’est-à-dire converties en euros.

Le CPF incarne la promesse d’une révolution. Dès 16 ans, chaque actif dispose d’un budget individuel pour se former, se reconvertir ou acquérir de nouvelles compétences, sans dépendre de son employeur. Avec 500 euros par année pleine travaillée (800 euros pour les moins qualifiés) et un accès simplifié grâce à une plate-forme en ligne et une plate-forme accessible sur smartphone à l’aide d’une application téléchargeable. La limite totale cumulée est de 5 000 euros (soit dix années pleines d’activité).

Le financement est assuré par les entreprises au moyen de prélèvements sur la masse salariale, notamment par l’Union de recouvrement des cotisations de sécurité sociale et d’allocations familiales (Urssaf) ou la Mutuelle sociale agricole (MSA) depuis 2022. Les opérateurs de compétences (Opco) peuvent aussi contribuer, notamment pour les petites entreprises.

Préparer la révolution numérique

L’objectif affiché est de réduire les inégalités d’accès à la formation et adapter les compétences aux mutations du marché du travail, notamment face à la révolution numérique et à l’essor des intelligences artificielles.

Le CPF développe l’adaptabilité et l’employabilité (et particulièrement pour les moins qualifiés) dans un environnement en mutation permanente. Pourtant, derrière les atouts du dispositif se cache une offre de formation pléthorique, parfois opaque, et un parcours semé d’embûches pour les bénéficiaires.

Casse-tête administratif

Le CPF s’est largement démocratisé Avec 1,4 million de personnes formées en 2024. Les motivations pour recourir au CPF sont diverses : reconversions professionnelles, montées en compétences, validations d’acquis… Le CPF permet des trajectoires personnalisées. Près de 72 % des salariés attendent du CPF d’être plus efficaces dans leur travail et 40 % visent l’obtention d’une certification pour faire reconnaître leur savoir-faire.

Des écueils

Les formations éligibles au CPF sont énumérées à l’article L.6323-6 du Code du travail

Il s’agit des actions de formations préparant à une certification ou un bloc de compétences enregistrées au Répertoire national des certifications professionnelles (RNCP) ou au Répertoire spécifique (RS).

Les actions de formation dites « de droit », comprenant les bilans de compétences, les actions permettant de valider les acquis de l’expérience (VAE) et la préparation aux épreuves théoriques et pratiques du permis de conduire.

Malheureusement, le choix est parfois difficile à effectuer dans une jungle de formations et des arnaques et dérives ont été recensées : certains organismes profitent du système pour proposer des formations peu utiles ou surévaluées et surtout non éligibles au CPF.

Pour contrer ses dérives, le périmètre du CPF a été réduit. Après avoir créé une participation forfaitaire obligatoire, l’État a fait évoluer le montant restant à charge : l’actif doit désormais financer une partie de sa formation, même s’il dispose des crédits nécessaires sur son CPF pour la payer intégralement. Le décret n°2026-234 du 30 mars 2026 fixe cette participation à 150 euros à compter du 2 avril 2026). Depuis le 20 février 2026, la loi de finances pour 2026 a fait évoluer les conditions d’éligibilité de certaines formations. Les montants mobilisables pour certains dispositifs sont désormais plafonnés (1 600 euros pour un bilan de compétences, par exemple).

Le paradoxe de l’autonomie

Le CPF place l’individu au cœur du dispositif d’employabilité mais suppose qu’il sache naviguer dans un système complexe. Pourtant, l’employeur devrait s’attacher à rester un acteur clé de l’accompagnement en matière de formation professionnelle continue en informant les salariés notamment.

Il est également nécessaire de poursuivre la clarification et la régulation de l’offre, de prévoir un référencement plus strict et d’exclure les formations sans débouchés avérés ou dont le coût est manifestement excessif en mettant en avant les organismes certifiés et les parcours validés par les branches professionnelles.

Il est important d’inciter les employeurs à cofinancer des formations alignées sur leurs besoins, tout en garantissant la portabilité des droits.

Sauver le CPF ?

Le CPF a indéniablement marqué une avancée majeure, en rendant la formation accessible à tous, mais pour qu’il devienne un réel levier d’émancipation et d’adaptabilité, il faut passer de la quantité à la qualité. Cela suppose de simplifier le choix pour éviter l’effet « supermarché de la formation » et accompagner les publics les plus fragiles, pour ne pas laisser les inégalités se creuser. Si le CPF est un outil encore perfectible, il demeure en l’état trop souvent détourné ou sous-exploité.

Caroline Diard ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

11.05.2026 à 11:12

Si vous participez à des ateliers collaboratifs, ne vous emballez pas, les décisions peuvent être déjà prises

Nathalie Tessier, Enseignante-chercheuse, ESDES - UCLy (Lyon Catholic University)

Texte intégral (1641 mots)

Les méthodes participatives de management ne seraient-elles pas qu’un leurre ? Elles faciliteraient l’adhésion des collaborateurs aux décisions de l’entreprise déjà prises en amont. Gare à ne pas vous laisser happer par ces moments collaboratifs, on vous demandera certainement de rattraper la charge de travail restante.

« Ces entreprises qui ont adopté le management participatif et qui cartonnent », titre le média Guide Entreprise. « Management participatif : comment libérer le potentiel de vos équipes ? », demande la Voix du Nord … La presse se fait l’écho des méthodes participatives et collaboratives de management dans les entreprises françaises qui semblent rencontrer un succès.

Le principe ? Faire participer activement tous les salariés. Les formats vont de simples réunions consacrées à la créativité à des séminaires pour générer de nouvelles idées avec des outils favorisant l’interactivité et l’intelligence collective.

Derrière une apparente démocratie participative à la prise de décisions de tout le monde, ces dispositifs ne serviraient-ils pas à s’assurer de l’adhésion des collaborateurs aux projets de l’entreprise, souvent décidés en amont ? Quid des collaborateurs qui n’y prennent pas part ? Le management participatif ne deviendrait-il pas un dispositif de « soumission librement consentie », notion introduite par Jonathan Freedman et Scott Fraser ? En 1966, ils soulignent que les individus peuvent avoir le sentiment d’agir librement, alors qu’ils ont été placés sous une contrainte ou une influence implicite.

Le risque : un « désenchantement managérial ».

La France, mauvaise élève en management

La France serait une « mauvaise élève » dans les pratiques managériales parmi ses voisins européens, c’est ce que semble révéler un rapport de l’Inspection générale des affaires sociales (Igas) publié en 2024. Il en ressort les points suivants :

un style jugé trop hiérarchique et vertical ;

un niveau assez faible d’autonomie des collaborateurs ;

un sentiment de reconnaissance insuffisant et une formation managériale très (voire trop) académique et largement insuffisante ;

l’absence d’une culture fondée sur le dialogue social et sur un principe contradictoire.

Pourtant, 78 % des professionnels pensent que leur entreprise favorise le travail collaboratif. Dans une autre étude plus récente, 70 % des salariés et 83 % des managers se déclarent engagés dans les projets de leurs entreprises.

Un modèle loin d’être nouveau

Ce modèle participatif est loin d’être nouveau. On le retrouve décrit dès les années 1950 sous la plume du chercheur en sciences sociales Chris Argyris. La participation des salariés était vue comme étant un moyen de motiver les collaborateurs.

Les formats de la participation des salariés ont été multiples dans les années 1970 et 1980 :

les cercles de qualité représentés par des groupes de salariés se réunissant pour améliorer la qualité, les coûts, etc. ;

les groupes semi-autonomes qui vont réfléchir de façon plus profonde et en continu sur le processus de production ;

les réunions de concertation pour favoriser l’expression des points de vue et prévenir ou gérer des conflits ;

les groupes d’expression où des salariés s’expriment sur les conditions de travail, les risques pour la santé ;

le management par les valeurs représenté par l’élaboration de chartes ou les projets d’entreprises.

À lire aussi : Pour sortir de la kakistocratie – le management par les nuls – il suffit d’affronter l’incompétence !

Au cours des années 1980, une littérature critique émerge. Ce modèle ne constitue pas réellement un modèle d’organisation du travail ; il s’agit davantage de bricoler autour de pratiques participatives, sans que son efficacité ne soit véritablement testée.

Effets pervers des pratiques participatives

Il semblerait qu’aujourd’hui il y ait une croissance de ces rituels collectifs institutionnalisés. Ces ateliers ou séminaires peuvent être encadrés par des consultants et durer une demi-journée voire une journée entière. Si elles sont mal encadrées et trop fréquentes, ce genre de pratiques managériales peuvent avoir des effets pervers.

Évaluation morale de loyauté à l’entreprise

Le premier risque est de juger les collaborateurs sur leur participation à ces rituels, plutôt que sur des réalisations objectives rédigées sur leur fiche de poste. L’engagement dans ces réunions devient un indicateur implicite de l’adhésion du collaborateur aux valeurs de l’entreprise. Pour ceux qui n’y participent pas : stigmatisation, puisque le collaborateur ne serait « pas motivé » ou « pas corporate ».

Surcharge de travail et perte de temps

La participation à ces réunions collectives peut constituer un coût invisible et caché. Le collaborateur, pouvant difficilement se défausser sous peine de ne pas être « corporate », finit par devoir rattraper leur charge, autrement dit travailler plus. Plus il y a de réunions, moins il y a de concentration et de qualité de travail. Cela augmente la fatigue, la vulnérabilité et peut être sur le long terme une source de risques psychosociaux (RPS).

Légitimer le travail des managers

Un troisième risque est d’utiliser la participation comme un outil pour justifier le rôle, voire le statut de manager. Ce dernier ne produirait-il pas du management visible dans la mesure où il anime les équipes de collaborateurs, il coordonne les actions et il contribue, grâce à ces réunions, à mobiliser les équipes ? Ces pratiques, loin de développer la performance, semblent les infantiliser, c’est la kakistocratie ou le règne des incompétents.

Consensus librement consenti

Déjà mis en évidence dans les théories de l’engagement et illustré dans l’ouvrage des psychologues Joule et Beauvois Petit Traité de manipulation à l’usage des honnêtes gens, un dernier effet pervers pourrait être de faire croire aux collaborateurs qu’ils deviendraient co-responsables des décisions prises. Or, la vision des managers sous-jacente n’est plus de la participation, mais une procédure de validation sociale de choix prédéfinis.

Trop de participation tue la participation

Les entreprises doivent-elles pour autant abandonner leurs pratiques « collectives » ? La non-participation à ces pratiques collaboratives pourrait-elle servir à argumenter des décisions prises pour justifier une insuffisance professionnelle ?

La participation pour être efficace doit être véritable, utile, volontaire et créatrice de valeur. Elle requiert certaines règles du jeu : créer un collectif, mettre en place des espaces de négociation, poser des intentions claires ou proposer un cadre transparent pour le processus de prise de décision. En parallèle, il est essentiel de former les collaborateurs sur des compétences relationnelles et émotionnelles adéquates afin d’animer ou coordonner l’action collective.

La participation ne devrait pas devenir ni systématique ni obligatoire, respecter le temps et l’intelligence des collaborateurs. Au contraire, elle pourrait être accompagnée d’actions concrètes :

suivre les propositions des collaborateurs ;

dégager du temps de travail pour ces temps collectifs ;

prévoir un budget dédié, mettre en place des équipes pilotes ;

lancer un projet expérimental.

Le cas échéant, le risque est de donner de faux espoirs de changements aux collaborateurs. Il existe de nombreuses pratiques et des outils de gestion efficaces des réunions participatives, mais c’est avant tout un état d’esprit. Trop de participation tue la participation.

Nathalie Tessier est membre de IP&M (Institut Psychanalyse & Management)

10.05.2026 à 11:16

Quand l’humour l’emporte sur la parole politique

Laélia Véron, Maîtresse de conférence en stylistique et langue française, Université d’Orléans

Texte intégral (1982 mots)

À mesure que les frontières entre information, divertissement et politique s’estompent, le rire s’impose au centre du jeu. L’humour semble combler le vide laissé par une parole politique en perte de crédit. Que révèle ce déplacement sur l’état du débat démocratique ? Que gagne (et que perd) la démocratie lorsque le rire prétend non seulement dénoncer, mais aussi changer le réel ?

« En vingt ans d’activisme pour la paix, j’ai influencé vingt personnes. Avec une plaisanterie sur un dictateur, vingt millions. »

Ces mots sont ceux de Noam Shuster-Eliassi, humoriste israélienne « entrée dans l’humour comme d’autres en politique » après avoir délaissé les manifestations et l’activisme aux Nations Unies pour la chanson et le stand-up engagé. L’humour permet-il le renouveau de la politique ?

Les relations entre les deux sphères restent houleuses. En témoigne la récente plainte du ministère de l’intérieur Laurent Nuñez contre l’humoriste Pierre-Emmanuel Barré (pour avoir comparé, dans une chronique sur les violences policières, la police à Daech) et le nouveau procès aux prudhommes de l’humoriste Guillaume Meurice, qui conteste la rupture anticipée de son contrat par son ex-employeur France Inter à la suite d’une blague sur Benyamin Nétanyahou.

Ces polémiques ne sont pas isolées : on peut également citer celle sur l’apparence vestimentaire lors d’un sketch sur France 5 de l’humoriste Merwane Benlazar (accusé d’islamisme en raison de son look) ou les controverses autour de l’humoriste Sophia Aram, accusée de « racisme » par les journalistes du Parisien à la suite d’une chronique dans laquelle elle se moquait des membres de la flottille en route vers Gaza, de l’eurodéputée Rima Hassan (surnommée « Lady Gaza ») et de l’activiste Greta Thunberg (renommée « Miss Krisprolls »).

Si ces polémiques ne sont pas nouvelles, comme le rappelle la linguiste Nelly Quemener, elles semblent prendre une dimension inédite : la blague de Guillaume Meurice, discutée à l’Assemblée nationale et au Sénat, a ainsi provoqué plus de réactions que certaines prises de position sérieuses de dirigeants politiques.

Des sphères de moins en moins étanches

Les sphères politiques et humoristiques ne cessent de se chevaucher. Les dispositifs discursifs médiatiques, qui jouent de plus en plus sur « l’infotainment » (le croisement de l’information et de l’entertainment, le divertissement), croisent très souvent prises de parole journalistique, politique et humoristique. Il est fréquent de voir réunis autour d’un plateau, politiques, experts, artistes et humoristes, si bien qu’on ne sait plus à quel régime discursif participe telle ou telle intervention.

Un exemple type est l’émission « Quotidien » de Yann Barthès, présentée comme « une grande session d’information qui mêle humour et impertinence. » Les réseaux sociaux contribuent à ce mélange des genres en rebondissant, avec des blagues, sur des informations sérieuses. Ces blagues peuvent faire le buzz et se voir ensuite relayées par les médias traditionnels.

Parole politique et parole politique humoristique s’entremêlent au point qu’il n’est plus toujours facile de les distinguer. Qui n’a pas fait l’expérience de s’esclaffer devant un titre du Gorafi puis d’être effaré quand, quelques jours après, l’information a priori burlesque est devenue réalité ? L’indistinction a donné lieu à un hastag, #pasgorafi, pour désigner des informations qui ont l’air d’être des blagues mais qui n’en sont pas. Les proches de Trump portent docilement des chaussures de la marque préférée du président des États-Unis, même lorsqu’elles sont trop grandes pour eux ? Clownesque mais #pasgorafi.

Que projette-t-on sur l’humour politique ?

Du côté du public, la dévalorisation de la parole politique, qui peut paraître de plus en plus vide et stéréotypée (ce qu’on appelle la « langue de bois ») peut aller de pair avec une tendance à reporter des attentes frustrées sur d’autres types de discours. On cherche alors la politique partout… sauf dans les discours institutionnels politiques.

Il peut s’agir de la parole scientifique, lorsque chercheuses et chercheurs sont sommés de trouver une solution à des problèmes politiques ou doivent mener un travail d’alerte politique face à la surdité de certains dirigeants, comme cela a été le cas avec les pesticides et la loi Duplomb. On pense aussi à la parole journalistique : il est quelquefois bien difficile de tracer la limite entre le discours d’un éditorialiste et le discours d’un politique professionnel. Enfin, c’est le cas de la parole humoristique.

Lorsque la parole politique est désavouée, qu’elle paraît inexistante ou nulle, l’humour politique peut finir par être perçu non comme un discours qui croise le politique, qui peut le servir ou au contraire le critiquer, mais comme l’incarnation de la parole politique. L’effet, quelquefois bien réel, de cet humour qui peut taquiner ou même déstabiliser le pouvoir en place peut alors être confondu avec une capacité politique à changer l’ordre des choses.

Retrouvez notre vidéo basée sur cet article

L’impossible équilibre des humoristes

Face à cette situation, les humoristes sont dans une situation d’autant plus inconfortable qu’ils peuvent être sanctionnés, comme le rappelle Nelly Quemener, « par en haut » (par des institutions, comme l’Arcom), mais aussi contestés « par en bas » (par le public, notamment sur les réseaux sociaux).

Pris entre des injonctions contradictoires, ces humoristes adoptent un discours ambigu. Certaines et certains vont revendiquer un humour « politique » mais tout en rejetant l’étiquette d’un humour « partisan » ou « militant ». L’humoriste Fary insiste sur l’importance de ne pas se prendre pour un « porte-parole » et préfère définir son spectacle comme un moment plus « poétique » que politique. Très peu d’humoristes assument de faire passer leur engagement politique au premier plan (Sophia Aram déclare qu’elle assume d’être « de moins en moins drôle », mais c’est une exception).

Guillaume Meurice signe bon nombre de pétitions marquées à gauche, mais lorsque La France insoumise (LFI) lui a proposé son investiture pour se présenter aux législatives en juin-juillet 2024, il a réagi en déclarant, sur les réseaux sociaux,

(une allusion ironique aux propos de Jean-Luc Mélenchon).

Quand on analyse le métadiscours des humoristes sur leurs pratiques, on remarque que les mêmes qui revendiquent l’humour politique et qui, pour le défendre, peuvent lui prêter bon nombre de vertus (pédagogiques, démocratiques, cathartiques) vont également prendre soin de rejeter la posture du « donneur de leçons » ou même de celui ou de celle qui croirait pouvoir agir sur le réel grâce au rire.

Dans un entretien au Monde, l’humoriste Charline Vanhoenacker déclare à la fois que l’humour politique est un moyen d’« inverser le rapport de domination » et qu’il ne faut pas le « surinterpréte[r] », car il n’aurait d’autre intention que de « faire rire ». Charline Vanhoenacker tente à la fois de défendre sa pratique (et son utilité) et de se protéger (sachant qu’elle a été, entre autres, interrogée par la police judiciaire à la suite de la blague de Guillaume Meurice) en dégonflant ses prétentions.

Ne réduire ni l’humour ni la politique

La force critique de l’humour n’est plus à démontrer. L’ironie politique peut ainsi permettre d’interroger et de reconsidérer les discours politiques dominants en les mettant à distance. Mais il ne faut pas réduire le discours politique à l’humour ou l’ironie. Le soulagement ou l’admiration éprouvée devant une vanne bien placée ne doit pas nous pousser à renoncer au débat, à la contestation et la proposition argumentée.

C’est d’ailleurs cet équilibre entre humour et sérieux politique que cherchent à atteindre bon nombre d’émissions qui ne sont rarement qu’humoristiques, qui alternent entre moments d’humour cathartique et écoute des analyses ou des propositions d’une ou d’un invité non humoriste.

L’humour politique peut être une étape, un moyen. Mais s’il devient une fin, il risque de tourner au ludisme, qui fait de tout discours un jeu, ou au cynisme, qui pointe les insuffisances de chaque discours. La dérision peut devenir une tentation : elle réduit alors le monde à un ensemble de discours absurdes et nous installe dans une position désabusée et désengagée vis-à-vis du réel. Au lieu de nous aider à affronter la politique, elle conduit alors à la déserter.

Laélia Véron est coautrice, avec Guillaume Fondu, de T’es sérieuse ? Problèmes politiques de l’ironie, La Découverte, 2026.

Laelia Véron a été chroniqueuse scientifique pendant plusieurs années dans l'émission "Par Jupiter" "C'est encore nous" "Le Grand Dimanche Soir" avec Charline Vanhoenacker et Guillaume Meurice sur France Inter. Elle est actuellement chroniqueuse dans l'émission "La Dernière", animée par Guillaume Meurice, sur Radio Nova.

10.05.2026 à 11:13

En Iran, la poésie comme langage politique clandestin

Firouzeh Nahavandi, Professeure émérite, Université Libre de Bruxelles (ULB)

Texte intégral (1734 mots)

En Iran, les vers des grands poètes classiques ne sont pas seulement un héritage culturel : ils permettent de dire, suggérer et partager des significations politiques sans les formuler explicitement.

Dans un contexte marqué, depuis plusieurs années par un durcissement de la répression en Iran — milliers de manifestants tués par les forces d’ordre, dizaines de milliers d’arrestations, surveillance accrue de la parole publique, multiplication des cas d’application de la peine capitale —, s’exprimer de façon explicite devient de plus en plus dangereux.

Dans ce contexte, certaines formes d’expression acquièrent une fonction particulière. C’est le cas de la poésie, qui ne relève pas uniquement du patrimoine culturel : elle constitue une pratique sociale vivante et un mode d’expression structurant. Aujourd’hui encore, les vers des grands poètes classiques continuent de circuler, d’être cités et réinterprétés — non seulement pour leur valeur littéraire, mais aussi parce qu’ils offrent une manière de dire les choses autrement.

Langage d’Ésope

Cette centralité de l’implicite ne relève pas seulement de la conjoncture actuelle : elle correspond à une ressource déjà disponible, qui devient particulièrement centrale en contexte de contrainte. Elle s’inscrit dans une histoire plus longue des rapports entre pouvoir et expression en Iran, où la parole indirecte a souvent constitué une modalité privilégiée pour dire ce qui ne pouvait être formulé ouvertement. Elle se retrouve également dans d’autres formes d’interaction sociale, comme le ta’arof, cet ensemble de codes relationnels fondés sur la politesse, le décalage entre le dit et le voulu, et la gestion implicite des positions sociales. Elle apparaît aussi, sous d’autres formes, dans les pratiques de négociation, où la formulation indirecte permet d’introduire des marges d’interprétation. On l’a par exemple constaté dans les pratiques diplomatiques contemporaines, quand l’Iran peut se dire prêt à la négociation tout en en déplaçant constamment les conditions, maintenant ainsi une marge d’interprétation.

À lire aussi : Realpolitik et fiabilité : le dilemme des négociations avec la République islamique d’Iran

Dans cette optique, le recours à la poésie ne relève pas d’un contournement ponctuel, mais d’un registre d’expression durable. Ainsi, dans un environnement où parler de façon directe revient à s’exposer au danger, la poésie apparaît comme une ressource discursive spécifique : elle permet de suggérer, d’évoquer, de partager des significations politiques sans les formuler explicitement. La densité symbolique et la polysémie de la poésie persane classique permettent des lectures multiples, ajustées aux contextes. Cette plasticité en fait un outil d’expression particulièrement efficace dans des contextes de coercition. Dans le Shahnameh, Ferdowsi (Xe–XIe siècle) met en scène des figures de souveraineté dont les trajectoires — justice, dérive, chute — offrent autant de modèles implicites d’évaluation du pouvoir. Ces récits n’évoquent pas directement le présent, mais ils fournissent des cadres d’interprétation à celui-ci.

Chez Saadi (XIIIe siècle), certaines maximes formulent plus directement les conditions de la légitimité politique :

« Le roi qui opprime son peuple creuse lui-même les fondations de sa chute. »

Leur généralité fait leur force : elles peuvent être mobilisées sans désigner explicitement une situation donnée.

À l’inverse, Hafez (XIVe siècle) privilégie l’ambiguïté. Ses vers autorisent des interprétations multiples, sans jamais s’inscrire dans un registre univoque. Cette indétermination facilite leur circulation dans des contextes de surveillance. Ces différents registres — récit exemplaire, maxime normative, ambiguïté poétique — composent un répertoire d’expressions disponibles. Ils offrent plusieurs manières de dire le pouvoir, de le juger ou de s’en distancier, sans recourir à une parole directe.

Lire entre les lignes : une compétence partagée

L’efficacité de ce mode d’expression repose sur une compétence largement partagée : la capacité à reconnaître les références, à interpréter les allusions et à lire entre les lignes. Car, en Iran, la poésie classique n’est pas réservée aux milieux lettrés. Elle est connue, citée, mobilisée dans les échanges quotidiens comme dans les discours publics.

« Les fils d’Adam sont les membres d’un même corps, créés d’une même essence. Si un membre souffre, les autres ne peuvent rester en repos. »

Ce passage de Saadi, inscrit au fronton du siège de l’Organisation des Nations unies, illustre la portée universelle de cette tradition. Mais dans le contexte iranien, il peut aussi être mobilisé comme une manière indirecte de rappeler que face à l’injustice, nul ne peut rester indifférent. Cette compétence ne se réduit pas à une connaissance des textes. Elle implique une capacité à situer les énoncés, à en ajuster l’interprétation en fonction de la situation, et à reconnaître ce qui est suggéré sans être explicitement formulé. Elle s’acquiert progressivement, par familiarité plus que par apprentissage formel, et constitue une dimension ordinaire de la socialisation.

Comprendre un vers ne consiste pas seulement à en saisir le sens littéral. C’est reconnaître une allusion, capter un sous-entendu, situer une référence. Cette compétence, acquise dans le temps long, devient dans un contexte de surveillance une ressource sociale et politique. Dans un environnement de surveillance, elle permet une communication implicite, où le sens circule sans être entièrement formulé.

Des répertoires anciens, des usages actuels

La force de la poésie classique tient aussi à sa distance par rapport aux situations contemporaines. Produits dans des contextes historiques éloignés, les vers d’Omar Khayyam (XIe–XIIe siècle), de Saadi ou de Hafez ne renvoient pas à une conjoncture précise. Cette distance facilite leur réappropriation. Les quatrains d’Omar Khayyam, qui insistent sur la fragilité de l’existence et la valeur de l’instant présent, peuvent ainsi entrer en résonance avec des contextes contemporains marqués par l’incertitude et la violence, en proposant une autre hiérarchie des valeurs. Cette capacité d’actualisation repose sur une tension productive entre distance historique et pertinence contemporaine. Plus les textes sont éloignés de leur contexte d’origine, plus ils peuvent être réinvestis dans des configurations nouvelles, sans être immédiatement assignables à une position politique explicite.

Aujourd’hui, ces répertoires se reconfigurent à travers de nouveaux supports. Sur les réseaux sociaux, les vers sont fragmentés, transformés, parfois anonymisés. Ils circulent sous forme de citations, d’images ou de slogans. Ces circulations numériques modifient les modalités de diffusion sans en altérer la logique. La fragmentation des vers, leur mise en image ou leur anonymisation renforcent parfois leur capacité de circulation, tout en maintenant leur fonction d’allusion. Le numérique n’efface pas la tradition : il en reconfigure les usages.

Lors des mobilisations qui ont suivi la mort de Mahsa Jina Amini en 2022, de nombreux messages ont repris, explicitement ou non, des motifs issus de la poésie classique — notamment très présents chez Hafez — la nuit, l’attente, l’aube — pour exprimer des attentes ou des critiques sans recourir à un langage explicitement politique.

Dans un espace public restreint, cette circulation permet de maintenir un langage commun.

Une autre manière de dire le politique

Le recours à la poésie peut être compris comme le signe d’un décalage entre les formes d’expression disponibles dans la société et les contraintes imposées à la parole publique. Ce décalage ne signifie pas absence de parole, mais transformation de ses formes. Il révèle une tension entre des attentes sociales d’expression et les limites imposées à leur formulation explicite. Dans cet espace contraint, la poésie apparaît comme l’un des lieux où cette tension peut se dire — de manière indirecte, mais intelligible.

Lorsque l’expression directe devient risquée, les formes indirectes ne disparaissent pas : elles se maintiennent, se transforment et parfois se renforcent. La poésie, en Iran, constitue une modalité spécifique du politique, fondée sur l’allusion, la polysémie et le partage de références communes.

Dans un contexte où parler peut entraîner des sanctions allant jusqu’à la mort, cette forme d’expression n’annule pas le risque, mais elle en modifie les conditions. Elle permet au sens de circuler sans être entièrement fixé. Ainsi comprise, la poésie apparaît moins comme un refuge que comme une ressource : non pas un extérieur au politique, mais une manière de le formuler sous contrainte.

Firouzeh Nahavandi ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview