12.05.2026 à 15:49

La majorité des Français n’est pas concernée par l’impôt sur l’héritage, mais pense l’être quand même

Julien Pillot, Enseignant-Chercheur en Economie, INSEEC Grande École

Texte intégral (2274 mots)

Une majorité de Français souhaite une baisse des droits de succession. Deux visions s’opposent : réduire les inégalités dès la naissance en taxant plus, ou diminuer l’impôt sur l’héritage pour valoriser ceux qui travaillent toute leur vie pour leur descendance. Mais de quoi parle-t-on au juste ? De quels montants ? Qui est concerné ? Quelles sont les tendances ?

« Des héritages passent de génération en génération, vous savez ce truc qui vous tombe du ciel. Il y a un moment où ça suffit ! » C’est par ces mots prononcés le 15 octobre dernier que la Présidente de l’Assemblée nationale, Yaël Braun-Pivet, a ravivé le serpent de mer de la taxation des successions.

Un débat de société qui ne laisse personne indifférent. Si les Français se prononcent majoritairement pour une baisse des droits de succession – 84 % dans un sondage d’avril 2024 –, dans les faits, seule une minorité est réellement concernée par le paiement de ces derniers. Par exemple, en ligne directe (parents-enfants), seuls 13 % des ménages dont le montant de l’héritage excède les 100 000 € sont assujettis au paiement de droits de succession.

Aujourd’hui, l’ampleur des montants en jeu est inédite. La « grande transmission » du patrimoine détenu par les générations du baby-boom est estimée à 9 000 milliards d’euros d’ici 2040.

Cet article vise à poser les termes d’un débat qui dépasse largement le cadre de l’analyse économique pour embrasser des dimensions morales, philosophiques, et politiques.

De quoi parle-t-on ?

Créés en France en 1791, les droits de succession taxent la part d’héritage reçue par chaque héritier, en fonction de son lien de parenté avec le défunt.

Concrètement, le barème de l’impôt sur l’héritage prévoit :

Un taux de 5 % en deçà de 8 072 € jusqu’à 45 % au-delà de 1,805 million d’euros pour les enfants et petits-enfants, selon la valeur des biens hérités ;

30 à 45 % pour les fratries selon la valeur des biens hérités ;

55 % pour les neveux, nièces, et autres parents jusqu’au 4e degré inclus ;

60 % pour les parents au-delà du 4e degré ou les personnes sans lien de parenté ;

Et une exonération pour le conjoint.

Des abattements personnels sont possibles, à condition que les héritiers n’en aient pas déjà bénéficié dans les 15 ans précédents le décès dans le cadre d’une « donation du vivant ». Ils sont de 100 000 € pour un enfant, un père ou une mère, 15 932 € pour un frère ou une sœur, 7 967 € pour un neveu ou une nièce et 1 594 € en l’absence d’un autre abattement applicable.

Au cours des dernières années, la progression des recettes de l’impôt sur l’héritage a été spectaculaire, passant de 7 milliards d’euros en 2011 à 16,6 milliards d’euros en 2023. Les principales raisons de cette progression sont naturellement à aller chercher dans la mortalité d’une population vieillissante, mais aussi dans la hausse de la valeur des actifs, immobilier en tête.

La France taxe plus que ses voisins

La France présente un des taux d’imposition, théorique comme effectif, parmi les plus élevés du monde. Avec un score de 0,74 % en 2021, la part des impôts sur les successions et donations, exprimée en point de PIB, y est la plus forte de tous les pays de l’OCDE.

Par ailleurs, alors que la tendance à la fiscalisation des héritages est à la baisse dans les pays développés, la France présente, avec la Corée du Sud, une progression sensible. De nombreux pays ont fait le choix d’abolir les droits de succession, parmi lesquels le Canada avant 1980, l’Inde en 1985, l’Autriche en 2008, la Hongrie en 2010 ou la Norvège en 2014. Les raisons invoquées par ces États : présenter un système fiscal attractif, et inciter à l’épargne et l’investissement.

Vision libérale vs sociale

L’argument selon lequel il serait injuste de taxer les économies réalisées après une vie à contribuer à l’État Providence revient très souvent dans le débat quand la parole est donnée aux citoyens, comme le souligne la chercheuse Stefanie Stantcheva. Les économistes, quant à eux, posent les termes du débat autrement. En simplifiant, nous pourrions évoquer une confrontation entre deux écoles de pensée.

Libérale : taxation contre-productive

L’impôt sur l’héritage découragerait les individus à être aussi productifs que possible de leur vivant. Ce déficit d’exploitation du plein potentiel de l’individu, dans la production comme l’investissement, finirait par éreinter la production de richesse nationale, au détriment de tous, à commencer par les classes populaires les plus dépendantes des mécanismes de redistribution.

Cette vision est portée par des économistes comme Milton Friedman, Gary Becker, Robert Barro, Thomas Sowell ou James Buchanan.

Sociale : réduire les inégalités à la naissance

Cette vision considère que la taxation des héritages, à plus forte raison dans un contexte où les revenus du capital sont prépondérants, permettrait à davantage d’individus à réaliser leur plein potentiel par une meilleure redistribution des richesses.

Elle est défendue par des économistes comme Thomas Piketty, Anthony Atkinson, Joseph Stiglitz, Emmanuel Saez ou Gabriel Zucman.

Les études cassent les préjugés

Dans un monde ouvert où les États n’hésitent pas à se livrer une concurrence fiscale pour attirer les capitaux, les hauts patrimoines pourraient déménager vers des contrées jugées plus accueillantes, de façon à échapper à la fiscalité sur les successions. Dans leur étude, les économistes Enrico Moretti et Daniel J. Wilson mettent en exergue un effet peu significatif des écarts d’imposition sur les choix de localisation des hauts patrimoines.

À lire aussi : Impôts sur l’héritage : une réforme nécessaire ?

Les économistes Jonathan Goupille-Lebret et Jose Infante se sont, quant à eux, intéressés à l’impact de l’augmentation du taux d’imposition de l’héritage sur la valeur du patrimoine transmis. Ils constatent un effet de substitution réel, mais modéré. Une augmentation de 10 % des droits de succession se traduirait ceteris paribus par une baisse de 2,5 % de la valeur du patrimoine transmis. Ces résultats peuvent s’expliquer par l’impréparation de certaines successions, notamment en cas de décès prématuré, ou par le fait que les impôts en question devront être acquittés par les héritiers sans affecter le niveau de vie de l’individu.

Si les effets d’une augmentation des droits de succession sur les comportements individuels ne sont pas bien documentés, leur effet sur la capacité des populations profitant de la redistribution à améliorer sensiblement leur niveau de vie, et à bénéficier d’une réelle mobilité sociale, n’est pas vraiment démontré non plus. Même des économistes tels que Gregory Mankiw ou James Mirrlees, a priori favorables à la fiscalisation des successions, reconnaissent que cela ne peut être fait sans étudier sérieusement les potentiels effets contre-productifs qu’ils pourraient engendrer.

60 % des Français surestiment l’impôt sur l’héritage

De nombreux mécanismes d’exonération – du démembrement de propriété, à la fiscalité sur les assurances-vie en passant par différentes dépenses fiscales catégorielles (dont le « pacte Dutreil ») – viennent réduire l’assiette de l’impôt sur l’héritage, mais contribuent également à en fausser sa perception auprès des Français.

Une enquête de France Stratégie de 2018 révélait, à ce titre, que seuls 15 % des Français parvenaient à situer correctement le taux moyen effectif d’imposition en ligne directe (entre 5 % et 10 %), quand ils étaient 60 % à le surestimer ; 74 % des répondants s’avéraient incapables de citer le seuil d’imposition ou la part des ménages français concernés par cet impôt.

Sans doute seraient-ils étonnés d’apprendre que 87,1 % des héritages en France sont inférieurs à 100 000 euros, et que la transmission médiane (par héritage et donation) est de l’ordre de 41 100 euros.

Les enfants héritent de plus en plus tard

Cette situation est à inscrire dans un contexte macroéconomique d’un patrimoine qui croît plus vite que le revenu, et dont la répartition dans la population est des plus inégales. En 2025, le Conseil des prélèvements obligatoires (CPO) indique que le patrimoine est passé de 4,5 fois le revenu disponible des ménages en 2000 à 6 fois en 2021. Les transmissions peuvent contribuer à figer des situations selon des principes liés au hasard de la naissance davantage que sur les mérites.

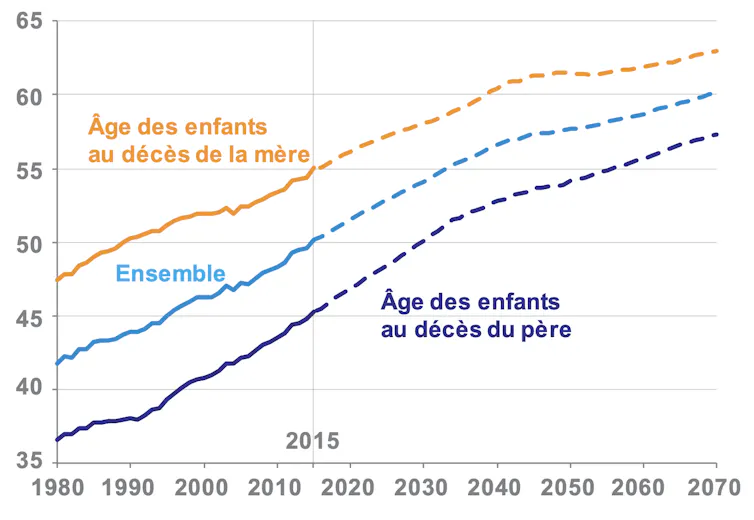

Ce débat, nous l’avons vu, dépasse largement le cadre de l’analyse économique pour embrasser des dimensions philosophiques. Et tandis que l’horloge tourne, la société française connaît une transition démographique inédite qui, par le jeu de l’allongement de l’espérance de vie, voit également reculer inexorablement l’âge auquel les enfants héritent. Un âge avancé qui est moins propice à l’investissement, lequel alimente l’économie, qu’à l’épargne, qui la prive de son carburant.

Julien Pillot ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

12.05.2026 à 15:47

Comment les sols sont-ils devenus un enjeu climatique ? Le regard de la sociologie

Céline Granjou, directrice de recherches, Inrae

Antoine Doré, Sociologue des sciences, techniques et politiques environnementales et agricoles., Inrae

Hélène Guillemot, Chercheuse retraitée, Centre national de la recherche scientifique (CNRS)

Laure Manach, Post-doctorante en sociologie, Mines Paris - PSL

Léo Magnin, Chargé de recherche en sociologie au CNRS, Université Gustave Eiffel

Robin Leclerc, Post-doctorant

Stéphanie Barral, Sociologue de l'économie et chargée de recherches, Inrae

Texte intégral (1998 mots)

Longtemps pensés uniquement à l’aune de leur fertilité, les sols sont aujourd’hui redécouverts pour leur statut de puits de carbone. Autrement dit, leur capacité à séquestrer le carbone en fait des contributeurs de premier plan à la lutte contre le changement climatique. Une étude sociologique menée auprès de scientifiques, politiques et acteurs publics territoriaux met en évidence cette redéfinition climatique des sols et ses conséquences concrètes.

Si le rôle climatique des forêts comme puits de carbone est connu depuis les années 1990, celui des sols l’est moins. Ces derniers contiennent pourtant trois fois plus de carbone et jouent un rôle clef dans son cycle global. Lors de la COP21 à Paris en 2015, le gouvernement français avait lancé l’initiative 4 pour 1000 afin d’encourager les agricultrices et agriculteurs à séquestrer du carbone dans les sols.

En augmentant les stocks de carbone des sols, la démarche visait à compenser les émissions fossiles tout en améliorant la qualité des sols. Mais la capacité des sols à séquestrer du carbone requiert l’adoption de pratiques agricoles spécifiques : implantation de couverts végétaux, réduction du labour, plantation de haies ou d’arbres, ou encore restitution à la terre des résidus de cultures comme les pailles. La préservation des zones humides, des forêts et des prairies, dont les sols sont particulièrement riches en carbone, contribue aussi à atténuer le changement climatique.

Comment ces diverses pratiques de séquestration du carbone modifient-elles les conceptions des sols ? L’équipe du projet ANR Posca a mené une vaste enquête sociologique pour répondre à cette question. À la clé, plus de 250 entretiens approfondis avec des scientifiques, des décideurs publics, des agents de collectivités territoriales et des acteurs agricoles.

Cette enquête montre que l’essor des pratiques de séquestration s’accompagne d’une redéfinition climatique des sols. Longtemps considérés principalement sous l’angle de la fertilité agricole, les sols sont désormais également vus comme des puits de carbone. Et cela, dans une large gamme de mondes sociaux : la recherche scientifique, mais également les politiques agricoles nationales et les territoires.

À lire aussi : Piéger le carbone dans le sol : ce que peut l’agriculture

Des recherches pour penser les sols à l’aune du climat

Il y a plusieurs décennies que les scientifiques travaillent sur le carbone des sols, souvent appréhendé en termes de matière organique ou d’humus. Ce carbone est en effet essentiel dans la fertilité des sols. Mais depuis le début des années 1990, une partie de leurs recherches se focalise désormais sur la description et la modélisation du rôle que joue le carbone des sols dans le changement climatique.

Les chercheurs ont notamment adapté leurs questions de recherche afin d’interroger les processus qui permettent de stabiliser le carbone dans les sols. Cela a permis de faire évoluer les modèles représentant ces mécanismes, dans le but de contribuer à améliorer les scénarios climatiques. Ils ont également créé de nouvelles infrastructures de surveillance des stocks de carbone dans les sols à l’échelle nationale, et noué de nouvelles collaborations avec les sciences du climat.

Les enjeux climatiques ont par ailleurs conduit les scientifiques des sols à produire de nouveaux travaux d’expertise, à la fois dans le cadre du Groupe d’experts intergouvernemental sur l’évolution du climat (GIEC) à l’échelle internationale, mais aussi à l’échelle nationale, pour estimer le potentiel de stockage du carbone dans les sols. Ces réorientations de leurs travaux permettent de fournir des éléments d’appui aux politiques publiques et aux développements économiques liés à la séquestration du carbone.

Les chercheuses et chercheurs ont ainsi transformé leurs agendas et pratiques de recherche pour produire des connaissances qu’ils estiment utiles à la lutte contre le changement climatique. Mais cela n’a pas été sans créer de nouvelles tensions au sein de cette discipline, notamment autour de la question de la non-permanence du carbone dans les sols.

Des crédits carbone pour les sols agricoles qui stockent

De nouvelles conceptions climatiques des sols sont également véhiculées par l’initiative du 4 pour 1000, depuis sa publication fin 2015 par le ministère de l’Agriculture. Cette initiative tire son nom du calcul selon lequel augmenter tous les ans d’environ 0,4 % le stock global de carbone contenu dans les sols permettrait de compenser l’augmentation annuelle des émissions de gaz à effet de serre.

Plus récemment, une étude coordonnée par Inrae a permis de préciser le potentiel de séquestration des sols nationaux. Celui-ci équivaut à environ 40 % des émissions de gaz à effet de serre du secteur agricole en France – soit 6,5 % du total des émissions nationales. Certes, c’est loin de pouvoir compenser l’ensemble des émissions nationales de gaz à effet de serre, mais cela reste une contribution bienvenue à l’effort d’atténuation, que le gouvernement souhaite encourager.

Cette promesse de séquestration est d’autant plus mise en avant aujourd’hui qu’elle permet de repositionner le secteur agricole comme solution au changement climatique, dans une période où celui-ci est fortement critiqué – quand bien même le secteur reste émetteur net de gaz à effet de serre.

Le gouvernement français a ainsi lancé son label bas carbone (LBC) fin 2018. Cadre de certification des réductions d’émissions et des pratiques séquestrantes, il vise, entre autres, à rétribuer les efforts des agriculteurs qui adoptent de nouvelles pratiques vertueuses. Il permet notamment d’attester du nombre de tonnes de carbone séquestrées, pour que les agriculteurs puissent vendre les crédits carbone correspondant à des entreprises ou des collectivités. Le principe est celui du marché carbone : ces acheteurs pourront, à leur tour, alléguer d’une contribution à l’effort d’atténuation du changement climatique.

Le label bas carbone contribue à véhiculer une vision des sols agricoles comme puits de carbone optimisables grâce aux changements de pratiques agricoles. Pour autant, son impact reste actuellement limité, car les projets qui en relèvent mobilisent finalement très peu la séquestration du carbone, mais plutôt des pratiques de réduction des émissions.

Des collectivités qui quantifient le carbone dans leurs sols

Depuis 2016, une nouvelle législation exige par ailleurs que les collectivités de plus de 20 000 habitants évaluent le potentiel de séquestration de carbone par les forêts et les sols. Elles doivent ainsi concevoir un plan climat air énergie territorial (PCAET) qui mesure, entre autres, la quantité de carbone contenu dans les sols et détaille des stratégies possibles pour augmenter ces stocks. La réglementation reste cependant muette sur les moyens et les outils utiles pour quantifier et gérer les stocks de carbone des sols.

Dans ce contexte, les collectivités territoriales mobilisent divers instruments de quantification du carbone des sols. Les analyses de terre étant longues et coûteuses à mettre en œuvre, ces outils reposent généralement sur des données et des modèles numériques qui prédisent l’évolution des stocks de carbone en fonction de différents scénarios de gestion.

L’Ademe a par exemple développé l’outil Aldo, qui permet aux fonctionnaires territoriaux et aux bureaux d’études d’obtenir aisément des valeurs de stocks de carbone.

Agro-Transfert, un organisme de recherche et développement agricole, a également créé l’outil Simeos-AMG. Initialement pensé pour aider les agriculteurs à conserver des sols fertiles et riches en matière organique, il est désormais mobilisé par les professionnels agricoles pour connaître l’impact carbone de leurs pratiques, ainsi que par certaines administrations territoriales pour concevoir leur plan climat air énergie territorial. Le carbone des sols devient ainsi un nouvel objet d’action publique dans les territoires.

Vers une redéfinition climatique des sols

Notre recherche a ainsi mis en lumière la façon dont les sols se trouvent redéfinis à l’aune des enjeux climatiques, que ce soit dans les mondes de la recherche scientifique, des politiques agricoles nationales ou des territoires. Nos résultats montrent que cette climatisation des sols se traduit d’ores et déjà concrètement par de nouvelles pratiques, des engagements et des instruments inédits qui se développent.

Les sols ne sont par ailleurs pas réduits au rôle de simples réservoirs de carbone à optimiser. L’enquête révèle que nombre d’acteurs, en particulier scientifiques, rappellent que ce carbone à séquestrer peut être relargué dans l’atmosphère, notamment si les pratiques agricoles de séquestration ne sont pas maintenues sur le long terme.

De ce fait, il est crucial d’inscrire ces changements dans le long terme. Et cela d’autant plus que ces pratiques sont aussi alignées avec des gains en termes de fertilité et de qualité des sols, les principales préoccupations dont ils faisaient jusqu’ici l’objet. La redéfinition climatique des sols relie ainsi les questions d’atténuation climatique avec les questions de maintien de la fertilité agricole et de conservation de la qualité des sols.

Céline Granjou a reçu des financements de l'Agence Nationale de la Recherche pour le projet ANR-20-CE26-0016

Antoine Doré a reçu des financements de l'Agence Nationale de la Recherche.

Hélène Guillemot a reçu des financements de l'ANR pour le projet POSCA.

Laure Manach a reçu des financements de l’Agence nationale de la recherche et de la Fondation TTI.5.

Léo Magnin a reçu des financements de Agence Nationale de la Recherche (ANR) dans le cadre du projet POSCA.

Robin Leclerc a reçu des financements de l'ANR

Stéphanie Barral a reçu des financements de l'Agence Nationale de la Recherche.

12.05.2026 à 15:11

Bubble tea, fluffy pancakes, corn dogs… quand la nouvelle street food des réseaux sociaux pose aussi une question de santé

Anne Parizot, Professeur des universités en sciences de l'information et de la communication émérite, Université Bourgogne Europe

Texte intégral (2094 mots)

Marqueurs d’une nouvelle street food mondialisée, bubble tea, fluffy pancakes et corn dogs séduisent par une esthétique attractive, ludique ou des textures étonnantes, et sont largement popularisés sur TikTok, Instagram, etc. Mais ces aliments sont généralement trop gras, trop sucrés, trop salés et ultratransformés. Consommés régulièrement, au goûter ou en snack, ils posent des questions de santé que la recherche devra explorer.

Textures spectaculaires, couleurs vives et hashtags gourmands : une nouvelle génération de street food est pensée autant pour être photographiée et partagée en ligne que dégustée, comme le fameux chocolat de Dubaï, contribuant à leur succès mondial.

À lire aussi : Le marketing viral du chocolat de Dubaï

Le bubble tea – une boisson remplie de perles noires remontant à la surface d’un thé lacté –, le fluffy pancake – un pancake épais tremblant comme un soufflé –, ou encore le corn dog, une saucisse panée qui s’étire en longs fils de mozzarella fondue… largement diffusés sur les réseaux sociaux, tous illustrent la transformation du rapport contemporain à l’alimentation. Manger devient une expérience visuelle, sociale et numérique.

Si ces produits sont séduisants par leur créativité et leur dimension ludique, ils soulèvent aussi une question de santé publique. Derrière leur esthétique attractive se cachent souvent des préparations qui contiennent beaucoup de sucre, de matières grasses ou de sel, dont la consommation répétée peut contribuer à des déséquilibres alimentaires.

Une street food mondialisée

Dans les villes européennes, vitrines colorées de bubble tea, piles de fluffy pancakes tremblotants ou corn dogs géants envahissent désormais rues commerçantes et centres commerciaux. Issus de Taiwan, du Japon, de Corée du Sud ou des États-Unis, ils incarnent une street food globalisée qui circule rapidement entre les cultures urbaines.

Traditionnellement définie par la FAO (Food and Agriculture Organization of the United Nations, 1990) comme la vente d’aliments et de boissons prêts à consommer dans l’espace public, la street food s’est largement transformée. Food trucks, marchés éphémères, festivals culinaires font désormais de la rue une scène gastronomique où la nourriture devient un phénomène pratique, culturel et médiatique.

En France, France Update relève que cette restauration rapide reprend même des produits du terroir, illustrant ce que le quotidien le Monde qualifie de « terroir sur le pouce »… bien loin cependant des produits du terroir sains comme les légumes oubliés.

À lire aussi : Rutabaga, topinambour : ce que le retour des légumes « oubliés » dit de notre rapport à l’alimentation

Une esthétique sensorielle… mais des aliments gras, sucrés, ultratransformés…

La nouvelle street food vise à créer des textures inédites et une expérience gustative immédiate. Son succès repose largement sur les textures et les couleurs. Perles moelleuses du bubble tea, légèreté des pancakes soufflés et croustillant des corn dogs produisent une expérience sensorielle forte.

Ces recettes mobilisent souvent sucre, amidon, matières grasses, additifs et autres marqueurs d’ultratransformation destinés à stabiliser les textures ou à renforcer l’attrait visuel.

À lire aussi : Aliments ultratransformés : Comment aider les consommateurs à les repérer et à les éviter ?

Cette recherche d’effets sensoriels contribue toutefois à des compositions nutritionnelles qui font la part belle au sucre, aux graisses ou au sel, ce qui soulève des questions de santé publique lorsque ces produits deviennent des consommations régulières.

Zoom sur trois icônes alimentaires virales

- Le bubble tea ou boba tea, né à Taiwan (1980), associe thé sucré, lait (ou crème végétale) et perles de tapioca gélifiées. Son succès repose aussi sur son aspect ludique et son vocabulaire marketing – boba, chewy pearls, creamy milk tea – à l’image des références proposées par les marques Tiger Sugar ou encore Moomin Boba. Pourtant, un verre standard peut contenir entre 30 et 60 g de sucre, ce qui peut favoriser surconsommation calorique, caries et/ou prise de poids.

Les hashtags (#bubbletea, #boba, #bobalife, #foodie) associent le produit à un univers de convivialité (partage), de gourmandise (sucré, perles) et de style de vie (lifestyle). Sur TikTok, la présence de #fyp (en toutes lettres_for you page_, qui signifie « page personnalisée »), et #foryou (« pour toi ») associés à bubble tea indiquent l’intégration du produit dans les circuits viraux et de découverte algorithmique.

- Les fluffy pancakes (pancakes soufflés japonais), popularisés dans les cafés de Tokyo et d’Osaka au début des années 2000 doivent leur texture aérienne à des blancs d’œufs montés en neige et à l’ajout de sucre et d’agents levants.

Leur esthétique, souvent décrite comme fluffy (« moelleuse »), airy (« aérée »)_ ou cloud-like (« comme un nuage »), alimente leur viralité sur les réseaux sociaux. Mais accompagnés de sirop, de crème, ils atteignent facilement 350 à 500 kcal par portion, avec un apport glucidique rapide.

Leur diffusion mondiale s’accompagne d’hashtags (#fluffypancakes, #soufflepancake, #foodporn, #brunch) soulignant texture et esthétique : le pancake tremblotant devient un spectacle culinaire, valorisant l’aérien, le léger « soufflé », le cloud-like envoie à l’esthétique et à la viralité dans les hashtags Instagram (#ふわふわパンケーキ ou #soufflepancakes), la wobble (tremblement), la hauteur et le visuel parfaits pour les photos et l’expérience sensorielle « airy », « soft », « jiggly » (tremblotant) révèlent une nouveauté tactile par rapport aux pancakes classiques. Sensation et visuel sont valorisés avant même de nommer l’ingrédient.

- Les corn dogs : issus des foires populaires américaines, leur origine serait aussi coréenne avant leur migration vers les États-Unis.

Ils combinent saucisse et pâte de maïs frite, servie sur un bâtonnet. Une version korean corn dog propose des variantes garnies de mozzarella, enrobées de chapelure panko ou même de morceaux de pommes de terre.

Les vidéos du spectaculaire cheese pull (étirement spectaculaire du fromage) participent à leur diffusion virale par l’intermédiaire de termes sensoriels : crunchy (croustillant), gooey (collant), cheesy (fromageux) mettant l’accent sur la texture et la gourmandise. Sur TikTok, les hashtags (#koreancorndog, #cheesepull, #foodadventures, #foodlover) renvoient à une isotopie de la découverte et de la viralité voire de fusion avec des spécialités locales.

Si on croit la liste des ingrédients qui entrent dans la conception des corn dogs (fromage, pâte de maïs, etc.), Leur profil nutritionnel fait toutefois craindre un apport élevé en graisses et en sel.

Ainsi, nourriture, langage et images participent à la construction d’un imaginaire gastronomique partagé. Les recettes sont reprises par les sites de cuisine pour les réaliser à la maison.

Mais alors qui est la cible ?

Nous formulons l’hypothèse, qui devra être confirmée, que l’influence des réseaux sociaux et le langage utilisé suggèrent que les publics visés seraient les suivants :

1 – Les jeunes urbains (15-35 ans) constitueraient le cœur de cible : ils sont particulièrement sensibles aux tendances alimentaires, à la nouveauté et à l’esthétique visuelle des produits.

2 – Les utilisateurs actifs des réseaux sociaux sont également visés : préparations colorées et photogéniques sont conçues pour être partagées en ligne, transformant l’acte de consommation en contenu numérique.

3 – Les curieux gastronomiques, enfin, sont attirés par l’expérimentation culinaire et les textures inédites (chewy, mousseux, croustillant).

Le langage marketing contribue à construire cette identité sociale : rapide, visuel et largement anglophone, il valorise le plaisir immédiat et la visibilité sur les réseaux plus que la dimension nutritionnelle.

Une étude récente sur l’impact des plateformes examine l’usage du bubble tea comme objet culturel et instrument de « gastrodiplomatie » pour Taïwan.

Entre plaisir alimentaire et enjeu de santé

Les nouvelles icônes de la street food racontent finalement autant notre manière de manger que notre manière de communiquer : dans les villes connectées, l’alimentation n’est plus seulement une question de goût ou de nutrition, mais aussi d’images, de langage et d’identité sociale. Mais si ces tendances révèlent une créativité culinaire mondiale, ces produits de la street food cachent, derrière leur dénomination et caractéristiques linguistiques et/ou photographiques, des produits alimentaires trop gras, trop sucrés, – bref, des bombes caloriques – également ultratransformées.

Ces produits ne sont pas nécessairement problématiques lorsqu’ils sont consommés occasionnellement. L’enjeu de santé publique réside davantage dans leur banalisation dans les pratiques alimentaires quotidiennes quand ils sont consommés comme snacks ou goûters. La question n’est pas de les interdire, mais de rappeler l’importance de la modération et d’une alimentation équilibrée. Des versions allégées – réduction du sucre, cuisson au four, ingrédients moins transformés – permettent également de concilier plaisir et attention nutritionnelle.

Cet article s’inscrit dans une réflexion plus large sur les transformations contemporaines des cultures alimentaires et des pratiques de consommation dans les espaces urbains.

Anne Parizot ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview