11.05.2026 à 16:46

IASI-NG, la nouvelle mission trois-en-un pour l’étude de l’atmosphère terrestre

Cyril Crevoisier, Chercheur au CNRS, observation spatiale du climat, École polytechnique

Adrien Deschamps, Responsable des programmes Atmosphère Météo, Centre national d’études spatiales (CNES)

Texte intégral (1765 mots)

Le satellite européen Metop-SG-A1 a été lancé depuis la base de Kourou à bord d’Ariane 6 le 12 août 2025, et les premières données ont été distribuées à la communauté scientifique ce 4 mai. À son bord, pas moins de six instruments dédiés à l’observation de l’atmosphère terrestre, parmi lesquels la mission-phare IASI-Nouvelle Génération (IASI-NG) du CNES.

À l’heure où les données sur le climat sont en danger, cette nouvelle génération d’instrument va suivre l’évolution de l’atmosphère terrestre pendant plus de 20 ans et servir de référence internationale pour le sondage vertical infrarouge de notre atmosphère.

—

Les satellites sont une composante majeure de l’étude et de l’observation de la Terre. Ils apportent à l’échelle globale les observations nécessaires afin de mieux comprendre et prévoir l’évolution de la planète, et de distinguer les effets induits par l’homme de ceux liés à la variabilité naturelle de la Terre. Au cours des trois dernières décennies, les observations satellitaires ont permis de surveiller en continu l’état de l’atmosphère terrestre. Les instruments spatiaux actuels alimentent ainsi les modèles de prévision météorologique, contribuent à l’évaluation du climat et surveillent les changements rapides dans la composition de l’atmosphère.

La mission IASI (pour « Interféromètre Atmosphérique de Sondage Infrarouge ») occupe une place essentielle dans ce domaine car elle permet de cartographier l’atmosphère et sa composition en 3D. IASI cumule désormais plus de dix-huit années d’observations grâce à la combinaison de trois instruments identiques lancés sur trois satellites successifs entre 2006 et 2018. Les deux derniers exemplaires sont toujours en activité.

Afin de garantir la continuité à long terme de ces observations, le CNES et EUMETSAT (l’agence européenne chargée de la surveillance satellite du climat et de la météorologie) ont lancé le développement de la mission IASI-NG.

Deux fois plus précise et deux fois plus performante que ses prédécesseurs, IASI-NG fournira pour 20 nouvelles années une meilleure description de la structure de l’atmosphère (température, humidité, gaz atmosphériques) notamment dans les premiers kilomètres de l’atmosphère, ce qui est essentiel pour réaliser une bonne prévision météorologique, étudier la qualité de l’air et les émissions de gaz à la surface.

Le sondage atmosphérique dans l’infrarouge : une filière d’excellence française

Développé par le CNES en collaboration avec EUMETSAT, l’instrument IASI mesure le spectre du rayonnement infrarouge émis par la Terre. Celui-ci varie en fonction de la température et des gaz présents dans l’atmosphère, et c’est son analyse qui permet de cartographier l’atmosphère en 3D et donc de visualiser les vagues de chaleur ou de froid, les nuages de poussières désertiques ou encore les panaches de pollution par exemple.

IASI est un élément clé du système de surveillance mondial de l’atmosphère. Il contribue individuellement davantage que tout autre instrument spatial à la précision des prévisions météorologiques mondiales à 24 heures. Ses observations représentent ainsi 45 % des données utilisées pour réaliser les prévisions dans le système de Météo-France.

De plus, grâce à IASI, la communauté scientifique a démontré la possibilité d’observer plus de trente composants atmosphériques, y compris des gaz qui n’avaient jamais été observés depuis l’espace auparavant, tel l’ammoniac.

IASI permet aussi de mesurer les concentrations de dioxyde de soufre émis par les éruptions volcaniques, qui participent au réseau de surveillance qui alerte les compagnies aériennes en cas d’éruption.

Enfin, IASI permet de mesurer l’évolution de seize variables climatiques essentielles pour suivre l’évolution du climat : gaz à effet de serre, nuages, aérosols.

IASI est ainsi un contributeur clé aux services européens Copernicus, le programme européen de surveillance intégrée de l’environnement basé sur des réseaux de surveillance in situ, sur l’observation spatiale et sur la mise en œuvre de modèles numériques. En reconnaissance de ses performances instrumentales exceptionnelles, IASI a été choisi comme référence internationale pour les mesures dans l’infrarouge par l’Organisation Météorologique Mondiale, contre laquelle toutes les autres missions spatiales du même type doivent se calibrer.

Les objectifs de IASI-NG

La mission IASI-NG vise à améliorer significativement les performances de IASI. Elle est embarquée sur les satellites européens Metop-SG-A dont trois lancements sont prévus de 2025 à 2039.

Ainsi, en couplant IASI et IASI-NG, quarante années d’observation du rayonnement infrarouge terrestre seront disponibles pour étudier l’évolution de l’atmosphère sur une échelle climatique.

De plus, grâce à ses performances instrumentales accrues, IASI-NG fournira une meilleure description de la température et de l’humidité, notamment dans les premiers kilomètres de l’atmosphère, ce qui est essentiel pour réaliser une bonne prévision météorologique. Ainsi, par exemple, IASI-NG améliorera la prévision des tempêtes, en termes de localisation et de suivi, mais également en termes de niveaux de précipitations.

Alors que les instruments IASI en service détectent déjà plus de 30 molécules de gaz différents (gaz à effet de serre, ammoniac, ozone, monoxyde de carbone), IASI-NG va encore enrichir ce catalogue, tout en observant mieux les basses couches de l’atmosphère ce qui est essentiel pour mieux prévoir les épisodes de pollution ou de soulèvement de poussières désertiques.

Enfin, IASI-NG permettra de mieux connaître le positionnement vertical de ces différents composants atmosphériques (gaz, particules), ce qui permettra de mieux contraindre les modèles de transport atmosphérique qui sont à la base des modèles de prévision météorologique et des modèles du climat.

Une innovation technologique pour une première mondiale

IASI et IASI-NG mesurent le spectre du rayonnement infrarouge émis par le système Terre-atmosphère. À l’aide d’algorithmes numériques de traitement du signal, les spectres sont interprétés en termes de variables géophysiques (température, concentration de gaz).

Lors de la conception d’un nouvel instrument, il est nécessaire de trouver un compromis entre différents paramètres instrumentaux — par exemple, avoir un spectre mieux résolu avec un meilleur échantillonnage en fréquences augmente le bruit associé à la mesure. Le défi consiste donc à optimiser le choix des paramètres instrumentaux afin d’améliorer la résolution verticale et la précision des sondages.

Pour IASI-NG, une amélioration d’un facteur deux de la résolution spectrale et du bruit radiométrique par rapport à IASI a été choisie. Pour y parvenir, la solution est d’augmenter le champ d’observation de l’instrument. Mais l’instrument reçoit alors un rayonnement à un angle d’incidence élevé par rapport à son axe, ce qui altère le spectre mesuré.

La conception de IASI-NG a donc nécessité une innovation technologique pour compenser ces « effets de champ » : la réalisation d’un interféromètre de Mertz. Ce concept est pour la première fois déployé dans le cadre d’une mission spatiale. Le mécanisme interférométrique central est particulièrement innovant et a été breveté par le CNES et Airbus Defence and Space, maître d’œuvre de l’instrument.

Depuis sa mise en orbite, IASI-NG mesure plus de 1,3 million de spectres infrarouges par jour, sur terre et sur mer, de jour comme de nuit, avec un délai de réception par les centres de prévision météorologique et les laboratoires de recherche de moins de 120 minutes. Après une phase classique de « calibratrion/validation », durant laquelle le CNES s’est assuré du bon fonctionnement technique et des derniers réglages, la distribution des observations de IASI à la communauté scientifique débute début avril.

Plus qu’une simple continuation de IASI, les performances accrues et innovantes de IASI-NG en feront un atout pour les sciences atmosphériques pour les prochaines décennies dans trois domaines majeurs, la prévision numérique du temps, la composition atmosphérique et l’étude du climat.

Cyril Crevoisier a reçu des financements de projets et bourses de recherche de l'Agence Nationale de la Recherche, du Centre National d'Etudes Spatiales, de l'Agence Spatiale Européenne et de l'Agence Spatiale Européenne pour les Satellites Météorologiques.

Adrien Deschamps travaille au CNES qui a la responsabilité du développement de IASI-NG et a assuré sa maitrise d'ouvrage

07.05.2026 à 15:06

Dissuasion algorithmique, rétention : l’IA fait-elle passer la cybersécurité à une nouvelle ère ?

Christine Abdalla Mikhaeil, Assistant professor in information systems, IÉSEG School of Management

Texte intégral (1859 mots)

L’entreprise états-unienne Anthropic, spécialisée en intelligence artificielle générative, a pris début avril la décision de geler la diffusion publique de l’un de ses modèles récents, baptisé « Mythos ».

Selon un communiqué de la société, cette décision découle d’une puissance de calcul et d’une capacité de raisonnement jugées trop « offensives ». Anthropic a choisi de ne partager son modèle qu’avec une coalition de géants technologiques (Apple, Amazon Web Services, Cisco, Google, Microsoft, etc.) dans le cadre du projet Glasswing. Le but annoncé est d’utiliser Claude Mythos Preview pour détecter des vulnérabilités dites « zero-day » (c’est-à-dire inconnues et n’ayant aucun correctif connu) et sécuriser proactivement les logiciels critiques… avant que des acteurs malveillants n’exploitent ces failles.

Les grands modèles de langage savent déjà coder depuis quelques années, mais la presse spécialisée documente désormais un saut plus préoccupant. Des systèmes d’intelligence artificielle (IA) peuvent identifier des vulnérabilités réelles dans des logiciels critiques. Les autorités, comme l’Agence nationale de la sécurité des systèmes d’information (Anssi), soulignent la capacité des systèmes d’IA à automatiser les attaques.

Les enjeux de la diffusion massive de tels modèles, Mythos compris, dépassent largement le cadre technique. Une cyberattaque d’envergure, automatisée par une IA, pourrait paralyser des systèmes financiers ou logistiques en quelques secondes, avec un coût de remédiation se chiffrant en milliards d’euros. Les enjeux sont aussi sociétaux et de santé, puisque nos hôpitaux, nos réseaux énergétiques et les autres systèmes critiques reposent sur des couches logicielles souvent anciennes, vulnérables à des « attaques de zero-day » désormais générées à la chaîne.

À lire aussi : Hacker la bombe ? Ce que l’IA Mythos révèle du pari de la dissuasion nucléaire

Dans ce contexte, des IA ultraperformantes, comme Mythos, peuvent-elles contribuer à une forme de « dissuasion algorithmique » ? Celle-ci repose sur un principe simple : détecter et neutraliser ses propres vulnérabilités critiques plus vite que n’importe quel attaquant humain ou automatisé – y compris lors d’une attaque – si rapidement que l’attaque en devient inutile ou trop coûteuse.

La rétention de ce modèle par une ou des entreprises privées états-uniennes rouvre également la question de la souveraineté numérique à l’échelle mondiale.

Les systèmes d’IA facilitent les cyberattaques

Historiquement, la cybersécurité repose sur une asymétrie fondamentale : l’attaquant n’a besoin de trouver qu’une seule faille de sécurité, tandis que le défenseur doit toutes les combler dans une forme de course contre la montre.

L’intégration de systèmes d’IA renforce les capacités des attaquants, en premier lieu parce qu’un modèle comme Mythos peut scanner des millions de lignes de code en quelques minutes, là où un humain passait des semaines à analyser le code source d’un logiciel pour y déceler une erreur de mémoire. C’est ce que l’on appelle l’« automatisation de la reconnaissance ».

De plus, l’IA permet le phishing de haute précision, c’est-à-dire des messages frauduleux (le phishing classique) mais plus crédibles, sans fautes d’orthographe, dans n’importe quelle langue et ultrapersonnalisés pour tromper l’utilisateur. L’Anssi alerte d’ailleurs sur l’usage de l’IA générative pour briser les barrières linguistiques et psychologiques traditionnelles qui rend les « pare-feux humains » – c’est-à-dire la vigilance et l’esprit critique des lecteurs – de plus en plus obsolètes.

Enfin, des malwares peuvent désormais réécrire leur propre code en temps réel pour échapper à la détection « par signature ». Cette méthode classique des antivirus consiste à identifier un virus par son « empreinte » (un code déjà connu et répertorié). En changeant constamment de forme (exploitation polymorphe), le malware devient invisible pour ces outils traditionnels.

L’IA pour la cyberdéfense

En miroir, l’IA améliore aussi les capacités de cyberdéfense, grâce à des analyses causales, qui permettent de modéliser les relations entre événements, ainsi qu’en accélérant l’identification d’anomalies par une surveillance automatisée et la priorisation de leurs corrections. Ainsi, un système d’analyse IA a permis en janvier de découvrir 12 failles de sécurité dans OpenSSL, un logiciel essentiel à la protection des communications internet mondiales.

Mythos semble également déjà participer à cette automatisation, et Firefox affirme déjà avoir identifié et réparé 271 vulnérabilités grâce à ce logiciel, ce qui suggère que Mythos excelle effectivement dans la détection de vulnérabilités lorsqu’il a accès au code source.

En revanche, rien ne prouve pour l’instant que Mythos puisse, sans accès au code source et sans intervention humaine, compromettre de manière autonome n’importe quel logiciel fermé.

De plus, des analyses suggèrent que des capacités comparables seraient déjà reproductibles à partir de modèles publics, remettant en cause l’efficacité de cette rétention. Ainsi, Mythos ressemble aujourd’hui davantage à un analyste de sécurité surpuissant, capable d’identifier des failles et de proposer des pistes d’exploitation, qu’à une entité autonome de cyberattaque universelle.

Ce qui inquiète vraiment, ce n’est pas seulement que Mythos sache mieux coder ou mieux tester du code : c’est qu’il semble abaisser le coût, le temps et le niveau d’expertise nécessaires pour découvrir et enchaîner des failles, donc potentiellement accélérer aussi bien la défense que l’attaque.

Vers un nouvel équilibre de la « dissuasion algorithmique » ?

Dans ce contexte, la notion de « dissuasion algorithmique » (algorithmic deterrence en anglais) émerge. Elle peut être comprise par analogie avec la dissuasion nucléaire : il ne s’agirait plus seulement de se protéger, mais de posséder une capacité de réponse et de détection si rapide que l’attaque en devient inutile ou trop coûteuse.

Contrairement au domaine nucléaire, la dissuasion algorithmique repose sur le renforcement des mécanismes défensifs (plutôt que de réponse) : détection accélérée des intrusions, analyse des causes et simulation d’attaques pour boucher les failles avant qu’elles ne soient exploitées.

Avant l’ère de l’IA, la dissuasion algorithmique était plus limitée : les équipes de sécurité réalisaient des tests d’intrusion, une méthode d’évaluation de la sécurité qui repose sur la simulation de cyberattaques, pour identifier les ports ouverts et failles connues, pour enclencher leur correction.

Aujourd’hui, on l’a vu, l’IA peut renforcer les mécanismes défensifs et donc la dissuasion. Mais, dans le meilleur des cas, une IA de défense permet de réduire le coût de la protection et d’augmenter la probabilité qu’un attaquant soit repéré ou neutralisé avant d’atteindre son objectif.

La dissuasion algorithmique reste donc fragile. Même à l’ère de l’IA, elle dépend beaucoup des pratiques des acteurs opérationnels (agences de cybersécurité, armées, entreprises), de la qualité et de la modernité des systèmes hérités qu’ils doivent protéger et intégrer, des stratégies nationales et militaires mises en œuvre par les États ainsi que des dispositifs de gouvernance qui définissent les règles, les responsabilités et les mécanismes de contrôle de l’IA.

Le dilemme de la rétention d’outils de dissuasion : sécurité contre transparence

Ne pas rendre disponibles au grand public certains modèles peut sembler responsable, car cela évite de publier des capacités offensives qui seraient immédiatement détournées. Mais cette rétention concentre le pouvoir technologique entre quelques mains et réduit la transparence scientifique.

Le débat rejoint ici celui du cadre l’AI Act européen, qui impose déjà des obligations de transparence, de traçabilité et de documentation pour les modèles d’IA d’usage général, tout en cherchant à concilier innovation, sécurité et protection des secrets industriels.

L’opacité des modèles d’IA limite leur auditabilité, entrave le développement de contre-mesures appropriées et concentre le pouvoir technique entre quelques acteurs principalement américains, au détriment de la recherche ouverte et de la gouvernance démocratique. Cette critique s’inscrit dans une littérature académique plus large montrant que l’opacité des systèmes d’intelligence artificielle compromet leur reproductibilité, leur auditabilité et, in fine, leur valeur scientifique.

Christine Abdalla Mikhaeil est membre de Association for Information Systems (AIS). Elle a reçu des financements de l'Institut Bachelier et du LEM CNRS UMR 9221.

07.05.2026 à 09:38

L’inversac de Thau, ou quand une source sous-marine absorbe l’eau salée et menace les eaux souterraines

Jean-Christophe Maréchal, Directeur de recherche - Hydrogéologue, BRGM

Bernard Ladouche, Chercheur, BRGM

Claudine Lamotte, Cheffe de projet, BRGM

Texte intégral (3941 mots)

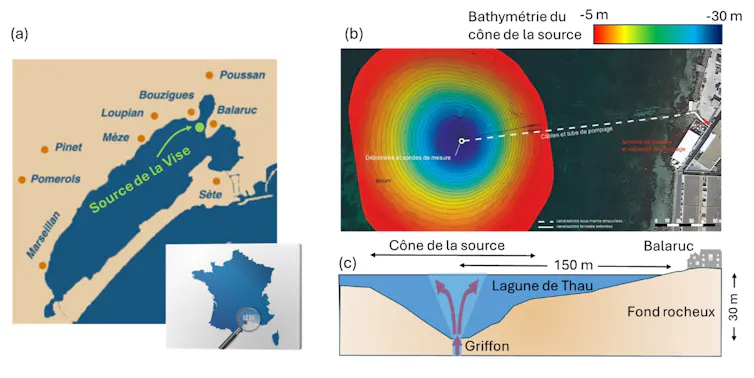

Au fond de la lagune de Thau, en Occitanie, la source de la Vise est régulièrement sujette à un phénomène dit d’inversac, où la source d’eau douce se met soudainement à absorber l’eau saumâtre. Ce mécanisme, jusque-là peu connu, expose les ressources en eau douce des côtes à un risque de salinisation. Grâce à un dispositif expérimental unique, des chercheurs français ont pu l’observer en direct. De quoi expliquer au passage pourquoi certaines villes des alentours souffrent, lors de ces épisodes, d’inondations en l’absence de pluies.

Un phénomène exceptionnel, appelé « inversac », menace les ressources d’eau souterraine autour de l’étang de Thau (une vaste lagune d’eau saumâtre) en Occitanie. En fonction des conditions météorologiques, la source sous-marine de la Vise (surnommée localement « le Volcan » ou « le Gouffre ») peut s’interrompre – et cesse alors momentanément d’apporter de l’eau douce dans la lagune.

Elle devient dès lors un point d’infiltration majeur d’eau salée de la lagune vers l’aquifère, provoquant une salinisation chronique des eaux souterraines si précieuses, et des épisodes d’inondation sans pluie dans la station thermale de Balaruc.

Avec des collègues, nous avons pu suivre le phénomène en direct grâce à des instruments spécifiques, une première mondiale, qui a notamment fait l’objet d’une publication scientifique en 2025. De quoi mieux comprendre les causes de ce phénomène jusque-là mystérieux, qui peut durer des mois : six mois pour les épisodes survenus en 2010 et en 2014, et même dix-huit mois pour celui survenu entre 2020 et 2022.

En zone côtière, les exutoires des eaux souterraines peuvent être sous-marins

Les eaux de pluie qui s’infiltrent à la surface de la terre rejoignent les nappes aquifères. Elles circulent ensuite dans le sous-sol jusqu’à des exutoires en surface : sources, zones humides et lits des rivières constituent autant de points bas du paysage vers lesquels convergent les eaux souterraines.

En zone côtière, les exutoires des eaux souterraines peuvent être sous-marins, situés dans la mer ou dans des lagunes côtières. Jouant un rôle important pour les écosystèmes marins côtiers, ils sont diffus ou ponctuels selon le type d’aquifère. Dans ce dernier cas, le plus souvent en contexte karstique, il s’agit de sources sous-marines. Elles sont particulièrement nombreuses en Méditerranée grâce à la forte présence de roches calcaires propices aux phénomènes karstiques.

En France, la source sous-marine de Port-Miou, au large de la calanque, est sans doute la mieux connue et est observée par les scientifiques depuis de nombreuses années.

Plus à l’Ouest, dans l’Hérault, il existe plusieurs autres sources sous-marines qui émergent dans la lagune de Thau. Parmi elles, la source sous-marine de la Vise, située au large de Balaruc, draine un aquifère côtier primordial pour les habitants de cette région au climat chaud et sec de type méditerranéen.

En effet, les eaux souterraines y sont prélevées pour l’alimentation en eau potable des villages voisins, pour l’irrigation aussi, mais surtout elles alimentent les thermes de Balaruc-les-Bains, première station thermale de France en nombre de curistes. Malheureusement, cette ressource d’eau douce précieuse est menacée par un phénomène exceptionnel : l’inversac.

L’inversac, ou quand les flux d’eau s’inversent et une source absorbe l’eau saumâtre

Bien connue des pêcheurs et des ostréiculteurs, la source de la Vise est située dans la lagune de Thau, à une profondeur de 30 mètres au large de Balaruc. Cette profondeur est exceptionnelle pour l’étang de Thau, dont la profondeur moyenne excède rarement 4 m à 5 m : les flux d’eau souterraine ont creusé et érodé la roche pour créer un grand cône sous-marin situé autour de l’émergence. Cette profondeur attire les amateurs de plongée sous-marine qui peuvent ainsi pratiquer leur sport au cœur d’un site remarquable.

La source est localisée au sommet d’un conduit karstique subvertical qui relie la lagune de Thau à une nappe aquifère captive (c’est-à-dire sous pression) située en profondeur dans les calcaires du Jurassique. Le débit de la source est généralement de l’ordre de 100-150 litres par seconde (l/s), et augmente avec le niveau d’eau dans la nappe après des pluies intenses. C’est une eau douce et chaude (20 °C), car réchauffée par les flux d’eau d’origine profonde qui alimentent également la station thermale de Balaruc.

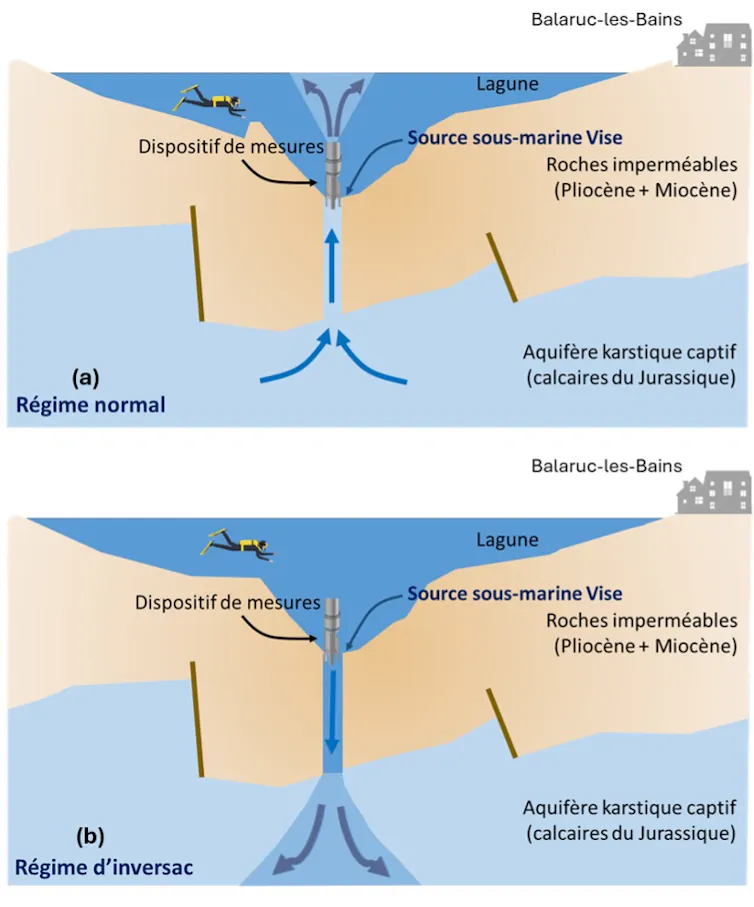

Or, depuis la fin des années 1950, on observe des épisodes temporaires d’inversion des flux d’eau au niveau de la source. Le résultat ? Une interruption brutale de l’arrivée d’eau douce d’origine souterraine, suivie d’une absorption des eaux de la lagune par la source. En hydrologie karstique, ce phénomène est connu sous le nom d’inversac, nom qui désigne une cavité karstique alternativement absorbante ou émissive, selon les conditions hydrologiques.

La plupart du temps, les inversacs sont des pertes-émergences situées le long d’une rivière : selon les niveaux d’eau, la rivière s’infiltre dans la cavité karstique (fonctionnement en perte) ou alors cette dernière déverse de l’eau dans la rivière (fonctionnement en émergence).

Dans le cas de la Vise, l’inversac se produit en lien avec l’étang de Thau. Selon les conditions hydroclimatiques, la source va tantôt déverser l’eau douce, tantôt absorber l’eau salée de l’étang.

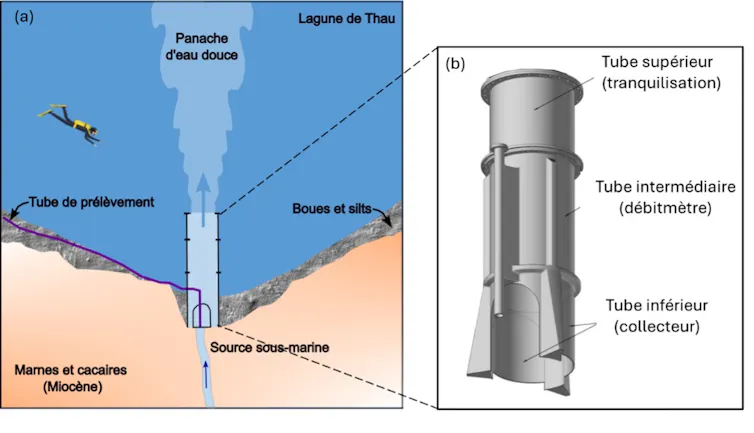

Un dispositif de mesure unique au monde

Pour mieux comprendre ce phénomène, les hydrogéologues du BRGM, en collaboration avec la société ANTEA, ont conçu un dispositif inédit spécialement consacré à la mesure des débits de la source sous-marine. Il s’agit d’un tube d’une longueur d’environ cinq mètres et d’un diamètre d’un mètre, posé sur l’émergence, composé de trois compartiments.

Le tube inférieur récolte l’eau douce sortant des principaux griffons (points d’émergence) présents au fond de la lagune. Au-dessus, un débitmètre électromagnétique permet de mesurer le débit vertical au sein du tube intermédiaire. Il est surmonté d’un tube de tranquillisation destiné à réguler les flux d’eau et à réduire les turbulences pour assurer une bonne qualité de la mesure du débit. Des capteurs de température, de salinité et de pression sont installés dans le dispositif pour compléter les mesures.

Un inversac observé en direct en novembre 2020

Installé en juin 2019 par des scaphandriers professionnels, il a permis d’observer en direct un inversac qui s’est produit le matin du 27 novembre 2020. En effet, à 9 h 40 exactement, le débit de la source s’est brutalement inversé : d’un débit ascendant d’environ 120 l/s, il est passé à un débit descendant de 350 l/s.

Simultanément, les capteurs ont mis en évidence la présence d’une eau complètement différente : une eau salée et froide (comme la lagune) s’est substituée, au sein du tube de mesures, à l’eau douce et chaude qui provenait précédemment de la nappe aquifère. À cet instant, la source a commencé à absorber l’eau de la lagune, qui a envahi progressivement la nappe aquifère.

Cet inversac a duré seize mois, durant lesquels environ 7 millions de mètres cubes d’eau salée se sont infiltrés, provoquant l’intrusion de 200 000 tonnes de sel dans l’aquifère. En 2014, la salinisation progressive de la nappe provoquée par la succession des inversacs a nécessité la fermeture du captage d’eau souterraine de Cauvy, qui alimentait en eau potable Balaruc-les-Bains.

La répétition successive des inversacs menace également la ressource en eau thermale, dont l’usage est important pour l’activité économique du secteur. Plusieurs maraîchers exploitants ont également arrêté leur activité à cause de la salinisation de leur puits, tandis que de nombreux forages domestiques ont été touchés. Le sel est aussi remonté dans les sols, menaçant les espaces verts en affaiblissant un grand nombre d’arbres de la commune.

En complément des mesures à la source de la Vise, un réseau d’observation a été installé pour surveiller les niveaux d’eau de la lagune et de la nappe aquifère.

L’analyse détaillée de toutes ces données a permis de montrer que l’inversac s’est enclenché à un moment bien particulier, où une tempête marine accompagnée d’un coup de vent marin avait induit une hausse du niveau de l’étang. Et cela, au moment même où, au contraire, le niveau de la nappe aquifère était au plus bas, par manque de précipitation et de recharge. Résultat : la pression exercée par la masse d’eau salée de l’étang est devenue plus élevée que la pression de la nappe : les écoulements d’eau se sont alors brusquement inversés. C’est ce mécanisme que nous avons décrit dans notre article publié dans la revue Nature Communications Earth and Environment.

« Bouchon de sel » et inondations sans pluie

Restait à expliquer une bizarrerie locale : alors que les inversacs se déroulent en période de sécheresse, lorsque le niveau de la nappe aquifère est au plus bas, ils sont systématiquement accompagnés d’inondations dans la ville de Balaruc-les-Bains. Ceci est d’autant plus étonnant qu’aucun épisode de pluie ne précède ces inondations qui frappent les sous-sols, les caves et les parkings souterrains de la commune, causant de nombreux dégâts.

Cette curiosité hydrologique est à rapprocher des mesures observées dans les piézomètres des environs : chaque inversac est suivi d’une augmentation rapide des niveaux d’eau de la nappe d’environ 2,3 m. Cette hausse est expliquée par le contraste de densité entre les eaux : l’eau salée de la lagune est environ 3 % plus lourde que l’eau douce.

Ainsi, au moment de l’inversac, le conduit karstique vertical se remplit en quelques minutes d’eau salée sur sa hauteur totale, estimée à environ 70 m. Il en résulte une augmentation brutale de 2,3 m de la pression exercée par la lagune sur la nappe aquifère. Cette onde de pression se propage ensuite rapidement dans la nappe aquifère captive jusqu’à plusieurs kilomètres en quelques heures, provoquant une hausse des niveaux d’eau, et donc des inondations, même en l’absence de pluie.

Cette hausse inattendue des niveaux d’eau explique l’apparente contradiction entre la soudaineté du déclenchement d’un inversac et sa très longue durée. Si un coup de vent sur l’étang provoquant une hausse de son niveau de quelques centimètres peut déclencher un inversac, il ne suffit pas d’une accalmie météorologique pour que le système revienne à son état normal initial. Pour retrouver des flux ascendants dans le conduit karstique, la pression de la nappe aquifère doit vaincre cette surpression de 2,3 m provoquée par l’intrusion de sel, qui agit alors comme une sorte de « bouchon » sur la source sous-marine.

De ce fait, seule une très forte pluie sur le causse d’Aumelas, sur les hauteurs du bassin de Thau, peut recharger suffisamment la nappe aquifère pour provoquer une augmentation de niveau supérieure à 2,3 m, capable de vaincre le bouchon de sel. C’est ce qui s’est déroulé le 14 mars 2022 lorsqu’un épisode pluvieux de plusieurs jours, supérieur à 100 millimètres, a mis fin à cet inversac.

À lire aussi : Comment le changement climatique perturbe la recharge des eaux souterraines

Depuis les années 1950, les inversacs se répètent et s’accélèrent. En cause, les pompages d’eau souterraine, mais surtout la succession des sécheresses, qui provoquent une baisse du niveau de la nappe. Jusqu’à présent, le système revient toujours à son état normal après quelques mois, mais qu’en sera-t-il dans le futur lorsque la recharge naturelle déclinera et que le niveau de la mer montera ?

Il n’est pas exclu que le système bascule définitivement en inversac, provoquant ainsi une salinisation complète et définitive de l’aquifère du Jurassique. C’est pour cette raison qu’un projet d’expérimentation est en cours avec le Syndicat mixte du bassin de Thau pour explorer les moyens possibles de réduire les effets d’un inversac et de préserver la nappe aquifère.

Cette étude a pu être menée dans le cadre du projet de recherche DEM’Eaux Thau (2017-2022).

D’un montant de 5,3 millions d’euros, le financement du projet DEM’Eaux Thau a été assuré à 42% par le ministère de l'Enseignement supérieur et de la Recherche et la Région Occitanie (dans le cadre du Contrat de Plan Etat-Région 2015-2020), à 11% par le fonds européen FEDER, à 17% par l’Agence de l’eau Rhône-Méditerranée-Corse, à 4% par Montpellier Méditerranée Métropole, à 2% par Balaruc-les-Bains et à 1% par le Syndicat Mixte du Bassin de Thau. Le reste du financement du projet (23%) a été apporté grâce à la participation financière de la plupart des partenaires

Bernard Ladouche et Claudine Lamotte ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview