01.05.2026 à 10:30

REVUES

Texte intégral (2254 mots)

Grâce aux panneaux solaires en silicium, l’électricité d’origine photovoltaïque est aujourd’hui disponible à faible coût. Pour aller plus loin – récolter plus d’énergie sur les mêmes surfaces pour des coûts réduits, produire plus localement – les scientifiques développent de nouveaux matériaux. Parmi eux, les « pérovskites » sont modulables et compatibles avec le silicium, ce qui les rend particulièrement prometteurs. Où en sont ces nouvelles technologies ? Quel chemin leur reste-t-il à parcourir ?

La filière du silicium est le leader du marché mondial des technologies photovoltaïque, avec 98 % des panneaux vendus. Grâce aux progrès dans le domaine, on dispose aujourd’hui d’électricité solaire déployable à faible coût dans la grande majorité des pays à travers le monde.

La montée en puissance des énergies renouvelables, avec en chef de file celle fondée sur la conversion directe de l’énergie solaire en électricité, légitime encore aujourd’hui le développement de nouvelles technologies photovoltaïques alliant frugalité, efficacité et longévité. Il s’agit d’augmenter encore les rendements de conversion et de minimiser les coûts (impact environnemental, prix de la fabrication, du transport, de l’installation, du recyclage), mais aussi de pouvoir garantir une durée de vie acceptable pour le fabricant, le consommateur et l’environnement.

Une des filières émergentes explorées par des chercheurs, start-up et industriels est celle exploitant les matériaux « pérovskites ». Dans cette communauté en ébullition, diverses stratégies sont développées pour allier de forts rendements et une longue durée de vie.

Dans nos études les plus récentes menées avec nos collaborateurs et publiées dans Science et Nature Synthesis, nous combinons plusieurs approches. La robustesse des nouvelles structures pérovskites est testée dans des conditions d’éclairement drastiques, simulant jusqu’à 15 fois la puissance du soleil. Ces résultats marquent une étape importante qui permet d’envisager de transposer les résultats en laboratoire à des produits industriels.

Le silicium, roi du marché, et les filières émergentes

Alors même que le silicium est devenu un matériau stratégique au cœur de nombreuses technologies électroniques, il risque de devenir une matière première critique (qui présente un risque d’approvisionnement). C’est tout particulièrement le cas en Europe, car la dernière fonderie de silicium active pourrait arrêter sa production, faute de pouvoir résister à la Chine en situation de surcapacité.

Parmi les filières photovoltaïques émergentes, celle des pérovskites fait la course seule en tête, car elle a rejoint en termes de performances (pour des cellules de laboratoire de petite surface, inférieures à un centimètre carré) la filière silicium avec des rendements certifiés supérieurs à 27 %. Les matières premières nécessaires sont disponibles en Europe.

Un de ses principaux atouts est d’être compatible avec les panneaux solaires silicium traditionnels, car ces deux technologies absorbent la lumière du soleil de façon complémentaire. Ainsi, en empilant une cellule silicium et une cellule pérovskite, on obtient une unique cellule dite « tandem » – qui dépasse aujourd’hui les 35 % pour des tandems de laboratoire et 27 % pour des modules de plus de 14 000 centimètres carrés (l’équivalent de panneaux carrés de 1,2 mètre de côté), permettant aux industriels – y compris en France — d’envisager sérieusement leur commercialisation.

En augmentant l’électricité produite pour une même surface de panneaux solaires, s’ouvre une perspective de retours sur investissements beaucoup plus rapides, qui pourrait encore booster le déploiement du photovoltaïque.

C’est pourquoi Daniel Lincot, membre de l’Académie des technologies et fervent défenseur de l’énergie solaire pour la transition énergétique et écologique, n’hésite pas à dresser un parallèle avec l’augmentation énorme et inattendue des vitesses des bateaux à voile au cours des dernières décennies grâce à l’ajout de surfaces portantes immergées (foils), en disant « les pérovskites sont les foils du silicium ».

Si le potentiel des matériaux pérovskites pour augmenter fortement les rendements des dispositifs photovoltaïques en silicium n’est désormais plus à démontrer, une dégradation rapide des performances en fonctionnement de ces nouvelles cellules et panneaux solaires est le verrou principal empêchant les pérovskites d’entrer sur le marché des panneaux solaires. Pour le lever, les scientifiques développent différentes stratégies pour mieux organiser la matière à l’échelle microscopique.

Les matériaux pérovskites : des promesses, des prouesses… et des défis

Le terme générique pérovskite désigne une structure cristalline caractéristique à l’échelle atomique avec des octaèdres partageant leurs sommets formant un réseau tridimensionnel (3D). La composition chimique des matériaux présentant cette structure varie avec notamment le titanate de calcium, un minéral découvert dès 1839 en milieu naturel et qui comprend des atomes d’oxygène (en bleu sur l’image).

Les compositions pertinentes pour le photovoltaïque et reconnues comme une nouvelle classe de semiconducteurs, sont, quant à elles, synthétiques (c’est-à-dire fabriquées par les chimistes) : l’oxygène est par exemple substitué par l’iode alors que le plomb (couleur or) occupe le centre de l’octaèdre, tandis qu’un atome tel que le Césium, ou une petite molécule organique (en rose) perd un électron (on parle de cation inorganique ou organique) et s’insère dans la cavité de la structure cristalline entre les octaèdres.

Si ce cation est trop petit ou au contraire trop volumineux, le réseau préfère adopter une autre structure cristalline qui n’aura pas les propriétés requises pour produire et conduire ensuite le courant électrique au sein d’une cellule solaire. Ceci se traduit par un changement de couleur, le matériau passant de la phase pérovskite semi-conductrice dite « noire », et donc fortement absorbante pour les longueurs d’onde visibles du spectre solaire (inférieures à 0,8 micromètre), à une phase non-pérovskite dite « jaune », signe que la gamme d’énergie des photons du soleil que le matériau est capable d’absorber est beaucoup plus restreinte (inférieures à 0,5 micromètre).

Ce changement de couleur est également observé lorsque le matériau pérovskite se dégrade, ce qui réduit fortement l’efficacité de conversion de l’énergie solaire. Depuis une dizaine d’années, la communauté de recherche s’efforce donc de comprendre les mécanismes de dégradation — et bien sûr, de les circonscrire.

Les dernières avancées pour des matériaux pérovskites efficaces et plus stables

Une des principales stratégies pour augmenter l’efficacité de conversion exploite des matériaux pérovskites qui sont en fait des mélanges de différents types de pérovskites synthétiques 3D. Malheureusement, ces alliages sont sujets à des phénomènes de démixtion et/ou à des déformations du réseau cristallin, notamment sous irradiation lumineuse – ce qui conduit à une dégradation irréversible. De plus, certaines de ces compositions 3D sont très sensibles à l’humidité. Enfin, on observe aussi des problèmes de stabilité à l’échelle du dispositif (cellule et panneau solaire), particulièrement en conditions opérationnelles (sous irradiation lumineuse ou lorsqu’un courant traverse la cellule solaire).

Au sein de la communauté internationale, plusieurs stratégies ont été inventées pour pallier ces problèmes. Par exemple, l’ingénierie des ligands a pris une place prépondérante avec l’exploration de divers acides qui viennent « passiver » les interfaces (c’est-à-dire empêcher la formation de « défauts » qui capturent les électrons et limitent donc la génération d’un courant électrique).

Un autre exemple est la « stratégie du millefeuille », explorée dès les années 90 : il s’agit d’une alternance périodique où la crème correspond à la couche organique et la pâte à la couche pérovskite. Des cellules solaires contenant ces pérovskites lamellaires ont atteint dès 2016 des stabilités record en fonctionnement.

En associant des pérovskites 2D (millefeuille) et 3D au sein d’une même cellule solaire, on combine la stabilité des premières aux rendements de conversion record des deuxièmes. En particulier, un design basé sur une ingénierie très poussée des hétérostructures 2D/3D a représenté l’état de l’art en 2022 et en 2024 en matière de stabilité pour une cellule solaire pérovskite en fonctionnement.

Aujourd’hui, nos tout derniers travaux publiés en ce printemps 2026 dans Science nous rapprochent encore plus de la stabilité requise en vue d’une commercialisation. En comprenant par quel chemin le matériau pérovskite synthétique passe de la phase noire à la phase jaune, l’ajout d’un additif spécifique a permis de soumettre les cellules 2D/3D à des tests encore plus drastiques : un flux lumineux équivalent à 15 soleils !

En parallèle, la fabrication récente de pérovskites 2D multicouches ne présentant aucune distorsion structurale et permettant un transfert des charges électriques générées par le soleil sur des distances records (au-delà de 2 micromètres, de l’ordre de 2 à 3 fois le diamètre d’un cheveu) permet pour la première fois d’envisager des dépôts de couches 2D et 3D avec des épaisseurs similaires de l’ordre de 300 à 500 nanomètres. Une telle épaisseur pour la partie 2D représente une barrière robuste à la pénétration d’espèces chimiques qui autrement risqueraient de détériorer la structure. Avec une couche épaisse, la partie 2D pourra aussi contribuer à la production d’électricité. De plus, les dernières couches 2D synthétisées possèdent des seuils d’absorption en énergie suffisamment bas pour qu’il soit envisageable de les tester en association avec le silicium dans des structures tandem en s’affranchissant totalement de la partie 3D.

Le projet SURFIN (ANR-23-CE09-0001) est soutenu par l’Agence nationale de la recherche (ANR), qui finance en France la recherche sur projets. L’ANR a pour mission de soutenir et de promouvoir le développement de recherches fondamentales et finalisées dans toutes les disciplines, et de renforcer le dialogue entre science et société. Pour en savoir plus, consultez le site de l’ANR.

Claudine Katan est membre du GDR HPERO.

George Volonakis a reçu des financements de l'Agence national de la recherche pare le projet de CPJ et le projet SURFIN (ANR-23-CE09-0001).

Jacky Even est membre du GDR HPERO et a reçu des financements de l'institut universitaire de France.

Aditya Mohite ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

29.04.2026 à 09:31

Texte intégral (1305 mots)

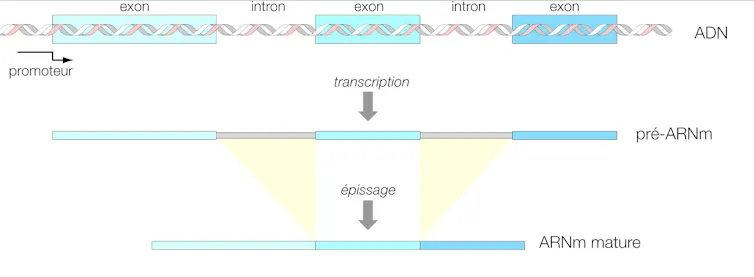

Pendant longtemps, nous avons appris à lire le génome en séparant deux mondes. D’un côté, les gènes, ces portions d’ADN qui contiennent les instructions pour fabriquer les protéines. À l’intérieur de ces gènes se trouvent les exons, les segments qui servent directement à produire l’ARN puis les protéines. De l’autre côté, l’ADN régulateur, souvent situé dans les régions dites non codantes, qui commande où, quand et à quel niveau les gènes s’expriment. Cette frontière a été très utile. Mais elle est plus poreuse qu’on ne le pensait.

Dans l’étude que nous venons de publier dans Nature Communications, nous montrons que des milliers d’exons, parmi les quelque 200 000 que compte le génome humain, ne servent pas seulement à coder des protéines. Une partie d’entre eux agissent aussi comme des régulateurs, c’est-à-dire des séquences capables de stimuler l’expression des gènes. Autrement dit, une même portion d’ADN peut porter deux messages à la fois : l’un pour la protéine, l’autre pour la régulation.

Cette idée existait déjà à travers quelques exemples isolés, mais notre travail en propose pour la première fois une vue systématique, à grande échelle, et dans plusieurs espèces, de l’humain à la souris, en passant par la drosophile et même une plante, Arabidopsis thaliana.

Comment avons-nous répondu à cette question ?

Ce phénomène n’était pas totalement inconnu. Depuis les années 1990, il était décrit dans la littérature scientifique, au fil de cas particuliers ou d’analyses plus larges, sans vraiment qu’on en saisisse l’ampleur.

Pour y répondre, nous avons combiné plusieurs approches à grande échelle, exploitant de très grands volumes de données biologiques issues de travaux antérieurs. Nous avons d’abord analysé plus de 20 000 cartes montrant les endroits du génome où se fixent des facteurs de transcription, ces protéines qui contrôlent l’activité des gènes, afin de repérer les exons qui ressemblent à de véritables régions régulatrices.

Nous avons ensuite cherché d’autres indices montrant que ces exons pouvaient vraiment jouer un rôle régulateur. Nous avons notamment vérifié s’ils se trouvent dans les régions de l’ADN les plus accessibles, condition nécessaire pour que les gènes puissent être activés, et s’ils sont capables d’augmenter l’expression d’un gène dans des tests fonctionnels. Nous avons aussi bloqué certaines de ces séquences dans des cellules afin de voir comment leur absence modifiait l’activité des gènes.

Au final, nous avons identifié plus de 10 000 exons candidats chez l’humain, avec des signatures comparables chez les autres espèces étudiées. Cela montre que cette double fonction n’est pas une exception, mais un phénomène largement répandu dans le vivant.

Pourquoi est-ce important ?

Cette découverte change d’abord notre vision de la régulation des gènes. Les séquences activatrices étaient surtout recherchées dans l’ADN non codant qui correspond à 98 % de notre ADN. Nous montrons qu’une partie de cette régulation est aussi inscrite au cœur même des régions codantes. Les exons ne sont donc pas seulement des segments qui produisent des protéines : certains participent aussi au pilotage de l’expression des gènes, parfois pour leur propre gène, parfois pour d’autres gènes à distance.

L’enjeu est aussi médical. En génétique, on accorde beaucoup d’attention aux mutations qui modifient la protéine. Mais les mutations dites synonymes, souvent qualifiées de silencieuses, sont généralement moins regardées. En effet, le code génétique est lu par groupes de trois lettres, appelés codons, et plusieurs codons différents peuvent correspondre au même acide aminé. Autrement dit, une mutation peut modifier la séquence d’ADN sans changer la protéine produite. Or, si un exon est aussi un régulateur, une mutation synonyme peut malgré tout perturber un signal régulateur sans altérer directement la protéine.

Dans notre étude, nous montrons par des tests fonctionnels que certaines de ces variations modifient bien l’activité régulatrice de l’exon. Dans des données issues de tumeurs, nous observons aussi que des mutations situées dans ces exons sont associées à des changements d’expression de gènes cibles, y compris pour des mutations synonymes.

Quelles suites donner à ce projet ?

Nous n’en sommes probablement qu’au début. Les 10 000 exons identifiés chez l’humain constituent un atlas, mais pas encore une carte complète de tous les contextes biologiques où ces séquences agissent. La suite consiste donc à en tester beaucoup plus, dans davantage de types cellulaires, de tissus et d’espèces, afin de comprendre quand ces régulateurs exoniques sont actifs, quels gènes ils contrôlent et comment ils ont émergé au cours de l’évolution.

Il faudra aussi revoir à grande échelle notre manière d’interpréter les variants situés dans les exons. Jusqu’ici, beaucoup d’analyses demandaient surtout : cette mutation change-t-elle la protéine ? Il faut désormais poser une seconde question : change-t-elle aussi la régulation du gène ? Cette lecture à double entrée pourrait affiner l’interprétation de variants encore mal compris, notamment en cancérologie et en génétique humaine.

Ce travail a été soutenu par le MESR, INSERM, IFB, ANR.

29.04.2026 à 09:31

Une anomalie au LHC laisse entrevoir une percée majeure en physique des particules

Texte intégral (1698 mots)

Des résultats obtenus au Large Hadron Collider, ou LHC, le Grand Collisionneur de hadrons du Cern, pourraient remettre en cause le modèle standard, pilier de la physique des particules depuis un demi-siècle.

Sommes-nous sur le point de détecter des signes d’une physique encore inconnue ? C’est ce que semblent suggérer les résultats récents des recherches que nous menons au Grand Collisionneur de hadrons du Cern (Large Hadron Collider ou LHC).

Si ces indices se confirmaient, ils remettraient en cause la théorie – appelée modèle standard (MS) – qui domine la physique des particules depuis cinquante ans. Les résultats indiquent, en effet, que le comportement de certaines particules subatomiques dans le LHC n’est pas conforme aux prédictions de ce modèle.

Les particules fondamentales sont les briques élémentaires de la matière : des particules subatomiques indivisibles (qui ne peuvent pas être décomposées en unités plus petites). Quatre forces fondamentales – la gravitation, l’électromagnétisme, l’interaction faible et l’interaction forte – régissent leurs interactions.

Le LHC est un immense accélérateur de particules installé dans un tunnel circulaire de 27 kilomètres sous la frontière franco-suisse. Son objectif principal est justement de mettre à l’épreuve le modèle standard.

Cette théorie constitue notre meilleure compréhension des particules et des forces fondamentales, mais elle n’est pas complète. Elle ne rend pas compte de la gravité ni de la matière noire – cette forme de matière invisible, encore jamais mesurée directement, qui représenterait environ 25 % de l’univers.

Au grand collisionneur de hadrons, des faisceaux de protons circulant en sens opposé sont mis en collision afin de déceler des indices d’une physique encore inconnue. Les nouveaux résultats proviennent de LHCb, une expérience du LHC consacrée à l’analyse de ces collisions.

Ce résultat repose sur l’étude de la désintégration – une forme de transformation – de particules subatomiques appelées mésons B. Nous avons analysé la manière dont ces mésons B se désintègrent en d’autres particules, et constaté que ce processus spécifique n’est pas conforme aux prédictions du modèle standard.

Une théorie élégante

Le modèle standard repose sur deux des avancées les plus révolutionnaires de la physique du XXᵉ siècle : la mécanique quantique et la relativité restreinte d’Einstein.

Les physiciens peuvent comparer les mesures réalisées dans des installations comme le LHC aux prédictions issues du modèle standard afin de tester rigoureusement cette théorie. Malgré son caractère incomplet, plus de cinquante ans de tests toujours plus exigeants n’ont encore révélé aucune faille dans ce cadre théorique. Du moins, jusqu’à aujourd’hui.

Notre mesure, acceptée pour publication dans la revue Physical Review Letters, met en évidence un écart de quatre écarts-types par rapport aux prédictions du modèle standard.

Concrètement, cela signifie que, après prise en compte des incertitudes liées aux résultats expérimentaux et aux prédictions théoriques, la probabilité qu’une fluctuation aléatoire des données produise un écart aussi important – si le modèle standard est correct – est d’environ 1 sur 16 000.

Même si ce résultat reste en deçà du standard ultime de la physique – ce que l’on appelle les cinq sigma, soit cinq écarts-types (environ une chance sur 1,7 million) – les indices commencent à s’accumuler. Cette hypothèse est renforcée par des résultats issus d’une autre expérience, CMS, publiés plus tôt en 2025.

Bien que les résultats de CMS soient moins précis que ceux de LHCb, ils sont en bon accord avec ces derniers, ce qui consolide l’ensemble. Nos nouveaux résultats proviennent de l’étude d’un type particulier de processus, appelé désintégration électrofaible « pingouin ».

Des événements rares

Le terme « pingouin » désigne un type particulier de désintégration (transformation) de particules de très courte durée de vie. Dans ce cas, nous étudions la manière dont le méson B se désintègre en quatre autres particules subatomiques – un kaon, un pion et deux muons.

Avec un peu d’imagination, la configuration des particules impliquées peut évoquer la silhouette d’un pingouin. Surtout, l’étude de cette désintégration permet d’observer comment un type de particule fondamentale, le quark bottom, peut se transformer en un autre, le quark étrange.

Cette désintégration « pingouin » est extrêmement rare dans le cadre du modèle standard : sur un million de mésons B, un seul se désintègre de cette manière. Nous avons analysé avec précision les angles et les énergies auxquels ces particules sont produites lors de la désintégration, et déterminé avec exactitude la fréquence du processus. Nos mesures de ces paramètres ne correspondent pas aux prédictions du modèle standard.

L’étude fine de ce type de désintégration constitue l’un des objectifs majeurs de l’expérience LHCb depuis sa création en 1994. Les processus « pingouin » sont particulièrement sensibles aux effets de nouvelles particules potentiellement très massives, qui ne peuvent pas être produites directement au LHC. De telles particules peuvent néanmoins exercer une influence mesurable sur ces désintégrations, en plus de la contribution attendue du modèle standard. Ce type d’observation indirecte n’est pas inédit. Par exemple, une forme de radioactivité a été découverte près de quatre-vingts ans avant que les particules fondamentales qui en sont responsables – les bosons W – ne soient observées directement.

Perspectives

L’étude de ces processus rares nous permet d’explorer des aspects de la nature qui ne deviendront peut-être accessibles autrement qu’avec des collisionneurs de particules dont on ne disposera au mieux que dans les années 2070. Un large éventail de nouvelles théories pourrait expliquer nos résultats. Beaucoup d’entre elles font intervenir de nouvelles particules appelées « leptoquarks », qui unifient deux types de constituants de la matière : les leptons et les quarks.

D’autres théories envisagent des particules plus massives, analogues à celles déjà décrites par le modèle standard. Ces nouveaux résultats permettent de contraindre ces modèles et d’orienter les recherches à venir.

Malgré notre enthousiasme, des questions théoriques ouvertes subsistent et nous empêchent d’affirmer avec certitude que nous avons observé une physique au-delà du modèle standard. La principale difficulté tient aux « pingouins charmants » (charming penguins), un ensemble de processus prévus par le modèle standard dont les contributions sont extrêmement difficiles à estimer. Les évaluations récentes suggèrent que leurs effets ne sont pas suffisamment importants pour rendre compte de nos données.

De plus, la combinaison d’un modèle théorique et des données expérimentales issues de LHCb indique que ces « pingouins charmants » – et donc le modèle standard – peinent à expliquer les résultats anormaux observés.

De nouvelles données, déjà collectées, devraient nous permettre de trancher dans les prochaines années : dans nos travaux actuels, nous avons analysé environ 650 milliards de désintégrations de mésons B enregistrées entre 2011 et 2018 pour identifier ces processus « pingouin ». Depuis, l’expérience LHCb a enregistré trois fois plus de mésons B.

D’autres avancées sont prévues dans les années 2030 afin de tirer parti des futures améliorations du LHC et de constituer un jeu de données 15 fois plus important. Cette étape décisive pourrait permettre d’apporter des preuves définitives – et, peut-être, d’ouvrir la voie à une nouvelle compréhension des lois fondamentales de l’Univers.

William Barter travaille pour l’Université d’Édimbourg. Il reçoit des financements de UKRI. Il est membre de la collaboration LHCb au CERN.

Mark Smith ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

⬅️ 15 / 25 ➡️

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview