07.05.2026 à 09:38

REVUES

Texte intégral (3963 mots)

Au fond de la lagune de Thau, en Occitanie, la source de la Vise est régulièrement sujette à un phénomène dit d’inversac, où la source d’eau douce se met soudainement à absorber l’eau saumâtre. Ce mécanisme, jusque-là peu connu, expose les ressources en eau douce des côtes à un risque de salinisation. Grâce à un dispositif expérimental unique, des chercheurs français ont pu l’observer en direct. De quoi expliquer au passage pourquoi certaines villes des alentours souffrent, lors de ces épisodes, d’inondations en l’absence de pluies.

Un phénomène exceptionnel, appelé « inversac », menace les ressources d’eau souterraine autour de l’étang de Thau (une vaste lagune d’eau saumâtre) en Occitanie. En fonction des conditions météorologiques, la source sous-marine de la Vise (surnommée localement « le Volcan » ou « le Gouffre ») peut s’interrompre – et cesse alors momentanément d’apporter de l’eau douce dans la lagune.

Elle devient dès lors un point d’infiltration majeur d’eau salée de la lagune vers l’aquifère, provoquant une salinisation chronique des eaux souterraines si précieuses, et des épisodes d’inondation sans pluie dans la station thermale de Balaruc.

Avec des collègues, nous avons pu suivre le phénomène en direct grâce à des instruments spécifiques, une première mondiale, qui a notamment fait l’objet d’une publication scientifique en 2025. De quoi mieux comprendre les causes de ce phénomène jusque-là mystérieux, qui peut durer des mois : six mois pour les épisodes survenus en 2010 et en 2014, et même dix-huit mois pour celui survenu entre 2020 et 2022.

En zone côtière, les exutoires des eaux souterraines peuvent être sous-marins

Les eaux de pluie qui s’infiltrent à la surface de la terre rejoignent les nappes aquifères. Elles circulent ensuite dans le sous-sol jusqu’à des exutoires en surface : sources, zones humides et lits des rivières constituent autant de points bas du paysage vers lesquels convergent les eaux souterraines.

En zone côtière, les exutoires des eaux souterraines peuvent être sous-marins, situés dans la mer ou dans des lagunes côtières. Jouant un rôle important pour les écosystèmes marins côtiers, ils sont diffus ou ponctuels selon le type d’aquifère. Dans ce dernier cas, le plus souvent en contexte karstique, il s’agit de sources sous-marines. Elles sont particulièrement nombreuses en Méditerranée grâce à la forte présence de roches calcaires propices aux phénomènes karstiques.

En France, la source sous-marine de Port-Miou, au large de la calanque, est sans doute la mieux connue et est observée par les scientifiques depuis de nombreuses années.

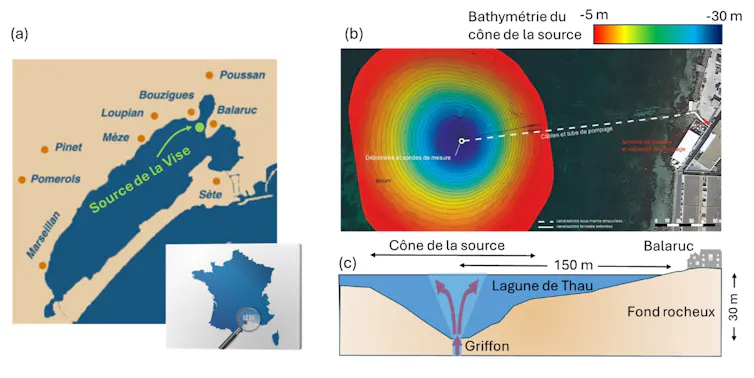

Plus à l’Ouest, dans l’Hérault, il existe plusieurs autres sources sous-marines qui émergent dans la lagune de Thau. Parmi elles, la source sous-marine de la Vise, située au large de Balaruc, draine un aquifère côtier primordial pour les habitants de cette région au climat chaud et sec de type méditerranéen.

En effet, les eaux souterraines y sont prélevées pour l’alimentation en eau potable des villages voisins, pour l’irrigation aussi, mais surtout elles alimentent les thermes de Balaruc-les-Bains, première station thermale de France en nombre de curistes. Malheureusement, cette ressource d’eau douce précieuse est menacée par un phénomène exceptionnel : l’inversac.

L’inversac, ou quand les flux d’eau s’inversent et une source absorbe l’eau saumâtre

Bien connue des pêcheurs et des ostréiculteurs, la source de la Vise est située dans la lagune de Thau, à une profondeur de 30 mètres au large de Balaruc. Cette profondeur est exceptionnelle pour l’étang de Thau, dont la profondeur moyenne excède rarement 4 m à 5 m : les flux d’eau souterraine ont creusé et érodé la roche pour créer un grand cône sous-marin situé autour de l’émergence. Cette profondeur attire les amateurs de plongée sous-marine qui peuvent ainsi pratiquer leur sport au cœur d’un site remarquable.

La source est localisée au sommet d’un conduit karstique subvertical qui relie la lagune de Thau à une nappe aquifère captive (c’est-à-dire sous pression) située en profondeur dans les calcaires du Jurassique. Le débit de la source est généralement de l’ordre de 100-150 litres par seconde (l/s), et augmente avec le niveau d’eau dans la nappe après des pluies intenses. C’est une eau douce et chaude (20 °C), car réchauffée par les flux d’eau d’origine profonde qui alimentent également la station thermale de Balaruc.

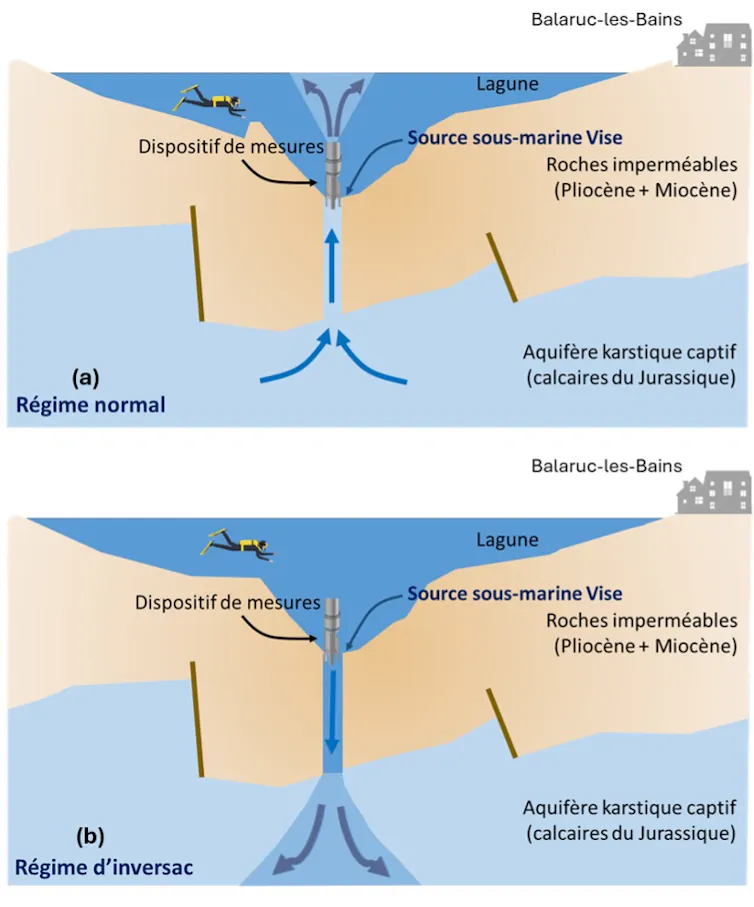

Or, depuis la fin des années 1950, on observe des épisodes temporaires d’inversion des flux d’eau au niveau de la source. Le résultat ? Une interruption brutale de l’arrivée d’eau douce d’origine souterraine, suivie d’une absorption des eaux de la lagune par la source. En hydrologie karstique, ce phénomène est connu sous le nom d’inversac, nom qui désigne une cavité karstique alternativement absorbante ou émissive, selon les conditions hydrologiques.

La plupart du temps, les inversacs sont des pertes-émergences situées le long d’une rivière : selon les niveaux d’eau, la rivière s’infiltre dans la cavité karstique (fonctionnement en perte) ou alors cette dernière déverse de l’eau dans la rivière (fonctionnement en émergence).

Dans le cas de la Vise, l’inversac se produit en lien avec l’étang de Thau. Selon les conditions hydroclimatiques, la source va tantôt déverser l’eau douce, tantôt absorber l’eau salée de l’étang.

Un dispositif de mesure unique au monde

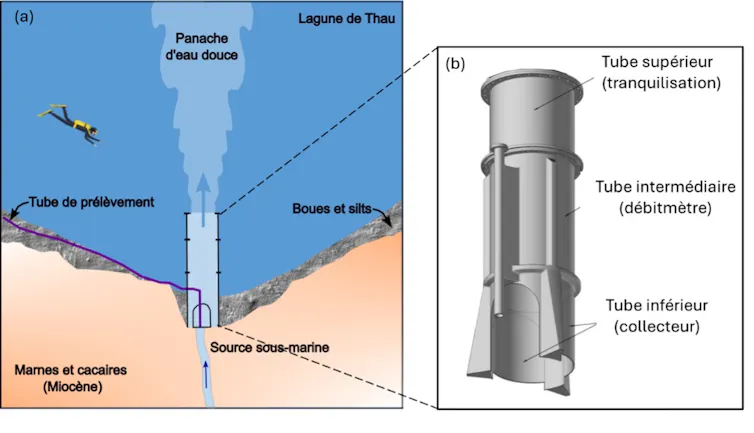

Pour mieux comprendre ce phénomène, les hydrogéologues du BRGM, en collaboration avec la société ANTEA, ont conçu un dispositif inédit spécialement consacré à la mesure des débits de la source sous-marine. Il s’agit d’un tube d’une longueur d’environ cinq mètres et d’un diamètre d’un mètre, posé sur l’émergence, composé de trois compartiments.

Le tube inférieur récolte l’eau douce sortant des principaux griffons (points d’émergence) présents au fond de la lagune. Au-dessus, un débitmètre électromagnétique permet de mesurer le débit vertical au sein du tube intermédiaire. Il est surmonté d’un tube de tranquillisation destiné à réguler les flux d’eau et à réduire les turbulences pour assurer une bonne qualité de la mesure du débit. Des capteurs de température, de salinité et de pression sont installés dans le dispositif pour compléter les mesures.

Un inversac observé en direct en novembre 2020

Installé en juin 2019 par des scaphandriers professionnels, il a permis d’observer en direct un inversac qui s’est produit le matin du 27 novembre 2020. En effet, à 9 h 40 exactement, le débit de la source s’est brutalement inversé : d’un débit ascendant d’environ 120 l/s, il est passé à un débit descendant de 350 l/s.

Simultanément, les capteurs ont mis en évidence la présence d’une eau complètement différente : une eau salée et froide (comme la lagune) s’est substituée, au sein du tube de mesures, à l’eau douce et chaude qui provenait précédemment de la nappe aquifère. À cet instant, la source a commencé à absorber l’eau de la lagune, qui a envahi progressivement la nappe aquifère.

Cet inversac a duré seize mois, durant lesquels environ 7 millions de mètres cubes d’eau salée se sont infiltrés, provoquant l’intrusion de 200 000 tonnes de sel dans l’aquifère. En 2014, la salinisation progressive de la nappe provoquée par la succession des inversacs a nécessité la fermeture du captage d’eau souterraine de Cauvy, qui alimentait en eau potable Balaruc-les-Bains.

La répétition successive des inversacs menace également la ressource en eau thermale, dont l’usage est important pour l’activité économique du secteur. Plusieurs maraîchers exploitants ont également arrêté leur activité à cause de la salinisation de leur puits, tandis que de nombreux forages domestiques ont été touchés. Le sel est aussi remonté dans les sols, menaçant les espaces verts en affaiblissant un grand nombre d’arbres de la commune.

En complément des mesures à la source de la Vise, un réseau d’observation a été installé pour surveiller les niveaux d’eau de la lagune et de la nappe aquifère.

L’analyse détaillée de toutes ces données a permis de montrer que l’inversac s’est enclenché à un moment bien particulier, où une tempête marine accompagnée d’un coup de vent marin avait induit une hausse du niveau de l’étang. Et cela, au moment même où, au contraire, le niveau de la nappe aquifère était au plus bas, par manque de précipitation et de recharge. Résultat : la pression exercée par la masse d’eau salée de l’étang est devenue plus élevée que la pression de la nappe : les écoulements d’eau se sont alors brusquement inversés. C’est ce mécanisme que nous avons décrit dans notre article publié dans la revue Nature Communications Earth and Environment.

« Bouchon de sel » et inondations sans pluie

Restait à expliquer une bizarrerie locale : alors que les inversacs se déroulent en période de sécheresse, lorsque le niveau de la nappe aquifère est au plus bas, ils sont systématiquement accompagnés d’inondations dans la ville de Balaruc-les-Bains. Ceci est d’autant plus étonnant qu’aucun épisode de pluie ne précède ces inondations qui frappent les sous-sols, les caves et les parkings souterrains de la commune, causant de nombreux dégâts.

Cette curiosité hydrologique est à rapprocher des mesures observées dans les piézomètres des environs : chaque inversac est suivi d’une augmentation rapide des niveaux d’eau de la nappe d’environ 2,3 m. Cette hausse est expliquée par le contraste de densité entre les eaux : l’eau salée de la lagune est environ 3 % plus lourde que l’eau douce.

Ainsi, au moment de l’inversac, le conduit karstique vertical se remplit en quelques minutes d’eau salée sur sa hauteur totale, estimée à environ 70 m. Il en résulte une augmentation brutale de 2,3 m de la pression exercée par la lagune sur la nappe aquifère. Cette onde de pression se propage ensuite rapidement dans la nappe aquifère captive jusqu’à plusieurs kilomètres en quelques heures, provoquant une hausse des niveaux d’eau, et donc des inondations, même en l’absence de pluie.

Cette hausse inattendue des niveaux d’eau explique l’apparente contradiction entre la soudaineté du déclenchement d’un inversac et sa très longue durée. Si un coup de vent sur l’étang provoquant une hausse de son niveau de quelques centimètres peut déclencher un inversac, il ne suffit pas d’une accalmie météorologique pour que le système revienne à son état normal initial. Pour retrouver des flux ascendants dans le conduit karstique, la pression de la nappe aquifère doit vaincre cette surpression de 2,3 m provoquée par l’intrusion de sel, qui agit alors comme une sorte de « bouchon » sur la source sous-marine.

De ce fait, seule une très forte pluie sur le causse d’Aumelas, sur les hauteurs du bassin de Thau, peut recharger suffisamment la nappe aquifère pour provoquer une augmentation de niveau supérieure à 2,3 m, capable de vaincre le bouchon de sel. C’est ce qui s’est déroulé le 14 mars 2022 lorsqu’un épisode pluvieux de plusieurs jours, supérieur à 100 millimètres, a mis fin à cet inversac.

À lire aussi : Comment le changement climatique perturbe la recharge des eaux souterraines

Depuis les années 1950, les inversacs se répètent et s’accélèrent. En cause, les pompages d’eau souterraine, mais surtout la succession des sécheresses, qui provoquent une baisse du niveau de la nappe. Jusqu’à présent, le système revient toujours à son état normal après quelques mois, mais qu’en sera-t-il dans le futur lorsque la recharge naturelle déclinera et que le niveau de la mer montera ?

Il n’est pas exclu que le système bascule définitivement en inversac, provoquant ainsi une salinisation complète et définitive de l’aquifère du Jurassique. C’est pour cette raison qu’un projet d’expérimentation est en cours avec le Syndicat mixte du bassin de Thau pour explorer les moyens possibles de réduire les effets d’un inversac et de préserver la nappe aquifère.

Cette étude a pu être menée dans le cadre du projet de recherche DEM’Eaux Thau (2017-2022).

D’un montant de 5,3 millions d’euros, le financement du projet DEM’Eaux Thau a été assuré à 42% par le ministère de l'Enseignement supérieur et de la Recherche et la Région Occitanie (dans le cadre du Contrat de Plan Etat-Région 2015-2020), à 11% par le fonds européen FEDER, à 17% par l’Agence de l’eau Rhône-Méditerranée-Corse, à 4% par Montpellier Méditerranée Métropole, à 2% par Balaruc-les-Bains et à 1% par le Syndicat Mixte du Bassin de Thau. Le reste du financement du projet (23%) a été apporté grâce à la participation financière de la plupart des partenaires

Bernard Ladouche et Claudine Lamotte ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

06.05.2026 à 15:11

Les « world models », lorsque l’intelligence artificielle apprend à comprendre le monde

Texte intégral (1929 mots)

Les systèmes d’intelligence artificielle générative, qui parlent si bien, ne comprennent pas encore le monde. De nouvelles méthodes physiques ou statistiques comme les world models, ou « modèles de monde », permettraient de les doter d’une forme de sens commun, qui leur servirait à mieux simuler la réalité et de mieux interagir avec elle.

Imaginez un enfant qui, après avoir vu une balle rouler derrière un canapé, sait instinctivement qu’elle continue d’exister et peut anticiper l’endroit précis où elle réapparaîtra. Cette capacité fondamentale, que la psychologie appelle la permanence de l’objet, constitue un socle de l’intelligence humaine. Nous ne nous contentons pas de réagir aux images qui frappent notre rétine ; nous simulons en permanence le futur dans notre esprit.

Aujourd’hui, l’intelligence artificielle tente de franchir ce cap décisif. Après l’ère des modèles capables de générer du texte, comme ChatGPT, ou des images, comme Midjourney, une nouvelle frontière se dessine avec les world models (« modèles de monde »). L’enjeu est de taille : il s’agit de doter les machines d’une forme de sens commun physique, spatial et logique pour qu’elles cessent d’imiter… et commencent enfin à comprendre.

À lire aussi : L’esprit est-il une machine prédictive ? Introduction à la théorie du cerveau bayésien

Ces modèles montrent d’ores et déjà des résultats prometteurs en laboratoire ou dans des environnements simulés. Néanmoins, leur maturité reste limitée et leur déploiement réel est encore restreint aujourd’hui.

Pourquoi les IA actuelles restent-elles en partie limitées ?

Les systèmes d’IA les plus célèbres aujourd’hui sont des modèles génératifs, à l’instar de Claude ou de ChatGPT. Ceux-ci excellent à prédire le mot suivant dans une phrase ou le pixel suivant dans une image, en s’appuyant sur des corrélations statistiques monumentales.

À partir de cette idée de base, les premières preuves mesurables de raisonnement et de bon sens fonctionnel ont été observées dans l’histoire de l’intelligence artificielle (IA). Cependant, comme le soulignent régulièrement des chercheurs du domaine, tels que Yann Le Cun, directeur scientifique d’AMI Labs ou Fei-Fei Li, directrice scientifique de Worldlabs, ces modèles n’ont pas de représentation interne cohérente de la réalité physique.

C’est ce qui explique notamment leurs fameuses hallucinations : un modèle de langage peut affirmer avec une assurance totale qu’un œuf de vache est un ingrédient de cuisine classique, simplement parce qu’il manipule des concepts sans comprendre pleinement les contraintes biologiques du monde réel. Pour dépasser ce stade de « perroquet stochastique » (« stochastique » désignant un phénomène ou un modèle qui intègre le hasard de manière structurée, comme un calcul de probabilités où l’imprévu devient une donnée clé), l’IA doit intégrer une architecture capable de modéliser les causes et les effets.

Cette ambition n’est pas nouvelle, mais elle bénéficie aujourd’hui d’un alignement technologique inédit. Dès 1943, le neuroscientifique Kenneth Craik suggérait déjà que le cerveau humain fonctionne en construisant des modèles de petite échelle de la réalité pour anticiper les événements. Ainsi, lorsque l’on traverse la rue, notre cerveau imagine d’avance la trajectoire des voitures pour savoir quand il est sûr de passer.

Ce qui a changé depuis, c’est que nous disposons de la puissance de calcul et des cadres mathématiques suffisants pour tester cette hypothèse à l’échelle de machines complexes. L’intérêt pour ces modèles a notamment explosé après les travaux pionniers de David Ha et Jürgen Schmidhuber, en 2018. Ils ont montré qu’une IA pouvait apprendre à conduire dans un environnement virtuel en s’entraînant presque exclusivement dans ses propres « rêves ». Ces « rêves » correspondent à une simulation interne, créée par l’IA elle-même, qui lui permet de tester différentes stratégies sans interagir avec le monde réel.

L’architecture des modèles de monde

Ces auteurs ont introduit la notion de « modèle de monde » : une représentation interne et structurée d’un environnement qui permet à un agent d’anticiper les conséquences de ses actions. Le modèle virtuel synthétise l’information observable pour construire une version abstraite et manipulable du monde réel, facilitant la planification, la simulation et la prise de décision, même dans des situations complexes ou incertaines. Sur le plan technique, un modèle de monde repose sur une mécanique de compression de l’information et de prédiction.

Plutôt que de se contenter d’identifier des objets comme « chat » ou « balle » après apprentissage, un modèle de monde apprend à représenter le monde de manière plus riche et structurée.

Dans un premier temps, le système observe d’énormes quantités de données et en extrait une représentation compacte des dynamiques essentielles, par exemple la trajectoire d’un objet, la rigidité d’une surface ou les interactions spatiales entre plusieurs éléments (la patte du chat qui joue avec la balle). Cette abstraction ne se limite pas à des labels : elle capture des régularités physiques et logiques du monde.

Dans un second temps, le modèle peut simuler des scénarios futurs en utilisant cette représentation (la balle passe sous un fauteuil et le chat essaye de la dégager). Ainsi, si l’agent doté du modèle de monde précédemment décrit envisage une action, elle peut prédire ses conséquences avant même de l’exécuter, dans un environnement potentiellement incertain ou bruité.

Autrement dit, contrairement à la simple classification statistique « ceci est un chat », le modèle de monde apprend une sorte de mini-simulation interne du monde, qui combine perception, compréhension spatiale et logique, et capacité à anticiper.

Ici, l’approche reste statistique, similaire à l’apprentissage par renforcement, mais sans recours direct à des modèles physiques explicites ; elle se fonde uniquement sur les régularités observées dans les données (les balles qui roulent sous les objets en ressortent ou y restent coincées). Cette distinction entre approches statistique et physique devient importante lorsqu’on aborde des environnements complexes et incertains, où les prédictions doivent intégrer la variabilité naturelle du monde réel.

À lire aussi : Des pistes pour une IA digne de confiance : mélanger expertises humaines et apprentissage automatique

Plusieurs propositions récentes illustrent le potentiel de l’approche statistique des modèles de monde. Le modèle V-JEPA de Meta apprend, par exemple, à comprendre les interactions physiques complexes en regardant simplement des vidéos, sans aucun étiquetage humain. De son côté, Google DeepMind a récemment dévoilé Genie, une architecture capable de créer des mondes virtuels interactifs à partir d’une simple photographie, prouvant que la machine a assimilé auparavant les lois de la physique et de la perspective.

Des applications qui touchent la société

Les répercussions de cette technologie sont massives et dépassent largement le cadre de l’informatique théorique.

En robotique, par exemple, un agent équipé d’un modèle du monde pourrait apprendre à manipuler des objets fragiles ou à se déplacer dans un entrepôt encombré sans passer par des milliers d’heures d’essais physiques coûteux et risqués.

Dans le secteur des véhicules autonomes, des pionniers, comme Wayve, affirment utiliser des modèles du monde pour que les voitures anticipent les comportements difficiles à prévoir des piétons ou des autres conducteurs, là où les systèmes classiques se contenteraient de réagir avec un temps de retard.

Dans le domaine de la santé, les jumeaux numériques sont encore en phase d’exploration et servent à simuler comment une maladie pourrait évoluer en réponse à un traitement expérimental. Toutefois, ces modèles ne donnent pas des prédictions certaines : ils sont dits « probabilistes », ce qui signifie qu’ils reposent sur des calculs de probabilités. Autrement dit, ils estiment plusieurs évolutions possibles d’un patient (amélioration, stabilité, aggravation) et attribuent à chacune une chance de se produire, en fonction des données disponibles et de modèles statistiques. Par conséquent, ces simulations restent des estimations, et non des certitudes. Elles doivent donc être validées avec beaucoup de rigueur, en particulier lorsqu’elles concernent des traitements qui n’ont encore jamais été testés en conditions cliniques réelles.

Les progrès de l’IA nous amènent à repenser ce que signifie réellement « comprendre » et « anticiper » dans un monde complexe. À terme, explorer ces questions pourrait non seulement transformer la technologie, mais aussi notre manière d’appréhender la cognition et la créativité humaines.

Il est important de nuancer l’enthousiasme autour de ces modèles. En dépit des avancées, celles-ci demeurent pour l’instant à l’échelle de la recherche et du développement. Par exemple, dans la robotique et les véhicules autonomes, la majorité des applications sont encore à l’état de prototypes ou de pilotes contrôlés, souvent dans des environnements très structurés.

L’adoption à grande échelle nécessitera de surmonter des défis techniques et réglementaires majeurs, comme la robustesse face à des situations imprévues ou la sécurité dans des contextes réels complexes. Ainsi, ces modèles sont en phase d’expérimentation avancée, et non opérationnels partout et tout le temps – même si leurs perspectives restent très prometteuses.

Julien Perez est membre de bpifrance, directeur de la recherche en AI.

01.05.2026 à 11:08

Comment les chênes déjouent les chenilles en retardant l’ouverture de leurs bourgeons

Texte intégral (898 mots)

Lorsque les chênes sont fortement endommagés par des chenilles une année, ils ouvrent leurs bourgeons plus tard au printemps suivant. Notre équipe internationale de recherche a montré que cette stratégie est très efficace contre leurs prédateurs. Nous venons de publier nos résultats dans la revue Nature Ecology & Evolution.

Au printemps en forêt, de nombreuses chenilles éclosent précisément lorsque les feuilles des arbres sont encore jeunes et tendres. Elles trouvent ainsi une table abondamment garnie.

Si les chênes sont fortement infestés par des chenilles une année donnée, ils réagissent au printemps suivant : ils retardent l’apparition de leurs feuilles de trois jours. Cela est défavorable aux chenilles. Après l’éclosion, elles se retrouvent littéralement face à des assiettes vides, car les feuilles de chêne sont encore bien cachées dans les bourgeons. Cette stratégie est très efficace : chez certaines espèces toutes les chenilles meurent après trois jours sans nourriture. En conséquence, ce stratégie de débourrement retardé diminue les dégâts causés par leur alimentation sur l’arbre de 55 %.

Comment avons-nous vu, depuis l'espace, comment les chênes combattent les chenilles ?

Pour démontrer ces liens, nous avons utilisé des méthodes interdisciplinaires de pointe issues de l’écologie et de la télédétection. Auparavant, les chercheurs devaient observer laborieusement des arbres individuels sur le terrain. Pour cette étude, cependant, une zone de 2 400 kilomètres carrés en Bavière du Nord a été surveillée en continu grâce aux données du satellite Sentinel-1. Ce qui rend ces satellites radar particuliers, c’est qu’ils fournissent des données précises sur l’état des canopées, même sous une épaisse couverture nuageuse.

Nous avons analysé un total de 137 500 observations individuelles sur cinq ans, de 2017 à 2021. Les satellites ont fourni des données avec une résolution de 10×10 mètres par pixel, ce qui correspond approximativement au houppier (la partie d'un arbre constituée d'un ensemble structuré des branches situées au sommet du tronc) d’un arbre unique. Au total, 27 500 pixels de ce type ont été analysés dans 60 zones forestières.

L’année 2019 s’est révélée particulièrement instructive, car la région a connu une invasion massive de la spongieuse (un ravageur des forêts de feuillus). Les capteurs radar ont enregistré précisément quels arbres ont perdu leurs feuilles et comment ils ont réagi l’année suivante.

En quoi cette découverte est-elle importante ?

Les arbres ne réagissent pas seulement à la météo au printemps. Cette tactique de retard est plus efficace pour le chêne qu’une défense chimique, comme les tanins amers présents dans les feuilles. En effet, l’arbre devrait dépenser beaucoup d’énergie pour augmenter sa production de tanins.

Pour la première fois, l’étude explique de manière concluante pourquoi, en moyenne, la forêt ne verdit pas aussi rapidement que les températures pourraient le laisser supposer. Les modèles informatiques antérieurs calculent souvent de manière inexacte l’état des forêts, car ils prennent exclusivement en compte des facteurs climatiques comme la température et ignorent les interactions biologiques entre plantes et insectes.

Les arbres se trouvent dans une sorte de bras de fer évolutif : alors que l’augmentation des températures liée au changement climatique les pousse à produire leurs feuilles de plus en plus tôt, la pression exercée par les insectes herbivores les contraint à retarder ce processus. Un avantage clé de cette stratégie de retard est qu’elle est temporaire et réversible. Comme les arbres ne retardent leur feuillaison qu’après une infestation réelle, les insectes ne peuvent pas s’y adapter de manière permanente. Cette interaction dynamique est un exemple de la grande résilience et capacité d’adaptation des forêts dans un monde en mutation.

Quelles sont les perspectives ?

Des expériences futures devraient permettre de mieux comprendre l'importance de ces mécanismes pour des phénomènes caractéristiques expliqués depuis des décennies par d'autres mécanismes, aussi bien que les conséquences pour les interactions des arbres avec leurs symbiontes mycorhiziens et avec les ennemies de leurs ennemies, comme les mésanges et des guêpes parasitoïdes.

Tout savoir en trois minutes sur des résultats récents de recherches, commentés et contextualisés par les chercheuses et les chercheurs qui les ont menées, c’est le principe de nos « Research Briefs ». Un format à retrouver ici.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

⬅️ 12 / 25 ➡️

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview