08.04.2026 à 17:45

Une nouvelle piste pour stocker l’énergie solaire… et fournir de l’électricité quand le soleil s’absente

Vera Moerbeek, Doctorante en physique, Centre national de la recherche scientifique (CNRS); Université de Perpignan Via Domitia

Texte intégral (2207 mots)

L’énergie solaire est associée à des problèmes d’intermittence, car elle ne génère d’électricité que quand le soleil brille. Certains dispositifs photovoltaïques pourraient permettre de stocker le rayonnement solaire sous forme de chaleur, puis de récupérer l’énergie sous forme d’électricité.

Il est devenu courant de voir des panneaux solaires sur les toits des maisons et des hangars, grâce à la baisse du prix des cellules en silicium et à leur taille compacte. Cependant, l’énergie solaire est intermittente, comme beaucoup d’autres types d’énergie renouvelable. Lors des périodes de production maximale, comme les journées estivales ensoleillées, le réseau d’électricité sature d’énergie, tandis que lors des périodes de faible production, comme le soir et en hiver, l’offre diminue alors même que la demande est la plus élevée. C’est pourquoi, afin de garantir la disponibilité de l’énergie à la demande, des solutions de stockage doivent être intégrées au réseau.

La technologie la plus utilisée pour le stockage à l’échelle du réseau électrique est le stockage hydroélectrique par pompage, mais le nombre de sites favorables en France est limité et déjà largement exploité, du fait des contraintes géographiques.

Une autre technologie courante est la batterie électrochimique : l’exemple le plus commun est celui des batteries lithium-ion des téléphones portables et des voitures. À plus grande échelle, des entreprises, par exemple Enedis, commencent à investir dans de grands parcs de batteries pour soutenir le réseau électrique. La technologie dominante pour ces très grandes batteries est la technologie lithium-fer-phosphate.

En grande partie pour cette raison, l’Agence internationale de l’énergie (IEA) dans un report récent prévoit une croissance de 42 % de la demande de lithium en 2040 par rapport à 2020. Or, l’extraction du lithium soulève des enjeux géopolitiques et humanitaires. Récemment, la possibilité d’ouvrir d’une mine dans l’Allier a intensifié le débat en France : si ces mines ont des impacts négatifs sur l’eau potable, la biodiversité et les sols, peut-on réellement soutenir qu’elles nous aideraient vers un futur durable ?

Peut-on stocker l’énergie autrement et assurer la stabilité du réseau électrique ?

Le stockage thermique : une alternative aux batteries électrochimiques

Les barrages hydroélectriques et les batteries électrochimiques ne constituent pas la seule solution pour le stockage de l’énergie. Une alternative est le stockage thermique, où l’énergie est stockée sous forme de chaleur.

C’est par exemple le principe des chauffe-eau solaires. À plus grande échelle, le stockage thermique est surtout appliqué en combinaison avec des centrales solaires à concentration (CSP), comme le Crescent Dunes Solar Energy Project aux États-Unis ou l’Andasol Solar Power Station en Espagne. Cependant, le CSP reste une technologie marginale, car ces grandes centrales nécessitent un investissement initial très important et les coûts de maintenance sont élevés.

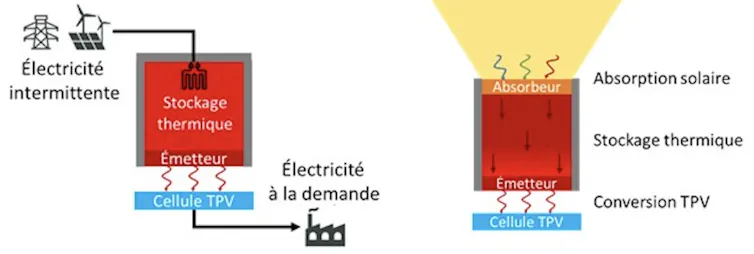

Dans ce type d’installations, la première étape est la conversion d’énergie solaire en chaleur au moyen de grands miroirs – soit paraboliques, soit petits, plats et suivant le soleil – qui concentrent le rayonnement solaire pour chauffer un fluide (conventionnellement du sel fondu). La chaleur est convertie en électricité lors de la deuxième étape, où la chaleur stockée dans le fluide entraîne une turbine.

Malheureusement, la conversion de la chaleur en énergie utile, comme l’électricité, est particulièrement difficile : l’efficacité de la conversion est limitée fondamentalement par ce qu’on appelle « la loi de Carnot ». Par exemple : à 300 °C, le maximum théorique de l’efficacité est environ 50 %, ce qui signifie que l’efficacité réelle est encore plus basse. En comparaison, l’efficacité des batteries lithium-ion, qui ne passent pas par la case « chaleur », peut surpasser 90 %.

« Détourner » les cellules photovoltaïques pour convertir le rayonnement de la chaleur en électricité

Mais il existe une autre façon de convertir la chaleur en électricité : en utilisant le rayonnement émis par tout objet chaud (qui dépend de la température).

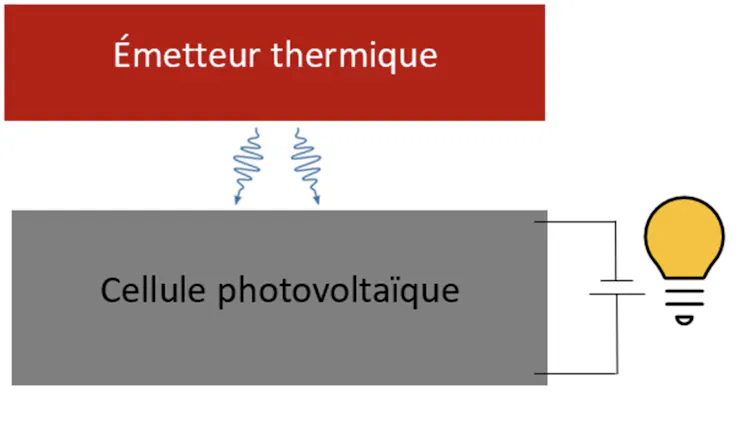

Tandis que les cellules photovoltaïques traditionnelles que l’on voit sur les toits et dans les fermes solaires convertissent le rayonnement solaire lui-même, l’idée de ce qu’on appelle les systèmes thermophotovoltaïques (abréviés TPV) est de récupérer le rayonnement infrarouge émis par n’importe quel objet chauffé – et qui stocke donc l’énergie sous forme de chaleur – et de la convertir en électricité.

Par exemple, le silicium fond à 1 414 °C et le graphite peut être chauffé jusqu’à plus de 2 000 °C. Ces matériaux émettent alors un rayonnement infrarouge, que l’on peut collecter grâce à des cellules photovoltaïques spéciales (comme des cellules en indium-gallium-arséniure). À de telles températures, la limite de Carnot est repoussée jusqu’à 83 % et 87 % respectivement. En pratique, les expériences réalisées au MIT, aux États-Unis, ont démontré une efficacité de plus de 40 %.

Différents dispositifs thermophotovoltaïques

Le dispositif le plus mature à ce jour n’utilise pas le rayonnement solaire pour chauffer le milieu de stockage, mais simplement l’électricité. Il est donc similaire à une batterie lithium-ion, mais effectue des conversions d’énergie successives « électricité → chaleur → électricité » au lieu de « électricité → énergie chimique → électricité ». De tels dispositifs promettent d’être compétitifs en raison de leurs coûts relativement faibles et aujourd’hui commencent à être commercialisés à l’échelle industrielle.

Il serait encore plus intéressant de chauffer le milieu de stockage directement avec le rayonnement solaire, comme pour le CSP conventionnel, afin que le système devienne une source d’énergie renouvelable non intermittente.

Pour cette raison, nous avons réalisé le premier prototype expérimental de ce dispositif, dont le milieu de stockage est chauffé à l’aide d’un rayonnement solaire concentré, et suit donc une conversion « solaire → chaleur → électricité ». Un avantage important de notre dispositif est qu’il pourrait être rentable à une échelle beaucoup plus réduite que les systèmes CSP actuels, du fait du remplacement de la turbine par les cellules thermophotovoltaïques (TPV).

Cependant, l’efficacité globale de ce nouveau type de batterie thermique (soleil → chaleur → électricité) — et notamment l’efficacité des cellules thermophotovoltaïques elles-mêmes (pour la conversion finale de chaleur en électricité) — doit encore être améliorée au laboratoire, afin que cette technologie devienne plus compétitive.

Vera Moerbeek a reçu des financements de l'École doctorale "énergie et environnement" (ED305).

08.04.2026 à 17:44

« For shhure » : quand l’accent étranger devient politique

Grégory Miras, Professeur des Universités en didactique des langues, Université de Lorraine

Adam Wilson, Maître de conférences en Linguistique (LEA), Université de Lorraine

Texte intégral (1624 mots)

La deuxième édition du Festival des accents se tiendra du 9 au 11 avril 2026 à Marseille, dans les Bouches-du-Rhône. L’occasion de s’intéresser à la question de la politisation des accents, souvent utilisés comme un marqueur de légitimité.

On garde à l’esprit les discussions autour du « for shhure » d’Emmanuel Macron, de Jean-Luc Mélenchon se demandant si on dit « Troump » ou « Trümp », ou de l’anglais de Melania Trump au Conseil de sécurité de l’ONU. Dans un monde globalisé, les débats sur les identités nationales s’intensifient et l’accent devient un marqueur politique clé. Entre légitimité contestée et mécanismes de rejet, la prononciation révèle combien la langue demeure politique.

Les façons de parler : un sujet en politique

En étudiant le cas du conseil municipal de Montreuil (Seine-Saint-Denis), la phonéticienne Charlotte Kouklia a montré comment l’expression vocale permettait de révéler dominance, hostilité et expressivité dans le débat politique. L’accent peut ainsi devenir le centre de phénomènes de domination.

En France, l’accent des politiques est scruté par la sphère publique participant à ces phénomènes de domination. L’envergure internationale d’Anne Hidalgo, ancienne maire de Paris, a souvent été remise en question du fait de son accent dit « français » lorsqu’elle s’exprime en anglais. Cela a notamment été le cas lors des Jeux olympiques 2024. En cela, elle rejoint une liste conséquente de figures politiques françaises qui ont reçu des critiques, ou des compliments, sur leur accent en anglais.

Le cas d’Emmanuel Macron est intéressant dans le sens où certains commentateurs peuvent lui reprocher de vouloir faire trop international et pas assez français, ou le contraire, selon son degré d’accent du moment. Dans le même temps, en 2021 à Marseille, on l’entendait prononcer quelques mots de son discours avec un accent dit « du sud » qui témoignerait d’une volonté de proximité régionale. L’accent « atypique » des personnalités publiques est souvent repris par les journalistes au sein de récits : celui de Jean Castex, par exemple, a été présenté comme un rapprochement politique du gouvernement d’Emmanuel Macron avec « les régions ».

Il convient de rappeler que les individus disposent d’une pluriphonie – la capacité des individus à avoir un éventail de sons dans son répertoire – ou peuvent convoquer une convergence phonologique – la capacité à s’adapter en contexte à d’autres façons de prononcer. Aussi, les manières de parler ne sont pas stables. Or, avoir des accents en politique n’est pas neutre.

Mettre à l’écart ses adversaires par leur accent

Lors des élections présidentielles de 2012, l’accent d’Eva Joly, alors candidate franco-norvégienne des écologistes, a été attaqué par l’écrivain Patrick Besson dans un pamphlet. Il y remettait en question sa crédibilité à la plus haute élection nationale en imitant à l’écrit son accent et en questionnant sa maîtrise du français. La candidate y a répondu dans une vidéo promouvant la diversité, mais la polarisation sur ses compétences linguistiques liées à sa légitimité aux élections avait déjà contaminé le débat public.

Certains hommes politiques aiment imiter les accents des autres. C’est le cas de Donald Trump, qui a plusieurs fois adopté un accent « français » quand il rapportait des propos d’Emmanuel Macron lors de conférences de presse, et de Boris Johnson, qui emploie dans ses mémoires une orthographe déformée de l’anglais afin de représenter son accent jugé « étranger ».

Parfois, l’accent peut aussi devenir un prétexte pour ne pas répondre à une question dérangeante. Donald Trump mentionne ainsi régulièrement l’accent de journalistes comme posant un problème de compréhension – que l’accent soit afghan ou français. Jean-Luc Mélenchon avait présenté une stratégie similaire face à une journaliste d’une antenne toulousaine de France 3. Donald Trump fait même appel à un interprète pour répéter ce que dit le premier ministre indien, pourtant anglophone.

Donald Trump n’est, en tout cas, pas gêné par l’accent de sa First Lady, Melania Trump, avec son accent dit « slovène ». Ce « deux poids, deux mesures » n’est pas passé inaperçu auprès des internautes, qui soulignent que tous les accents dits « étrangers » n’ont pas la même valeur en politique. Ce même président des États-Unis prétend d’ailleurs qu’il aurait plus facilement été élu président s’il avait eu un accent britannique, renvoyant au prestige supposé de cette variété.

Pourtant, lors d’une conférence de presse en 2025, l’élue républicaine pro-Trump Marjorie Taylor Greene a qualifié une question d’illégitime en raison de la nationalité britannique de la journaliste, nationalité identifiée par le biais de l’accent. La politicienne a expliqué par la suite qu’elle voulait bien répondre à la question si elle était posée par un journaliste américain, avec un accent américain donc.

Plus récemment, un citoyen américain a été arrêté par ICE, la police contestée de l’immigration états-unienne, car un officier avait développé des soupçons relatifs à sa nationalité basés uniquement sur sa façon de parler, donc son accent.

L’accent est donc impliqué dans la construction et la destruction de la légitimité dans la sphère publique.

Accents, délégitimation et déshumanisation

L’accent est mobilisé pour questionner la légitimité d’un individu, que ce soit celle à poser une question à une élue ou celle d’être sur le sol américain. L’accent fonctionne donc comme une arme d’altérisation, permettant de souligner une différence chez un individu, pour le positionner comme illégitime mais aussi comme un ennemi. Identifier des ennemis potentiels de l’État à travers l’accent de cette manière n’est pas sans rappeler d’autres périodes sombres de l’histoire.

L’accent – ou plutôt les façons de parler – c’est une trace, une trace des histoires de vie ou des parcours. Il raconte les contacts avec d’autres langues, d’autres cultures, et plus généralement la diversité et le multiculturalisme dans un monde globalisé. L’accent peut aussi devenir un stigmate pour rappeler à l’autre qu’il est un étranger et lui faire entendre son illégitimité à avoir une place dans la société.

Alors que des discours, parfois réactionnaires ou nationalistes, opposent des récits concurrents, l’accent joue un rôle clé : il permet de définir qui appartient à une communauté ou, au contraire, de marquer son exclusion. Comme le montre l’exemple du schibboleth (une phrase qui ne peut être prononcée « correctement » que par les membres d’un groupe), la prononciation peut révéler l’appartenance à un groupe social. Ainsi, un simple accent ou une prononciation peut devenir un marqueur d’exclusion. Reconnaître ces mécanismes permet d’éviter que la langue ne serve à discriminer plutôt qu’à unir.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

08.04.2026 à 17:43

Recourir à une IA quand on n’est pas médecin n’aide pas à poser un meilleur diagnostic

Rebecca Payne, Clinical Senior Lecturer, Bangor University; University of Oxford

Texte intégral (1833 mots)

De plus en plus de gens consultent les agents conversationnels dopés à l’intelligence artificielle pour répondre aux questions du quotidien. Ces nouveaux outils sont également sollicités pour fournir des informations en lien avec la santé. Pourtant, ils sont encore très loin de pouvoir remplacer les médecins, comme le révèle une nouvelle étude.

Désormais, pour obtenir des conseils sur des sujets aussi variés que la cuisine ou la façon de remplir leur déclaration d’impôts, des millions de personnes se tournent vers des agents conversationnels (chatbots, en anglais) basés sur l’intelligence artificielle (IA). Un nombre croissant d’individus leur pose également des questions concernant leur santé. Or, comme le rappelait récemment le médecin-chef du Royaume-Uni, lorsqu’il s’agit de prendre des décisions médicales, une telle démarche peut s’avérer risquée.

Dans une étude récente, mes collègues et moi-même avons évalué dans quelle mesure les chatbots reposant sur des grands modèles de langage (LLM) sont réellement capables d’aider le grand public à faire face à certains problèmes de santé courants. Nos résultats, frappants, démontrent que les chatbots que nous avons testés ne sont pas encore en mesure d’endosser le rôle de médecin.

Utiliser un chatbot ne permet pas de prendre de meilleures décisions en matière de santé

Avant tout, soulignons qu’une objection fréquente face à des recherches telles que celles que nous avons menées est d’affirmer que l’IA évolue plus vite que le cycle de publication académique : au moment où un article paraît, les modèles étudiés ont souvent déjà été mis à jour, rendant ses conclusions obsolètes. Pourtant, des études menées dans le contexte du triage médical (processus visant à déterminer à la phase initiale de la prise en charge d’un patient, la filière adaptée à son état en matière de délai et de type de soins, ndlr) et portant sur des versions plus récentes de ces systèmes suggèrent que les mêmes problèmes persistent.

Nos travaux ont consisté à soumettre à des participants de brèves descriptions de situations médicales courantes. Les volontaires ont été répartis de manière aléatoire en deux groupes. Les membres du premier groupe devaient interagir avec l’un des trois chatbots que nous avions sélectionnés (des chatbots courants, facilement accessibles pour le grand public), tandis que ceux de l’autre groupe pouvaient recourir aux sources qu’ils avaient l’habitude de consulter ordinairement, chez eux. À l’issue de l’interaction, nous leur posions deux questions : quelle affection était la plus compatible avec les symptômes décrits ? Et, en conséquence, vers quelle structure de soins valait-il mieux se tourner ?

Les utilisateurs de chatbots se sont révélés moins aptes à identifier la bonne affection que ceux qui n’en avaient pas utilisé. Ils ne se montraient pas non plus meilleurs que le groupe témoin pour déterminer la bonne modalité de recours aux soins. En d’autres termes, interagir avec un chatbot n’a pas permis aux participants de prendre de meilleures décisions en matière de santé.

Des connaissances solides, mais des résultats décevants

Ces résultats ne signifient pas que les connaissances médicales des modèles de chatbots testés sont lacunaires : les LLM sont, en effet, capables de passer facilement des examens de certification médicale. D’ailleurs, une fois que nous avons mis de côté l’élément humain, en soumettant directement les mêmes scénarios aux chatbots, leurs performances se sont sensiblement améliorées.

Sans intermédiaire humain, les modèles ont identifié les affections pertinentes dans la grande majorité des cas et suggéré le plus souvent des modalités de recours aux soins appropriées.

Pourquoi, alors, les résultats se dégradent-ils dès lors que des utilisateurs réels entrent en jeu ? L’analyse des échanges a mis en lumière plusieurs écueils. Il arrivait fréquemment que les chatbots mentionnent la bonne hypothèse diagnostique au fil de la conversation, sans que les participants ne la retiennent ou ne la restituent dans leur réponse finale.

Dans d’autres cas, les utilisateurs transmettaient des informations parcellaires, ou bien le chatbot interprétait mal des détails essentiels. L’échec ne relevait donc pas d’un simple manque de connaissances médicales. Il tenait à un problème de communication entre l’être humain et la machine.

Ne pas confondre la théorie et la pratique

Cette étude démontre qu’avant de déployer de nouvelles technologies dans des environnements où les enjeux sont importants, les décideurs politiques doivent impérativement avoir des données collectées « en condition réelles » pour estimer les véritables performances des outils concernés. C’est évidemment le cas dans le secteur de la santé.

Nos résultats mettent en évidence que bon nombre des évaluations actuellement menées pour déterminer l’intérêt de l’IA en médecine présentent d’importantes lacunes. En effet, les modèles de langage obtiennent souvent d’excellents résultats lorsqu’il s’agit de répondre à des questions d’examen structurées, ou durant des interactions simulées entre différents modèles.

Mais l’usage réel de ces outils est bien plus complexe que cela. Dans la réalité, les patients décrivent leurs symptômes de façon vague ou incomplète. Ils peuvent aussi mal comprendre les explications qui leur sont données, ou poser leurs questions selon un ordre imprévisible. Un système dont les résultats lors des tests d’évaluations s’avèrent impressionnants peut se comporter très différemment une fois confronté à de véritables utilisateurs.

Cette étude souligne également un point fondamental sur la nature même de la pratique clinique. En tant que médecin généraliste, mon travail ne se limite pas à mobiliser des faits mémorisés antérieurement. La médecine est souvent décrite comme un art autant qu’une science. Une consultation n’a pas pour seul objet d’établir le bon diagnostic : elle consiste à interpréter le récit du patient, à sonder l’incertitude et à prendre des décisions qui sont le résultat d’une négociation.

Cette complexité du colloque singulier entre le médecin et son patient est depuis longtemps reconnu par les enseignants en médecine. Pendant des décennies, les futurs médecins ont été formés selon le modèle de Calgary-Cambridge. Celui-ci implique d’instaurer une relation de confiance avec le patient, de recueillir les informations en le questionnant et en l’écoutant avec la plus grande attention, de comprendre ses préoccupations et ses attentes, de lui expliquer clairement les conclusions et de s’accorder avec lui sur un plan de prise en charge.

Ces processus reposent sur l’établissement d’une connexion humaine, rendue possible grâce à une communication sur mesure, faite d’exploration précautionneuse, afin d’aboutir à l’établissement d’un jugement façonné par le contexte et la confiance. Toutes ces qualités ne peuvent pas être facilement appréhendées par des techniques de reconnaissance de formes (techniques à la base des modèles d’IA, qui permettent à l’ordinateur de détecter, à partir de données brutes ou prétraitées, la présence de formes ou de régularités, ndlr)

Les chatbots IA, des assistants plus que des médecins

Nos travaux ne démontrent pas que l’IA n’a pas sa place dans le secteur de la santé – loin de là. La leçon à retenir est qu’il est crucial de comprendre ce que ces systèmes savent faire à l’heure actuelle, et où se situent leurs limites.

Les chatbots actuels doivent être davantage considérés comme des assistants que comme des médecins. Ils excellent dans l’organisation de l’information, la synthèse de textes et la structuration de documents complexes. Des tâches qui sont précisément celles pour lesquelles les modèles de langage s’avèrent déjà utiles au sein des systèmes de santé, qu’il s’agisse de rédiger des comptes rendus cliniques, de synthétiser des dossiers médicaux ou de générer des lettres d’adressage, par exemple.

Les promesses de l’IA en médecine demeurent réelles, mais à court terme, son rôle sera vraisemblablement plus un rôle de soutien qu’une véritable révolution. On ne peut pas attendre des chatbots qu’ils soient la porte d’entrée dans le système de soins. Ils ne sont pas encore en mesure de poser des diagnostics ni d’orienter les patients vers les prises en charge pertinentes.

Certes, l’IA est déjà capable de réussir des examens de médecine. Mais de même que réussir un examen du Code de la route ne fait pas de vous un conducteur compétent, exercer la médecine ne se limite pas à répondre correctement à des questions.

Retrouver son chemin au cœur de la complexité qui se dissimule derrière chaque rencontre clinique requiert de savoir faire preuve d’empathie et de discernement. Cela reste encore l’apanage des humains. Pour l’heure, du moins.

Rebecca Payne travaille sur le projet REMEDY, financé par Health and Care Research Wales, et bénéficie également d'une bourse Clarendon-Reuben de l'université d'Oxford. Elle est membre du Royal College of General Practitioners et membre senior de la Faculty of Medical Leadership and Management.

08.04.2026 à 17:42

Ces élus issus de l’immigration confrontés au racisme

Marie-Hélène Bacqué, Sociologue, urbaniste, Université Paris Nanterre

Claudette Lafaye, Maitresse de conférence en sociologie, Université Paris 8 – Vincennes Saint-Denis

Texte intégral (1905 mots)

Une nouvelle génération de maires appartenant aux minorités visibles s’est imposée lors des élections municipales de mars 2026. Leur présence s’inscrit dans un mouvement très lent, lié au travail de longue haleine des militants des quartiers populaires. Les charges racistes contre ces élus, et en particulier contre Bally Bagayoko, maire de Saint-Denis, en Seine-Saint-Denis, sont particulièrement violentes. Certains élus témoignent : relents colonialistes, climat islamophobe, soupçons de sorcellerie…

Un ensemble de réactions racistes émanant de médias d’extrême droite, repris par plusieurs chaînes nationales (Cnews, RMC, France 5) et par des responsables politiques ont accueilli, lors du dernier scrutin municipal, l’élection de maires racisé·es et les manifestations de joie qui se sont exprimées dans leurs villes. Les réactions officielles se sont fait attendre. Sofienne Karroumi à Aubervilliers, Aly Diouara à La Courneuve, Demba Traoré au Blanc-Mesnil, Mélissa Youssouf à Villepinte (Seine-Saint-Denis), Imène Souid-Ben Cheikh à Orly (Val-de-Marne), Bassi Konaté à Sarcelles (Val-d’Oise), Adama Gaye à Mantes-la-Jolie (Yvelines), Kadir Mebarek à Melun (Seine-et-Marne), mais aussi au-delà de l’Île-de-France : Omar Yaqoob à Creil (Oise), Abdel-Kader Guerza à Dreux (Eure-et-Loir), Idir Boumertit à Vénissieux (Rhône)… Ils, plus souvent qu’elles, sont aujourd’hui premiers magistrats de leurs villes respectives. Ils et elles ont en commun d’appartenir à des minorités ethnoraciales et de représenter des territoires populaires.

Que disent ces réactions de la représentation en politique, de son évolution et de ses inerties ?

Un lent mouvement de reconnaissance

« La politique est un univers d’hommes privilégiés, âgés, diplômés et issus des catégories supérieures de la société », constatait le politiste Rémi Lefebvre – il faudrait préciser d’hommes blancs. L’élection de ces nouveaux et nouvelles maires vient bousculer, partiellement, cet ordre établi et les représentations qui l’accompagnent.

Leur arrivée en responsabilité n’est pas, pour autant, soudaine. Elle renvoie à un lent mouvement et une difficile reconnaissance du travail de militant·es des quartiers populaires. Dans une enquête portant sur la Seine Saint-Denis, département populaire, historiquement marqué par le communisme municipal et par l’histoire de l’immigration, nous montrions au niveau local une progression significative de la part des élus racisé·es entre les élections de 2001 (9 %) et celles de 2020 (36 %).

Il aura, néanmoins, fallu attendre 2014 pour qu’une commune de Seine-Saint-Denis, Stains, élise son premier maire racisé, Azzedine Taïbi. Le plafond de verre pour l’accès à la fonction de premier magistrat venait de se craqueler. Le mouvement s’est poursuivi avec l’élection de sept maires racisés en 2000 puis de 13, dont deux femmes, lors du dernier scrutin – les sept sortants ayant tous été réélus. Cette dynamique d’ouverture est donc bien confirmée en Seine Saint-Denis comme, plus largement, dans les banlieues populaires. Elle reflète, encore bien timidement, la diversité ethnoraciale de leurs populations.

Cette ouverture ne se traduit cependant pas par une meilleure représentation des femmes qui restent largement sous-représentées : 4 femmes maires sur les 39 villes du département, dont deux racisées. Les classes populaires demeurent par ailleurs largement exclues de la représentation politique.

Contrairement aux préjugés qui assimilent personne racisée et personne sans diplôme, appartenant aux classes populaires, ces maires racisé·es sont à l’image de l’ensemble des maires des villes de plus de 30 000 habitants que la profession initiale rattache majoritairement aux catégories supérieures et intermédiaires. Ils et elles sont néanmoins le plus souvent issus de familles populaires, ont grandi et habitent dans les territoires qui les ont socialisés politiquement.

Une diversité de parcours

À rebours des représentations médiatiques qui font de ces nouvelles et nouveaux maires, vu·es du seul critère racial, un ensemble homogène, c’est aussi la diversité de leurs trajectoires qui est confirmée. Leur élection est souvent associée à La France insoumise (LFI) et présentée comme une irruption soudaine dans la vie politique alors que leurs parcours renvoient à un ancrage et à un engagement de long terme dans leurs quartiers et leurs villes.

Leurs affiliations politiques sont plurielles, et ils et elles entretiennent des relations complexes avec les partis politiques souvent prêts à les instrumentaliser mais plus réticents à les reconnaître. Plusieurs ont conduit des « listes citoyennes » ou « diverses » réunissant l’appui de plusieurs partis.

Dans la seule ville de La Courneuve par exemple, s’affrontaient trois candidat·es racisé·es, tous trois issu·es de la Cité des 4 000 : Aly Dioura, Nadia Chahboune, Oumarou Doucouré. Le premier a construit son implantation dans le tissu associatif local : amicale de locataires, aide aux devoirs dans une association de quartier. Très critique vis-à-vis des partis politiques, il a investi la politique représentative en marquant d’emblée son indépendance, participant à la création du mouvement citoyen La Seine Saint-Denis au cœur. Il s’est présenté sous cette bannière aux élections départementales de 2021 et législatives de 2022. Deux ans plus tard, en 2024, il est investi par LFI et élu député. C’est aussi une liste LFI qu’il conduit pour les municipales de 2026 qui lui permet de devenir maire.

Nadia Chahboune, de son côté, conduit la liste soutenue par le maire communiste qui ne se représente pas. Elle est aussi issue du milieu associatif ; elle a créé et présidé deux associations sportives en direction des femmes avant d’être sollicitée par le maire communiste pour les élections de 2020. Elle occupe alors un poste de maire adjointe pendant un mandat. Contrairement à Aly Diouara, elle souhaite garder son indépendance vis-à-vis des partis politiques. Quant à Oumarou Doucouré, il est membre du Parti socialiste, conseiller technique au cabinet du président du Conseil départemental et présente une trajectoire partisane plus classique qui le conduit au poste de premier adjoint au cours du mandat 2020-2026 puis à mener une liste investie par le PS aux dernières municipales. Ces trois parcours illustrent des relations différentes avec le champ partisan, faites d’oppositions, de collaborations et de tentatives d’émancipation.

Les sept maires racisé·es élu·es en 2020 et réélu·es en 2026 témoignaient également d’une relation complexe aux partis politiques. Parmi les cinq qui s’affirment de gauche, on relève un compagnon de route, Abdel Saadi, et un membre du Parti communiste français (PCF) ayant rendu sa carte en 2022, Azzedine Taïbi (Stains), un membre du PS ayant fait ses classes au PCF, Karim Bouamrane (Saint-Ouen), et deux maires ayant conduit des listes citoyennes. L’un, Mohamed Gnabaly (L’Île-Saint-Denis), a depuis rejoint Les Écologistes (ex-EELV) tandis que l’autre, Dieunor Excellent (Villetaneuse), avait préalablement flirté avec le Parti radical de gauche (PRG) et le PS et continue de collaborer avec les élu·es de ces partis au sein de l’intercommunalité. Les deux maires de droite racisés élus en 2020 avaient été investis par Les Républicains (LR) où ils avaient fait leurs classes. Pour autant, l’un, Rolin Cranoly (Gagny), a quitté ce parti en 2024 ne se reconnaissant pas dans l’alliance avec le Rassemblement national (RN) préconisée par son président d’alors, tandis que l’autre, Zartoshte Bakhtiary (Neuilly-sur-Marne), a conduit au dernier scrutin municipal une liste d’union du centre.

Des prédécesseurs déjà confrontés au racisme

La charge raciste contre Bally Bakayoko, maire de Saint-Denis, a été particulièrement violente ; elle est couplée avec un mépris de classe et une stigmatisation des banlieues populaires. Azzedine Taïbi faisait déjà état du climat islamophobe qui avait marqué sa campagne en 2014. Dieunor Excellent racontait que des bruits courraient sur son usage de la sorcellerie lors de son élection en 2020. Tous deux ont reçu plusieurs fois menaces et insultes qui les ont conduits à porter plainte. Meriem Derkaoui, qui a succédé au maire communiste d’Aubervilliers en cours de mandat en 2016, a été confrontée au doute instillé par les médias, quand le Parisien, par exemple, titre « Madame la Maire franco-algérienne… réintégrée », à propos d’une procédure qui s’est déroulée vingt ans auparavant.

Le scénario se reproduit et se durcit au fur et à mesure que des personnes racisées arrivent en responsabilité. À cela s’ajoutent toutes les expressions d’un racisme ordinaire que rencontrent nombre d’élu·es à l’instar de cette maire adjointe :

« Ah, c’est subtil, c’est très subtil. Au début, on doute en [se] disant que ce n’est pas possible. Au début, on écorche votre nom, puis on vous demande de le répéter ; quand vous dites une phrase, on vous demande de la répéter deux ou trois fois ; c’est de venir vous voir et vous demander si vous faites le ramadan. »

Ou de cette autre élue :

« J’arrive dans des services où des [personnes] ont fait des bacs plus dix, ou plus sept, la petite Noire qui arrive, qui est leur cheffe, parfois peut-être c’était compliqué pour certains d’accepter. »

L’élection de ces nouvelles et nouveaux maires représente un pas important vers une représentation politique dans laquelle les habitant·es des quartiers populaires puissent se reconnaître.

Mais le déferlement de réactions racistes aux relents colonialistes témoigne aussi à rebours de la prégnance des discriminations raciales, de classe et de genre, des rapports de domination qui structurent la représentation politique et, au-delà, la société française. Ces nouveaux et nouvelles maires ont contribué à ouvrir la porte de la représentation, à ouvrir de nouveaux imaginaires et possibles politiques. Les laissera-t-on remplir la charge qui leur a été confiée par les électeurs et électrices ?

La pression médiatique et politique à laquelle ils et elles sont confronté·es, les procès en légitimité et en communautarisme, les inévitables rapports de force à venir quand ils voudront appliquer leurs programmes représentent un véritable défi démocratique auquel certain·es de leurs prédécesseurs élu·es en 2020 ont déjà dû faire face. Cette dynamique d’ouverture et de reconnaissance, pour se consolider, restera à confirmer et à amplifier au cours des prochaines échéances électorales, locales, mais aussi nationales.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

08.04.2026 à 17:41

Robert F. Kennedy Jr et l’art politique de la fabrique du doute

Fatima-Zahra Aklalouch, Associate Professor, Université Paris Cité

Texte intégral (1865 mots)

Le 9 septembre 2025, Robert F. Kennedy Jr, ministre de la santé de Donald Trump, publiait la stratégie MAHA (Make America Healty Again) : « Rendre sa santé à l’Amérique. » Pourtant, sa rhétorique semble exprimer autre chose : celle du maintien d’un doute permanent.

Robert F. Kennedy Jr n’est pas seulement un homme politique controversé. C’est une personnalité qui a su transformer le scepticisme en véritable identité politique et qui a appris à se servir du discours de la transparence comme arme de doute envers la santé publique elle-même.

Son ascension jusqu’au poste élevé qu’il occupe aujourd’hui n’est pas qu’une histoire de dénonciation du principe de la vaccination. Elle est celle d’une production du doute : phrase après phrase, métaphore après métaphore, jusqu’à ce que l’incertitude s’immisce dans le quotidien.

La biographie de Kennedy commence par une autorité héritée. Né en 1954, il est le neveu de John F. Kennedy et le fils de Robert F. Kennedy. Aujourd’hui, il porte un nom qui résonne encore avec l’idéalisme américain. Pourtant, comme le souligne le Monde, son nom à lui est progressivement devenu associé à un activisme teinté de théories complotistes et au vaccinoscepticisme – une fusion délicate entre dynastie et dissidence.

Pendant des décennies, la carrière publique de Kennedy ne s’est pas centrée sur la médecine mais sur l’environnement. C’est en exerçant les fonctions d’avocat et de militant écologiste qu’il s’est forgé une crédibilité, luttant contre les entreprises polluantes et poursuivant en justice des entreprises industrielles accusées d’empoisonner les rivières et les communautés.

Cette période de sa vie est importante aujourd’hui car elle fournit le cadre moral qui continue aujourd’hui de façonner son discours : les industries puissantes oppressent les innocents, les autorités de régulation échouent, et le justicier, seul, expose la vérité.

Problème : Kennedy semble avoir repris ce modèle – propre à l’environnement – pour l’appliquer au domaine de la santé publique. Selon lui, les vaccins sont moins des outils médicaux que des symboles d’une corruption institutionnelle.

La fabrique d’une rhétorique

C’est au milieu des années 2000 que Kennedy commence à promouvoir des idées remettant en cause l’innocuité des vaccins. En 2016, il cofonde l’une des organisations antivax les plus influentes du pays : le World Mercury Project, devenu en septembre 2018 Children’s Health Defense, dont il sera ensuite le « chairman » (président du conseil).

Certains fact-checkers relèvent par ailleurs qu’il établit souvent des liens entre l’autisme et les vaccins, alors même que l’inexistence de ces liens a été démontrée scientifiquement.

Langage du doute : lire entre les lignes

Mais ce qui singularise Kennedy est avant tout sa méthode rhétorique. En effet, il se présente rarement comme un antivax. Au contraire, il modère ses discours par des mots bien choisis, qui lui offrent une sorte de « bouclier linguistique ».

« Je suis pour la sécurité sanitaire. Je ne suis pas anti-vaccin… tous mes enfants sont vaccinés. »

Cette affirmation n’est pas fortuite. Elle est stratégique. En rejetant cette étiquette tout en entretenant le soupçon, Kennedy donne l’impression que le doute est raisonnable, voire responsable. Il en résulte une banalisation de la méfiance sans qu’il n’ait jamais à en assumer les conséquences.

Lors de la pandémie de Covid-19, cette rhétorique s’est significativement intensifiée. La revue scientifique Nature a qualifié Kennedy d’un des principaux diffuseurs de fausses informations concernant les vaccins, aux États-Unis. De même, le média NPR a analysé la façon dont il a attisé la méfiance envers les institutions de santé publique pendant la crise.

Lors de cette période, son discours se caractérise par une rhétorique populiste constante, opposant les citoyens ordinaires aux élites corrompues. La vaccination n’est plus présentée comme une intervention médicale, mais comme un symbole de coercition. « Soumettez-vous au gouvernement, faites ce qu’on vous dit », dénonce-t-il, déplorant qu’il n’y ait « aucun débat possible ».

Opposer la science à la « quête de la vérité »

Ce discours est politiquement efficace, précisément parce qu’il change la donne. Le débat ne porte plus sur des aspects épidémiologiques, mais sur des concepts comme la liberté, la trahison et l’intégrité morale. La science est présentée non pas comme une méthode mais comme une institution dont il faut se méfier.

Le propos de Kennedy repose sur un minutieux entretien du doute.

« Il n’y a pas de preuve », concède-t-il, avant de faire volte-face : « Nous ne savons pas encore ce qui en est la cause, alors ne devrions-nous pas garder l’esprit ouvert ? » La manœuvre est subtile : le consensus est présenté comme une conclusion hâtive, le scepticisme comme une vertu intellectuelle.

Kennedy va plus loin en redéfinissant la science elle-même. « La science ne dit rien », déclare-t-il. « La science est un débat. » Cette posture épistémique a des conséquences graves : si la science n’est qu’une dispute sans fin, alors aucune preuve ne pourra jamais trancher définitivement un désaccord. Le doute devient, dès lors, structurel.

Pour légitimer sa méfiance, Kennedy s’appuie davantage sur des récits moraux que sur une méthodologie rigoureuse. Il invoque volontiers Francis Kelsey (1914-2015), la scientifique de l’US Food and Drug Administration (FDA) qui s’était opposée à l’autorisation de la thalidomide, et la salue car elle « remettait la science en question ». La suggestion implicite est claire : la voix discordante d’aujourd’hui pourrait être le héros de demain. Mais l’analogie est trompeuse. Remettre en question la négligence réglementaire n’équivaut en aucun cas à remettre en cause des décennies de données sur les vaccins.

Lorsqu’on le contredit directement, Kennedy oppose au consensus scientifique des études « alternatives », promettant que s’il a tort, il « présentera des excuses publiques », insistant sur le fait qu’« il existe également d’autres études encore ». La conclusion est ainsi sans cesse repoussée et la discussion est conçue pour ne jamais aboutir.

Plus significatif encore, la rhétorique de Kennedy a commencé à remodeler les institutions elles-mêmes après son arrivée au ministère de la Santé. Des législateurs l’ont accusé de déstabiliser la gouvernance vaccinale après qu’il eut limogé les 17 membres d’un important comité consultatif, qualifiant cette décision d’inédite et d’irresponsable.

L’Association états-unienne de santé publique a averti que ses antécédents témoignaient d’un net penchant pour la désinformation et d’un manque de rigueur scientifique. La revue médicale The Lancet est allée plus loin, affirmant que son influence pourrait accroître la réticence mondiale à la vaccination, citant l’épidémie de rougeole aux îles Samoa comme un exemple tragique d’une méfiance amplifiée jusqu’à la catastrophe.

Kennedy n’agit pas seul. Il est porté par tout un écosystème qui le présente comme un défenseur persécuté de la vérité. Le rapport que lui a consacré la sénatrice démocrate Elizabeth Warren décrit par ailleurs son leadership comme la mise en œuvre d’une stratégie de déstabilisation anti-vaccinale. Ce qui en ressort n’est pas simplement un scepticisme individuel, mais un mouvement dont la méfiance est le fondement et où l’exigence de transparence devient une arme politique.

La vraie question que RFK Jr impose à la vie publique n’est pas de savoir si les vaccins sont sûrs – une question maintes fois tranchée par des preuves scientifiques – mais si les sociétés démocratiques peuvent survivre à l’érosion délibérée d’une réalité commune.

Un dissident de la santé publique

À un certain point, le sujet dépasse la simple personne du ministre de la santé, et interroge la culture qui permet à de telles affirmations de prospérer.

Comment le doute devient-il une identité ? Comment la remise en question se transforme-t-elle en une forme de pouvoir ?

Et que se passe-t-il lorsque le langage de la science devient un champ de bataille plutôt qu’une méthode ?

Dans un tel monde, la science cesse de fonctionner comme un outil commun d’établissement des faits. Elle devient au contraire un terrain de joute rhétorique : des acteurs rivaux revendiquent l’autorité de la science, chacun présentant sa propre version de celle-ci. Il en résulte non pas de la clarté, mais un conflit permanent, où le mot lui-même devient une arme dans la lutte pour savoir qui a le droit de définir la réalité.

Si Kennedy a commencé sa carrière comme militant écologiste, il est devenu un dissident de la santé publique. Désormais, il est quelque chose de plus inquiétant : un acteur politique dont l’influence ne réside pas dans la résolution de l’incertitude, mais dans son maintien.

La question la plus urgente n’est peut-être pas ce que croit Robert F. Kennedy Jr C’est ce que sa rhétorique rend possible.

Fatima-Zahra Aklalouch ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

08.04.2026 à 17:41

La contamination chimique des cires d’abeille, un problème sanitaire qui passe sous les radars

Julie Chiron, Chef de projet évaluation des risques liés à la santé, l'alimentation et au bien-être des animaux, Agence nationale de sécurité sanitaire de l’alimentation, de l’environnement et du travail (Anses)

Texte intégral (3170 mots)

Substance clé de la ruche, la cire agit aussi comme piège à polluants, ce qui pourrait menacer la santé des abeilles. Une expertise de l’Agence nationale de sécurité sanitaire, ou Anses, montre que la quasi-totalité des cires présente des contaminations chimiques, avec des niveaux plus élevés dans les circuits commerciaux que chez les apiculteurs qui recyclent leur propre cire d’une année à l’autre.

On le sait : la pérennité des écosystèmes dépend de la santé des pollinisateurs. Les abeilles en sont les représentantes emblématiques, leur déclin suscite l’inquiétude de la société et de la communauté scientifique. En cause, l’évolution des paysages, l’usage de produits chimiques en agriculture et en apiculture, notamment antiparasitaires pour lutter contre l’acarien Varroa destructor.

Or, la cire produite par les abeilles, substance de nature lipophile (c’est-à-dire présentant une affinité chimique pour les graisses), fixe et diffuse les substances chimiques contaminantes. En ce sens, elle peut constituer un biomarqueur de la contamination environnementale de la colonie d’abeilles.

Les jeunes abeilles produisent naturellement de la cire, mais le coût énergétique de sa fabrication peut diminuer la quantité de miel produit. L’ajout de cire dans la ruche leur donne un coup de pouce précieux pour édifier les alvéoles. Pour cela, les apiculteurs disposent chaque année sur les cadres de la ruche des feuilles de cire gaufrée, qui servent alors de base aux abeilles ouvrières.

Pour des raisons économiques, ces feuilles sont généralement produites à partir de cire recyclée : les cires sont collectées en même temps que la récolte de miel, fondues puis réutilisées. Ce recyclage peut entraîner l’accumulation progressive de contaminants chimiques susceptibles d’être nocifs pour les abeilles.

Les bonnes pratiques apicoles de l’Institut de l’abeille et de la pollinisation (Itsap) préconisent que seuls les opercules de cire (les pellicules de cire utilisées pour fermer les alvéoles) produits dans l’année par les abeilles soient recyclés, mais la cire étant un produit rare, certains apiculteurs s’approvisionnent auprès de fournisseurs tiers.

Pour mieux comprendre l’ampleur du problème, l’Agence nationale de sécurité sanitaire (Anses) a récemment mené une expertise pour dresser l’état des lieux des contaminants chimiques présents dans les cires utilisées en apiculture, en France hexagonale.

Pas de contrôle des cires importées, faute de définition réglementaire

La France importe ainsi environ 1 000 tonnes de cire par an, essentiellement de Chine. Or, en raison de l’absence de définition réglementaire de la cire d’abeille à usage apicole, il n’existe pas de contrôle spécifique pour ce produit, en dehors des contrôles documentaires classiques (portant sur l’exactitude, l’exhaustivité et la validité des déclarations en douane) effectués en postes frontières.

L’exposition chronique, par la cire, du couvain et des abeilles aux contaminants qu’elle contient, est susceptible d’avoir un impact sur leur développement, leur santé et leur survie. Et cela, à tous les stades de développement (larves, nymphes et adultes), ce qui peut menacer la santé de la colonie entière.

Il n’existait, jusqu’alors, aucun état des lieux de la contamination des cires en France ni d’évaluation chiffrée du risque posé pour la santé des abeilles.

À lire aussi : Pourquoi l’abeille est-elle devenue le symbole de la lutte contre les pesticides ?

Les contaminations chimiques découvertes

Dans le but de mieux connaître l’état des contaminations des différents types de cires en France, deux études de terrain successives ont été conduites, en plus d’une revue de la bibliographie.

La première a été menée auprès des apiculteurs professionnels (étude CIMEQA) et la seconde (une convention de recherche-développement, ou CRD, cosignée par l’Itsap et l’Anses), auprès des apiculteurs de loisir.

En effet, ces deux groupes n’ont pas les mêmes pratiques :

Les apiculteurs professionnels (possédant plus de 150 ruches) sont majoritairement autosuffisants en cire : leur rucher leur en procure suffisamment pour qu’ils puissent la recycler et fournir la quantité nécessaire au renouvellement des cadres de leurs ruches. En apportant leur production annuelle au cirier (industriel ou artisan préparant la cire ou des produits en cire), ils peuvent récupérer les feuilles de cire gaufrée issues du recyclage de leur propre cire.

Les apiculteurs de loisir (possédant moins de 150 ruches) ne sont généralement pas autosuffisants. Différents circuits de recyclage et d’achats de cire s’offrent à eux : les ciriers, les collectifs d’apiculteurs, les enseignes spécialisées en apiculture et, enfin, les enseignes non spécialisées (type magasin de jardinage-bricolage).

Il en ressort que la quasi-totalité des échantillons analysés est contaminée, quelle que soit la population d’apiculteurs étudiée.

En comparaison des cires qu’emploient les apiculteurs professionnels, les cires distribuées dans le commerce présentent des niveaux de contamination supérieurs. Il apparaît toutefois que les contaminants les plus fréquemment retrouvés dans ces deux catégories de cires sont globalement les mêmes : le tau-fluvalinate, le coumaphos, le propargite et le piperonyl butoxide (PBO).

Il s’agit de résidus de produits phytopharmaceutiques, de médicaments vétérinaires, de biocides et d’éléments traces métalliques, qui sont d’origine environnementale ou apicole. Dans le second cas, ils sont souvent liés à la lutte contre l’acarien Varroa destructor.

Ces analyses confirment des fréquences d’occurrence importantes des médicaments vétérinaires, actuellement ou auparavant autorisés (tau-fluvalinate, coumaphos, thymol pour la seule étude l’ayant recherché, métabolites de l’amitraze, fluméthrine).

D’autres résultats étaient moins prévisibles, comme la présence de pyréthrinoïdes (utilisés comme insecticides, notamment en agriculture), des composés organophosphorés ou organochlorés, qui sont des polluants organiques persistants. Parmi les substances les plus préoccupantes, des pyréthrinoïdes ont été retrouvés dans plus de 40 % des échantillons des cires gaufrées commercialisées.

Les cires vendues par les enseignes généralistes sont davantage à risque

L’Anses a ensuite calculé le risque pour les abeilles à partir des DL50 (c’est-à-dire une dose provoquant 50 % de mortalité pour les populations d’abeilles) de chacune des substances chimiques identifiées dans les échantillons et dans les concentrations où elles y ont été retrouvées. Plus la DL50 est faible, plus la substance est toxique.

L’outil en ligne BeeToxWax, développé par l’Université de Liège, a été utilisé. Il permet de calculer instantanément un quotient de risque (QR) qualifiant la toxicité de la cire et sa possible réutilisation en apiculture en fonction de seuils définis dans la littérature scientifique.

Les seuils étaient les suivants :

QR < 250 : risque chimique jugé acceptable, cire considérée comme étant de bonne qualité pour l’apiculture ;

250 < QR < 5 000 : toxicité significative, la cire est classée comme étant de qualité intermédiaire pour l’apiculture ;

QR > 5 000 : toxicité élevée, la cire est considérée comme étant de mauvaise qualité pour l’apiculture.

Verdict ? Les résultats obtenus sont plus favorables pour les cires issues de l’autorenouvellement des apiculteurs professionnels. Seuls 4,5 % des échantillons issus de cet autorenouvellement présentaient un score de QR supérieur à 5 000.En revanche, les cires du commerce dépassent ce seuil pour 38,8 % des échantillons étudiés.

Au final, les cires les moins contaminées sont retrouvées essentiellement parmi les cires des apiculteurs professionnels : dans ce groupe, 81 % des cires ont un score de QR inférieur à 250, contre 30 % des cires provenant de l’étude CRD (apiculeurs de loisir).

Pour les différentes voies d’approvisionnement, enfin, les meilleurs résultats ont été obtenus pour les cires provenant des groupements d’apiculteurs, puis des ciriers. Les cires issues des enseignes spécialisées et surtout celles des généralistes obtiennent le moins bon score.

À lire aussi : Abeilles à miel : comment les humains ont bouleversé leur histoire et leur diversité

De l’importance des bonnes pratiques apicoles

Ainsi, la qualité toxicologique d’une cire est en partie liée à son circuit d’approvisionnement et à son origine géographique.

La cire utilisée par les apiculteurs autosuffisants est de bien meilleure qualité que celle du commerce. De même, les cires labellisées AB présentent une meilleure qualité que les cires conventionnelles. Enfin, les feuilles de cire gaufrées confectionnées exclusivement à partir d’opercules sont de meilleure qualité que les feuilles confectionnées à partir de mélanges contenant toutes les cires de cadres et/ou d’origines diverses.

La part de risque attribuable aux médicaments apicoles rappelle l’importance du respect des bonnes pratiques en termes d’application et de posologie. La fluméthrine (pyréthrinoïde), acaricide autorisé pour lutter contre le varroa qui parasite les abeilles, doit faire l’objet d’une attention particulière quant aux doses d’application. En cas de dépassement, une dégradation exponentielle de la qualité de la cire s’ensuit, et cela d’autant plus en association avec le PBO, qui augmente l’activité insecticide de cette molécule, que l’on retrouve dans 77,6 % des échantillons analysés chez les apiculteurs de loisir.

Même en retirant la part de risque liée aux médicaments vétérinaires, la qualité toxicologique des cires reste dégradée. Les substances présentant les parts de risque le plus élevé sont, pour les deux études, des pyréthrinoïdes. Là aussi, la présence du PBO augmente leur activité insecticide et augmente le risque chimique. Or, les connaissances et les outils disponibles aujourd’hui ne permettent pas d’évaluer de telles synergies.

De nombreux contaminants sont présents dans les cires alors qu’ils ne sont plus – ou n’ont jamais été autorisés – en Europe. Le maintien de leurs usages dans certains pays tiers, voire leurs usages détournés et mésusages en France ou ailleurs dans le monde, rappelle la nécessité de contrôler efficacement la provenance et la qualité des cires disponibles sur le marché français. Les enquêtes conduites ont démontré la meilleure qualité des cires d’origine française contre celles d’origine UE ou hors UE.

La conservation des molécules dans la cire recyclée nécessite de remettre dans le circuit des cires de la meilleure qualité possible. Pour cela, l’apiculteur est le premier intervenant à agir par l’application des bonnes pratiques apicoles et la surveillance régulière et attentive de ses colonies. Le rapport d’expertise de l’Anses compte de nombreuses recommandations à destination de tous les acteurs de la filière apicole, et en premier lieu des apiculteurs.

L’autrice de ce texte adresse ses remerciements au groupe de travail Cires de l’Anses : Carole Peroz (présidente du groupe de travail), Lionel Grisot (vice-président), Frédéric Delbac, Yves Le Conte, Monique L’Hostis, Anne-Claire Martel, Freddie-Jeanne Richard, Christophe Roy, Claude Saegerman et Cyril Vidau ainsi qu’à Caroline Boudergue (adjointe à la cheffe d’unité Anses).

Julie Chiron ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

08.04.2026 à 17:40

Se conformer aux normes de genre, ça commence dès le plus jeune âge

Adam Stanaland, Assistant Professor of Psychology, University of Richmond

Andrea Vial, Assistant Professor of Psychology, New York University Abu Dhabi

Texte intégral (1745 mots)

Très tôt sensibles aux normes de genre, les enfants ne se contentent pas d’en être des observateurs, ils les intériorisent. Comment cela se manifeste-t-il ? Et comment cela évolue-t-il avec l’âge ?

Beaucoup de personnes ont déjà ressenti cette pression subtile qui les pousse à vouloir paraître « assez viriles » ou « assez féminines » aux yeux des autres. Des études ont démontré que cette pression peut avoir des conséquences tant sur le plan personnel que social.

Lorsque les hommes ont le sentiment que leur virilité est mise en question, ils peuvent réagir par des comportements agressifs et nuisibles. Lorsque les femmes s’écartent des stéréotypes de la féminité – ou même lorsqu’elles envisagent simplement de le faire –, elles subissent souvent des réactions négatives.

En tant que chercheurs étudiant la manière dont les stéréotypes et les normes de genre affectent les individus, de façon souvent inattendue, nous nous sommes interrogés sur les processus qui poussent les enfants à se conformer à ces normes stéréotypées. Quand cela commence-t-il, et de quelle manière cela peut-il se manifester ?

Dans une étude récemment publiée, menée avec notre collègue Andrei Cimpian, nous avons constaté que, lorsque les enfants perçoivent que leur sentiment d’appartenance en tant que « membre à part entière » d’un groupe de genre est menacé, ils se sentent poussés à se conformer à des rôles de genre, avec des conséquences durables.

Les questions des filles et celles des garçons

En nous inspirant de recherches menées auprès d’adultes, nous avons estimé que la meilleure façon d’évaluer la motivation des enfants à se conformer aux normes de genre consistait à remettre en question leur statut de membre « représentatif » de leur groupe de genre.

Pour ce faire, nous avons demandé à 147 enfants, âgés de 5 à 10 ans, à New York, de jouer à deux jeux, un « jeu de questions pour filles » et un « jeu de questions pour garçons ». Chacun comportait des questions difficiles sur des sujets stéréotypés selon le genre, telles que « Laquelle de ces fleurs est un coquelicot ? » (Jeu des questions pour filles) et « Laquelle de ces équipes de football a été championne en 2016 ? » (Jeu des questions pour garçons).

Nous avons réparti les enfants de manière aléatoire pour qu’ils reçoivent des commentaires suggérant que leurs performances étaient soit conformes aux stéréotypes de genre, soit atypiques par rapport à ceux-ci, cette dernière catégorie constituant notre version d’une menace pesant sur leur conformité de genre. Par exemple, un garçon placé dans cette condition de menace recevait un commentaire indiquant qu’il avait brillé au « Jeu des questions pour filles », mais qu’il avait échoué au « Jeu des questions pour garçons ».

Nous avons ensuite évalué comment ils réagissaient à ce retour d’information. Le garçon allait-il partager publiquement ou cacher sa réussite dans un « Livre des gagnants du Jeu des questions pour filles » ? Allait-il porter fièrement un autocollant « Gagnant du Jeu des questions pour filles », ou préférait-il changer d’autocollant ? Allait-il s’inquiéter de ce que ses camarades allaient penser ?

Quelles réponses aux menaces sur la conformité aux normes de genre ?

Nous avons identifié trois façons distinctes dont les enfants réagissaient face à des menaces pesant sur leur conformité de genre.

Tout d’abord, les filles et les garçons de tous âges sont particulièrement préoccupés par le fait de ne pas s’intégrer à leur groupe de genre. Cela signifie qu’ils s’attendent à davantage de rejet de la part de leurs pairs et manifestent une faible estime de soi.

Deuxièmement, certains enfants s’efforcent de montrer activement qu’ils s’intègrent dans leur groupe de genre. Les plus jeunes filles accentuent leur féminité, tandis que les garçons plus âgés accentuent leur masculinité. Par exemple, les garçons plus âgés nous ont dit qu’ils préféraient les figurines d’action aux poupées, ou qu’ils voulaient rejouer au « jeu des questions pour garçons » plutôt qu’au « jeu des questions pour filles ».

Cela va dans le sens de recherches antérieures montrant que de nombreuses jeunes filles sont plongées dans une « culture des princesses » et particulièrement soucieuses de prouver leur féminité, même si cette tendance s’estompe avec l’âge. À l’inverse, les garçons plus âgés apprennent de plus en plus, à mesure qu’ils grandissent, que la masculinité est un statut social précaire qui se gagne difficilement et doit être activement prouvé.

Troisièmement, les garçons de tous âges évitaient de paraître atypiques par rapport à leur groupe de genre, en se distanciant activement de tout ce qui était féminin. Nous n’avons pas observé chez les filles une tendance similaire à se distancier de tout ce qui était masculin.

Cette réaction reflète un double standard culturel aux États-Unis : on encourage souvent les filles à être sportives, à s’affirmer ou à ressembler à des « garçons manqués », alors que les garçons ne disposent pas d’équivalent socialement acceptable ; il n’existe pas de version masculine positive du terme « garçon manqué ». L’expression qui s’en rapproche le plus est « poule mouillée », qui n’est généralement pas considérée comme un compliment.

Aider les enfants à entretenir une relation plus saine avec les normes de genre

Nos résultats montrent que les fondements de cette recherche de conformité de genre à l’âge adulte – y compris certaines de ses manifestations les plus néfastes, telles que certaines formes d’agressivité masculine et certaines angoisses féminines sur les poursuites de carrière dans les domaines dominés par les hommes – se mettent en place dès le plus jeune âge.

Dès l’âge de 5 ans, les garçons repèrent qu’il est préférable pour eux d’éviter les comportements vus comme « féminins ». Vers 7 ans, ils semblent comprendre que la masculinité est un statut qu’il faut activement prouver et défendre, et cette mentalité peut se manifester par de l’agressivité, des violences sexuelles et une réticence à demander de l’aide à l’âge adulte.

Pour les filles, nos résultats suggèrent qu’elles sont motivées à prouver leur féminité de manière stéréotypée dès le plus jeune âge, mais que cela peut s’estomper ensuite. Cela s’explique peut-être par le fait que les filles sont parfois encouragées à se lancer dans des domaines historiquement vus comme « masculins », tels que le sport et les sciences et technologies. Ou bien elles se rendent compte que la masculinité permet aux hommes – et aux garçons – de réussir dans ces domaines, et cherchent donc à s’en rapprocher en s’éloignant de la féminité.

Il est toutefois possible que, dans d’autres contextes, les filles subissent davantage de pression pour incarner la féminité et éviter la masculinité – c’est-à-dire pour se conformer aux stéréotypes féminins – d’une façon que nous n’avons pas pu mettre en évidence dans notre étude. Nous ne comprenons pas non plus pourquoi les réactions des filles face à la perception de menaces sur la conformité de genre pourraient s’atténuer avec l’âge, étant donné que les femmes adultes sont elles aussi affectées par ces menaces. Notre prochain objectif est d’étudier plus en détail comment la conformité de genre se développe dans des contextes géographiques et culturels plus diversifiés, ainsi que chez des enfants aux identités de genre plus variées.

En somme, nous pensons que l’enfance pourrait constituer une période critique pour intervenir. Les programmes qui aident les enfants, en particulier les garçons, à se forger une identité solide qui ne repose pas sur la conformité aux normes pourraient les aider à entretenir une relation plus saine avec les normes de genre. De cette manière, les enfants pourraient être moins enclins à réagir aux menaces perçues envers leur conformité de genre d’une manière qui leur serait préjudiciable à l’âge adulte.

Néanmoins, ce qui est clair, c’est que les enfants ne se contentent pas d’observer les normes de genre : ils les intériorisent, les défendent activement et commencent à le faire plus tôt que ce que l’on pense.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

08.04.2026 à 17:40

Les stratégies de légitimation économique d’une offre culturelle, le cas du Louvre-Lens

Hélène Gorge, Maître de conférences, LUMEN (ULR 4999), Université de Lille, Université de Lille

Melvin Grefils, Docteur en sciences de gestion, Université de Lille

Nil Özçaglar-Toulouse, Professeure des universités, LUMEN (ULR 4999), Université de Lille

Texte intégral (2042 mots)

Les récentes élections municipales ont montré comment les investissements culturels pouvaient être instrumentalisés dans un débat politique ; comme à Lens, dans le Pas-de-Calais. Le Louvre local a été accusé de ne pas profiter suffisamment aux habitants de la ville. Cela pose la question de l’utilité des équipements culturels. Faut-il la mesurer en fonction de considérations économiques, sociales ou culturelles ?

Dans un contexte d’élections municipales tendues, en particulier dans la ville de Lens (Pas-de-Calais), l’offre culturelle proposée dans cette ville a été l’objet de questions. Un article de Télérama interroge notamment la réussite de la revitalisation culturelle annoncée avec l’implantation du musée du Louvre-Lens.

Comme le montre cet article, l’opposition au conseil municipal ne se prive pas de pointer des résultats en demi-teinte pour le Louvre-Lens, en particulier lorsque l’on regarde les chiffres des entrées au musée et la part du public international, moins importante qu’annoncé.

Cependant, il est peu aisé – voire dangereux – de quantifier des résultats d’une offre culturelle, telle qu’un musée, dans une localisation où la population, principalement issue des classes populaires, n’est que peu, voire n’est pas, familière des institutions muséales. Ce phénomène de quantification menace directement un champ culturel déjà en tension et soumis à de nombreuses coupes budgétaires ces dernières années. Cela pourrait encourager une hiérarchisation des acteurs culturels et une potentielle instrumentalisation de la culture.

À lire aussi : Le Centre Pompidou, le musée superstar en équilibre précaire, avant fermeture pour travaux

Deux discours de légitimation

Notre travail sur le processus de légitimation du Louvre-Lens dans la ville de Lens et la région du bassin minier, publié en 2024, montre justement les dynamiques économiques et culturelles de l’implantation du musée. Depuis 2004, début de la médiatisation du projet d’implantation de ce musée, le contexte local exerce une forte influence sur les deux types de légitimation du Louvre-Lens, développés en parallèle par les acteurs médiatiques, politiques, socio-économiques et culturels : une légitimation économique et une légitimation culturelle.

La stratégie de légitimation économique est souvent au cœur des discours, en particulier des acteurs politiques, pour défendre – ou critiquer – un projet d’offre culturelle. Présenté comme un levier de revitalisation économique pour le bassin minier et ses habitants, le musée allait assurer « la survie économique » de la région au début des années 2000 (La Voix du Nord, 21 juillet 2004). Cette stratégie et sa réception sont alors fortement influencées par le contexte local. Les difficultés socio-économiques des habitants accentuent les attentes autour du Louvre-Lens mais également les tensions, avec la crainte d’un investissement trop lourd pour une région qui connaît déjà des difficultés.

Des retombées économiques insuffisantes ?

Quelques années après l’ouverture du musée, à partir du milieu des années 2010, le bilan économique n’a pas tenu toutes ses promesses, ce qui déclenche des critiques dans la sphère médiatique qui pointe « un impact limité sur l’économie locale » (Le Monde, 21 août 2016) et le décalage perçu entre les promesses des acteurs publics et le développement économique réel.

Pour mieux comprendre l’importance de l’argument économique dans les discours sur le Louvre-Lens, les apports du marketing culturel peuvent s’avérer utiles. Dans les années 1990-2000, des travaux sur le concept de la « ville créative » ou sur la théorie de la « classe créative » émergent. Ces travaux supposent que le développement d’activités créatives et culturelles dans une ville génère un développement économique, favorise l’inclusion sociale et améliore les conditions de vie des habitants.

Si ces concepts ont séduit les décideurs politiques, de nombreux travaux scientifiques les ont critiqués, en particulier pour le flou relatif à leur application concrète. De plus, une grande majorité des [travaux] supportant l’argument économique se base toujours sur le même exemple de revitalisation culturelle, celui du musée Guggenheim à Bilbao, grandement médiatisé et repris dans les discours politiques comme un modèle à suivre.

Le poids du contexte

Mais ce modèle ne s’exporte pas facilement, tant les spécificités propres à chaque territoire, leurs contextes historique, politique, social, économique, spatial ou encore culturel sont cruciaux pour mieux appréhender le développement d’une offre culturelle locale.

En parallèle de ce processus de légitimation économique particulièrement mobilisé par des acteurs politiques, économiques et médiatiques, la légitimation culturelle s’inscrit plutôt dans un objectif de démocratisation culturelle, afin d’encourager l’appropriation du Louvre-Lens par les habitants. Dès le début du projet de développement du musée, le Louvre-Lens est représenté comme une compensation pour une ville et une région souvent délaissée par les pouvoirs publics depuis la désindustrialisation. Ainsi, Guy Delcourt, maire socialiste de la ville et vice-président du conseil général du Pas-de-Calais, estimait que le choix du gouvernement annoncé le 29 novembre par le premier ministre lors d’une visite dans la ville n’est que justice pour un département qui a « toujours été oublié sur le bord de la route, y compris par nos amis du Nord ».

Des traces matérielles du passé préservées

La dimension symbolique de cette implantation, en lien avec le passé minier du territoire, est renforcée par sa dimension spatiale. Qu’il s’agisse de son lieu d’implantation (un ancien carreau de fosse) ou des traces matérielles préservées et valorisées (signalisation de l’ancien puits de mine, conservation de la trace des anciens rails qui servaient au transport du charbon).

La dimension spatiale d’un musée influence significativement ses représentations et sa fréquentation. Dans ce cadre, les travaux en marketing culturel et en urbanisme décrivent souvent une architecture de musée qui serait conçue et pensée par des acteurs publics et des architectes à des fins de développement touristique sans réelles considérations ou implication des habitants, freinant ainsi leur fréquentation et les efforts de démocratisation culturelle. Cependant, dans le cas du Louvre-Lens, sa dimension spatiale a contribué à inscrire le musée dans une histoire et une identité commune, celle du bassin minier.

À la suite de l’ouverture du musée, sa légitimation culturelle s’est renforcée grâce aux différentes actions développées par le Louvre-Lens, telles que des expositions sur le RC Lens, le club de football local, sur la Pologne faisant écho à l’importante communauté polonaise sur le territoire, ou encore à travers la mise en place de cartels conçus avec plus de 200 habitants pour encourager la démarche collaborative.

Les associations locales mobilisées

Ces actions favorisent la collaboration des habitants et des associations locales, répondant à l’objectif d’ancrage territorial du Louvre-Lens. Cette légitimation culturelle est finalement assez peu remise en cause dans les discours médiatiques et par les habitants, qui sont de plus en plus nombreux à visiter le Louvre-Lens chaque année. En 2024, selon le rapport d’activité du Louvre-Lens, 74 % des visiteurs viennent des Hauts-de-France et 30 % résident aux alentours du musée, une proportion en augmentation ces dernières années (28 % en 2023 et 25 % en 2022). À titre de comparaison, selon le rapport d’activité du Mucem en 2024, 39 % de leurs visiteurs viennent de la région Sud, et 28 % résident à Marseille.

Dans le processus de légitimation du Louvre-Lens, si la légitimation culturelle a tendance à être reléguée au second plan par certains acteurs : médiatiques, politiques en particulier, elle s’avère être en réalité au cœur de la réussite actuelle du musée auprès de la population locale, et donc du développement du territoire.

En effet, l’analyse des discours médiatiques autour du Louvre-Lens montre que sa légitimation économique a été plus fortement discutée au commencement du projet dans les années 2000, puis à l’inauguration du musée en 2012. Elle est ensuite de moins en moins questionnée au fil des années, au profit de discours représentant le Louvre-Lens comme une réussite culturelle, acceptée et légitime. Cependant, l’argument économique ressurgit régulièrement, à des moments de forts enjeux politiques, comme en témoigne récemment le contexte actuel des municipales.

Clarifier les retombées

Les discours médiatiques et politiques contribuent à alimenter les tensions en omettant des éléments essentiels à la pleine compréhension des retombées économiques, rendant l’argument économique peu clair. Le Louvre-Lens a fêté ses 13 ans en fin d’année 2025 ; si cela représente une durée relativement courte à l’échelle d’un musée, il n’en va pas de même à l’échelle des habitants. La temporalité des retombées économiques doit être prise en compte et communiquée à la population locale afin d’éviter toute ambiguïté sur le temps nécessaire au développement économique.

La revitalisation des territoires doit être approchée de manière nuancée, car les enjeux économiques et sociaux n’affectent pas tous les acteurs de la même manière. Les acteurs privés et les investisseurs immobiliers sont les premiers à bénéficier des retombées économiques, puis, dans une moindre mesure, les habitants. Il est donc essentiel de clarifier comment l’ensemble des acteurs bénéficie du développement économique du territoire, qu’il s’agisse de la population locale, du tissu associatif ou encore des entreprises privées.

La même approche s’applique aux espaces géographiques. Par exemple, les infrastructures développées autour du Louvre-Lens, telles que le parc du musée, la Louvre-Lens Vallée ou la rénovation des accès routiers, ont un impact beaucoup plus direct sur les quartiers aux alentours du musée que sur les quartiers les plus éloignés, pouvant créer des tensions au sein de la population ou une forme d’incompréhension envers ce type d’investissements.

La thèse de Melvin Grefils a été cofinancée par l'université de Lille (50%) et le conseil régional Hauts-de-France (50%). Ce travail a également bénéficié d'une convention de collaboration avec le musée du Louvre-Lens.

Hélène Gorge et Nil Özçaglar-Toulouse ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

08.04.2026 à 17:37

Quand Internet sauve un musée : l’exemple du Musée des tissus de Lyon

Damien Chaney, Professor, EM Normandie

Déborah Philippe, Professeure de stratégie et durabilité, Université de Lausanne

Texte intégral (1673 mots)

Signer une pétition, relayer un message, partager une image : ces gestes ordinaires peuvent-ils infléchir le destin d’une institution culturelle menacée de fermeture ? À l’heure des réseaux sociaux, certaines mobilisations dépassent leur ancrage local pour toucher des publics inattendus. Mais qu’est-ce qui transforme une indignation diffuse en véritable levier d’action collective ?

En 2015, un musée prestigieux situé au cœur de Lyon (Rhône) est menacé de fermeture. Le Musée des tissus et des arts décoratifs, qui abrite l’une des plus importantes collections textiles du monde, risque de disparaître faute de financements. Deux ans plus tard, il est finalement sauvé. Entre-temps, une mobilisation citoyenne inattendue s’est développée, largement portée par Internet.

Cet épisode illustre une transformation des formes d’engagement autour du patrimoine. Comment une mobilisation née en ligne peut-elle contribuer à préserver un site culturel ? Et que révèle ce cas sur les nouvelles dynamiques de militantisme dans le domaine du patrimoine ? Nous avons mené une étude pour tenter de répondre à ces questions.

Un musée au cœur de l’histoire lyonnaise

Le Musée des tissus est intimement lié à l’histoire économique et culturelle de Lyon. Au XVIIIᵉ siècle, la ville devient l’un des principaux centres mondiaux de la production de soie. Les célèbres canuts, les ouvriers tisserands lyonnais, jouent alors un rôle central dans cette industrie. Créé au XIXᵉ siècle, le musée conserve et met en valeur le patrimoine textile, en retraçant l’histoire des savoir-faire liés aux étoffes.

Ses collections rassemblent aujourd’hui plus de deux millions de pièces textiles couvrant près de 4 500 ans d’histoire, provenant de nombreuses régions du monde. Tissus anciens, vêtements, échantillons industriels ou créations contemporaines témoignent de l’évolution des techniques et des styles à travers les siècles. Grâce à cette richesse patrimoniale, le musée attire à la fois des chercheurs, des professionnels du textile et des visiteurs intéressés par l’histoire des arts décoratifs.

Menace de fermeture et mobilisation en ligne

Au début des années 2010, l’équilibre financier du musée devient fragile. L’institution est gérée par la chambre de commerce et d’industrie de Lyon, qui subit alors une baisse importante de ses ressources. Cette situation conduit l’organisme à envisager l’arrêt du financement du musée. Plusieurs scénarios sont étudiés pour assurer la pérennité du site : transfert de la gestion à la Ville de Lyon, au ministère de la culture ou encore à d’autres institutions culturelles. Mais aucune solution ne se concrétise rapidement. Progressivement, l’hypothèse d’une fermeture devient de plus en plus probable.