13.12.2025 à 17:12

« Un an après le cyclone Chido, la situation de Mayotte reste critique »

Fahad Idaroussi Tsimanda, Géographe, chercheur associé au LAGAM, Université de Montpellier

Texte intégral (1672 mots)

Le cyclone Chido a ravagé le département français de Mayotte le 14 décembre 2024. Si l’État est intervenu massivement pour traiter l’urgence, les promesses de reconstruction structurelles semblent loin d’avoir été tenues. Entretien avec le géographe mahorais Fahad Idaroussi Tsimanda.

The Conversation : Un an après Chido, où en est la reconstruction ?

Fahad Idaroussi Tsimanda : Le 14 décembre 2024, le cyclone Chido a frappé Mayotte et endommagé 80 % du territoire mahorais (près de 60 % de l’habitat aurait été détérioré ou totalement détruit, mais aussi de nombreuses infrastructures, des territoires agricoles et naturels). Il s’agissait d’une catastrophe humanitaire majeure, malgré un bilan officiel limité à 40 morts et 41 disparus. Rapidement, l’État a mobilisé de forts moyens d’urgence après avoir déclaré l’état de calamité naturelle exceptionnelle. Sur place, plus de 4 000 personnels de la sécurité civile, de la police, de la gendarmerie et des armées ont été déployés. De l’aide humanitaire a été distribuée massivement – packs d’eau, patates, bananes, farine, huile, etc. La remise en état des routes et des principaux réseaux d’eau potable et d’électricité ont été effectifs au bout d’un mois environ.

Une forte mobilisation politique a également eu lieu dans le courant de l’année 2025. Pour formaliser et encadrer la reconstruction de l’île, le gouvernement a adopté une loi d’urgence en février 2025, puis une loi pour la refondation de Mayotte, fixant une trajectoire d’investissement de 4 milliards d’euros sur plusieurs années. Ces textes ont été complétés par des ordonnances visant à accélérer la reconstruction, notamment en adaptant temporairement les règles de construction pour faciliter la reconstruction des logements détruits.

Pourtant, notre constat est que, au-delà de l’urgence, la reconstruction structurelle n’a toujours pas eu lieu et la situation demeure critique sur place. Nous sommes encore très loin de ce que les Mahorais attendaient. Selon les chiffres de la députée Estelle Youssouffa, très peu d’argent a été dépensé : 25 millions d’euros seulement depuis le début de l’année, soit environ 0,6 % de l’enveloppe totale promise de 4 milliards d’euros.

J’ai pu constater que, dans le chef-lieu, Mamoudzou, plusieurs bâtiments publics (ceux du Département de Mayotte, la mairie, le commissariat, ceux de l’intercommunalité, etc.) sont toujours couverts de bâches. Au centre hospitalier de Mayotte, des travaux de toiture sont en cours, mais l’essentiel a en revanche été réalisé.

Pour ce qui concerne les particuliers, un prêt à taux zéro de reconstruction a été a été promis aux Mahorais, aux ménages sinistrés avec une enveloppe de 50 000 euros. Mais je ne connais personne autour de moi qui en ait bénéficié. Certains habitants ont déjà reconstruit, certains démarrent à peine leurs chantiers.

Je suis enseignant, et je constate que la situation des écoles est toujours très dégradée, avec beaucoup de salles de classe indisponibles ce qui conduit à charger les effectifs pour chaque classe. On estime que 40 % des établissements scolaires ont été détruits ou endommagés pendant le cyclone. Les classes fermées contraignent les élèves à un nombre d’heures de cours limités avec un système de rotation.

Les bidonvilles ont été ravagés par Chido. Que s’est-il passé dans ces quartiers depuis un an ? François Bayrou, le premier ministre de l’époque, s’était engagé à bloquer leur reconstruction. Est-ce le cas ?

F. I. T. : Dès le lendemain du passage de Chido, les familles de migrants vivant dans les bidonvilles ont reconstruit leurs maisons. Le préfet de Mayotte a interdit aux particuliers d’acheter des tôles s’ils ne pouvaient pas présenter de justificatif de domicile, afin d’empêcher la reconstruction de bidonvilles. Pourtant, il fut très facile de contourner cela avec le justificatif d’un voisin. Ceux qui avaient les moyens ont acheté des tôles et des chevrons. D’autres ont réutilisé les tôles déformées et ont débité des cocotiers tombés à terre pour les structures.

Imaginer reconstruire en dur dans ces quartiers est un leurre. Les personnes qui habitent dans les bidonvilles sont souvent en situation irrégulière, elles n’ont pas droit au logements sociaux qui sont de toute façon en nombre insuffisant. Quelle autre option est possible ? Selon les statistiques officielles, avant Chido, il existait environ neuf logements sociaux pour 1 000 habitants, ce qui est extrêmement faible. Or 40 % des logements sont en tôle à Mayotte et 77 % des habitants vivent sous le seuil de pauvreté national. Les bidonvilles, reconstruits à l’identique, sont toujours aussi fragiles et vulnérables face aux intempéries.

Après Chido, les migrants ont été pointés du doigt par une partie de la classe politique française. Le gouvernement Bayrou a légiféré pour durcir l’accès à la nationalité française et a promis plus de fermeté pour lutter contre l’immigration. Comment évolue la situation sur place ?

F. I. T. : Près de la moitié des personnes vivant à Mayotte sont des étrangers, dont de nombreux illégaux, installés dans les bidonvilles. Les opérations policières massives, comme Wambushu ou Place nette pour raser les bidonvilles et expulser massivement, n’ont pas été renouvelées en 2025. En revanche, les policiers aux frontières interviennent toujours en mer et au sein de l’île pour expulser les illégaux. Mais ces derniers reviennent : l’île est facilement accessible depuis les îles voisines en bateau et les frontières sont difficiles à contrôler.

Malgré les efforts de l’État, les arrivées illégales se poursuivent. Les migrants vivent toujours dans des logements précaires, avec un accès limité aux droits fondamentaux et des inégalités qui perdurent.

Les relations entre la France et les Comores jouent un rôle central dans cette problématique migratoire. Quel est l’état de ces relations ?

F. I. T. : En 2018, un accord a été conclu entre l’Union des Comores et la France. Il s’agissait pour la France d’aider les Comores sur le plan de l’agriculture, de l’éducation, de la santé – ceci à condition que le gouvernement comorien stoppe le départ des migrants depuis l’île d’Anjouan. Mais depuis, rien n’a changé. Le président de l’Union des Comores Azali Assoumani répète avec constante que la France doit abandonner Mayotte et l’île intégrer l’Union des Comores. Il affirme que Mayotte appartient aux Comores, sans doute pour satisfaire son électorat, alors que les habitants des Comores vivent dans une grande pauvreté.

Quel est l’état d’esprit des habitants de l’île que vous côtoyez ?

F. I. T. : Les Mahorais sont résilients. Après le cyclone, ils se sont entraidés, ils étaient solidaires. Ici, la vie suit son cours. Certains critiquent le gouvernement, mais, en général, les Mahorais sont confiants dans l’avenir. Ce qui est un sujet de tension, ce sont les phénomènes de violence qui impliquent parfois des migrants. Cela ne date pas de Chido. La question migratoire est montée en puissance depuis que l’île est un département français, en 2011.

Fahad Idaroussi Tsimanda ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

13.12.2025 à 09:02

Scolarité : Le privé fait-il mieux que le public ?

Léonard Moulin, Research fellow, Ined (Institut national d'études démographiques)

Texte intégral (2580 mots)

Lorsque l’on considère évaluations nationales et examens, les écoles privées affichent non seulement de meilleurs résultats que les écoles publiques, mais aussi de meilleurs taux de progression des élèves au fil de leur scolarité. Est-ce le simple reflet de leur composition sociale plus favorisée ? Ou faut-il y voir un « effet » propre à ces établissements ?

La question de l’école privée occupe aujourd’hui une place singulière dans le débat éducatif français. Elle revient d’ailleurs régulièrement au centre des discussions publiques, souvent au gré de polémiques autour des choix scolaires des ministres de l’éducation nationale eux-mêmes. La séquence s’est répétée récemment : Édouard Geffray, le nouveau ministre, a inscrit ses enfants dans le privé – comme ses prédécesseurs Amélie Oudéa-Castéra, en 2024, et Pap Ndiaye.

Si ces épisodes retiennent autant l’attention, c’est qu’ils cristallisent une tension devenue centrale : régulièrement crédité de meilleurs résultats scolaires que le secteur public, le secteur privé est largement financé par des fonds publics tout en étant autorisé à sélectionner ses élèves.

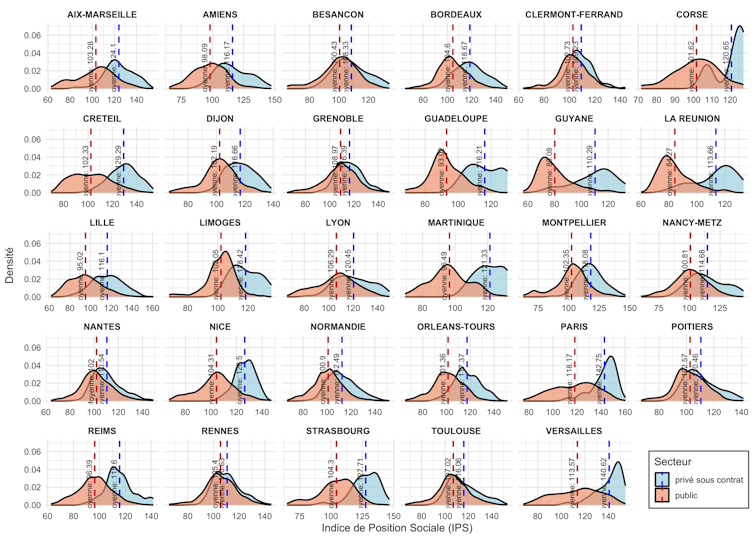

Ces différences de recrutement se traduisent par des écarts massifs dans la composition sociale des établissements entre public et privé. C’est ce que montrent les indices de position sociale (IPS) calculés par le ministère de l’éducation nationale en considérant les catégories socio-professionnelles des parents d’élèves.

Les graphiques ci-dessous traduisent ces disparités, académie par académie. Prenons l’exemple de Paris : l’IPS moyen des écoles publiques y est d’environ 118, contre 143 dans le privé sous contrat, soit un écart d’environ 25 points, l’un des plus élevés du pays. Autrement dit, les écoles privées parisiennes scolarisent un public en moyenne beaucoup plus favorisé socialement que les écoles publiques. Les distributions montrent également que le privé est concentré sur le haut de l’échelle sociale, tandis que le public accueille une population plus hétérogène, avec davantage d’élèves issus de milieux modestes.

Les meilleurs résultats des écoles privées aux évaluations nationales et aux examens viennent-ils réellement d’un « effet » propre au privé ou reflètent-ils avant tout la composition sociale plus favorisée de ses élèves ?

Des résultats scolaires plus élevés dans le privé

Les comparaisons internationales offrent un premier éclairage. Les évaluations PISA, menées auprès d’élèves de 15 ans, rappellent combien la France demeure l’un des pays où les résultats scolaires dépendent le plus du milieu social : près d’un cinquième des performances s’explique par l’origine sociale.

Dans ce contexte, les établissements privés – qui accueillent un public en moyenne plus favorisé – obtiennent logiquement de meilleurs scores bruts. Mais il s’agit d’une photographie instantanée, qui ne dit rien de la manière dont les élèves progressent dans le temps.

Lorsque l’on cesse de regarder uniquement les performances à un instant donné pour suivre les élèves au fil de leur scolarité, un autre constat apparaît. Du début à la fin du collège, les élèves scolarisés dans un établissement privé progressent plus que ceux du public, à milieu social comparable. Cette différence apparaît à la fois dans les évaluations de sixième et dans les notes finales du brevet : en moyenne, les trajectoires scolaires s’améliorent plus nettement dans le privé.

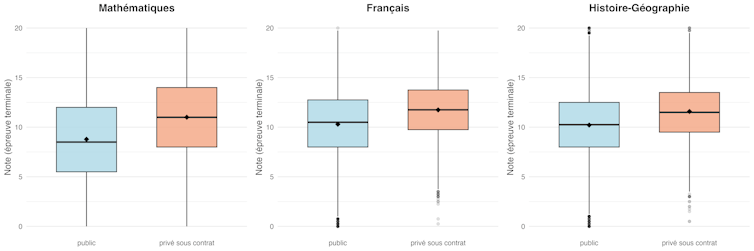

Lorsque l’on considère les épreuves terminales du brevet, dans les graphiques qui suivent, il apparaît que, dans chaque matière, les élèves scolarisés dans le privé sous contrat obtiennent en moyenne des notes plus élevées que ceux du public. Les distributions montrent également que les résultats des élèves du public sont plus dispersés, avec davantage d’élèves dans la partie basse de la distribution.

En examinant ces parcours de manière plus fine, un élément supplémentaire émerge : ces écarts ne sont pas uniformes selon le niveau initial. Une étude récente montre que l’avantage observé en fin de troisième est plus marqué pour les élèves initialement les plus faibles, en particulier en mathématiques. Autrement dit, les différences entre public et privé tiennent à la fois aux acquis de départ, mais aussi à la manière dont les élèves progressent au cours du collège.

Des progrès plus marqués au fil de la scolarité dans le privé

Un travail conduit par le service statistique du ministère de l’éducation nationale aboutit à un résultat très proche. En suivant une cohorte d’élèves du CP au début du lycée, ses auteurs montrent que, à contexte familial et scolaire comparable, la progression en français et en mathématiques au collège – et surtout en mathématiques – est plus élevée dans le privé que dans le public.

Ces différences de progression ne peuvent pas s’expliquer par certains facteurs souvent avancés dans le débat public. Les chiffres sont sans ambiguïté : les classes du privé comptent en moyenne 27,2 élèves, contre 24,7 dans le public ; le nombre d’élèves par enseignant y est plus élevé (14,6 contre 12,8) ; et le privé n’emploie pas davantage d’enseignants agrégés (4,5 % contre 13,4 % dans le public). Rien, dans ces indicateurs d’encadrement, ne suggère donc des conditions plus favorables dans le privé.

Les explications doivent être cherchées ailleurs. Deux pistes se dégagent. D’abord, la composition sociale : les établissements privés accueillent un public plus favorisé, ce qui peut mécaniquement tirer les résultats vers le haut et permettre d’enseigner à des niveaux plus élevés.

Ensuite, le libre recrutement des enseignants, qui permet de constituer des équipes pédagogiques plus cohérentes et plus stables, potentiellement mieux alignées sur un projet éducatif commun – un cadre qui peut là aussi soutenir un niveau d’exigence plus élevé.

Une composition sociale qui n’explique pas tout

Une fois posés ces constats, une question centrale demeure : dans quelle mesure les écarts public/privé s’expliquent-ils simplement par la composition sociale beaucoup plus favorisée des établissements privés ? Lorsqu’on compare des élèves de même origine sociale, et que l’on tient compte non seulement de leurs caractéristiques individuelles, mais aussi de la composition sociale des établissements et des classes dans lesquels ils sont scolarisés, l’avantage du privé sur le public ne diminue que très légèrement.

En pratique, seulement 15 à 23 % de l’avantage initial s’efface. Autrement dit, la composition sociale explique bien une partie de la différence… mais certainement pas tout. D’autres facteurs sont donc en jeu.

L’étude révèle un point essentiel : la composition sociale n’agit pas de la même manière selon l’origine des élèves. Pour les élèves issus de milieux favorisés, l’avantage apparent du privé tient surtout au fait qu’ils sont scolarisés dans des collèges où la part d’élèves aisés est nettement plus élevée que dans le public. Une fois que l’on compare des élèves favorisés inscrits dans des établissements au profil social similaire dans les deux secteurs, l’écart de performances entre public et privé devient quasi nul. Rien n’indique, en revanche, que ces élèves tirent leurs meilleures performances de spécificités pédagogiques propres au privé.

À l’inverse, pour les élèves issus de milieux modestes, la situation est tout autre : l’avantage du privé demeure nettement perceptible, même après avoir neutralisé les effets du milieu social et de l’environnement scolaire. Ce sont finalement ces élèves, pourtant très minoritaires dans le privé, qui tirent le plus de bénéfices de la scolarisation dans le privé en termes de résultats scolaires.

Interroger l’équité du système scolaire

S’ajoute une interrogation liée au fonctionnement même des établissements : si la composition sociale n’explique qu’une part modeste des écarts observés, où chercher les leviers restants ? Une piste souvent avancée concerne le mode de recrutement des enseignants, plus flexible dans le privé : dans le public, les enseignants sont affectés par l’administration, tandis que dans le privé sous contrat ce sont les chefs d’établissement qui recrutent directement les enseignants, ce qui leur laisse davantage de marge pour composer leurs équipes pédagogiques autour du projet d’établissement.

Rien n’interdit d’examiner ce que certaines pratiques propres au privé – par exemple le recrutement plus libre des enseignants par le chef d’établissement – pourraient inspirer au secteur public, comme l’expérimentation récente menée dans le cadre du plan « Marseille en grand ». Ce type de dispositif reste encore peu documenté par la recherche et constitue un terrain privilégié pour de futurs travaux.

Finalement, peut-on considérer comme durable un système où l’argent public soutiendrait, de fait, une organisation qui contribue à renforcer la ségrégation scolaire ? La question mérite d’être posée, ne serait-ce qu’au regard des principes mêmes inscrits dans le Code de l’éducation, selon lesquels « le service public de l’éducation […] contribue à l’égalité des chances et à lutter contre les inégalités sociales et territoriales en matière de réussite scolaire et éducative ».

L’enjeu est désormais de documenter précisément les mécanismes à l’œuvre, afin d’identifier quels leviers d’organisation scolaire pourraient, à terme, être mobilisés au service d’une plus grande équité du système éducatif.

Léonard Moulin ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

12.12.2025 à 13:09

Le sort de Warner Bros suspendu au duel Netflix–Paramount

Julien Jourdan, Professeur, HEC Paris Business School

Texte intégral (1496 mots)

Ce pourrait être un épisode d’une série américaine sur le monde des affaires. Qui, de Paramount ou de Netflix, mettra la main sur la Warner Bros ? Les deux projets n’ont pas les mêmes motivations. Surtout, l’un et l’autre devront faire avec le droit de la concurrence aux États-Unis, mais aussi en Europe, mondialisation oblige. Résumé des premiers épisodes, si vous avez manqué le début…

La nouvelle a frappé Hollywood de stupeur. Le 4 décembre dernier, Netflix annonçait l’acquisition des studios Warner Bros. (WB) pour 83 milliards de dollars, coiffant au poteau le favori Paramount. La situation s’est depuis compliquée : le patron de Paramount, David Ellison, a surenchéri avec une offre hostile à 108 milliards de dollars pour l’ensemble du groupe WB Discovery, incluant les studios ainsi qu’un bouquet – en déclin – de chaînes de télévision, dont la célèbre chaîne d’information CNN.

L’issue de cette bataille est incertaine à l’heure actuelle. Les deux opérations sont de nature différente. Un achat par Paramount impliquerait une triple fusion entre deux studios, deux plates-formes de streaming – Paramount+ (79 millions d’abonnés) et HBO+ (128 millions d’abonnés) – et deux bouquets de chaînes de télévision (dont CNN et CBS). Ce serait une fusion horizontale entre des acteurs en concurrence directe sur leurs marchés. L’impact social pourrait être très lourd : l’opération prévoit 6 milliards de dollars de synergies, en grande partie via la suppression de postes en doublon.

À lire aussi : Netflix, une machine à standardiser les histoires ?

Si Netflix mettait la main sur WB, ce serait principalement pour acquérir le vaste catalogue de WB et de HBO, les chaînes du câble étant exclues de l’offre du géant du streaming. Les synergies anticipées, de l’ordre de 3 milliards, concerneraient les dépenses technologiques pour les deux tiers et seraient constituées, pour le reste, d’économies sur les achats de droits de diffusion. Netflix pourrait ainsi librement diffuser Game of Thrones ou Harry Potter auprès de ses 302 millions d’abonnés dans le monde. Ce serait une fusion verticale combinant un producteur de contenus, WB, et un diffuseur, Netflix, qui éliminerait au passage un concurrent notable, HBO+.

Des précédents coûteux

Ce type d’opération pourrait rendre nerveux quiconque se rappelle l’histoire des fusions de Warner Bros. Déjà en 2001, le mariage de WB et d’AOL célébrait l’alliance du contenu et des « tuyaux » – pour utiliser les termes alors en vogue. L’affaire s’était terminée de piteuse manière par le spin-off d’AOL et l’une des plus grosses dépréciations d’actifs de l’histoire – de l’ordre de 100 milliards de dollars. Quinze ans plus tard, AT&T retentait l’aventure. L’union fut de courte durée. En 2021, le géant des télécoms se séparait de WB, qui se voyait désormais associé au groupe de télévision Discovery, sous la direction de David Zaslav, aujourd’hui à la manœuvre.

Pourquoi ce qui a échoué dans le passé marcherait-il aujourd’hui ? À dire vrai, la position stratégique de Netflix n’a rien à voir avec celle d’AOL et d’AT&T. Les fusions verticales précédentes n’ont jamais produit les synergies annoncées pour une simple raison : disposer de contenu en propre n’a jamais permis de vendre plus d’abonnements au téléphone ou à Internet. Dans les deux cas, le château de cartes, vendu par les dirigeants, et leurs banquiers, s’est rapidement effondré.

Un catalogue sans pareil

Une fusion de Netflix avec WB délivrerait en revanche des bénéfices très concrets : le géant du streaming ajouterait à son catalogue des produits premium – films WB et séries HBO – dont il est à ce jour largement dépourvu. L’opération permettrait de combiner l’une des bibliothèques de contenus les plus riches et les plus prestigieuses avec le média de diffusion mondiale le plus puissant qui ait jamais existé. L’ensemble pourrait en outre attirer les meilleurs talents, qui restent à ce jour largement inaccessibles à Netflix.

En pratique, certains contenus, comme la série Friends, pourraient être inclus dans l’offre de base pour la rendre plus attractive et recruter de nouveaux abonnés. D’autres films et séries pourraient être accessibles via une ou plusieurs options payantes, sur le modèle de ce que fait déjà Amazon Prime, augmentant ainsi le panier moyen de l’abonné.

Le rapprochement de deux stars du divertissement ferait à coup sûr pâlir l’offre de leurs concurrents, dont Disney mais aussi… Paramount. Et c’est là que le bât blesse. Les autorités de la concurrence, aux États-Unis et en Europe, approuveront-elles la formation d’un tel champion mondial ? Si la fusion est confirmée, les procédures en recours ne tarderont pas à arriver.

CNN dans le viseur

C’est l’argument avancé par David Ellison, le patron de Paramount, qui agite le chiffon rouge de l’antitrust pour convaincre les actionnaires de WBD : que restera-t-il du studio si la fusion avec Netflix est rejetée après deux ans de procédures ? Ted Sarandos, le co-PDG de Netflix, pourrait lui retourner la pareille, car une fusion horizontale avec Paramount ne manquerait pas d’éveiller, elle aussi, des inquiétudes – d’autant plus qu’elle serait largement financée par des capitaux étrangers venant du Golfe.

Le fils de Larry Ellison, deuxième fortune mondiale, réputé proche du président américain, s’est assuré le soutien financier du gendre de ce dernier, Jared Kushner. Si Donald Trump se soucie probablement assez peu du marché du streaming, il pourrait être sensible au sort réservé à la chaîne CNN, une de ses bêtes noires. En cas de victoire de Paramount, CNN pourrait être combinée avec CBS et sa ligne éditoriale revue pour apaiser le locataire de la Maison-Blanche. Du côté du vendeur, David Zaslav laisse les enchères monter. Il pourrait empocher une fortune – on parle de plus de 425 millions de dollars.

À cette heure, le sort de WB est entre les mains de cette poignée d’hommes. Des milliers d’emplois à Los Angeles, et ailleurs, sont en jeu. Une fusion WB/Netflix pourrait par ailleurs accélérer la chute de l’exploitation des films en salles, dans un contexte d’extrême fragilité : le nombre de tickets vendus dans les cinémas en Amérique du Nord a chuté de 40 % depuis 2019. Netflix pourrait choisir de diffuser directement sur sa plateforme certains films de WB, qui représente environ un quart du marché domestique du cinéma. Pour les films qui conserveraient une sortie en salle, la fenêtre d’exclusivité réservée aux exploitants pourrait se réduire à quelques semaines, fragilisant un peu plus leur économie. Hollywood retient son souffle.

Julien Jourdan ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

12.12.2025 à 13:08

Le smic protège-t-il encore de la pauvreté ?

Hugo Spring-Ragain, Doctorant en économie / économie mathématique, Centre d'études diplomatiques et stratégiques (CEDS)

Texte intégral (1866 mots)

Vendredi 12 décembre 2025, le Groupe d’experts sur le smic publie un rapport sur l’impact du salaire minimum sur l’économie française. Son impact sur la pauvreté n’est cependant pas univoque. Le smic ne suffit pas à expliquer les trajectoires personnelles de plus en plus diverses. Le revenu disponible qui prend en compte les aides perçues et les dépenses contraintes est un critère plus juste.

La question revient cette année encore avec le rapport du Groupe d’experts du smic publié ce vendredi 12 décembre : le salaire minimum protège-t-il encore réellement de la pauvreté ? Pourtant, comme l’ont rappelé l’Insee et l’Institut des politiques publiques (IPP) dans plusieurs travaux plus ou moins récents, le salaire brut, seul, ne détermine pas la pauvreté. Ce qui importe, c’est le niveau de vie, c’est-à-dire le revenu disponible après transferts sociaux de toutes sortes (qui s’ajoutent), impôts et charges contraintes (qui se soustraient). Dans un contexte de renchérissement du logement (13 % d’augmentation de l’indice de référence des loyers, IRL) et d’hétérogénéité croissante des situations familiales, la question ne doit plus être posée en termes uniquement macroéconomiques.

La littérature académique reprend ce constat. Antony B. Atkinson souligne que la pauvreté ne renvoie pas simplement à un « manque de salaire », mais à un insuffisant accès aux ressources globales ; Patrick Moyes rappelle que la structure familiale modifie profondément le niveau de vie relatif. Quant à France Stratégie et l’Insee, après sa publication faisant l’état des lieux de la pauvreté en France, ils documentent la montée de ce qu’on appelle la pauvreté laborieuse, c’est-à-dire le fait de travailler sans pour autant dépasser les seuils de pauvreté et sans possibilité de profiter de l’ascenseur social.

À lire aussi : La pauvreté de masse : symptôme d’une crise de la cohésion sociale

Un amortisseur d’inflation ?

Notre premier graphique compare l’évolution du smic, des salaires et des prix depuis 2013. On y observe très nettement que le salaire minimum a servi d’amortisseur pendant la séquence inflationniste récente : ses revalorisations automatiques l’ont fait progresser aussi vite, souvent plus vite, que l’indice des prix à la consommation.

Figure 1 – Évolution du smic, du salaire mensuel de base (SMB), du salaire horaire de base des ouvriers et des employés (SHBOE) et de l’indice des prix à la consommation (IPC) hors Tabac – Sources : Dares, Insee, Rapport GES 2025 – Graphique de l’auteur.

Ce mouvement contraste avec celui des salaires moyens, dont la progression a été plus lente. Comme le soulignent plusieurs analyses de France Stratégie et de l’Organisation de coopération et de développement économiques (OCDE), cela a eu pour effet de resserrer la hiérarchie salariale, une situation déjà documentée lors de précédentes périodes de rattrapage du smic.

L’influence du temps de travail

Mais ce constat ne dit rien d’une dimension pourtant déterminante : l’accès au temps plein car une partie des salariés au smic n’y est pas à temps complet. Comme l’ont montré plusieurs travaux de l’Insee et de la direction de l’animation de la recherche, des études et des statistiques (Dares, ministère du travail), une proportion importante de travailleurs rémunérés au salaire minimum occupe des emplois à temps partiel, et souvent non par choix mais parce qu’aucun temps plein n’est disponible. C’est ce que les économistes appellent le temps partiel contraint.

Ce temps partiel modifie radicalement l’interprétation du smic : on parle d’un salaire minimum horaire, mais, concrètement, les ressources mensuelles ne reflètent pas ce taux. Un salaire minimum versé sur 80 % d’un temps plein ou sur des horaires discontinus conduit mécaniquement à un revenu inférieur et donc à une exposition accrue à la pauvreté.

Mais si l’on s’en tenait à cette comparaison, on pourrait conclure que le smic protège pleinement les salariés les plus modestes. Or, c’est précisément ici que la question se complexifie. Car la pauvreté ne dépend pas du seul salaire : elle dépend du revenu disponible et donc de l’ensemble des ressources du ménage. C’est ce que montrent les travaux sur la pauvreté laborieuse, un phénomène en hausse en France selon l’Observatoire des inégalités, environ une personne en situation de pauvreté sur trois occupe un emploi mais les charges familiales, le coût du logement ou l’absence de second revenu maintiennent le ménage sous les seuils de pauvreté.

Du smic au revenu disponible

Pour comprendre la capacité réelle du smic à protéger de la pauvreté, il faut observer ce qu’il devient une fois transformé en revenu disponible grâce aux données de l’Insee et de la Dares, c’est-à-dire le revenu après impôts, aides et charges incompressibles.

Le graphique suivant juxtapose trois situations familiales : une personne seule, un parent isolé avec un enfant et un couple avec un enfant dont les deux adultes perçoivent le smic.

Figure 2 – Revenu disponible et seuils de pauvreté selon trois profils de ménages rémunérés au smic Sources : Dares, Insee, Rapport GES 2025 – Graphique de l’auteur.

Dans le premier panneau, on observe qu’une personne seule rémunérée au smic dispose d’un revenu disponible supérieur au seuil de pauvreté à 60 % du revenu médian. La prime d’activité joue un rôle important, mais c’est surtout l’absence de charge familiale et de coûts fixes élevés qui explique ce résultat.

Ce profil correspond à la représentation classique du smic comme filet de sécurité individuel. Comme le confirment les données de l’Insee et les travaux de France Stratégie, la pauvreté laborieuse y est encore relativement limitée. Cependant, même seul, un actif au smic pourrait avoir des dépenses contraintes extrêmement élevées dans des zones à forte demande locative.

La pauvreté laborieuse

Le deuxième panneau raconte une histoire totalement différente. Le parent isolé, même à temps plein au smic se situe clairement en dessous du seuil de pauvreté, plus grave encore, son revenu disponible ne compense plus le salaire net via les transferts. C’est ici que la notion de pauvreté laborieuse prend tout son sens. Malgré un emploi et malgré les compléments de revenu, le ménage reste dans une situation de fragilité structurelle.

Selon l’Insee, les familles monoparentales sont aujourd’hui le groupe le plus exposé à la pauvreté et notamment à la privation matérielle et sociale, non parce qu’elles travaillent moins, mais parce qu’elles cumulent un revenu unique, des charges plus élevées et une moindre capacité d’ajustement.

Dans le troisième panneau, un couple avec un enfant et deux smic vit lui aussi en dessous de la ligne de pauvreté. Ce résultat laisse penser que la composition familiale, même accompagnée de deux smic crée une pauvreté structurelle sur les bas revenus ; aussi le graphique montre-t-il que la marge est finalement assez limitée. Une partie du gain salarial disparaît en raison de la baisse des aides et de l’entrée dans l’impôt, un phénomène bien documenté par l’IPP et par le rapport Bozio-Wasmer dans leurs travaux sur les « taux marginaux implicites ». Dans les zones de loyers élevés, un choc de dépense ou une hausse de charges peut faire basculer ces ménages vers une situation beaucoup plus précaire.

Situations contrastées

Une conclusion s’impose : le smic protège encore une partie des salariés contre la pauvreté, mais ce résultat est loin d’être uniforme. Il protège l’individu à plein temps et sans enfant, mais ne suffit plus à assurer un niveau de vie décent lorsque le salaire doit couvrir seul les charges d’un foyer, notamment dans les configurations monoparentales. Cette asymétrie est au cœur de la montée de la pauvreté laborieuse observée par l’Insee et documentée par l’Institut des politiques publiques.

Ces résultats rappellent que la pauvreté n’est plus seulement un phénomène d’exclusion du marché du travail. Elle touche des travailleurs insérés, qualifiés et en contrat stable, mais dont le salaire minimum, appliqué sur un volume horaire insuffisant ou absorbé par des dépenses contraintes, ne permet plus un niveau de vie supérieur aux seuils de pauvreté. Le smic se révèle alors davantage un plancher salarial individuel qu’un instrument de garantie sociale familiale.

À l’heure où la question du pouvoir d’achat occupe une place centrale et où la revalorisation du smic reste l’un des outils majeurs d’ajustement, ces conclusions invitent à réorienter le débat. Ce n’est pas seulement le niveau du smic qu’il faut interroger, mais sa capacité à constituer un revenu de référence pour des configurations familiales et territoriales très hétérogènes. Autrement dit, le smic joue encore sa fonction de stabilisateur individuel, mais il n’est plus suffisant seul pour protéger durablement certains ménages.

La question devient alors moins « De combien augmenter le smic ? » que « Comment garantir que le revenu disponible issu d’un emploi au smic permette effectivement d’éviter la pauvreté ? ».

Hugo Spring-Ragain ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

11.12.2025 à 16:16

L’internationale trumpiste : la Stratégie de sécurité nationale 2025 comme manifeste idéologique

Jérôme Viala-Gaudefroy, Spécialiste de la politique américaine, Sciences Po

Texte intégral (2420 mots)

L’administration Trump vient de rendre publique sa Stratégie de sécurité nationale. Charge virulente contre l’Europe, affirmation de l’exceptionnalisme des États-Unis, présentation du président actuel en héros affrontant au nom de son pays des périls mortels pour la civilisation occidentale : bien plus qu’un simple ensemble de grandes lignes, il s’agit d’une véritable proclamation idéologique.

La Stratégie de sécurité nationale (National Security Strategy, NSS) est normalement un document technocratique, non contraignant juridiquement, que chaque président des États-Unis doit, durant son mandat, adresser au Congrès pour guider la politique étrangère du pays.

La version publiée par l’administration Trump en 2025 (ici en français) ressemble pourtant moins à un texte d’État qu’à un manifeste idéologique MAGA (Make America Great Again) qui s’adresse tout autant à sa base qu’au reste du monde, à commencer par les alliés européens de Washington, accusés de trahir la « vraie » démocratie. Pour la première fois, et contrairement à la NSS du premier mandat Trump publiée en 2017, la sécurité nationale y est définie presque exclusivement à partir des obsessions trumpistes : immigration, guerre culturelle, nationalisme.

Les trois principales articulations du texte

La NSS 2025 rompt complètement avec la tradition libérale de la démocratie constitutionnelle (respect des droits fondamentaux, primauté de l’État de droit, pluralisme) et avec sa traduction internationale — la promotion de la démocratie dans le cadre d’un ordre multilatéral fondé sur des règles. Elle réécrit l’histoire depuis la fin de la guerre froide, construit un ennemi composite (immigration, élites « globalistes », Europe) et détourne le vocabulaire de la liberté et de la démocratie au service d’un exceptionnalisme ethno-populiste.

Ce document présente une grande narration en trois actes.

Acte I : La trahison des élites.

C’est le récit de l’échec des politiques menées par les États-Unis depuis 1991, imputées à l’hubris d’élites qui auraient voulu l’hégémonie globale. Elles auraient mené des « guerres sans fin », mis en place un « prétendu libre-échange » et soumis le pays à des institutions supranationales, au prix de l’industrie américaine, de la classe moyenne, de la souveraineté nationale et de la cohésion culturelle. Ce premier acte souligne enfin l’incapacité à renouveler un récit national crédible après la fin de la guerre froide : c’est sur ce vide narratif que Trump construit son propre récit.

Acte II : Le déclin.

Le déclin des États-Unis tel que vu par l’administration Trump est à la fois économique, moral, géopolitique et démographique. Il se manifeste par la désindustrialisation, les guerres ratées, ou encore par la crise des frontières avec le Mexique. Il fait écho au « carnage américain » que l’actuel président avait dénoncé lors de son premier discours d’investiture, en 2017. L’ennemi est ici décrit comme à la fois intérieur et extérieur : l’immigration, présentée comme une « invasion » liée aux cartels, mais aussi les institutions internationales et les élites de politique étrangère, américaines comme européennes. Tous sont intégrés dans un même schéma conflictuel, celui d’une guerre globale que l’administration Trump serait prête à mener contre ceux qui menaceraient souveraineté, culture et prospérité américaines.

Acte III : Le sauveur.

La NSS présente le locataire de la Maison Blanche comme un leader providentiel, comme le « président de la Paix » qui corrige la trahison des élites. Trump y apparaît comme un « redresseur », héros (ou anti-héros) qui aurait, en moins d’un an, « réglé huit conflits violents ». Il incarnerait une nation retrouvée, prête à connaître un « nouvel âge d’or ». On retrouve ici un schéma narratif typiquement américain, issu de la tradition religieuse de la jérémiade : un prêche qui commence par dénoncer les fautes et la décadence, puis propose un retour aux sources pour « sauver » la communauté. L’historien Sacvan Bercovitch a montré que ce type de récit est au cœur du mythe national américain. Un texte qui devrait être techno-bureaucratique se transforme ainsi en récit de chute et de rédemption.

L’exceptionnalisme américain à la sauce Trump

À y regarder de près, la NSS 2025 foisonne de tropes propres aux grands mythes américains. Il s’agit de « mythifier » la rupture avec des décennies de politique étrangère en présentant la politique conduite par l’administration Trump comme un retour aux origines.

Le texte invoque Dieu et les « droits naturels » comme fondement de la souveraineté, de la liberté, de la famille traditionnelle, voire de la fermeture des frontières. Il convoque la Déclaration d’indépendance et les « pères fondateurs des États-Unis » pour justifier un non-interventionnisme sélectif. Il se réclame aussi de « l’esprit pionnier de l’Amérique » pour expliquer la « domination économique constante » et la « supériorité militaire » de Washington.

Si le mot exceptionalism n’apparaît pas (pas plus que la formule « indispensable nation »), la NSS 2025 est saturée de formulations reprenant l’idée d’une nation unique dans le monde : hyper-superlatifs sur la puissance économique et militaire, rôle central de l’Amérique comme pilier de l’ordre monétaire, technologique et stratégique. Il s’agit d’abord d’un exceptionnalisme de puissance : le texte détaille longuement la domination économique, énergétique, militaire et financière des États-Unis, puis en déduit leur supériorité morale. Si l’Amérique est « la plus grande nation de l’histoire » et « le berceau de la liberté », c’est d’abord parce qu’elle est la plus forte. La vertu n’est plus une exigence qui pourrait limiter l’usage de la puissance ; elle est au contraire validée par cette puissance.

Dans ce schéma, les élites — y compris européennes — qui affaiblissent la capacité américaine en matière d’énergie, d’industrie ou de frontières ne commettent pas seulement une erreur stratégique, mais une faute morale. Ce n’est plus l’exceptionnalisme libéral classique de la diffusion de la démocratie, mais une forme d’exceptionnalisme moral souverainiste : l’Amérique se pense comme principale gardienne de la « vraie » liberté, contre ses adversaires mais aussi contre certains de ses alliés.

Là où les stratégies précédentes mettaient en avant la défense d’un « ordre international libéral », la NSS 2025 décrit surtout un pays victime, exploité par ses alliés, corseté par des institutions hostiles : l’exceptionnalisme devient le récit d’une surpuissance assiégée plutôt que d’une démocratie exemplaire. Derrière cette exaltation de la « grandeur » américaine, la NSS 2025 ressemble davantage à un plan d’affaires, conçu pour servir les intérêts des grandes industries — et, au passage, ceux de Trump lui-même. Ici, ce n’est pas le profit qui se conforme à la morale, c’est la morale qui se met au service du profit.

Une vision très particulière de la doctrine Monroe

De même, le texte propose une version mythifiée de la doctrine Monroe (1823) en se présentant comme un « retour » à la vocation historique des États-Unis : protéger l’hémisphère occidental des ingérences extérieures. Mais ce recours au passé sert à construire une nouvelle doctrine, celui d’un « corollaire Trump » — en écho au « corollaire Roosevelt » : l’Amérique n’y défend plus seulement l’indépendance politique de ses voisins, elle transforme la région en chasse gardée géo-économique et migratoire, prolongement direct de sa frontière sud et vitrine de sa puissance industrielle.

À lire aussi : États-Unis/Venezuela : la guerre ou le deal ?

Sous couvert de renouer avec Monroe, le texte légitime une version trumpiste du leadership régional, où le contrôle des flux (capitaux, infrastructures, populations) devient le cœur de la mission américaine. Là encore, le projet quasi impérialiste de Trump est présenté comme l’extension logique d’une tradition américaine, plutôt que comme une rupture.

La NSS 2025 assume au contraire une ingérence politique explicite en Europe, promettant de s’opposer aux « restrictions antidémocratiques » imposées par les élites européennes (qu’il s’agisse, selon Washington, de régulations visant les plates-formes américaines de réseaux sociaux, de limitations de la liberté d’expression ou de contraintes pesant sur les partis souverainistes) et de peser sur leurs choix énergétiques, migratoires ou sécuritaires. Autrement dit, Washington invoque Monroe pour sanctuariser son hémisphère, tout en s’arrogeant le droit d’intervenir dans la vie politique et normative européenne — ce qui revient à revendiquer pour soi ce que la doctrine refuse aux autres.

Dans la NSS 2025, l’Europe est omniprésente — citée une cinquantaine de fois, soit deux fois plus que la Chine et cinq fois plus que la Russie —, décrite comme le théâtre central d’une crise à la fois politique, démographique et civilisationnelle. Le texte oppose systématiquement les « élites » européennes à leurs peuples, accusant les premières d’imposer, par la régulation, l’intégration européenne et l’ouverture migratoire, une forme d’« effacement civilisationnel » qui reprend, sans le dire, la logique du « grand remplacement » de Renaud Camus, théorie complotiste d’extrême droite largement documentée.

À lire aussi : L’Europe vue par J. D. Vance : un continent à la dérive que seul un virage vers l’extrême droite pourrait sauver

L’administration Trump s’y arroge un droit d’ingérence idéologique inédit : elle promet de défendre les « vraies » libertés des citoyens européens contre Bruxelles, les cours et les gouvernements, tout en soutenant implicitement les partis d’extrême droite ethno-nationalistes qui se posent en porte-voix de peuples trahis. L’Union européenne est dépeinte comme une machine normative étouffante, dont les règles climatiques, économiques ou sociétales affaibliraient la souveraineté des nations et leur vitalité démographique. Ce faisant, le sens même des mots « démocratie » et « liberté » est inversé : ce ne sont plus les institutions libérales et les traités qui garantissent ces valeurs, mais leur contestation au nom d’un peuple soi-disant homogène et menacé, que Washington prétend désormais protéger jusque sur le sol européen.

La Russie, quant à elle, apparaît moins comme ennemi existentiel que comme puissance perturbatrice dont la guerre en Ukraine accélère surtout le déclin européen. La NSS 2025 insiste sur la nécessité d’une cessation rapide des hostilités et de la mise en place d’un nouvel équilibre stratégique, afin de favoriser les affaires. La Chine est le seul véritable rival systémique, surtout économique et technologique. La rivalité militaire (Taïwan, mer de Chine) est bien présente, mais toujours pensée à partir de l’enjeu clé : empêcher Pékin de transformer sa puissance industrielle en hégémonie régionale et globale.

Le Moyen-Orient n’est plus central : grâce à l’indépendance énergétique, Washington cherche à transférer la charge de la sécurité à ses alliés régionaux, en se réservant un rôle de faiseur de deals face à un Iran affaibli. L’Afrique, enfin, est envisagée comme un terrain de reconquête géo-économique face à la Chine, où l’on privilégie les partenariats commerciaux et énergétiques avec quelques États jugés « fiables », plutôt qu’une politique d’aide ou d’interventions lourdes.

Un texte qui ne fait pas consensus

Malgré la cohérence apparente et le ton très péremptoire de cette doctrine, le camp MAGA reste traversé de fortes divisions sur la politique étrangère, entre isolationnistes « America First » hostiles à toute projection de puissance coûteuse et faucons qui veulent continuer à utiliser la supériorité militaire américaine pour imposer des rapports de force favorables.

Surtout, les sondages (ici, ici, ou ici) montrent que, si une partie de l’électorat républicain adhère à la rhétorique de fermeté (frontières, Chine, rejet des élites), l’opinion américaine dans son ensemble demeure majoritairement attachée à la démocratie libérale, aux contre-pouvoirs et aux alliances traditionnelles. Les Américains souhaitent moins de guerres sans fin, mais ils ne plébiscitent ni un repli illibéral ni une remise en cause frontale des institutions qui structurent l’ordre international depuis 1945.

Jérôme Viala-Gaudefroy ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

11.12.2025 à 15:57

Le cash recule, mais reste solidement ancré dans les portefeuilles des Français

Timothée Waxin, Responsable du département Finance, Data & Performance, Pôle Léonard de Vinci

Texte intégral (1491 mots)

Le cash recule mais ne disparaît pas. Face à l’essor fulgurant des paiements numériques et aux ambitions européennes d’un euro digital, les espèces résistent, portées par la recherche de confidentialité, de contrôle et de résilience. À l’heure du tout dématérialisé, les Français n’ont pas encore remisé pièces et billets.

Le cash, c’est-à-dire l’argent liquide, tangible et immédiatement disponible, est très ancien, bien antérieur au mot lui-même. Les premières pièces de monnaie remontent à 600 avant notre ère environ en Lydie (actuelle Turquie). Les billets de banque remplacent progressivement les pièces à partir du XVIIe siècle.

Plus de 2 600 ans après son apparition, la monnaie fiduciaire (pièces et billets), par opposition à la monnaie scripturale (virements, cartes, paiements mobiles…), est-elle condamnée à disparaître ?

Un moindre usage des espèces au profit des paiements dématérialisés

L’usage des espèces recule progressivement en France au profit de la carte bancaire et des paiements mobiles. La quatrième enquête de la Banque centrale européenne (BCE) sur les habitudes de paiement des consommateurs en zone euro, publiée en décembre 2024, montre en effet que les paiements par carte représentent désormais 48 % des transactions, contre 43 % pour les paiements en espèces.

Pour la première fois, la carte dépasse donc le cash dans l’Hexagone – une situation qui contraste avec celle de l’ensemble de la zone euro, où les espèces demeurent le moyen de paiement le plus utilisé aux points de vente.

Répartition des moyens de paiement aux points de vente, en France et en zone euro (en % du nombre de transactions)

Cette évolution s’inscrit dans une tendance de long terme, nourrie par un environnement propice à l’innovation et à la numérisation des services financiers.

L’écosystème français des paiements, porté par un tissu dynamique de fintech, propose une offre diversifiée de solutions scripturales qui séduit un nombre croissant de consommateurs. L’essor du paiement sans contact accompagne ce mouvement. Apparue en 2012 avec un plafond initial de 20 euros, relevé successivement à 30 puis 50 euros, cette fonctionnalité concerne aujourd’hui près de sept paiements sur dix réalisés au point de vente. Le développement de la technologie dite « PIN online », permettant de dépasser ce seuil après saisie d’un code sur le terminal de paiement, devrait encore accélérer cette adoption. Parallèlement, la croissance du commerce en ligne a profondément transformé les usages.

Un quart des paiements en France s’effectue désormais sur Internet, une évolution largement stimulée par la crise sanitaire, qui a ancré durablement les réflexes numériques des consommateurs. Les paiements mobiles et les virements instantanés connaissent eux aussi une progression rapide, soutenue par l’émergence de solutions innovantes comme Wero, service européen de paiement instantané proposé par les banques de cinq pays européens.

Cette transition vers le numérique soulève des enjeux majeurs

Cette dynamique devrait se poursuivre à mesure que l’écosystème des paiements continue d’évoluer. De nouveaux acteurs – prestataires techniques, grandes entreprises technologiques, fintech spécialisées – renforcent leur présence dans la chaîne de valeur des paiements.

Dans ce contexte d’initiatives privées et de dématérialisation accrue, les banques centrales cherchent à préserver leur rôle dans les paiements. L’Eurosystème prépare ainsi l’émission d’un euro numérique, destiné à compléter les espèces et les moyens de paiement existants. Son déploiement pourrait intervenir à l’horizon 2027 ou 2028, malgré des interrogations persistantes sur sa complexité d’usage et sa valeur ajoutée perçue par le grand public.

De leur côté, les paiements en stablecoins progressent également, portés par des cas d’usage concrets dans le commerce numérique, les transferts de fonds et les paiements internationaux : ils s’intègrent de plus en plus à l’économie réelle et ne relèvent plus uniquement de la spéculation.

Toutefois, cette transition vers le numérique soulève des enjeux majeurs de souveraineté. Comme le souligne François Villeroy de Galhau, gouverneur de la Banque de France, dans sa Lettre au président de la République, d’avril 2025, 72 % des paiements par carte en zone euro au second semestre 2023 reposaient sur des réseaux internationaux. Christine Lagarde, présidente de la BCE, alerte également sur la dépendance de l’Europe à des infrastructures non européennes – Visa, Mastercard, PayPal, Alipay – issues pour la plupart des États-Unis ou de Chine.

Les infrastructures de cartes nationales, comme Carte bleue (CB) en France, s’érodent en Europe : seuls neuf demeurent actives dans l’Union européenne, tandis que treize pays de la zone euro dépendent entièrement d’acteurs internationaux. Cette dépendance accroît la vulnérabilité de l’Europe face à d’éventuelles restrictions d’accès aux systèmes de paiement. Dans un récent rapport de la Fondation Concorde, nous préconisons le développement de solutions européennes et le co-badging sur les cartes pour renforcer l’autonomie financière du continent.

Le numérique séduit, le cash rassure

Malgré cette dématérialisation rapide des paiements, les Français restent profondément attachés aux espèces. L’enquête de la BCE souligne en effet que 60 % d’entre eux jugent important de conserver la possibilité de payer en liquide. L’anonymat et la protection de la vie privée (d’ailleurs, crainte souvent émise à l’égard du projet d’euro numérique de la BCE), le règlement immédiat et la maîtrise des dépenses figurent parmi les avantages les plus fréquemment cités.

L’accès au cash demeure par ailleurs très satisfaisant : 94 % des commerçants acceptent encore les espèces, et la quasi-totalité de la population (99,9 %) vit à moins de quinze minutes de trajet par la route d’un site équipé d’au moins un distributeur automatique de billets (DAB) ou d’un point d’accès privatif chez un commerçant. Bien que le nombre de DAB ait reculé (42 578 DAB fin 2024, contre 52 697 en 2018), 91 % des Français estiment que l’accès au liquide reste « facile » ou « très facile » – l’un des meilleurs scores de la zone euro.

Assez paradoxalement, la Banque centrale européenne elle-même invite dans une note « Gardez votre calme et conservez de l’argent liquide : leçons sur le rôle unique de la monnaie physique à travers quatre crises », parue en septembre dernier, à ne pas tourner totalement le dos au cash. En cas de crise majeure – panne électrique, cyberattaque ou pandémie –, elle recommande de garder entre 70 et 100 euros en liquide par personne pour les dépenses essentielles. Un conseil révélateur : si le cash décline dans nos portefeuilles, il reste une valeur refuge, un symbole de sécurité et d’autonomie. Autrement dit, la France avance vers les paiements du futur… sans tout à fait lâcher ses pièces et ses billets.

Entre la carte et les espèces, les Français se montrent ainsi ambivalents. Ils adoptent avec enthousiasme les technologies sans contact, les paiements mobiles et les virements instantanés, tout en conservant dans leurs portefeuilles un peu de cash « au cas où ». Le futur du paiement s’écrira sans doute à deux vitesses : numérique par choix, mais liquide par prudence.

Timothée Waxin est administrateur et vice-président du conseil scientifique de la Fondation Concorde.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- CETRI

- ESSF

- Inprecor

- Journal des Alternatives

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview