27.05.2026 à 10:09

Centres de données : pourquoi leur refroidissement consomme autant d’eau (et pourquoi cela pose problème)

Thomas Le Goff, Maître de conférences en droit et régulation du numérique, Télécom Paris – Institut Mines-Télécom

Texte intégral (1838 mots)

La course à l’IA engagée à l’échelle internationale ne doit pas se traduire par un détricotage des règles préservant nos ressources naturelles.

Qui n’a pas déjà expérimenté la désagréable sensation de surchauffe de son téléphone portable ou de son ordinateur lors d’une utilisation prolongée ou lorsque vous avez ouvert trop d’onglets sur votre navigateur ?

Imaginez maintenant la chaleur dégagée par 100 000 puces de calcul de dernière génération, entassées les unes sur les autres et tournant à plein régime, et ce, dans un complexe de plus de 26 kilomètres carrés soit environ 3714 terrains de football. Placez ce grille-pain géant dans une région où la température est de 35 degrés en moyenne et peut atteindre les 50 °C l’été, et vous voilà devant le projet « Stargate UAE » visant à construire jusqu’à 5 gigawatts de puissance de calcul installée dans un immense centre de données à Abu Dhabi.

Ces projets de centres de données dits « hyperscale » visant à alimenter l’essor de l’intelligence artificielle (IA) se multiplient dans le monde, que ce soit aux États-Unis avec le projet Prometheus de Meta prévoyant la construction d’un centre de données de la taille de Manhattan, et même en France avec le « Campus IA ».

Au-delà de leur importante consommation énergétique, ces mastodontes soulèvent d’autres problèmes. Pour fonctionner correctement, ils ne peuvent pas atteindre des températures trop élevées, et contiennent donc des systèmes de refroidissement qui permettent aux composants électroniques de fonctionner à plein régime tout en évitant qu’ils ne se détériorent sous la chaleur qu’ils dégagent.

Comment ces centres de données sont-ils refroidis ? Quel est l’impact de leur refroidissement sur l’environnement, et comment les rendre plus sobres ?

Centres de données, refroidissement et consommation en eau

Il existe plusieurs techniques pour refroidir un centre de données. Pour le résumer simplement, les systèmes de refroidissement reposaient auparavant exclusivement sur des systèmes de ventilation (comme dans votre ordinateur) ou de climatisation (comme dans votre voiture) qui utilisent la circulation de l’air comme source de fraîcheur et rejettent l’air chaud à l’extérieur.

Une deuxième solution de refroidissement utilise l’eau, beaucoup plus efficace que l’air pour transférer la chaleur. Celle-ci permet de rafraîchir des plaques placées proches des composants électroniques, et/ou de rafraîchir l’air ventilé dans l’entrepôt de données.

Dans le premier cas (la climatisation), l’opérateur a besoin de beaucoup d’énergie pour faire tourner les pompes et systèmes de ventilation. Dans le deuxième (le refroidissement liquide), l’entreprise a besoin de moins d’énergie mais nécessitera l’accès à une source d’eau douce (l’eau salée endommagerait les tuyaux et composants) afin d’alimenter son système en eau fraîche.

Les opérateurs de centres de données sont donc face à un arbitrage complexe : doivent-ils utiliser des systèmes de climatisation énergivores ou bien du refroidissement liquide qui, cette fois, nécessite la consommation d’importantes ressources en eau ?

En effet, la consommation en eau des data centers est estimée à 560 milliards de litres chaque année dans le monde, soit l’équivalent de la consommation annuelle en eau potable de 10 millions de Français.

Cette soif insatiable se retrouve également dans les chiffres publiés par les Gafam. Ainsi, Google a vu sa consommation nette d’eau augmenter de 28 % entre 2023 et 2024, atteignant 30 milliards de litres dont environ un tiers provient de régions en stress hydrique. Microsoft, pour sa part, estime que 46 % de ses prélèvements d’eau ont lieu dans de telles zones en 2024.

Toutefois, il faut avoir à l’esprit que les besoins en eau des data centers ne sont pas uniquement liés aux systèmes de refroidissement. Pour obtenir une vision globale de l’impact du développement de ces infrastructures sur les ressources en eau, il convient de prendre également en compte l’eau utilisée par les centrales électriques qui les alimentent, ainsi que l’eau consommée lors du processus de fabrication des composants électroniques. Des chercheurs estiment ainsi que les mégacentres de données construits spécifiquement pour les besoins de calcul de l’IA utilisent, en moyenne, jusqu’à 20 millions de litres d’eau par jour, soit autant qu’une ville de 10 000 à 50 000 habitants.

Peut-on rendre les centres de données moins gourmands en eau ?

Il existe des solutions innovantes pour limiter cette consommation et rendre les systèmes de refroidissement plus efficients. Des entreprises, comme OVH Cloud, Nvidia ou Nebius, développent et déploient de nouvelles architectures de systèmes de refroidissement liquide au plus proche des puces de calcul. Ces nouvelles techniques permettent de réduire, selon les chiffres annoncés, jusqu’à 50 % de la consommation en eau. Toutefois, elles restent encore onéreuses à mettre en œuvre et assez peu développées sur le parc existant.

De manière plus générale, la principale source de perte en eau lors du fonctionnement des centres de données vient du fait qu’ils reposent aujourd’hui pour la plupart sur des circuits ouverts, conduisant à l’évaporation d’une grande partie de l’eau utilisée. C’est pourquoi les nouveaux centres de données devraient idéalement reposer, autant que possible, sur des systèmes de refroidissement en circuit fermé, évitant ce phénomène d’évaporation. Néanmoins, ce type de refroidissement peut s’avérer plus cher, conduit souvent à une hausse du besoin en électricité, et n’est pas évident à mettre en œuvre dans tous les centres de données « historiques » qui n’ont pas été conçus pour le mettre en œuvre.

Des propositions plus farfelues sont aussi avancées, telles que l’envoi de data centers dans l’espace ou bien en immersion dans les océans. Néanmoins, l’apport réel de ces propositions reste encore largement débattu, que ce soit pour des questions de faisabilité technique (bon courage pour réaliser la maintenance de votre centre de données sous-marin !) ou de bénéfices en termes d’émission de CO₂ par rapport à un centre construit sur terre – le cabinet de conseil en décarbonation, Carbone 4, fondé par Alain Grandjean et Jean-Marc Jancovici a, à cet égard, montré que les data centers spatiaux risquaient d’avoir un impact carbone plus important que sur terre en raison des émissions liées au lancement.

À lire aussi : Pourrait-on faire fonctionner des data centers dans l’espace ?

Pour un développement raisonné des centres de données, conscient du caractère fini des ressources naturelles

Au-delà de la faisabilité technique, ces discours risquent de nous détourner du vrai problème : le développement massif de centres de données hyperscale très gourmands en eau, dont une bonne partie dans des territoires où cette ressource se fait rare et conduit à des conflits d’usage.

Ce développement ne se fait pas dans un vide juridique. Les règles du droit de l’environnement, de l’aménagement du territoire et de l’urbanisme prévoient un certain nombre de régimes d’autorisation et d’évaluation environnementale en amont de la construction de ces projets, notamment en France avec le régime des installations classées pour la protection de l’environnement (ICPE).

Néanmoins, la course à l’IA engagée à l’échelle internationale conduit les pays à rivaliser d’ingéniosité pour attirer les investisseurs quitte, parfois, à assouplir les contraintes réglementaires comme c’est le cas actuellement en France avec la loi dite de simplification de la vie économique récemment adoptée. Il est urgent de prêter attention à l’ode à la « simplification », qui provient des discours politiques au sein de l’Union européenne et transcrite dans la politique menée par la Commission européenne, mais qui ne doivent pas se traduire par un détricotage des règles préservant nos ressources naturelles.

Plus généralement, ces débats soulèvent la question de l’usage : alors que certaines économistes parlent de « bulle de l’IA », qui peut réellement prédire quels seront les véritables usages futurs de ces infrastructures ?

Dans les années 1960, il fallait un bâtiment entier pour faire tenir un ordinateur, ils tiennent aujourd’hui dans notre smartphone. Si les IA de demain tiennent aussi sur nos terminaux, doit-on réellement sacrifier nos ressources naturelles pour créer ces mastodontes ?

À lire aussi : Charles Ponzi nous permet-il de comprendre la bulle de l’IA ?

Thomas Le Goff est Research Fellow au sein du think thank Centre on Regulation in Europe (CERRE).

27.05.2026 à 10:09

L’oubli catastrophique, ou pourquoi les IA ne savent pas encore apprendre en continu

Eric Moulines, Professeur en apprentissage statistique et traitement du signal, EPITA; Académie des sciences

Texte intégral (2961 mots)

Un modèle d’IA peut être très performant dans un cadre contrôlé, mais se dégrader lorsque les données qu’il reçoit en conditions réelles ne ressemblent plus exactement aux données sur lesquelles il a été conçu, validé ou récemment mis à jour.

Ainsi, lorsque la mise à jour du modèle est faite naïvement, on peut être confronté au problème de l’« oubli catastrophique » : le modèle a progressé sur les données récentes, mais perd brutalement en performance sur les données plus anciennes. Ce sont précisément ces difficultés qui motivent le développement de l’« apprentissage continu ».

Dans l’apprentissage automatique « classique », on entraîne un réseau de neurones sur un très grand ensemble de données, puis on l’utilise tel quel. Mais ce cadre devient insuffisant lorsque les données arrivent au fil du temps, par exemple dans le cas de données météo, à l’arrivée de nouveaux patients dont la démographie ou la génération évolue, ou encore avec de nouvelles pratiques professionnelles.

Un système de Google Health destiné à automatiser le dépistage de la rétinopathie diabétique (l’ensemble des maladies de la rétine dues à la détérioration des vaisseaux rétiniens par le diabète) était prometteur lors d’évaluations contrôlées. En clinique, en revanche, il a rencontré des difficultés : sur 1 838 images traitées pendant les six premiers mois d’usage dans onze cliniques en Thaïlande, 393 (21 %) n’atteignaient pas le seuil de qualité requis.

Cet exemple ne signifie pas que la rétinopathie diabétique aurait changé en quelques mois. Il montre plutôt que les données vues par le système en clinique peuvent différer fortement de celles utilisées lors de son développement : qualité variable des images, différences de caméras, luminosité, reflets, patients plus difficiles à photographier, contraintes de temps et organisation du dépistage.

Autrement dit, la distribution des données change lorsque l’on passe d’un cadre contrôlé à un environnement réel. C’est précisément ce type de décalage qui rend insuffisant un modèle figé et qui pose la question suivante : comment adapter le modèle à ces nouvelles conditions sans perdre ce qu’il savait déjà faire ?

Les méthodes les plus simples conceptuellement, par exemple un réentraînement complet sur toutes les données, incluant les nouvelles, exigent beaucoup de calculs et sont donc peu réalistes.

Le continual learning, ou apprentissage continu, vise justement à faire évoluer le modèle au rythme du flux de données : s’adapter, intégrer de l’information nouvelle et apprendre des tâches successives, sans repartir systématiquement de zéro. Il se distingue d’un simple réentraînement périodique par une contrainte essentielle : apprendre le nouveau sans détruire l’ancien.

Au fond, l’apprentissage continu cherche un compromis entre deux exigences opposées] : la plasticité, nécessaire pour apprendre du nouveau, et la stabilité, indispensable pour ne pas effacer l’ancien.

Pourquoi les modèles d’IA oublient-ils ?

La difficulté vient du fait qu’un réseau de neurones n’a pas une mémoire rangée en dossiers indépendants. Les mêmes paramètres – les mêmes neurones et les mêmes connexions – servent souvent à plusieurs tâches.

Si les tâches se ressemblent, cette mutualisation est utile : le modèle peut réutiliser des représentations déjà apprises. Mais si les tâches diffèrent, les mises à jour nécessaires à la nouvelle tâche entrent en concurrence avec ce qui faisait la réussite des anciennes.

Prenons un exemple simple. Un modèle industriel a appris à détecter des défauts sur des pièces métalliques à partir d’images prises avec une première caméra. Plus tard, l’usine remplace la caméra : la résolution, la luminosité et les reflets changent. Si l’on réentraîne le modèle uniquement avec les nouvelles images, il peut s’adapter au nouveau capteur, mais perdre en performance sur les images produites par l’ancien système. Ce n’est pas parce que les anciens défauts ont disparu ; c’est parce que les paramètres qui les reconnaissaient ont été modifiés pour résoudre le nouveau problème.

En production, les incidents publiés sont plus souvent décrits comme des « décalages de données » que comme de l’oubli catastrophique. Les deux problèmes restent liés : dès qu’un modèle est mis à jour avec des données récentes, il faut éviter d’effacer des compétences antérieures.

Une étude récente menée sur des modèles d’IA utilisés à l’hôpital illustre bien cette difficulté. Les chercheurs ont supervisé un système chargé d’estimer le risque de décès de patients hospitalisés. Avec le temps, les dossiers reçus par ce système ont changé : les patients n’étaient plus exactement les mêmes, certaines mesures médicales variaient, et les pratiques hospitalières ont été bouleversées, en particulier pendant le Covid-19.

Le problème n’est donc pas qu’un dossier isolé serait anormal. C’est l’ensemble des données qui se transforme peu à peu. Pour rester utile, le modèle doit alors être mis à jour avec des exemples plus récents. Dans l’étude, cette mise à jour permettait effectivement de meilleurs résultats qu’un modèle laissé tel quel. Mais il y a un risque : si on laisse le système « apprendre » trop sur les données récentes, le modèle peut se spécialiser et devenir très bon sur les cas nouveaux, tout en perdant une partie de ses capacités sur les cas plus anciens. Il s’adapte au présent, mais au prix d’un oubli du passé. C’est ce qu’on appelle l’« oubli catastrophique ».

Pour intégrer des informations nouvelles sans sacrifier ce qui a déjà été appris, plusieurs grandes familles de méthodes existent : rejouer une partie du passé, protéger certains paramètres, modifier l’architecture du modèle ou apprendre des représentations plus stables.

Garder en mémoire des exemples représentatifs

La première, assez intuitive, consiste à rejouer le passé. C’est le « replay » : on conserve une petite mémoire d’exemples représentatifs des tâches antérieures et l’on entraîne le modèle sur un mélange « nouvelles données + mémoire ». C’est une forme de révision : le modèle ne relit pas tout le manuel, mais revoit quelques pages bien choisies.

Dans un système de reconnaissance d’images qui apprend progressivement de nouvelles catégories, on peut garder quelques images typiques de chaque ancienne classe, mais aussi des cas ambigus proches des frontières entre classes. Des méthodes comme iCaRL ont popularisé cette idée : apprendre de nouvelles classes tout en gardant un petit ensemble d’exemples représentatifs des anciennes.

Lorsque stocker des données réelles est difficile – pour des raisons de confidentialité, de coût ou de stockage – on peut recourir à un modèle génératif. Entraîné sur le passé, ce modèle produit des exemples artificiels des anciennes tâches, qui jouent le rôle de « souvenirs » synthétiques. Cette stratégie, appelée generative replay, peut réduire le besoin de conserver les données originales.

Mais ces données synthétiques ne sont pas automatiquement équivalentes aux données initiales. Elles peuvent manquer de diversité, négliger les cas rares, amplifier certains biais ou produire des exemples plausibles mais trompeurs. Il faut donc les valider : vérifier qu’elles couvrent les anciennes classes, préservent les cas difficiles et maintiennent les performances sur des jeux de test indépendants.

Les travaux récents sur l’entraînement répété à partir de données synthétiques montrent aussi un risque d’« effondrement » du modèle : à force d’apprendre sur des données synthétiques, il peut perdre des informations sur la vraie distribution, surtout sur ses parties « rares ».

Toute la question est donc de décider quoi conserver (ou générer) lorsque l’on a un budget restreint : des exemples typiques, rares, difficiles, ou un mélange des trois.

À lire aussi : Apprendre à oublier : le nouveau défi de l’intelligence artificielle

Protéger certains paramètres du modèle

Une deuxième famille de méthodes vise non pas à conserver des exemples, mais à protéger certaines parties du modèle. L’idée est d’identifier les poids déterminants pour les tâches passées, puis d’ajouter une pénalité lorsqu’ils changent trop pendant l’apprentissage d’une nouvelle tâche. Le modèle peut continuer à apprendre, mais il paie un « coût » plus élevé lorsqu’il modifie des paramètres jugés importants pour ses compétences anciennes.

C’est le principe de méthodes comme Elastic Weight Consolidation : ralentir l’apprentissage sur les poids importants pour les tâches déjà vues, afin de réduire l’oubli.

Une approche voisine, mais différente, consiste à préserver le comportement de l’ancien modèle plutôt que ses poids. On ajoute alors un terme de coût qui encourage le modèle mis à jour à produire des sorties proches de celles de l’ancien modèle sur des données de référence. C’est le principe de la « distillation » : l’ancien modèle joue le rôle de professeur, et le nouveau apprend la nouvelle tâche sans trop s’éloigner des réponses du professeur. La méthode Learning without Forgetting repose sur cette logique, même lorsque les données initiales ne sont plus disponibles.

La différence est donc la suivante : la régularisation des poids demande de « ne pas trop déplacer ces réglages internes », tandis que la distillation demande de « garder un comportement proche de l’ancien modèle ». Dans les deux cas, on peut parfois limiter l’oubli sans stocker toutes les données passées.

Leur limite est le compromis imposé : si l’on protège trop le modèle, il devient moins plastique et apprend moins bien la nouvelle tâche. Dans l’exemple du changement de caméra, protéger les anciens paramètres peut aider à reconnaître les défauts déjà connus, mais une protection trop forte empêchera le modèle de s’adapter à la nouvelle luminosité ou à la nouvelle résolution.

Superposer à l’ancien modèle de nouvelles couches de neurones qui apprennent des nouvelles données

Une troisième stratégie consiste à éviter de faire tenir tous les apprentissages dans les mêmes paramètres. Plutôt que de modifier sans cesse le même réseau, on peut réserver des « espaces » distincts à différentes tâches.

Certaines approches figent les parties du réseau déjà apprises et ajoutent, pour chaque nouvelle tâche, de nouveaux modules reliés aux précédents. Les réseaux progressifs, par exemple, ajoutent de nouvelles colonnes de neurones tout en réutilisant les connaissances acquises par des connexions latérales. Le modèle bénéficie ainsi de l’expérience accumulée sans risquer de la dégrader.

D’autres méthodes apprennent à n’activer qu’une partie des paramètres selon la tâche ou le contexte. On peut imaginer le modèle comme un réseau routier : au lieu de faire passer toutes les tâches par la même route, il apprend quels chemins internes utiliser pour chaque situation. Les approches par masques d’attention ou par sélection de sous-réseaux suivent cette logique.

Enfin, lorsque la nouvelle tâche est trop éloignée des précédentes, on peut agrandir le modèle en lui ajoutant des neurones ou des modules. Des méthodes comme PackNet exploitent par exemple les redondances d’un grand réseau pour libérer puis réserver des paramètres à de nouvelles tâches.

Ces stratégies réduisent sensiblement l’oubli, mais elles ont un coût : le modèle peut grossir au fil du temps, et il faut parfois savoir, au moment de l’usage, quelle partie du réseau mobiliser. Dans certains cas, cette information est disponible — par exemple si l’on sait quelle tâche est demandée. Dans d’autres, le modèle doit aussi apprendre à reconnaître le contexte.

Apprendre des représentations plus stables

Une piste complémentaire consiste à agir plus en amont : il ne s’agit pas seulement de protéger le modèle ou de lui ajouter des modules, mais de lui apprendre des représentations internes plus stables.

Une représentation interne, ou embedding, est la description numérique qu’une couche intermédiaire fabrique à partir d’une donnée. Une image, un texte ou un signal de capteur est transformé en un vecteur de nombres qui résume certaines caractéristiques utiles : formes, textures, mots, régularités, anomalies. Si deux données se ressemblent, on aimerait que leurs représentations soient proches ; si elles correspondent à des classes différentes, on aimerait qu’elles soient bien séparées.

L’objectif est alors d’organiser cet espace de représentation de façon à ce qu’il change le moins possible lorsque de nouvelles tâches arrivent. On peut conserver quelques prototypes — des représentants typiques d’une classe — qui servent d’ancrages. On peut aussi utiliser des méthodes contrastives, qui rapprochent les exemples semblables et éloignent les exemples différents dans l’espace des représentations. Ces méthodes sont utiles parce qu’elles tendent à extraire des caractéristiques plus générales, donc moins dépendantes d’un contexte particulier.

On peut également pratiquer un replay en espace latent : au lieu de stocker les données brutes, on mémorise les activations produites par une couche intermédiaire du réseau. Cette stratégie peut réduire fortement le coût en mémoire et en calcul. Elle ne résout toutefois pas automatiquement toutes les questions de confidentialité : une représentation interne peut encore contenir des informations sensibles !

Combiner plusieurs mécanismes pour éviter les oublis catastrophiques

Dans les systèmes les plus efficaces, ces idées ne sont pas utilisées isolément. On combine fréquemment plusieurs mécanismes : un petit tampon de replay avec une régularisation des poids, du replay avec de la distillation, ou encore des représentations stables avec une architecture modulaire.

Le choix dépend des contraintes concrètes : budget mémoire, exigences de confidentialité, coût de calcul, vitesse d’adaptation attendue, criticité de l’application. Dans les domaines sensibles, comme la santé, l’apprentissage continu ne doit pas signifier qu’un modèle se modifie sans contrôle. Il doit s’accompagner d’une surveillance de la dérive des données, d’évaluations régulières, de garde-fous et d’une possibilité de revenir à une version antérieure du modèle.

L’apprentissage continu ne promet donc pas une IA qui apprendrait indéfiniment sans risque. Il propose plutôt une manière plus réaliste de maintenir des modèles utiles dans un monde qui change : apprendre du présent, sans effacer trop vite le passé.

Eric Moulines ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

27.05.2026 à 10:09

Tests de féminité aux JO : un seul gène peut-il déterminer le sexe d’une personne ?

Jean-François Bodart, Professeur des Universités, en Biologie Cellulaire et Biologie du Développement, Université de Lille

Texte intégral (1940 mots)

Pour les Jeux olympiques 2028, le Comité international olympique souhaite réserver la catégorie féminine aux athlètes « de sexe biologique féminin » ne portant pas le gène SRY, présenté comme le déclencheur génétique du développement testiculaire. SRY est certes un acteur clé de la différenciation sexuelle chez les mammifères et a longtemps été enseigné comme le « gène du sexe ». Mais la recherche en biologie du développement montre, aujourd’hui, que le sexe ne se résume ni à ce gène, ni même aux seuls chromosomes XX et XY. En effet, chromosomes non sexuels (autosomes), hormones, récepteurs et environnement s’entrecroisent pour produire une grande diversité de situations.

Depuis 2026, l’admissibilité à toute épreuve féminine des Jeux olympiques est, selon les nouvelles règles annoncées par le Comité international olympique (CIO) pour les JO 2028, réservée aux « personnes de sexe biologique féminin », non porteuses du gène SRY. Ce dernier est pris par le CIO comme critère d’exclusion, y compris pour des athlètes qui s’identifient comme femmes et répondent par ailleurs aux critères hormonaux (seuil de testostérone). Ce critère de port du gène SRY est critiqué par de nombreux spécialistes, perçu comme un indicateur de performance anachronique, reposant sur des bases scientifiques limitées et exposant les athlètes à des effets stigmatisants.

Historiquement, les règlements sportifs se sont d’abord appuyés sur des seuils de testostérone pour définir l’éligibilité à la catégorie féminine, en supposant qu’un taux plus élevé se traduisait mécaniquement par un avantage de performance.

Dans ce schéma, le rôle du SRY est implicite : ce gène influence les gonades, c’est-à-dire les organes responsables de la production des cellules sexuelles et de la sécrétion des hormones sexuelles, jouant de fait un rôle essentiel dans le développement sexuel. SRY oriente les gonades vers la différenciation en testicule, et favorise la production d’androgènes, hormones sexuelles stéroïdiennes (comme la testostérone) qui stimulent le développement et le maintien des caractères sexuels masculins. Ces hormones contribuent notamment à la masse musculaire, à la taille ou au pourcentage du volume sanguin occupé par les globules rouges (hématocrite), autant de facteurs susceptibles d’influencer certains résultats sportifs.

Mais même sur ce point, les données sont discutées : quelques études observent en moyenne un léger avantage pour les sportives avec les taux de testostérone les plus élevés, tandis que d’autres ne retrouvent pas de corrélation simple entre testostérone détectée dans le sang et performance, y compris chez les athlètes intersexes (athlètes nés avec des caractéristiques sexuelles, chromosomes, hormones, organes génitaux, qui ne correspondent pas exactement aux définitions « typiques » du masculin ou du féminin). La biologie du développement et la génétique montrent en effet une réalité beaucoup plus complexe et nuancée, qui déborde largement du cadre des seuls chromosomes sexuels. Le gène SRY ne contrôle pas à lui seul la différenciation des gonades en testicules.

XX, XY et SRY, « gène du sexe »

De manière classique, la détermination du sexe chez les mammifères est souvent présentée comme un mécanisme binaire : les individus XX deviendraient des femmes, les individus XY des hommes, grâce à l’action d’un « gène du sexe », SRY, localisé sur le chromosome Y. On parle de chromosomes sexuels pour désigner cette paire particulière (XX ou XY) qui, contrairement aux autosomes ou chromosomes non sexuels, diffère généralement entre femelles et mâles et porte une partie des gènes impliqués dans la détermination du sexe, comme SRY sur le Y.

Au cours du développement, les gonades du fœtus sont d’abord indifférenciées. Sous l’effet de SRY, elles s’orientent habituellement vers un développement testiculaire, tandis qu’en l’absence de SRY fonctionnel elles évoluent plutôt vers un développement ovarien.

Au début des années 1990, plusieurs équipes ont montré que le gène SRY, situé sur le chromosome Y pouvait être : impliqué dans la mise en place des testicules, présent chez des personnes XX avec un corps « masculin », altéré chez certaines personnes XY au corps « féminin », ce qui le rend nécessaire au développement testiculaire. Des expériences chez la souris ont ensuite prouvé qu’exprimer le gène SRY dans un embryon XX suffit pour qu’il développe des testicules. Ces résultats ont bouleversé les modèles précédents en instaurant l’idée qu’un seul gène peut déclencher toute la cascade de différenciation sexuelle vers le masculin. Cette vision reste cependant très simplificatrice.

Par exemple, l’étude des « variations du développement sexuel » (VDS, ou Disorders/Differences of Sex Development en anglais, DSD) remet en question la stricte équivalence XX = femme et XY = homme. Les variations du développement sexuel sont rares : en France et dans les pays aux profils similaires, les estimations cliniques situent leur fréquence autour d’une naissance sur 2 500 – 4 500, soit de l’ordre de 0,02 - 0,04 % des naissances, selon les définitions retenues. Ces troubles/variations du développement sexuel incluent, par exemple, des individus XY qui présentent des gonades mal développées, souvent réduites à des bandelettes fibreuses non fonctionnelles et un phénotype féminin, ou, inversement, des individus XX présentant des caractères typiquement masculins. Ces variations du développement sexuel, régulièrement rencontrées en clinique pédiatrique et endocrinologique, soulignent que ce que l’on appelle « sexe biologique » recouvre en réalité plusieurs dimensions (chromosomique, gonadique, phénotypique, hormonale) qui ne sont pas toujours alignées.

Un réseau de gènes pour déterminer le sexe

L’analyse moléculaire de la différenciation en testicule ou en ovaire chez les mammifères montre que cette différenciation ne résulte pas de l’action isolée de SRY. Plusieurs gènes s’activent ou se répriment de manière coordonnée dans le temps et dans l’espace. SRY constitue un signal d’initiation majeur dans la gonade XY, mais la mise en place puis la conversion durable de la gonade indifférenciée en testicule fonctionnel avec production d’hormones (androgènes) reposent ensuite sur des facteurs situés sur les chromosomes non sexuels (autosomes). On peut citer parmi eux les gènes SOX9 ou CBX2. Les gènes comme RSPO1 et WNT4 sont, quant à eux, impliqués dans le maintien d’un destin ovarien.

Les phénotypes observés lors de mutations de ces gènes illustrent leur rôle déterminant. Chez l’humain, des anomalies d’expression du gène SOX9 (par exemple des délétions régulatrices en amont du gène) chez des sujets XY peuvent entraîner un développement incomplet ou anormal des gonades et un phénotype féminin malgré un gène SRY fonctionnel.

À l’inverse, des mutations de RSPO1 ou de WNT4 peuvent, chez des individus XX humains, favoriser la formation de tissu testiculaire et une virilisation marquée des organes génitaux externes, en l’absence de chromosome Y.

Il existe donc des femmes XY et des hommes XX, parce que des gènes autosomiques ont fait basculer la cascade du développement sexuel dans un sens ou dans l’autre.

Autrement dit, SRY déclenche une trajectoire, mais ne la détermine pas à lui seul.

Au‑delà du génome : hormones, récepteurs et environnement

Les caractères sexuels secondaires (musculature, pilosité, voix, répartition des graisses, cycles menstruels, etc.) dépendent fortement des hormones sexuelles et de la sensibilité des tissus à ces hormones via leurs récepteurs. Ces hormones, comme les œstrogènes et les androgènes, agissent sur des milliers de gènes répartis sur l’ensemble du génome, et non pas seulement sur les chromosomes sexuels, avec des réponses qui varient selon les organes, l’âge, la nutrition, l’activité physique ou l’exposition à des perturbateurs endocriniens.

Des études récentes d’expression des gènes à l’échelle du génome montrent d’ailleurs de nombreuses différences d’expression génique entre femmes et hommes, qui concernent surtout des gènes sur les chromosomes non sexuels, dont l’activité est modulée par le contexte hormonal et le type de tissu. Même si le caryotype (composition en chromosomes, par exemple XX ou XY) joue un rôle important, la biologie du sexe chez les mammifères résulte ainsi d’interactions continues entre gènes, hormones et environnement au cours du développement et de la vie entière.

Un gène à lui seul ne suffit pas à « dire » le sexe

Les débats récents sur le sport de haut niveau reposent ainsi sur des dispositifs qui supposent que le sexe se laisse réduire à un simple marqueur génétique binaire. Or, la biologie contemporaine du développement décrit une réalité beaucoup plus riche : détermination chromosomique, différenciation gonadique, phénotype des organes génitaux (ensemble des caractères observables), profil hormonal et, au-delà, action de nombreux gènes autosomiques capables d’orienter ou d’inverser la trajectoire sexuelle.

Se pose une question plus large : que se passe-t-il lorsqu’on transforme un « fragment » de génome en critère de classement social ou sportif, alors qu’il ne reflète qu’une partie de la réalité biologique ? Comprendre cette complexité rappelle que le génome n’est pas un arbitre neutre, et que faire de la génétique un outil de tri mérite bien plus de prudence qu’un simple résultat de test ne le suggère.

Jean-François Bodart ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

25.05.2026 à 18:20

Comme l’humain, le chimpanzé a son propre style de dessin et le garde pendant des années

Cédric Sueur, Professeur des Universités en éthologie, primatologie et éthique animale, Université de Strasbourg

Marie Pelé, Directrice de recherche en éthologie, Institut catholique de Lille (ICL)

Texte intégral (1515 mots)

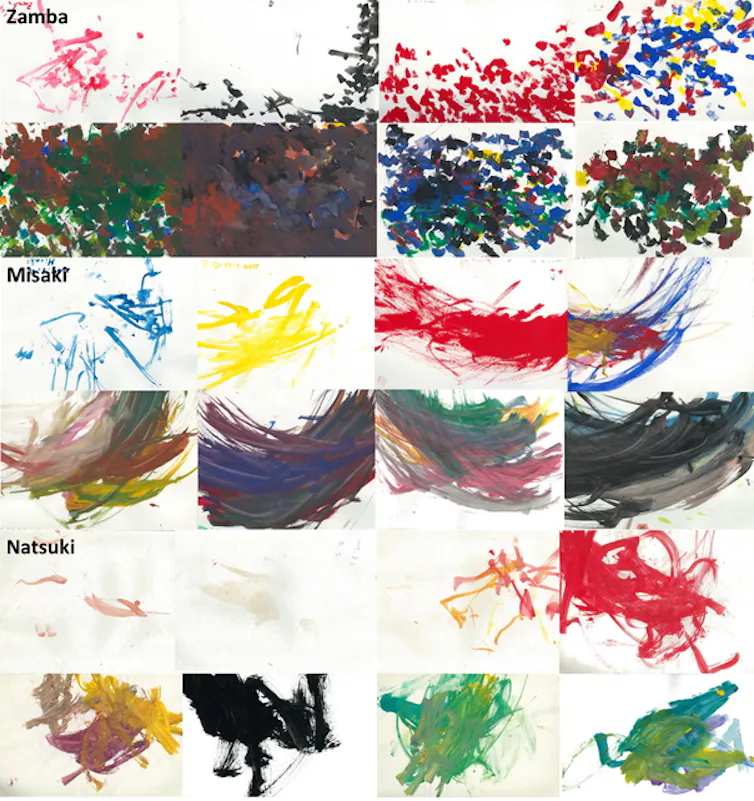

De même que chaque être humain possède une écriture reconnaissable ou que les peintres ont leur style artistique, les chimpanzés (Pan troglodytes) développent une manière de dessiner qui leur est propre et qui reste constante pendant des années. C’est ce que nous montrons dans notre récente étude parue dans la revue Primates.

Ainsi, le mâle Zamba remplit sa feuille de petits points compacts, disposés en grappes denses. Loi, lui, trace des courbes et des triangles répartis sur toute la feuille. La femelle Misaki, quant à elle, produit de grands motifs en éventail.

Ces différences ne relèvent pas du hasard : elles persistent de façon cohérente sur huit années d’observation, suggérant que le comportement graphique des chimpanzés reflète des traits individuels stables, et donc une forme de personnalité esthétique.

Comment cette découverte a-t-elle été réalisée ?

L’étude repose sur l’analyse systématique de 494 dessins produits entre 1999 et 2012 par six chimpanzés, hébergés au Great Ape Research Institute, au Japon. Ces animaux participaient librement à des séances de dessin proposées comme activité d’enrichissement cognitif, sans récompense conditionnelle : ils pouvaient entrer dans la salle, dessiner ou bien partir. Notons que, lors de leur première séance de dessin, les chercheurs leur montrent comment utiliser crayons, pinceaux et peinture et que tous les chimpanzés n’apprécient pas forcément cette pratique.

Quand un chimpanzé se désintéresse de son dessin et le laisse, il est récupéré, numérisé puis examiné, à l’aide d’une grille de 96 cellules permettant de quantifier dix variables dont le taux de remplissage de la feuille, le nombre de couleurs utilisées et leur chevauchement, la distance du dessin par rapport au centre de la feuille ou encore la présence de formes géométriques, telles que des boucles, des triangles ou des motifs en éventail.

Une analyse statistique a ensuite condensé ces mesures en trois grandes dimensions graphiques : le remplissage (densité et couverture), la forme (géométrie des tracés) et la couleur (diversité et superposition). Ces trois dimensions ont été comparées entre les individus, entre les saisons et au fil du temps pour chaque chimpanzé.

En quoi cette découverte est-elle importante ?

C’est la première fois qu’on démontre quantitativement, et durant plusieurs années, la stabilité d’un style graphique individuel chez un primate non humain. Nos études antérieures sur les orangs-outans ou d’autres chimpanzés avaient mis en évidence des différences entre individus, mais à des instants ponctuels ou sur de courtes périodes. Ici, les signatures individuelles persistent au cours d’une période de huit ans, indiquant que le dessin reflète des traits stables et récurrents, tels que les stratégies motrices, les préférences cognitives et les tendances exploratives, plutôt que des fluctuations d’humeur occasionnelles de la part des animaux.

Cette étude révèle par ailleurs que les dessins évoluent avec le temps : chaque chimpanzé remplit davantage la feuille, diversifie son utilisation des couleurs et ses formes au fil des mois et des années, un développement analogue à ce qu’on observe chez les enfants humains qui apprennent à dessiner. On note également un effet saisonnier marqué : en hiver, les productions sont plus légères et plus pauvres en formes, possiblement en lien avec une baisse générale d’activité liée au froid et à la luminosité réduite.

Enfin, si les chimpanzés utilisent préférentiellement leur main droite, ils peuvent aussi mobiliser les deux mains au sein d’un même dessin. Quand ils utilisent les deux mains, les chimpanzés couvrent une plus grande partie de la feuille et superposent davantage de couleurs.

Quelles sont les suites ?

Pour les chimpanzés, nous cherchons à agrandir la taille de la cohorte et à affiner nos résultats en déterminant s’ils sont capables de reconnaître leurs propres dessins.

Étendre cette approche à d’autres espèces de grands singes (gorilles, bonobos, gibbons – espèces encore jamais étudiées sous cet angle) permettrait de savoir si cette personnalité graphique est partagée par l’ensemble de ces espèces et d’en retracer l’histoire évolutive. L’utilisation de tablettes tactiles offrirait en outre accès à la dimension temporelle du dessin : l’ordre des couleurs ou la vitesse des tracés par exemple.

Sur le plan évolutif, la variabilité interindividuelle observée chez les chimpanzés pourrait refléter des comportements protographiques qui existaient chez les hominines (les gestes exploratoires de marquage de surfaces – tracer, gratter, pointer – qui précèdent et préfigurent le dessin intentionnel, sans en avoir encore la dimension symbolique ou représentative) bien avant l’émergence de l’art figuratif dont les premières traces datent de plus de 45 000 ans. Comprendre comment le geste exploratoire devient intentionnel, puis symbolique, passe sans doute par l’étude approfondie de nos plus proches cousins, comme nous l’avons suggéré chez les macaques.

Tout savoir en trois minutes sur des résultats récents de recherches, commentés et contextualisés par les chercheuses et les chercheurs qui ont menées ces dernières, c’est le principe de nos « Research Briefs ». Un format à retrouver ici.

Cédric Sueur a reçu des financements de l'université de Strasbourg (IDEX) et du CNRS MITI pour ces recherches. Il est membre de l'Institut Universitaire de France (IUF) et directeur de la Chaire Conservation et Culture des Grands Singes

Marie Pelé a reçu des financements de l'Université de Strasbourg (IDEX) et du CNRS MITI pour effecteur ces recherches.

24.05.2026 à 12:30

ChatGPT Santé se veut une aide pour les médecins et les patients. Est-ce fiable ? Quels risques pour la confidentialité et le secret médical ?

Nesrine Kaaniche, Associate professor, Télécom SudParis – Institut Mines-Télécom

Texte intégral (2040 mots)

En janvier 2026, OpenAI a lancé, aux États-Unis, ChatGPT Santé. Ce logiciel est principalement destiné aux patients pour les aider à mieux comprendre et à gérer leurs informations de santé. Il peut aussi être utilisé par les médecins afin de faciliter l’accès aux données médicales et d’améliorer le suivi des patients.

Avec une telle utilisation par les médecins et les patients, la protection des patients – que ce soit leur santé ou leurs données – et la préservation du secret médical dépendent des barrières techniques mises en place.

En pratique, ChatGPT Santé permet d’interpréter des résultats d’analyses, de suivre l’évolution de certains indicateurs, de préparer des rendez-vous médicaux ou encore d’obtenir des explications personnalisées à partir de données de santé.

Pour les patients, c’est un outil d’assistance informationnelle visant à les accompagner dans leur parcours de soins, sans se substituer aux professionnels de santé. Pour ces professionnels, ChatGPT peut servir d’aide au diagnostic.

Dans les deux cas, sa légitimité dépend d’un équilibre délicat : il s’agit de transformer des dossiers médicaux éparpillés en une aide au diagnostic fiable, tout en protégeant la vie privée des patients.

En effet, les données de santé, considérées comme sensibles, sont soumises à des réglementations bien précises. Leur confidentialité est essentielle pour garantir le respect du secret médical et limiter les risques d’utilisation abusive. En effet, un accès non consenti par des assureurs ou des banques pourrait entraîner des refus de couverture, des hausses de primes ou des refus de crédit fondés sur l’état de santé d’un individu.

Pour pouvoir garantir la confidentialité des données de santé transmises et traitées par ChatGPT Santé (ou d’autres systèmes équivalents), il faut résoudre des défis techniques majeurs : sécuriser les flux de données, garantir l’anonymisation dans un environnement massivement interconnecté, à la fois lors de la collecte de données, de l’entraînement du modèle et de son utilisation.

Fiabilité algorithmique et risque d’hallucination clinique

En tout premier lieu, la protection du patient repose sur la justesse des informations fournies par l’IA aux utilisateurs, patients comme médecins.

Le phénomène d’hallucination, inhérent aux architectures de type Large Language Model (LLM), prend une dimension critique en milieu clinique : une erreur de conversion d’unité ou une confusion posologique (par exemple, 5 milligrammes contre 50 milligrammes) peut engager le pronostic vital.

Pour neutraliser ce biais, OpenAI déploie des « mécanismes d’ancrage » (grounding) par l’intermédiaire de référentiels tels que HealthBench, un benchmark de 150 000 ressources validées par des pairs. Ce processus transforme l’IA en un moteur de synthèse documentaire où chaque affirmation est corrélée à une source vérifiable (DOI d’études, portails hospitaliers), ce qui permet aux patients de mieux comprendre les résultats de leurs analyses avec un jargon moins technique.

Pour les professionnels de santé, cet ancrage rend l’outil plus fiable, car il repose dès lors sur le concept de garantie humaine : l’interface ne se substitue jamais au décideur final (le médecin, quand il s’agit de poser un diagnostic), mais agit comme un médiateur d’informations dont la traçabilité permet au praticien de valider systématiquement la suggestion du modèle.

Sécuriser les flux de communication

L’architecture de ChatGPT Santé repose sur une organisation claire des différents éléments : les phases de calcul (à distance ou en local) afin de permettre la collecte des données, l’entraînement du modèle et son utilisation ; mais aussi les flux d’information entre différents terminaux (smartphones, laboratoires d’analyses, hôpitaux, data centers, etc.).

La circulation des données est gérée par la plateforme B.Well Connected Health. Cette infrastructure agit comme une interface consacrée au domaine médical, permettant de faire communiquer entre elles différentes sources de données même si elles sont très différentes.

Elle permet ainsi d’harmoniser des données variées, comme celles issues d’applications personnelles (Apple Health, MyFitnessPal) ou celles provenant des dossiers médicaux hospitaliers. En vérifiant que chaque donnée correspond bien au bon patient, et en garantissant que les données respectent les normes et règles en vigueur, la plateforme assure un flux de données déterministe ou associé à un seul utilisateur pour la phase d’inférence du LLM (c’est-à-dire son utilisation grâce à des prompts). L’ensemble de cette chaîne de traitement s’opère dans un environnement maintenu en isolation totale vis-à-vis du réseau public.

Contrairement à l’interface standard de ChatGPT, les informations cliniques des patients sont exclues du processus d’entraînement global du modèle de langage : elles ne modifient jamais les poids synaptiques du réseau de neurones global de ChatGPT. Ces données personnelles sont stockées uniquement dans un espace de recherche spécifique à chaque utilisateur, ce qui garantit que les informations sensibles restent séparées du modèle et de son évolution ultérieure.

De plus, l’architecture de ChatGPT Santé s’appuie sur la méthode RAG (Retrieval-Augmented Generation) : au lieu de mémoriser l’historique médical, le modèle consulte, lors de chaque requête, une base de données privée et isolée. Contrairement à une mémorisation classique, où un modèle pourrait intégrer et retenir directement des informations sensibles dans ses paramètres, ce mécanisme limite le risque que ces données soient apprises ou réutilisées involontairement par le modèle.

Cependant, ces vecteurs restent temporairement stockés sur les serveurs d’OpenAI, notamment pour des raisons de modération, jusqu’à trente jours. Cette conservation, même limitée, représente un point de vulnérabilité potentiel, car elle expose les données à un risque résiduel d’accès non autorisé.

Anonymiser les données pour éviter l’identification des patients

La protection des données dans ChatGPT Santé doit garantir que la nature des informations traitées ne permette pas l’identification du patient.

La première technique de « dés-identification » mise en place par OpenAI est bien sûr de retirer les identifiants directs, par exemple les noms de patients. Mais ceci n’élimine pas le risque de réidentification par corrélation de métadonnées, rendant l’anonymat vulnérable. En effet, une récente étude a démontré que le croisement de seulement trois points de données (une pathologie rare, une géolocalisation précise et un historique de fréquence cardiaque issu d’un wearable) permet une réidentification dans plus de 80 % des cas. Par sa capacité de corrélation, l’IA peut en effet lier des informations anonymes pour isoler un profil unique.

Pour neutraliser ce risque, ChatGPT Santé pourrait se reposer sur la « confidentialité différentielle », qui consiste à ajouter une petite perturbation aléatoire aux données afin qu’aucune analyse ne puisse être rattachée avec certitude à un individu.

L’efficacité du système dépend de la gestion de ce compromis entre bruit et confidentialité : un niveau de confidentialité trop élevé sacrifie l’utilité clinique des informations (qui sont trop bruitées pour être utiles), alors qu’un bruit insuffisant fragilise le secret médical face à la puissance d’analyse croisée des systèmes d’IA.

Garder les données confidentielles lors de la phase d’utilisation du LLM

Si ChatGPT Santé s’appuie sur un chiffrement de bout en bout pour sécuriser les flux de communication, le véritable défi réside dans la protection des données en cours d’utilisation, lors de la phase dite d’« inférence ».

En effet, l’architecture des modèles de type transformer impose à ce jour au système de déchiffrer l’information pour opérer ses calculs d’inférence. Cela implique que, même de manière fugitive, les données de santé résident en clair dans la mémoire vive (RAM) des serveurs de calcul, constituant un point de vulnérabilité face à des vecteurs d’attaque de type « extraction de mémoire ».

L’avenir de la confidentialité des données de santé repose sur des techniques de chiffrement avancées, notamment le chiffrement homomorphe. Cette approche permet d’effectuer des calculs directement sur des données chiffrées, sans avoir besoin de les déchiffrer au préalable. Autrement dit, il est possible de traiter les données tout en les gardant protégées, ce qui garantit que leur contenu reste inaccessible, même pendant leur utilisation.

Pour l’instant, OpenAI adopte une approche hybride : l’utilisation de serveurs spécifiques sur Microsoft Azure doit permettre de garder les données séparées des données des autres utilisateurs (ou celles d’autres applications que ChatGPT Santé). Cette organisation crée un environnement proche d’un système interne (également appelé « sur site »), même s’il repose sur le cloud. Elle permet de mieux protéger les échanges de données, mais n’élimine pas totalement les risques d’exposition temporaire lors de leur traitement.

Le conflit de souveraineté : les données françaises face aux lois états-uniennes

Enfin, le déploiement de ChatGPT Santé en Europe poserait un défi de souveraineté majeur.

En effet, en France, la législation impose l’hébergement des données cliniques chez des prestataires certifiés « Hébergeurs de données de santé ». Bien que Microsoft Azure dispose de centres de données certifiés en France (France Central), le calcul intensif requis par l’IA nécessite des processeurs ultrapuissants qui consomment énormément d’énergie. Pour des raisons de disponibilité électrique, ces moteurs de calcul sont souvent situés dans des fermes de serveurs hors de l’Union européenne.

Or, ce déport de la donnée vers des serveurs états-uniens déclenche l’application du Cloud Act, une loi qui permet aux autorités des États-Unis d’exiger l’accès aux informations gérées par une entreprise états-unienne, indépendamment de leur lieu de stockage physique.

Ce cadre entre en collision directe avec le règlement général sur la protection des données (RGPD) européen, créant un conflit de lois où la protection européenne s’effacerait devant les prérogatives de sécurité américaines.

Nesrine Kaaniche ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

22.05.2026 à 12:53

Comment fonctionnent les climatiseurs et pompes à chaleur ? L’éclairage de la thermodynamique

Alexandre Malley-Ernewein, Maître de Conférence au CETHIL (Centre d'Energétique et de Thermique de Lyon - UMR5008), Université Claude Bernard Lyon 1

Eric Peyrol, chercheur, Université Claude Bernard Lyon 1

Jocelyn Bonjour, Professeur des universités au CETHIL (UMR5008), INSA Lyon – Université de Lyon

Texte intégral (3165 mots)

De fortes chaleurs sont attendues sur la France dans le courant des prochains jours. Face à des étés toujours plus chauds, la climatisation est de plus en plus incontournable dans les commerces et les logis. Dans le même temps, les pompes à chaleur s’imposent pour chauffer de façon plus performante pendant la saison froide. Comment fonctionnent ces appareils ? Ils s’appuient en réalité sur les mêmes bases thermodynamiques. Mais attention : le changement climatique pourrait bien leur faire atteindre leurs limites physiques.

Après ceux de 2002 et de 2022, l’été 2025 a été le troisème été le plus chaud en France : deux vagues de chaleur l’ont marqué de par leur précocité, leur intensité et leur durée. Ainsi, l’été dernier a enregistré une anomalie thermique de + 1,9 °C (+ 3,3 °C pour juin).

En raison du changement climatique, et même lorsque nos sociétés auront atteint la neutralité carbone, la fréquence et l’intensité de ces épisodes de fortes chaleurs vont continuer à augmenter pendant plusieurs décennies. En conséquence, un sujet s’est imposé dans les discussions : la climatisation, en tant que moyen d’adaptation au changement climatique.

À lire aussi : La climatisation, une solution pour mieux vivre le réchauffement climatique ?

Avant même de débattre de la pertinence d’installer des climatiseurs et de mesurer leurs impacts (énergétique, sonore, thermique), il faut comprendre comment fonctionnent ces équipements. Les climatiseurs (et plus généralement, les systèmes de refroidissement) sont la directe application des principes d’une branche des sciences physiques, la thermodynamique, dont l’objet est l’étude des transferts d’énergie – en particulier de chaleur.

Spontanément, un transfert de chaleur survient du milieu présentant la température la plus élevée (la source chaude) vers celui de la plus faible température (la source froide). Par exemple, quand la température extérieure est supérieure à celle d’un local, le transfert de chaleur se produit de l’extérieur vers l’intérieur par l’intermédiaire des parois du bâtiment.

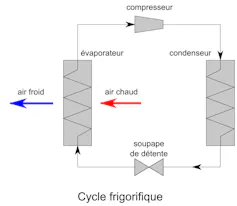

Un système de climatisation permet d’effectuer l’opération inverse, grâce à un apport d’énergie externe : prélever de l’énergie de la source froide (l’intérieur) pour la transférer vers la source chaude (l’extérieur). Il est alors possible de refroidir l’intérieur en rejetant l’énergie à l’extérieur, même s’il y fait plus chaud. Le principe de fonctionnement d’une pompe à chaleur (PAC) est le même : un local peut-être chauffé en récupérant de l’énergie à l’extérieur, alors même qu’il y fait plus froid.

Pour comprendre comment tout cela est possible, il faut mobiliser les savoirs issus de la thermodynamique.

Le cycle frigorifique, au cœur des climatiseurs et pompes à chaleur

Pour opérer ce transfert d’énergie, on tire parti des propriétés d’un fluide dit « frigorigène ». Ces derniers ont la particularité de pouvoir changer d’état, c’est-à-dire de passer d’une phase liquide à gazeuse et inversement. C’est souvent cette caractéristique qui sera utilisée pour extraire la chaleur.

On parle de « cycle frigorifique » pour décrire les quatre transformations successives qui sont permises par l’utilisation d’un climatiseur ou d’une pompe à chaleur.

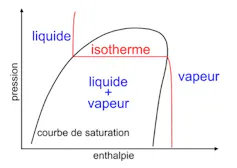

Ces transformations peuvent être représentées sur un diagramme enthalpique, aussi appelé « diagramme de Mollier ». L’enthalpie est une grandeur physique souvent utilisée en thermodynamique. Elle peut être envisagée comme un potentiel énergétique qui inclut à la fois les énergies thermique (chaleur) et mécanique, en lien avec des variations de pression et de volume du système.

Cette représentation peut sembler complexe à première vue, mais elle permet de visualiser rapidement l’évolution du fluide frigorigène et, en particulier, ses changements d’état. Elle présente la pression du fluide en ordonnée et son enthalpie en abscisse.

Ce diagramme est divisé en trois parties par la « cloche » qui est en son centre, nommée « courbe de saturation ». Celle-ci indique la limite entre différents états du fluide : à droite, le fluide à l’état de vapeur et, à gauche, le fluide sous forme de liquide. La zone située sous la courbe correspond à l’état de mélange liquide-vapeur du fluide.

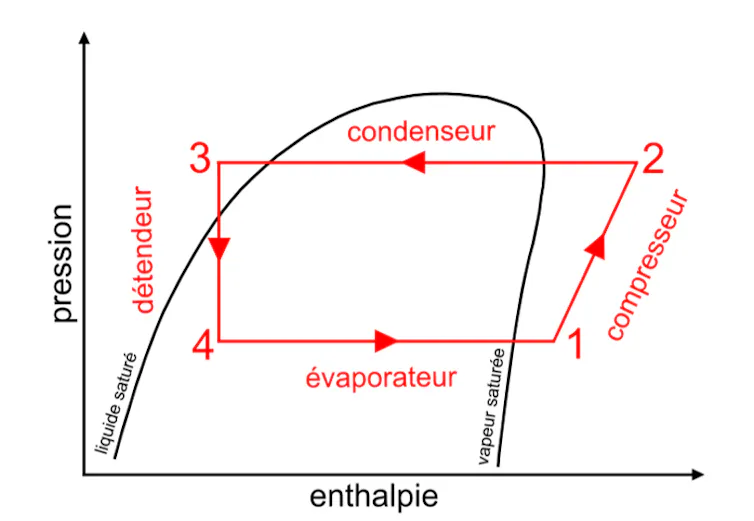

Ce diagramme sert à représenter les transformations du cycle frigorifique, comme le montre le schéma ci-dessous.

Les étapes sont les suivantes :

1 à 2 : le fluide frigorigène est à l’état de vapeur ; il est comprimé, ce qui fait augmenter sa pression et sa température ainsi que son enthalpie. C’est le seul apport d’énergie du cycle. Celle-ci est sous forme d’énergie mécanique, produite par un compresseur, qui lui-même consomme de l’électricité.

2 à 3 : le fluide, toujours à l’état de vapeur, mais à haute pression et haute température, traverse alors un échangeur de chaleur, dans lequel il va céder de l’énergie thermique à la source chaude (pour un climatiseur, l’air extérieur, pour une PAC en hiver, l’air intérieur), celle-ci étant nécessairement à une température plus basse que celle du fluide. Cet échangeur est appelé « condenseur », car ce refroidissement provoque la condensation de la vapeur qui devient liquide. L’enthalpie du fluide diminue alors.

3 à 4 : le fluide traverse un détendeur, où un changement de section de la conduite fait baisser la pression.

4 à 1 : le fluide, désormais majoritairement liquide, à basse pression et basse température, traverse un échangeur où il reçoit de la chaleur de la source froide (pour un climatiseur, l’air intérieur, pour une PAC en hiver, l’air extérieur), son enthalpie augmente. Cet échangeur est appelé « évaporateur », car le fluide frigorigène y passe de l’état liquide à celui de vapeur.

Ces transformations peuvent sembler contre-intuitives, car le fluide frigorigène cède de la chaleur majoritairement sans changer de température, mais en changeant d’état. C’est la différence entre chaleur sensible – liée à un changement de température – et chaleur latente – liée à un changement d’état de la matière.

Le cycle est entretenu tant qu’il y a un besoin de transférer de la chaleur de la source froide à la source chaude, grâce au fonctionnement du compresseur qui met le fluide en mouvement.

Lorsqu’un climatiseur est utilisé pour rafraîchir un local, le condenseur est placé à l’extérieur (le « split » extérieur) et l’évaporateur à l’intérieur (la « cassette »).

Dans le cas d’un système réversible, capable de chauffer en hiver et de refroidir en été, les échangeurs changent de rôle en fonction des saisons, à l’aide d’une vanne 4 voies.

Des systèmes poussés à leurs limites physiques par le changement climatique

Une des principales limites des climatiseurs réside dans leur principe même : leurs performances dépendent des caractéristiques du fluide frigorigène, mais aussi fortement des températures des sources froide et chaude.

Par exemple, l’énergie nécessaire à la compression augmente avec l’écart entre les températures des sources. Le coefficient de performance (COP), c’est-à-dire le rapport entre la chaleur extraite à l’évaporateur et l’électricité consommée, va alors baisser en proportion. C’est d’ailleurs pour cela que la consommation des pompes à chaleur, en hiver, augmente lorsque les températures extérieures diminues. Elles sont parfois munies, pour compenser la baisse du COP lors de températures extérieures très basses, de résistances électriques pour fournir un chauffage d’appoint.

En outre, un fluide frigorigène a des caractéristiques fixes, notamment l’enthalpie de changement d’état (et, en particulier, celle pour passer de l’état liquide à gazeux, que l’on appelle souvent « chaleur latente de vaporisation »), qui dépend de la pression et de la température. Si la température de la source chaude augmente, il ne sera peut-être pas possible de comprimer indéfiniment le fluide pour pouvoir lui céder de la chaleur. Autrement dit, on peut atteindre les limites physiques du cycle frigorifique pour le fluide utilisé.

Or, en France, avec le changement climatique, la température extérieure – la source chaude – va continuer à augmenter en été. Ainsi, un climatiseur installé en 2000 ou en 2020 ne sera pas nécessairement toujours capable de refroidir en 2035.

Par ailleurs, ces fluides ont un pouvoir de réchauffement bien supérieur à celui du CO₂, ce qui questionne leur usage en raison du risque de fuites. C’est pourquoi une réglementation de plus en plus contraignante s’applique à ces produits.

Des risques de « maladaptation » pour les villes

Dans ce contexte, deux problématiques vont se poser pour les villes : l’augmentation de la consommation électrique lors des périodes estivales et celle, locale, de la température dans les zones urbaines due au rejet de chaleur des climatiseurs.

Une étude de 2024 fondée sur des simulations numériques a ainsi montré, pour la ville de Toulouse (Haute-Garonne), que la généralisation de l’usage de la climatisation entraînerait une augmentation de la consommation énergétique en période estivale de 54 %. Si ces climatiseurs sont réversibles et peuvent assurer le chauffage en hiver, en fonctionnant comme une PAC, l’économie d’énergie sur l’année serait de l’ordre de 32 %, car ils ont un meilleur rendement que les chaudières et radiateurs qu’ils remplaceraient.

En 2012 déjà, d’autres simulations numériques montraient que, à Paris, l’augmentation locale de température due au rejet de chaleur pouvait atteindre 2 °C pendant une période de canicule similaire à celle de 2003. Ce résultat est toutefois à nuancer, car le modèle utilisé comporte des simplifications dans la représentation des phénomènes physiques. Ceci appelle à des études complémentaires.

Si les climatiseurs permettent d’évacuer la chaleur de nos lieux de vie, le changement climatique va exacerber leurs limites. Leur généralisation dans nos sociétés nous demande d’étudier leurs impacts sur nos environnements.

Dans tous les cas, elles ne sauraient être l’unique solution qui permettra d’assurer des conditions vivables, en particulier pour les publics les plus vulnérables (par exemple, personnes âgées, jeunes enfants, personnes malades).

À lire aussi : Climatisation : quelles alternatives au quotidien, quelles recherches pour le futur ?

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

21.05.2026 à 17:03

Face aux entreprises privées qui se ruent vers les étoiles, une gouvernance internationale de l’espace devient indispensable

Peter Brown, Professor in Physics and Astronomy, Western University

Texte intégral (2253 mots)

Il y a dix ans, l’orbite basse comptait 2 000 satellites actifs. Aujourd’hui, ils sont près de 20 000 et jusqu’à un million pourraient suivre. Une explosion du trafic spatial qui pousse les chercheurs à réclamer des règles internationales plus strictes.

Les académies des sciences des pays membres du G7 ont fait de la gouvernance internationale de l’espace un enjeu majeur en vue du sommet des dirigeants du G7, qui se tiendra en France du 15 au 17 juin à Évian (Haute-Savoie).

L’essor fulgurant des grandes constellations de satellites au cours de la dernière décennie ouvre la perspective d’un accès quasi universel à l’Internet haut débit. Mais cette croissance s’accompagne de risques encore mal compris.

Parmi ces risques figurent la pollution du ciel nocturne, les perturbations de la recherche astronomique, l’augmentation du risque de collisions entre satellites ainsi que les dangers liés au retour sur Terre d’un grand nombre de satellites.

Notre compréhension de l’impact humain sur l’environnement spatial proche de la Terre en est aujourd’hui à un stade comparable à celui des connaissances sur le changement climatique dans les années 1990. Nous savons que l’intensification des activités humaines provoque d’importantes perturbations dans l’environnement spatial, mais nous ignorons encore si un point de bascule est sur le point d’être atteint.

Dans ce contexte, l’une des recommandations les plus importantes adressées aux États membres du G7 consiste à créer un groupe intergouvernemental sur la durabilité spatiale (IPSS).

Des impacts sur la chimie de l’atmosphère

La recherche et les connaissances sur les impacts des activités humaines dans l’espace en sont encore à un stade très précoce. Ainsi, nous ne savons pas vraiment à partir de quel moment certaines altitudes orbitales deviendront tellement encombrées de débris spatiaux qu’elles atteindront leur capacité opérationnelle maximale.

Les scientifiques ont également récemment constaté que l’augmentation du nombre de lancements de fusées à l’échelle mondiale – avec plus d’une fusée lancée chaque jour désormais – pourrait entraîner une remise en cause de la reconstitution de la couche d’ozone.

De la même manière, nous savons que les satellites qui se consument lors de leur rentrée dans l’atmosphère terrestre auront des effets importants sur la chimie de la haute atmosphère. Nous savons également que plusieurs de ces retours de satellites se produisent désormais chaque jour, mais les conséquences exactes de ce phénomène restent encore mal comprises.

Une gouvernance spatiale fragmentée

Plusieurs organismes scientifiques conseillent aujourd’hui les pouvoirs publics sur les différents enjeux liés à la durabilité de l’espace. Parmi eux figure le Comité de coordination interagences sur les débris spatiaux, chargé des questions liées à la pollution de l’environnement spatial par les débris.

Autre acteur important : le Centre pour la protection d’un ciel sombre et silencieux de l’Union astronomique internationale, qui coordonne les initiatives destinées à limiter l’impact des satellites sur l’astronomie optique et radio.

Mais il n’existe aujourd’hui aucun organisme unique capable de fournir aux gouvernements une expertise globale pour éclairer les décisions politiques et réglementaires. La situation rappelle celle de la recherche sur le changement climatique, lorsque le Groupe consultatif sur les gaz à effet de serre (AGGG), créé dans les années 1980, a progressivement laissé place au Groupe d’experts intergouvernemental sur l’évolution du climat (GIEC).

Nous avons aujourd’hui un besoin urgent d’un groupe intergouvernemental sur la durabilité spatiale (IPSS).

Il y a dix ans, l’orbite basse terrestre comptait près de 2 000 satellites actifs ; aujourd’hui, leur nombre approche les 20 000. Ces dernières années, des gouvernements et des entreprises ont annoncé des projets pouvant conduire au lancement de jusqu’à un million de satellites supplémentaires.

Définir des seuils mondiaux

Comment cet IPSS pourrait-il être structuré pour aborder la gouvernance spatiale d’une manière comparable à celle dont le Giec a abordé le problème du changement climatique ?

L’un de ses premiers objectifs devrait être de définir des seuils mondiaux de durabilité. À l’image de la limite de 1,5 °C dans les sciences du climat, ce groupe devrait identifier les seuils au-delà desquels certaines altitudes orbitales atteignent leur capacité de charge.

Comme le Giec, un IPSS devrait s’appuyer sur plusieurs groupes de travail chargés de fournir aux décideurs des synthèses scientifiques transparentes et accessibles. L’un d’eux devrait se consacrer aux sciences physiques de l’environnement orbital. Il s’agirait notamment d’étudier l’état de l’orbite basse terrestre en tant que ressource limitée : évolution des débris spatiaux et des risques de collision, effets de la météorologie spatiale, ou encore modélisation d’un trafic spatial soutenable à l’avenir.

Un autre groupe de travail devrait se concentrer sur les impacts environnementaux et sociétaux des grandes constellations de satellites. Il pourrait évaluer l’appauvrissement de la couche d’ozone stratosphérique causé par les émissions des lancements de fusées, les effets de l’augmentation des retours de satellites dans l’atmosphère, les modifications de la chimie atmosphérique ainsi que les risques accrus d’accidents pour les populations. Il aurait également pour mission de mesurer l’impact de ces constellations sur l’astronomie au sol.

Enfin, un groupe de travail consacré aux politiques publiques et aux mesures d’atténuation pourrait jeter les bases de normes internationales claires concernant la désorbitation des satellites en fin de mission, le retrait actif des débris spatiaux et de nouvelles exigences en matière de licences prenant en compte le risque « systémique » d’une constellation, plutôt que le risque posé par chaque satellite pris individuellement.

L’empreinte du trafic spatial

L’IPSS pourrait aussi être complété par un groupe de travail consacré à l’empreinte du trafic spatial. Inspiré de la Task Force du Groupe d’experts intergouvernemental sur l’évolution du climat (Giec) sur les inventaires nationaux de gaz à effet de serre, cet organisme aurait pour mission de développer des méthodologies standardisées permettant aux États de mesurer et déclarer leur « empreinte de trafic spatial » – c’est-à-dire la pression exercée par leurs objets spatiaux sur la sécurité et la durabilité de l’orbite basse terrestre.

À l’instar du rôle joué par le Giec dans l’évaluation des modèles climatiques, l’IPSS devrait également fournir une expertise indépendante sur les affirmations concernant la désintégration contrôlée des satellites – autrement dit la manière dont les satellites sont retirés du service puis désorbités en toute sécurité. Cela impliquerait d’évaluer l’efficacité réelle des technologies de désorbitation, mais aussi notre capacité à suivre les satellites et à estimer précisément leur position.

En mettant en place dès aujourd’hui une approche internationale coordonnée, l’IPSS contribuerait à concilier les immenses promesses des activités commerciales spatiales avec les risques environnementaux qu’elles engendrent – de la même manière que le Giec pour le climat terrestre face aux activités humaines.

Peter Brown a reçu des financements du Conseil de recherches en sciences naturelles et en génie du Canada, de la National Aeronautics and Space Administration (NASA) des États-Unis, de l’Agence spatiale européenne, de Ressources naturelles Canada et de Recherche et développement pour la défense Canada.

21.05.2026 à 15:24

Comment les communautés d’arbres façonnent le fonctionnement souterrain des forêts européennes

Ludovic Henneron, Maître de Conférences en écologie, Université de Rouen Normandie

David Wardle, Professor at Department of Ecology, Environment and Geoscience, Umeå University

Paul Kardol, Professor, Division of Forest Microbiology, Swedish University of Agricultural Sciences

Stephan Hattenschwiler, Directeur de recherche CNRS. Directeur du département "Ecologie Fonctionnelle", Centre national de la recherche scientifique (CNRS)

Texte intégral (1749 mots)

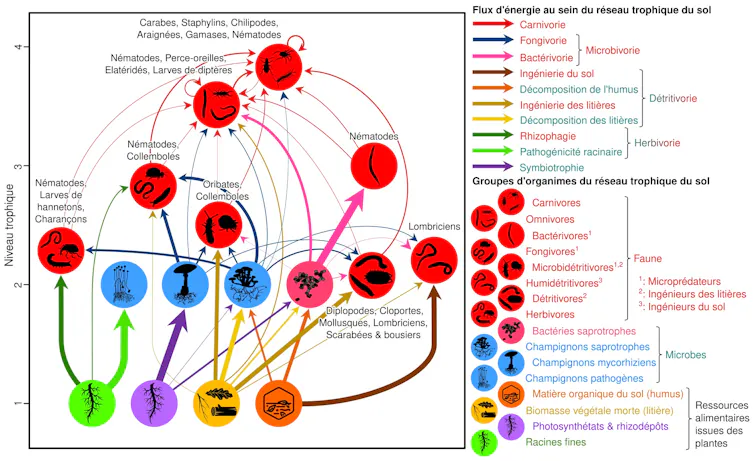

Les écosystèmes du monde entier évoluent rapidement sous la pression des changements globaux tels que le réchauffement du climat, les changements d’usage des terres ou les invasions biologiques, mais ce qui se passe sous terre reste encore mal compris. On sait, par exemple, que les plantes jouent un rôle central dans les « réseaux trophiques », ces ensembles d’interactions d’ordre alimentaire entre les êtres vivants d’un écosystème. Cependant, nous connaissons encore mal la manière dont les communautés végétales, les essences d’arbres d’une forêt par exemple, influencent la circulation de la matière et de l’énergie par les interactions trophiques entre organismes du sol, tels que les microbes (champignons et bactéries) et la faune détritivore, herbivore et carnivore.

Dans notre étude récente, publiée le 6 avril dans Nature, nous nous sommes penchés sur 64 forêts européennes, sur les espèces d’arbres qui s’y trouvent et sur le problème de savoir comment celles-ci influencent l’activité du réseau trophique du sol en matière de flux d’énergie au sein de celui-ci.

Nous avons découvert que les forêts dominées par des espèces d’arbres priorisant l’acquisition des ressources (eau, nutriments et lumière) et étant ainsi capables d’une croissance rapide, comme le charme commun (Carpinus betulus) ou le bouleau verruqueux (Betula pendula), présentent une activité du réseau trophique du sol plus élevée. Ces arbres fournissent, en effet, davantage de matière organique fraîche de bonne qualité nutritive et créent des microclimats plus chauds, stimulant le métabolisme des organismes du sol et accélérant des processus comme la décomposition des matières organiques et le recyclage des nutriments du sol.

À l’inverse, les forêts dominées par des espèces d’arbres priorisant la conservation des ressources, comme le pin sylvestre (Pinus sylvestris) ou l’épicéa commun (Picea abies), et dont la capacité de croissance est ainsi plus lente, présentaient une activité du réseau trophique du sol plus faible.

En d’autres termes, l’identité des espèces et leurs « traits fonctionnels » liés à leur stratégie d’allocation des ressources au sein d’une communauté d’arbres sont plus importants qu’on ne le pensait auparavant.

Étonnamment, le simple mélange de différentes espèces d’arbres n’a pas amélioré le fonctionnement du sol – et l’a même souvent légèrement réduit – malgré l’augmentation de la croissance aérienne des arbres induit par cette diversification. Ce décalage met en lumière un point essentiel : ce qui profite aux arbres en surface ne profite pas toujours au réseau trophique souterrain.

Pourquoi c’est important ?

Ces résultats ont des implications importantes pour la gestion forestière. Promouvoir la diversité des arbres à elle seule pourrait ne pas suffire à maintenir des sols sains, c’est-à-dire capables de fonctionner afin d’assurer la fourniture de multiples services bénéficiant à l’humanité. En revanche, sélectionner les espèces d’arbres en fonction de leurs traits fonctionnels, tels que leur activité métabolique ou leur capacité de croissance, pourrait s’avérer plus efficace pour préserver la vitalité des écosystèmes forestiers.

À l’avenir, le changement climatique devrait accroître la fréquence et l’intensité des sécheresses et ainsi favoriser des espèces d’arbres priorisant la conservation des ressources, car ils sont plus résistants à la mortalité par cavitation induite par le stress hydrique. Nos découvertes suggèrent que ce changement dans la composition en espèces des communautés d’arbres pourrait ralentir le fonctionnement du sol, avec des répercussions importantes pour le recyclage de la matière organique du sol, la disponibilité des nutriments et la régénération forestière. Globalement, l’étude souligne la nécessité de prendre en compte les dynamiques aériennes et souterraines dans la gestion des forêts face aux changements climatiques.

Quelles sont les suites ?

Cette recherche ouvre la voie à de multiples perspectives de recherche.

Il serait ainsi intéressant d’étudier de nouveau ces communautés d’arbres et le fonctionnement du réseau trophique du sol de ces forêts de manière répétée dans le temps, afin de suivre la dynamique temporelle conjointe des comportements aérien et souterrain en lien avec les changements globaux en cours. Ceci permettrait de mieux comprendre les liens de causalité en jeu.

Ce travail de recherche pose également des questions concernant l’importance relative pour la nutrition des organismes du sol de différentes sources d’aliments fournis à la base du réseau trophique par les plantes. Parmi celles-ci, on compte les litières, qui constituent l’apport dominant de matière végétale sous forme de feuilles, racines et tiges mortes nécessitant une décomposition pour s’en nourrir. On compte aussi les racines vivantes, qui peuvent être consommées directement par les herbivores ou les pathogènes mais apportent aussi au sol des matières organiques fraîches sous forme soluble directement accessible pour les organismes du sol par un phénomène appelé « rhizodéposition ».

Le projet SoilForEUROPE (ANR-16-EBI3-0009) est soutenu par l’Agence nationale de la recherche (ANR), qui finance en France la recherche sur projets. L’ANR a pour mission de soutenir et de promouvoir le développement de recherches fondamentales et finalisées dans toutes les disciplines, et de renforcer le dialogue entre science et société. Pour en savoir plus, consultez le site de l’ANR.

Ludovic Henneron a reçu des financements de l'ANR (Appel à projets générique 2024, projet Jeunes Chercheuses et Jeunes Chercheurs) pour le projet PLASTRAIT (Plasticité de la qualité des litières foliaires d'arbres : conséquences pour le recyclage de l'azote du sol et les interactions plantes-plantes).

Paul Kardol a reçu des financements de BiodivERsA COFUND call for research proposals, with the national funders Agence Nationale de la Recherche (ANR, France), the Belgian Science Policy Office (BELSPO, Belgium), Deutsche Forschungsgemeinschaft (DFG, Germany), the Research Foundation Flanders (FWO, Belgium), the Swedish Research Council (FORMAS, Sweden).

Stephan Hattenschwiler a reçu des financements de BiodivERsA COFUND call for research proposals, with the national funders Agence Nationale de la Recherche (ANR, France), the Belgian Science Policy Office (BELSPO, Belgium), Deutsche Forschungsgemeinschaft (DFG, Germany), the Research Foundation Flanders (FWO, Belgium), the Swedish Research Council (FORMAS, Sweden) et du programme exploratoire français (France 2030) FairCarboN (ANR-22-PEXF-0001).

David Wardle ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

20.05.2026 à 15:51

Quelles solutions pour stabiliser le réseau électrique aujourd’hui ?

Damien Guilbert, Professor in Electrical Engineering, Université Le Havre Normandie

Texte intégral (2279 mots)

Derrière l’apparente simplicité d’une prise électrique ou d’une borne de recharge se cache pourtant une machinerie complexe, dont l’équilibre doit être maintenu en permanence. L’enjeu est de taille : garantir un approvisionnement fiable tout en poursuivant les objectifs de décarbonation – la France vise une neutralité carbone à l’horizon 2050.

Le 28 avril 2025, l’Espagne et le Portugal ont connu des perturbations majeures de leur réseau électrique, entraînant une coupure de plusieurs dizaines d’heures de la fourniture d’électricité affectant des millions de personnes. La France, pourtant interconnectée avec la péninsule ibérique, a été très peu touchée grâce à l’activation de mécanismes de protection du réseau français. En isolant ainsi les systèmes électriques, ces dispositifs ont permis d’éviter la propagation des perturbations aux pays voisins.

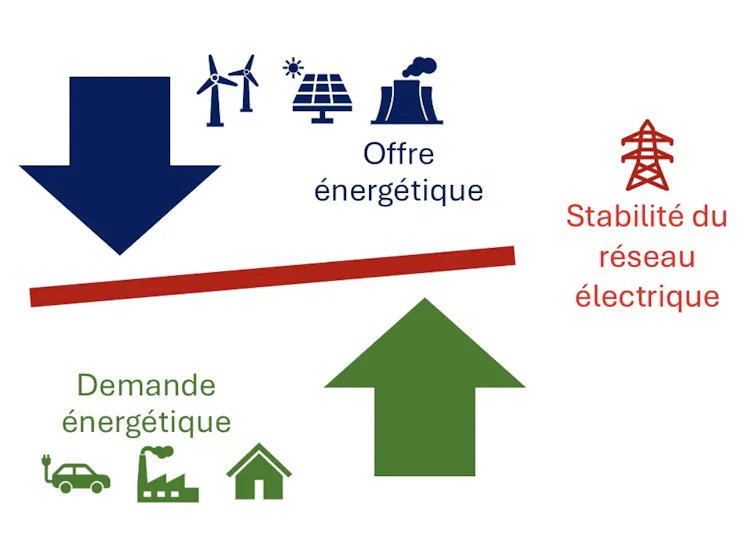

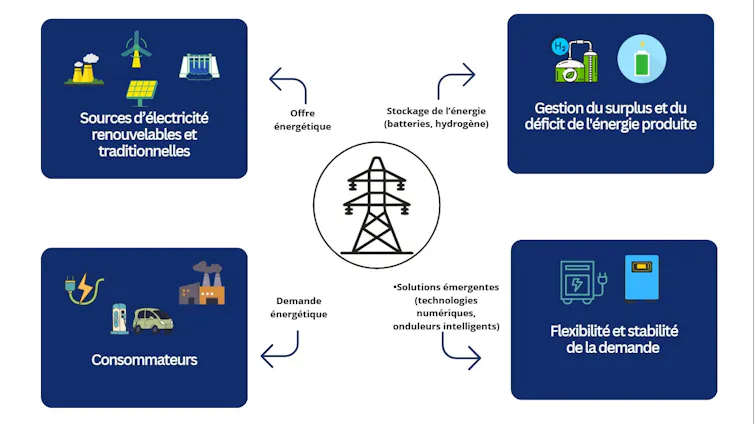

Cet épisode n’est pas un incident isolé : il illustre les défis croissants auxquels sont confrontés les systèmes électriques modernes. Ceux-ci doivent aujourd’hui répondre à plusieurs transformations simultanées : l’essor des énergies renouvelables, l’électrification croissante des usages (transports, chauffage, industrie), l’augmentation des échanges transfrontaliers d’électricité, mais aussi le vieillissement de certaines infrastructures électriques. Cela nécessite un changement profond des infrastructures existantes, tout en développant de nouveaux modes de gestion du réseau électrique, afin d’assurer en permanence l’équilibre entre production et consommation.

La bonne nouvelle est que plusieurs solutions pour assurer la stabilité du réseau progressent rapidement. Batteries, hydrogène, pilotage numérique de la consommation ou encore onduleurs intelligents permettent de rendre les réseaux électriques plus robustes et plus flexibles.

Le défi consiste désormais à déployer ces technologies à grande échelle et de manière coordonnée afin d’intégrer davantage d’énergies renouvelables tout en assurant une alimentation électrique fiable.

Les fondements de la stabilité du réseau