28.11.2025 à 13:13

L’effet ChatGPT : comment, en trois ans, l’IA a redéfini les recherches en ligne

Deborah Lee, Professor and Director of Research Impact and AI Strategy, Mississippi State University

Texte intégral (1881 mots)

Le 30 novembre 2022, OpenAI rendait accessible à tous ChatGPT, l’intelligence artificielle générative sur laquelle elle travaillait depuis sept ans. En trois ans, un geste du quotidien s’est déplacé : au lieu de taper une requête dans Google ou de chercher un tutoriel sur YouTube, des millions de personnes ouvrent désormais ChatGPT pour poser leur question. Ce réflexe nouveau, qui s’impose dans les usages, marque un tournant majeur dans notre rapport à la recherche d’information en ligne.

Il y a trois ans, lorsqu’il fallait réparer un robinet qui fuit ou comprendre l’inflation, la plupart des gens avaient trois réflexes : taper leur question sur Google, chercher un tutoriel sur YouTube ou appeler désespérément un assistant vocal à l’aide.

Aujourd’hui, des millions de personnes adoptent une autre stratégie : elles ouvrent ChatGPT et posent simplement leur question.

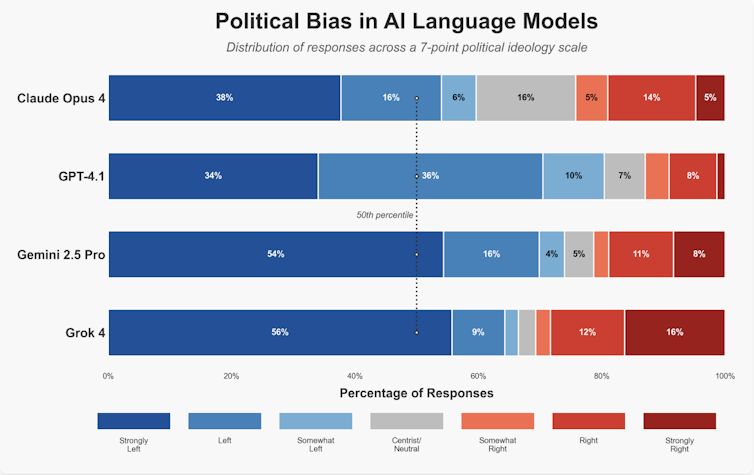

Je suis professeure et directrice de la recherche et de la stratégie en matière d’IA à la Mississippi State University Libraries. En qualité de chercheuse spécialisée dans la recherche d’informations, je constate que ce changement dans l’outil vers lequel les gens se tournent en premier pour trouver des informations est au cœur de la manière dont ChatGPT a transformé nos usages technologiques quotidiens.

Près de 800 millions de personnes utilisatrices hebdomadaires

Le plus grand bouleversement n’est pas la disparition des autres outils, mais le fait que ChatGPT soit devenu la nouvelle porte d’entrée vers l’information.

Quelques mois après son lancement, le 30 novembre 2022, ChatGPT comptait déjà 100 millions d’utilisateurs hebdomadaires. Fin 2025, ce chiffre était passé à 800 millions. Cela en fait l’une des technologies grand public les plus utilisées au monde.

Les enquêtes montrent que cet usage dépasse largement la simple curiosité et qu’il traduit un véritable changement de comportement. Une étude réalisée en 2025 par le Pew Research Center (Washington) indique que 34 % des adultes états-uniens ont utilisé ChatGPT, soit environ le double de la proportion observée en 2023. Parmi les adultes de moins de 30 ans, une nette majorité (58 %) l’a déjà testé.

Un sondage AP-NORC rapporte qu’aux États-unis, environ 60 % des adultes qui utilisent l’IA déclarent l’utiliser pour rechercher des informations, ce qui en fait l’usage le plus courant de l’IA. Ce taux grimpe à 74 % chez les moins de 30 ans.

Un bouleversement des usages

Les moteurs de recherche traditionnels restent le socle de l’écosystème de l’information en ligne, mais la manière dont les gens cherchent a, elle, considérablement changé depuis l’arrivée de ChatGPT. Les utilisateurs modifient tout simplement l’outil qu’ils sollicitent en premier.

Pendant des années, Google était le moteur de recherche par défaut pour tout type de requête, de « Comment réinitialiser ma box Internet » à « Expliquez-moi le plafond de la dette ». Ce type de requêtes informatives de base représentait une part importante du trafic. Mais ces petites questions du quotidien, rapides, clarificatrices, celles qui commencent par « Que veut dire… », sont désormais celles que ChatGPT traite plus vite et plus clairement qu’une page de liens.

Et les internautes l’ont bien compris. Une enquête menée en 2025 auprès de consommateurs américains a montré que 55 % des personnes interrogées utilisent désormais les chatbots ChatGPT d’OpenAI ou Gemini AI de Google pour des tâches qu’ils confiaient auparavant à Google Search, avec des taux encore plus élevés au Royaume-Uni.

Une autre analyse portant sur plus d’un milliard de sessions de recherche montre que le trafic issu des plateformes d’IA générative augmente 165 fois plus vite que les recherches classiques, et qu’environ 13 millions d’adultes, aux États-Unis, ont déjà fait de l’IA générative leur outil de prédilection pour explorer le web.

Les atouts de ChatGPT

Cela ne signifie pas que les gens ont cessé d’utiliser Google, mais plutôt que ChatGPT a capté les types de questions pour lesquelles les utilisateurs veulent une explication directe plutôt qu’une liste de résultats. Vous voulez connaître une évolution réglementaire ? Vous avez besoin d’une définition ? Vous cherchez une manière polie de répondre à un email délicat ? ChatGPT offre une réponse plus rapide, plus fluide et plus précise.

Dans le même temps, Google ne reste pas les bras croisés. Ses pages de résultats n’ont plus la même allure qu’il y a trois ans, car le moteur a intégré directement son IA Gemini en haut des pages. Les résumés « AI Overview », placés au-dessus des liens classiques, répondent instantanément à de nombreuses questions simples parfois avec justesse, parfois moins.

Quoi qu’il en soit, beaucoup d’utilisateurs ne descendent jamais plus bas que ce résumé généré par l’IA. Ce phénomène, combiné à l’impact de ChatGPT, explique la forte hausse des recherches « zéro clic ». Un rapport fondé sur les données de Similarweb révèle que le trafic envoyé par Google vers les sites d’information est passé de plus de 2,3 milliards de visites à la mi-2024 à moins de 1,7 milliard en mai 2025, tandis que la part des recherches liées à l’actualité se soldant par zéro clic a bondi de 56 % à 69 % en un an.

La recherche Google excelle dans la mise en avant d’une pluralité de sources et de points de vue, mais ses résultats peuvent paraître brouillons et davantage conçus pour générer des clics que pour offrir une information claire. ChatGPT, à l’inverse, fournit une réponse plus ciblée et conversationnelle, privilégiant l’explication au classement. Mais cette approche se fait parfois au détriment de la transparence des sources et de la diversité des perspectives qu’offre Google.

Côté exactitude, les deux outils peuvent se tromper. La force de Google réside dans le fait qu’il permet aux personnes qui utilisent ChatGPT de recouper plusieurs sources, tandis que l’exactitude de ce dernier dépend fortement de la qualité de la requête et de la capacité de l’utilisateur à reconnaître quand une réponse doit être vérifiée ailleurs.

Enceintes connectées et YouTube

L’impact de ChatGPT dépasse le cadre des moteurs de recherche. Les assistants vocaux comme les enceintes Alexa et Google Home restent très répandus, mais leur taux de possession recule légèrement. Une synthèse des statistiques sur la recherche vocale aux États-Unis pour 2025 estime qu’environ 34 % des personnes âgées de 12 ans et plus possèdent une enceinte connectée, contre 35 % en 2023. La baisse n’est pas spectaculaire, mais l’absence de croissance pourrait indiquer que les requêtes plus complexes se déplacent vers ChatGPT ou des outils similaires. Lorsqu’on souhaite une explication détaillée, un plan étape par étape ou une aide à la rédaction, un assistant vocal qui répond par une phrase courte paraît soudain limité.

En revanche, YouTube reste un mastodonte. En 2024, la plateforme comptait environ 2,74 milliards de personnes utilisatrices, un chiffre en progression constante depuis 2010. Aux États-Unis, près de 90 % des adolescents déclarent utiliser YouTube, ce qui en fait la plateforme la plus utilisée dans cette tranche d’âge. Cependant, le type de contenu recherché est en train de changer.

Les internautes ont désormais tendance à commencer par ChatGPT, puis à se tourner vers YouTube si une vidéo explicative est nécessaire. Pour bon nombre de tâches quotidiennes – « Comprendre mes avantages sociaux », « M’aider à rédiger un email de réclamation » –, ils demandent d’abord à ChatGPT un résumé, un script ou une liste de points clés, puis consultent YouTube uniquement s’ils ont besoin de visualiser un geste ou un processus concret.

Cette tendance se retrouve aussi dans des domaines plus spécialisés. Les développeurs, par exemple, utilisent depuis longtemps les forums comme Stack Overflow pour obtenir des conseils ou des extraits de code. Mais le volume de questions a commencé à chuter fortement après la sortie de ChatGPT, et une analyse suggère que le trafic global a diminué d’environ 50 % entre 2022 et 2024. Lorsqu’un chatbot peut générer un extrait de code et une explication à la demande, moins de gens prennent le temps de poster une question dans un forum public.

Alors, où va-t-on ?

Trois ans après son lancement, ChatGPT n’a pas remplacé l’écosystème technologique, mais il l’a reconfiguré. Le réflexe initial a changé. Les moteurs de recherche restent indispensables pour les explorations approfondies et les comparaisons complexes. YouTube demeure la plateforme incontournable pour voir des personnes réaliser des actions concrètes. Les enceintes connectées continuent d’être appréciées pour leur côté mains libres.

Mais lorsqu’il s’agit d’obtenir rapidement une réponse à une question, beaucoup commencent désormais par l’utilisation d’un agent conversationnel plutôt que par une requête dans un moteur de recherche. C’est là le véritable effet ChatGPT : il n’a pas simplement ajouté une application de plus sur nos téléphones, il a discrètement transformé notre manière de chercher de l’information.

Deborah Lee ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

26.11.2025 à 11:26

Les champignons d’Ötzi, l’homme des glaces du Néolithique

Hubert Voiry, Mycologue, Muséum national d’histoire naturelle (MNHN)

Texte intégral (1974 mots)

On l’oublie trop souvent mais les champignons ont accompagné l’histoire de l’humanité : médecine, géopolitique, psychologie, architecture, gastronomie, ils s’invitent dans de nombreux champs de nos vie depuis le Néolithique.

Dans cet extrait de son ouvrage Dix champignons qui ont changé la vie des hommes (éditions Actes Sud, 2025), le mycologue Hubert Voiry nous parle des deux champignons retrouvés par les archéologues dans la besace d’Ötzi, l’homme préhistorique découvert fortuitement en 1991 à 3 200 mètres d’altitude, dans les Alpes italiennes. Il tâche de comprendre pourquoi cet homme avait, avec lui des amadous et des polypores du bouleau.

Ötzi portait un petit sac en cuir rempli de matière noire. Dans ce sac, il y avait aussi trois outils en silex et un os en forme de poinçon. Au début, on a pensé que la matière noire était de la résine et que ce sac était une sorte de « kit » de réparation d’outils. Or, la substance, une fois séchée, a montré une teinte virant au brun. L’examen microscopique de cet objet a révélé qu’il s’agissait de la chair d’un champignon, l’amadouvier (Fomes fomentarius). Cette chair brune que l’on trouve sous la croûte (la face supérieure) du champignon avait été travaillée manuellement pour obtenir un produit de consistance fibreuse que l’on appelle l’amadou. Mélangées à cette matière, on a détecté aussi des traces de pyrite. Silex, pyrite et amadou ainsi réunis permettent d’allumer le feu et de le conserver.

Ce n’est pas le témoignage le plus ancien de l’usage de l’amadou pour le feu. Celui-ci a en effet été retrouvé en grande quantité associé à des nodules de pyrite sur le site archéologique de Star Carr en Angleterre qui date de près de 10 000 ans. On a fait les mêmes observations dans les fouilles archéologiques de Maglemose au Danemark, site qui remonte à 8 000 ans. Il existe aussi des témoignages plus récents datant de l’âge du bronze en Suisse, dans les sites préhistoriques d’anciens villages lacustres. L’amadou a donc la propriété de produire et de transporter le feu. Contrairement à une idée reçue, les humains de cette époque ne frappaient pas deux silex l’un contre l’autre pour allumer un feu, car les étincelles résultant de leur percussion sont trop éphémères pour enflammer un combustible. Ils avaient recours essentiellement à deux techniques : celle de la friction avec du bois et celle de la percussion, vraisemblablement utilisée par Ötzi. Dans la première, on dispose un morceau de bois à la verticale d’un autre placé au sol. On frotte le morceau de bois sur l’autre en lui donnant un mouvement de rotation avec les mains. Cela produit de la sciure échauffée qui va donner quelques braises. Ensuite, il faudra les mettre en contact avec des brindilles sèches. Ce procédé n’a pas laissé de traces archéologiques. L’autre méthode consiste à utiliser, comme Ötzi, pyrite, silex et amadou. La percussion d’un morceau de disulfure de fer (pyrite ou marcassite) contre une roche dure comme le silex produit des étincelles. L’amadou au contact de l’étincelle est capable de s’embraser facilement du fait de sa structure fibreuse, et le feu peut couver longtemps, ce qui facilite son transport. Il reste à produire des flammes en mettant par exemple en contact l’amadou incandescent avec des herbes très sèches ou des fibres d’écorce.

Pour faciliter l’embrasement, on a perfectionné la technique. L’amadou est débité en tranches fines qui sont amollies à coups de maillet puis qui sont mises à sécher. Au cours des siècles, des traitements au salpêtre ou aux cendres ont été mis au point pour qu’il s’enflamme plus facilement. Le célèbre mycologue Christiaan Hendrik Persoon en donne la description dans son ouvrage Traité sur les champignons comestibles, contenant l’indication des espèces nuisibles paru en 1818. Il précise que les bûcherons des Vosges avaient une technique moins recommandable pour traiter l’amadou : ils enterraient les tranches du “bolet” et les arrosaient pendant un certain temps avec de l’urine.

À partir de l’âge du fer, les morceaux de disulfure sont remplacés par des briquets, petits objets en acier qui au Moyen Âge avaient une forme de crochet aplati. Actuellement, on peut se procurer, dans le commerce, ce type de briquet appelé aussi briquet à silex et ainsi reproduire les gestes de nos ancêtres en frappant l’acier sur un silex aiguisé. On recueille les étincelles avec un morceau d’amadou ou à défaut avec un morceau de coton carbonisé. Les briquets “à amadou” qui apparaissent vers 1840 ne contiennent curieusement pas d’amadou. Le nom a été repris, mais c’est une mèche de coton trempée dans une solution chimique qui joue le rôle de l’amadou.

De nos jours, l’amadou est encore utilisé de façon traditionnelle pour le transport du feu, comme en Autriche lors du Weihfeuertragen, littéralement “le transport de feu consacré”. Le samedi de Pâques, le prêtre catholique réunit les familles de paroissiens autour d’un feu qu’il bénit au cours d’une cérémonie. Ensuite, les enfants récupèrent les braises à l’aide de bidons métalliques et passent dans les maisons du village apporter le feu béni. Pour faciliter le transport, ils ajoutent aux braises des morceaux d’amadou. En plus d’être le polypore le plus efficace pour la fabrication et le transport du feu, grâce à sa chair, l’amadouvier a aussi des vertus médicinales et artisanales, voire spirituelles. Un peuple de l’île d’Hokkaidō au Japon, les Aïnous, procédait, en cas de maladie ou d’épidémie, à un rituel de fumée autour des habitations. Ils faisaient brûler toute la nuit des fructifications de F. fomentarius pour éloigner les démons. Un rite analogue était pratiqué en Sibérie chez les Khantys et en Amérique du Nord dans des tribus amérindiennes.[…]

Le deuxième champignon retrouvé dans les affaires d’Ötzi est le polypore du bouleau, en latin : Fomitopsis betulina. Il se présentait sous forme de deux fragments enfilés sur une lanière de cuir. L’un de forme sphérique et l’autre de forme conique. Le polypore du bouleau, une fois séché, s’enflamme rapidement mais le feu ne couve pas. Ötzi ne l’a pas probablement pas utilisé pour le transport du feu, d’autant qu’il possédait déjà de l’amadou. Quel usage faisait-il donc des morceaux de ce polypore ?

Cette question a naturellement suscité des débats, dont sont ressorties deux grandes hypothèses. La première a été avancée par l’anthropologue italien Luigi Capasso : il suggère que l’Homme des Glaces était conscient de la présence de ses parasites intestinaux et les combattait avec des doses adaptées de Fomitopsis betulina. Ce champignon, qui est comestible – nous en reparlerons plus loin –, était probablement le seul vermifuge disponible à l’époque. L’autre hypothèse est défendue par la biologiste autrichienne Ursula Peintner : elle a fait le rapprochement avec certaines coutumes d’Amérindiens, rapportées par le biologiste américain Robert Blanchette. Ils possédaient des objets décorés avec des morceaux de forme ronde ou ovale d’Haploporus odorus, polypore à l’odeur très suave. Ces fragments étaient enfilés sur des lacets en cuir puis attachés aux tuniques sacrées ou aux colliers des guérisseurs. Ce polypore était aussi considéré comme ayant des vertus médicinales : on le faisait brûler pour produire une fumée agréable pour les personnes malades. Comme souvent dans les traditions, les aspects spirituel et médical sont mêlés. Concernant l’Homme des Glaces, nous avons bien noté que les bouts de F. betulina étaient enfilés sur une lanière de cuir de façon élaborée. S’il s’était agi d’un simple transport, ils auraient été placés sans perforation dans un récipient. On peut donc penser que les morceaux de F. betulina jouaient un rôle spirituel et médicinal. Robert Blanchette évoque aussi l’importance d’un autre champignon, Fomitopsis officinalis, aux propriétés médicinales pour les Amérindiens et leurs chamanes qui l’appellent “le pain des fantômes”. Les chamanes utilisaient des masques sculptés dans ces polypores pour effectuer des rites destinés à guérir certaines maladies. À leur mort, les masques étaient placés à la tête de la tombe et protégeaient l’esprit des chamanes. En Autriche, des fructifications de polypore du bouleau étaient sculptées pour protéger les animaux de ferme de la malchance. Le fragment conique du polypore d’Ötzi pourrait évoquer une sculpture qui n’aurait pas été très bien conservée. On pourrait donc considérer qu’Ötzi était un chamane qui portait sur lui, comme un talisman, ces deux fragments d’un champignon aux vertus médicinales et spirituelles. Rappelons que les affaires d’Ötzi n’ont pas été pillées, ce qui laisse supposer qu’on ne voulait pas s’approprier ses objets : c’était peut-être un personnage important.

Hubert Voiry est l'auteur de l'ouvrage « 10 champignons qui ont changé la vie des hommes », publié aux éditions Actes Sud dont ce texte est tiré.

26.11.2025 à 11:25

L’Univers a-t-il un début ? Le Big Bang contre la théorie de l’état stationnaire

Waleed Mouhali, Enseignant-chercheur en Physique, ECE Paris

Texte intégral (2417 mots)

La question de l’évolution de l’Univers a attisé de nombreux débats au cours de l’histoire de la physique. Au début du XXe siècle, deux camps de scientifiques s’affrontèrent : d’un côté, les tenants d’un Univers stable et ayant toujours existé, de l’autre, les physiciens qui adhèrent au modèle d’un atome primitif, ancêtre de notre théorie du Big Bang.

Au cours du XXe siècle, la cosmologie a été bouleversée par deux visions concurrentes du Cosmos. D’un côté, Georges Lemaître proposait l’hypothèse d’un « atome primitif », précurseur du Big Bang, selon laquelle l’Univers a une histoire et un commencement. De l’autre, Fred Hoyle, Thomas Gold et Hermann Bondi défendaient en 1948 une alternative : l’état stationnaire, un modèle où l’Univers, en expansion, reste inchangé à grande échelle grâce à une création continue de matière.

Cette théorie séduisait par son élégance : elle évitait l’idée d’un début absolu et renouait avec de vieilles intuitions philosophiques – puisqu’elles remontent à la Grèce antique – selon lesquelles le Cosmos était éternel et immuable. Mais elle allait bientôt se heurter à l’épreuve des observations. Le déclin de cette théorie fascinante s’inscrit dans une querelle scientifique majeure, au terme de laquelle le modèle de l’atome primitif de Georges Lemaître s’est imposé.

Le modèle de l’état stationnaire : un Univers éternel et immuable

En 1948, Fred Hoyle, Thomas Gold et Hermann Bondi introduisent le modèle cosmologique de l’état stationnaire. Leur approche repose sur deux principes fondamentaux. D’une part, le principe cosmologique parfait : non seulement l’Univers est homogène et isotrope dans l’espace – cela signifie qu’à grande échelle, l’Univers présente les mêmes propriétés en tout point et dans toutes les directions d’observation, aucun lieu ni direction n’est privilégiés – mais il l’est aussi dans le temps – ses propriétés sont globalement les mêmes à toutes les époques. D’autre part, ils postulent la création continue de matière pour compenser l’expansion observée de l’Univers mise en évidence par Hubble, de la matière est continuellement créée à un rythme très faible (de l’ordre d’un atome d’hydrogène par mètre cube tous les milliards d’années).

Ce modèle évite un commencement à l’Univers, et par conséquent la question philosophique et scientifique de la création de quelque chose à partir du néant. Il offre un cadre élégant, statique à grande échelle, dans lequel l’Univers n’a ni origine ni fin. D’un point de vue philosophique, il s’inscrit dans la continuité d’une vision éternelle du Cosmos, une position qui était majoritaire parmi les savants de l’Antiquité jusqu’au XVIIIe siècle, une idée déjà défendue par les stoïciens ou Aristote. À noter qu’Aristote s’interroge sur les limites de l’Univers et rejette l’idée d’un Univers infini, qu’il juge physiquement insoutenable.

Pourquoi le modèle de l’état stationnaire a-t-il séduit ?

Le modèle de l’état stationnaire a longtemps bénéficié d’un certain prestige pour plusieurs raisons. D’abord, sa simplicité philosophique, que l’on vient de décrire, mais aussi sa stabilité mathématique, puisqu’il repose sur des solutions simples des équations cosmologiques formulées par Einstein dans le cadre de sa relativité générale. Enfin, il séduit aussi du fait de son esthétique scientifique : un Univers inchangé dans le temps apparaît comme harmonieux et prévisible.

Le modèle de l’état stationnaire avait donc tout pour plaire. Sûr de sa théorie, c’est Fred Hoyle, en voulant se moquer et tourner en dérision le modèle concurrent de l’atome primitif qu’il considérait comme absurde, qui forge le terme de Big Bang lors d’une émission de radio sur la BBC en 1949. Et pourtant…

Le modèle de l’atome primitif de Lemaître : un précurseur du Big Bang

Avant même la formulation du Big Bang moderne tel que nous le concevons aujourd’hui, le prêtre et physicien belge Georges Lemaître avait développé en 1931 une hypothèse audacieuse : le modèle de l’atome primitif. Selon lui, l’Univers aurait été créé à partir de la désintégration d’un « atome cosmique », un point originel dense et chaud, à l’origine de l’expansion de l’espace. Il complète ainsi un modèle qu’il avait commencé à formuler dès 1927, dans lequel il proposait déjà un Univers en expansion.

Vous avez tout à fait raison sur le point historique concernant Lemaître : dans son article de 1927, il obtient des solutions dynamiques des équations d’Einstein, établit déjà la relation distance-vitesse et en donne une première estimation, à partir notamment des redshifts mesurés par Slipher, sans s’appuyer sur Hubble. Les travaux de Hubble, publiés ensuite, ont surtout apporté la confirmation observationnelle systématique et ont contribué à populariser cette loi aujourd’hui appelée loi de Hubble-Lemaître. Il conçoit un Univers en expansion, mais doté d’un passé à la fois physique et avec un commencement. Lemaître imaginait l’atome primitif comme un noyau contenant toute la matière de l’Univers dont la fission aurait déclenché l’expansion cosmique. Il interprétait les rayons cosmiques, récemment découverts, comme des résidus de cette désintégration initiale. Cette hypothèse s’est avérée inexacte puisqu’ils proviennent en réalité de phénomènes astrophysiques situés dans notre environnement cosmique proche.

Lemaître accepte l’idée d’un début de l’Univers, tout en distinguant clairement cette question cosmologique de la Création au sens religieux, qu’il considère relever d’un tout autre registre. Le modèle de l’atome primitif est le précurseur direct de ce que l’on appellera par découvertes successives le modèle du Big Bang, qui s’imposera plus tard, notamment grâce à ses prédictions observables.

Les preuves observationnelles contre l’état stationnaire

Malgré son attrait initial, le modèle de l’état stationnaire a commencé à vaciller face à des données de plus en plus précises. Le coup le plus dur arrive en 1964, quand Arno Penzias et Robert Wilson détectent par hasard un signal radio bruité provenant de toutes les directions d’observation. Ce bruit, appelé rayonnement cosmologique, est en fait la lueur fossile laissée par l’Univers très jeune, exactement comme l’avaient prédit les partisans du Big Bang. Le modèle stationnaire, lui, n’a aucun moyen d’expliquer un tel vestige. Le fond diffus cosmologique, découvert en 1965, est le témoin le plus direct du Big Bang. Ses détails ont ensuite été étudiés par les satellites COBE (1992), WMAP (2003) et Planck (2009).

D’autres indices vont dans le même sens : les galaxies lointaines – dont l’image qui nous parvient d’elle date du moment où elles étaient encore jeunes – n’ont pas la même apparence que les galaxies actuelles. De plus, les quasars, sortes de noyaux galactiques hyperactifs, étaient bien plus nombreux dans le passé qu’aujourd’hui. Ces différences montrent que l’Univers évolue au fil du temps, contrairement à ce qu’affirmait l’état stationnaire.

Enfin, le Big Bang prédit avec une grande précision les proportions des éléments légers (hélium, deutérium, lithium) formés durant les toutes premières minutes. Les mesures des éléments fossiles qui sont parvenus jusqu’à nous confirment ces valeurs. Le modèle stationnaire, qui n’inclut pas de phase chaude et dense initiale, est incapable de les expliquer.

L’évolution de la cosmologie moderne

Face à ces observations, la communauté scientifique adopte progressivement le modèle du Big Bang comme modèle standard. Pourtant, Fred Hoyle, dans les années 1990, refusant d’abandonner son hypothèse, propose un modèle dit quasi stationnaire, mais il reste marginal.

Aujourd’hui, le modèle ΛCDM (Lambda Cold Dark Matter), une version étendue du Big Bang qui intègre la constante cosmologique, l’idée selon laquelle il existe une minuscule énergie du vide, identique partout, exerçant une pression qui accélère l’expansion de l’Univers, est considéré comme le cadre le plus complet pour décrire l’évolution de l’univers. Introduite par Einstein en 1917 pour contrecarrer l’effet de la gravité dans un Univers qu’il pensait lui-même statique, elle a été réhabilitée sous le nom d’énergie sombre pour expliquer l’accélération observée, est considéré comme le cadre le plus complet pour décrire l’évolution de l’Univers.

Le modèle de l’état stationnaire illustre un cas typique d’élégance théorique confrontée à la rigueur de l’expérimentation. Cette controverse a stimulé les débats, inspiré des développements mathématiques et permis une meilleure compréhension de ce qu’est une bonne théorie scientifique : cohérente, testable, et surtout, réfutable.

Elle rappelle aussi que la science avance non par dogme, mais par confrontation avec la réalité du cosmos. Et si certaines théories comme celle de la simulation ou du multivers flirtent aujourd’hui avec la frontière de ce que l’on est capable de tester, elles perpétuent une tradition millénaire : tenter de comprendre ce qui, depuis toujours, nous dépasse.

Waleed Mouhali ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

26.11.2025 à 11:25

Votre chien ou chat vieillit ? Des gestes simples pour prolonger sa qualité de vie

Sara Hoummady, DMV, PhD, Associate professor in ethology and animal nutrition, UniLaSalle

Texte intégral (3145 mots)

Déjà, ses premiers poils gris. Votre chien ou votre chat a pris un petit coup de vieux. Comment prendre soin de lui à présent ? Des chercheurs se sont penchés sur la question et prodiguent quelques conseils faciles à mettre en œuvre.

En France, avec une espérance de vie moyenne de 11,3 ans chez les chiens comme chez les chats, la gériatrie animale est devenue indispensable. Les connaissances progressent rapidement pour mieux accompagner ces animaux. On sait désormais que quelques aménagements simples améliorent nettement le confort et la qualité de vie d’un chat ou d’un chien âgé. L’essentiel pour les propriétaires est de ne pas rester observateur passif du vieillissement de leur compagnon à quatre pattes.

À quel âge mon chien ou mon chat peut-il être considéré comme âgé ?

Une recherche portant sur plus de deux millions de chats et plus de quatre millions de chiens a permis de mieux définir leurs différents stades de vie.

Chez le chat, l’entrée dans le « troisième âge » se situe autour de 10 ans. Le « troisième âge » comprend le stade mature, senior et super-senior.

Selon cette même étude, pour le chien, la situation est moins uniforme : la vitesse de vieillissement dépend fortement de la taille.

Les chiens de petit format (toy et small, des races dont le poids est inférieur à 9 kg, comme les chihuahas ou les cavalier king charles) entrent dans le troisième âge vers 7 ans, puis deviennent seniors autour de 12 ans.

Les chiens de format moyen à grand, de plus de 9 kg, comme les welsh corgis, les golden retrievers ou les bergers australiens par exemple, y accèdent plus tôt : environ 6 ans pour le début du troisième âge, puis 10 ans pour le stade sénior.

Il est important d’être rassuré : passer dans ce nouveau stade ne signifie absolument pas que “la fin” approche. Cela indique surtout qu’il est temps d’être plus attentif à son compagnon et d’adapter progressivement son suivi, son environnement et ses soins pour l’aider à vieillir dans les meilleures conditions.

Qu’est-ce qu’un vieillissement sain ? Comment l’évaluer chez son animal ?

Avant de parler de « vieillissement sain », il est utile de rappeler ce qu’est le vieillissement : un processus naturel, progressif et inévitable. Avec le temps, les animaux tolèrent moins bien les stress de leur environnement et leurs cellules accumulent des dommages, ce qui entraîne des modifications physiologiques variées.

Qu’entend-on alors par un chien ou un chat vieillissant « en bonne santé » ? Un récent article de consensus auquel j’ai participé propose une définition adaptée à nos animaux de compagnie : un animal âgé en bonne santé est celui qui conserve suffisamment de capacités et de résistance pour répondre à ses besoins physiques, comportementaux, sociaux et émotionnels, tout en maintenant une relation stable et positive avec son humain.

Certains signes sont tout à fait normaux : poils qui grisonnent, léger tartre, peau plus fine, perception sensorielle un peu diminuée mais sans impact notable sur la qualité de vie.

En revanche, des difficultés locomotrices entravant l’accès aux ressources (difficulté à se lever, à monter les escaliers ou à interagir facilement avec vous) ne doivent pas être considérées comme de simples manifestations de l’âge. Il en va de même avec les premiers signes de dysfonction cognitive (un syndrome qui présente quelques similitudes avec Alzheimer), lorsqu’un chien ou un chat a du mal à retrouver sa gamelle ou semble perdu dans la maison, par exemple. Ces cas nécessitent un avis vétérinaire.

La qualité de vie devient donc le critère central pour évaluer si un animal suit une trajectoire de vieillissement harmonieuse. Chez le chien et le chat, on utilise désormais la notion de fragilité, issue de la gériatrie humaine (voir tableau ci-dessous).

Comment évaluer la fragilité de son animal ?

Les animaux classés comme fragiles sont plus susceptibles de développer des maladies et doivent faire l’objet d’un suivi plus rapproché.

L’intérêt majeur de cette approche est que, comme chez l’humain, la fragilité repérée tôt pourrait parfois être atténuée. D’où l’importance d’un dépistage régulier et d’un accompagnement précoce pour soutenir au mieux nos compagnons âgés.

Quelques aménagements à mettre en place

La première étape consiste à rendre l’environnement de l’animal plus accessible afin qu’il puisse atteindre facilement toutes ses ressources : nourriture, eau, lieux de repos, espaces de cachette, zones d’interaction… De simples aménagements peuvent déjà faire une vraie différence : petits escaliers pour monter sur le canapé, chauffeuses ou coussins fermes et peu hauts, gamelles surélevées pour les chiens et chats souffrant d’arthrose.

Multiplier les points d’accès est également utile : deux ou trois zones d’alimentation, plusieurs endroits pour dormir, et davantage de litières, faciles à enjamber. Certains bacs du commerce sont trop hauts pour des chats arthrosiques ; un plateau large à rebord bas peut être bien plus confortable.

Maintenir une relation apaisée et positive apparaît essentiel. Un comportement jugé « indésirable » doit toujours être investigué avec un vétérinaire et un comportementaliste (ou un vétérinaire comportementaliste) : il peut en effet traduire un besoin, un inconfort ou une difficulté. Un chat qui griffe le tapis plutôt que son arbre à chat, par exemple, peut simplement chercher une position moins douloureuse. Certains animaux deviennent aussi plus anxieux ou plus réactifs avec l’âge ou certaines conditions médicales ; il est alors important d’en comprendre la cause plutôt que de sanctionner, au risque d’abîmer la relation et de ne pas régler la problématique.

La stimulation cognitive et physique doit se poursuivre, mais en s’adaptant aux capacités de l’animal. Les « puzzle feeders »(ou gamelles interactives, des bols où les animaux doivent résoudre des jeux pour avoir leur ration) restent intéressants, à condition d’être choisis en fonction de son état : un tapis de fouille, une gamelle interactive à pousser du nez seront préférables à un système demandant des mouvements complexes des pattes. Les jeux, les apprentissages et les petits entraînements restent bénéfiques ; il suffit parfois de raccourcir les séances et d’utiliser des récompenses très appétentes (petits morceaux de blanc de poulet ou de saucisses…).

Les promenades peuvent être adaptées notamment en utilisant des sacs confortables et sécuritaires pour porter le chien lorsqu’il est trop fatigué, que ce soit pour une partie ou l’ensemble de la balade, l’important étant de continuer à ce que l’animal ait accès à l’extérieur.

L’alimentation joue enfin un rôle majeur dans l’accompagnement des animaux âgés. Le vieillissement entraîne une modification de la digestion et une perte progressive de masse musculaire. Il est donc recommandé de privilégier une alimentation facilement digestible, dont l’odeur et le goût attirent votre animal, et formulée spécifiquement pour les besoins des seniors. Les rations de viande crue sont à éviter : elles sont souvent déséquilibrées en minéraux, ce qui peut être délétère pour les animaux âgés, particulièrement sensibles aux excès de phosphore ou aux rapports calcium/phosphore inadaptés. Elles présentent également un risque sanitaire accru alors que leur système immunitaire est moins performant.

En revanche, combiner une alimentation sèche (croquettes) et humide (terrine, mousses…) est souvent bénéfique. Une ration cuite et faite maison (en suivant les conseils d’un vétérinaire) peut aussi aider un animal à retrouver l’appétit. Et pour les plus difficiles, une astuce simple peut suffire : tiédir légèrement l’aliment humide pour en renforcer l’odeur et la rendre plus attirante.

À quel moment faire intervenir le vétérinaire ?

Les visites de suivi chez le vétérinaire restent indispensables, notamment pour maintenir à jour le protocole vaccinal et le déparasitage. Avec l’âge, le système immunitaire perd en efficacité : un animal senior est donc plus vulnérable et nécessite une protection régulière contre les maladies infectieuses et les parasites.

Les consultations de gériatrie ont pour objectif de suivre l’évolution du vieillissement qui est propre à chaque individu. La première est souvent la plus longue : elle permet un échange approfondi et inclut, lorsque nécessaire, des examens complémentaires. Ces premiers éléments serviront de référence pour les visites suivantes. L’idéal est d’entamer ce suivi dès le début du « troisième âge ». La fréquence des consultations dépend ensuite de la trajectoire de l’animal : tous les six mois si des signes de fragilité apparaissent, ou une fois par an si son état reste stable.

L’enjeu n’est plus seulement d’allonger la durée de vie de nos compagnons, mais surtout de prolonger leur vie en bonne santé, en préservant leur qualité de vie le plus longtemps possible – une démarche qui rejoint celle adoptée pour les humains.

Sara Hoummady est membre de l'AFGASP (Association Française de Gériatrie Animale et de Soins Palliatifs). Elle a reçu la bourse de la FVE (Federation Veterinaire Européenne) pour ses travaux sur le vieillissement félin. Elle a fait partie d'un comité de réflexion sur le vieillissement sain chez le chien et le chat organisé par un petfooder.

22.11.2025 à 18:08

Effets secondaires des chimiothérapies : une molécule française prometteuse pour lutter contre les neuropathies périphériques, dont souffrent près de 90 % des patients

Laurence Lafanechère, Directrice de recherche CNRS, Université Grenoble Alpes (UGA)

Texte intégral (1623 mots)

Une nouvelle molécule capable de protéger les neurones des effets toxiques de la chimiothérapie, tout en renforçant l’efficacité de certains traitements anticancéreux, a été découverte et offre des résultats prometteurs chez l’animal. Une start-up a été créée pour continuer son développement et mener des études chez l’humain.

Picotements dans les mains et les pieds, brûlures, douleurs, perte de sensibilité, sensation d’engourdissement… Les neuropathies périphériques figurent parmi les effets secondaires les plus fréquents de la chimiothérapie, touchant jusqu’à 90 % des patients pour certains traitements. Leur sévérité conduit parfois les praticiens à ajuster, voire à réduire les doses de chimiothérapie, ce qui peut en diminuer l’efficacité.

Dans un cas sur quatre, ces atteintes nerveuses persistent des mois, voire des années après la fin du traitement. Elles rappellent alors chaque jour aux patients qu’ils ont eu un cancer – alors même que leurs cheveux ont repoussé et que les nausées ou la fatigue ont disparu. Aucun droit à l’oubli, même une fois la maladie vaincue

À ce jour, hormis le port de gants et de chaussons réfrigérants pendant les séances de chimiothérapie – une méthode pas toujours efficace et souvent désagréable –, aucun traitement préventif n’existe. Quelques médicaments palliatifs sont utilisés, pour atténuer la douleur, avec une efficacité modeste.

Notre équipe, en collaboration avec des chercheurs états-uniens et français, vient de franchir une étape importante avec la découverte d’un composé, baptisé Carba1, capable de protéger les neurones des effets toxiques de la chimiothérapie, tout en renforçant l’efficacité de certains traitements anticancéreux. Ces travaux viennent d’être publiés dans la revue Sciences Advances.

Une molécule, deux cibles

Carba1 appartient à la famille des carbazoles, une classe de molécules développée par les chercheurs du Centre d’études et de recherche sur le médicament de Normandie (CERMN), avec lesquels nous collaborons depuis plus de dix ans.

Nos travaux ont mis en évidence que Carba1 agit sur deux cibles principales.

Premièrement, Carba1 interagit avec la tubuline, la brique de base des microtubules. Selon les besoins de la cellule, ces briques peuvent s’assembler pour former soit des « câbles » capables de tirer et de séparer les chromosomes lors de la division cellulaire, soit des « rails » sur lesquels se déplacent des moteurs moléculaires transportant nutriments et organites comme les mitochondries, assurant ainsi la distribution de l’énergie et des ressources dans toute la cellule.

Ce système de transport est particulièrement essentiel dans les cellules nerveuses, dont les prolongements peuvent atteindre plus d’un mètre de longueur, par exemple les neurones qui partent du ganglion rachidien, près de la moelle épinière et vont innerver la peau des pieds. De nombreux médicaments anticancéreux, tels que le paclitaxel (Taxol) ou le docétaxel (Taxotère), ciblent déjà ces structures afin de bloquer la prolifération des cellules tumorales. Cependant, cette action n’est pas sans conséquence : les neurones, eux aussi dépendants des microtubules pour le transport de leurs constituants, en sont affectés, ce qui constitue l’une des causes majeures des neuropathies.

Nous avons montré que Carba1 modifie subtilement les microtubules : il perturbe leur extrémité, favorisant la liaison du paclitaxel. Cette interaction permet d’utiliser des doses plus faibles du médicament anticancéreux sans perte d’efficacité contre les tumeurs.

Mais ce n’est pas tout.

Des neurones plus résistants

Deuxièmement, en examinant plus en détail les propriétés de Carba1, nous avons découvert qu’il agit également sur un autre front : le métabolisme énergétique. Les neurones figurent parmi les cellules les plus gourmandes en énergie, et la défaillance bioénergétique est considérée comme l’un des principaux facteurs contribuant à la dégénérescence neuronale.

Nos résultats montrent que Carba1 active directement une enzyme clé, la nicotinamide phosphoribosyltransférase (NAMPT), qui relance la production de NAD⁺, molécule cruciale pour la génération d’énergie. Résultat : les neurones deviennent plus résistants au stress métabolique et survivent mieux aux agressions des agents chimiothérapeutiques.

Nous avons confirmé l’effet neuroprotecteur de Carba1 sur des cultures de neurones exposées à trois agents chimiothérapeutiques connus pour induire une neuropathie, via des mécanismes différents : le paclitaxel (ciblant les microtubules), le cisplatine (agent alkylant) et le bortézomib (inhibiteur du protéasome).

Contrairement aux cultures témoins où s’étendent des prolongements neuritiques lisses et vigoureux, dans les cultures traitées par ces médicaments, les prolongements présentent un aspect fragmenté, caractéristique d’un processus de dégénérescence. En revanche, lorsque les neurones sont exposés à ces mêmes traitements en présence de Carba1, leurs prolongements demeurent intacts, indiscernables de ceux des cultures non traitées. Ces observations indiquent que Carba1 protège efficacement les neurones de la dégénérescence induite par ces agents neurotoxiques.

Des résultats encourageants chez l’animal

Pour aller plus loin, nous avons testé Carba1 dans un modèle de neuropathie chez le rat traité au paclitaxel, développé par le Dr David Balayssac à Clermont-Ferrand (unité Neurodol). Ce traitement provoque une hypersensibilité cutanée : les rats réagissent à des pressions très faibles sur leurs pattes, un signe de douleur neuropathique. L’analyse histologique montre également une diminution des terminaisons nerveuses intra-épidermiques, tandis que le sang présente des taux élevés de NfL (chaîne légère de neurofilaments), marqueur de dégénérescence neuronale.

Lorsque Carba1 est administré avant et pendant le traitement, ces altérations disparaissent : les nerfs restent intacts, la concentration de NfL demeure normale et la sensibilité cutanée des animaux reste inchangée. Autrement dit, Carba1 protège les neurones de la dégénérescence induite par le paclitaxel. Signe rassurant, Carba1 n’impacte pas la croissance tumorale.

Comme les neurones, les cellules cancéreuses consomment beaucoup d’énergie. Il était donc essentiel de vérifier que Carba1 n’avait pas d’effet pro-tumoral et qu’il ne diminuait pas l’efficacité du paclitaxel. Pour le savoir, nous avons administré Carba1 seul, ou en association avec une dose thérapeutique de paclitaxel, à des souris porteuses de tumeurs greffées. Les résultats sont clairs : Carba1 n’a provoqué aucun effet toxique, ni altéré la santé générale des animaux, ni stimulé la croissance des tumeurs. Il n’interfère pas non plus avec l’action anticancéreuse du paclitaxel.

Une nouvelle voie vers des traitements mieux tolérés

Cette découverte est particulièrement enthousiasmante, car elle combine deux effets rarement réunis :

renforcer l’efficacité des médicaments anticancéreux de la famille du paclitaxel (taxanes) en permettant d’en réduire la dose ;

préserver les nerfs et améliorer la qualité de vie des patients pendant et après le traitement.

Avant d’envisager un essai clinique chez l’humain, plusieurs étapes restent indispensables. Il faut d’abord confirmer la sécurité de Carba1 chez l’animal, déterminer la dose minimale efficace et la dose maximale tolérée. Enfin, il sera nécessaire de mettre au point une formulation adaptée à une administration chez l’humain.

Cette mission incombe désormais à la start-up Saxol, issue de cette recherche, dont je suis l’une des cofondatrices. Si ces étapes – qui devraient s’étendre sur cinq ans au moins, selon les défis techniques et les levées de fonds – se déroulent comme prévu, Carba1 pourrait devenir le premier traitement préventif contre la neuropathie induite par la chimiothérapie – une avancée majeure qui pourrait transformer la façon dont les patients vivent leur traitement anticancéreux.

Carba1 incarne une innovation à l’interface de la chimie, de la neurobiologie et de l’oncologie. En associant protection neuronale et renforcement de l’efficacité thérapeutique, cette petite molécule pourrait, à terme, réconcilier traitement du cancer et qualité de vie. Pour les millions de patients confrontés à la double épreuve du cancer et de la douleur neuropathique, elle représente un espoir concret et prometteur.

Laurence Lafanechère est cofondatrice et conseillère scientifique de la Société SAXOL. Pour mener ses recherches elle a reçu des financements de : Société d’Accélération de Transfert de Technologies Linksium Maturation grant CM210005, (L.L) Prématuration CNRS (LL) Ligue contre le Cancer Allier et Isère (LL, C.T, D.B.) Ruban Rose (LL)

20.11.2025 à 16:16

Les textes des COP parlent-ils vraiment de climat ? Le regard de l’écolinguistique

Albin Wagener, Professeur en analyse de discours et communication à l'ESSLIL, chercheur au laboratoire ETHICS, Institut catholique de Lille (ICL)

Texte intégral (2295 mots)

Derrière les grandes déclarations de la diplomatie climatique, que disent vraiment les textes des COP ? Une étude de leurs discours, passés au crible du « text mining », montre comment les mots des COP sont davantage centrés sur les mécaniques institutionnelles que sur l’urgence environnementale. Le langage diplomatique sur le climat fabrique ainsi un récit institutionnel dont la nature est presque absente.

Alors que la COP30 se tient au Brésil en ce mois de novembre 2025, des voix s’élèvent : ces montagnes onusiennes accoucheraient-elles de souris ? En effet, ces grand-messes du climat aboutissent le plus souvent à des textes consensuels. Certes, ils reconnaissent – sur le papier – la réalité des enjeux climatiques, mais ils ne sont que rarement suivis d’effets. On se souvient, par exemple, du texte de la COP26, à Glasgow (2021), qui évoquait enfin clairement la question de la sortie des énergies fossiles. Mais la mise en œuvre de cette promesse, non réitérée lors de la COP29, à Bakou (2024), reste encore à concrétiser.

Leur processus de décision même est de plus en plus critiqué. Il ne fait intervenir que les délégations nationales à huis clos, tout en donnant un poids important aux lobbies. On y retrouve bien sûr des ONG, mais aussi des grandes entreprises, comme Coca-Cola lors de la COP27, à Charm el-Cheikh (2022). L’occasion pour les États producteurs d’énergie fossile de se livrer à des opérations remarquables d’écoblanchiment – comme les Émirats arabes unis furent accusés de le faire lors de la COP28 à Dubaï. Dans le même temps, les populations autochtones et les mouvements des jeunes pour le climat peinent à se faire entendre à l’occasion de ces événements.

Afin de mieux comprendre l’évolution sémantique dans les déclarations des COP et de voir dans quelle mesure celles-ci reflètent l’urgence climatique, j’ai mené une analyse de discours à partir des déclarations officielles (en anglais) des COP entre 2015 – soit juste après la signature de l’accord de Paris – et 2022. Cela permet de mieux saisir les représentations sociales des instances internationales à propos du changement climatique, dans la mesure où ces discours prennent sens au cours de leur circulation dans la société.

Écolinguistique et text mining, mode d’emploi

Cette étude s’inscrit dans l’approche écolinguistique héritée des travaux d’Arran Stibbe ; une approche qui permet notamment d’explorer la manière dont les institutions cadrent les discours sur l’environnement, tout en aidant à comprendre comment les intérêts divergents d’acteurs différents aboutissent à des positions médianes. Pour le climat comme pour les autres grands sujets politiques internationaux, la façon dont les acteurs en parlent est capitale pour aboutir à des consensus, des prises de décision et des textes engageant les États.

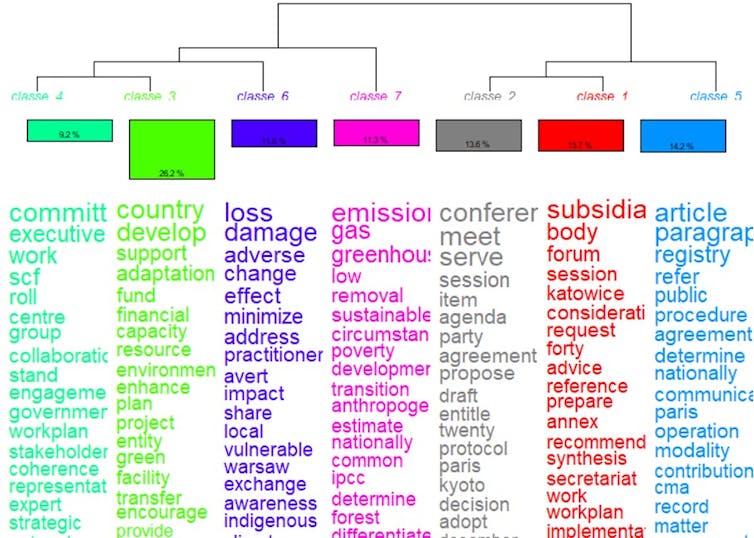

J’ai mené cette analyse grâce à l’outil Iramuteq, développé par Pascal Marchand et Pierre Ratinaud. Il permet une approche statistique du nombre de mots présents dans un corpus textuel, des mots avec lesquels ils apparaissent le plus souvent, mais également de les croiser avec les définitions et leur sens en contexte.

Par ordre de poids statistique, on retrouve ainsi les thèmes suivants :

Fonds de soutien international (26,2 %, en vert fluo, classe 3), qui recoupe les discussions sur l’aide aux pays en voie de développement et la proposition d’un fonds afin de faire face au changement climatique.

Textes des COP (14,2 %, en bleu, classe 5). Cette catégorie intègre les passages qui évoquent le fonctionnement des COP elles-mêmes et des leurs organes administratifs, dont les objectifs sont actés grâce aux textes.

Préparation des COP (13,7 %, en rouge, classe 1). Il s’agit de tout le jargon lié aux coulisses des COP et aux travaux d’organisation qui permettent aux COP d’aboutir et à leurs décisions d’être appliquées de manière concrète.

Organisation des COP (13,6 %, en gris, classe 2). Il s’agit du détail concernant les événements des COP elles-mêmes, c’est-à-dire leur organisation et leur calendrier, avec le fonctionnement par réunions et documents à produire.

Conséquences négatives du changement climatique (11,6 % seulement, en violet, classe 6). Il s’agit des passages où l’accent est mis sur les dommages, les risques et les vulnérabilités, c’est-à-dire les conséquences négatives du réchauffement climatique.

Écologie (11,3 %, rose, classe 7). Cette classe traite des éléments d’ordre écologique liés au changement climatique, ainsi que des causes du réchauffement planétaire.

Gouvernance de la COP (9,2 %, vert pâle, classe 4). Dans cette dernière classe, on retrouve les éléments d’ordre stratégique liés aux COP, à savoir la gouvernance, les parties prenantes, les groupes de travail et les plans à suivre.

À lire aussi : Les mots de la COP : dictionnaire portatif des négociations climatiques

Que retenir de ce découpage ? Les questions strictement climatiques et écologiques ne totalisent que 22,9 % des occurrences dans les textes, ce qui paraît assez faible alors qu’il s’agit des raisons pour lesquelles ces COP existent. Dans une grande majorité des thématiques abordées par le corpus, les COP parlent d’abord d’elles-mêmes.

C’est peu surprenant pour une institution internationale de ce calibre, mais cela pose de sérieuses questions concernant la prise en compte des dimensions extra-institutionnelles du problème.

L’écologie déconnectée des autres mots clés

J’ai ensuite poussé le traitement des données un peu plus loin grâce à une méthode statistique appelée « analyse factorielle de correspondance ». Celle-ci permet de comprendre comment les différentes thématiques sont articulées entre elles dans les discours au sein du corpus.

Les récits en lien avec les thèmes qu’on retrouve au centre droit du graphe, liés aux textes des COP (bleu), à leur préparation (rouge), à leur organisation (gris) et à leur gouvernance (vert pâle) forment ainsi un ensemble homogène.

On note toutefois, dans la partie en bas à gauche, que la gouvernance des COP (vert pâle) a un positionnement hybride et semble jouer le rôle d’interface avec la thématique des conséquences négatives du réchauffement climatique (violet) et celle des fonds de soutien internationaux (vert fluo).

En d’autres termes, ces observations confirment que les COP se donnent bien pour objectif de remédier aux conséquences du changement climatique. Et cela, à travers la gouvernance mise en place par les COP, et avec la proposition d’aides aux pays les plus vulnérables comme moyen.

Quant au thème de l’écologie (en rose), il se retrouve en haut à gauche du graphe. Surtout, il semble comme déconnecté du reste des thématiques. Ceci montre que, dans ces textes, il existe peu de liens entre les propos qui traitent de l’écologie et ceux qui évoquent le fonctionnement des COP ou la mise en œuvre concrète de solutions.

À lire aussi : Les classes populaires en ont-elles vraiment marre de l’écologie ?

L’absence de termes pourtant centraux

Plus intéressant encore, les textes analysés brillent par l’absence relative de certains termes clés.

Ainsi, le terme animal (en anglais) n’est jamais utilisé. Certains termes n’apparaissent qu’une fois dans tous les textes étudiés, comme life, river ou ecological. D’autres apparaissent, mais très peu, comme natural (trois occurrences), earth (quatre occurrences). Des termes comme water, biodiversity ou ocean, aux enjeux colossaux, ne totalisent que six occurrences.

Ainsi, alors que les COP ont pour objectif de s’intéresser aux conséquences du réchauffement climatique sur les sociétés humaines et le vivant en général, il est marquant de constater que la plupart des champs thématiques du corpus parlent non pas des problèmes liés au changement climatiques, mais surtout des COP elles-mêmes, plus précisément de leur fonctionnement.

En d’autres termes, les COP se parlent à elles-mêmes, dans une logique de vase clos qui vise d’abord à s’assurer que les dispositions prises pour respecter l’accord de Paris sont bien respectées.

À lire aussi : À quoi servent les COP ? Une brève histoire de la négociation climatique

Cet état de fait contraste avec les conséquences concrètes du réchauffement climatique. Il illustre la vivacité de représentations d’ordre gestionnaire et institutionnel, qui s’autoalimentent en voyant d’abord l’environnement, la biodiversité et le vivant comme des ressources à préserver ou des objectifs à accomplir. En restant focalisées sur l’accord de Paris, les déclarations officielles voient ainsi le vivant et la biodiversité comme autant d’outils, d’objets ou de cases à cocher pour rendre compte d’engagements pris au niveau international.

C’est compréhensible étant donnée la nature des textes des COP et du contexte socio-institutionnel qui encadrent leur production. Il n’en reste pas moins que cela trahit bon nombre de représentations qui continuent de percoler nos imaginaires. Dans cette logique, les éléments d’ordre naturel, environnemental ou écologique constituent soit des ressources à utiliser ou préserver, soit des éléments à gérer, soit des objectifs à remplir. Or, cette représentation est loin d’être neutre, comme l’explique George Lakoff.

Ici, le changement climatique est donc traité comme un ensemble de problèmes auxquels il s’agit d’apporter de simples solutions techniques ou des mécanismes de compensation, sans que les conditions qui alimentent ce même dérèglement climatique (notamment liées au système économique et aux modes de production et de consommation) ne soient abordées à aucun moment dans les textes.

C’est cette même logique qui semble condamner les instances internationales à tenter de gérer les conséquences du réchauffement climatique, tout en évitant soigneusement d’en traiter les causes.

Albin Wagener ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

20.11.2025 à 16:16

On peut réactiver un souvenir ou le faire disparaître de façon réversible – chez la souris

Jean-Christophe Cassel, Professeur de neurosciences à l'Université de Strasbourg, Université de Strasbourg

Texte intégral (1776 mots)

Après avoir démontré que les souvenirs s’inscrivent de façon matérielle dans notre cerveau, les scientifiques s’attèlent à la tâche de réactiver des souvenirs attaqués par des maladies neurodégénératives chez des souris.

Chacun sait ce qu’est un souvenir : un événement, une odeur, une sensation de notre passé que nous pouvons rappeler. Mais à quoi ressemble-t-il dans notre cerveau ?

Il est porté par des groupes de neurones interconnectés. À cette échelle, le support du souvenir est appelé « engramme ». Ce mot désigne le substrat matériel constitué par un réseau spécifique de neurones, dont les interconnexions se sont renforcées durablement lors de la mémorisation. Ainsi, quand on se souvient, une partie de ce réseau est réactivée. Les recherches récentes montrent comment se fait cette réactivation et comment on peut la contrôler de façon réversible chez la souris.

Mieux comprendre les mécanismes cellulaires qui sous-tendent nos souvenirs est un enjeu de taille, car nombre de maladies neurodégénératives et de traumatismes altèrent notre mémoire, non seulement en perturbant l’accès aux images de notre passé, mais aussi en s’attaquant directement au matériel biologique dans lequel ces images sont fixées.

Comment les souvenirs s’inscrivent dans le cerveau

L’idée que nos souvenirs ne sont pas quelque chose d’immatériel mais ont un support physique est ancienne. Déjà Platon imaginait que l’âme recèle des tablettes de cire dans lesquelles se grave ce que nous voulons retenir.

Mais il a fallu bien longtemps pour affiner cette intuition, puis pour la démontrer expérimentalement. À la fin du XIXe siècle, l’Espagnol Santiago Ramon y Cajal pense que les connexions entre certains neurones sont renforcées lors d’activations répétées accompagnant l’apprentissage – ainsi se formerait le souvenir.

Dans les années 1960, ces spéculations commencent à trouver une assise expérimentale. C’est d’abord chez un mollusque marin, l’aplysie, qu’on les démontre. Lorsqu’on stimule mécaniquement une partie de son dos, il rétracte ses branchies pour les protéger. Mais si cette stimulation est répétée quelques fois, le réflexe s’atténue durablement. Cette adaptation repose sur une réduction prolongée de l’excitabilité synaptique et du nombre de synapses dans le circuit moteur qui pilote la rétraction.

À l’inverse, une sensibilisation de ce réflexe, déclenchée par une stimulation nociceptive (douleur déclenchée par une agression de l’organisme, ndlr) appliquée sur la queue de l’animal, provoque une augmentation persistante de l’excitabilité synaptique et fait apparaître des connexions additionnelles. En 1973, un mécanisme du même type est décrit dans l’hippocampe du lapin – il est nommé « potentialisation à long terme ».

Pour désigner l’encodage permanent dans le substrat cérébral des éléments d’une expérience vécue, rappelons la formule laconique de Carla Shatz :

« Neurons that fire together, wire together » (Les neurones qui se coactivent s’interconnectent.) Carla Shatz, 1992, « Scientific American »

Observer directement les souvenirs en « allumant » les neurones interconnectés

Si les neurones coactivés au cours de l’encodage se réactivent pour permettre le rappel d’un souvenir (Figure 1), on doit pouvoir prouver que leur réactivation accompagne le rappel du souvenir et montrer que leur destruction l’empêche.

Pour ce qui est de la réactivation lors du rappel, le groupe de Mark Mayford a appris à des souris à reconnaître un signal sonore annonçant un choc électrique désagréable. Lorsque plus tard, les souris réentendent ce son, leur immobilité traduit la peur, donc une réactivation du souvenir de ce qu’annonce le son.

Pour imager les neurones qui portent la réactivation du souvenir, voici la procédure : avant l’apprentissage, on infecte des cellules de l’amygdale

– une structure cruciale pour les émotions, dont la peur – avec un virus qui permettra de rendre fluorescents les neurones activés pendant l’apprentissage. Ultérieurement, une fois que ces souris ont réentendu le son, elles sont mises à mort et, à l’aide d’un second marquage, on visualise les neurones qui se sont activés pendant ce rappel. Du coup, les neurones doublement marqués auront été activés pendant l’apprentissage et réactivés pendant le rappel. Or, Mayford et ses collègues constatent qu’il y a bien eu augmentation du double marquage chez les souris ayant eu peur pendant le rappel (comparativement aux différentes conditions de contrôle).

Pour ce qui est de la destruction des neurones qui aboutissent à l’anéantissement du souvenir, on utilisera également une stratégie reposant sur une infection virale des neurones de l’amygdale, mais cette fois, les neurones activés pendant l’apprentissage seront tués avant le rappel à l’aide d’une toxine. De cette manière, le groupe de Paul Frankland a pu montrer qu’une destruction de ces neurones faisait disparaître toute réaction de peur chez les souris car, du fait de la mort des neurones « souvenir », elles ont oublié la signification du signal sonore.

Comment réactiver un souvenir ou le faire disparaître de façon réversible ?

Aujourd’hui, les chercheurs ont peaufiné cette démonstration en parvenant à manipuler ponctuellement et réversiblement l’engramme (le réseau de neurones souvenirs) pour induire l’expression ou la disparition d’un souvenir.

C’est là qu’intervient une technique relativement récente : l’optogénétique. Elle permet de contrôler (soit activer, soit inhiber) avec une grande précision l’activité de certains neurones en les exposant à de la lumière par l’intermédiaire d’une fibre optique plongée dans une région d’intérêt du cerveau. Il suffit pour cela de rendre ces neurones sensibles à une longueur d’onde lumineuse par introduction de gènes codant pour des protéines photosensibles. De plus, il est possible de faire dépendre l’expression de ces gènes de l’activation même des neurones.

C’est ainsi que le groupe de Susumu Tonegawa a pu montrer, chez la souris, qu’après l’apprentissage d’un danger lié à un contexte donné, l’activation par la lumière des neurones ayant participé à l’apprentissage induisait un comportement de peur, donc un rappel… et cela dans un contexte sans danger bien connu de la souris, et sans rapport avec celui de l’apprentissage ! Par ailleurs, lorsque ces neurones étaient inhibés par la lumière dans le contexte dangereux, la souris ne manifestait plus aucune peur.

Implanter un faux souvenir

Il y a même mieux, puisque le groupe de Tonegawa a aussi réussi à implanter un faux souvenir dans la mémoire des souris.

Les souris ont d’abord encodé un premier contexte parfaitement neutre. Les neurones ayant été activés pendant l’encodage de ce contexte ont exprimé une protéine photoactivable avec de la lumière bleue. Les chercheurs ont ensuite exposé ces souris à un autre contexte, celui-là désagréable, tout en activant conjointement la trace du premier avec de la lumière bleue.

Lorsque les souris étaient ultérieurement réexposées au premier contexte (pourtant neutre, à la base), elles se sont mises à le craindre.

Enfin, dans un modèle murin de maladie d’Alzheimer, le groupe de Tonegawa est même allé jusqu’à ressusciter un souvenir le temps d’une photoactivation d’un engramme d’abord rendu photoactivable mais ultérieurement oublié, alors même que celui-ci était invalidé du fait de l’évolution d’un processus neurodégénératif.

Pour l’heure, ces résultats, bien que spectaculaires, et avec lesquels s’alignent les données produites par d’autres groupes de recherche, se limitent à des mémoires simples qui pilotent des comportements simples dans des modèles animaux raisonnablement complexes.

Reste à savoir si les travaux menés sur ces modèles sont généralisables sans nuances à l’humain, et par quel mécanisme un motif d’activation neuronale peut générer des images et des impressions passées dans une phénoménologie consciente actuelle.

Cet article est publié dans le cadre de la Fête de la science (qui a eu lieu du 3 au 13 octobre 2025), dont The Conversation France est partenaire. Cette nouvelle édition porte sur la thématique « Intelligence(s) ». Retrouvez tous les événements de votre région sur le site Fetedelascience.fr.

Jean-Christophe Cassel a reçu des financements de l'ANR. ANR-14-CE13-0029-01 ANR-23-CE37-0012-02

20.11.2025 à 11:22

L’IA générative est-elle soutenable ? Le vrai coût écologique d’un prompt

Denis Trystram, Professeur des universités en informatique, Université Grenoble Alpes (UGA)

Danilo Carastan Dos Santos, Professeur assistant, Université Grenoble Alpes (UGA)

Djoser Simeu, Ingénieure de recherche en Intelligence Artificielle Frugale, Inria

Laurent Lefèvre, Chercheur en informatique, Inria

Texte intégral (2747 mots)

Circulez, il n’y a rien à voir ? Les estimations du bilan environnemental de l’intelligence artificielle générative, comme celles réalisées à l’été 2025 par Google sur son IA Gemini, semblent rassurantes : seulement 0,003 g de CO2 et cinq gouttes d’eau par « prompt ». Des résultats qui dépendent en réalité beaucoup des choix méthodologiques réalisés, alors que de telles études sont le plus souvent menées en interne et manquent de transparence. Le problème est que ces chiffres font de plus en plus souvent figure d’argument marketing pour inciter à l’utilisation de l’IA générative, tout en ignorant le risque bien réel d’effet rebond lié à l’explosion des usages.

Depuis la sortie de ChatGPT fin 2022, les IA génératives ont le vent en poupe. En juillet 2025, OpenAI annonçait que ChatGPT recevait 18 milliards de « prompts » (instructions écrites par les utilisateurs) par semaine, pour 700 millions d’utilisateurs – soit 10 % de la population mondiale.

Aujourd’hui, la ruée vers ces outils est mondiale : tous les acteurs de la Big Tech développent désormais leurs propres modèles d’IA générative, principalement aux États-Unis et en Chine. En Europe, le Français Mistral, qui produit l’assistant Le Chat, a récemment battu les records avec une capitalisation proche de 12 milliards d’euros. Chacun de ces modèles s’inscrit dans un environnement géopolitique donné, avec des choix technologiques parfois différents. Mais tous ont une empreinte écologique considérable qui continue d’augmenter de façon exponentielle, portée par la démultiplication des usages. Certains experts, dont ceux du think tank spécialisé The Shift Project, sonnent l’alerte : cette croissance n’est pas soutenable.

À lire aussi : L’IA peut-elle vraiment être frugale ?

Or, tous les acteurs du domaine – y compris les consommateurs – sont aujourd’hui bien conscients que du coût environnemental qui accompagne les usages liés au numérique, mais pas forcément des chiffres que cela représente.

Poussés par de multiples raisons (obligations réglementaires, marketing, parfois par conscience environnementale), plusieurs des grands acteurs de la tech ont récemment réalisé l’analyse de cycle de vie (ACV, méthodologie permettant d’évaluer l’impact environnemental global d’un produit ou service) de leurs modèles.

Fin août 2025, Google a publié la sienne pour quantifier les impacts de son modèle Gemini. Que valent ces estimations, et peut-on s’y fier ?

Une empreinte carbone étonnement basse

Un modèle d’IA générative, pour fonctionner, doit d’abord être « entraîné » à partir d’une grande quantité d’exemples écrits. Pour mesurer l’électricité consommée par un « prompt », Google s’est donc concentré sur la phase d’utilisation – et non pas d’entraînement – de son IA Gemini. Selon ses propres calculs, Google annonce donc qu’un prompt ne consommerait que 0,24 wattheure (Wh) en moyenne – c’est très faible : environ une minute de consommation d’une ampoule électrique standard de 15 watts.

Comment les auteurs sont-ils arrivés à ce chiffre, significativement plus faible que dans les autres études déjà réalisées à ce sujet, comme celle menée par Mistral IA en juillet 2025 ?

La première raison tient à ce que Google mesure réellement. On apprend par exemple dans le rapport que l’électricité consommée par un prompt est utilisée pour 58 % par des processeurs spécialisés pour l’IA (l’unité de traitement graphique, ou GPU, et le circuit intégré spécifique Tensor Processing Unit, ou TPU), 25 % par des processeurs classiques et à hauteur d’environ 10 % par les processeurs en veille, et les 7 % restants pour le refroidissement des serveurs et le stockage de données.

Autrement dit, Google ne tient ici compte que de l’électricité consommée par ses propres data centers, et pas de celle consommée par les terminaux et les routeurs des utilisateurs.

Par ailleurs, aucune information n’est donnée sur le nombre d’utilisateurs ou le nombre de requêtes prises en compte dans l’étude, ce qui questionne sa crédibilité. Dans ces conditions, impossible de savoir comment le comportement des utilisateurs peut affecter l’impact environnemental du modèle.

À lire aussi : Impact environnemental du numérique : l’inquiétant boom à venir

Google a racheté en 2024 l’équivalent de la production d’électricité annuelle de l’Irlande

La seconde raison tient à la façon de convertir l’énergie électrique consommée en équivalent CO2. Elle dépend du mix électrique de l’endroit où l’électricité est consommée, tant du côté des data centers que des terminaux des utilisateurs. Ici, on l’a vu, Google ne s’intéresse qu’à ses propres data centers.

Depuis longtemps, Google a misé sur l’optimisation énergétique, en se tournant vers des sources décarbonées ou renouvelables pour ses centres de données répartis partout dans le monde. Selon son dernier rapport environnemental, l’effort semble porter ses fruits, avec une diminution de 12 % des émissions en un an, alors que la demande a augmenté de 27 % sur la même période. Les besoins sont colossaux : en 2024, Google a consommé, pour ses infrastructures de calcul, 32 térawattsheures (TWh), soit l’équivalent de la production d’électricité annuelle de l’Irlande.

À lire aussi : Un data center près de chez soi, bonne ou mauvaise nouvelle ?

De fait, l’entreprise a signé 60 contrats exclusifs de fourniture en électricité à long terme en 2024, pour un total de 170 depuis 2010. Compte tenu de l’ampleur des opérations de Google, le fait d’avoir des contrats d’électricité exclusifs à long terme compromet la décarbonation dans d’autres secteurs. Par exemple, l’électricité à faibles émissions qui alimente les prompts pourrait être utilisée pour le chauffage, secteur qui dépend encore fortement des combustibles fossiles.

Dans certains cas, ces contrats impliquent la construction de nouvelles infrastructures de production d’énergie. Or, même pour la production d’énergie renouvelable décarbonée, leur bilan environnemental n’est pas entièrement neutre : par exemple, l’impact associé à la fabrication de panneaux photovoltaïques est compris entre 14 gCO2eq et 73 gCO2eq/kWh, ce que Google ne prend pas en compte dans ses calculs.

Enfin, de nombreux services de Google font appel à de la « colocation » de serveurs dans des data centers qui ne sont pas nécessairement décarbonés, ce qui n’est pas non plus pris en compte dans l’étude.

Autrement dit, les choix méthodologiques réalisés pour l’étude ont contribué à minimiser l’ampleur des chiffres.

Cinq gouttes d’eau par prompt, mais 12 000 piscines olympiques au total

La consommation d’eau douce est de plus en plus fréquemment prise en compte dans les rapports environnementaux liés au numérique. Et pour cause : il s’agit d’une ressource précieuse, constitutive d’une limite planétaire récemment franchie.

L’étude de Google estime que sa consommation d’eau pour Gemini est de 0,26 ml – soit cinq gouttes d’eau – par prompt. Un chiffre qui semble dérisoire, ramené à l’échelle d’un prompt, mais les petits ruisseaux font les grandes rivières : il faut le mettre en perspective avec l’explosion des usages de l’IA.

Globalement, Google a consommé environ 8 100 millions de gallons (environ 30 millions de mètres cubes, l’équivalent de quelque 12 000 piscines olympiques) en 2024, avec une augmentation de 28 % par rapport à 2023.

Mais là aussi, le diable est dans les détails : le rapport de Google ne comptabilise que l'eau consommée pour refroidir les serveurs (selon un principe très similaire à la façon dont nous nous rafraîchissons lorsque la sueur s’évapore de notre corps). Le rapport exclut de fait la consommation d’eau liée à la production d’électricité et à la fabrication des serveurs et autres composants informatiques, qui sont pourtant prises en compte pour le calcul de son empreinte carbone, comme on l’a vu plus haut. En conséquence, les indicateurs d’impact environnemental (carbone, eau…) n’ont pas tous le même périmètre, ce qui complique leur interprétation.

À lire aussi : Les métaux de nos objets connectés, face cachée de l’impact environnemental du numérique

Des études encore trop opaques

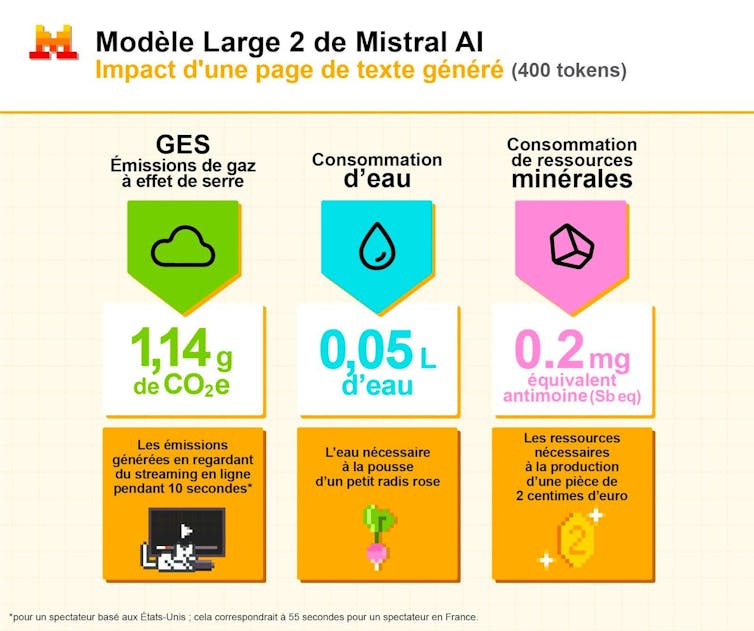

Comme la plupart des études sur le sujet, celle de Google a été menée en interne. Si on comprend l’enjeu de secret industriel, un tel manque de transparence et d’expertise indépendante pose la question de sa légitimité et surtout de sa crédibilité. On peut néanmoins chercher des points de comparaisons avec d’autres IA, par exemple à travers les éléments présentés par Mistral IA en juillet 2025 sur les impacts environnementaux associés au cycle de vie de son modèle Mistral Large 2, une première.

Cette étude a été menée en collaboration avec un acteur français reconnu de l’analyse du cycle de vie (ACV), Carbone4, avec le soutien de l’Agence de l'environnement et de la maîtrise de l’énergie (Ademe), ce qui est un élément de fiabilité. Les résultats sont les suivants.

Pendant les dix-huit mois de durée de vie totale du modèle, environ 20 000 tonnes équivalent CO2 ont été émises, 281 000 m3 d’eau consommée et 660 kg équivalent antimoine (indicateur qui prend en compte l’épuisement des matières premières minérales métalliques).

Mistral attire l’attention sur le fait que l’utilisation du modèle (inférence) a des effets qu’ils jugent « marginaux », si on considère un prompt moyen utilisant 400 « tokens » (unités de traitement corrélées à la taille du texte en sortie) : ce prompt correspond à l’émission de 1,14 g équivalent CO2, de 50 ml d’eau et 0,5 mg équivalent antimoine. Des chiffres plus élevés que ceux avancés par Google, obtenus, comme on l’a vu, grâce à une méthodologie avantageuse. De plus, Google s’est basé dans son étude sur un prompt « médian » sans donner davantage de détails statistiques, qui seraient pourtant bienvenus.

En réalité, l’une des principales motivations, que cela soit celles de Google ou de Mistral, derrière ce type d’étude reste d’ordre marketing : il s’agit de rassurer sur l’impact environnemental (ce qu’on pourrait qualifier de « greenwashing ») de l’IA pour pousser à la consommation. Ne parler que de l’impact venant des prompts des utilisateurs fait également perdre de vue la vision globale des coûts (par exemple, ceux liés à l’entraînement des modèles).

À lire aussi : Comment rendre l’électronique plus soutenable ?

Reconnaissons que le principe d’effectuer des études d’impacts est positif. Mais l’opacité de ces études, même lorsqu’elles ont le mérite d’exister, doit être interrogée. Car, à ce jour, Mistral pas plus que Google n’ont pas dévoilé tous les détails des méthodologies utilisées, les études ayant été menées en interne. Or, il faudrait pouvoir disposer d’un référentiel commun qui permettrait de clarifier ce qui doit être pris en compte dans l’analyse complète du cycle de vie (ACV) d’un modèle d’IA. Ceci permettrait de réellement comparer les résultats d’un modèle à l’autre et de limiter les effets marketing.

Une des limites tient probablement à la complexité des IA génératives. Quelle part de l’empreinte environnementale peut-on rattacher à l’utilisation du smartphone ou de l’ordinateur pour le prompt ? Les modèles permettant le fine-tuning pour s’adapter à l’utilisateur consomment-ils plus ?

La plupart des études sur l’empreinte environnementale des IA génératives les considèrent comme des systèmes fermés, ce qui empêche d’aborder la question pourtant cruciale des effets rebonds induits par ces nouvelles technologies. Cela empêche de voir l’augmentation vertigineuse de nos usages de l’IA, en résumant le problème au coût environnemental d’un seul prompt.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

18.11.2025 à 16:13

Pour prédire si un volcan sera effusif ou explosif, il faut s’intéresser à ses bulles

Olivier Roche, Chercheur en volcanologie, Institut de recherche pour le développement (IRD); Université Clermont Auvergne (UCA)

Jean-Michel Andanson, Chargé de recherche, Centre national de la recherche scientifique (CNRS); Université Clermont Auvergne (UCA)

Texte intégral (1769 mots)

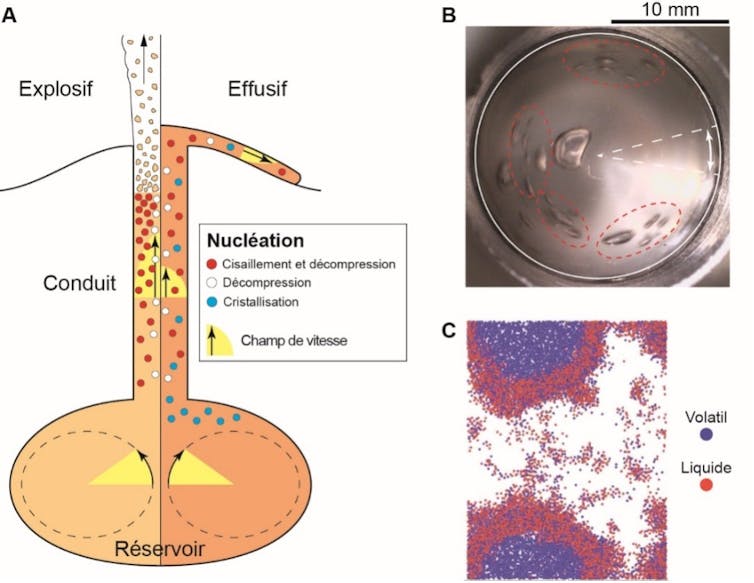

Une étude publiée très récemment dans la revue « Science » permet de mieux comprendre le moteur des éruptions volcaniques : la formation des bulles dans le magma.

Les observations faites depuis des décennies dans diverses régions du monde montrent que les éruptions volcaniques sont caractérisées par deux types de comportement en surface. D’un côté du spectre, le magma qui remonte depuis les profondeurs de la Terre est émis calmement sous forme de coulées ou de dômes de lave, caractérisant ainsi le style « effusif ». C’est le cas des volcans d’Hawaï ou de La Réunion dont les éruptions quasi annuelles font souvent l’actualité dans les médias.