27.01.2026 à 18:51

On meurt dans mon université.

Olivier Ertzscheid

Texte intégral (951 mots)

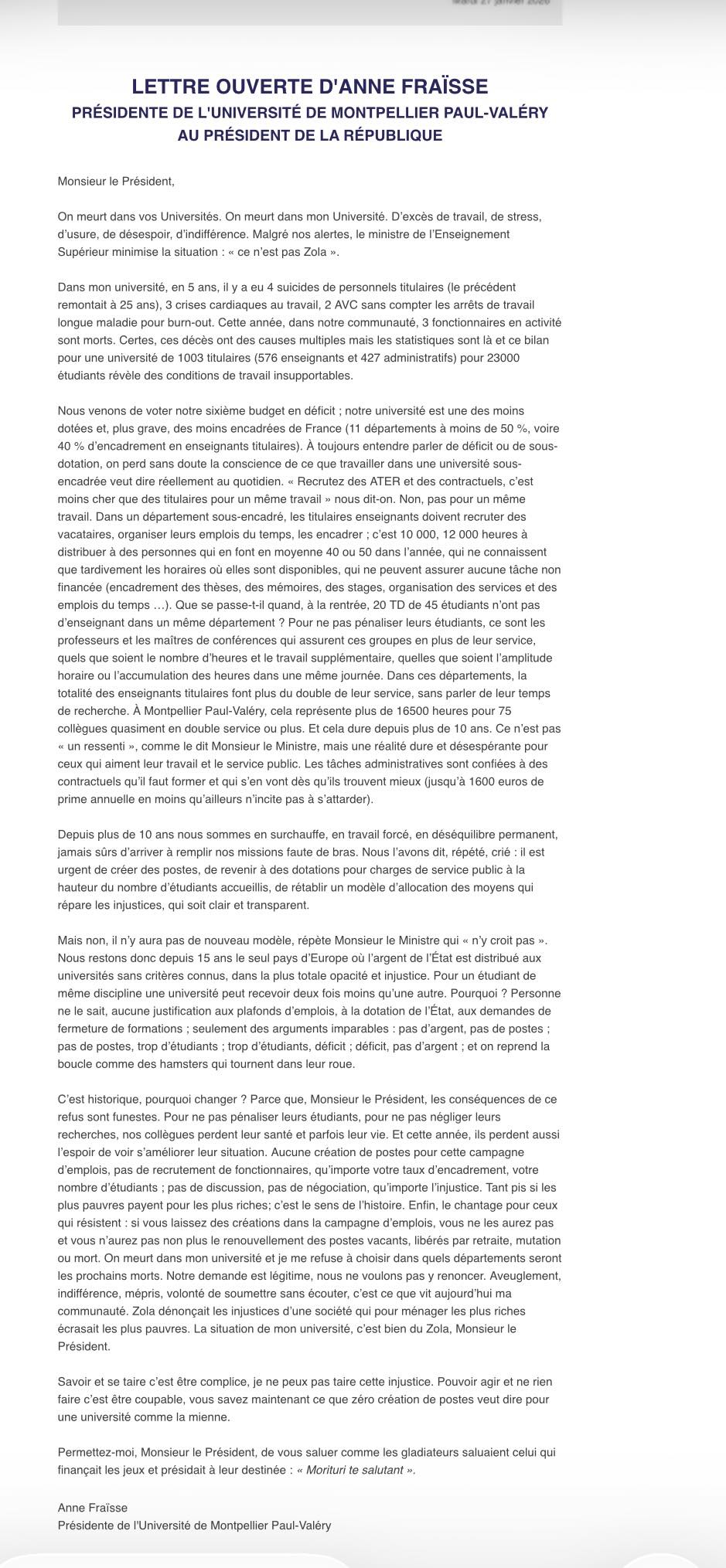

C’est une lettre absolument inédite, absolument dramatique, et absolument bouleversante aussi. La lettre d’une présidente d’université, Anne Fraïsse, présidente de l’université Paul Valery, une lettre qu’elle adresse au président de la république. Aujourd’hui dans le journal Le Monde. Vingt piges que je suis titulaire dans l’enseignement supérieur et je n’ai jamais vu ça. Personne n’a jamais vu ça. Pourtant ce courrier, tous les présidents et toutes les présidentes d’université auraient déjà dû l’écrire depuis 10 ans au moins.

Depuis des années, nous alertons sur la situation des universités. Si vous êtes lecteur et lectrice de ce blog vous m’avez souvent vu et lu en train d’utiliser un vocabulaire pas toujours très universitaire et très châtié pour décrire ce qui n’est que la réalité que chaque jour nous sommes des milliers à éprouver. Si la réalité c’est quand on se cogne (comme le formulait Lacan), alors je vous confirme qu’on se cogne. Et chaque année de plus en plus fort. Et de plus en plus dur.

Il y a presque 3 ans, je vous expliquais pourquoi à Nantes Université on ne sourcillait pas à l’idée de conjuguer le label du bien-être et la réalité de l’épuisement professionnel.

Il y a un mois et demi, mi-décembre 2025 j’écrivais « Regarde les universités crever. Regarde bien. »

Il y a à peine une semaine j’écrivais encore « Parcoursup est lancé. Et à l’université, c’est tous les jours le Doomsday. »

Tout en mesurant la difficulté de l’exercice qui est le leur, je rappelle régulièrement ce qui à mon sens est une faute des présidents et présidentes d’université qui plutôt que de se mobiliser et d’emmener avec elles et eux leurs personnels, n’ont jamais vraiment tiré la sonnette d’alarme autrement que poliment et de manière feutrée, quand pourtant tout appelait à une immense colère qu’il s’agissait « juste » de canaliser, de porter, et d’incarner. Toutes et tous ont alors choisi de répondre « Oui mais … ».

Discutez avec n’importe quel universitaire aujourd’hui, de n’importe quelle université, quelque soit son rang, son statut, sa discipline. Toutes et tous vous diront que oui, ils ont aussi vu, connu, observé, vécu, traversé, ce qui est enfin décrit, enfin porté, enfin affirmé par une présidente d’université.

Je vous partage cette lettre. Je vous incite à la lire attentivement, à la faire circuler aussi. Massivement.

Je forme le voeu que toutes les présidentes et présidents d’université auront le même courage que celui d’Anne Fraïsse. Et lui apporteront publiquement leur soutien (car elle va probablement prendre cher …) et qu’à leur tour, surtout, ils auront le courage de poser aussi les mots nécessaires à la description du réel qui cogne. Qui cogne. Et qui cogne encore.

La lettre d’Anne Fraïsse parle de gens qui meurent au travail. D’épuisement. De rage. De colère. Elle parle d’abandon et de mise à mort programmée et inscrite dans les « objectifs budgétaires ». Elle parle de travail forcé. Ces mots peuvent apparaître démesurés à l’échelle de l’image qui est portée sur l’université, principalement d’ailleurs par les mêmes salopards qui organisent sa mise à mort par discrédit autant que par assèchement de crédits. Ces mots sont pourtant les seuls qui vaillent. Sauf que jamais personne n’aurait dû ne serait-ce que pouvoir imaginer qu’ils puissent être tenus au 21ème siècle dans la 6ème puissance économique mondiale.

Lisez la lettre d’Anne Fraïsse. Partagez-là. Et prenez là pour ce qu’elle est, un ultime avertissement après lequel, si rien n’est fait, plus rien ne pourra être sauvé de ce que fut l’université. Chacun alors aura le choix entre la soumission, l’indifférence ou l’indignation.

« Savoir et se taire c’est être complice, je ne peux pas taire cette injustice. » Cent pour cent des universités françaises ont voté un budget en déficit. Les prochains silences des présidents et présidentes d’université ou leurs prochains atermoiements feutrés ne seront plus simplement complices. Ils seront pleinement coupables.

Et si vous croisez Anne Fraïsse, remerciez la pour son courage.

La lettre est directement accessible depuis le site de l’université. J’en reproduis ici une version.

26.01.2026 à 17:21

Pourquoi il ne faut pas interdire les réseaux sociaux aux moins de 15 ans (mais réfléchir à interdire CNews aux adultes avec le droit de vote).

Olivier Ertzscheid

Texte intégral (5377 mots)

Depuis plusieurs mois, Emmanuel Macron tient un discours extrêmement offensif sur la nécessité d’interdire les réseaux sociaux aux moins de 15 ans (malgré un premier taquet du conseil d’état). Et pousse très fort (en tout cas communique très fort) sur sa volonté de légiférer rapidement. Très rapidement. D’ailleurs c’est aujourd’hui (lundi 26 Janvier) que le projet de loi arrive à l’assemblée nationale pour un examen en « procédure accélérée » avec en ligne de mire (mais il a un peu de mal à viser en ce moment, huhuhu) une entrée en vigueur pour la rentrée de Septembre 2026.

En plus de celui de baser l’essentiel de sa communication sur le sujet au travers de publications sur … X, cette interdiction pose au moins deux problèmes.

D’abord la rationalité d’une telle décision en termes de politique de santé publique. Car tout le monde (je parle ici de la communauté scientifique, pas des experts de plateaux télé ou de votre oncle Patrick) est d’accord pour indiquer qu’il n’existe pas de consensus scientifique sur le sujet d’une addiction (aux écrans et/ou aux réseaux sociaux). Or la démonstration de cette addiction serait pourtant la seule cause rationnelle d’une nécessité d’interdiction. Interdiction qui si une addiction était un jour réellement démontrée, et si on poussait alors la logique, devrait ne pas se limiter aux moins de 15 ans mais s’étendre aussi à l’ensemble de la société et donc aux publics y compris … adultes, ou à tout le moins, pour ces publics, faire l’objet de campagnes de sensibilisation au moins équivalentes à celle contre le tabac et l’alcool (toujours pour lesdits adultes).

Ensuite parce que, et je l’explique sur ce blog depuis des années, l’idée même d’une interdiction ou d’un couvre-feu est totalement idiote. Non pas que l’impact des médias sociaux sur les enfants et les adolescents soit nul, non pas qu’il faille le minorer, non pas que lesdits réseaux sociaux soient exempts de problèmes et ne causent aucune situation de souffrance ou de dépendance corrélées à des situations sans lien direct avec l’usage ou le non-usage des écrans ; mais cette interdiction telle qu’elle est imaginée aujourd’hui et au regard des dispositifs, des habitus technologiques partagés mais aussi de leurs failles inhérentes, cette interdiction porte en elle l’ensemble des possibilités de contournement qui seront (et sont déjà) à l’oeuvre pour s’en défaire et la rendre au mieux inopérante et au pire totalement contre-productive. Dans le seul pays (démocratique) qui l’a voté et tente de l’appliquer (l’Australie), les adolescents concernés détournent déjà les dispositifs de reconnaissance faciale supposés certifier l’âge. Et sur un autre sujet, depuis que l’on a interdit l’accès aux mineurs aux mastodontes du porno que sont Youporn ou Pornhub, on a vu croître et se multiplier les sites pornographiques se soustrayant à l’obligation de vérification d’âge et encore plus immondes en termes de violence de contenu et de pratiques que les deux sus-nommés.

La seule vertu d’une interdiction (pour autant qu’elle repose sur un consensus scientifique et qu’elle puisse s’appliquer sans atteinte aux libertés fondamentales ce qui n’est doublement pas le cas ce celle imaginée par Emmanuel Macron), la seule vertu d’une interdiction est de minorer les effets nocifs, malsains, « addictifs » qui auraient été démontrés.

Mais la seule chose qui est aujourd’hui démontrée, documentée et établie, et il faut donc encore une fois le marteler, c’est que les plateformes de médias sociaux sont non seulement parfaitement au courant des nuisances qu’elles produisent, mais qu’elles sont aussi parfaitement en capacité de les limiter voire de les réduire à néant (en cassant les chaînes de contamination virales, en supprimant la visibilité de certaines métriques, en embauchant en nombre suffisant des modérateurs, etc.). Et qu’elles ne le font pas parce que ce n’est pas bon pour leur modèle d’affaire. Et qu’après les industries du pétrole et du tabac, elles entretiennent de manière cynique et criminelle le troisième grand mensonge de notre modernité. Je vous remets ce que j’écrivais en Septembre 2023 dans l’article « Ouvrir le code des algorithmes ne suffit plus » :

« Après les mensonges de l’industrie du tabac sur sa responsabilité dans la conduite vers la mort de centaines de millions de personnes, après les mensonges de l’industrie du pétrole sur sa responsabilité dans le dérèglement climatique, nous faisons face aujourd’hui au troisième grand mensonge de notre modernité. Et ce mensonge est celui des industries extractivistes de l’information, sous toutes leurs formes. (…) Et même s’ils s’inscrivent, comme je le rappelais plus haut, dans un écosystème médiatique, économique et politique bien plus vaste qu’eux, leur part émergée, c’est à dire les médias sociaux, sont aujourd’hui pour l’essentiel de même nature que la publicité et le lobbying le furent pour l’industrie du tabac et du pétrole : des outils au service d’une diversion elle-même au service d’une perversion qui n’est alimentée que par la recherche permanente du profit. »

Depuis que j’écrivais ceci en Septembre 2023, la dérégulation totale de l’espace médiatique (des chaînes de télé aux médias sociaux et passant par la presse écrite) s’est encore accélérée alors qu’on l’imaginait pourtant déjà au maximum de sa vitesse, et chaque fait de notre réalité n’est aujourd’hui plus que le prétexte à un récit médiatique pour l’essentiel aussi totalement hors de contrôle que totalement asservi aux intérêts de puissances illibérales ou d’individus ayant fait le choix de les incarner ou de ramper à leurs pieds pour préserver leurs propres intérêts économiques. Ce ne sont pas « les médias sociaux » qui maintiennent à l’antenne un pédocriminel (Morandini) ; ce ne sont pas « les médias sociaux » qui donnent libre antenne à une personnalité politique multi-condamnée notamment pour complicité de provocation à la haine (Zemmour) ; ce ne sont pas « les médias sociaux » qui font d’un gigot mal cuit la source d’un complot du monde musulman autour de la nourriture Halal ; ce ne sont pas « les médias sociaux » qui laissent sans sourciller à l’antenne et en présence de journalistes, le fils d’un chasseur de Nazis parler de la nécessité d’établir aujourd’hui des rafles de population immigrée (Klarsfeld) ; ce ne sont pas « les médias sociaux » qui face à des images de l’ICE assassinant à bout portant des citoyens américains reprennent mot à mot les éléments de discours de l’administration Trump qui sont à l’opposé de l’évidence des faits et des images les documentant.

Vous me pardonnerez donc la comparaison mais l’impact (délétère, problématique) des médias sociaux sur les mineurs de moins de 15 ans est infiniment moins problématique que l’impact de l’écosystème de l’empire Bolloré (notamment) sur la santé mentale et le rapport aux faits et à la vérité de toute la population adulte en âge de voter.

Et je veux ici encore une fois le rappeler, à chaque fois qu’Emmanuel Macron (ou d’autres) vous parlent de l’urgence et de la nécessité de réguler les médias sociaux, il évite de traiter de la seule urgence qui vaille et qui serait de totalement repenser et rééquilibrer les forces du champ médiatique « classique » qui part totalement en vrille.

« Oui mais donc on fait quoi ? » me direz-vous.

On fait ce qui suit. Il est de toute évidence éminemment urgent et nécessaire d’astreindre les plateformes de médias sociaux à des régulations limitant leur pouvoir de nuisance. Et chacun sait aujourd’hui exactement comment faire. Tout comme chacun se rend aujourd’hui compte qu’il n’est qu’une seule et unique manière d’y parvenir. Tout cela aussi je l’ai déjà écrit, dit, expliqué. Il faut que l’ensemble de ces plateformes de médias sociaux soient reconnues comme pleinement éditrices des contenus qu’elles portent. Et il faut en finir avec l’hypocrisie du statut d’hébergeur qui continue aujourd’hui de leur être accordé. J’ai écrit un long article sur le sujet il y a peu, voyez le « chapitre 4 » du billet titré « Le web pourrissant et l’IA florissante : si nous sommes le bruit, qui sera la fureur. » En résumé (mais vraiment allez lire mon article en entier si cela vous intéresse) :

Dans la jurisprudence, l’un des critères les plus déterminants qui permet de distinguer entre hébergeur et éditeur et celui dit du « rôle actif », défini comme « la connaissance et le contrôle sur les données qui vont être stockées. » Or qui peut aujourd’hui sérieusement prétendre que Facebook, Instagram, X, TikTok et les autres n’ont pas un rôle actif dans la circulation des contenus hébergés, et que ces plateformes n’auraient ni connaissance ni contrôle sur les données et contenus stockés ? Le gigantisme fut longtemps l’argument mis en avant par les plateformes pour, précisément échapper à leur responsabilité éditoriale. Cet argument n’a aujourd’hui (presque) plus rien de valide techniquement ou de valable en droit.

Alors certes c’est un changement de paradigme. Alors certes là pour le coup va falloir se doter en termes de volonté politique de toute la panoplie du courage sacrificiel de l’imaginaire de Top Gun et pas simplement des lunettes aviateur de kéké.

Mais dans le discours ambiant autour de cette interdiction des réseaux sociaux aux mineurs de moins de 15 ans, il y a encore un point, un élément, une conséquence, que jamais personne n’évoque ni ne discute et qui me semble pourtant déterminant. Heureusement que je suis là

Admettons que cette interdiction soit votée et admettons qu’elle s’applique.

Si l’interdiction des réseaux sociaux aux moins de 15 ans était votée ce serait alors le plus tonitruant signal envoyé à l’appui de toutes les formes de dérégulation que ces plateformes espèrent et attendent.

Et c’est assez simple à comprendre : si plus aucun mineur de moins de 15 ans, aux yeux de la loi, ne peut et ne doit y être présent, alors le peu de (re)tenue et de régulation auxquelles elles s’astreignaient jusqu’ici par crainte d’une atteinte trop profonde à leur image deviendra instantanément caduque.

La responsabilité, la seule responsabilité de l’accès de mineurs de moins de 15 ans à des contenus extrêmement violents ou problématiques pour cet âge reposerait alors intégralement soit sur une défaillance de la responsabilité parentale, soit sur une incapacité de l’État à garantir le respect du cadre législatif dont il s’est doté. En clair et quoi qu’il puisse se passer ce ne sera plus du tout la faute des plateformes.

Si cette interdiction était votée et s’appliquait, tout se jouerait donc autour de la charge de la preuve de la vérification d’âge. Si c’est aux plateformes de faire la chasse aux comptes de moins de 15 ans, cela impliquera aussi, pour être efficace, que l’État (via des tiers de confiance comme … la CNIL ou l’ANSSI ou l’ARCOM ou PHAROS ou ma tante …) que l’État donc soit lui-même en capacité de documenter leurs manquements, c’est à dire d’identifier des comptes de moins de 15 ans toujours actifs alors qu’ils auraient supposément dû être repérés et fermés. Autant vous dire que ça va être compliqué vu les moyens actuels de l’état et le dimensionnement des effectifs des tiers de confiance sus-mentionnés. Notez bien sûr que les plateformes n’ont absolument aucun intérêt à effectuer cette vérification ou en tout cas à l’effectuer de manière optimale et maximale. Et si c’est à l’État de faire les vérifications, on retombe alors dans le scénario que j’évoquais plus haut, c’est à dire que l’entièreté de la responsabilité et de la charge de la preuve reposerait alors sur les familles (ou sur l’État lui-même). Aucune de ces deux solutions n’est ni souhaitable ni envisageable à l’heure actuelle autrement que dans des contextes politiques totalement et dangereusement illibéraux ou aveugles.

Soyez attentifs et attentives aux prochaines semaines autour de ce projet de loi. Vous serez surpris de constater qu’un certain nombre de plateformes ne vont pas le combattre avec toute l’énergie et la détermination que l’on aurait pu supposer. Car ce projet de loi ne les desservira pas totalement, et il est même probable qu’il leur soit utile pour basculer dans de nouveaux régimes de dérégulation.

« Oui mais en Australie. »

Je vous vois et vous entend. Et j’entends aussi notre Topper Harley national et tout l’hémicycle de droite et d’extrême-droite me dire « Oui mais en Australie ils l’ont fait et ça marche !« . Ce à quoi je réponds : « Alors en Australie ce qui marche c’est surtout des kangourous. » En d’autres termes, alors oui ils l’ont fait, mais ils l’ont fait de manière quand même assez … étrange, et pour l’instant bah ça marche pas super super.

Ils l’ont fait c’est certain et ce sont près de 5 millions de comptes qui auraient été supprimés ou désactivés ou restreints, en tout cas, et c’est important, selon les autorités.

Ils l’ont fait et en effet ça nous a mis le Zuck en pétard (mouillé) et en mode, « vous voulez pas plutôt collaborer avec l’industrie » et « travailler à un relèvement collectif des standards de sécurité, avec la possibilité de proposer des expériences adaptées à l’âge« , arguant (ce qui est vrai, je l’ai moi-même fait dans l’argumentaire de ce billet) que l’un des risques était de voir migrer les adolescents (en Australie la majorité numérique est à 16 ans) vers d’autres plateformes (encore) moins régulées.

Mais ils ne l’ont pas fait pour toutes les plateformes (et du coup bah … on cherche un peu le sens de tout ça …). Ils l’ont fait pour Facebook, Instagram, Threads, TikTok, Snapchat, Kick, Reddit, X, Twitch et YouTube (c’est certes déjà pas mal), mais ils ne l’ont pas fait pour Messenger, WhatsApp, Discord ou Roblox (plateformes initialement de messagerie ou de jeux mais qui sont aujourd’hui fonctionnellement construites et pensée comme autant de médias sociaux, perméables notamment à de la publicité et à toute une liste de dérives déjà largement documentées).

L’esprit de la loi australienne est le suivant « La législation est formulée de manière à donner une définition assez large des réseaux sociaux, laissant à la discrétion de la commissaire à la sécurité numérique [Julie Inman Grant – ndlr] le soin de désigner les plateformes comme telles. » Et bon courage à Julie Inman Grant qui jouit ici d’un grand pouvoir que j’espère corrélé à de grandes responsabilités parce qu’elle va avoir du taff … #SpidermanAttitude

Et donc l’une des premières conséquences a été un déport vers trois plateformes dont la popularité à explosé : « Lemon8, une application qui appartient à ByteDance, propriétaire de TikTok, puis Yope et WhatsApp. » Faut bien avouer que si on ferme des comptes de mineurs sur Instagram ou Tiktok pour qu’ils se retrouvent sur Lemon8 qui appartient à Tiktok …

Autre problème ou effet cliquet que ces débats mal posés et mal arbitrés inaugurent partout dans l’écosystème des services numériques, c’est celui d’une vérification d’âge que personne n’est en capacité de faire sans porter atteinte aux libertés (en l’état en tout cas des services actuels) mais que tout le monde à intérêt de faire y compris des pires manières possibles pour s’affranchir de possibles réglementations inabouties et bancales. Et voici donc « OpenAi qui ient d’annoncer le déploiement dans les prochaines semaines dans l’Union européenne de son outil de prédiction de l’âge » qui reposera, je cite toujours, sur « une combinaison de signaux, notamment la durée d’existence du compte, les sujets de conversations, les moments de la journée où l’utilisateur se connecte ou encore l’âge déclaré, a expliqué l’entreprise. » Et pourquoi OpenAI fait-il cela : parce qu’OpenAI vient d’ouvrir sa boîte de Pandore en proposant des chatbots sexualisés (notamment) et constate (comme c’est étonnant …) les dégâts causés à l’échelle de population jeunes (mais pas uniquement).

Conclusion.

Il faut avoir et garder un élément en tête. Jamais les grandes plateformes de médias sociaux ne renonceront à capter ce public adolescent et même enfantin. Jamais. Pour une raison simple : c’est là leur dernier levier de croissance. Et c’est le seul. Je vous l’expliquais déjà il y a … onze ans, en vous chantant : « Voici venu le temps du web des enfants. » C’est la raison pour laquelle toutes ces plateformes sans exception ont déjà déployé ou tenté de déployer des offres calibrées pour capter ces audiences : Youtube Kids, Messenger Kids ou encore Instagram for Kids (projet mis en pause depuis 2021). Et elles vont continuer.

La seule « bonne approche » dans cette régulation des accès des mineurs à ces plateformes, et quand je dis « bonne approche » j’entends qu’elle soit applicable en droit sans éparpiller façon puzzle les libertés publiques associées, la seule « bonne approche » consiste donc soit à modifier le statut des plateformes pour les rendre pleinement éditrices (et marginalement hébergeuses), mais en effet c’est un. changement complet de paradigme. Et/ou à travailler à contraindre les plateformes pour faire en sorte d’augmenter leurs responsabilités (éditoriales) à destination des publics mineurs qu’elles sont tout à fait ne capacité de circonscrire et de cibler. C’est par exemple l’orientation qui avait été travaillée, en Californie, à l’occasion du vote d’une loi « The California Age-Appropriate Design Code Act« , proposée en 2021 pour une entrée en vigueur en 2024, mais qui s’était finalement vue barrée par le puissant lobby des entreprises derrière « Netchoice » qui milite pour une dérégulation totale du commerce en ligne et combat toute forme de régulation quelle qu’elle soit au nom du 1er amendement de la constitution américaine.

L’idée derrière le California Age Appropriate Design Code Act était pourtant assez vertueuse et bien dimensionnée puisqu’il s’agissait :

« d’obliger les réseaux sociaux – comme Instagram et TikTok – et les plateformes de jeux via Internet à faire passer l’intérêt des enfants avant leurs profits. Approuvé à l’unanimité, le « California Age-Appropriate Design Code Act » obligerait ces plateformes en ligne à examiner comment la conception de leurs produits, leurs algorithmes et leurs stratégies publicitaires pourraient constituer un danger pour les mineurs. (…) S’il est définitivement approuvé, ce texte n’entrera en vigueur qu’à partir de 2024. Les législateurs californiens ont renoncé à une autre mesure qui aurait permis aux autorités de poursuivre les réseaux sociaux s’ils développaient des produits addictifs pour les mineurs (sic). »

Source Les Echos. Août 2022

Mais ces approches de régulation concertée et centrée sur les plateformes ne sont envisageables que dans le cadre d’une sincérité législative qui est aujourd’hui malheureusement inenvisageable. Si les lobbies ne font pas entrave, si Donald Trump ne menace pas d’augmenter les droits de douane et d’envahir la Pologne, les détournements seront dans tous les cas massifs et pour l’essentiel invérifiables.

Interdire les médias sociaux aux moins de 15 ans est donc en l’état inapplicable, et l’applicabilité d’une telle mesure reviendrait à encore augmenter l’arsenal législatif entravant le respect de la vie privée et des libertés individuelles. Et au regard de ce qui se passe à l’étranger et se profile potentiellement en France pour les prochaines présidentielles, si on peut éviter de se tirer des balles dans le pied, ça permettra peut-être que la future « ICE » nous mette un peu. moins de balles dans la tête.

La seule décision raisonnable et rationnelle pour protéger les mineurs (mais pas uniquement) c’est que la responsabilité des plateformes soit engagée sur leur statut désormais clair d’éditeur de l’ensemble des contenus qu’elle agrègent et organisent éditorialement et que le recours à la mention d’hébergeur ne soit plus la règle mais l’exception.

Zuckeberg à l’époque où il faisait son tour du monde de convocations devant les représentations nationales pour une liste de manquements extrêmement graves et documentés de sa plateforme (c’était en 2020) avait eu cette phrase : « Treat us like something between a Telco and a Newspaper » (« traitez-nous comme quelque chose entre un opérateur télécom et un journal »). Et bien ne le traitons pas comme ça l’arrange mais comme ce qu’il est : avant tout un journal, avant tout un média. Et traitons tous les autres également et de la même manière.

Grain à moudre.

Petit recueil de textes pour réfléchir (‘sereinement) à tout ça (et comprendre pourquoi après y avoir réfléchi sereinement ça reste bien une idée à la con

D’abord l’article très complet de Léo Roussel sur Mediapart à propos de l’expérience Australienne.

Ensuite l’interview d’Anne Cordier (la Queen sur ces sujets) et Grégoire Borst dans Usbek Et Rica : « Faut-il interdire les réseaux sociaux aux jeunes ? » (spoiler : bah non).

Bien sûr l’étude de l’ANSES dont tout le monde parle beaucoup mais que peu de personnes ont visiblement lu, et qui ne préconise pas d’interdire les réseaux sociaux mais de leur imposer des régulations suffisamment fortes pour désarmer leurs paramétrages toxiques (viralisation, biais de négativité, dark patterns, etc.)

Sans oublier les 3 articles d’Hubert Guillaud (le GOAT) sur la vérification d’âge, notamment le troisième (« un internet de moins en moins sûr« , « Impunité des géants et criminalisation des usagers« , « Panique morale en roue libre »)

Et parce qu’il traite d’une partie de ce sujet (autour de Grok qui déshabille les mineurs) mais aussi parce que chaque phrase de cet article est un coup de point dans la gueule des MAGA et de Musk (et une invitation à nous interroger sur ce que nous-mêmes tolérons et acceptons), le dernier papier de Thibault Prévost sur Arrêt sur Images, « Contre X », dont j’extraie cette citation, « Que faut-il attendre d’un président qui promet 109 milliards d’euros pour développer des IA génératives toxiques, et qui fête l’ouverture d’un sommet industriel pro-IA en publiant un deepfake de lui-même, sur X de surcroît ? »

[Mise à jour du lendemain] L’assemblée nationale a, malheureusement et sans trop de surprise, adopté le projet de loi d’interdiction des réseaux sociaux. Le sénat lui emboîtera probablement le pas.

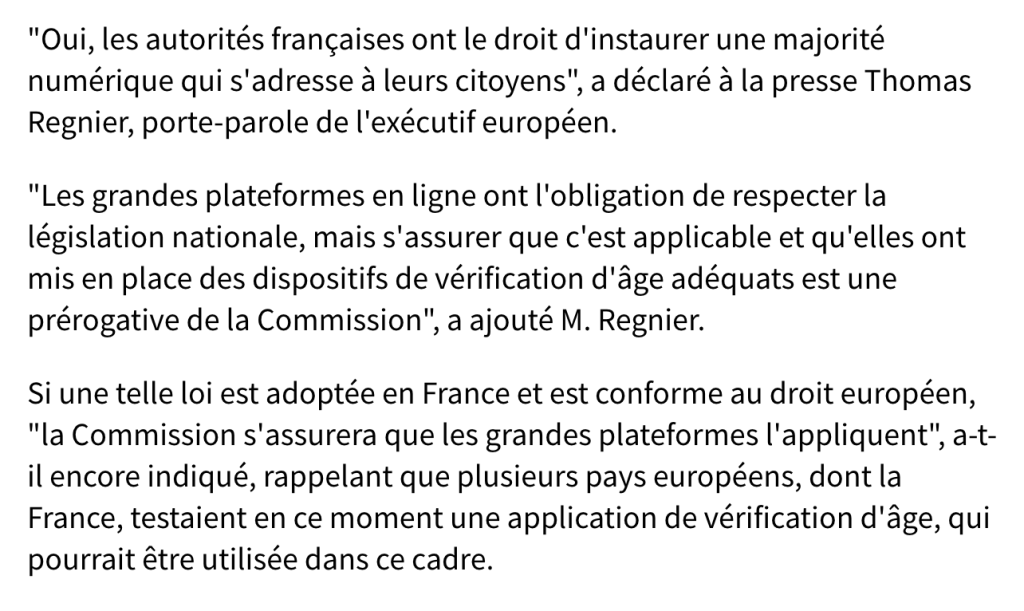

Spoiler : en l’état du droit et comme le remarque Raphaël Grably, la capacité de cette interdiction relève du seul périmètre de la commission européenne. Plus précisément :

Spoiler again : il est plus que probable que le Conseil d’Etat (avant ou après le passage au Sénat) remette un taquet en expliquant que grosso modo y’a rien qui va (définition de ce qu’est un réseau social, périmètre législatif européen, risque constitutionnel …).

Spoiler for sure : La commission européenne depuis quelques temps ne se signale pas vraiment pas sa volonté d’appliquer ne serait-ce que les règlementations en vigueur (notamment rapport à l’homme orange qui menace d’envahir la Pologne à chaque fois qu’on touche à un cheveu de ses Techbros). C’est donc très très peu probable qu’elle valide quelque forme d’interdiction que ce soit.

Spoiler au carré : de source bien informée (ici notamment), le gouvernement s’apprêterait à sortir une appli de vérification d’âge, adossée à la carte d’identité et intégrée à France Identité. Pour autant que ça marche et que ça aille au bout (cf les spoilers précédents), c’est donc France Identité qui deviendrait le tiers certificateur de confiance. Et là je dis bah bon courage et surtout « Hold my Beer » dès lors que le RN (par exemple) accédera au pouvoir. Et bon courage (bis) au regard de la quotidienneté et de l’immensité des fuites de données, y compris sensibles, et y compris au ministère de l’intérieur qui pas plus tard qu’il y a un mois reconnaissait son « manque d’hygiène informatique » (sic). [Mise à jour de la mise à jour du lendemain] Car pour rappel le principe du tiers de confiance c’est qu’il ne soit pas capable de faire le lien entre vous (qui cherchez à accéder à tel ou tel site) et la plateforme ou le service ou le site (auquel vous voulez accéder). Or en l’état, France Identité accède aux deux bouts de la chaîne, en tout cas est en capacité de le faire.

20.01.2026 à 16:32

Parcoursup est lancé. Et à l’université, c’est tous les jours le Doomsday.

Olivier Ertzscheid

Texte intégral (4091 mots)

Imaginez-vous vivre dans un pays où la totalité des entreprises seraient déficitaires. La totalité. Un pays dans lequel aucune, je dis bien aucune entreprise ne serait en capacité de dégager un résultat positif. Et bien c’est exactement la situation actuelle de l’ensemble des université françaises. La totalité. Je vous l’avais annoncé (avec d’autres et depuis quelques années et avec colère) et c’est arrivé. La totalité des universités françaises ont voté un budget en déficit.

Vous me direz qu’une université n’est pas une entreprise. Certes. Pour autant et depuis le vote de la funeste LRU, loi dite « d’autonomie », par la fumeuse Valérie Pécresse sous injonction du premier président délinquant (Nicolas Sarkozy), tout à été fait pour assimiler les universités à autant d’entreprises. Ça donne envie de gifler des gens de droite avec une barre à mine quand on relit ça aujourd’hui, mais à l’époque tout ça nous était présenté en mode « il s’agit de redonner de l’attractivité aux universités« . Lol. Dans un an, en 2027, voilà 20 ans que la loi LRU aura donc été déployée. Ne comptez-pas trop sur moi pour la fête d’anniversaire, mais le bilan est là : vingt ans c’est le temps qu’il faut pour totalement détruire à la fois les infrastructures universitaires (ou les laisser s’effondrer, cela revient au même), pour précariser totalement à la fois la population étudiante mais aussi les vacataires et personnels administratifs et techniques sans qui rien jamais n’est possible, pour faire de la recherche une activité concurrentielle comme les autres et ne plus la financer que « sur projet » (dont la plupart ne sont donc … pas financés), et pour épuiser presque totalement la bonne volonté et la détermination des enseignant.e.s. et des chercheurs et chercheuses.

Vingt ans c’est aussi le temps qu’il aura fallu pour en parallèle, faire toute la place au secteur privé, à ces écoles véroles qui captent les financements publics, à ces formations croupion qui ajoutent des frais de scolarité exorbitants à des diplômes en carton (mais tout va bien, c’est un banquier qui vous y accueille et qui vous parle des prêts possibles avant de vous parler des enseignements reçus), à ces conglomérats d’escrocs aka les grands groupes privés qui recrutent des clients avant de former des étudiants. Juste un chiffre. Presque 3 millions d’étudiantes et d’étudiants en France, dont presque 800 000 dans le privé. Un chiffre et une dynamique : « Depuis 2013, les inscriptions dans le privé ont même augmenté de 62,7 % contre 9,6 % dans le public. » Pourquoi cette explosion du privé depuis 2013 ? Pour bien comprendre, 2007 c’est donc l’année où la loi LRU est votée pour les universités, et 2013 c’est l’année où elles l’ont dans le cul parce que ce qui était prévu dans le cadre de la loi LRU c’était que : « d’ici au 1er , toutes les universités accèdent à l’autonomie dans les domaines budgétaire (article 50) et de gestion de leurs ressources humaines et qu’elles puissent devenir propriétaires de leurs biens immobiliers. » Tout ça, les 100% d’universités publiques qui votent aujourd’hui un budget en déficit, ce n’est pas le fruit du hasard mais l’aboutissement d’un projet politique parfaitement pensé, et surtout parfaitement dégueulasse.

Il fallait être rentable. Rentable les formations, rentable les débouchés, rentable, rentable, rentable. Et autour et pendant que les aides de l’état tombaient comme jamais dans les financements des aides aux entreprises, comme jamais les aides de l’état pour les universités se tarissaient : et aux universités de se démerder avec leur gestion bâtimentaire (pile au moment où la plupart desdits bâtiments commençaient à tomber en ruine), et aux universités de se démerder avec la prise en charge du glissement vieillesse-technicité, et aux universités de se démerder avec la prise en charge de la mutuelle de tous leurs agents et salariés. Et « à moyens constants » hein.

Alors on trouve certes sous la plume de quelques journalistes également ou anciennement universitaires, des éditoriaux qui nous alertent. Par exemple celui de Guillaume Erner le 16 Janvier sur France Culture qui disait et écrivait :

« Il y a deux manières de faire la guerre à l’université. La première est frontale : considérer, comme Donald Trump, que ce sont des repaires de gauchistes et les étrangler ouvertement. La seconde est plus sournoise : les laisser crever à petit feu, silencieusement, sans débat, sans indignation. J’ai bien peur que ce soit cette seconde méthode qui soit à l’œuvre en France.

Or il n’y a rien de plus dangereux pour un pays que cet anti-intellectualisme-là. Faire la guerre à l’université, ce n’est pas un détail budgétaire : c’est un volet central de la guerre à l’intelligence. C’est obérer l’avenir. Les étudiants d’aujourd’hui sont les doctorants de demain et les chercheurs d’après-demain. Ceux qui, au nom d’autres “priorités”, se désintéressent du sort des universités sont en train d’endommager gravement l’avenir du pays — dans une indifférence quasi générale. »

Mais à part ces quelques surgissements tout à fait confidentiels dans le bruit médiatique ambiant, partout un grand silence.

Et pourtant moi comme d’autres on s’agite, on analyse, on gueule, on documente. Et depuis longtemps. Mais rien putain. Rien. Et des ministres de la chose dont on à l’impression qu’ils ne font que se disputer le podium de la connerie, le maillot jaune de l’incurie, et la palme de la provocation. Dernier en date : Philippe Baptiste qui après avoir littéralement chié sur les universités et les universitaires en Novembre 2025 (« c’est pas Zola non plus« ) lance en Janvier 2026 des « Assises du financement des universités » (lire à ce sujet l’indispensable, l’incontournable, et le plus précieux d’entre nous, aka Julien Gossa). Le résultat de ces assises je vais vous le donner en exclusivité :

- « la carte des formations va être revue. » Traduction : des formations vont fermer. Traduction de la traduction : les SHS ça va être une boucherie, allez plutôt vous trouver des métiers utiles et rentables aux yeux du Medef.

- « L’offre de formation va être rationalisée à l’échelle des territoires. » Traduction : des sites universitaires délocalisés vont fermer (mais pas tout de suite, en tout cas pas partout tout de suite, parce que y’a des municipales et que globalement c’est pas le bon timing)

- « Une politique différenciée des droits sera appliquée. » Traduction : les frais d’inscription vont exploser. Un peu exploser en licence. Beaucoup exploser en Master et au-delà. Et à la folie exploser pour les étudiantes et étudiants étrangers extra-communautaires (c’est malheureusement déjà souvent le cas) parce qu’en plus d’être étudiants bah ils sont étrangers.

Et vous savez quoi ? A la fin de ces « assises » on aura toujours aussi mal au cul et on fera toujours semblant de ne pas comprendre pourquoi.

Franchement je ne sais plus ni comment le dire ni comment m’y prendre. De la place qui est la mienne, de ce que je vois des micro-responsabilités que j’endosse ou ai endossé (ouverture de formation, direction d’un département, direction-adjointe d’une composante) je suis toujours autant effaré qu’en colère quand je vois à la fois notre propre capacité à nous tirer des balles dans le pied, notre incapacité à nous indigner autrement que de manière feutrée et policée, et pourtant l’énergie et la « bonne foi » d’une majorité de collègues qui décident de mesures dont chacun voit bien qu’elles sont mortifères. On n’a jamais fait autant de réunions, on n’a jamais eu autant d’instances, on n’a jamais eu autant de tutelles, on n’a jamais eu autant d’évaluations permanentes sur la qualité de ceci et l’opportunité de cela, et on n’a jamais été autant absolument incapables de « piloter » nos établissements autrement que par injonctions paradoxales et contradictoires. [Disclaimer. La littérature scientifique (notamment dans le champ de la psychologie et notamment dans les années d’après-guerre avant celle de l’économie et du management des années 1980) documente parfaitement la manière dont se termine l’histoire des individus et des institutions dirigées sur des injonctions paradoxales, et elle (la littérature scientifique) est unanime : ça se termine à l’asile.]

Mais alors concrètement, c’est quoi le quotidien d’une université

avec un budget en (gros) déficit ?

En résumé c’est une université où plus rien n’est jamais certain. On nous répète souvent dans tous les éditos économiques et politiques que les entreprises ont besoin de visibilité sur le moyen et le long terme et qu’elles n’aiment rien moins que l’incertitude. Bah figurez-vous que les universités … aussi. Quand plus rien n’est jamais certain, quand les personnels (profs, vacataires, agents techniques, personnels administratifs) ne savent pas s’ils pourront toujours être là dans un mois ou dans un an, quand on ne sait pas si on pourra maintenir tel ou tel groupe, telle ou telle formation, tout se tend puis … tout se détend brutalement dans le fracas d’un effondrement.

C’est une université dans laquelle des gens font des cours, beaucoup de cours, parce qu’il n’y a plus assez de collègues pour faire ces putains de cours (parce qu’on ne crée plus du tout de postes à l’échelle de la volumétrie des départs en retraite notamment et parce que même les vacataires ne veulent plus venir tellement c’est compliqué et la misère), et où ces mêmes gens qui font beaucoup de cours, où ces enseignant.e.s doivent attendre la réunion d’un tribunal des heures supplémentaires une fois que l’année est terminée, pour savoir s’ils pourront être ou non payés pour les cours qu’ils ont fait « en plus » durant cette année. Vous me direz « bah ils n’ont qu’à bosser pour la gloire, ça va bien vu leur salaire. » Je vous confirme que certains le font déjà. Vous me direz aussi « bah ils n’ont qu’à pas faire ces cours. » En effet. Certains le font déjà aussi. Et donc on ampute les maquettes et les contenus de formation. Et on marche au rabais. Mangez plutôt vos morts tiens.

C’est une université dans laquelle plus rien, absolument plus rien n’est logique. Chaque décision sur le plan de la formation ou de la recherche entre directement en concurrence (pas du tout libre et totalement faussée) avec des arbitrages de gestion de pénurie ou de financement sur projet qui au mieux les rendent impossible et au pire se font systématiquement au détriment d’autres (formations, composantes, collègues, services) qui sont pourtant les mêmes que nous. Ça me rend totalement dingue quotidiennement. Et si j’étais tout seul ce ne serait pas très grave.

100% des universités publiques qui ont voté un budget en déficit et n’ont donc, de manière très rationnelle et très empirique, plus aucun moyen pour fonctionner normalement. Je le redis différemment. 100% des universités publiques fonctionnent aujourd’hui au mieux en mode dégradé, en gérant des pénuries et de la précarité à tous les niveaux. Je le redis encore autrement. Derrière ce 100% des universités publiques qui crèvent à crédit, il y a vos gosses. 3 millions d’entre elles et eux. Vos gosses (les miens aussi hein) qu’on accueille. Vos gosses qu’on forme professionnellement. Vos gosses qu’on émancipe intellectuellement. Vos gosses qu’on ouvre culturellement. Mais vos gosses aussi qu’on soigne (la médecine universitaire est digne de celle d’un pays du tiers-monde mais les collègues – médecins, infirmières, psys, font ce qu’ils et elles peuvent et sans elles et eux les drames déjà intolérables le seraient encore davantage). Mais vos gosses aussi qu’on nourrit parce qu’aujourd’hui chaque campus est devenu une putain de succursale des restos du coeur, où l’on voit des profs filer des cours et à manger.

[Parenthèse : vous connaissez Benjamin Duhamel ?] Et lorsqu’enfin le gouvernement devrait voter les repas à un euro pour tous les étudiants et les étudiantes (hope so …) il faut encore se fader ce chancre mou de Benjamin Duhamel expliquant que « houlala mais les enfants de Bernard Arnault et des milliardaires ils vont pouvoir manger pour un euro, est-ce que c’est vraiment une mesure de gauche ? » Benjamin écoute-moi. Ecoute-moi bien. T’as vraiment cru que les enfants de Bernard Arnault ils étaient passé en fac de lettres à Cergy ? Où même à l’IAE de Poitiers ? T’as vraiment pensé que les chiards de nos milliardaires ils allaient faire la queue au Resto U ? Benjamin pardon mais vraiment t’es trop con. Tu me fatigues avec la constance d’un enfant de 3 ans sous ecsta, tu m’énerves avec l’opinâtreté d’un bouton d’acné récalcitrant sur la peau d’un adolescent, tu m’irrites la tête avec l’efficacité d’un milliard d’oxuyres irritant des culs. [/Maintenant vous connaissez Benjamin Duhamel.]

[Mise à jour du lendemain] Par ailleurs comme l’écrit très bien Nozo sur X : « On s’en branle on préfère qu’un enfant de bourgeois mange pr 1€ plutôt qu’un pauvre ne puisse pas manger ou se retrouve à devoir 36000 justificatifs pr bénéficier d’un repas pas cher. » [/Mise à jour du lendemain]

Dites et pensez ce que vous voulez de l’université mais gardez en tête que tout cela concerne d’abord vos enfants. Trois millions d’entre eux. Le monde dans lequel vos gosses (et les miens) vont devenir des adultes n’aura plus rien de commun avec celui que nous avons connu. Dérèglement climatique, conflits internationaux, escalades militaires, brutalisation des démocraties et des institutions, désinformation massive, arrivée au pouvoir de régimes autoritaires, illibéraux, montée des nationalismes et des fascismes. Donc on ne va pas seulement avoir besoin de discipliner les corps via la remilitarisation qui s’annonce, mais on va aussi avoir besoin, et besoin comme jamais d’avoir des gens capables de réfléchir et de penser le monde, leur monde, avec toute la distance et les connaissances que cela implique.

J’écoutais dimanche soir l’émission « En société » sur France 5 dans laquelle Magali Lafourcade (magistrate) expliquait à la fois comment et pourquoi Donald Trump et toute sa diplomatie mettaient les bouchées double en pression et en désinformation pour faire en sorte que l’extrême-droite (Le Pen ou Bardella) arrive au pouvoir en France (à partir de la 29ème minute). Demain il sera beaucoup trop tard pour sauver les universités et avec elles une certaine conception de la démocratie et de la société. Parce qu’aujourd’hui la plupart des politiques ont « juste » le projet qu’elles s’effondrent en nourrissant leur croyance que le privé les remplacerait. Ils et elles ne sont pas hostiles « au savoir » ou « à la connaissance » mais ils ne voient pas l’intérêt ce « cette connaissance là » ou de « ces savoirs là ». Mais demain celles et ceux qui seront au pouvoir auront une posture totalement différente : ils n’en auront absolument plus rien à foutre et viendront pisser sur nos tombes. Et pour ce qui tiendra encore vaguement debout, ils y mettront des grands coups de botte pour que ça finisse de s’effondrer. Nous ne serons plus des opposants ou des adversaires, nous serons des ennemis. Regardez autour de vous partout dans de monde à chaque fois qu’un pouvoir a basculé : aux USA avec Trump, en Argentine avec Milei, en Italie avec Melloni, et ainsi de suite. En France la rumeur d’un « islamo-gauchisme » à l’université a très exactement été inventée et construite pour cela. Et force est de constater que ça marche. A ce rythme là, demain en France comme ailleurs aujourd’hui, les enseignants, enseignantes, chercheurs, chercheuses, seront juste des ennemis. Des cibles. Voilà pour la première ligne. Mais derrière, juste derrière, il y a la deuxième ligne. Celle de vos gosses, justement.

Et puis sur tout ça vous ajoutez cette autre immense

saloperie qu’est Parcoursup.

Et dont je vous ai aussi souvent parlé. Et là aussi pardon d’avoir eu (avec d’autres) raison trop tôt mais cela fonctionne exactement comme c’était prévu au départ. C’est à dire primo, déposséder la plupart des établissements de leur marges d’appréciation des dossiers. Juste pour vous donner une idée d’à quel point c’est lunaire, cette année on nous a expliqué que si on voulait toujours avoir des lettres de motivation dans les dossiers, bah il allait falloir … le justifier. Et oui. Je rappelle que par ailleurs tout est tellement saucissonné dans Parcoursup pour les lycéens et lycéennes que le remplissage d’un dossier renvoie immanquablement à la scène « ça dépend ça dépasse » du Père Noël est une ordure : décrivez votre vie en 100 caractères, votre projet d’orientation en 250 et votre motivation en 300 caractères espaces comprises. Parcoursup aujourd’hui c’est Twitter y’a 10 ans. Et donc maintenant c’est à nous de justifier que « ah mais oui on veut une lettre de motivation. » C’est encore une idée à la con de mon ami Mister T et de son équipe qui met au moins les 2/3 des équipes pédagogiques universitaires en PLS mais ça, mon ami Mister T et le ministère, ils n’en ont absolument rien à foutre. Deuxio, remettre entre les mains de décideurs aussi éloignés que possible du terrain (ou totalement alignés avec un agenda politique libéral circonstanciel, ce qui est tout à fait compatible avec le premier critère), les choix de volumétrie d’accueil et de nombre de places. Et là encore il faut lire Julien Gossa qui le répète, le documente et l’explique patiemment :

Pour la première fois depuis la seconde guerre mondiale, la politique éducative nationale ne vise plus à élargir l’accès aux études supérieures, mais à le réduire. La France se tourne désormais officiellement vers un régime de démassification, de réduction du niveau global d’éducation et de formation professionnalisante de la population. Cette orientation n’a pas d’équivalent historique (…)

Tertio, tout miser sur l’épuisement par la contrainte. C’est tellement compliqué, tellement usant de se battre contre ces guignols, il faut tellement tout recommencer chaque année, qu’au bout d’un moment même les plus énervés (genre moi) finissent par capituler. Ok. Balek. Vous voulez qu’on trie juste parmi des moyennes anonymes ? On va le faire. Vous voulez qu’on soit tellement inondés de dossiers et de demandes qu’on finisse par se résoudre à ne plus les traiter que statistiquement ou algorithmiquement, et bah d’accord (vu que ça fait maintenant 7 ans qu’on s’épuise à vous expliquer et à vous démontrer que, par exemple, la hiérarchisation des voeux permettrait de tout accélérer et d’arrêter de faire nimp). Et derrière y’a plus pour les ministres et gouvernements qu’à tout laisser filer, et dès que ça commence à filer, tout vient très vite. Les universités suppriment des places : 300 par ci, 600 par là.

Plusieurs milliers de places supprimées à la rentrée à l’échelle de l’ensemble des universités et au regard des 3 millions d’étudiantes et d’étudiants ça paraît anecdotique. C’est pourtant tout à fait critique. Parce que c’est le point de bascule. Définitif. Derrière ces places supprimées il y a, encore et toujours, vos gosses. Qui devront soit renoncer à étudier, soit aller étudier plus loin de chez eux (avec les frais que cela impose), soit se résoudre et vous avec à se tourner vers les vautours opportunistes du privé. Et puis ce ne sont pas que des « places » que l’on supprime. Parce qu’en face de ces « places » il n’y aura plus de profs, il n’y aura plus de personnels techniques et administratifs. Y’aura plus rien. Juste notre colère et notre rage. Qui peut-être trouvera des formes collectives pour s’incarner et se manifester. Il en est de très rares à l’université comme le collectif RogueESR par exemple. Mais face à l’Empire …

11.01.2026 à 14:30

Le réel, le vrai et la technorrhée. Comment la question du langage s’est déplacée.

Olivier Ertzscheid

Texte intégral (6796 mots)

Republication pour archivage et partage de l’article paru sur AOC.media le 20 Octobre 2025.

La question du langage s’est déplacée, et ce déplacement s’accélère de manière assez vertigineuse. Juin 2024 : mon livre « Les IA à l’assaut du cyberespace » revient sur les début tonitruants de ChatGPT et de ce que je nomme les « artefacts génératifs ». J’y pointe notamment les promesses encore maladroites de la génération de vidéos. Six mois plus tard, décembre 2024 : chacun reste bouche bée devant les prémisses des promesses de Sora d’OpenAI en termes de génération vidéo. Six mois plus tard encore, mai 2025, nous restons bouche bée devant cette fois Veo 3 de Google qui ajoute du son synchronisé à des vidéos toujours artificielles. Et en août 2025 c’est encore Google qui dévoile « Genie 3 », permettant de générer des mondes interactifs en temps réel à partir d’un simple prompt.

La question du langage s’est déplacée. C’est ce que depuis 25 ans et un peu plus, j’observe et documente à l’échelle de recherche qui est la mienne : celle de nos environnements numériques. Ces environnements avant-hier saturés de mots, puis hier encore d’images et de vidéos, et qui le sont désormais d’artefacts génératifs qui à leur tout sursaturent tant les mots que les images. Ad Libitum. Vertiges non d’une simple logorrhée mais d’une sorte de « technorrhée », l’emballement continu d’un capitalisme sémiotique ; une technorrhée pensée comme l’alliance chimiquement pure entre, d’une part, la merdification – « enshittification » – des médias sociaux en particulier et du web en général, et d’autre part, le « Brainrot » ou « abrutissement numérique » qui en est tout autant la cause que l’effet.

La question du langage s’est déplacée. Et dans ce déplacement, dans cette « différance » (Derrida), naissent et prennent place des mondes. Avec leurs images, leurs langages, leurs grammaires, et leurs vérités propres qui sont autant de singulières croyances. C’est dans cet écart par exemple que deviennent possibles, tristement et pathétiquement possibles, des images de Gaza transformée en Riviera, ou celles de soldats nazis défilant au milieu de résistants fêtant la fin de la guerre dans une vidéo mise en ligne par le pourtant très sérieux Service d’Information du Gouvernement (SIG). Dans ces déplacements du langage, dans ces « différances », et dans ces univers propres, cohabitent des représentations tenant aussi bien de délires, de fantasmes ou d’imaginaires que de saisissants réalismes.

Dans ce monde, dans ces mondes plus précisément qui sont aussi le nôtre, qui font en tout cas partie du nôtre, la frontière est extrêmement fine entre la capacité de ces technologies à nous laisser tout émerveillés et ahuris ou à nous transformer en autant d’abrutis totalement hébétés.

La question du langage s’est déplacée.

Et avec elle nos capacités à faire récit, à s’entendre et à s’écouter. Et avec elles, donc, notre capacité à faire société.

Longtemps cantonnées à la vallée de l’étrange, ces générations artificielles, ces vidéos notamment, n’ont aujourd’hui plus rien d’étrange dans leur rendu naturaliste. Fini les scènes animées où l’on détectait l’intervention de l’IA en regardant les mains et le nombre de doigts. Cela ne dispense pas ces générations d’erreurs factuelles ou contextuelles ou d’approximations, d’errances et d’hallucinations (nous y reviendrons) mais le photoréalisme est désormais totalement calculable. Certes le coût de ce calcul est vertigineux mais pour l’instant nous n’y prenons garde. Cette sortie de la vallée de l’étrange pour la plupart des contenus vidéos générés par IA (je parle ici de ceux qui ont vocation illustrative et non délirante ou seulement poético-ludique), nous fait entrer dans un monde … étrange. Une étrangeté qui ré-interroge notre capacité à dire le vrai, et surtout nos heuristiques de preuve, c’est à dire la manière dont collectivement nous pouvons attester que ceci s’est produit et s’inscrit dans une possibilité du monde que l’on appelle le réel.

On convoque souvent, à raison, l’argument selon lequel rien de tout cela ne serait vraiment nouveau. En effet l’invention de la peinture voit aussi l’invention des faussaires, l’invention de la photographie voit aussi celle de la retouche, avec l’invention du cinéma vient l’invention du truquage, et le développement de la radio et de la presse vont de pair avec celui des blagues, canulars, détournements, caricatures et fausses nouvelles. Mais les artefacts génératifs contemporains proposent une cinétique de représentations qui, à des échelles jamais atteintes d’usages massifiés et de circulations permanentes, cessent de nourrir nos imaginaires pour préférer les instancier, et ce faisant prive notre capacité individuelle et collective de recours à l’imaginaire d’une bonne part de sa puissance symbolique ; car tout est déjà là, car tout semble calculable et donc prévisible ; car tous les calculs ont été déjà faits ou le seront bientôt.

Pour bien saisir ce qui nous étreint et nous éreinte collectivement dans l’irruption de ces artefacts génératifs, il faut par exemple imaginer l’intérêt de l’écriture et le rôle d’un écrivain dans un monde où la bibliothèque infinie de Borges serait non seulement réelle mais dans laquelle chacun des ouvrages qu’elle contient serait surtout aisément accessible et consultable ; puisque tout est déjà là où peut l’être sur simple commande, alors la langue n’est plus un ouvroir de potentialités et d’imaginaires : elle semble n’être plus que la gangue de possibles concaténés, calculables et révélables.

Création, confiance et certification.

Sans refaire le débat du Phèdre de Platon et la condamnation de l’écriture, il est certain que quelque chose d’essentiel se joue aujourd’hui autour de la création, de la confiance et de la certification.

Création d’abord : qui peut encore être créateur/créatrice (dans le domaine des arts comme dans l’ensemble des métiers, tâches et fonctions de nos quotidiens) et de quelle manière l’être « avec », « à l’abri » ou « à l’écart » des artefacts génératifs ?

Confiance ensuite : comment avoir et faire confiance à celui ou celle qui crée dans l’originalité et l’intentionnalité de sa création ?

Certification enfin : comment certifier la part de cette création de la confiance qui peut ou doit lui être rattachée (et qui peut varier d’intensité et d’enjeu selon que ladite création concernera une oeuvre par exemple littéraire ou picturale, ou une décision médicale ou de justice) ? Des questions en triptyque que l’on ramène trop souvent à nos perceptions singulières alors qu’elles sont un bouleversement qui doit être pensé collectivement comme le suggérait Hervé Le Crosnier il y a … 30 ans de cela :

« La modification d’un document porteur de sens, de point de vue, d’expérience est problématique. Ce qui change dans le temps c’est la connaissance. Celle d’un environnement social et scientifique, celle d’un individu donné … Mais ce mouvement de la connaissance se construit à partir de référents stables que sont les documents publiés à un moment donné. Les peintres pratiquaient le « vernissage » des toiles afin de s’interdire toute retouche. Les imprimeurs apposaient « l’achevé d’imprimer ». Il convient d’élaborer de même un rite de publication sur le réseau afin que des points stables soient offerts à le lecture, à la critique, à la relecture … et parfois aussi à la réhabilitation. » Hervé Le Crosnier. « De l’(in)utilité de W3 : communication et information vont en bateau. » Présentation lors du congrès JRES’95, Chambéry, 22-24 Novembre 1995.

Ce que nous traversons avec l’IA dans sa dimension générative relève également d’un manque de ritualisation assumant la création de « points stables » qui fassent consensus ; mais apposer un label ou un filigrane « généré avec IA » ne suffira pas à construire ce repère car il ne s’agit plus ici de traiter seulement des questions de « modification » de documents porteurs de sens mais d’étendre ces points stables à des processus créatifs qui relèvent essentiellement de continuums complexes entremêlant des questions juridiques, économiques, techniques (informatiques) et éthiques.

Le temps des c(e)rises.

Nous sommes à ce moment de bascule où, pour l’instant, c’est comme si perdurait encore un effet Larsen dans l’esthétique de la réception de ces images et de ces vidéos ; comme si subsistait encore un bruit, une distorsion, un Larsen cognitif autant que collectif ; un Larsen qui ne s’éteint que lorsqu’enfin nous sommes à distance, à bonne distance, entre l’intention lisible de la génération et l’interprétation lucide de son effet sur nous ou sur le monde. Tant que cette distance n’est pas établie, ce bruit, ce doute, nécessaire, subsiste à l’horizon interprétatif : ce que nous voyons est-il réel malgré son photoréalisme ? Dès lors que cette distance est abolie – et tout est fait dans l’économie des plateformes pour y parvenir – alors ce bruit et ce doute s’éteignent, nous croyons ce que nous voyons. Or il n’est plus grand-chose de réel à voir dans ces enceintes.

Heuristique (et colégram).

C’est à chaque fois la même question qui revient et que je pointe (avec d’autres) depuis au moins 2011, parce que cette question est consubstancielle de chaque avancée technique qui touche à notre rapport au langage ou à l’image ou aux deux, c’est à dire à notre rapport au réel. Cette question c’est celle de savoir comme l’on bâtit de nouvelles heuristiques de preuve.

Il y a deux niveaux différents sur lesquels penser la complexification de nos anciennes heuristiques de preuve. D’abord la documentation récréative, ludique ou fictionnée du monde : l’enjeu est alors celui de la dissimulation ; il faut soit faire en sorte que le destinataire ne voit pas la simulation, soit qu’elle se dise pour ce qu’elle est (un « dit » de simulation) et qu’elle suscite l’étonnement sur sa nature. Et puis il y a la documentation rétrospective de tout ce qui fait histoire dans le temps long ainsi que celle qui concerne l’actualité. C’est alors l’exemple de la vidéo du SIG que j’évoquais plus haut, où le moindre casque à pointe nous fait basculer de l’ahurissement à l’abrutissement.

On croit souvent – et l’on s’abrite derrière cette croyance – que chaque simulation, chaque nouvelle production documentaire générée par intelligence artificielle, ajoute au réel. C’est totalement faux. Chaque nouvelle simulation enlève au réel. Parce que le réel historique n’est pas un réel extensible : il peut se nourrir de représentations historiques mouvantes au gré de l’historiographie et de l’émergence de preuves ou de témoignages, mais chaque nouvelle génération de ce réel historique potentiel va venir se sédimenter dans l’espace public mémoriel dont la part transmissible est extrêmement ténue et s’accommode mal d’effets de concurrences génératives. La question, dès lors, n’est pas tant de condamner les utilisations imbéciles ou négligentes de technologies d’IA pour illustrer un fait historique mais, par exemple, de savoir comment mieux rendre visible et faire pédagogie de la force incroyable d’authentiques images d’archives.

Nos imaginaires sont des réels en plus. Les effets de réel produits par les artefacts génératifs sont des imaginaires en moins.

Dans le domaine du langage les artefacts génératifs orientent bien plus qu’ils n’augmentent notre capacité à faire récit. Il se produit à peu de choses près ce que l’on avait déjà observé derrière la – fausse – promesse marketing initiale qui fut celle des grands réseaux sociaux généralistes : la promesse qu’en multipliant la diversité des profils, des origines, des croyances, des nationalités, des cultures auxquelles nous serions confrontés alors nous deviendrions plus ouverts, plus riches de liens sociaux, et plus empathiques. Or il se produisit essentiellement deux choses : d’abord cette exposition à une supposée diversité fut un feu de paille parce qu’elle allait contre la naturalité première de nos socialisations qui est de d’abord chercher celles et ceux qui nous sont semblables et que les plateformes, Facebook en tête s’aperçurent très vite que tout cela n’était pas bon pour le business (voir à ce sujet les travaux de danah boyd qui montra très tôt comment Facebook avait détruit l’expérience de la mixité sociale dans les universités de 1er cycle – « college » – aux états-unis). Ensuite les effets promis de proximité se transformèrent en effets subis de promiscuités effaçant toute forme d’empathie au profit de la dimension spéculative immédiatement virale et donc rentable de l’ensemble du spectre des discours de haine.

Il est en train de nous arriver exactement la même chose avec l’ensemble de l’actuelle panoplie des artefacts génératifs disponibles, de Genie 3 à ChatGPT5 : nous ne multiplions pas nos capacités collectives à faire récit (que ces récits soient imaginaires, réels ou réalistes et que leur support premier soit celui du texte, de l’image ou de la vidéo), nous les standardisons et nous nous enfonçons dans des dynamiques de reproduction qui se nourrissent de toutes les formes possibles de confusion ; une confusion entretenue par des formes complexes d’indiscernabilité qui tiennent à l’immensité non auditable des corpus sur lesquels ces IA et autres artefacts génératifs sont « entraînés » et ensuite calibrés.

Nous ne produisons pas davantage de nouveaux récits ou de nouveaux imaginaires mais, pour l’essentiel, nous reproduisons de manière industrielle toujours les mêmes, et après la phase de ce que l’on nomma des « hallucinations » vient aujourd’hui une autre phase, qui est celle de « l’effondrement » et qui désigne ce moment où les artefacts génératifs sont entraînés sur des contenus eux-mêmes artificiellement générés, des effondrements qui ruinent et minent les dynamiques d’interprétation et de représentation au fur et à mesure où celles-là mêmes sont érigées en modèles.

Au commencement était le mot-clé.

« En 2025 le web est donc un champ de ruine épistémique » écrit Thibault Prévost dans l’une de ses analyses à propos du phénomène de Slop AI, cette « technorrhée » symptôme de la merdification des plateformes et de notre expérience générale des environnement numériques. Je vous propose un (rapide) retour sur l’une des origines de cet effondrement qui fait qu’aujourd’hui et comme l’écrivait Balzac à propos d’une figure féminine de l’un de ses romans, la plupart de nos environnements numériques, dont le web, « n’ont plus que la beauté des villes sur lesquelles ont passé les laves d’un volcan. »

Au commencement donc était le mot-clé. Notre premier rapport au langage comme nouvelle agentivité opératoire sur une immensité de contenus non-ordonnés, c’est celui du mot-clé tel que les moteurs de recherche nous le proposèrent en prenant la suite des annuaires de recherche (lesquels catégorisaient en arborescence une série limitée de sites et pages choisies par des opérateurs humains). Ce mot-clé, longtemps utilisé seul, est de l’ordre de la formule incantatoire : écrivez « voyage » et vous trouverez les destinations et les prix et les conditions et les descriptions de vos destinations y compris celles non-choisies ; écrivez « voyage » et vous voyagerez. Nous ne donnons qu’un seul mot, qu’une seule clé, et nous attendons de recevoir un monde ordonné, accessible et surtout un monde soit « pertinent » (c’est à dire depuis le début aussi conforme que possible à notre propre désir), soit « populaire » (c’est à dire aussi conforme que possible au désir des autres, ce que René Girard appelle le désir mimétique). Un seul mot et en face, l’immensité ordonnée de pages choisies et triées dans l’économie libidinale où nous sommes passés du statut de déclamant à celui de simple variable statistique dans une chaîne de production qui ne vise que son propre maintient.

Puis de plus en plus, à la place des mots (clés), nous avons fait des phrases. Nous sommes partis à la conquête du langage naturel. Nous avons donc discouru avec des machines, avec des algorithmes. Qui en retour de notre déclamation naturelle, se mirent à nous répondre non plus sous forme de liste de sites, mais d’extraits choisis et signifiants.

Et puis lassés de leur écrire autant que par la simple possibilité offerte de le faire, nous leur avons parlé. Les interfaces vocales se sont proposées, souvent imposées. De cette vocalisation nouvelle sont nées en retour d’autres échos sonores : ceux des machines et de algorithmes nous répondant, prenant voix. Siri, Alexa, et les autres. World Wide Voice.

Il y a l’initiative de la parole, de la requête, de la question. Et l’espace de la réponse. Car durant tout ce temps, de nos premiers mots-clés balbutiés à nos dernières commandes vocales prononcées, s’est structuré un espace matériel du recueil de nos expressions, une géographie politique de nos espaces de parole, de nos espaces discursifs, singuliers et partagés.

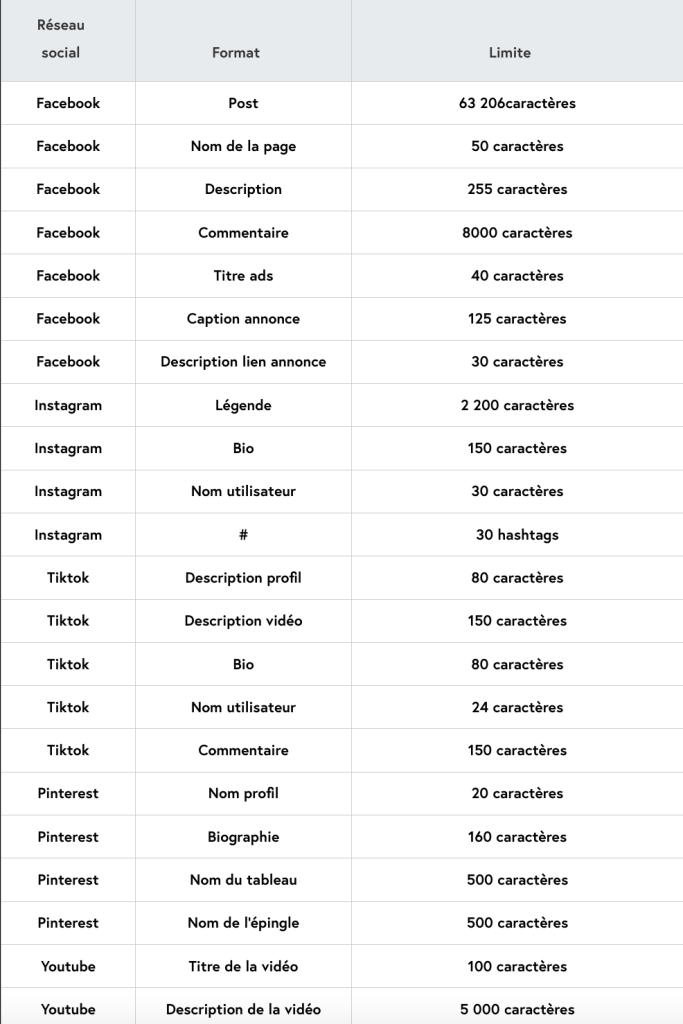

Le passage du web aux plateformes, aux « jardins fermés » comme les appelle Tim Berners-Lee, ne fut pas simplement le passage d’un espace public à des espaces semi-privés. Il fut aussi celui où ces plateformes délimitèrent en nombre l’espace de nos énonciations possibles. On décrit souvent le numérique comme un espace de publication illimité, ce que fut et que demeure le web en effet, mais les plateformes, toutes les plateformes, ont installé des espaces discursifs bornés, limités, frustrants, dont rien ne peut ni ne doit dépasser tels de modernes Procuste, ce bandit qui dans la mythologie proposait aux gens de les héberger avant que de leur couper les membres qui dépassaient de son lit.

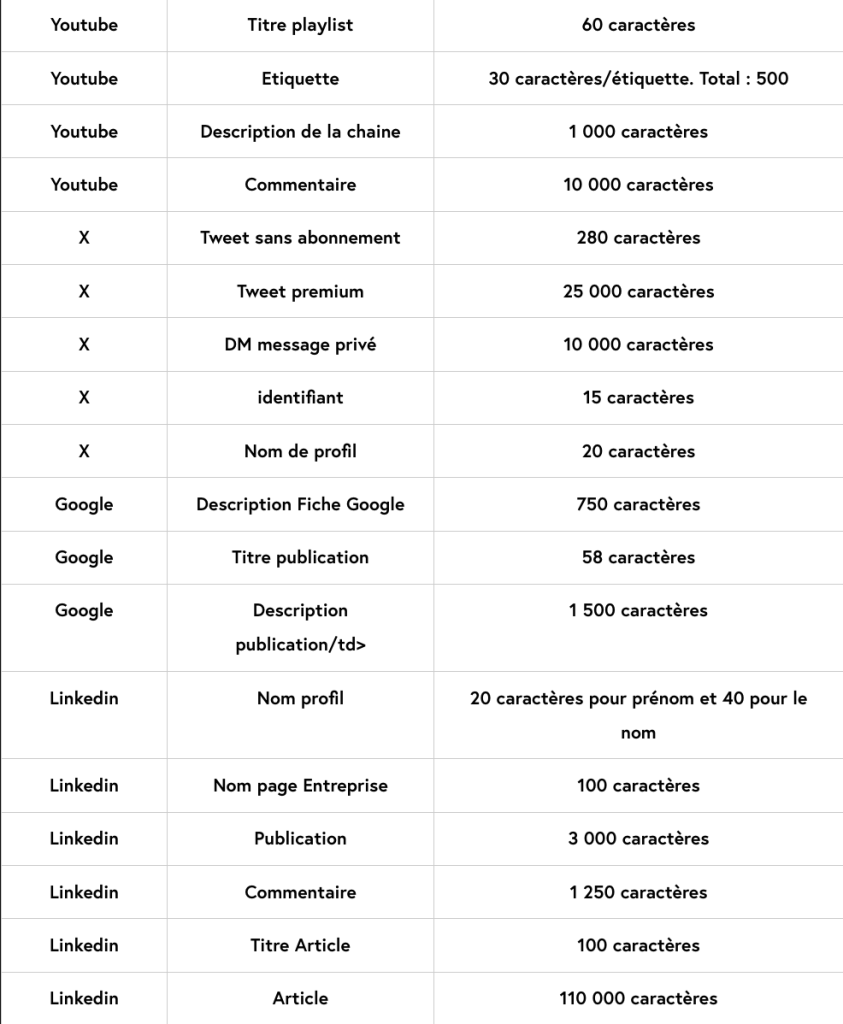

Procuste dans l’histoire des plateformes c’est 140 signes sur Twitter puis 280 sur X, 2200 signes sur Instagram, 3000 pour LinkedIn, 150 signes pour une vidéo TikTok et 5000 signes pour décrire une vidéo Youtube. Malgré l’extension du domaine de la statusphère, Et tout le reste de ces espaces tant limités que limitrophes d’une atrophie des possibles.

(source : Dailyfy.co)

Comme le montre ce tableau, chaque espace est catégorisé par sa nature « titre de publication », « nom de la page », « description », « commentaire », « description vidéo », « bio », « DM message privé », etc. Et à chaque catégorie un autre espace, une autre limite : 58 caractères pour un titre de publication, 80 caractères pour une bio Tiktok, 30 pour un nom de profil Instagram, 1250 pour un commentaire LinkedIn, et ainsi de suite. Tout est métrique. A coups de trique. Quelques grands espaces demeurent : 110 000 caractères l’article LinkedIn mais 3000 caractères la « publication » de la même plateforme ; 63206 caractères le le post Facebook mais 8000 seulement pour le commentaire. Le numérique des plateformes est tout sauf l’espace infini qui était celui de la publication web des années 2000, c’est un espace totalement sous contrainte et en permanence sous astreinte.

Aujourd’hui l’essentiel de nos espaces discursifs en ligne qui ont recours au langage indépendamment de l’image ou de la vidéo sont des espaces Procustéens (images et vidéos par ailleurs elles-mêmes soumises à des limitations de durée). Des espaces où l’énonciation, où l’accès à la capacité de dire, ne vaut que par l’acceptation de cet horizon court de la diction. Certes il est possible, et certains y parviennent, de sublimer ces limites en les esthétisant ou en les poétisant. Les formes courtes ont par ailleurs une existence culturelle et littéraire longue. Mais nous parlons ici des conditions de production de la langue et donc du réel à l’échelle d’une humanité toute entière, en tout cas de sa part connectée (près de 5,5 milliards d’êtres humains). La « merdification » (enshittification) des plateformes, de presque toutes les énonciations qui s’y déploient aujourd’hui, est aussi liée à cela. Ces espaces ne nous offrent pas tant la possibilité de dire qu’ils ne nous imposent la nécessité de rapidement nous taire. Il est d’ailleurs singulier de voir les plateformes parler de « liberté d’expression » dans des espaces aussi bornés et limités que ceux qu’elles nous offrent. Parlerait-on d’une « liberté de circulation » si celle-ci se limitait à un déplacement entre notre chambre et nos toilettes ?

D’un côté donc, il y eut, à l’échelle des plateformes numériques, la multiplication des espaces d’expression possibles. Mais en parallèle chaque nouvel espace énonciatif est apparu comme permettant de cadrer et de limiter « en nombre » toute expression singulière en ligne. Et désormais il y a la contamination de l’ensemble de ces espaces par des tiers énonciatifs logorrhéiques dopés à l’IA et aux artefacts génératifs. Voilà pour la parole « en émission ».

Quand à la parole « en réception », nous sommes aujourd’hui de plus en plus confrontés et exposés à ces dispositifs techno-logorrhéiques à proportion inverse de nos propres capacités à nourrir et à alimenter ces espaces expressifs et énonciatifs. Pour le dire plus trivialement : la part des bots et des contenus artificiellement générés explose et contamine l’ensemble des espaces numériques de l’ensemble des plateformes (c’est l’un des thèmes de mon livre « Les IA à l’assaut du cyberespace : vers un web synthétique » paru l’été dernier chez C&F Editions).

A l’échelle du numérique, si l’humanité se figeait à ce moment précis, et si nous l’observions à l’échelle macroscopique, nous serions alors forcés de constater que l’initiative de la parole, de la conversation, de la langue comme interaction et comme compréhension, que cette initiative revient davantage aux machines qu’à nous-mêmes. Et que notre réel s’y consomme d’abord, puis s’y épuise et s’y consume. Je le redis, chaque nouvelle simulation enlève au réel. Quand Trump annonce vouloir transformer Gaza en Riviera, des milliers d’images et de vidéos « génératives » viennent instantanément illustrer, montrer, filmer, documenter cet impossible, ce délire macabre autant que cynique. Ce qui était et aurait du rester impossible, y compris à formuler, devient sous le poids des générations illustratives un embranchement possible du futur qui nous est proposé comme instantanément disponible pour nos sens et nos imaginaires. C’est en cela qu’il enlève au réel, au seul réel possible qui est celui d’un arrêt des massacres en cours. Il ne s’agit pas uniquement d’élargir la fenêtre d’Overton mais bien de bâtir autour d’elle l’ensemble la totalité de la barre d’immeuble où elle ne sera plus qu’une fenêtre parmi d’autres, de faire exister la réalité qu’elle inaugure pour laisser au réel encore moins de chance de pouvoir la limiter ou la contraindre rapidement. C’est aussi cela que Trump a sinon compris, du moins intuitivement senti, et qui le fait tant à l’aise dans ces médias sociaux où prime l’expression courte et bouffonne : la parole politique, sa parole politique, se suffit au lit de Procuste tant que l’image y tient les dimensions voulues. Gaza en Riviera. Voilà ce qui seul doit tenir. Le reste s’abîme, s’épuise et s’effondre derrière ces dispositifs techno[-logo]rrhéiques pensés pour l’emballement viral et dont les IA et autres artefacts génératifs ne sont que la dernière – mais non ultime – instance contemporaine.

Les 3 chambres.

Depuis longtemps dans l’analyse des médias on utilise le concept de « chambre d’écho » pour désigner de manière métaphorique, le fait que « l’information, les idées, ou les croyances sont amplifiées ou renforcées par la communication et la répétition dans un système défini. »

Avec l’arrivée des médias sociaux, se fait jour chez Eli Pariser le concept de « bulle(s) de filtre« , cette idée que les algorithmes des moteurs de recherche comme des grands médias sociaux tendent à nous enfermer dans nos propres croyances et convictions.

Aujourd’hui, avec l’essor et la place que prennent les différents artefacts génératifs à l’identique de ChatGPT, des chercheurs (Jacob, Kerrigan, Bastos 2025) parlent d’un « Chat-Chamber effect ». Rien à voir avec les matous qui ont conquis l’internet, le « chat » doit être lu et compris comme le « Tchat », et caractérise l’un des biais de nos échanges conversationnels avec des artefacts génératifs, lequel biais désigne les informations incorrectes mais allant dans le sens du questionnement de l’utilisateur que les grands modèles de langage peuvent fournir ; des résultats et informations qui restent non contrôlées et non vérifiées par les mêmes utilisateurs mais auxquels ces mêmes utilisateurs font pourtant confiance. Le titre complet de leur article est ainsi : « L’effet ‘Chat-Chamber’ : faire confiance aux hallucinations de l’IA« .

Derrière ces 3 déclinaisons d’une même tendance à trois époques contemporaines successives, se jouent deux choses. D’abord des dynamiques médiatiques qui s’interpénètrent pour forger, favoriser et figer une certaine logique ou esthétique de réception des discours qui s’y tiennent. Ensuite une affordance informationnelle première qui est l’inverse du doute raisonnable : ces systèmes médiatiques ont pour affordance première leur capacité à nous faire croire qu’ils disent le vrai : les logiques virales de partage (« si c’est tant partagé c’est bien que ça doit être vrai« ), le dispositif de proximité (illusoire) avec l’énonciateur (« si c’est lui qui le dit alors cela doit être vrai« ), le biais de disponibilité (des informations délibérément erronées ou mensongères sont plus immédiatement accessibles et rendus visibles que d’autres plus sourcées) ne sont que quelques-uns des leviers de cette affordance de vérité supposée.

Depuis plus de 20 ans j’explique et documente le fait que les algorithmes sont des éditorialistes comme les autres, mais qui avancent essentiellement masqués et que les IA et autres artefacts génératifs installent dans une sorte de théâtre total, « gestes, sons, paroles, feus, cris« , dont plus personne n’est en capacité de comprendre les codes.

A.M.I. : Assemblage Machinique Informationnel.

L’arrivée des artefacts génératifs ajoute une dimension nouvelle et passablement problématique au tableau contemporain de la fabrication de nos croyances et adhésions. Jusqu’ici, moteurs de recherche et réseaux sociaux jouaient sur le levier déjà immensément puissant de leurs arbitraires d’indexation et de publication (le fait de choisir ce qu’ils allaient indexer et/ou publier) ainsi que sur celui, tout aussi puissant, de la hiérarchisation et de la circulation (viralisation) de ce qui pouvait être vu et donc en creux de ce qu’ils estimaient devoir l’être moins ou pas du tout.

Choisir quoi mettre à la « Une » et définir l’agenda médiatique selon le vieux précepte de « l’agenda setting » qui dit que les médias ne nous disent pas ce qu’il faut penser mais ce à quoi il faut penser. Ce principe premier de l’éditorialisation se double, avec les artefacts génératifs conversationnels à vocation de recherche, d’une capacité à produire des sortes d’assemblages machiniques informationnels, c’est à dire des contenus uniquement déterminés par ce que nous interprétons comme un « devenir machine** » en capacité de « phraser » les immenses bases de données textuelles sur lesquelles il repose. Des machines à communiquer mais en aucun cas, comme le souligne aussi Arthur Perret, en aucun cas des machines à informer.

** [ce « devenir-machine » est à lire dans le sens du « devenir-animal » chez Deleuze et Guattari : « le “devenir-animal” ne consiste pas à “imiter l’animal, mais d’entrer dans des rapports de composition, d’affect et d’intensité sensible” ».]

Ce concept d’assemblage machinique informationnel me semble intéressant à penser en miroir ou en leurre des agencements collectifs d’énonciation théorisés par Félix Guattari. D’abord parce qu’un assemblage n’est pas un agencement. Il n’en a justement pas l’agentivité. Il n’est mû par aucune intentionnalité, par aucun désir combinatoire, calculatoire, informationnel, communicationnel ou social. Ensuite parce que la dimension machinique est antithétique de la dimension collective, elle en est la matière noire : ChatGPT (et les autres artefacts génératifs) n’est rien sans la base de connaissance sur laquelle il repose et les immenses réservoirs de textes, d’images et de contenus divers qui ont été, pour le coup, assemblés, et sont l’oeuvre de singularités fondues dans un collectif qui n’a jamais été mobilisé ou sollicité en tant que tel. Enfin, l’information est ici un degré zéro de l’énonciation. L’énonciation c’est précisément ce qui va donner un corps social à ce qui étymologiquement, a donc déjà été « mis en forme » (in-formare) et se trouve prêt à être transmis, à trouver résonance. ChatGPT est l’ombre, le simulacre, le leurre d’une énonciation. Et cette duperie est aussi sa plus grande victoire.

La question du langage s’est déplacée. Un grand déplacement. Quelque chose qui n’est plus aligné entre le territoire du monde et la langue qui en est la carte.

Apostille(s).

Pendant que nos réels sont saturés et épuisés d’IA, en Israël, un spot de publicité pour une entreprise d’armement utilise pour la première fois des images réelles d’une attaque de drone à Gaza. C’est à la fois la plus cynique et la plus perverse des formes de publicitarisation. Pendant ce temps Youtube dévoile un système baptisé « Peak Points » qui utilise son IA « Gemini » pour insérer des publicités aux moments où l’attention des spectateurs est supposément la plus forte grâce à l’exploitation de données « émotionnelles » (ou qui sont en tout cas supposées rendre compte de notre état émotionnel).

Couplez maintenant ces deux informations et déterminez sans algorithme votre propre état émotionnel …

De manière plus anecdotique, on constate un jaunissement par contamination de nombreuses images générées artificiellement. Les animaux étaient malades de la peste, les IA le sont déjà de consanguinité. Pendant ce temps encore, Youtube fait des retouches de vidéos sans en avertir les créateurs, pour « rapprocher esthétiquement le rendu des vidéos de ce que l’IA générative peut proposer. » Standardiser la consanguinité des contenus générés.

Pendant ce temps, des images pédocriminelles générées par IA sèment autant le trouble que le doute et entravent les démarches déjà si complexes du travail de police et de justice. La volumétrie des faux-positifs est ici la première alliée des pédocriminels. Et une nouvelle fois la charge de la preuve s’inverse comme si souvent dans l’histoire du numérique : il ne s’agit plus de pouvoir détecter la marginalité de faux-positifs sur un volume de contenus donnés, il s’agit de la maximiser pour que les résultats « sincères » soient marginalisés.