28.08.2019 à 09:24

Regards sur Thinkerview

signauxfaiblesco

Texte intégral (9655 mots)

Nb : Cet article a été publié en 2019. Il ne tient pas compte des éventuelles évolutions de Thinkerview post-2019.

***

C’est l’une des vidéos du moment, de celles dont on se passe le mot, qui récolte éloges et superlatifs sur les réseaux sociaux. « Alstom : la France vendue à la découpe ? » : depuis sa mise en ligne début juillet, cette interview de Frédéric Pierucci, ex-cadre d’Alstom, a dépassé les 700 000 vues, une prouesse pour une interview géopolitique de plus de 2 heures.

Son succès – qui continuera certainement de grandir ces prochaines semaines – tient bien sûr en large partie à son sujet. L’affaire de la vente d’Alstom à l’américain General Electric (qui avait déjà été relatée bien avant cette vidéo, et fait l’objet d’un documentaire) a tout du thriller fascinant, mêlant espionnage, affaire d’Etat, intelligence économique…tout en abordant des sujets capitaux (souveraineté, Europe, relation avec les Etats-Unis, etc.).

Mais il y a autre chose. Le succès de cet entretien est directement lié, aussi, au média qui en est à l’origine : Thinkerview.

Thinkerview n’est pas une nouveauté dans le paysage des nouveaux médias en ligne. Lancée en 2013, cette chaîne YouTube, qui s’est fait une spécialité de diffuser de longs entretiens (1h30, parfois même 2h) en direct, puis en streaming, de personnalités aux points de vue souvent « alternatifs » sur des sujets variés (géopolitique, numérique, écologie, finance, journalisme…), a cependant mis plusieurs années avant de percer au-delà de son cercle d’habitués.

Depuis l’an dernier, et surtout depuis ces derniers mois, la chaîne décolle : de 150 000 abonnés sur Youtube en juin 2018, elle passe à 200 000 en octobre puis double ce chiffre en neuf mois avec 400 000 abonnés en juillet 2019. A titre de comparaison, Cash Investigation en est à 270 000, C à vous 300 000, Quotidien 400 000, On n’est pas couché 500 000. Thinkerview devrait dépasser la barre des 500 000 d’ici cet automne.

Depuis janvier 2019, les chiffres indiquent entre 2 et 3 millions de vidéos vues par mois.

La popularité de Thinkerview, encore limitée il y a quelques temps, ne peut plus être considérée comme anecdotique, ni comme un feu de paille comme Internet a l’habitude d’en produire.

Alain Juillet, ancien directeur du renseignement à la DGSE, interviewé par la chaîne l’an dernier, raconte ainsi avoir « découvert un monde à l’impact effarant. J’avais déjà fait des passages télé, mais jamais connu ça. Des gens m’arrêtent depuis dans la rue parce qu’ils m’ont vu sur ThinkerView. »

Tout indique que la chaîne est partie pour s’installer durablement et, plus encore, qu’elle continuera à gagner en importance au fil du temps.

Thinkerview suscite pourtant un certain nombre d’agacements et de critiques, qui tiennent en large partie à son intervieweur. Celui qui se fait appeler Sky et qui tient à rester anonyme (même si quelques recherches suffisent à retrouver nom, mail personnel, etc.) fait grincer quelques dents : sa façon tantôt nonchalante tantôt agressive de mener ses entretiens, son prisme complotiste ou son choix d’accueillir certaines personnalités controversées sont des critiques récurrentes à son égard, pas dénuées de vérité.

Mais plutôt qu’un simple questionnement binaire « pour ou contre Thinkerview » (à l’évidence, il y a du bon et du moins bon, et rejeter le tout serait passer à côté de certains entretiens passionnants, comme, outre celui sur Alstom, celui de l’économiste Gaël Giraud sur l’écologie), il est plus important de se demander pourquoi la chaîne prospère autant. En la matière, le plus simple est d’abord d’écouter ceux qui la suivent :

…ainsi que ceux qui y sont invités :

Si Thinkerview est populaire, c’est parce que la chaîne répond à un besoin – celui exprimé ci-dessus.

Comprendre le succès de Thinkerview implique de comprendre ce besoin initial. Il y avait plusieurs manières d’y répondre. Thinkerview en a proposé une ; force est de reconnaître qu’il l’a très bien exécuté, que l’on partage ou non les opinions qui y sont véhiculées.

Le manque initial est bien sûr loin d’être comblé par cette seule chaîne, ce qui signifie qu’il y a de place pour d’autres initiatives, avec leur propre ton, leur propre style, leur propre ligne éditoriale…Tenter de répliquer le modèle de Thinkerview tel quel n’aurait pas grand sens, mais chercher à répondre (différemment) au même besoin garde toute sa pertinence.

Un média atypique…et pourtant typique de l’ère numérique

Le succès de Thinkerview est intéressant parce qu’il vient affronter directement la représentation commune d’un « média Internet » aujourd’hui. A l’ère des vidéos courtes façon Brut et Konbini, de la course à l’audience d’un Melty, et de la « production de contenus » orientée « junk news (pratiquée par toujours plus de magazines en ligne), nous voici en présence d’un média gratuit qui a fait le choix du très long format, dédié à l’analyse, sur des sujets parfois arides…et qui cartonne.

Diantre ! Nous aurait-on menti ? Le web ne serait donc pas forcément synonyme de buzz, formats courts, instantanéité ? Les sujets de fond, la réflexion, le temps long ne serait donc pas la chasse gardée des médias traditionnels (et/ou payants) ? Thinkerview force à revoir certaines représentations parfois solidement ancrées. Oui, les internautes – ou du moins certains – sont bel et bien capables de rester attentifs, et même captivés, sur un même contenu pendant 1h, 2h, et même plus… :

Bien qu’en décalage avec l’idée que l’on se fait généralement d’un média gratuit sur Internet, Thinkerview correspond en réalité parfaitement à l’ère numérique :

1 – Il se nourrit de la défiance vis-à-vis des médias et plus généralement des institutions – conjuguée à un intérêt porté à l’actualité qui ne faiblit pas – en donnant la parole, via à des outils numériques classiques (YouTube, Facebook, Twitter…) et moins classiques (PeerTube, Mastodon), à des personnalités souvent critiques et peu entendues dans le paysage médiatique traditionnel. Ce faisant, il propose un discours alternatif, qui plait.

Il est donc le produit de ce contexte particulier, cette société de la défiance qui est encore plus forte en France qu’ailleurs, le numérique étant ici un levier.

A cet égard, notons que l’une des propositions de valeur phares de la chaîne réside dans l’absence de tout montage post-interviews : après leur diffusion en direct, les vidéos ne sont pas coupées lorsqu’elles deviennent ensuite accessibles en streaming. Cette transparence, qui empêche toute manipulation, s’inscrit entièrement dans le besoin issu de la société de défiance.

2 – Il s’appuie sur le désir, puissant, d’entendre des idées non-politiquement correctes, parfois dérangeantes, par opposition aux idées jugées trop convenues, plates, répétitives, de nombreuses émissions habituelles abordant des sujets de fond.

Le numérique est ici exploité comme terrain d’expression et de création libre (via le format vidéo) – à l’instar de la vague des blogs dans les années 2005-2010 (format écrit) et de la progression plus récente des podcasts (format audio) – pour combler un manque insuffisamment adressé par les émissions habituelles, qui s’essoufflent.

En la matière, l’arrêt de l’émission « Ce soir (ou jamais !) » sur France TV en 2016 a marqué une nouvelle étape, étant considérée comme la dernière à proposer des débats de fond, en direct, où des invités aux idées parfois non-conventionnelles disposaient d’un temps rare à la télévision pour s’exprimer. Notons d’ailleurs que « Ce soir (ou jamais !) » recevait des critiques similaires à celles reçues par Thinkerview aujourd’hui (invités jugés trop « limites » ou extrêmes, propos parfois trop peu recadrés, etc.). Le fait que Frédéric Taddeï, l’animateur de l’émission, n’ait trouvé aucun autre point de chute que la controversée chaîne russe RT pour proposer une émission dans le même esprit n’est d’ailleurs pas anodin.

3 – Plus qu’un média réalisant des vidéos en ligne, Thinkerview est une communauté de milliers d’internautes, fidèles à la chaîne, et pour une partie d’entre eux soutiens actifs. C’est avant tout en cela, et non simplement par son usage intelligent des outils numériques, qu’il s’agit d’un média typique de l’ère numérique, et ainsi qu’il préfigure un certain avenir des médias.

Thinkerview est le média typique de « L’Age de la Multitude », du nom de l’ouvrage passionnant de Nicolas Colin et d’Henri Verdier publié en 2012 qui développe l’idée que le fait majeur de la révolution numérique, bien au-delà de la simple technologie, est la libération d’un potentiel nouveau, celui de la « multitude » d’internautes, à considérer comme un actif d’une puissance inédite. Dès lors, l’enjeu stratégique est de parvenir à susciter et exploiter le potentiel de cette multitude (ce qui amène les auteurs à parler du concept de « sur-traitance »).

Thinkerview est loin d’être le premier média à avoir tenté d’exploiter cette multitude. La vague des « médias participatifs » dans les années 2005-2010 (LePost, Agoravox, Rue89) suivait ce chemin. Mais le modèle s’est essoufflé au bout de quelques années et cette vague s’est éteinte au début des années 2010.

Là où les sites comme LePost et Agoravox faisaient produire du contenu aux internautes, Thinkerview garde la main sur le contenu et bénéficie autrement de la multitude qui l’entoure.

L’actif principal et différenciant de Thinkerview : sa communauté

La communauté entourant Thinkerview entre bien dans le paradigme présenté par N. Colin et H. Verdier. Concrètement, elle se manifeste par :

* Des actions simples et spontanées de communication sur les réseaux sociaux (et via du bouche-à-oreille classique) pour partager les vidéos et recommander la chaîne, permettant ainsi de la faire connaître à toujours plus de nouvelles personnes.

* Du fact-checking collaboratif en direct, via la plateforme CaptainFact, pour vérifier pendant les interviews que les invités appuient leurs propos sur des faits réels.

* De l’aide apportée à l’animateur pour proposer et parfois contacter des invités potentiels. La force de la communauté est ici celle du réseau personnel de chacun de ses membres.

Et de fait, cela fonctionne. La chaîne est aujourd’hui capable de faire venir des invités de marque. Elle n’est plus réduite à un panel restreint d’invités boudés par les grands médias et en recherche de lumière. Edgar Morin, Jean-Luc Mélenchon, Elise Lucet, Lilian Thuram, Arnaud Montebourg, Mounir Mahjoubi (lorsqu’il était au gouvernement) ou encore Yanis Varoufakis se sont ainsi pliés aux règles du jeu de la chaîne.

* Un soutien financier, qui permet à la chaîne de récolter plus de 20 000 euros par mois de la part de 2631 internautes (soit une moyenne de 7.6 euros mensuel par contributeur). Ce montant, qui ne fait qu’augmenter (il était de 17 000 euros il y a trois mois), permet depuis peu de rémunérer l’animateur (environ 2200 euros par mois, indique-t-il) et l’équipe technique, et de rendre le média rentable (« on a besoin de 14 700 euros pour ne pas être dans le rouge »).

Les dons sont apportés via la plateforme Tipeee, d’où le terme « tipper » :

Un cas d’école en marketing

La construction de cette communauté très engagée rejoint les analyses du « gourou du marketing » Seth Godin, que l’on peut appliquer ici à l’univers médiatique.

Celui-ci considère (comme déjà écrit dans un précédent article) que « cela n’a plus de sens de vouloir plaire à tout le monde. Plus aucun produit ou service ne peut avoir cette ambition. Les marques doivent concentrer leurs efforts sur un petit nombre de clients, et susciter leur engagement. Et pour cela, elles ne doivent plus hésiter à être avant-gardistes, à prendre des risques, à oser les extrêmes ».

Thinkerview n’a pas été construit comme un business mais ce propos reste applicable. La chaîne gagne de l’argent grâce à ceux qui la « consomment » et suscite leur engagement grâce une marque forte : valeurs non consensuelles (défiance vis-à-vis de l’Etat, des médias, culture de la remise en question…), mise en avant de personnalités et idées en marge (parfois controversées), forme de théâtralité avec son fond noir et son générique hypnotisant, récurrence de la même question d’introduction (« bonjour, nous vous recevons pour une chaine Youtube qui s’appelle Thinkerview, pouvez-vous vous présenter su-ccin-te-ment » qui relève d’ailleurs plus de l’injonction que de la demande), tous ces éléments créant une adhésion très nette chez certains et des rejets marqués chez d’autres.

Seth Godin considère d’ailleurs que « la plupart des marketeurs ne prennent pas la peine de mesurer ce qui compte vraiment: la confiance; les attentes; être manqué lorsqu’on s’absente. » Là encore, l’analyse peut s’appliquer à Thinkerview. Chaque nouvelle émission, annoncée peu avant, constitue ainsi un petit événement pour les suiveurs assidus :

Combien d’émissions peuvent-elles en dire autant ? Combien suscitent-elles une adhésion telle que certains spectateurs non-rassasiés cherchent à savoir s’il existe des équivalents hors de France ?

Thinkerview valide ainsi la théorie des « 1000 vrais fans » de l’auteur américain Kevin Kelly : pour vivre en tant que créateur indépendant, il n’est pas nécessaire d’avoir des millions de suiveurs mais de pouvoir compter sur 1 000 fans capables de s’engager fortement, en particulier en mettant la main au portefeuille. Dès lors, plutôt que de chercher à créer le consensus pour intéresser le plus grand nombre, mieux vaut essayer de d’abord de plaire fortement à un nombre limité d’individus, sans s’inquiéter de déplaire à beaucoup d’autres. Le mot se répandra ensuite, conduisant naturellement à croître. « Vouloir parler à tout le monde revient à ne parler à personne » tranche Seth Godin, pour qui chercher à plaire à tous conduit à « faire des choses moyennes pour des gens moyens ».

Un aperçu du futur des médias

Comme l’explique Nicolas Colin, au XXe siècle l’industrie des médias s’est convertie, comme les autres industries, au paradigme dominant de la production de masse. « La télévision, la radio et la presse écrite se sont massifiées. Tous ces secteurs se sont concentrés autour d’un oligopole de quelques acteurs dominants. »

Cette massification des médias s’est produite par nécessité, pour absorber le coût élevé de la distribution. « Être un média au XXe siècle, ça voulait dire acheter ou louer des fréquences hertziennes ou immobiliser une énorme infrastructure logistique pour l’impression et la distribution de journaux et magazines.

Pour couvrir ce coût fixe élevé de la distribution, il fallait avoir une audience massive. Et comment fait-on ça ? En étant le plus consensuel possible. Pas de place pour l’outrance et la polarisation quand l’objectif est d’être regardé, écouté ou lu par la masse. »

Internet est venu percuter cette donne de plein fouet, en faisant chuter le coût de distribution des contenus. Les barrières à l’entrée se sont effondrées, ouvrant la voie à l’éclosion possible de multiples nouveaux médias n’ayant plus besoin d’être consensuels, pouvant s’adresser à des niches et pouvant être créés par des non-professionnels.

Dès lors, les médias traditionnels se sont retrouvés affaiblis sur leurs deux principales missions, comme l’explique l’Institut Montaigne dans une étude récente : d’une part, sur leur capacité à agir en « gardiens de l’information » (le fait qu’un nombre limité de professionnels informent la majorité des citoyens et décident des informations à présenter), d’autre part, sur leur capacité à organiser le débat public (décider des sujets à débattre).

Le nouveau paradigme qui s’est ouvert rebat (en partie) les cartes. Nicolas Colin met en avant trois traits communs aux médias de demain :

- Des formats

innovants qui exploitent les avantages permis par Internet. C’est le cas de

Thinkerview qui se permet de « casser » la contrainte d’une durée

d’interviews resserrée et minutée, diffuse ses interviews sur plusieurs canaux,

se sert largement de la force des réseaux sociaux, utilise un outil innovant

pour le fact-checking collaboratif en direct, etc. - « Une relation directe et privilégiée avec une

communauté engagée ». C’est

là aussi le cas de Thinkerview : l’animateur interagit lui-même avec

sa communauté (relation directe) ; cette communauté peut notamment poser

des questions en direct aux invités, agissant ainsi sur le

contenu (relation privilégiée), et est bel et bien engagée comme expliqué

plus haut (soutien financier et non-financier). - « Une ligne éditoriale subjective, clivante et

sans concession. Le journalisme

consensuel et “objectif” du XXe siècle était le produit d’une nécessité : le

coût élevé de la distribution. Il est aujourd’hui devenu ennuyeux et non-rentable ».

Même si Thinkerview se revendique « apolitique » (comprendre : ne prend pas

position pour tel ou tel parti), la chaîne s’empare de sujets éminemment

politiques, et est bel et bien clivante dans ses choix d’invités, d’angles, de

questions. Pour Nicolas Colin, « nous assistons à une révolution

copernicienne. L’avenir de l’industrie des médias réside dans la couverture

subjective et la polarisation idéologique – comme c’était le cas au XIXe

siècle, juste avant l’avènement des médias de masse. »

On voit donc ici pourquoi Thinkerview préfigure l’avenir des médias : il

constitue l’archétype d’un des modèles appelés à se développer à l’avenir.

L’idée n’est pas de dire que ce modèle est l’unique voie à suivre. En France, les quelques réussites de nouveaux médias, qu’ils soient numériques comme Contexte (spécialisé dans les politiques publiques) ou papiers comme Le 1, montrent par exemple qu’il est possible de trouver un lectorat prêt à payer sans pour autant devoir polariser idéologiquement – à condition d’avoir une proposition de valeur claire et différenciante…et de ne pas négliger les formats innovants (cf la grande feuille dépliable du 1, ou les innovations web de Contexte).

Mais plusieurs signes indiquent tout de même que le secteur se dirige dans la direction de ci-dessus. Il n’est pas anodin, par exemple, que depuis l’élection de Trump le Washington Post se soit doté pour la première fois de son histoire d’une devise engagée et percutante (« Democracy dies in darkness »). Tout comme la forte hausse des abonnements au New York Times suite à cette même élection souligne en creux qu’un de ses atouts clefs réside bien dans sa ligne éditoriale subjective et clivante (…pour un pays comme les Etats-Unis). Dans le cas français, on peut penser à l’évolution d’un journal comme Le Monde sur les questions écologiques, qui est, là aussi, significative : en l’espace d’un an, son ton s’est fait nettement plus engagé, notamment via ses choix de Une et de sujets. Sans parler, bien sûr, des médias numériques clivants dont Mediapart est la tête de proue mais n’est pas le seul (Reporterre engagé sur les enjeux écologiques, Next INpact sur les enjeux politiques et juridiques du numérique, etc.).

De même, la renaissance du Washington Post n’est pas étranger à l’accent qu’il met sur les formats innovants, à commencer par la newsletter (format redevenu très à la mode) – dont il en publie près de 60, en s’appuyant sur une équipe à temps plein de 14 salariés – mais aussi, au-delà, avec la multitude d’initiatives conçues par des centaines d’ingénieurs, aussi bien sur l’aspect éditorial que publicitaire. Sans parler de sa stratégie d’ « hyperdistribution » des contenus bien adaptée au monde numérique. Autant d’innovations qui ne remplacent évidemment pas la qualité du contenu mais qui permettent d’exploiter au mieux le tournant numérique plutôt que le subir. Sur le plan éditorial, l’exemple de la relance récente du format des blogs (qui était tombé en désuétude) par le site du journal Le Temps est lui aussi intéressant : ces blogs – présélectionnés et bénéficiant ensuite d’une grande visibilité – sont en effet appelés à couvrir des « thématiques de niches, peu traitées par les médias généralistes alors qu’elles intéressent pourtant un grand nombre de lecteurs ».

Enfin, s’agissant de la construction d’une « relation directe et privilégiée avec une communauté engagée », les grands titres de presse ont été nombreux à lancer des initiatives en ce sens ces dernières années, notamment autour de la notion de « club ». Entre autres exemples, pensons au membership program du Guardian, qui propose notamment l’accès à des débats avec des « plumes » du quotidien, ou encore, dans le cas d’un nouveau média comme Contexte, aux rencontres privées régulières avec des décideurs clefs. Néanmoins en la matière, la marge de manœuvre est probablement encore importante ; l’engagement des communautés reste par exemple peu développé. Beaucoup reste encore à faire, même si cela doit parfois passer par une diversification au-delà du journalisme. Ainsi, l’exemple des événements extrêmement divers (mais en cohérence avec la ligne éditoriale) organisés avec succès par Le Temps témoigne du champ des possibles : visite d’un laboratoire de parfumerie suite à un dossier paru dans le journal, soirée zéro déchet, cours de philosophie pour enfants…Le journal rappelle que « depuis le XVIIIe siècle, la presse a toujours joué un rôle d’animateur de la vie sociale » – une proposition de valeur qui semble avoir plus-que-jamais du sens à l’ère du numérique et de la recherche de lien social.

En pratique, ces initiatives s’appuient toutefois en large partie sur l’existence d’une marque déjà forte. La donne risque donc d’être différente pour les titres moins prestigieux, pris en étau entre les grandes marques historiques et les nouveaux médias de l’ère numérique. Pour eux, le besoin de se réinventer fortement, de se transformer radicalement, risque d’être une question de survie.

Les défis que pose le succès d’un média comme Thinkerview

La popularité d’une chaîne comme Thinkerview n’est pas sans présenter certains risques. Ceux-ci peuvent être reliés, pour une partie d’entre eux, à cette réflexion du blogueur Guillaume Champeau postée récemment sur Twitter :

« Quand il n’y avait pas Internet, tout le monde s’informait avec le 20h de TF1 et/ou quelques journaux, radios et magazines. L’info était biaisée mais on le ressentait peu. Il y avait des référentiels communs de discussion.

C’était une société au mieux de sous-information, au pire de facile manipulation, où discuter d’un sujet entre nous était possible parce qu’on avait tous à peu près les mêmes bases factuelles (biaisées, mais les mêmes). Ce n’est plus le cas. Aujourd’hui, ce qui passe à 15h23 sur BFMTV est contredit à 15h24 sur Facebook, l’édito de RTL de 8h01 est en décalage avec ce qui se dit sur Twitter depuis 7h43, la dépêche AFP de 9h12 est nuancée par un Checknews de 17h35…

On nage dans un océan de points de vue différents, de faits différents, il n’y a plus de référentiel commun dans la réception de l’actualité. Et donc, on n’arrive plus à discuter entre nous. On ne comprend pas le commentaire de celui qui n’a pas les mêmes faits que nous, on s’énerve contre celui qui a un point de vue qu’on ne peut pas admettre sachant ce qu’on sait, croyant ce qu’on croit savoir.

C’est un vrai défi de vie en société. La communication politique reste encore largement ancrée dans les réflexes de quand j’étais petit, de quand l’info était uniforme. On matraque très vite qu’il s’est passé telle chose innommable sans y apporter la moindre nuance, en se disant que ça sera ça l’info, en négligeant que la nuance est déjà là, qu’elle circule, qu’elle circulera, et donc qu’on ne fait que renforcer des colères, là où avant, sans doute, le politique pouvait vouloir mentir ou exagérer pour apaiser, pour contrôler. Ce n’est plus possible.

D’un certain sens, tant mieux. Mais quelle est la bonne réponse à ça ? Comment fait-on société, dans un monde d’information personnalisée ?

Je suis convaincu qu’on n’est qu’aux tous débuts d’une crise planétaire parce qu’Internet, on l’oublie trop souvent, révolutionne la médiatisation comme l’imprimerie l’a fait en son temps. Et qu’il y a, ou y aura, une sorte de convergence des crises, économiques et démocratiques, favorisée par Internet, qui provoque(ra) une envie d’autre chose à tous les niveaux. C’est à la fois inquiétant parce que c’est l’inconnu et passionnant parce que c’est l’inconnu. What a time to be alive. »

Les ilots informationnels et les bulles de pensée ne sont certes pas des nouveautés – comme le dit un internaute, par le passé « celui qui lisait l’Huma n’avait [déjà] pas la même lecture de l’actualité que le lecteur du Figaro » – mais « c’est la vitesse et la capacité à trouver en ligne des clubs d’opinions semblables » qui changent aujourd’hui la donne.

D’ores et déjà, un certain nombre – manifestement croissant – d’internautes semblent privilégier les médias en ligne « alternatifs » comme Thinkerview comme sources d’information quasi-exclusives, considérant qu’ils s’approchent le plus fidèlement d’une « vérité » omise dans les médias traditionnels. Or la pensée véhiculée par ces nouveaux médias est, évidemment, parfois, si ce n’est souvent, aussi biaisée et déformée qu’ailleurs.

Qui-plus-est, la liberté d’expression que les « médias alternatifs » chérissent a parfois des pendants controversés. Citons ici cet extrait d’un article récent des Inrocks : « Thinkerview prend le risque de colporter des contre-vérités. On a récemment reproché à Sky d’avoir laissé un boulevard à l’essayiste d’extrême droite Laurent Obertone ou à l’ancien leader du groupuscule extrémiste noir la “Tribu Ka”, Kemi Seba. “Il a une conception non journalistique de l’interview, critique un participant. Il déroule le tapis rouge, alors qu’à mon sens, couper la parole est une qualité.” »

S’il est assez malhonnête de parler de « boulevard » laissé à Laurent Obertone (il n’y a qu’à lire les commentaires sous son entretien pour s’en rendre compte), il est clair qu’inviter des personnalités avec des idées comme les siennes, nauséabondes, est un choix, certes assumé, mais qui prête le flanc à la critique – cf, entre autres exemples, ce coup de gueule récent du journaliste Olivier Cyran à propos des choix de la chaîne :

Au-delà du débat sur les limites à apporter à la liberté d’expression, chacun se retrouvera en tout cas sur la nécessité d’une (plus grande) éducation à l’esprit critique, et sur la pertinence des médias qui conservent un travail journalistique solide et rigoureux (même si jamais infaillible ni neutre) pour trier, sélectionner, remettre en perspective. A condition – et c’est là que le bât blesse parfois – de ne pas s’enfermer dans une même bulle de pensée (sauf si c’est assumé)…

Pour autant, attention tout de même :

- La parole des grands médias est considérée avec moins de crédulité qu’auparavant, à l’heure où il devient possible d’aller vérifier leurs dires – ou leurs oublis – en un clic, et où leur parole est concurrencée par de multiples autres sources d’information. Plus encore : en cas d’erreur, les faux pas se paient plus cher, précisément parce que la promesse des grands médias historiques est justement de servir de rempart aux fake news et aux manipulations de l’information – promesse en réalité difficilement tenable en permanence. Il y a (pour le moment) plus d’indulgence envers les nouveaux médias sur ces questions car ceux-ci ne se placent pas sur le même créneau, n’ont pas la même proposition de valeur. Dès lors, pour les médias traditionnels, l’honnêteté (dont la capacité à reconnaître ses erreurs, ce qui implique de l’humilité) devient plus cruciale que jamais.

- Les fake news peuvent devenir un piège pour les médias historiques qui courent le risque, en faisant de celles-ci leur combat prioritaire, de s’enfermer dans un rôle de « vérificateurs » – qui s’avère en outre parfois bancal, puisqu’en pratique on constate que certains services de fact-checking ne vérifient pas que des faits mais aussi des opinions, et ouvrent ainsi la voie à des critiques en raison d’une confusion sur leur rôle (Checknews de Libération se définit d’ailleurs aujourd’hui comme un « service de questions/réponses qui amène à faire parfois autre chose que du factchecking »)

- Dès lors, comment se positionner pour les médias historiques ? Outre le besoin évident de contextualisation et d’analyse, il est impératif de ne pas laisser la sérendipité aux seuls nouveaux médias numériques. La sociologue Monique Dagnaud estimait ainsi (il y a dix ans !) qu’« Internet transforme le rapport à l’écrit : nous nous y livrons à ce qu’on appelle «des explorations curieuses». C’est la sérendipité : nous trouvons quelque chose que nous ne cherchions pas au départ, avec un résultat jouissif. Quand vous ouvrez un journal papier, vous savez à quoi vous attendre ; sur Internet, il y a l’exploration curieuse, c’est très important, notamment chez les jeunes. »

Même si cette sérendipité est favorisée par la nature même d’Internet, via les hyperliens (qui ne s’est pas déjà « perdu » sur Wikipédia en passant de liens en liens, à partir d’une seule recherche initiale ?), les médias historiques peuvent tout à fait y mettre également l’accent – et pas seulement dans le choix des sujets, mais aussi dans celui des invités appelés à s’exprimer. Le succès de Thinkerview est ainsi directement lié à son ouverture à des personnalités, et donc des idées, qui ont parfois du mal à se faire un chemin dans les canaux médiatiques classiques (soit parce que ces personnalités n’y sont pas invitées, soit parce qu’elles n’ontpas le temps d’y développer leur propos). Thinkerview est regardée pour ce côté « pas vu / lu / entendu ailleurs » et pour découvrir de nouvelles personnalités ayant le temps de s’exprimer, par opposition à certaines émissions qui invitent simplement…les invités des autres émissions, dans une logique de vase clos, et qui laissent trop rarement le temps de développer des idées. Dans ce contexte, il n’est pas étonnant de voir certaines émissions, notamment politiques, s’essouffler.

- Enfin, puisque l’on associe souvent fake news et réseaux sociaux, les médias traditionnels doivent veiller à ce que leur combat contre les fake news ne se transforme pas en combat contre les réseaux sociaux – fréquemment dépeints de façon négative, en particulier à la télévision. On voit mal, en effet, comment le développement de formats innovants et (surtout) la construction de communautés engagées pourraient se passer totalement de ces réseaux sociaux…

Ce qu’apporte la chaîne

Dans son étude récente sur la polarisation du paysage médiatique français, l’Institut Montaigne écrivait en conclusion que cette « polarisation s’observe sur un axe vertical opposant les institutionnels aux « anti-élites », plutôt que sur une opposition horizontale entre la droite et la gauche » (à l’inverse, par exemple, de l’espace médiatique américain, polarisé sur l’opposition « progressistes » vs conservateurs).

Thinkerview correspond bien à cette analyse puisqu’il se place sur la critique des élites et interroge des personnalités aux idées de gauche (souvent) et de droite (parfois) – il est d’ailleurs parfois dépeint comme pro-extrême gauche, parfois comme pro-extrême droite (affirmation du reste fortement débattue).

Le biais complotiste de certaines questions posées par Thinkerview, et le choix de certains invités, sont un repoussoir pour un certain nombre d’internautes, qui rejettent ce média (…lui-même ne cherchant en rien à les attirer en retour).

L’apport d’un média comme Thinkerview, malgré ses défauts (dont, également, l’intérêt très hétérogène des vidéos), et sans cautionner tous ses choix, est pourtant réel, à au moins deux égards :

1- Pour découvrir des idées (encore) peu entendues ailleurs, et/ou repérer des signaux faibles, puisqu’« étendre son regard, notamment pour repérer des mouvements émergents, implique souvent d’observer les marges » (extrait de l’article « Pourquoi les prédictions sont souvent fausses ») – or Thinkerview s’est fait une spécialité d’interroger ces marges, souvent mieux que des médias grands publics traditionnels. En témoigne ainsi ce commentaire, en réponse à un article de FranceTVInfo sur Thinkerview :

L’ex-cadre d’UBS Stéphanie Gibaud (qui avait dénoncé les pratiques de fraude fiscale du groupe) parle d’ailleurs d’une « chaîne lanceuse d’alerte ».

2- Sans même penser au futur, ce média « alternatif » offre, en complément de médias « classiques », des clefs de lecture intéressantes pour comprendre le présent. A cet égard, l’analyse du traitement médiatique du mouvement des Gilets jaunes réalisé par le Médialab de Sciences Po mérite l’attention. Le Médialab a analysé 70 000 articles de 391 médias sur une période de septembre 2018 à février 2019, et en a tiré cette conclusion : les médias historiques, traditionnels « se sont principalement préoccupés des conséquences du mouvement pour le gouvernement, les partis politiques, et le maintien de l’ordre », alors que « la question des valeurs et des demandes des Gilets jaunes » a été traitée en priorité par les médias alternatifs et/ou nouveaux médias. Or comment comprendre ce mouvement sans se préoccuper en premier lieu (et non en aparté, ou de façon secondaire) de ses demandes et des raisons de son émergence ?

Au fond, une nouvelle étape sera franchie lorsqu’il sera question de Thinkerview dans les médias non plus simplement pour parler de la chaîne en général (ou de la personnalité de son intervieweur), comme cela a été fait ces derniers mois, mais pour apporter des analyses critiques sur le fond de certaines vidéos. Ce sera alors, certes, légitimer la chaîne. Mais au rythme où celle-ci grimpe, est-il vraiment préférable d’essayer de garder une frontière étanche, en faisant comme si ses entretiens n’existaient pas ? La question se posera de plus en plus, à l’heure où une vidéo sur la géopolitique et l’intelligence économique se dirige vers le million de vues sans autre promotion que le bouche-à-oreille. Peut-être verra-t-on ainsi un jour dans un journal comme Le Monde Alain Frachon (éditorialiste international) apporter son éclairage, par exemple, sur l’interview (intéressante) de l’ancien haut fonctionnaire Pierre Conesa sur l’Arabie Saoudite…

– Par Clément Jeanneau

Mise à jour (28/08/2019) : Suite à la publication de l’article, Thinkerview menace d’attaquer pour diffamation, mettant en avant des « petites piques sournoises » pour cause de mentions liées au complotisme. Affaire à suivre.

17.06.2019 à 20:53

Trois erreurs d’analyse à éviter sur la monnaie de Facebook

signauxfaiblesco

Texte intégral (3559 mots)

NB : Cet article a été publié en 2019 et ne tient donc pas compte des évolutions post-2019.

L’annonce par Facebook ce mardi du lancement de sa propre monnaie, le Libra, est largement analysée – à raison – sous l’angle du proto-Etat que devient année après année la création de Mark Zuckerberg.

Si cette évolution vers un « proto-Etat » n’est pas nouvelle – rappelons qu’en 2018 la France avait annoncé que son système d’alerte attentat auprès des citoyens reposerait désormais en partie sur le Safety Check de Facebook, et que l’année précédente le Danemark avait annoncé la création d’un ambassadeur auprès des GAFA – il est évident que l’initiative de battre monnaie, traditionnelle chasse-gardée des Etats, marque une nouvelle étape, historique, dans la trajectoire de Facebook.

Pour autant, cet événement mérite d’être regardé aussi sous un autre angle.

Une bataille se joue sous nos yeux sans qu’elle fasse (encore) les gros titres. C’est l’éléphant dans la pièce.

Quelle sera la monnaie de référence dans l’espace numérique ?

Internet est né et a grandi sans monnaie native.

Dans les années 1990 et encore au début des années 2000, l’idée d’inscrire ses coordonnées de carte bancaire sur un site Internet était vue comme périlleuse, si ce n’est déconseillée. Au fil du temps, l’acte d’acheter sur Internet s’est banalisé, tout comme la gestion de ses comptes bancaires en ligne, notamment les transferts d’argent.

Pour autant, si ces actions s’effectuent bien sur Internet, elles ne consistent qu’en la numérisation de processus existants : la monnaie utilisée en ligne reste celle de la vie de tous les jours (euro, dollar, etc.). Les monnaies de référence sur Internet sont aujourd’hui les monnaies de référence dans le monde physique.

Trente ans après l’invention du web, la création par Facebook de sa propre monnaie numérique pourrait venir bouleverser cette donne. Mais gare aux raccourcis simplificateurs…

Trois erreurs d’analyse à éviter

Face à l’arrivée du Libra, trois erreurs d’analyse doivent être évitées.

1- La première erreur serait de croire que Facebook crée une nouvelle innovation sur un terrain vierge. Le Libra est peut-être inédit dans sa force de frappe, via les milliards d’utilisateurs de Facebook, Whatsapp et Instagram (trois applications que Facebook souhaite fusionner), mais ne l’est pas dans sa nature.

Certes, le Libra se différencie fondamentalement des services de transferts d’argent comme Paypal, puisque le Libra sera, lui, un nouvel actif à part entière (dont le cours sera indexé sur la moyenne d’un panier de devises).

Mais Facebook arrive sur un terrain déjà existant, qui a largement commencé à être labouré.

Il y a dix ans, soit vingt ans après l’invention du web, une monnaie numérique apparaissait : le bitcoin. Ce n’était pas la première tentative en la matière, mais elle est la seule qui a duré. Sa valeur de marché avoisine aujourd’hui les 160 milliards de dollars.

Ne s’agit-il pourtant pas d’une bulle sans fondement, comme on l’a si souvent entendu ? C’est effectivement la thèse d’une large partie des économistes invités à s’exprimer sur le sujet, jusqu’à Jean Tirole, prix Nobel d’économie (même si certains reconnaissent, comme Jean-Marc Daniel, « ne pas maîtriser » le sujet). Une recherche dans les archives de The Economist révèle d’ailleurs que les articles affirmant que « le bitcoin est une bulle sur le point d’éclater » sont publiés par le magazine sans discontinuer depuis près de huit ans– et ce dès 2011, quand celui-ci ne valait que quelques centimes de dollars.

Dix ans après sa création, une grande partie des experts économiques semblent encore réticents à l’idée de creuser, au-delà des poncifs, ce qui fait la spécificité de Bitcoin – malgré les problèmes que cette innovation peut poser par ailleurs. Résumons (très) rapidement : en s’appuyant sur différents mécanismes ayant notamment trait à la cryptographie et la théorie des jeux, le bitcoin constitue un actif rare, programmable, fongible, divisible, transférable à quiconque dans le monde entier en quelques minutes, à faible coût, de façon sécurisée et transparente.

En outre – et c’est son atout fondamental – Bitcoin est dit permissionless.

Ce même principe était au cœur d’Internet avant qu’il ne se retrouve sous la coupe de quelques géants. Comme l’expliquait en 2017 Henri Verdier, désormais ambassadeur de France pour le numérique, « Internet a permis la « permissionless innovation », l’innovation sans autorisation préalable. Ce réseau a permis, depuis des décennies, aux innovateurs de créer et de bousculer le vieux monde économique sans avoir à lui demander de permission préalable ».

Dans le cas du bitcoin, cela signifie deux choses. D’une part, il n’est nul besoin de demander la permission pour en acquérir, en stocker ou en transférer : le bitcoin est ouvert à tout citoyen, partout dans le monde. D’autre part, le caractère ouvert de son protocole permet à tout un chacun de participer à son mécanisme et de créer des applications sans en demander de permission.

Ce caractère « permissionless » est un retour à l’esprit originel d’Internet avant son ultra-concentration entre les mains des GAFA, et un moteur d’innovation particulièrement puissant sur le long terme. Suite à sa création, le bitcoin a d’ailleurs vu en dix ans le nombre de ses concurrents ou alternatives se multiplier. Si la majorité de ces alternatives ne présente pas d’intérêt particulier, certaines ont le mérite de proposer (ou d’avoir tenté) des modèles différents, fondés sur d’autres propositions de valeur.

En résumé, le bitcoin constitue la première véritable monnaie adaptée à l’espace numérique : nativement numérique, mondiale par nature, ouverte à tous, indépendante de toute entreprise ou Etat.

C’est dans ce contexte qu’arrive le Libra, qui constitue un objet numérique tout à fait différent.

2- La deuxième erreur serait de considérer que le Libra est un nouvel avatar du bitcoin.

Le Libra et le bitcoin sont deux monnaies que tout oppose, si ce n’est qu’elles sont toutes deux numériques. Or la distinction entre monnaies traditionnelles d’une part (euro, dollar…) et monnaies numériques d’autre part est obsolète.

Et ce pour trois raisons :

* D’abord parce qu’on peut tout à fait imaginer qu’une monnaie traditionnelle comme l’euro effectue sa « transformation digitale ». La tendance structurelle actuelle mène déjà à une disparition du cash et une « numérisation » toujours plus importante de la monnaie. L’étape suivante, logique, pourrait être la création d’un e-euro (ou équivalent pour les autres monnaies). Cette hypothèse est déjà explorée par une large partie – si ce n’est déjà la majorité – des banques centrales dans le monde. Christine Lagarde, directrice du FMI, a d’ailleurs livré fin 2018 un véritable plaidoyer pour des monnaies numériques émises par les banques centrales.

* Ensuite parce que la monnaie de Facebook sera (du moins pour commencer) un « dérivé » de monnaies traditionnelles : sa valeur sera liée à un panier de devises (dollar, euro, livre sterling, yen…). Facebook ne rompt donc pas avec les monnaies traditionnelles : il crée « simplement » un système fondé sur les monnaies traditionnelles et plus adapté à un espace numérique qui est mondial par nature. Mais son modèle est très différent de celui du bitcoin qui, lui, est né avec son propre système monétaire indépendant, nativement numérique.

* Enfin, et surtout, parce que le Libra a été créé et est contrôlé par une entreprise privée – ou un groupement d’entreprises privées – ce qui est exactement l’inverse du bitcoin.

Et c’est là que réside tout l’enjeu. Bitcoin est un commun ; le Libra est tout l’inverse. Le danger du Libra est que les acteurs qui le contrôlent puissent censurer des transactions, bloquer l’accès à des comptes, se plier aux exigences légitimes ou non de certains gouvernements, et, plus simplement, surveiller les usages des utilisateurs – tout ceci parce que ce contrôle restera centralisé, à l’inverse de la décentralisation de Bitcoin construite « by design ».

Or ce danger n’est pas simplement hypothétique. Comme l’explique l’auteur Andreas Antonopoulos, il est bien évident que Facebook ne jouera pas avec le feu et suivra au pied de la lettre, par exemple, les consignes du Trésor américain de ne pas autoriser tel ou tel transfert d’argent vers des pays, entreprises ou individus considérés comme « ennemis » des Etats-Unis. Ce faisant, le Libra aura de facto certaines frontières, et ne sera donc pas « mondial » ni « ouvert à tous ». Et ce d’autant plus que cette logique s’applique partout dans le monde ; or chaque juridiction a ses propres règles, que Facebook devra respecter. « Facebook fonctionne comme une entreprise sans frontières à de nombreux égards, mais ne pourra pas fonctionner ainsi avec la monnaie : [or il lui sera très compliqué de] respecter les régulations financières pour 2 milliards de clients répartis dans 194 pays » pronostique à raison Antonopoulos.

Qu’une entreprise émette sa propre monnaie n’est donc pas le problème fondamental : cela peut être vu positivement, négativement ou ni l’un ni l’autre selon les appréciations de chacun. Ce phénomène, bien que rare aujourd’hui, est en tout cas loin d’être inédit : au XVIIe siècle, la Compagnie néerlandaise des Indes orientales (connue pour avoir été « l’une des entreprises capitalistes les plus puissantes qui aient jamais existé ») avait par exemple battu monnaie.

Le problème fondamental tient au fait qu’Internet est un bien public et doit le rester. C’est d’ailleurs l’avis qu’exprimait il y a un an et demi Henri Verdier.

Or l’émergence du Libra – ou des futures monnaies numériques créées par d’autres géants – constitue une nouvelle menace à l’égard d’Internet comme bien public (comme l’a été la fin de la neutralité du net aux Etats-Unis ou comme l’est le « jardin fermé » constitué par Apple avec l’App Store sur Iphone). Si le Libra venait à s’imposer comme une monnaie de référence sur Internet – ce qui est loin d’être évident mais ce qui est une hypothèse à considérer tout de même sérieusement -, c’est tout un pan de l’économie numérique qui aura été privatisé. Ce faisant, c’est la liberté propre à l’espace numérique qui se trouvera menacée, tout autant que se renforcera un capitalisme de surveillance toujours plus dangereux.

La question clef : quel Internet voulons-nous ?

Internet a permis à tout un chacun – ce qui a initialement suscité scepticisme et oppositions – de créer, publier, conserver et échanger des contenus nativement numériques sans avoir à en demander la permission. Bitcoin permet à tout un chacun – ce qui suscite aujourd’hui scepticisme et oppositions – d’acquérir, recevoir, conserver, échanger de la valeur nativement numérique, et participer à son mécanisme, sans avoir à en demander la permission.

Bitcoin correspond aux valeurs d’Internet ; plus encore, il en constitue le prolongement naturel.

Mais il s’agit désormais plus que de cela : il s’agit de sauver Internet du virage orwellien que le réseau a pris depuis quelques années.

Bitcoin n’est pas parfait. Il a ses revers. Mais Internet avait les siens, et en a encore aujourd’hui (qu’ils soient originels ou plus récents). Son utilité fondamentale est-elle pour autant être remise en cause ?

3- La troisième erreur serait de se focaliser (uniquement) sur la question d’un éventuel démantèlement de Facebook.

Cette question est importante mais n’est pas la question fondamentale.

Se contenter d’appeler au démantèlement de Facebook ne peut pas être une stratégie gagnante sur le moyen – long terme.

* D’abord parce que l’initiative de Facebook en appelle d’autres. D’autres acteurs du numérique suivront probablement (sauf échec du Libra). Amazon semble face à un boulevard : on aurait d’ailleurs pu imaginer qu’il soit le premier géant technologique à se lancer dans cette aventure tant elle semble taillée pour lui (le e-commerce étant le cœur de son modèle). Au passage, il faut souligner une certaine audace de Facebook (ou plus précisément de Mark Zuckerberg puisque des échos indiquent que la n°2 de Facebook, Sheryl Sandberg, et le CTO du groupe, sont sceptiques sur le projet) : ce projet constitue a priori une prise de risques non-négligeable pour un acteur économique aussi important, puisque les velléités de démantèlement, déjà présentes, ne devraient que se renforcer.

Mais avec la création possible, si ce n’est probable, d’autres monnaies numériques par d’autres entreprises que Facebook, vouloir démanteler chaque géant numérique qui participera à son tour à ce phénomène (…qui pourrait peu à peu se banaliser) est-il réellement une stratégie viable ?

* Ensuite, et surtout, parce que se focaliser sur l’éventuel démantèlement de Facebook revient à se focaliser sur l’arbre qui cache la forêt.

Facebook est le premier géant technologique à faire le pont entre l’économie numérique actuelle – dont il est le représentant phare avec les autres GAFA – et la nouvelle économie numérique qui émerge – dans laquelle il n’avait pas encore mis les pieds.

Cette nouvelle économie numérique repose sur de nouveaux fondements technologiques (cryptomonnaies et nouveaux types de plateformes comme Ethereum) mais aussi économiques (nouveaux modèles) et sociaux (nouvelles formes d’organisations).

Nous sommes au tout début d’un mouvement de fond : en ce sens, l’initiative de Facebook, bien que sa monnaie ne doive pas être considérée comme une véritable cryptomonnaie (elle n’en présente pas les caractéristiques fondamentales : ouverture à tous, caractère mondial, etc.), est un début (l’entrée dans cette nouvelle économie numérique), et non une fin (comme on pourrait le penser en considérant sa monnaie comme le parachèvement de sa « proto-Etatisation »).

En rester à la question du démantèlement ne permet pas de préparer l’avenir : cela permet seulement de (tenter de) protéger le passé. C’est regarder le numérique uniquement sous un prisme défensif, sous l’angle des risques, sans percevoir les opportunités qu’il peut ouvrir. C’est prendre le risque de se condamner à être une nouvelle fois spectateur, et non acteur majeur, d’une grande vague d’innovations, alors même que celle-ci correspond aux valeurs défendues publiquement par nos représentants : Internet comme bien public, l’ouverture à tous, la volonté de limiter le capitalisme de surveillance, etc.

Conclusion

Internet a besoin d’une monnaie mondiale, ouverte à tous, qui ne soit pas contrôlée par un géant privé (ni par un Etat).

Cette monnaie existe déjà. Le cofondateur et PDG de Twitter le dit lui-même : « Internet aura sa monnaie native. Cela ne viendra d’aucun acteur ou institution spécifique, et cela ne sera empêché par aucun acteur ou institution spécifique (…) Je n’ai vu aucune autre monnaie capable de défier Bitcoin à travers toutes ses dimensions. Bitcoin est construit avec les bons principes, les principes d’Internet, c’est-à-dire un monde connecté dans lequel tout le monde peut participer et où tout le monde a un accès égal. »

Dès lors, plutôt que de chercher à faire comme si les cryptomonnaies n’existaient pas (au mieux), ou essayer de les freiner en tentant de créer une éphémère ligne Maginot (au pire), une stratégie plus intelligente serait d’en tirer le meilleur tout en essayant d’en limiter les revers.

Les cryptomonnaies ouvrent la voie à une nouvelle économie numérique, qui fait émerger de nouveaux modèles d’affaire, de nouvelles verticales, de nouveaux champions. De multiples opportunités s’ouvrent pour les entrepreneurs et les pays qui sauront les exploiter suffisamment tôt. Pensons par exemple à la startup française Ledger, reconnue mondialement, qui conçoit des mini coffre-forts pour cryptomonnaies et qui a fait le choix d’industrialiser sa production en France, créant d’ores et déjà des dizaines d’emplois notamment à Vierzon, en Sologne.

Il serait d’autant plus dommageable de ne pas chercher à entrer de plein pied dans cette nouvelle économie numérique que celle-ci a toutes les chances de sortir renforcée suite à l’initiative de Facebook : le Libra ne devrait en effet pas menacer le bitcoin – dont la proposition de valeur est radicalement différente -, mais au contraire légitimer celui-ci et les cryptomonnaies en général, et, par ricochet, favoriser leur développement…précipitant ainsi la nécessité, pour les pays souhaitant faire émerger des écosystèmes leaders sur ce nouveau terrain, d’investir celui-ci sans attendre.

In fine, l’initiative de Facebook ne doit pas mener à un unique réflexe défensif et anti-GAFA, mais servir d’électrochoc pour nous inciter à investir collectivement (acteurs politiques, entreprises, chercheurs, citoyens, entrepreneurs, intellectuels…) cette nouvelle économie, afin de ne pas reproduire la passivité dont nous avons fait preuve par le passé vis-à-vis des actuels géants du numérique.

11.05.2019 à 09:45

Mythes et légendes de l’intelligence artificielle

signauxfaiblesco

Texte intégral (8447 mots)

Que n’a-t-il pas déjà été dit sur l’intelligence artificielle (IA) ? La fascination – ou l’agacement – que suscite l’IA est à la hauteur du buzz médiatique qui a porté le sujet ces dernières années.

A coup de punchlines de certaines personnalités désormais bien connues (« sans politique volontariste en matière d’IA, la France pourrait devenir le Zimbabwe de 2080 »), le sujet est sorti des seules sphères technophiles pour se loger au cœur des discours de nombreux dirigeants d’entreprises, personnalités politiques, philosophes, etc.

NB : Cet article est paru en 2019 et reflétait donc l’état des réflexions d’alors.

Ces phrases chocs ont eu du bon. Elles ont réveillé des décideurs pour certains apathiques face à la montée de la technologie, inconscients de la domination américaine et chinoise et des enjeux sous-jacents de souveraineté. Elles ont servi de déclic pour accélérer la prise de conscience.

Reste pourtant, malgré ce tintamarre (qui n’a rien eu d’artificiel, lui), comme un goût d’inachevé. Le sentiment que l’accumulation de prophéties catastrophistes (« les dirigeants européens sont les Gamelin de l’IA ») a parfois empêché de faire entendre un discours plus nuancé, plus distancié. Que le sensationnalisme l’a trop souvent emporté au détriment d’une réalité scientifique plus prosaïque, forcément moins spectaculaire.

De là le besoin de revenir sur terre. C’est l’objet de cet article.

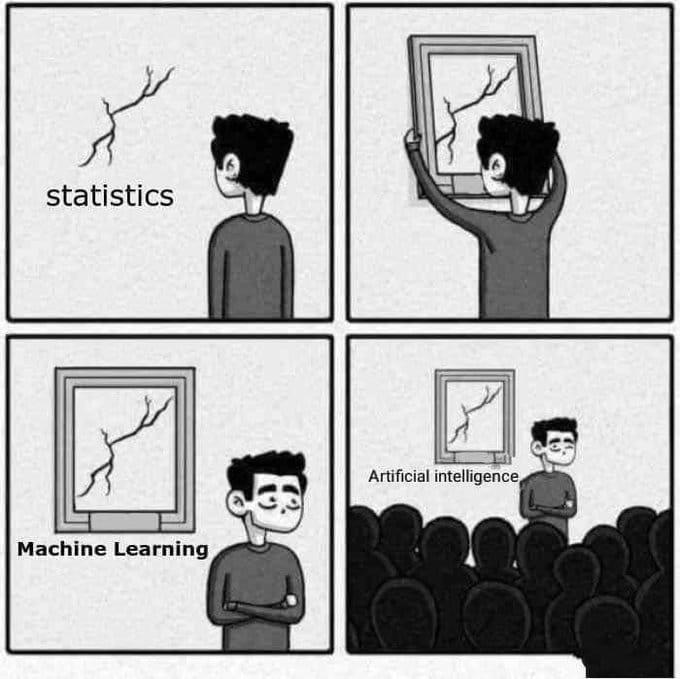

Mythe n°1 : croire qu’il existe UNE intelligence artificielle

L’IA englobe parfois des réalités très différentes. Selon les points de vue et ce que l’on y inclue, elle peut renvoyer aussi bien à des logiques d’automatisation (faire effectuer, par un logiciel, des tâches répétitives et souvent fastidieuses – de là l’essor des « chatbots » par exemple) ou de statistiques. Les statistiques ouvrent la voie au « machine learning » (apprentissage automatique), un sous-domaine de l’IA dont les progrès permettent de réaliser des tâches plus complexes (reconnaissance visuelle et vocale, prévisions, recommandations…). Le machine learning regroupe lui-même plusieurs subdivisions, dont l’apprentissage supervisé et l’apprentissage non-supervisé, et peut mener au fameux « deep learning», qui s’appuie notamment sur les « réseaux de neurones ».

Précisons également que contrairement à certaines idées répandues, l’IA ne se résume pas au machine learning, et que le deep learning n’est pas nécessairement « l’approche ultime » en matière d’IA.

Face à ce jargon, il est facile de s’emmêler les pinceaux ; les différentes notions se retrouvent d’ailleurs parfois mélangées…sciemment. Des outils relativement simples sont parfois présentés comme des solutions d’IA très innovantes, en induisant en erreur sur leur caractère faussement révolutionnaire.

Mythe n°2 : croire que la mention « IA » rime forcément avec innovation

« Il y a cette blague dans Le Bourgeois gentilhomme à propos d’un homme [Monsieur Jourdain] qui apprend que toute parole est soit prose, soit vers, et qui est enchanté de découvrir qu’il a parlé en prose toute sa vie sans en avoir conscience. Les statisticiens pourraient ressentir la même chose aujourd’hui : ils ont travaillé sur « l’intelligence artificielle » toute leur carrière sans en avoir conscience » – Benedict Evans

Certains malins profitent de la méconnaissance entourant ces sujets pour présenter leurs solutions sous un nouveau jour. C’est ainsi que des modèles statistiques utilisés avec un peu d’informatique connaissent parfois un toilettage marketing pour se transformer en outil d’« IA », ce qui sonne plus moderne.

Comme l’écrit le chercheur Thierry Berthier, « l’emploi du mot IA devient un marqueur séparant le discours marketing grand public du discours d’expert pratiquant ». Cette séparation se retrouve par exemple dans cette blague qui a circulé ces derniers mois sur les réseaux sociaux :

Une étude récente indiquait même que 40% des « startups IA » en Europe n’utiliseraient en réalité pas d’IA ! Si ce chiffre a été déconstruit ensuite, la vitesse de sa propagation témoigne d’un sentiment largement partagé autour d’un certain niveau de tartufferie en la matière…

Mythe n°3 : croire que l’IA est une technologie de luxe, accessible à quelques happy few

Une distinction est importante à avoir en tête : « faire de l’IA » est très différent d’ « utiliser de l’IA ». « Très peu de startups créent de nouvelles briques de l’IA » explique ainsi le consultant Olivier Ezratty : « les briques de base de l’IA sont un Lego géant essentiellement disponible en open source. Une bonne part du travail d’aujourd’hui consiste à les choisir et à réaliser un travail d’intégration et d’assemblage ».

L’investisseur Benedict Evans va jusqu’à écrire qu’ « il n’y aura bientôt plus aucune startup « IA ». On parlera plutôt d’entreprises d’analyses de processus industriels, d’entreprises d’optimisation de ventes, d’entreprises d’aide à la résolution de litiges, etc. », toutes rendues possibles grâce à l’IA.

Pour lui, « la diffusion du machine learning signifie des startups très diverses peuvent construire des choses bien plus rapidement qu’avant. Le machine learning doit être vu comme un bloc de construction qui ouvre de nouvelles possibilités et qui sera intégré partout. Si vous ne l’utilisez pas alors que vos concurrents l’utilisent, vous vous ferez distancer. »

Il dresse un parallèle entre le machine learning et le langage de programmation SQL (langage phare pour communiquer avec des bases de données) : « Walmart a connu le succès en partie grâce à l’utilisation de bases de données pour gérer ses stocks et sa logistique plus efficacement. Mais aujourd’hui, si vous créez une entreprise de distribution en annonçant que vous utiliserez des bases de données, cela ne vous rendrait ni différent ni intéressant, car SQL a été intégré partout. La même chose se produira avec le machine learning. »

Dès lors, l’IA ne sera plus forcément un élément différenciant pour une startup. Cette situation commence du reste déjà se manifester : selon Olivier Ezratty, « comme les briques de l’IA sont devenues des commodités, il est de plus en plus difficile de jauger une startup par rapport à ses concurrents. La différence pourra venir de l’IA, mais le plus souvent, elle viendra de la capacité à toucher les bons clients et à déployer rapidement. »

Mythe n°4 : croire que les GAFA deviendront puissants dans tous les domaines grâce aux multiples données dont ils disposent

Pour faire fonctionner une IA de façon performante, les données à exploiter doivent être spécifiques au problème à résoudre ; dès lors, collecter des données n’a d’intérêt que si celles-ci ont bien un lien avec le problème visé.

C’est ce qu’explique Benedict Evans, qui l’illustre par un exemple simple : « D’un côté, General Electric dispose de nombreuses données télémétriques venant de turbines à gaz. De l’autre, Google dispose de nombreuses données de recherche. Or on ne peut pas utiliser des données de turbines pour améliorer des résultats de recherche. On ne peut pas non plus utiliser les données de recherche pour détecter des turbines défectueuses ».

Autrement dit, « le machine learning est une technologie généraliste – elle peut être utilisée aussi bien pour détecter des fraudes que reconnaître des visages – mais les applications qu’elle permet de construire ne sont pas généralistes : elles sont spécifiques à une tâche ».

C’est du reste ce que l’on avait connu lors des précédentes vagues d’automatisation, juge-t-il : « tout comme une machine à laver peut seulement laver des vêtements, et non laver des plats ou cuisiner un repas, et tout comme un programme pour jouer aux échecs ne peut pas remplir votre fiche d’imposition, un système de traduction à base de machine learning ne peut pas reconnaître des chats. »

De ce constat, Benedict Evans tire une conclusion : l’utilisation du machine learning se répartira de façon large. « Google n’aura pas « toutes les données » : Google aura toutes les données obtenues via les services Google. Google aura des résultats de recherche plus fins, General Electric aura des machines plus performantes, Vodafone aura une meilleure vue sur la gestion de son réseau, etc. »

En définitive, « Google sera meilleur à être Google, mais cela ne veut pas dire que Google deviendra meilleur à autre chose. »

Mythe n°5 : croire que l’IA est aujourd’hui souvent intelligente

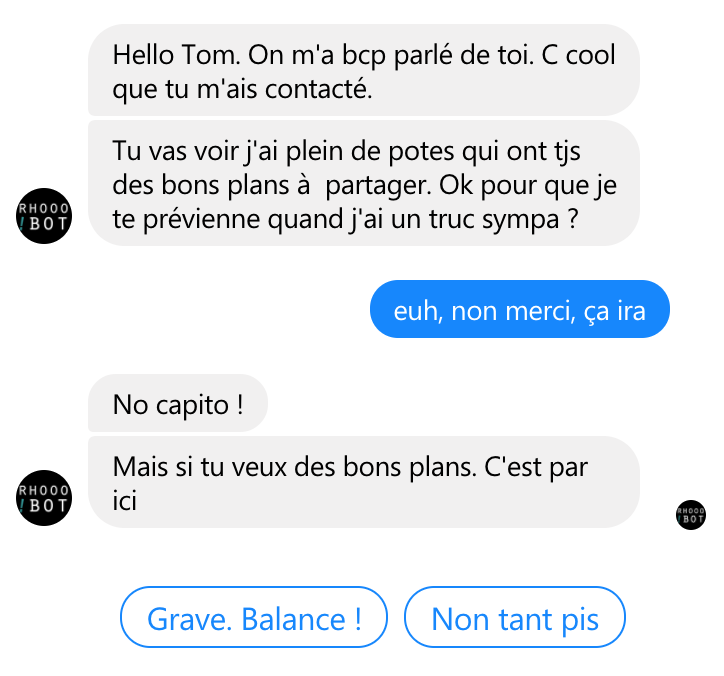

Qui n’a pas déjà vécu des échanges particulièrement laborieux (pour ne pas dire pénibles) avec des chatbots ou des agents conversationnels ?

Chacun aura noté que ces outils disposent encore d’une (très) large marge de progression avant de pouvoir soutenir une conversation décente. L’échange ci-dessous en est un exemple criant :

Les chatbots ne sont certes pas représentatifs des avancées de l’IA aujourd’hui. Mais s’il est évident que l’IA est d’ores et déjà capable de performances impressionnantes (cf ses victoires au jeu de go, aux échecs, ou encore au jeu Starcraft), soyons clairs : une IA brillante dans un contexte donné ne l’est pas forcément dans d’autres contextes – et ne l’est même souvent pas.

Il y a quelques semaines, on apprenait ainsi que l’IA de DeepMind (appartenant à Google), célèbre pour ses prouesses au jeu de go, avait largement raté un contrôle de mathématiques destiné à des adolescents de 16 ans dans le cursus scolaire britannique. Son score : 14 sur 40, soit la note E dans le système britannique. Elle n’a pas réussi à transformer les mots en calcul et en équation, alors qu’elle avait pourtant été entraînée sur le sujet.

Au-delà de cette anecdote, les exemples de « déraillement » d’IA sont multiples. On se souvient notamment du robot conversationnel mis en ligne par Microsoft en 2016 qui s’était transformé en quelques heures en personnage machiste, raciste et néo-nazi, sous l’influence d’internautes.

Un an auparavant, la reconnaissance faciale de l’application Photos de Google avait assimilé un couple afro-américain à des gorilles. Le site Wired a révélé fin 2018 que Google, après s’être déclaré « consterné » et après avoir promis de remédier au problème, avait en réalité choisi ensuite de…supprimer les gorilles et d’autres primates (chimpanzés, singes…) du lexique de son service. Comme l’écrit Wired, « cette solution de contournement illustre les difficultés rencontrées par Google et d’autres entreprises technologiques pour faire progresser la reconnaissance d’image ».

Le cas emblématique de Watson

Le système Watson d’IBM était annoncé à ses débuts comme capable de révolutionner la médecine : son IA allait être capable de détecter des maladies plus rapidement, de proposer des traitements plus adaptés, etc. En 2018, le couperet tombe : selon des documents internes révélés par le site StatNews, des spécialistes ont identifié de « multiples exemples de recommandations de traitements de cancers dangereux et incorrects » effectuées par Watson. Malgré des milliards investis, Watson reste très peu performant par rapport aux ambitions affichées.

Par exemple, comme nous l’apprend une grande enquête récente intitulée « How IBM overpromised and underdelivered with Watson Health », « il s’est avéré impossible d’enseigner à Watson comment lire des articles scientifiques comme un médecin le ferait. Le fonctionnement de Watson est fondé sur les statistiques : tout ce qu’il peut faire est de rassembler des statistiques sur les principaux résultats. Mais ce n’est pas comme ça que les médecins travaillent. »

Les chercheurs ont ainsi découvert que Watson peinait à exploiter de façon autonome des informations publiées très récemment dans la littérature médicale. De même, Watson s’est avéré avoir plus de mal que prévu à récupérer des informations contenues dans les dossiers médicaux électroniques.

In fine, « il ne suffit pas de prouver que vous disposez d’une technologie puissante » déclare Martin Kohn, un ancien scientifique médical d’IBM. « Il faut prouver qu’elle va réellement faire quelque chose d’utile – que ça va améliorer ma vie, et celle de mes patients. » Or selon lui, « à date il existe très peu de publications » scientifiques qui prouvent le bénéfice de l’IA pour les médecins. « Et aucune s’agissant de Watson ».

***

« L’intelligence artificielle est devenue un gros business et il est très probable qu’il y ait un retour de bâton quand les promesses les plus extravagantes ne seront pas remplies » Yann Le Cun, directeur du laboratoire IA de Facebook, en 2017

Face à cette réalité crue, qui ne correspond pas toujours aux promesses (sur)vendues, certaines entreprises s’adaptent…et innovent dans leur manière de communiquer ! En la matière, la palme revient sans aucun doute à l’organisation OpenAI (notamment soutenue par Elon Musk) : OpenAI a laissé diffuser l’idée selon laquelle elle aurait préféré ne pas sortir son IA publiquement car celle-ci serait trop…dangereuse ! Le sociologue Antonio Casilli résume bien ci-dessous avec humour ce qui semble plus probable…

De fait, après vérification, les résultats d’OpenAI se révèlent effectivement « moins bons que ceux des IA spécialisées obtenues par apprentissage supervisé », selon Laurent Besacier, professeur au laboratoire d’informatique de Grenoble…

Mythe n°6 : croire que l’IA peut fonctionner sans intervention humaine

Dans son récent ouvrage « En attendant les robots : enquête sur le travail du clic », Antonio Casilli montre que le grand remplacement des hommes par les robots est un fantasme, en mettant en lumière une face cachée de l’IA : l’existence de millions de « travailleurs du clic » invisibilisés, précarisés, payés à la micro-tâche pour éduquer des algorithmes.

Antonio Casilli cite par exemple le scandale ayant touché fin 2017 l’entreprise américaine Expensify, spécialisée dans la gestion par l’IA de la comptabilité d’autres entreprises. En apparence, « les salariés de ces entreprises n’avaient qu’à photographier leurs factures et leurs reçus, et l’application les organisait en notes de frais. On a découvert que des personnes recrutées sur la plateforme de micro-travail Amazon Mechanical Turk transcrivaient et labellisaient en temps réel une partie de ces factures. »

Cet exemple n’est pas isolé. En réalité, « il y a toujours une part d’algorithmes et une part de travail humain ». Pour concevoir son programme Watson, IBM a ainsi recouru à 200 000 micro-travailleurs qui devaient notamment ordonner les différents éléments de l’image d’un paysage (nuages, montagnes, etc.).

Casilli souligne une hypocrisie du milieu technologique, où il perçoit « une attitude double. Tout le monde connaît l’existence des plateformes de micro-travail et comprend l’exigence d’impliquer des humains dans l’étiquetage et le nettoyage de l’information. En même temps, il y a une espèce d’effort cognitif pour ne pas voir ce qu’on sait pertinemment. »

Lorsqu’il est reconnu, ce travail humain est fréquemment minoré, à tort : « cette partie du processus est décrédibilisée en tant que travail : on imagine que les micro-tâches qu’accomplissent les travailleurs du clic ont une faible valeur ajoutée, qu’elles ne sont pas centrales ; or leur contribution est cruciale. »

Une équipe de recherche du CNRS, Télécom ParisTech et MSH Paris-Saclay, dans laquelle fait partie Antonio Casilli, a du reste montré que les plateformes paient en France métropolitaine 266 000 personnes pour micro-travailler (avec une rémunération par micro-tâche de quelques dizaines de centimes d’euro). Dans le monde, ces « poinçonneurs de l’IA » comme les appelle Casilli, seraient entre 40 millions et…des centaines de millions, constituant ainsi une nouvelle division du travail au niveau mondial. Leur rémunération peut descendre jusqu’à 0,000001 centime la tâche, sans accès aux droits de protection des travailleurs salariés.

Casilli est formel : l’IA ne pourra pas devenir assez développée pour se passer des micro-tâches. « Il n’y aura pas d’automatisation complète. Les machines que les ingénieurs de l’IA sont en train de développer n’ont pas vocation à travailler toute seule : [elles] prévoient toujours la réalisation de tâches par les humains. »

Mythe n°7 : croire que le « machine learning » et le « deep learning » ont plié le match en matière d’IA

Début 2019, la chercheuse en statistique Genevera Allen jetait un froid lors du congrès annuel de l’Association américaine pour l’avancement de la science : « Je ne ferais pas confiance à une très grande partie des découvertes [médicales] en cours ayant recours à du machine learning appliqué à de grands ensembles de données ».

« Ces algorithmes sont entrainés pour détecter des « patterns » quoi qu’il arrive », explique-t-elle. « Ils ne reviennent jamais avec « je ne sais pas « ou « je n’ai rien découvert » : ils ne sont pas conçus pour cela. »

Le machine learning entraîne de ce fait une crise de reproductibilité des découvertes, estime-t-elle. Quand le machine learning établit un lien entre les gènes de certains patients et leur maladie, les chercheurs peuvent ensuite rationaliser scientifiquement leur découverte sans que cette rationalisation soit correcte. « On peut toujours construire une histoire [a posteriori] pour montrer pourquoi des gènes donnés sont regroupés ensemble » explique Dr Allen.

Ce problème de reproductibilité risque de mener les scientifiques vers de fausses pistes (voire des résultats incorrects) et gaspiller des ressources (en essayant de confirmer des résultats impossibles à reproduire). La mise en garde de Genevera Allen a permis de (re)mettre en lumière ce problème. Pour le surmonter, en attendant l’émergence d’une nouvelle génération d’algorithmes à même d’évaluer la fiabilité de leurs résultats, les chercheurs doivent s’assurer eux-mêmes de la reproductibilité de leurs expériences.

***

Cette invitation à la prudence autour du machine learning n’est pas isolée.

Les exemples ne manquent pas pour souligner les problèmes liés plus particulièrement au deep learning. En 2016, une étude s’est penchée sur le succès – proche de 100% – d’une IA qui avait été entraînée pour distinguer les chiens et les loups sur des images données. Il s’est avéré que l’algorithme se fondait avant tout sur…la couleur de fond des images : il y cherchait de la neige car les images de loups sur lesquelles il avait été entraîné comportait souvent de la neige en fond.

Dans le même ordre d’idées, des chercheurs nord-américains se sont rendus compte en 2018 qu’en ajoutant un éléphant dans certaines images, en fonction de son emplacement, le système ne le voyait pas…ou bien le prenait pour une chaise !

Bien d’autres exemples pourraient être cités (en 2017, des chercheurs japonais ont montré qu’en changeant un seul pixel d’une image de chien blanc, l’IA se mettait à y voir une autruche). Tous soulignent la même chose : ces algorithmes parviennent à des résultats sans comprendre ce qu’ils font. Ils peuvent être performants pour certaines tâches de perception (encore qu’il suffit donc parfois d’un changement de pixel pour les tromper), mais butent sur les tâches de raisonnement.

Le succès de l’IA d’AlphaGo (appartenant à Google), premier programme informatique à avoir battu l’humain au go, semble d’ailleurs être à l’origine d’un malentendu. AlphaGo a brillé en s’appuyant sur une IA non-supervisée, reposant sur du deep learning, pouvant donner l’impression que cette approche était intrinsèquement supérieure aux autres. En réalité, cette approche était plus simplement la plus pertinente pour le jeu de go, dont les règles sont particulièrement structurées et logiques. Or ce contexte très spécifique est loin de se retrouver souvent ailleurs, en particulier lorsqu’il s’agit d’activités humaines.

« Un énorme problème à l’horizon est de doter les programmes d’IA de bon sens : même les petits enfants en ont, mais aucun programme de deep learning n’en a », estime le spécialiste américain Oren Etzioni.

In fine, les algorithmes de deep learning « n’apprennent que des indices superficiels, et non des concepts », diagnostique le chercheur Yoshua Bengio, justement l’un des pères fondateurs du deep learning.

Or ces problèmes relèvent de traits inhérents à ces systèmes, et non de bugs…

***

Dans ce contexte de (re)questionnement autour du deep learning, de plus en plus de voix plaident pour élargir les méthodes de recherche utilisées en IA. Ironie de l’Histoire : les regards se tournent vers l’IA dite symbolique (l’enchaînement de règles explicites pour construire un raisonnement), approche historique autrefois reine mais qui était tombée en désuétude avec l’émergence du machine learning.

L’enjeu est aujourd’hui de réussir à exploiter l’apprentissage statistique (ce dont le machine learning relève) et les méthodes symboliques de façon combinée. Les questionnements restent entiers sur les façons de procéder, mais des expérimentations ont commencé.

Antoine Bordes, directeur du laboratoire d’IA de Facebook, entend ainsi dépasser les limites du machine learning dans le langage (en particulier en compréhension de texte, où le machine learning est très peu performant) en « créant des architectures qui peuvent être entraînées sur des données mais qui s’appuient sur le symbolique ».

« La prochaine génération d’IA aura une architecture hybride » confirme la chercheuse Véronique Ventos, qui a cofondé le laboratoire privé NukkAI avec un (premier) objectif : créer une IA capable de briller au Bridge (jeu qui y résiste encore)…

Une opportunité pour l’Europe ?

Dans une tribune parue en mars 2019, Virginia Dignum, professeur d’informatique à l’université d’Umeå en Suède, appelle l’Europe à « explorer des alternatives » au machine learning :

« Il y a peu, une étude ayant analysé 25 ans de recherche en IA a conclu que l’ère du deep learning touche à sa fin. L’Europe a traditionnellement été forte sur les approches symboliques de l’IA. Dès lors, ce serait une erreur de suivre aveuglement les US et la Chine dans leur « course » au machine learning alors que nous avons l’opportunité de montrer la valeur d’approches alternatives, dans lesquelles nous Européens pourrions avoir un avantage. »

Ces réflexions mériteraient d’être plus écoutées en France. Comme l’écrit Olivier Ezratty, « le rapport de la Mission Villani fait la part belle au deep learning. L’approche symbolique semble y être mise en sourdine. (…) De même, l’IA symbolique est assez maigrement représentée dans la feuille de route de l’INRIA de 2016. (…) Pourtant, en prenant du recul, on peut se demander si l’enjeu n’est que dans le deep learning »…

Mythe n°8 : croire que l’IA peut dépasser l’intelligence humaine de façon générale

La thèse de la singularité, selon laquelle l’IA sera capable de dépasser l’intelligence humaine au cours des toutes prochaines décennies, continue étonnamment d’être considérée par certains comme une hypothèse crédible, malgré de multiples remises en cause de la part de spécialistes :

-Jean Ponce, chercheur en vision artificielle à l’ENS, en avril 2017 : « La Singularité, ça m’énerve. Je ne vois personnellement aucun indice que la machine intelligente soit plus proche de nous aujourd’hui qu’avant ».

–Jean-Louis Dessalles, chercheur en intelligence artificielle et en sciences cognitives, auteur de l’ouvrage « Des intelligences très artificielles », en février 2019 : « La question de la Singularité technologique ressemble à celle de la surpopulation sur Mars : on ne peut exclure que le problème se pose un jour, mais ce n’est pas demain ».

-Luc Julia, vice-président de l’innovation chez Samsung, inventeur de l’assistant vocal d’Apple, en mars 2019 : « Notre vision menaçante de l’intelligence des machines découle en partie de notre anthropomorphisme. Ces assistants ne sont que des mathématiques et des statistiques, ils répondent à des règles édictées en amont. Jamais une IA ne sera aussi intelligente qu’un humain ».

Comment comprendre, dès lors, la permanence de la thèse de la Singularité ? Dans son ouvrage « Le mythe de la Singularité – faut-il craindre l’intelligence artificielle ? » paru en 2017, l’informaticien et philosophe Jean-Gabriel Ganascia tente d’apporter une explication. Selon lui, cette thèse est avant tout défendue par des ingénieurs travaillant, en large partie, pour des géants technologiques et ayant l’impression, réelle ou exagérée, de changer le monde. Il parle d’un « sentiment de vertige » et de puissance chez ces ingénieurs qui en viennent à surestimer la capacité des géants du numérique à bouleverser les réalités existantes et l’humanité. Ce sentiment est accentué par le fait que ces entreprises ont réussi en très peu de temps – quelques années, contre plusieurs décennies pour les entreprises traditionnelles – à devenir des géants économiques. Il estime qu’il existe donc des prédispositions chez ces ingénieurs à croire les thèses de la Singularité.

A cette prédisposition se rajoute une forme de complaisance liée à l’envie de « se faire peur face à la technologie » : cette complaisance, juge-t-il, est véhiculée par certains médias qui préfèrent le spectaculaire à la réalité plus prosaïque et…scientifique. Il prend ainsi l’exemple de l’idée selon laquelle il deviendra un jour possible de télécharger son propre esprit sur une machine afin de rendre son esprit immortel. Cette idée, portée notamment par un milliardaire russe ayant initié le projet 2045.com (qui, à son lancement, invitait l’internaute à appuyer sur un “bouton d’immortalité”), ne repose sur aucun fondement scientifique, et a pourtant été amplement médiatisée, contribuant ainsi à véhiculer les peurs et inquiétudes liées à l’IA.

Enfin, Ganascia relève le fait que ces craintes remontent bien avant l’invention d’Internet et avant même l’arrivée des ordinateurs. Il prend ainsi l’exemple d’une scène du film Fantasia, sorti en 1940, où plusieurs balais commencent à s’animer et à porter des seaux d’eau à la place du personnage principal. “Cette inquiétude-là, d’être dépassé un jour, me semble ancrée dans le cœur de l’homme. C’est pour cela que l’idée de Singularité est assez populaire” juge-t-il.

***

Pour autant, si de nombreuses voix ont remis en cause la Singularité, peu d’entre elles se sont attelées à déconstruire cette thèse méthodiquement.

C’est en cela que le long article intitulé « Le mythe de l’intelligence artificielle super-humaine », écrit par l’auteur américain Kevin Kelly en 2017, est particulièrement précieux.

Dans cet article, il montre que croire que l’IA peut être plus intelligente que l’homme relève d’une mauvaise compréhension de ce qu’est l’intelligence.

Selon les défenseurs de la Singularité, comme Nick Bostrom, il existerait une échelle de l’intelligence, comme il existe une échelle des niveaux sonores en décibels. Dans ce paradigme, il est envisageable de penser une extension de l’intelligence qui ne ferait que croître, étape par étape, et in fine dépasserait notre propre intelligence.

Or la réalité scientifique s’oppose à la vision simpliste d’une intelligence à une seule dimension qui augmenterait de façon linéaire.